n8n

Integra FlowHunt con n8n per automatizzare i flussi di lavoro, gestire le esecuzioni e semplificare le operazioni aziendali utilizzando comandi in linguaggio na...

Integra FlowHunt con la potente automazione dei workflow di n8n utilizzando il server n8n MCP. Permetti ai tuoi agenti AI di avviare, monitorare e gestire workflow in modo programmatico per un’automazione senza interruzioni.

FlowHunt fornisce un livello di sicurezza aggiuntivo tra i tuoi sistemi interni e gli strumenti AI, dandoti controllo granulare su quali strumenti sono accessibili dai tuoi server MCP. I server MCP ospitati nella nostra infrastruttura possono essere integrati perfettamente con il chatbot di FlowHunt così come con le piattaforme AI popolari come ChatGPT, Claude e vari editor AI.

Il server n8n MCP è un server Model Context Protocol (MCP) che consente una perfetta integrazione tra assistenti AI e la piattaforma di automazione n8n tramite la sua API. Agendo da ponte, il server n8n MCP permette ad agenti AI e modelli linguistici di grandi dimensioni (LLM) di interagire con workflow esterni, automatizzare compiti e interrogare o avviare automazioni in tempo reale. Questo migliora i workflow di sviluppo permettendo agli sviluppatori di svolgere azioni come la gestione dei workflow n8n, il recupero della cronologia delle esecuzioni e l’interazione programmatica con le risorse n8n. Di conseguenza, il server n8n MCP semplifica il processo di connessione degli agenti AI a potenti capacità di automazione, rendendo più semplice costruire soluzioni sofisticate e automatizzate che sfruttano sia l’AI che l’automazione dei workflow.

Nessuna informazione sui template di prompt è stata trovata nel repository.

Nessuna risorsa MCP esplicita è stata confermata dai file del repository.

Nessun elenco diretto di strumenti MCP è stato trovato nel codice o nella documentazione disponibile.

mcpServers con il seguente snippet JSON:{

"n8n-mcp-server": {

"command": "npx",

"args": ["@n8n/mcp-server@latest"]

}

}

Conserva le API key sensibili utilizzando variabili d’ambiente. Esempio:

{

"env": {

"N8N_API_KEY": "la_tua_api_key_qui"

},

"inputs": {

"apiKey": "${env.N8N_API_KEY}"

}

}

mcpServers:{

"n8n-mcp-server": {

"command": "npx",

"args": ["@n8n/mcp-server@latest"]

}

}

{

"mcpServers": {

"n8n-mcp-server": {

"command": "npx",

"args": ["@n8n/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"n8n-mcp-server": {

"command": "npx",

"args": ["@n8n/mcp-server@latest"]

}

}

}

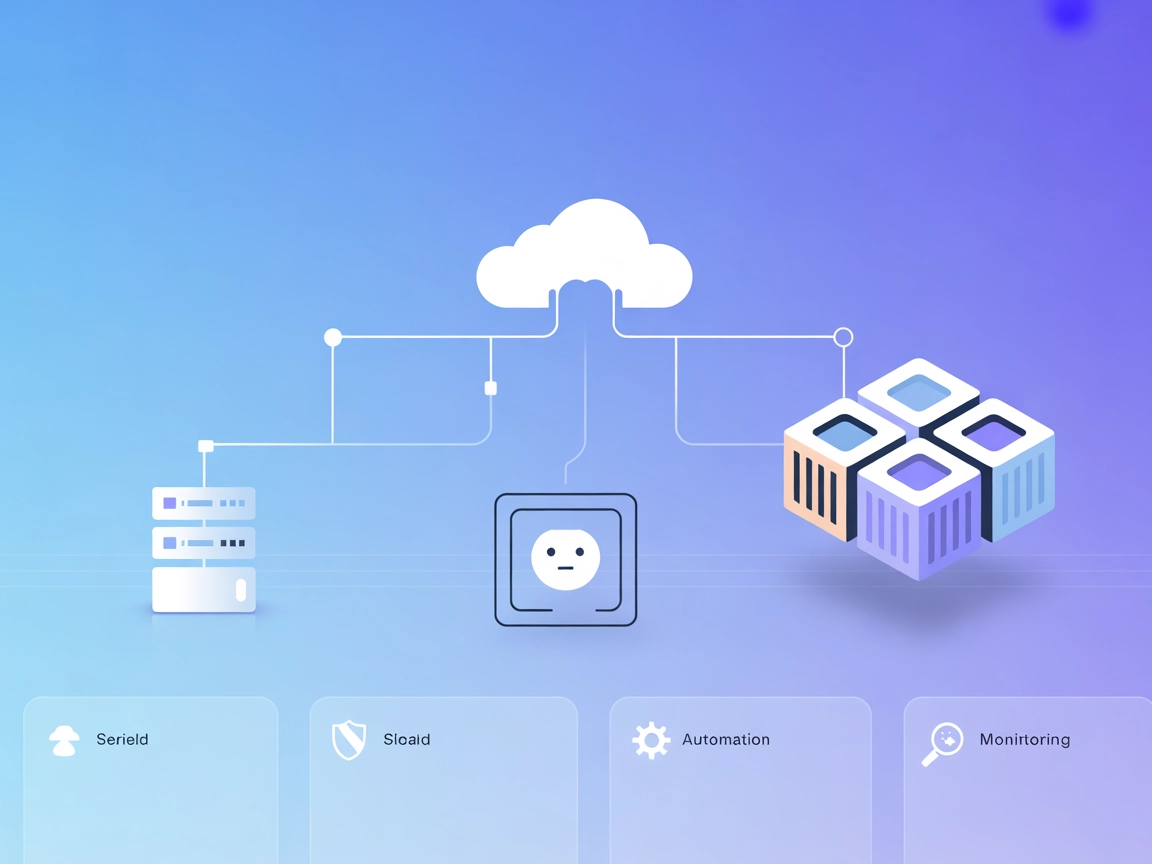

Utilizzo di MCP in FlowHunt

Per integrare i server MCP nel tuo workflow FlowHunt, inizia aggiungendo il componente MCP al tuo flow e collegandolo al tuo agente AI:

Clicca sul componente MCP per aprire il pannello di configurazione. Nella sezione della configurazione MCP di sistema, inserisci i dettagli del tuo server MCP utilizzando questo formato JSON:

{

"n8n-mcp-server": {

"transport": "streamable_http",

"url": "https://iltuomcpserver.esempio/percorsoalmcp/url"

}

}

Una volta configurato, l’agente AI sarà in grado di utilizzare questo MCP come strumento con accesso a tutte le sue funzioni e capacità. Ricordati di cambiare “n8n-mcp-server” con il nome effettivo del tuo server MCP e sostituire l’URL con quello del tuo server MCP.

| Sezione | Disponibilità | Dettagli/Note |

|---|---|---|

| Panoramica | ✅ | Panoramica trovata nel repo e nel README |

| Elenco dei Prompt | ⛔ | Nessun template prompt trovato |

| Elenco delle Risorse | ⛔ | Nessuna risorsa MCP documentata |

| Elenco degli Strumenti | ⛔ | Nessun elenco diretto di strumenti MCP |

| Protezione delle API Key | ✅ | .env.example presente; guida all’uso delle env |

| Supporto Sampling (meno importante in valutazione) | ⛔ | Nessuna menzione esplicita |

In base alle informazioni disponibili, il server n8n MCP fornisce un ponte fondamentale per l’automazione ma manca di documentazione dettagliata su prompt, risorse e strumenti all’interno del repository. Copre bene la configurazione e l’utilizzo core, ma potrebbe beneficiare di una documentazione ampliata per una maggiore adozione.

| Ha una LICENSE | ✅ (MIT) |

|---|---|

| Ha almeno uno strumento | ⛔ |

| Numero di Fork | 84 |

| Numero di Stelle | 483 |

Valutazione:

Sulla base delle due tabelle, valuterei questo server MCP 5/10. Ha configurazione core, licenza e un caso d’uso chiaro, ma manca di documentazione su strumenti MCP reali, risorse e template di prompt che sono essenziali per una maggiore utilità e adozione.

Connetti i tuoi assistenti AI al motore di automazione di n8n tramite FlowHunt. Semplifica la gestione dei workflow e l'automazione con pochi clic.

Integra FlowHunt con n8n per automatizzare i flussi di lavoro, gestire le esecuzioni e semplificare le operazioni aziendali utilizzando comandi in linguaggio na...

Il server MCP mcp-k8s-go consente agli assistenti AI di interagire in modo programmatico con i cluster Kubernetes tramite il Model Context Protocol, automatizza...

Il server MCP k8s-multicluster-mcp offre una gestione centralizzata e senza interruzioni di più cluster Kubernetes tramite un'API standardizzata, supportando op...

Consenso Cookie

Usiamo i cookie per migliorare la tua esperienza di navigazione e analizzare il nostro traffico. See our privacy policy.