FlowHuntのオブザーバビリティをPowerBIで実現

FlowHuntをPowerBIと連携し、オブザーバビリティ設定を構成し、FlowHuntワークスペースの指標をPowerBIダッシュボードで直接可視化する方法を解説します。...

この記事では、FlowHuntとLangfuseを接続し、包括的なオブザーバビリティを実現する方法、AIワークフローのパフォーマンスをトレースする方法、Langfuseダッシュボードを活用してFlowHuntワークスペースを監視・最適化する方法を解説します。

FlowHuntでAIワークフローが拡大するにつれ、裏側で何が起きているのかを理解することが重要になります。「このワークフローが遅いのはなぜ?」「どれだけトークンを消費している?」「どこでエラーが起きている?」などの疑問に答えるには、システムの詳細な可視化が欠かせません。

適切なオブザーバビリティ(可観測性)がなければ、AIワークフローのデバッグは手探り状態になり、結果は見えてもその過程が見えません。Langfuseのようなトレーシングツールは、ワークフロー実行の全ステップを記録し、パフォーマンスやコスト、挙動をきめ細かく把握できます。

この記事では、FlowHuntとLangfuseをシームレスに連携し、すべてのAIワークフローで包括的なオブザーバビリティを実現する方法を解説します。実行経路のトレース、トークン使用量の監視、ボトルネックの特定、パフォーマンス指標の可視化を—すべて一元ダッシュボードで可能にします。

読み終わる頃には、FlowHuntワークスペースの全貌が見えるようになり、ワークフローの最適化、コスト削減、信頼性向上の手段が手に入ります。

**オブザーバビリティ(可観測性)**とは、トレース、メトリクス、ログといった外部出力を通じてシステム内部の状態を把握するための仕組みです。

AI搭載ワークフローを運用するFlowHuntユーザーにとって、オブザーバビリティは以下の可視化をもたらします:

オブザーバビリティがなければ、問題の診断は後手に回り、手間もかかります。備えておくことで、継続的な最適化や迅速なトラブルシューティングが可能になります。

Langfuseは、LLMアプリケーション向けに特化して開発されたオープンソースのオブザーバビリティ&アナリティクスプラットフォームです。AIワークフロー実行の詳細なトレースを記録し、開発者やチームにデバッグ・監視・最適化のためのインサイトを提供します。

Langfuseの主な特徴:

LangfuseをFlowHuntに接続することで、実行データがインテリジェンスに変わり、「何がうまくいき、何が課題か、どこを最適化すべきか」が明確になります。

この記事の手順を通じて、以下が実現できます:

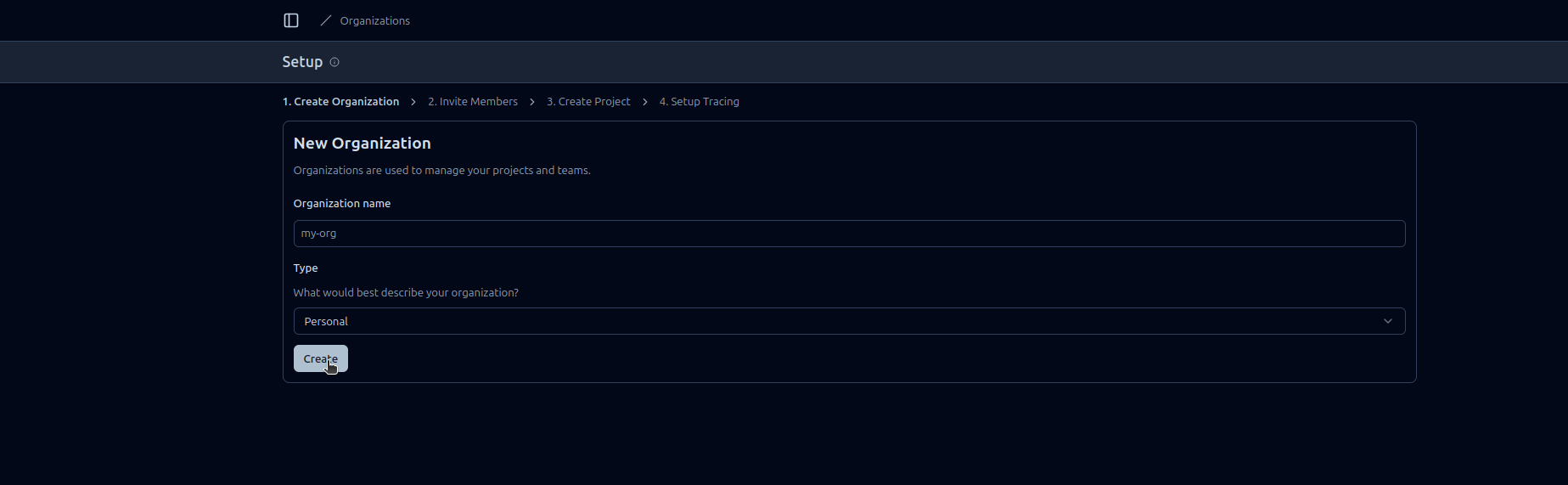

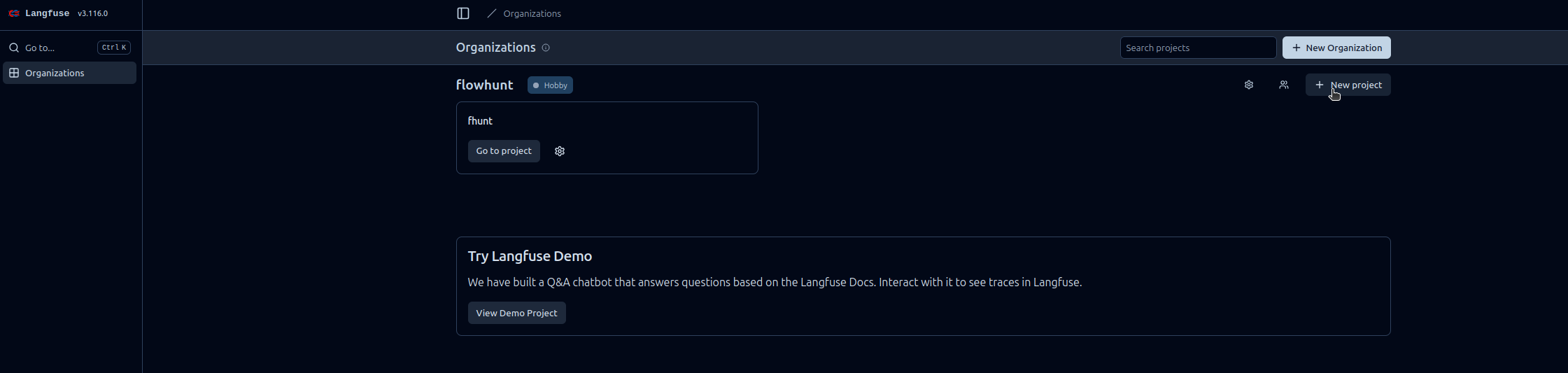

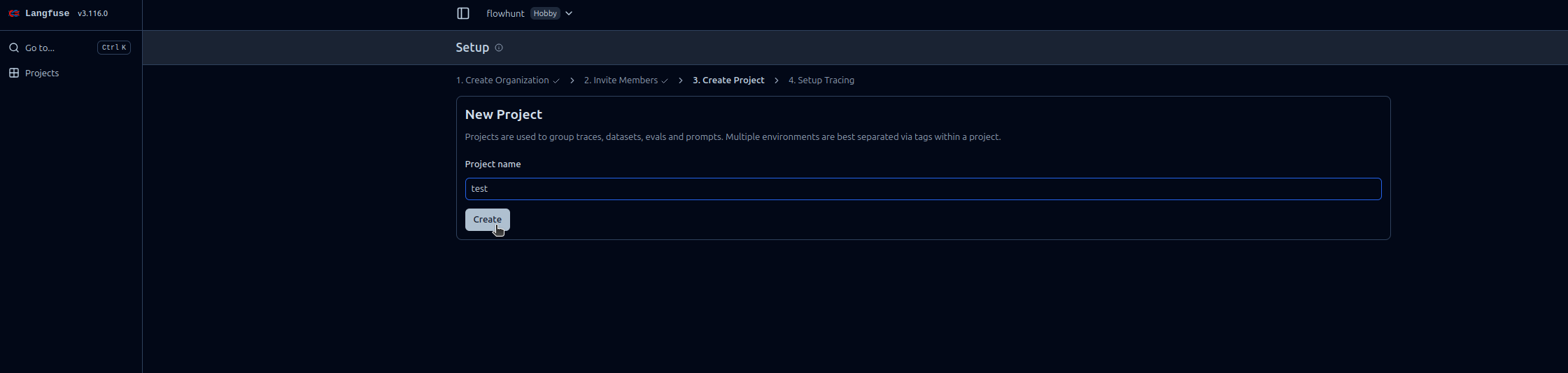

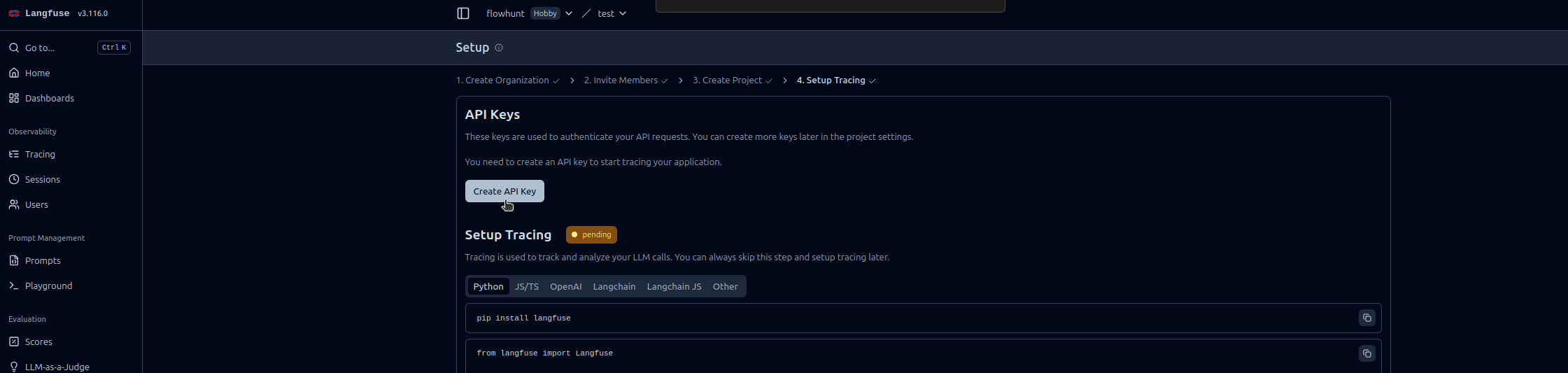

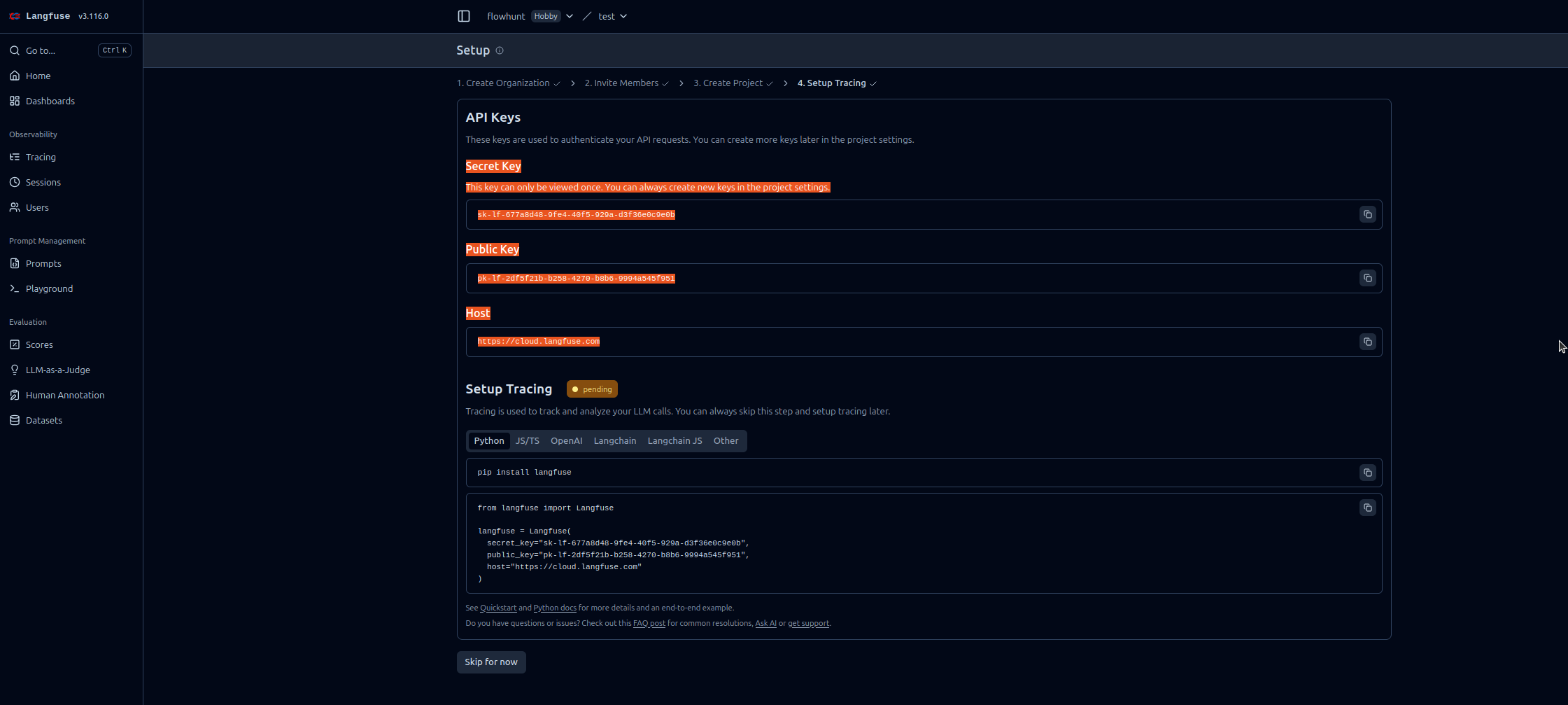

FlowHuntのLangfuseオブザーバビリティを有効化するため、以下の手順に従ってください。

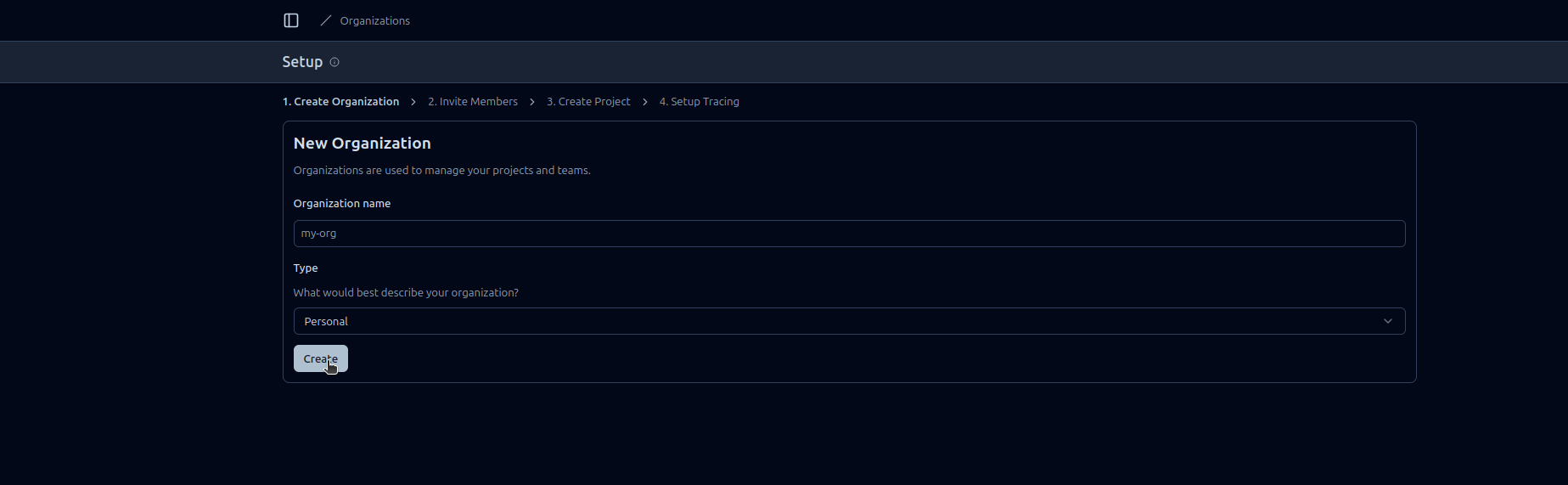

https://cloud.langfuse.com)

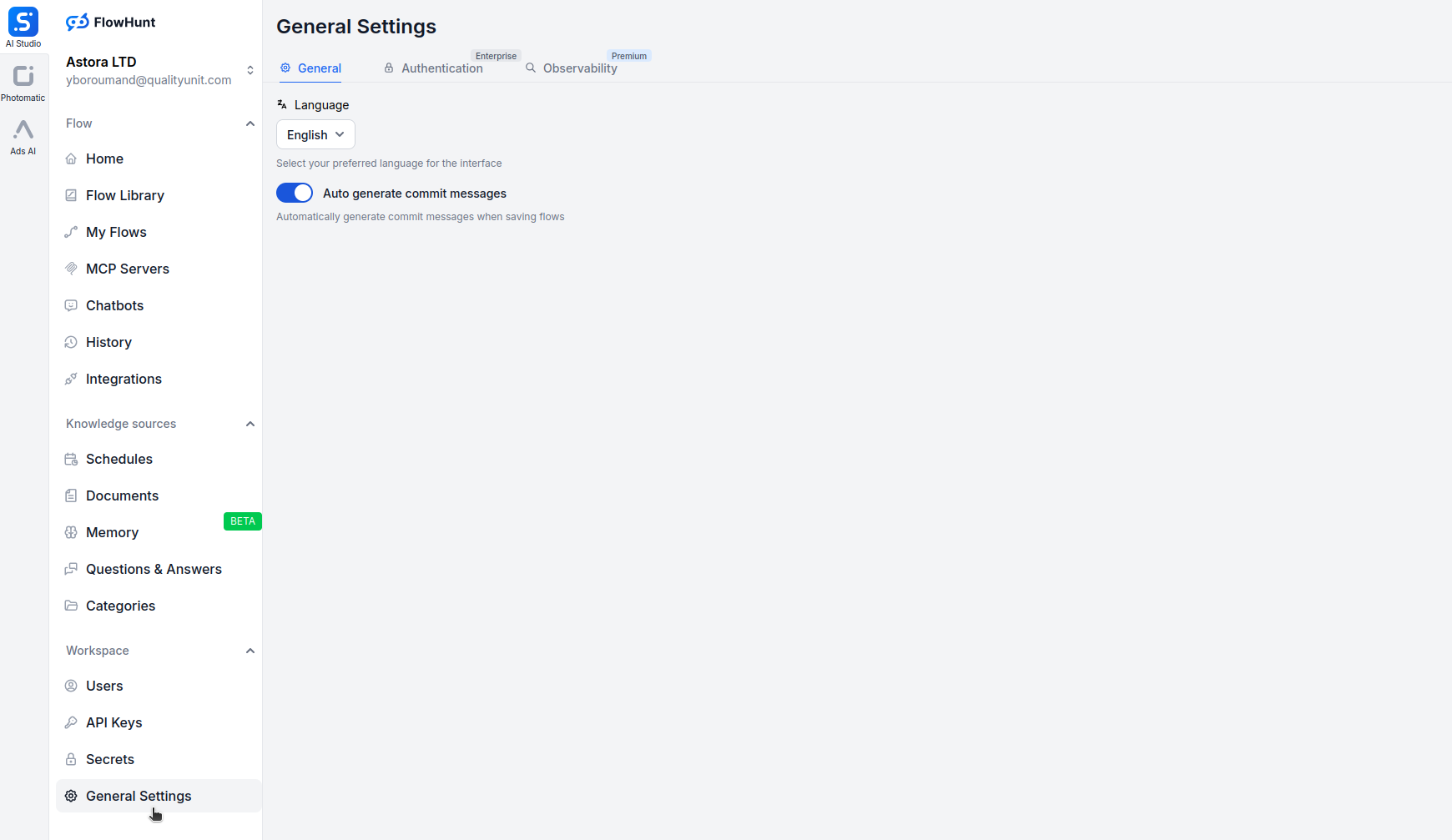

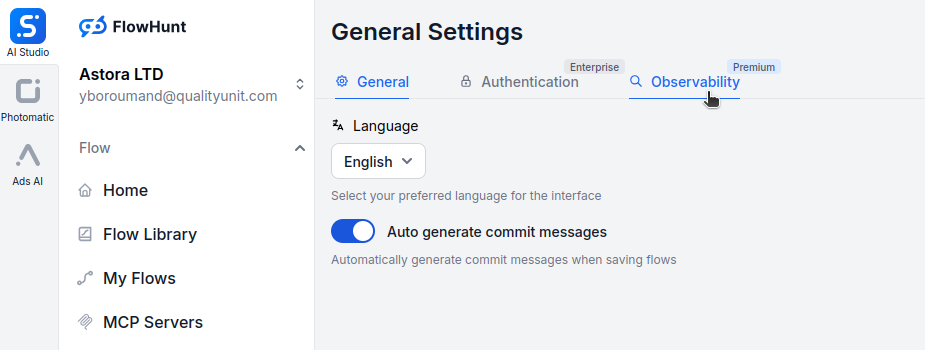

ブラウザで app.flowhunt.io を開きます。

**一般設定(General Settings)**へ移動します(サイドバーや上部メニューからアクセス可能)。

画面下部までスクロールし、オブザーバビリティタブをクリックします。

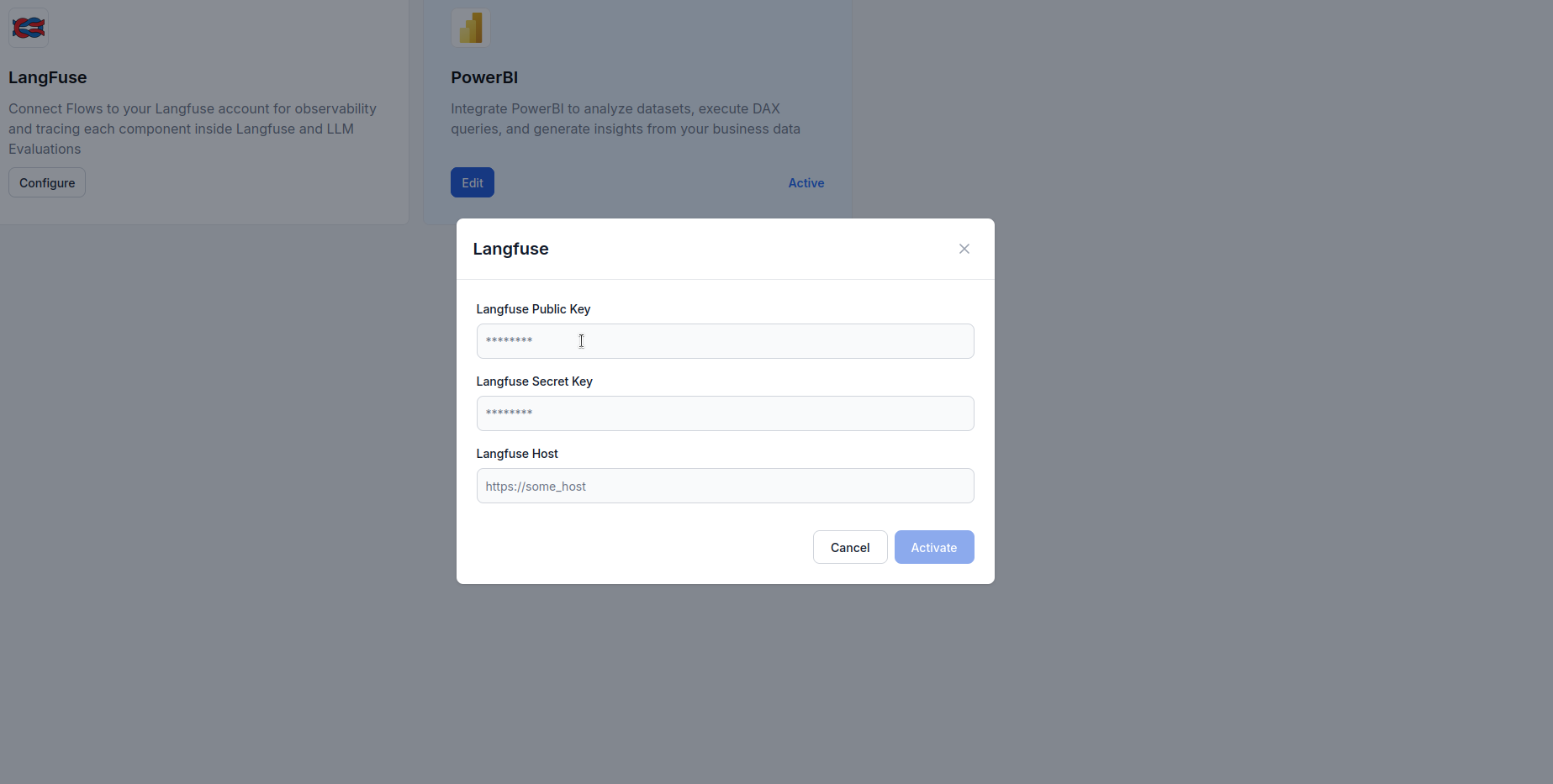

Langfuseのボックスを見つけ、Configureをクリックします。

https://cloud.langfuse.com)

FlowHuntをLangfuseに接続すると、強力な可視化・分析機能を活用できます。主なインサイト例を紹介します。

各ワークフロー実行の詳細なタイムラインを表示:

これにより、ボトルネックを特定し、ワークフロー挙動を詳細に把握できます。

ワークフローごとのトークン消費を監視:

トークン消費が多い処理を特定し、コスト最適化に役立ちます。

主要なパフォーマンス指標を可視化:

SLAの維持やユーザー体験の最適化に有効です。

失敗の特定と診断:

トラブルシュートを加速し、信頼性向上に寄与します。

会話型AIエージェント向けに:

エージェントの挙動やユーザー体験の最適化に活かせます。

異なるLLMプロバイダーの性能比較:

実際の利用データに基づき、最適なモデル選定が可能です。

FlowHuntとLangfuseの連携により、AIワークフローはブラックボックスから透明で最適化可能なシステムへと進化します。包括的なトレーシングにより、すべての実行ステップが可視化され、パフォーマンス・コスト・信頼性についてデータドリブンな判断が可能となります。

Langfuseのオブザーバビリティ連携は、APIキーの簡単なセットアップから、本番環境でのワークフロー挙動を明らかにするリッチなダッシュボードまで、監視をシームレスに実現します。

これでFlowHuntワークスペースがLangfuseと接続され、継続的な改善の基盤が整いました。ボトルネックの特定、トークン使用量の最適化、レイテンシの削減に取り組み、AIシステムが最大の価値を自信を持って発揮できる体制を構築しましょう。

FlowHuntをPowerBIと連携し、オブザーバビリティ設定を構成し、FlowHuntワークスペースの指標をPowerBIダッシュボードで直接可視化する方法を解説します。...

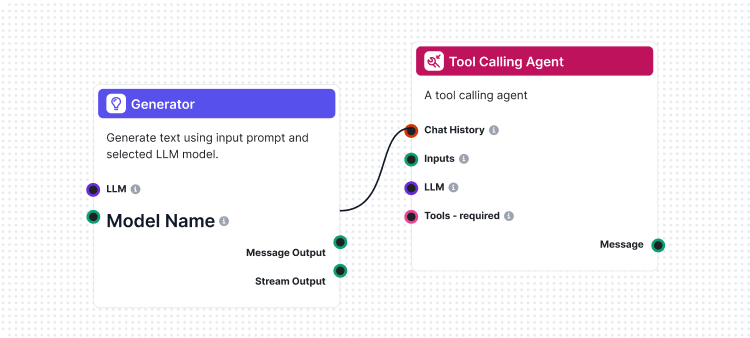

フローはFlowHuntの頭脳です。ノーコードのビジュアルビルダーで、最初のコンポーネントの配置からWebサイトへの統合、チャットボットの展開、テンプレートの活用まで、フローの作り方を学びましょう。...

FlowHunt と LiveAgent の高度な統合をマスターするための技術ガイド。言語ターゲティング、マークダウン抑制、スパムフィルタリング、API バージョン管理、LLM モデル選択、ワークフロー自動化、トラブルシューティングを解説します。...