Reexpress MCPサーバー

FlowHuntをReexpress MCPサーバーと統合することで、高度な統計的検証、リアルタイム信頼度スコアリング、動的なモデル適応をLLMパイプラインに導入できます。透明性が高く堅牢なAI検証とエンタープライズ向けカスタマイズにより、ソフトウェア開発・データサイエンスのワークフローを強化します。...

Reexpress MCP サーバーは、LLMに高度な統計的検証を付加し、開発者やデータサイエンティスト向けに信頼できるAIレスポンスと安全で監査可能なエージェンティックワークフローを実現します。

FlowHuntは、お客様の内部システムとAIツールの間に追加のセキュリティレイヤーを提供し、MCPサーバーからアクセス可能なツールをきめ細かく制御できます。私たちのインフラストラクチャーでホストされているMCPサーバーは、FlowHuntのチャットボットや、ChatGPT、Claude、さまざまなAIエディターなどの人気のAIプラットフォームとシームレスに統合できます。

Reexpress MCP サーバーは、特にソフトウェア開発やデータサイエンス分野でのLarge Language Model(LLM)ワークフローを強化するためのツールです。Model Context Protocol(MCP)サーバーとしてドロップインで導入でき、Similarity-Distance-Magnitude(SDM)推定器による最先端の統計的検証をLLM出力に提供します。この推定器は、複数のモデル(GPT-4、o4-mini、text-embedding-3-largeなど)の結果を組み合わせ、LLM生成コンテンツに対する堅牢な信頼度推定を実現します。Reexpress MCP サーバーは、質問への回答検証、統計的フィードバックに基づくレスポンスの改善、ユーザー固有タスクへの検証適応などの作業を可能にします。データはローカル(Apple silicon Mac上)で処理され、明示的なファイルアクセス制御を通じて外部データとの連携にも対応。ミッションクリティカルなAIワークフローのための信頼できる「セカンドオピニオン」ツールです。

mcpServers オブジェクト内に以下のJSONスニペットを挿入します。{

"reexpress": {

"command": "npx",

"args": ["@reexpress/mcp-server@latest"]

}

}

{

"reexpress": {

"command": "npx",

"args": ["@reexpress/mcp-server@latest"],

"env": {

"ANTHROPIC_API_KEY": "<your_api_key>"

},

"inputs": {

"api_key": "${env.ANTHROPIC_API_KEY}"

}

}

}

{

"reexpress": {

"command": "npx",

"args": ["@reexpress/mcp-server@latest"]

}

}

{

"reexpress": {

"command": "npx",

"args": ["@reexpress/mcp-server@latest"],

"env": {

"ANTHROPIC_API_KEY": "<your_api_key>"

},

"inputs": {

"api_key": "${env.ANTHROPIC_API_KEY}"

}

}

}

mcpServers 設定を開きます。{

"reexpress": {

"command": "npx",

"args": ["@reexpress/mcp-server@latest"]

}

}

{

"reexpress": {

"command": "npx",

"args": ["@reexpress/mcp-server@latest"],

"env": {

"ANTHROPIC_API_KEY": "<your_api_key>"

},

"inputs": {

"api_key": "${env.ANTHROPIC_API_KEY}"

}

}

}

{

"reexpress": {

"command": "npx",

"args": ["@reexpress/mcp-server@latest"]

}

}

{

"reexpress": {

"command": "npx",

"args": ["@reexpress/mcp-server@latest"],

"env": {

"ANTHROPIC_API_KEY": "<your_api_key>"

},

"inputs": {

"api_key": "${env.ANTHROPIC_API_KEY}"

}

}

}

FlowHuntでのMCPの利用

FlowHuntワークフローにMCPサーバーを統合するには、まずMCPコンポーネントをフローに追加し、AIエージェントと接続します。

MCPコンポーネントをクリックして設定パネルを開き、システムMCP設定セクションで以下のJSON形式でMCPサーバーの詳細を入力します。

{

"reexpress": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

設定後、AIエージェントはこのMCPをツールとして利用でき、すべての機能と能力にアクセスできるようになります。reexpress を実際のMCPサーバー名に、URLもご自身のMCPサーバーURLに置き換えてください。

| セクション | 利用可否 | 詳細・備考 |

|---|---|---|

| 概要 | ✅ | README.mdに記載あり |

| プロンプト一覧 | ⛔ | 明示的なプロンプトテンプレートなし |

| リソース一覧 | ⛔ | 明示的なMCPリソースプリミティブの記述なし |

| ツール一覧 | ✅ | README.mdにツールのリストと説明あり |

| APIキーのセキュリティ | ✅ | 設定用のJSON例あり |

| サンプリングサポート(評価上は重要度低) | ⛔ | サンプリングサポートの記載なし |

| Rootsサポート | ⛔ | Roots概念の記載やREADME.mdでの説明なし |

上記の表から、Reexpress MCP サーバーは中核となるLLM検証機能や開発者向け機能で高評価ですが、プロンプトやリソース、RootsやSamplingなどの高度なMCP機能に関するドキュメントは不足しています。

Reexpress MCP サーバーは統計的検証に特化した革新的なMCPサーバーであり、セットアップや利用方法のドキュメントは充実していますが、MCP固有プリミティブや高度な機能の幅はやや限定的です。ターゲットを絞った用途には最適です。

| ライセンスあり | ✅ (Apache-2.0) |

|---|---|

| 少なくとも1つのツール | ✅ |

| フォーク数 | 0 |

| スター数 | 1 |

Reexpress MCP サーバーは、LLMワークフローを統計的に検証するModel Context Protocol(MCP)サーバーです。Similarity-Distance-Magnitude(SDM)推定器を用いてLLM出力の信頼度スコアを提供し、適応的な検証や安全なファイルアクセスをサポートします。

主なユースケースは、AI出力の検証、対話的なコードやデータレビュー、検証モデルの動的適応、LLMのための安全なファイルアクセス、検証フィードバックに基づくエージェンティック推論などです。

統計的検証(Reexpress)、回答を正しいとマークする(ReexpressAddTrue)、回答を誤りとマークする(ReexpressAddFalse)、明示的なファイル/ディレクトリアクセス制御(ReexpressDirectorySet, ReexpressFileSet)のツールを提供します。

Reexpress MCP サーバーは、ユーザーが許可した明示的なファイルやディレクトリへのアクセスのみを許可し、LLMが対話中に指定されたリソースのみにアクセスできるようにしています。

はい。検証結果を正しい・誤りとマークすることでSDM推定器の学習を助け、特定のワークフローに適応させて将来の検証精度を向上させることができます。

FlowHuntフローにReexpress MCP サーバーを追加してLLMワークフローの信頼性を高めましょう。AI出力を統計的に検証し、安全で監査可能な意思決定を実現します。

FlowHuntをReexpress MCPサーバーと統合することで、高度な統計的検証、リアルタイム信頼度スコアリング、動的なモデル適応をLLMパイプラインに導入できます。透明性が高く堅牢なAI検証とエンタープライズ向けカスタマイズにより、ソフトウェア開発・データサイエンスのワークフローを強化します。...

FlowHuntのReplicate MCPサーバーコネクタは、Replicateの膨大なAIモデルハブへのシームレスなアクセスを提供し、開発者がワークフロー内で直接、機械学習モデルの検索・探索・実行を行えるようにします。モデルの発見、情報取得、予測、コレクション管理を自動化フローに簡単に組み込めます。...

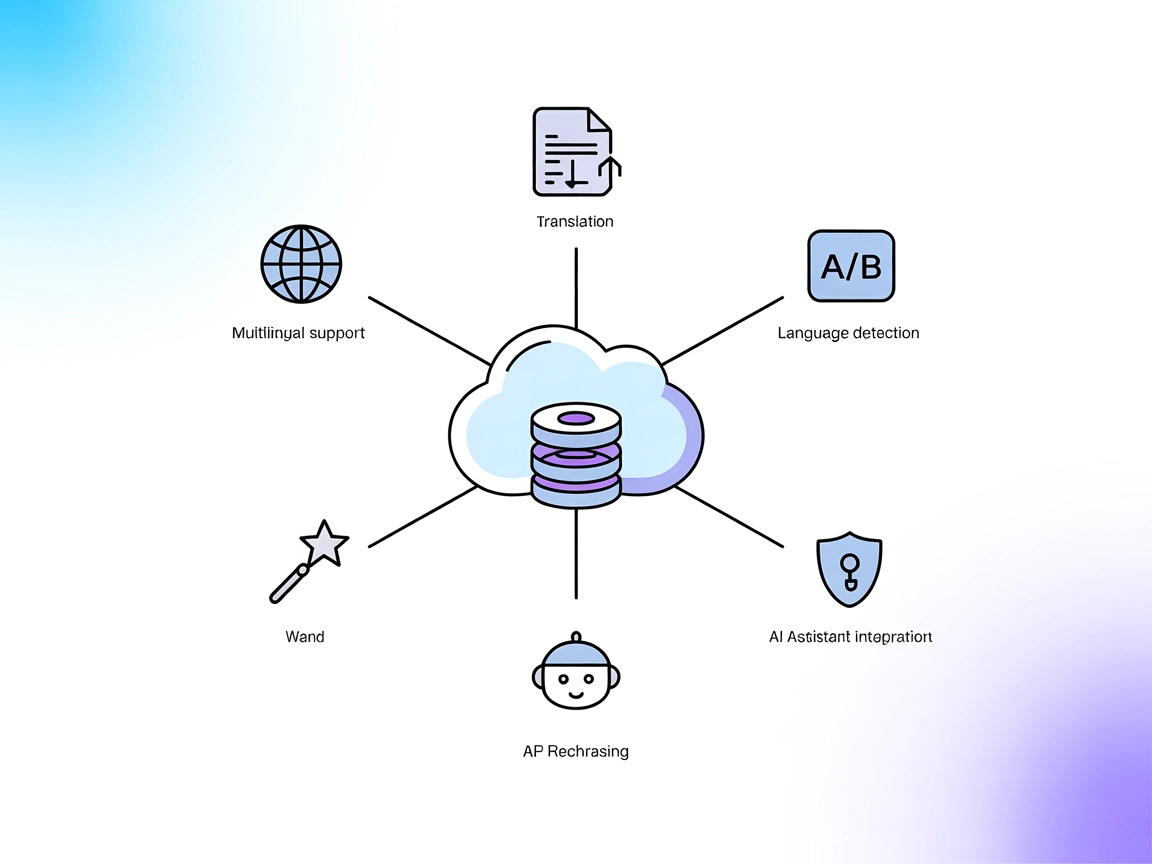

DeepL MCPサーバーは、DeepL APIを通じて高度な翻訳、言い換え、言語検出をAIワークフローに統合します。FlowHuntや他のAIアシスタントにリアルタイム多言語機能、自動言語識別、トーンのカスタマイズを提供し、シームレスなグローバルコミュニケーションを実現します。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.