Vectorize MCP Server-integratie

Integreer de Vectorize MCP Server met FlowHunt om geavanceerde vectoropvraging, semantische zoekopdrachten en tekstanalyse mogelijk te maken voor krachtige AI-g...

Verbind FlowHunt-agenten veilig met Vectara’s krachtige RAG-platform via Vectara MCP Server voor betrouwbare, contextrijke AI-antwoorden en geavanceerde kennisopvraging.

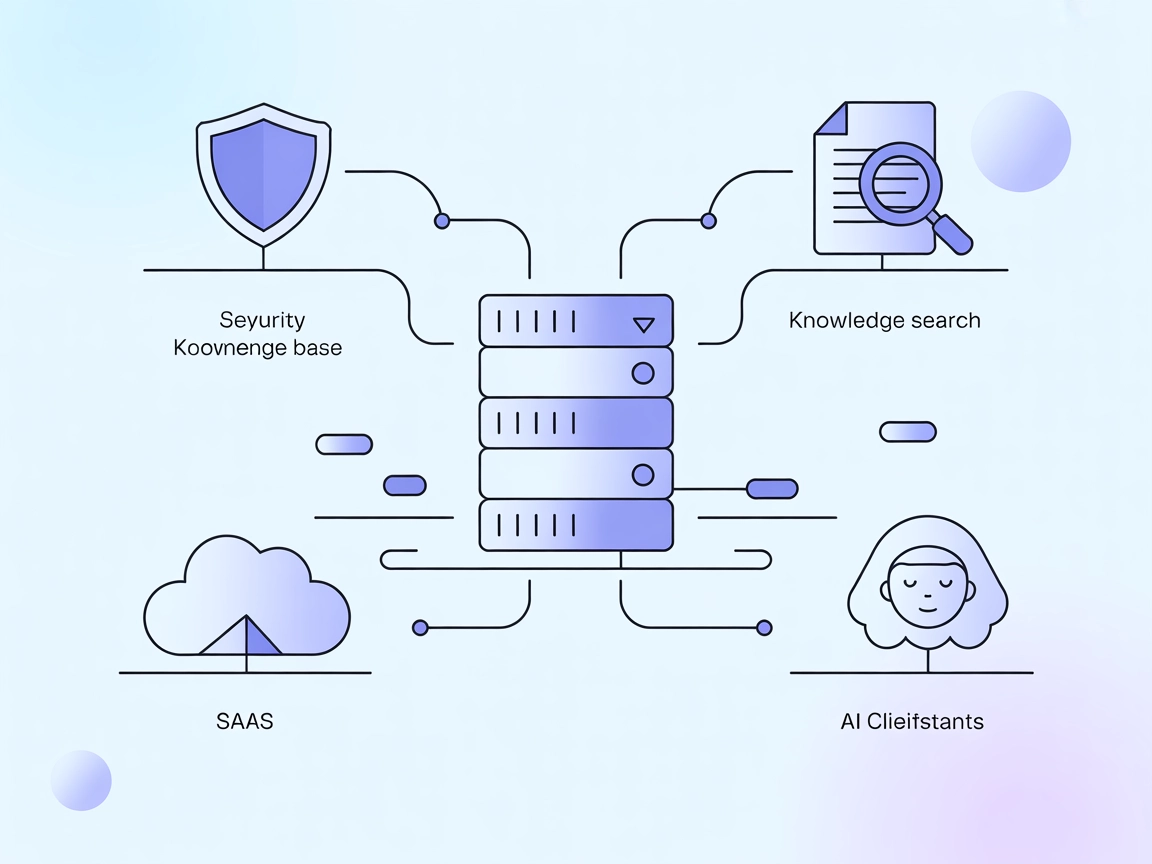

FlowHunt biedt een extra beveiligingslaag tussen uw interne systemen en AI-tools, waardoor u granulaire controle heeft over welke tools toegankelijk zijn vanaf uw MCP-servers. MCP-servers die in onze infrastructuur worden gehost, kunnen naadloos worden geïntegreerd met FlowHunt's chatbot evenals populaire AI-platforms zoals ChatGPT, Claude en verschillende AI-editors.

Vectara MCP Server is een open source implementatie van het Model Context Protocol (MCP) die is ontworpen om AI-assistenten te koppelen aan Vectara’s Trusted RAG (Retrieval-Augmented Generation) platform. Door als MCP-server te fungeren, stelt het AI-systemen in staat om veilig en efficiënt geavanceerde zoek- en opvragingstaken uit te voeren op Vectara’s betrouwbare retrieval-engine. Dit faciliteert naadloze, tweerichtingsverbindingen tussen AI-clients en externe databronnen, waardoor ontwikkelaars hun workflows kunnen verrijken met geavanceerde RAG-mogelijkheden, hallucinaties minimaliseren en snel toegang krijgen tot relevante informatie voor generatieve AI-toepassingen.

Er worden geen specifieke prompt-templates genoemd in de beschikbare documentatie of repositorybestanden.

Er worden geen expliciete MCP-resources vermeld in de beschikbare documentatie of repositorybestanden.

pip install vectara-mcp.mcpServers object:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp).mcpServers sectie:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

Het is sterk aanbevolen om gevoelige API-sleutels op te slaan in omgevingsvariabelen in plaats van in configuratiebestanden. Voorbeeld:

{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": [],

"env": {

"VECTARA_API_KEY": "${VECTARA_API_KEY}"

},

"inputs": {

"api_key": "${VECTARA_API_KEY}"

}

}

}

}

Gebruik van MCP in FlowHunt

Om MCP-servers te integreren in je FlowHunt-workflow, begin je door het MCP-component toe te voegen aan je flow en deze te verbinden met je AI-agent:

Klik op het MCP-component om het configuratiepaneel te openen. Voeg in het systeem-MCP-configuratiegedeelte de details van je MCP-server toe met dit JSON-formaat:

{

"vectara-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Als dit is geconfigureerd, kan de AI-agent deze MCP nu gebruiken als tool met toegang tot alle functies en mogelijkheden. Vergeet niet om “vectara-mcp” te vervangen door de eigenlijke naam van jouw MCP-server en de URL te vervangen door die van jouw eigen MCP-server.

| Sectie | Beschikbaarheid | Details/Opmerkingen |

|---|---|---|

| Overzicht | ✅ | Vectara MCP Server-overzicht en functie beschreven |

| Lijst van Prompts | ⛔ | Niet gespecificeerd in de beschikbare documentatie |

| Lijst van Resources | ⛔ | Niet gespecificeerd in de beschikbare documentatie |

| Lijst van Tools | ✅ | Alleen ask_vectara tool beschreven |

| Beveiliging van API-sleutels | ✅ | Gedocumenteerd met JSON/env-voorbeeld |

| Sampling-ondersteuning (minder belangrijk) | ⛔ | Niet gespecificeerd |

Vectara MCP biedt een duidelijke, gerichte integratie voor RAG met sterke documentatie voor installatie en API-sleutelbeveiliging, maar mist details over prompts, resources of sampling/roots. Het is uitstekend voor het mogelijk maken van RAG in agentic workflows, maar het ontbreken van rijkere MCP-functies beperkt de veelzijdigheid.

| Heeft een LICENSE | ✅ (Apache-2.0) |

|---|---|

| Heeft minstens één tool | ✅ |

| Aantal Forks | 2 |

| Aantal Sterren | 8 |

Beoordeling: 5/10 — Het is solide en klaar voor productie voor het RAG-gebruiksdoel, maar dekt slechts een minimaal MCP-featurepakket en mist documentatie over prompts, resources en geavanceerde MCP-concepten.

Vectara MCP Server is een open source implementatie van het Model Context Protocol en verbindt AI-assistenten met Vectara's Trusted RAG-platform. Het maakt veilige, efficiënte zoek- en opvragingsmogelijkheden mogelijk voor generatieve AI-workflows.

De belangrijkste tool is `ask_vectara`, die een RAG-query uitvoert tegen Vectara en zoekresultaten met een gegenereerd antwoord teruggeeft. Deze tool vereist gebruikersvragen, Vectara corpus keys en een API-sleutel.

Belangrijke toepassingen zijn Retrieval-Augmented Generation (RAG) om hallucinaties te minimaliseren, integratie met enterprise search, automatisering van kennisbeheer en veilige toegang tot gevoelige gegevens via API-sleutelbescherming.

Sla API-sleutels op in omgevingsvariabelen in plaats van ze hardcoded in configuratiebestanden te zetten. Gebruik JSON-configuraties met variabelen zoals `${VECTARA_API_KEY}` voor extra beveiliging.

Voeg het MCP-component toe aan je FlowHunt-flow, configureer het met de gegevens van je Vectara MCP-server en verbind het met je AI-agent. Zo krijgt de agent toegang tot Vectara's geavanceerde retrievalfuncties.

Hoewel krachtig voor RAG en search, ontbreekt er momenteel gedetailleerde documentatie over prompt-templates, aanvullende MCP-resources en geavanceerde sampling of MCP root-functies.

Voorzie je AI-agenten van veilige, feitelijke en contextbewuste antwoorden door Vectara MCP Server te integreren in je FlowHunt-workflows.

Integreer de Vectorize MCP Server met FlowHunt om geavanceerde vectoropvraging, semantische zoekopdrachten en tekstanalyse mogelijk te maken voor krachtige AI-g...

De Wikidata MCP Server stelt AI-agenten en ontwikkelaars in staat om via het Model Context Protocol te communiceren met de Wikidata API. Het biedt tools voor he...

Integreer FlowHunt met Vectara MCP om je AI-agenten en RAG-toepassingen te versterken met betrouwbare, laag-hallucinatie zoekmogelijkheden via het Model Context...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.