Prompt

Lag en prompt-mal med dynamiske variabler for LLM, støtter felt som {input}, {human_input}, {context}, {chat_history}, {system_message}.

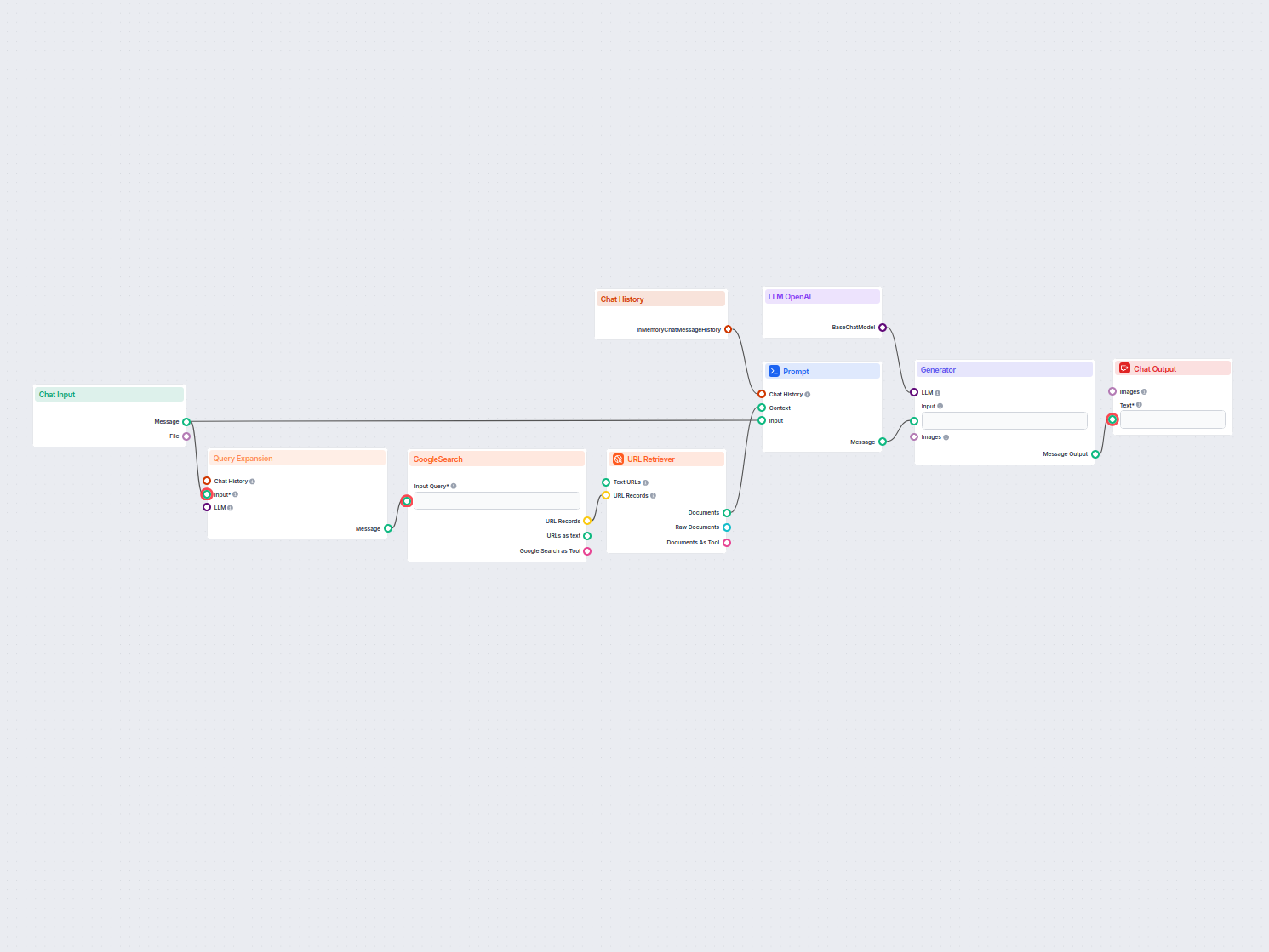

En sanntids chatbot som bruker Google Søk begrenset til ditt eget domene, henter relevant nettinnhold, og utnytter OpenAI LLM for å svare på brukerforespørsler med oppdatert informasjon. Ideell for å gi nøyaktige, domene-spesifikke svar i kundestøtte eller informasjonsportaler.

Flows

Lag en prompt-mal med dynamiske variabler for LLM, støtter felt som {input}, {human_input}, {context}, {chat_history}, {system_message}.

Nedenfor er en komplett liste over alle komponenter som brukes i denne flowen for å oppnå dens funksjonalitet. Komponenter er byggesteinene i hver AI Flow. De lar deg lage komplekse interaksjoner og automatisere oppgaver ved å koble sammen ulike funksjoner. Hver komponent tjener et spesifikt formål, som å håndtere brukerinndata, behandle data, eller integrere med eksterne tjenester.

Chat Input-komponenten i FlowHunt initierer brukerinteraksjoner ved å fange opp meldinger fra Playground. Den fungerer som startpunktet for flyter, og gjør det mulig for arbeidsflyten å behandle både tekst- og filbaserte innspill.

Oppdag Chat Output-komponenten i FlowHunt—fullfør chatbot-svar med fleksible, flerdelte utganger. Essensielt for sømløs flytavslutning og for å lage avanserte, interaktive AI-chatboter.

Knapp-widget-komponenten i FlowHunt gjør om tekst eller input til interaktive, klikkbare knapper i arbeidsflyten din. Perfekt for å lage dynamiske brukergrensesnitt, samle inn brukerens valg og forbedre engasjement i AI-drevne chatboter eller automatiserte prosesser.

Komponenten Chat Åpnet Utløser oppdager når en chatøkt starter, slik at arbeidsflyter kan svare øyeblikkelig så snart en bruker åpner chatten. Den igangsetter flyter med den innledende chatmeldingen, noe som gjør den essensiell for å bygge responsive, interaktive chatboter.

Chatthistorikk-komponenten i FlowHunt gjør det mulig for chatboter å huske tidligere meldinger, noe som sikrer sammenhengende samtaler og forbedret kundeopplevelse samtidig som minne- og tokenbruk optimaliseres.

Lær hvordan FlowHunts Prompt-komponent lar deg definere din AI-bots rolle og oppførsel, og sikrer relevante, personaliserte svar. Tilpass prompt og maler for effektive, kontekstsensitive chatbot-strømmer.

Utforsk Generator-komponenten i FlowHunt—kraftig AI-drevet tekstgenerering ved bruk av din valgte LLM-modell. Lag enkelt dynamiske chatbot-svar ved å kombinere prompt, valgfrie systeminstruksjoner og til og med bilder som input, noe som gjør den til et kjernetool for å bygge intelligente, samtalebaserte arbeidsflyter.

FlowHunt støtter dusinvis av tekstgenereringsmodeller, inkludert modeller fra OpenAI. Her er hvordan du bruker ChatGPT i dine AI-verktøy og chatboter.

Forespørselsekspansjon i FlowHunt forbedrer chatbotens forståelse ved å finne synonymer, rette stavefeil og sikre konsistente, nøyaktige svar på brukerhenvendelser.

FlowHunts GoogleSearch-komponent forbedrer chatbotens nøyaktighet ved å bruke Retrieval-Augmented Generation (RAG) for å få tilgang til oppdatert kunnskap fra Google. Kontroller resultatene med alternativer som språk, land og spørreprefikser for presise og relevante svar.

Lås opp webinnhold i arbeidsflytene dine med URL-henter-komponenten. Hent og prosesser tekst og metadata fra en hvilken som helst liste med URL-er – inkludert nettartikler, dokumenter og mer. Støtter avanserte alternativer som OCR for bilder, selektiv metadatauttrekk og tilpassbar caching, noe som gjør den ideell for å bygge kunnskapsrike AI-flyter og automasjoner.

Flow-beskrivelse

Denne arbeidsflyten implementerer en enkel Retrieval-Augmented Generation (RAG) chatbot som benytter sanntids Google Søk for å hente oppdatert informasjon fra internett—spesielt kan den tilpasses til å begrense alle søk til et bestemt domene. Hovedmålet er å skape en chatbot som kan svare på brukerforespørsler ved å bruke det mest relevante og nyeste innholdet som finnes på nettet, noe som gjør den svært verdifull i situasjoner hvor statiske kunnskapsbaser ikke strekker til.

Arbeidsflyten består av flere modulære blokker, hvor hver representerer en spesifikk egenskap. Nedenfor er en oversikt over struktur og funksjonalitet i arbeidsflyten:

| Komponent | Rolle |

|---|---|

| Chat Input | Mottar brukerens forespørsler og chatmeldinger. |

| Chat History | Opprettholder samtalehistorikk for kontekstsensitive svar. |

| Query Expansion | Parafraserer brukerinnspill til flere alternative forespørsler for å forbedre søkedekning. |

| Google Search | Utfører søk på Google, begrenset av et tilpassbart domeneprefiks. |

| URL Retriever | Henter ut innhold fra URL-ene returnert av Google Søk. |

| Prompt Template | Strukturerer kontekst, brukerinnspill og historikk for språkmodellen. |

| OpenAI LLM | Genererer svar ved hjelp av en språkmodell (f.eks. GPT-3/4). |

| Generator | Kaller LLM med prompt og kontekst for å produsere svaret. |

| Chat Output | Viser chatbot-svar til brukeren. |

| Button Widgets | Gir raske eksempelspørsmål brukeren kan prøve med ett klikk. |

| Chat Opened Trigger | Initierer samtalen og fyller på med hurtigstart-knapper. |

Når en bruker åpner chatten, aktiveres Chat Opened Trigger. Dette initialiserer chatgrensesnittet og viser flere Button Widgets med eksempelspørsmål (f.eks. “hvilken dinosaur har 500 tenner?”). Når en bruker klikker på en knapp eller skriver en egen melding via Chat Input, går arbeidsflyten videre slik:

Query Expansion: Brukerens innspill parafraseres til flere versjoner for å maksimere sjansen for relevante søkeresultater.

Google Search: De utvidede forespørslene sendes til Google Søk. Som standard er søket begrenset til et spesifikt domene (angitt av query_prefix-feltet, f.eks. site: www.DITTDOMENE.com), slik at du kan fokusere chatbotens kunnskap på ditt eget nettsted eller en betrodd kilde.

URL Retriever: Arbeidsflyten henter innholdet fra de øverste søkeresultatene (URL-er) som hele dokumenter.

Prompt Assembly: Det hentede innholdet, brukerinnspill og chat-historikk kombineres ved hjelp av Prompt Template-komponenten for å gi rik kontekst til svaret.

Language Model Generation: Prompten sendes til OpenAI LLM, som genererer et sammenhengende og kontekstuelt relevant svar.

Response Output: Det genererte svaret vises til brukeren via Chat Output.

query_prefix kan du sikre at chatboten kun henter informasjon fra ditt betrodde nettsted eller kunnskapsbase, noe som øker påliteligheten i svarene.| Steg | Beskrivelse |

|---|---|

| Brukerinnspill | Brukeren skriver et spørsmål eller klikker på en hurtigstart-knapp |

| Query Expansion | Innspillet parafraseres for bredere søkedekning |

| Google Search | Søk utføres på Google, begrenset til angitt domene |

| URL Content Retrieval | Innhold fra de øverste søkeresultatene hentes |

| Prompt Construction | Brukerinnspill, søkeresultater og chathistorikk samles til en prompt |

| LLM Generation | OpenAI LLM genererer et svar ved hjelp av full kontekst |

| Output | Svaret vises til brukeren |

query_prefix-feltet i Google Search-komponenten (f.eks. site: www.DITTDOMENE.com).Ved å automatisere søk, henting og svargenerering sparer denne arbeidsflyten tid på manuell research og sikrer at brukere alltid får den mest aktuelle og relevante informasjonen tilgjengelig.

Vi hjelper bedrifter som din med å utvikle smarte chatboter, MCP-servere, AI-verktøy eller andre typer AI-automatisering for å erstatte mennesker i repeterende oppgaver i organisasjonen din.

Oppdag den enkle chatboten med Google-søk-mal, designet for bedrifter som ønsker å gi domenespesifikk informasjon effektivt. Forbedre brukeropplevelsen ved å le...

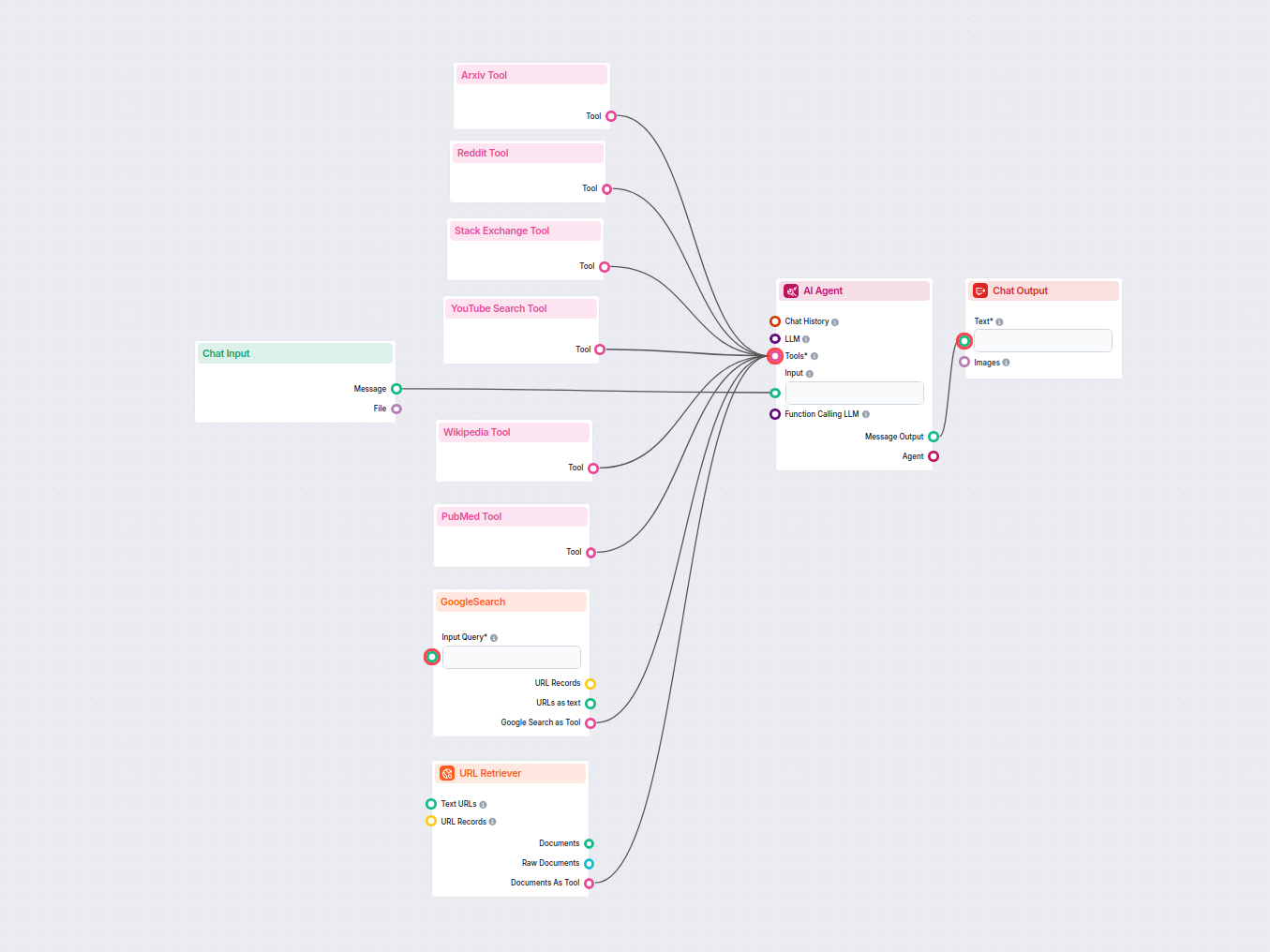

En kraftig AI-chatbot som besvarer brukerens spørsmål i sanntid ved å hente og sammenstille informasjon fra Google, Reddit, Wikipedia, Arxiv, Stack Exchange, Yo...

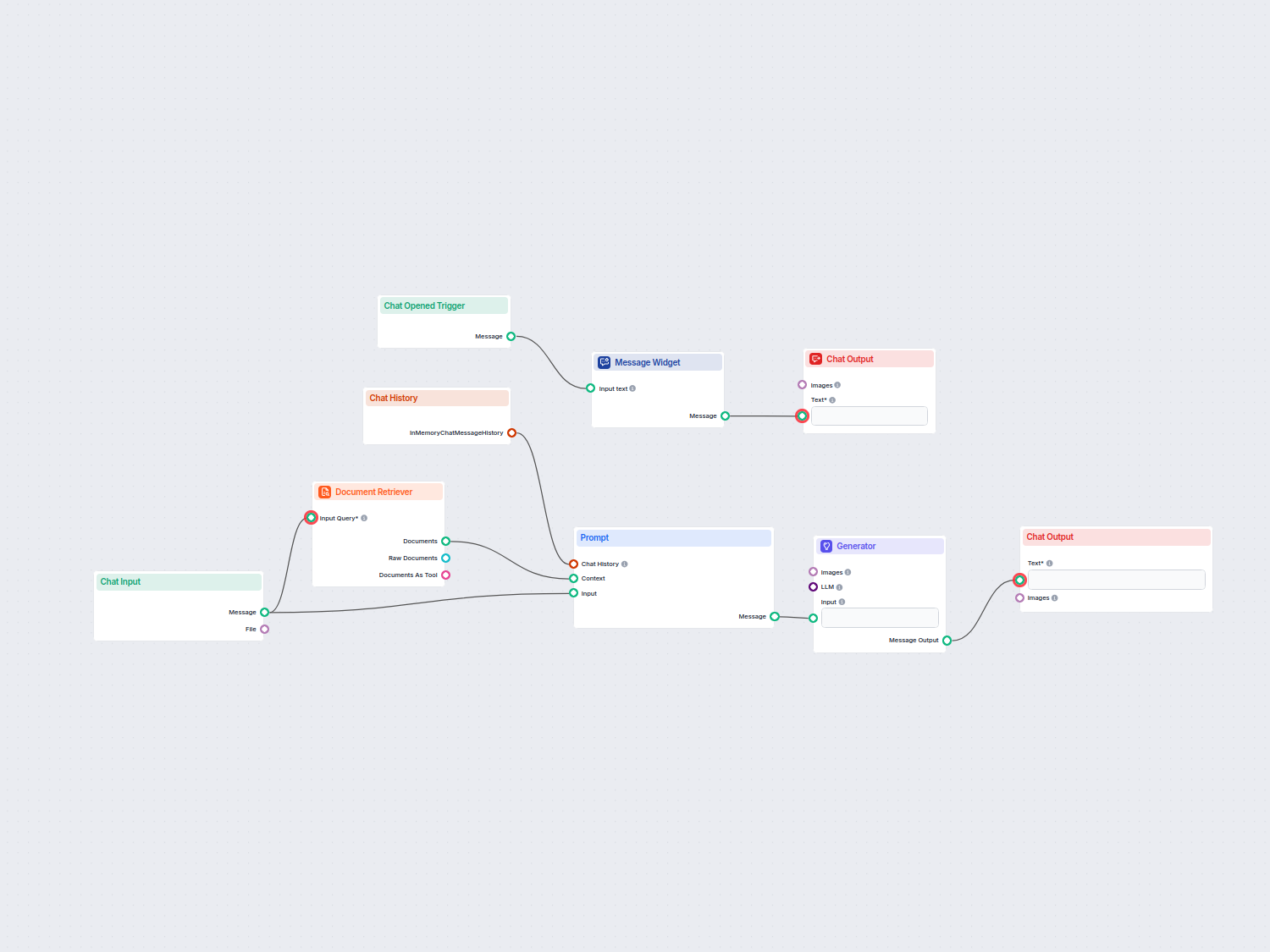

AI chatbot-assistent drevet av OpenAI GPT-4o som automatisk søker og utnytter interne bedriftsdokumenter for å svare på brukerens spørsmål. Leverer kontekstsens...