OpenAPI Schema Explorer MCP Server

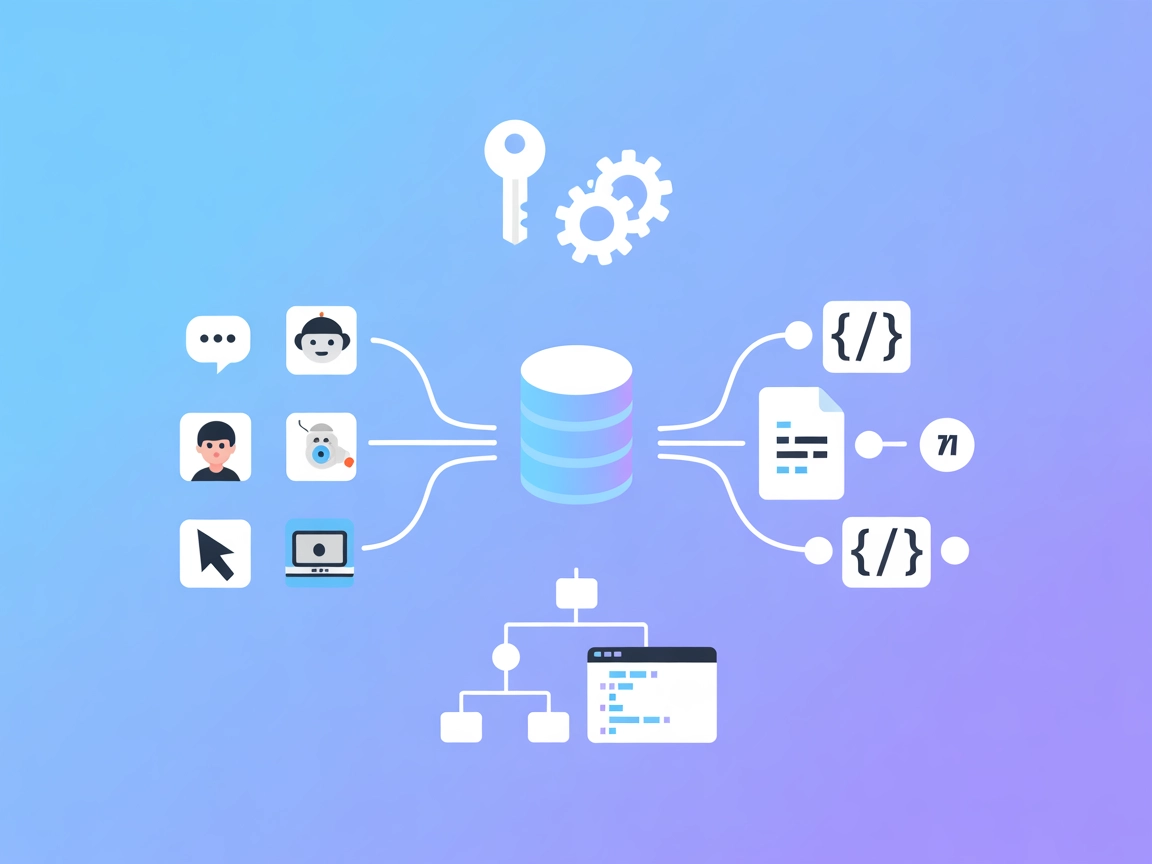

OpenAPI Schema Explorer MCP Server muliggjør effektiv, strukturert tilgang til OpenAPI/Swagger-spesifikasjoner som MCP-ressurser, og bygger bro mellom AI-assist...

Eksponer og søk i OpenAPI-skjemaer med LLM-er. List opp endepunkter umiddelbart, hent skjemaer og forbedre API-arbeidsflyter med OpenAPI Schema MCP Server.

FlowHunt gir et ekstra sikkerhetslag mellom dine interne systemer og AI-verktøy, og gir deg granulær kontroll over hvilke verktøy som er tilgjengelige fra dine MCP-servere. MCP-servere som er hostet i vår infrastruktur kan sømløst integreres med FlowHunts chatbot samt populære AI-plattformer som ChatGPT, Claude og forskjellige AI-editorer.

OpenAPI Schema MCP Server er en Model Context Protocol (MCP)-server utviklet for å eksponere OpenAPI-skjema-informasjon til store språkmodeller (LLM-er) som Claude. Ved å gi strukturert tilgang til OpenAPI-spesifikasjoner gjør denne serveren det mulig for AI-assistenter å utforske og forstå API-er, inkludert deres endepunkter, parametere, forespørsels- og respons-skjemaer og mer. Dette gir utviklere og AI-verktøy mulighet til å spørre etter API-strukturer, søke i spesifikasjoner og hente detaljerte skjema-definisjoner, noe som forbedrer arbeidsflyter knyttet til API-integrasjon, dokumentasjon og kodegenerering. Serveren støtter lasting av OpenAPI-filer i JSON- eller YAML-format og gir resultater i YAML for bedre forståelse for LLM-er.

Ingen eksplisitte prompt-maler er dokumentert i depotet.

Ingen eksplisitte ressurser er beskrevet i depotet.

OpenAPI Schema MCP Server tilbyr følgende verktøy for LLM-er:

Ingen installasjonsveiledning gitt for Windsurf.

npx er installert.~/Library/Application Support/Claude/claude_desktop_config.json$env:AppData\Claude\claude_desktop_config.jsonmcpServers-objektet:{

"mcpServers": {

"OpenAPI Schema": {

"command": "npx",

"args": ["-y", "mcp-openapi-schema", "/ABSOLUTE/PATH/TO/openapi.yaml"]

}

}

}

Ingen installasjonsveiledning gitt for Cursor.

npx er installert.claude mcp add openapi-schema npx -y mcp-openapi-schema

claude mcp add petstore-api npx -y mcp-openapi-schema ~/Projects/petstore.yaml

claude mcp list

claude mcp get openapi-schema

claude mcp remove openapi-schema

Ingen informasjon gitt om sikring av API-nøkler eller bruk av miljøvariabler.

Bruke MCP i FlowHunt

For å integrere MCP-servere i din FlowHunt-arbeidsflyt, start med å legge til MCP-komponenten i flyten og koble den til AI-agenten din:

Klikk på MCP-komponenten for å åpne konfigurasjonspanelet. I systemets MCP-konfigurasjonsseksjon setter du inn detaljene for MCP-serveren din med dette JSON-formatet:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Når dette er konfigurert, kan AI-agenten bruke denne MCP-en som et verktøy med tilgang til alle dens funksjoner og muligheter. Husk å endre “MCP-name” til det faktiske navnet på MCP-serveren din (f.eks. “github-mcp”, “weather-api”, osv.) og bytt ut URL-en med din egen MCP-server-URL.

| Seksjon | Tilgjengelig | Detaljer/Notater |

|---|---|---|

| Oversikt | ✅ | |

| Liste over Prompts | ⛔ | Ingen prompt-maler dokumentert |

| Liste over Ressurser | ⛔ | Ingen eksplisitte ressurser dokumentert |

| Liste over Verktøy | ✅ | 10 dokumenterte verktøy for OpenAPI-tilgang |

| Sikring av API-nøkler | ⛔ | Ikke nevnt |

| Støtte for sampling (mindre viktig i vurdering) | ⛔ | Ikke nevnt |

Basert på tilgjengelig dokumentasjon er OpenAPI Schema MCP Server svært spesialisert for OpenAPI-utforskning via LLM-er, med et sterkt verktøysett, men mangler detaljer om prompts, ressurser, håndtering av API-nøkler og avanserte MCP-funksjoner. For OpenAPI-bruksområder er den robust; for bredere MCP-funksjoner er den begrenset.

| Har en LISENS | ⛔ |

|---|---|

| Har minst ett verktøy | ✅ |

| Antall forks | 9 |

| Antall stjerner | 30 |

Vurdering:

Jeg vil gi denne MCP-serveren en 6/10. Den er godt definert for OpenAPI-skjemautforskning og tilbyr en solid verktøypakke, men mangler dokumentasjon på MCP prompt-maler, eksplisitte ressursdefinisjoner, sikkerhetspraksis og nevner ikke støtte for røtter eller sampling. Mangelen på LISENS er også en betydelig begrensning for åpen samarbeid.

Det er en Model Context Protocol-server som gir store språkmodeller strukturert tilgang til OpenAPI-spesifikasjoner, og muliggjør avansert API-utforskning, dokumentasjon og kodegenerering.

Den tilbyr verktøy for å liste endepunkter, hente skjemaer for endepunkter og komponenter, hente forespørsels- og respons-skjemaer, liste sikkerhetsskjemaer, søke i skjemaer og hente eksempler – alt tilgjengelig programmessig for LLM-er.

Bruksområder inkluderer API-utforskning, automatisert kodegenerering, API-dokumentasjon, sikkerhetsgjennomgang, skjema-søk og analyse, samt støtte for API-testverktøy.

Ja, serveren kan laste OpenAPI-filer i både JSON- og YAML-format og returnerer resultater i YAML for bedre forståelse for LLM-er.

Nei, den nåværende dokumentasjonen gir ikke prompt-maler eller eksplisitte ressursdefinisjoner.

Nei, den nåværende dokumentasjonen dekker ikke sikring av API-nøkler eller bruk av miljøvariabler.

Den mangler prompt-maler, eksplisitt ressursdokumentasjon, API-nøkkelhåndtering, støtte for sampling, og spesifiserer ikke lisens, noe som begrenser åpen samarbeid.

Gi AI-agentene dine mulighet til å forstå, dokumentere og teste API-er programmessig. Integrer OpenAPI Schema MCP Server i dine flyter for sømløs API-tilgang og automatisering.

OpenAPI Schema Explorer MCP Server muliggjør effektiv, strukturert tilgang til OpenAPI/Swagger-spesifikasjoner som MCP-ressurser, og bygger bro mellom AI-assist...

OpenAPI MCP-serveren kobler AI-assistenter med mulighet til å utforske og forstå OpenAPI-spesifikasjoner, og tilbyr detaljert API-kontekst, sammendrag og endepu...

Koble AI-assistenter som Claude til hvilken som helst API med en OpenAPI (Swagger)-spesifikasjon. Enhver OpenAPI MCP-server muliggjør semantisk endepunktoppdage...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.