Pinecone MCP-serverintegrasjon

Integrer FlowHunt med Pinecone vektordatabaser ved hjelp av Pinecone MCP-serveren. Aktiver semantisk søk, Retrieval-Augmented Generation (RAG) og effektiv dokum...

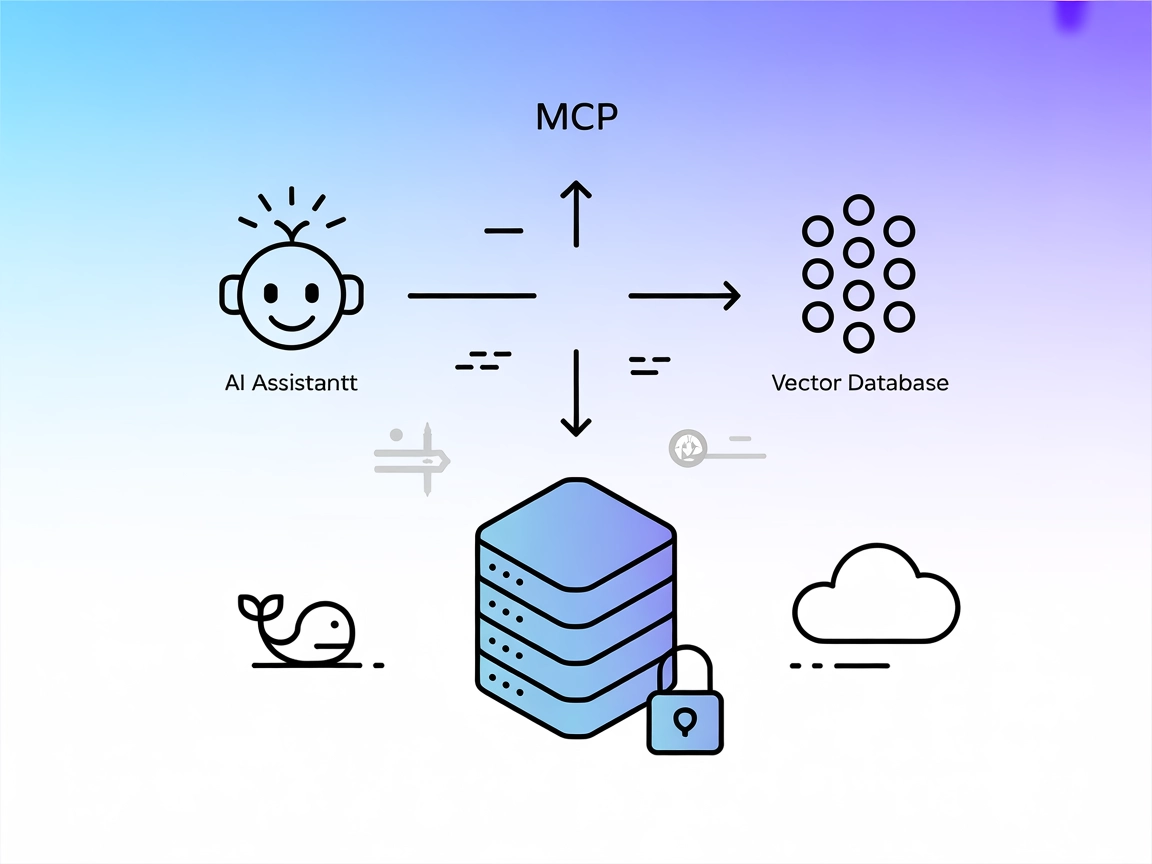

Integrer Pinecone Assistant sitt semantiske søk, henting av flere resultater og tilgang til kunnskapsbase i dine AI-agenter med denne sikre MCP-serveren.

FlowHunt gir et ekstra sikkerhetslag mellom dine interne systemer og AI-verktøy, og gir deg granulær kontroll over hvilke verktøy som er tilgjengelige fra dine MCP-servere. MCP-servere som er hostet i vår infrastruktur kan sømløst integreres med FlowHunts chatbot samt populære AI-plattformer som ChatGPT, Claude og forskjellige AI-editorer.

Pinecone Assistant MCP Server er en Model Context Protocol (MCP)-serverimplementasjon utviklet for å hente informasjon fra Pinecone Assistant. Den gjør det mulig for AI-assistenter å koble seg til Pinecones vektordatabase og dens assistentfunksjoner, og legger til rette for forbedrede utviklingsarbeidsflyter som semantisk søk, informasjonshenting og spørringer med flere resultater. Ved å fungere som en bro mellom AI-klienter og Pinecone Assistant API, muliggjør den oppgaver som søk i kunnskapsbaser, besvarelse av forespørsler og integrering av vektordatabase-funksjonalitet i bredere AI-arbeidsflyter. Serveren kan konfigureres og distribueres via Docker eller bygges fra kildekode, noe som gjør den egnet for integrasjon i ulike AI-utviklingsmiljøer.

Ingen prompt-maler er nevnt i den tilgjengelige dokumentasjonen eller i repository-filer.

Ingen eksplisitte ressurser er beskrevet i den tilgjengelige dokumentasjonen eller i repository-filer.

Ingen eksplisitte verktøy eller verktøynavn er beskrevet i den tilgjengelige dokumentasjonen eller i repository-filer.

Ingen Windsurf-spesifikke installasjonsinstruksjoner er gitt i den tilgjengelige dokumentasjonen.

claude_desktop_config.json:{

"mcpServers": {

"pinecone-assistant": {

"command": "docker",

"args": [

"run",

"-i",

"--rm",

"-e",

"PINECONE_API_KEY",

"-e",

"PINECONE_ASSISTANT_HOST",

"pinecone/assistant-mcp"

],

"env": {

"PINECONE_API_KEY": "<YOUR_PINECONE_API_KEY_HERE>",

"PINECONE_ASSISTANT_HOST": "<YOUR_PINECONE_ASSISTANT_HOST_HERE>"

}

}

}

}

API-nøkler og sensitive miljøvariabler angis i env-blokken som vist over, slik at de ikke havner på kommandolinjen eller i konfigurasjonsfiler.

Ingen Cursor-spesifikke installasjonsinstruksjoner er gitt i den tilgjengelige dokumentasjonen.

Ingen Cline-spesifikke installasjonsinstruksjoner er gitt i den tilgjengelige dokumentasjonen.

Bruke MCP i FlowHunt

For å integrere MCP-servere i din FlowHunt-arbeidsflyt, start med å legge til MCP-komponenten i flyten og koble den til din AI-agent:

Klikk på MCP-komponenten for å åpne konfigurasjonspanelet. I systemets MCP-konfigurasjonsseksjon legger du inn MCP-serverdetaljene dine med dette JSON-formatet:

{

"pinecone-assistant": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Når den er konfigurert, kan AI-agenten nå bruke denne MCP-serveren som et verktøy med tilgang til alle funksjoner og muligheter. Husk å endre “pinecone-assistant” til det faktiske navnet på din MCP-server og bytt ut URL-en med din egen MCP-server-URL.

| Seksjon | Tilgjengelig | Detaljer/Notater |

|---|---|---|

| Oversikt | ✅ | Oversikt og funksjoner er tilgjengelig i README.md |

| Liste over prompt-maler | ⛔ | Ingen prompt-maler funnet i dokumentasjonen eller repo |

| Liste over ressurser | ⛔ | Ingen eksplisitte ressurser beskrevet |

| Liste over verktøy | ⛔ | Ingen eksplisitte verktøydefinisjoner funnet |

| Sikring av API-nøkler | ✅ | Bruk av env-blokk i Claude-konfigeksempelet |

| Støtte for sampling (mindre viktig i vurdering) | ⛔ | Ingen omtale av sampling-funksjonalitet |

Basert på tilgjengelig dokumentasjon er Pinecone Assistant MCP-serveren godt dokumentert for oppsett og grunnleggende bruk, men mangler detaljer om prompt-maler, ressurser og verktøy spesifikke for MCP-protokollen. Den er enkel å integrere med Claude Desktop og gir veiledning om sikring av API-nøkler, men kan ha behov for flere MCP-spesifikke funksjoner og dokumentasjon for fullstendig utnyttelse.

Poengsum: 5/10

MCP-serveren er solid for Pinecone-integrasjon og sikkerhet, men manglende dokumentasjon på MCP-spesifikke primitive og funksjoner begrenser dens bredere nytteverdi.

| Har LICENSE | ✅ |

|---|---|

| Har minst ett verktøy | ⛔ |

| Antall forks | 4 |

| Antall stjerner | 20 |

Den kobler AI-assistenter til Pinecones vektordatabase, og muliggjør semantisk søk, kunnskapsinnhenting og svar med flere resultater for forbedrede AI-arbeidsflyter.

For Claude Desktop bruker du Docker og legger inn din Pinecone API-nøkkel og Assistant-host i konfigurasjonsfilen. Se konfigurasjonsseksjonen for et eksempel på JSON-oppsett.

Ja. API-nøkler og sensitive verdier angis via miljøvariabler i konfigurasjonsfilen, slik at de holdes sikre og adskilt fra koden.

Semantisk søk i store datasett, forespørsler mot organisasjonens kunnskapsbaser, henting av flere relevante resultater og integrering av vektorsøk i AI-arbeidsflyter.

Ingen spesifikke oppsettsinstruksjoner er gitt for Windsurf eller Cursor, men du kan tilpasse den generelle MCP-konfigurasjonen til ditt miljø.

Øk kapasiteten til din AI-agent ved å koble til Pinecones vektordatabase med Pinecone Assistant MCP Server. Prøv den med FlowHunt eller ditt favorittutviklingsverktøy for avansert søk og kunnskapsinnhenting.

Integrer FlowHunt med Pinecone vektordatabaser ved hjelp av Pinecone MCP-serveren. Aktiver semantisk søk, Retrieval-Augmented Generation (RAG) og effektiv dokum...

ModelContextProtocol (MCP) Server fungerer som en bro mellom AI-agenter og eksterne datakilder, API-er og tjenester, slik at FlowHunt-brukere kan bygge kontekst...

kintone MCP Server muliggjør sømløs integrasjon mellom AI-assistenter og kintone-plattformen, slik at AI-verktøy kan søke, oppdatere og samhandle med data fra k...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.