NLTK

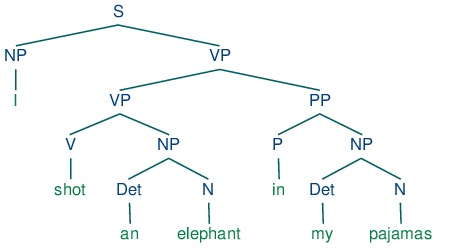

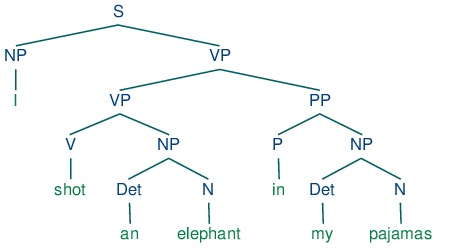

Natural Language Toolkit (NLTK) er en omfattende pakke med Python-biblioteker og programmer for symbolsk og statistisk behandling av naturlig språk (NLP). Mye b...

AllenNLP er et robust, åpen kildekode-bibliotek for NLP-forskning, bygget på PyTorch av AI2. Det tilbyr modulære, utvidbare verktøy, forhåndstrente modeller og enkel integrasjon med biblioteker som spaCy og Hugging Face, og støtter oppgaver som tekstklassifisering, koreferanseoppløsning og mer.

AllenNLP er et robust og omfattende åpen kildekode-bibliotek spesielt utviklet for forskning på naturlig språkprosessering (NLP), og tilbyr et rikt utvalg av verktøy og funksjonaliteter bygget på PyTorch-rammeverket. Utviklet av Allen Institute for Artificial Intelligence (AI2), har biblioteket som mål å støtte forskere og utviklere ved å legge til rette for enkel eksperimentering og deling av avanserte NLP-modeller. Det gir høynivåabstraksjoner og API-er for vanlige komponenter og modeller innen moderne NLP, noe som gjør det til et essensielt verktøy for alle som jobber med dyp læring og språkmodellering.

AllenNLP ble laget for å dekke behovet for en fleksibel, utvidbar og brukervennlig plattform som kan støtte banebrytende NLP-forskning og -applikasjoner. Utformingen av AllenNLP fokuserer på å tilby et modulært og gjenbrukbart rammeverk som enkelt kan tilpasses det raskt utviklende NLP-landskapet. Dette fokuset på modularitet sørger for at forskere sømløst kan integrere nye modeller og datasett etter hvert som de blir tilgjengelige, slik at de kan holde tritt med utviklingen i feltet uten å bli hemmet av tekniske kompleksiteter.

AllenNLP gjør det enkelt å bygge tekstklassifiseringsmodeller. Definer en dataset-leser, modell og treningsoppsett i JSON, og tren/evaluer raskt modeller for oppgaver som sentimentanalyse eller emneklassifisering.

Eksempel på JSON-konfigurasjon for tekstklassifisering:

{

"dataset_reader": {

"type": "20newsgroups"

},

"train_data_path": "train",

"model": {

"type": "20newsgroups_classifier",

"model_text_field_embedder": {

"tokens": {

"type": "embedding",

"pretrained_file": "glove.6B.100d.txt",

"embedding_dim": 100

}

},

"internal_text_encoder": {

"type": "lstm",

"bidirectional": true,

"hidden_size": 100

}

},

"trainer": {

"num_epochs": 10,

"optimizer": {

"type": "adagrad"

}

}

}

Smartere chatboter og AI-verktøy samlet på ett sted. Koble sammen intuitive blokker for å gjøre ideene dine om til automatiserte Flows.

Natural Language Toolkit (NLTK) er en omfattende pakke med Python-biblioteker og programmer for symbolsk og statistisk behandling av naturlig språk (NLP). Mye b...

spaCy er et robust, åpen kildekode Python-bibliotek for avansert behandling av naturlig språk (NLP), kjent for sin hastighet, effektivitet og produksjonsklare f...

PyTorch er et åpen kildekode maskinlæringsrammeverk utviklet av Meta AI, kjent for sin fleksibilitet, dynamiske beregningsgrafer, GPU-akselerasjon og sømløs Pyt...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.