Entendendo o OpenAI Whisper

Whisper é um Modelo ou um Sistema?

O OpenAI Whisper pode ser considerado tanto um modelo quanto um sistema, dependendo do contexto.

- Como modelo, o Whisper compreende arquiteturas de redes neurais projetadas especificamente para tarefas de ASR. Inclui vários modelos de diferentes tamanhos, variando de 39 milhões a 1,55 bilhão de parâmetros. Modelos maiores oferecem melhor precisão, mas exigem mais recursos computacionais.

- Como sistema, o Whisper engloba não apenas a arquitetura do modelo, mas também toda a infraestrutura e processos ao seu redor. Isso inclui os dados de treinamento, métodos de pré-processamento e a integração das diversas tarefas que pode executar, como identificação de idioma e tradução.

Capacidades Centrais do Whisper

A principal função do Whisper é transcrever fala em texto. Ele se destaca em:

- Reconhecimento de Fala Multilíngue: Suporta 99 idiomas, tornando-se uma ferramenta poderosa para aplicações globais.

- Tradução de Fala: Capaz de traduzir fala de qualquer idioma suportado para texto em inglês.

- Identificação de Idioma: Detecta automaticamente o idioma falado sem especificação prévia.

- Robustez a Sotaques e Ruídos de Fundo: Treinado com dados diversos, o Whisper lida eficazmente com diferentes sotaques e ambientes ruidosos.

Como o OpenAI Whisper Funciona?

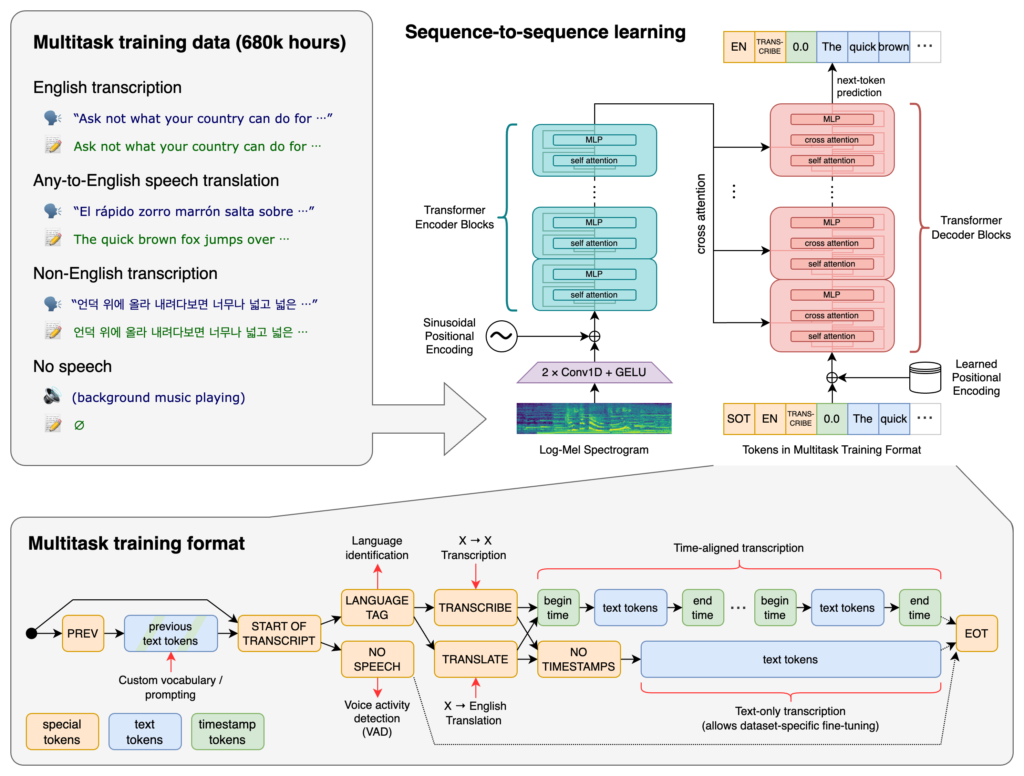

No núcleo do Whisper está a arquitetura Transformer, especificamente um modelo encoder-decoder. Transformers são redes neurais que se destacam no processamento de dados sequenciais e na compreensão de contexto em sequências longas. Introduzidos no artigo “Attention is All You Need” em 2017, os Transformers se tornaram fundamentais em muitas tarefas de PLN.

O processo do Whisper envolve:

- Pré-processamento de Áudio: O áudio de entrada é segmentado em blocos de 30 segundos e convertido em um espectrograma log-Mel, capturando a frequência e a intensidade dos sinais ao longo do tempo.

- Encoder: Processa o espectrograma para gerar uma representação numérica do áudio.

- Decoder: Utiliza um modelo de linguagem para prever a sequência de tokens de texto (palavras ou subpalavras) correspondentes ao áudio de entrada.

- Uso de Tokens Especiais: Incorpora tokens especiais para lidar com tarefas como identificação de idioma, marcação de tempo e instruções específicas (ex.: transcrever ou traduzir).

Treinamento em Dados Supervisionados Multilíngues e Multitarefas

O Whisper foi treinado em um enorme conjunto de 680.000 horas de dados supervisionados coletados da web. Isso inclui:

- Dados Multilíngues: Aproximadamente 117.000 horas dos dados estão em 99 idiomas diferentes, aumentando a capacidade do modelo de generalizar entre línguas.

- Condições Acústicas Diversas: O conjunto de dados contém áudios de diversos domínios e ambientes, garantindo robustez a diferentes sotaques, dialetos e ruídos de fundo.

- Aprendizado Multitarefa: Ao treinar em múltiplas tarefas simultaneamente (transcrição, tradução, identificação de idioma), o Whisper aprende representações compartilhadas que melhoram o desempenho geral.

Pronto para expandir seu negócio?

Comece seu teste gratuito hoje e veja resultados em dias.

Aplicações e Casos de Uso

Serviços de Transcrição

- Reuniões Virtuais e Anotações: Automatize a transcrição em plataformas voltadas para áudio geral e indústrias específicas como educação, saúde, jornalismo e serviços jurídicos.

- Criação de Conteúdo: Gere transcrições para podcasts, vídeos e transmissões ao vivo para aumentar a acessibilidade e fornecer referências em texto.

Tradução de Idiomas

- Comunicação Global: Traduza fala em um idioma para texto em inglês, facilitando a comunicação entre línguas.

- Ferramentas de Aprendizagem de Idiomas: Auxilie estudantes a compreender pronúncia e significado em diferentes línguas.

Automação de IA e Chatbots

- Chatbots com Voz: Integre o Whisper a chatbots para permitir interações por voz, melhorando a experiência do usuário.

- Assistentes de IA: Desenvolva assistentes que possam compreender e processar comandos falados em diversos idiomas.

Melhorias de Acessibilidade

- Legendas: Gere legendas para conteúdos em vídeo, auxiliando pessoas com deficiência auditiva.

- Tecnologias Assistivas: Permita que dispositivos transcrevam e traduzam fala para usuários que necessitam de suporte linguístico.

Call Centers e Suporte ao Cliente

- Transcrição em Tempo Real: Forneça aos agentes transcrições em tempo real das chamadas dos clientes para melhor atendimento.

- Análise de Sentimento: Analise o texto transcrito para avaliar o sentimento do cliente e aprimorar interações.

Vantagens do OpenAI Whisper

Suporte Multilíngue

Com cobertura de 99 idiomas, o Whisper se destaca pela capacidade de lidar com entradas linguísticas diversas. Essa capacidade multilíngue o torna adequado para aplicações globais e serviços voltados a públicos internacionais.

Alta Precisão e Robustez

Treinado em grandes volumes de dados supervisionados, o Whisper atinge altos índices de precisão em tarefas de transcrição. Sua robustez a diferentes sotaques, dialetos e ruídos de fundo o torna confiável em diversos cenários do mundo real.

Versatilidade nas Tarefas

Além da transcrição, o Whisper pode realizar:

- Identificação de Idioma: Detecta o idioma falado sem entrada prévia.

- Tradução de Fala: Traduz fala de um idioma para texto em inglês.

- Geração de Marcação de Tempo: Fornece marcações de tempo em nível de frase nas transcrições.

Disponibilidade de Código Aberto

Lançado como software de código aberto, o Whisper permite que desenvolvedores:

- Personalizem e Ajustem: Adaptem o modelo para tarefas ou domínios específicos.

- Integre em Aplicações: Embutam o Whisper em produtos e serviços sem restrições de licenciamento.

- Contribuam com a Comunidade: Aprimorem o modelo e compartilhem melhorias.

Junte-se à nossa newsletter

Receba gratuitamente as últimas dicas, tendências e ofertas.

Limitações e Considerações

Requisitos Computacionais

- Uso Intensivo de Recursos: Modelos maiores exigem bastante poder computacional e memória (até 10 GB de VRAM para o maior modelo).

- Tempo de Processamento: A velocidade de transcrição pode variar, com modelos maiores sendo mais lentos que os menores.

Propensão a Alucinações

- Transcrições Incorretas: O Whisper pode, às vezes, produzir texto que não foi falado, conhecido como alucinação. Isso é mais provável em certos idiomas ou com áudio de baixa qualidade.

Suporte Limitado para Idiomas Não-Ingleses

- Viés dos Dados: Uma parte significativa dos dados de treinamento está em inglês, o que pode afetar a precisão em idiomas menos representados.

- Necessidade de Ajuste Fino: Pode ser necessário treinamento adicional para melhorar o desempenho em línguas ou dialetos específicos.

Limitações de Entrada

- Duração do Áudio: O Whisper processa áudios em blocos de 30 segundos, o que pode dificultar a transcrição de áudios contínuos mais longos.

- Restrições de Tamanho de Arquivo: O modelo de código aberto pode ter limitações quanto ao tamanho e formato dos arquivos de entrada.

OpenAI Whisper em Automação de IA e Chatbots

Melhorando as Interações do Usuário

Ao integrar o Whisper em chatbots e assistentes de IA, desenvolvedores podem permitir:

- Comandos de Voz: Usuários podem interagir utilizando fala em vez de texto.

- Suporte Multilíngue: Atende usuários que preferem ou necessitam de outros idiomas.

- Acessibilidade Aprimorada: Auxilia usuários com deficiência ou que não podem utilizar métodos tradicionais de entrada.

Otimizando Fluxos de Trabalho

- Transcrições Automatizadas: Reduz o esforço manual em anotações e registros.

- Análise de Dados: Converte conteúdo falado em texto para análise, monitoramento e insights.

Exemplos na Prática

- Bots de Reunião Virtual: Ferramentas que participam de reuniões online para transcrever discussões em tempo real.

- Bots de Atendimento ao Cliente: Sistemas que compreendem e respondem a solicitações faladas, melhorando a experiência do cliente.

- Plataformas Educacionais: Aplicativos que transcrevem aulas ou fornecem traduções para estudantes.

Alternativas ao OpenAI Whisper

Alternativas de Código Aberto

- Mozilla DeepSpeech: Um mecanismo ASR de código aberto que permite treinamento personalizado de modelos.

- Kaldi: Um kit amplamente utilizado em pesquisa e indústria para reconhecimento de fala.

- Wav2vec: Sistema da Meta AI para processamento de fala auto-supervisionado.

APIs Comerciais

- Google Cloud Speech-to-Text: Oferece reconhecimento de fala com suporte abrangente a idiomas.

- Microsoft Azure AI Speech: Fornece serviços de fala com opções de personalização.

- AWS Transcribe: Serviço de reconhecimento de fala da Amazon, com recursos como vocabulário customizado.

Fornecedores Especializados

- Gladia: Oferece uma arquitetura Whisper híbrida e aprimorada com capacidades adicionais.

- AssemblyAI: Fornece APIs de fala para texto com recursos como moderação de conteúdo.

- Deepgram: Oferece transcrição em tempo real com opções de treinamento personalizado de modelos.

Fatores a Considerar ao Escolher o Whisper

Precisão e Velocidade

- Compensações: Modelos maiores oferecem maior precisão, mas exigem mais recursos e são mais lentos.

- Testes: Avalie o desempenho com dados reais relevantes para sua aplicação.

Volume de Áudio

- Escalabilidade: Considere as necessidades de hardware e infraestrutura para processar grandes volumes.

- Processamento em Lote: Implemente métodos para lidar com grandes conjuntos de dados de forma eficiente.

Recursos Avançados

- Funcionalidades Adicionais: Avalie se recursos como transcrição ao vivo ou diarização de falantes são necessários.

- Personalização: Determine o esforço necessário para implementar recursos adicionais.

Suporte a Idiomas

- Idiomas-Alvo: Verifique o desempenho do modelo nos idiomas relevantes para sua aplicação.

- Ajuste Fino: Planeje possível treinamento adicional para idiomas menos representados.

Especialização e Recursos

- Especialização Técnica: Garanta que sua equipe tenha as habilidades para implementar e adaptar o modelo.

- Infraestrutura: Avalie os requisitos de hardware e capacidades de hospedagem.

Considerações de Custo

- Código Aberto vs. Comercial: Balanceie a economia inicial do código aberto com possíveis custos de manutenção e escala a longo prazo.

- Custo Total de Propriedade: Considere hardware, tempo de desenvolvimento e custos de suporte contínuo.

Como o Whisper é Usado em Python?

O Whisper é implementado como uma biblioteca Python, permitindo integração fluida em projetos baseados em Python. Utilizar o Whisper em Python envolve configurar o ambiente, instalar as dependências necessárias e utilizar as funções da biblioteca para transcrever ou traduzir arquivos de áudio.

Configurando o Whisper em Python

Antes de usar o Whisper, é necessário preparar o ambiente de desenvolvimento instalando Python, PyTorch, FFmpeg e a própria biblioteca Whisper.

Pré-requisitos

- Python: Recomenda-se a versão 3.8 a 3.11.

- PyTorch: Framework de aprendizado profundo necessário para rodar o modelo Whisper.

- FFmpeg: Ferramenta de linha de comando para manipulação de arquivos de áudio e vídeo.

- Biblioteca Whisper: O pacote Python fornecido pela OpenAI.

Passo 1: Instale Python e PyTorch

Se ainda não tem o Python instalado, baixe no site oficial

. Para instalar o PyTorch, utilize o pip:

pip install torch

Alternativamente, visite o site do PyTorch

para instruções específicas conforme seu sistema operacional e versão do Python.

Passo 2: Instale o FFmpeg

O Whisper requer o FFmpeg para processar arquivos de áudio. Instale o FFmpeg usando o gerenciador de pacotes apropriado ao seu sistema operacional.

Ubuntu/Debian:

sudo apt update && sudo apt install ffmpeg

MacOS (com Homebrew):

brew install ffmpeg

Windows (com Chocolatey):

choco install ffmpeg

Passo 3: Instale a Biblioteca Whisper

Instale o pacote Whisper Python usando pip:

pip install -U openai-whisper

Para instalar a versão mais recente diretamente do repositório GitHub:

pip install git+https://github.com/openai/whisper.git

Observação para Usuários do Windows

Certifique-se de que o Modo de Desenvolvedor está ativado:

- Vá para Configurações.

- Navegue até Privacidade e Segurança > Para Desenvolvedores.

- Ative o Modo de Desenvolvedor.

Modelos Disponíveis e Especificações

O Whisper oferece vários modelos que variam em tamanho e capacidades. Os modelos vão de tiny a large, cada um equilibrando velocidade e precisão de forma diferente.

| Tamanho | Parâmetros | Modelo Somente Inglês | Modelo Multilíngue | VRAM Necessária | Velocidade Relativa |

|---|

| tiny | 39 M | tiny.en | tiny | ~1 GB | ~32x |

| base | 74 M | base.en | base | ~1 GB | ~16x |

| small | 244 M | small.en | small | ~2 GB | ~6x |

| medium | 769 M | medium.en | medium | ~5 GB | ~2x |

| large | 1550 M | N/A | large | ~10 GB | 1x |

Escolhendo o Modelo Ideal

- Modelos Somente Inglês (

.en): Otimizados para transcrição em inglês, oferecendo melhor desempenho para áudios nesse idioma. - Modelos Multilíngues: Capazes de transcrever múltiplos idiomas, ideais para aplicações globais.

- Tamanho do Modelo: Modelos maiores oferecem maior precisão, mas requerem mais recursos computacionais. Escolha o que melhor se adapta ao seu hardware e requisitos de desempenho.

Usando o Whisper em Python

Após configurar o ambiente e instalar os componentes necessários, você pode começar a usar o Whisper em seus projetos Python.

Importando a Biblioteca e Carregando um Modelo

Comece importando a biblioteca Whisper e carregando um modelo:

import whisper

# Carregue o modelo desejado

model = whisper.load_model("base")

Substitua "base" pelo nome do modelo que melhor se adapta à sua aplicação.

Transcrevendo Arquivos de Áudio

O Whisper fornece uma função simples transcribe para converter arquivos de áudio em texto.

Exemplo: Transcrevendo um Arquivo de Áudio em Inglês

# Transcreva o arquivo de áudio

result = model.transcribe("path/to/english_audio.mp3")

# Imprima a transcrição

print(result["text"])

Explicação

model.transcribe(): Processa o arquivo de áudio e retorna um dicionário contendo a transcrição e outros metadados.result["text"]: Acessa o texto transcrito do resultado.

Traduzindo Áudio para Inglês

O Whisper pode traduzir áudio de vários idiomas para o inglês.

Exemplo: Traduzindo Áudio em Espanhol para Inglês

# Transcreva e traduza áudio em espanhol para inglês

result = model.transcribe("path/to/spanish_audio.mp3", task="translate")

# Imprima o texto traduzido

print(result["text"])

Explicação

task="translate": Instrui o modelo a traduzir o áudio para inglês em vez de apenas transcrever literalmente.

Especificando o Idioma

Embora o Whisper possa detectar o idioma automaticamente, especificá-lo pode melhorar a precisão e a velocidade.

Exemplo: Transcrevendo Áudio em Francês

# Transcreva áudio em francês especificando o idioma

result = model.transcribe("path/to/french_audio.wav", language="fr")

# Imprima a transcrição

print(result["text"])

Detectando o Idioma do Áudio

O Whisper pode identificar o idioma falado em um arquivo de áudio usando o método detect_language.

Exemplo: Detecção de Idioma

# Carregue e pré-processe o áudio

audio = whisper.load_audio("path/to/unknown_language_audio.mp3")

audio = whisper.pad_or_trim(audio)

# Converta para espectrograma log-Mel

mel = whisper.log_mel_spectrogram(audio).to(model.device)

# Detecte o idioma

_, probs = model.detect_language(mel)

language = max(probs, key=probs.get)

print(f"Idioma detectado: {language}")

Explicação

whisper.load_audio(): Carrega o arquivo de áudio.whisper.pad_or_trim(): Ajusta o comprimento do áudio conforme os requisitos do modelo.whisper.log_mel_spectrogram(): Converte o áudio para o formato esperado pelo modelo.model.detect_language(): Retorna probabilidades para cada idioma, identificando o mais provável.

Uso Avançado e Personalização

Para maior controle sobre o processo de transcrição, é possível usar funções de baixo nível e personalizar opções de decodificação.

Usando a Função decode

A função decode permite especificar opções como idioma, tarefa e inclusão de marcações de tempo.

Exemplo: Opções de Decodificação Personalizadas

# Defina as opções de decodificação

options = whisper.DecodingOptions(language="de", without_timestamps=True)

# Decodifique o áudio

result = whisper.decode(model, mel, options)

# Imprima o texto reconhecido

print(result.text)

Processando Áudio de Entrada ao Vivo

É possível integrar o Whisper para transcrever entrada de áudio ao vivo de um microfone.

Exemplo: Transcrevendo Entrada ao Vivo do Microfone

import whisper

import sounddevice as sd

# Carregue o modelo

model = whisper.load_model("base")

# Grave áudio do microfone

duration = 5 # segundos

fs = 16000 # Taxa de amostragem

print("Gravando...")

audio = sd.rec(int(duration * fs), samplerate=fs, channels=1, dtype='float32')

sd.wait