Integração do Servidor MCP da Aiven

O Servidor MCP da Aiven conecta agentes de IA do FlowHunt aos serviços gerenciados em nuvem da Aiven, viabilizando descoberta automatizada de projetos, inventár...

Automação de IA

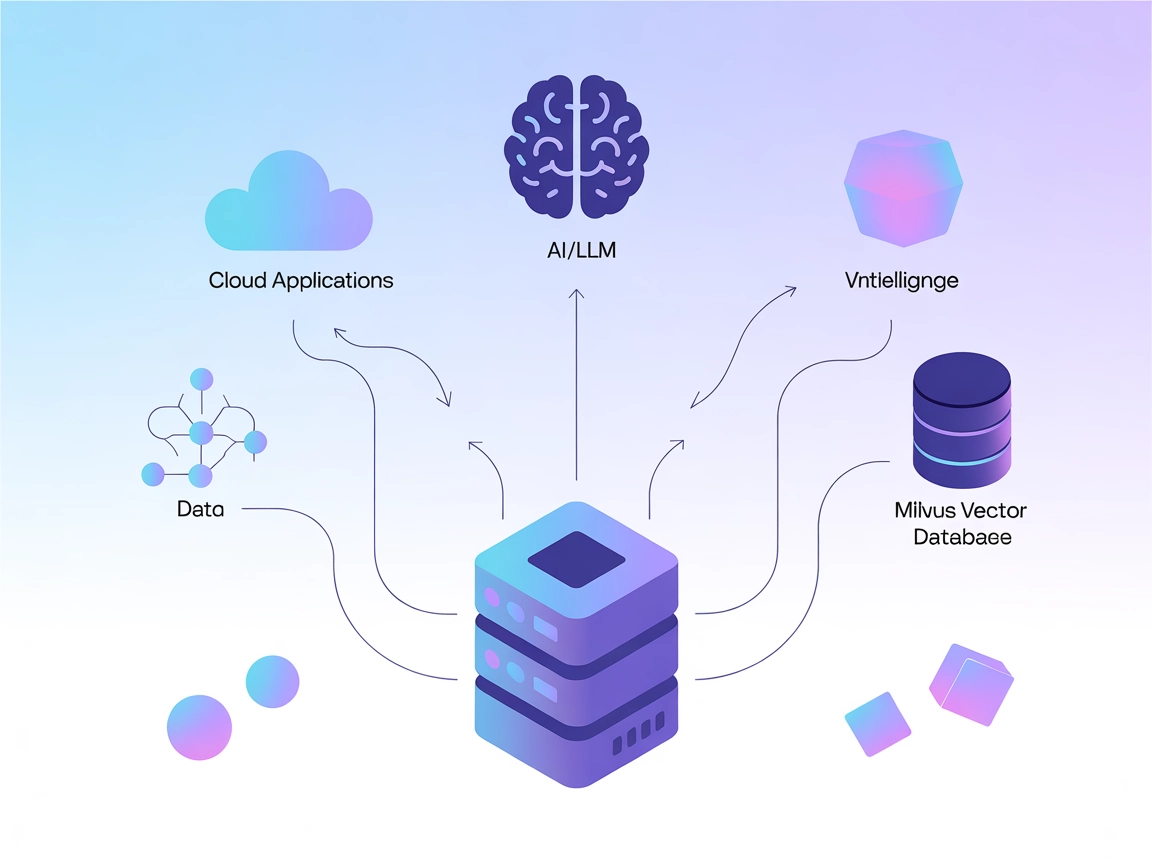

Conecte LLMs e agentes de IA ao Milvus para busca vetorial poderosa, memória contextual e recomendações orientadas por dados diretamente nos seus fluxos de trabalho FlowHunt.

O FlowHunt fornece uma camada de segurança adicional entre seus sistemas internos e ferramentas de IA, dando-lhe controle granular sobre quais ferramentas são acessíveis a partir de seus servidores MCP. Os servidores MCP hospedados em nossa infraestrutura podem ser perfeitamente integrados com o chatbot do FlowHunt, bem como com plataformas de IA populares como ChatGPT, Claude e vários editores de IA.

O Servidor Milvus MCP (Model Context Protocol) conecta assistentes de IA e aplicações alimentadas por LLM ao banco de dados vetorial Milvus. Isso permite uma interação fluida entre modelos de linguagem e dados vetoriais em grande escala, oferecendo uma forma padronizada de acessar, consultar e gerenciar o Milvus a partir de fluxos de trabalho de IA. Utilizando o Servidor Milvus MCP, desenvolvedores podem integrar capacidades de busca, recuperação e gerenciamento de dados baseados em Milvus diretamente em seus agentes de IA, IDEs ou interfaces de chat. O servidor suporta múltiplos modos de comunicação (stdio e Server-Sent Events), permitindo que se adapte a diversos cenários de implantação e ambientes de desenvolvimento. Ao fazer a ponte entre LLMs e Milvus, ele amplia significativamente a capacidade dos sistemas de IA para realizar operações sensíveis ao contexto em dados de alta dimensão, desbloqueando experiências mais ricas e inteligentes alimentadas por LLM.

Não há informações sobre templates de prompt fornecidas no repositório.

Não há uma lista explícita de “recursos” do Model Context Protocol descrita na documentação ou código disponível.

Não há lista explícita de ferramentas ou nomes de funções documentados na documentação ou arquivos de código disponíveis, incluindo server.py.

git clone https://github.com/zilliztech/mcp-server-milvus.gituv run src/mcp_server_milvus/server.py --milvus-uri http://localhost:19530{

"mcpServers": {

"milvus-mcp": {

"command": "uv",

"args": ["run", "src/mcp_server_milvus/server.py", "--milvus-uri", "http://localhost:19530"]

}

}

}

Protegendo chaves de API:

Se o servidor exigir informações sensíveis, use variáveis de ambiente:

{

"env": {

"MILVUS_URI": "http://localhost:19530"

},

"inputs": {}

}

{

"mcpServers": {

"milvus-mcp": {

"command": "uv",

"args": ["run", "src/mcp_server_milvus/server.py", "--milvus-uri", "http://localhost:19530"]

}

}

}

Proteja as credenciais via variáveis de ambiente como acima.

uv.uv run src/mcp_server_milvus/server.py --milvus-uri http://localhost:19530{

"mcpServers": {

"milvus-mcp": {

"command": "uv",

"args": ["run", "src/mcp_server_milvus/server.py", "--milvus-uri", "http://localhost:19530"]

}

}

}

Protegendo chaves de API:

Use variáveis de ambiente como mostrado acima.

uv.{

"mcpServers": {

"milvus-mcp": {

"command": "uv",

"args": ["run", "src/mcp_server_milvus/server.py", "--milvus-uri", "http://localhost:19530"]

}

}

}

Variáveis de ambiente:

{

"env": {

"MILVUS_URI": "http://localhost:19530"

}

}

Usando MCP no FlowHunt

Para integrar servidores MCP ao seu fluxo de trabalho no FlowHunt, comece adicionando o componente MCP ao seu fluxo e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração do sistema MCP, insira os detalhes do seu servidor MCP usando este formato JSON:

{

"milvus-mcp": {

"transport": "streamable_http",

"url": "https://seuservidormcp.exemplo/caminhoparamcp/url"

}

}

Uma vez configurado, o agente de IA poderá utilizar este MCP como uma ferramenta com acesso a todas as suas funções e capacidades. Lembre-se de alterar “milvus-mcp” para o nome real do seu servidor MCP e substituir a URL pela URL do seu MCP.

| Seção | Disponibilidade | Detalhes/Notas |

|---|---|---|

| Visão Geral | ✅ | |

| Lista de Prompts | ⛔ | Nenhum template de prompt documentado |

| Lista de Recursos | ⛔ | Nenhuma lista explícita de recursos MCP |

| Lista de Ferramentas | ⛔ | Nenhuma ferramenta explícita listada nos arquivos disponíveis |

| Proteção de Chaves de API | ✅ | Usa variáveis de ambiente, documentado nos exemplos de setup |

| Suporte a Amostragem (menos importante na avaliação) | ⛔ | Não mencionado |

Suporte a roots: Não mencionado

Suporte a amostragem: Não mencionado

O Servidor Milvus MCP é uma ponte prática e focada para conectar LLMs ao Milvus, com guias de configuração claros para ferramentas de desenvolvimento populares. No entanto, sua documentação carece de detalhes sobre recursos MCP, prompts e APIs de ferramentas acionáveis, o que limita a descoberta pronta para uso. Ainda assim, é uma base sólida para integrações de IA baseadas em vetores.

| Possui uma LICENSE | ✅ (Apache-2.0) |

|---|---|

| Possui ao menos uma ferramenta | ⛔ |

| Número de Forks | 32 |

| Número de Stars | 139 |

Geral: 4/10

O servidor é útil para seu nicho, mas se beneficiaria muito de uma documentação mais explícita sobre recursos, templates de prompt e APIs de ferramentas para máxima interoperabilidade e facilidade de uso.

Aprimore seus agentes de IA com acesso facilitado a bancos de dados vetoriais, permitindo buscas mais inteligentes, recomendações e memória contextual. Integre o Servidor Milvus MCP ao FlowHunt agora!

O Servidor MCP da Aiven conecta agentes de IA do FlowHunt aos serviços gerenciados em nuvem da Aiven, viabilizando descoberta automatizada de projetos, inventár...

O Servidor LSP MCP conecta servidores Language Server Protocol (LSP) a assistentes de IA, permitindo análise avançada de código, autocompletar inteligente, diag...

O Servidor LLM Context MCP conecta assistentes de IA a projetos de código e texto externos, permitindo fluxos de trabalho com reconhecimento de contexto para re...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.