Servidor Figma-Context MCP

O Servidor Figma-Context MCP conecta agentes de codificação de IA com layouts de design do Figma expondo dados do Figma via o Model Context Protocol (MCP). Ele ...

Automação de IA

Automatize, analise e modifique arquivos Figma programaticamente com o Cursor Talk To Figma MCP Server—tornando a automação de design acessível para agentes de IA e desenvolvedores.

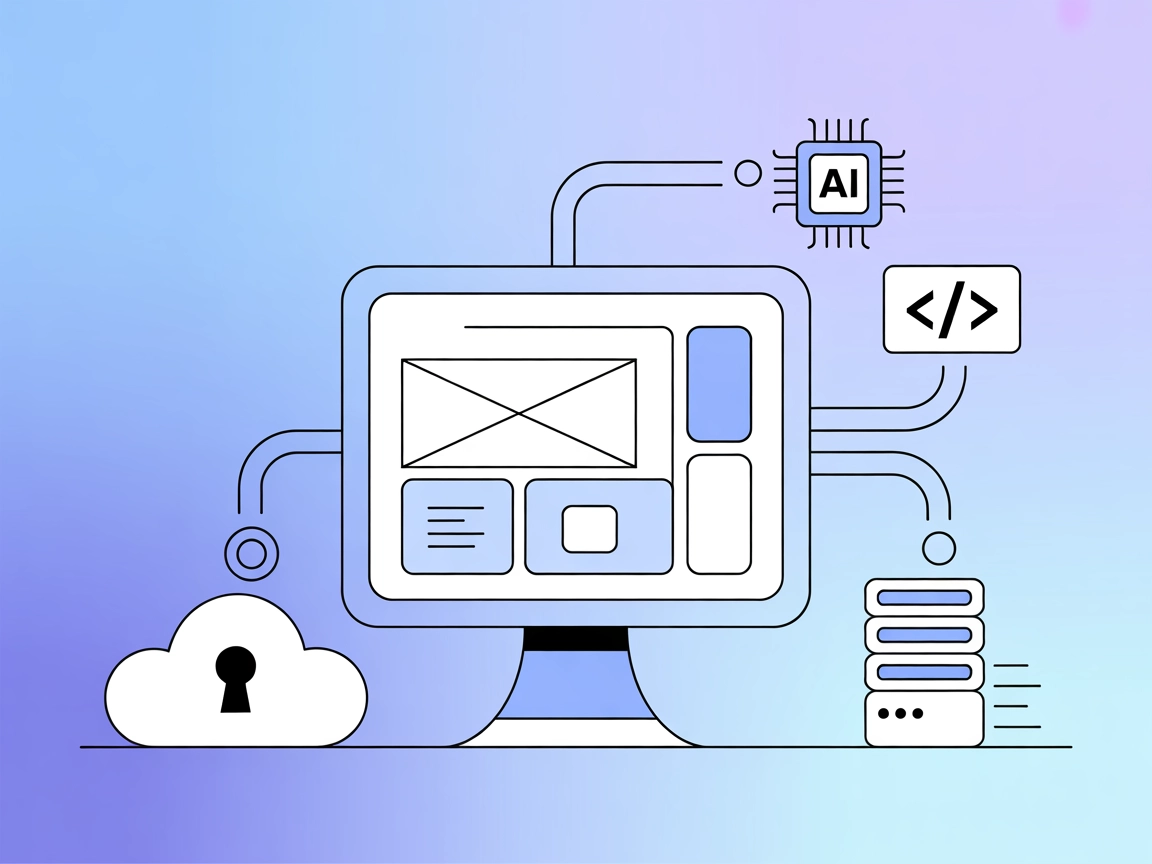

O FlowHunt fornece uma camada de segurança adicional entre seus sistemas internos e ferramentas de IA, dando-lhe controle granular sobre quais ferramentas são acessíveis a partir de seus servidores MCP. Os servidores MCP hospedados em nossa infraestrutura podem ser perfeitamente integrados com o chatbot do FlowHunt, bem como com plataformas de IA populares como ChatGPT, Claude e vários editores de IA.

O Cursor Talk To Figma MCP Server fornece uma ponte entre o ambiente de desenvolvimento Cursor AI e o Figma, permitindo uma interação fluida entre assistentes de IA e arquivos de design. Ao expor os dados e ações do Figma através do Model Context Protocol (MCP), esse servidor possibilita que desenvolvedores e agentes de IA leiam, analisem e modifiquem designs Figma programaticamente. Esta integração agiliza fluxos de trabalho para designers e desenvolvedores ao automatizar tarefas repetitivas de design, permitindo substituição em massa de conteúdo, propagação de overrides de componentes e oferecendo outras capacidades de automação diretamente de ferramentas com IA. O servidor aumenta a produtividade e colaboração ao tornar os recursos do Figma acessíveis via endpoints MCP padronizados.

Nenhum modelo de prompt é explicitamente listado no repositório ou na documentação.

Nenhuma lista explícita de recursos MCP é fornecida no repositório ou na documentação.

Nenhuma lista explícita de ferramentas MCP está incluída no repositório ou nos arquivos do servidor conforme apresentado.

curl -fsSL https://bun.sh/install | bash).bun setup para instalar as dependências.bun socket.{

"mcpServers": {

"cursor-talk-to-figma": {

"command": "bunx",

"args": ["cursor-talk-to-figma-mcp"]

}

}

}

Protegendo as chaves de API:

{

"mcpServers": {

"cursor-talk-to-figma": {

"command": "bunx",

"args": ["cursor-talk-to-figma-mcp"],

"env": {

"FIGMA_API_KEY": "${env.FIGMA_API_KEY}"

},

"inputs": {

"apiKey": "${env.FIGMA_API_KEY}"

}

}

}

}

bun setup e bun socket como acima.{

"mcpServers": {

"cursor-talk-to-figma": {

"command": "bunx",

"args": ["cursor-talk-to-figma-mcp"]

}

}

}

Protegendo as chaves de API: (veja exemplo acima)

bun setup.bun socket.{

"mcpServers": {

"cursor-talk-to-figma": {

"command": "bunx",

"args": ["cursor-talk-to-figma-mcp"]

}

}

}

Protegendo as chaves de API: (veja exemplo acima)

bun setup e bun socket.{

"mcpServers": {

"cursor-talk-to-figma": {

"command": "bunx",

"args": ["cursor-talk-to-figma-mcp"]

}

}

}

Protegendo as chaves de API: (veja exemplo acima)

Usando MCP no FlowHunt

Para integrar MCP servers ao seu fluxo de trabalho FlowHunt, comece adicionando o componente MCP ao seu fluxo e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração do MCP do sistema, insira os detalhes do seu MCP server usando este formato JSON:

{

"cursor-talk-to-figma": {

"transport": "streamable_http",

"url": "https://yourseumcpserver.example/pathtothemcp/url"

}

}

Após configurar, o agente de IA poderá usar este MCP como uma ferramenta com acesso a todas as suas funções e capacidades. Lembre-se de mudar “cursor-talk-to-figma” para o nome real do seu MCP server e substituir a URL pela URL do seu MCP server.

| Seção | Disponibilidade | Detalhes/Notas |

|---|---|---|

| Visão Geral | ✅ | Detalhado em readme.md e descrição do projeto |

| Lista de Prompts | ⛔ | Nenhum modelo de prompt encontrado |

| Lista de Recursos | ⛔ | Não listado explicitamente |

| Lista de Ferramentas | ⛔ | Não listado explicitamente |

| Proteção de API Keys | ✅ | Exemplo de variável de ambiente fornecido |

| Suporte a Sampling (menos relevante na avaliação) | ⛔ | Nenhuma menção encontrada |

O repositório fornece uma integração robusta para automação do Figma via MCP, mas carece de documentação detalhada sobre prompts, ferramentas e recursos. As instruções de configuração e casos de uso são claras e práticas, mas recursos MCP mais avançados (roots, sampling, etc.) não estão documentados.

| Possui LICENSE | ✅ (MIT) |

|---|---|

| Possui ao menos uma ferramenta | ⛔ |

| Número de Forks | 433 |

| Número de Stars | 4.4k |

Opinião e Avaliação:

Com base nas duas tabelas, este servidor MCP recebe nota 6/10. É bem avaliado, amplamente utilizado e fornece integração e configuração claras e valiosas, mas carece de documentação explícita de prompts, recursos e ferramentas MCP, além de não apresentar evidências de suporte a roots ou sampling.

Integre o Cursor Talk To Figma MCP Server para automatizar tarefas de design, acelerar prototipagem e unir equipes de desenvolvimento e design usando IA.

O Servidor Figma-Context MCP conecta agentes de codificação de IA com layouts de design do Figma expondo dados do Figma via o Model Context Protocol (MCP). Ele ...

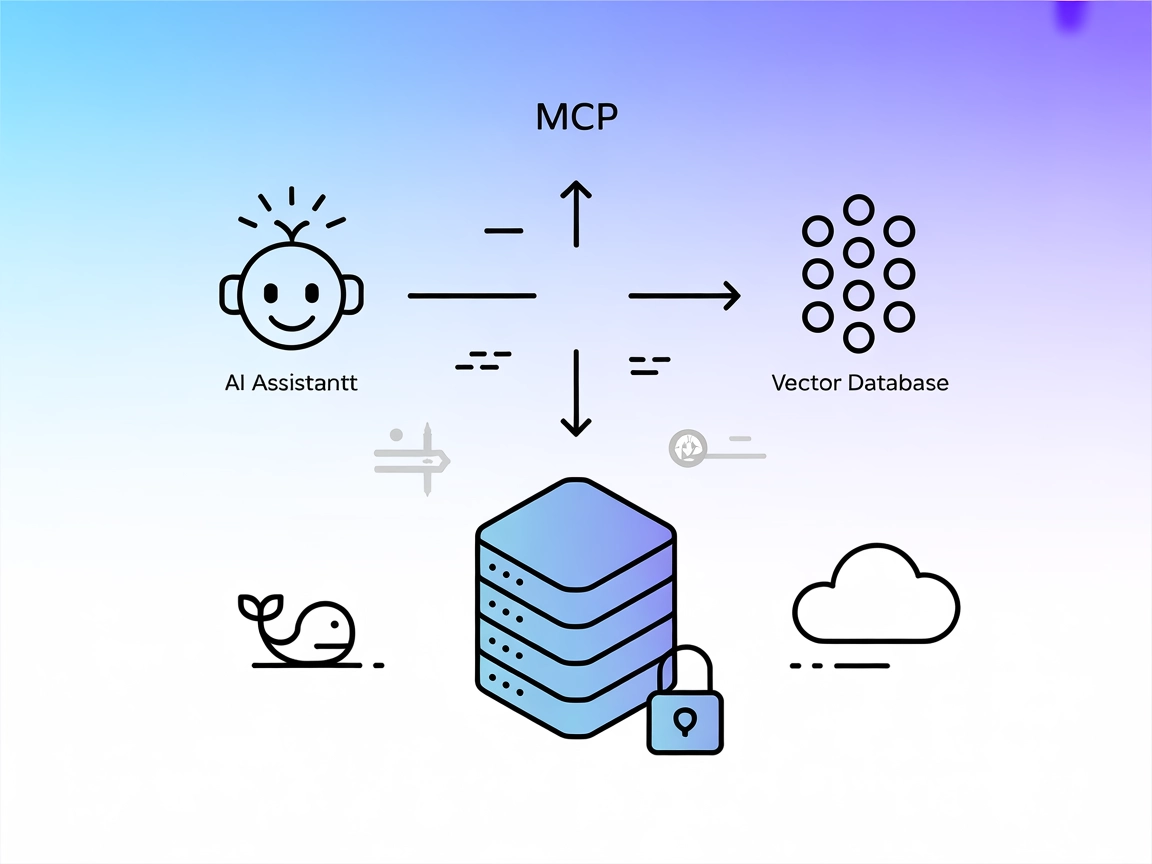

O Pinecone Assistant MCP Server faz a ponte entre assistentes de IA e o banco de dados vetorial da Pinecone, permitindo busca semântica, recuperação de múltiplo...

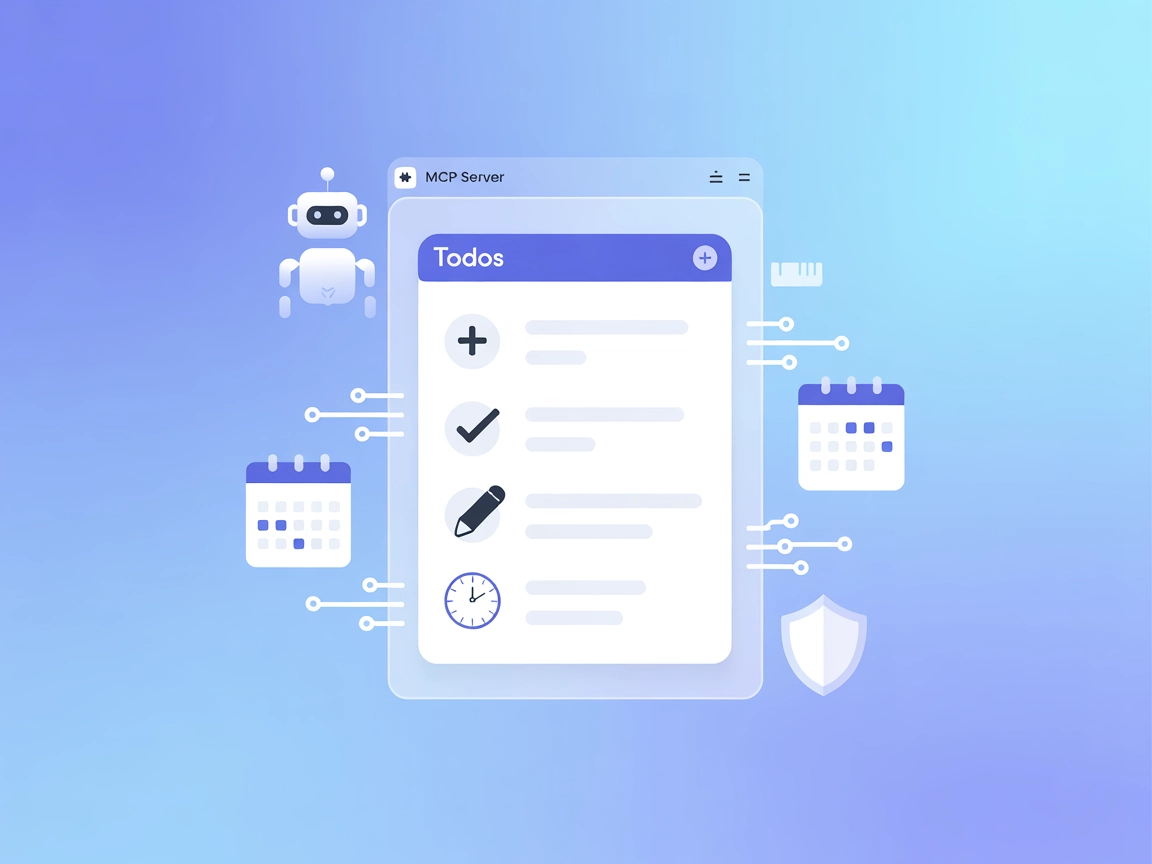

O Todos MCP Server é um aplicativo de lista de tarefas open-source com suporte ao Model Context Protocol (MCP), permitindo que assistentes de IA e chatbots gere...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.