Înțelegerea OpenAI Whisper

Este Whisper un Model sau un Sistem?

OpenAI Whisper poate fi considerat atât un model, cât și un sistem, în funcție de context.

- Ca model, Whisper cuprinde arhitecturi de rețele neuronale proiectate special pentru sarcini ASR. Include mai multe modele de dimensiuni variate, de la 39 de milioane la 1,55 miliarde de parametri. Modelele mai mari oferă o acuratețe mai bună, dar necesită mai multe resurse computaționale.

- Ca sistem, Whisper cuprinde nu doar arhitectura modelului, ci și întreaga infrastructură și procesele aferente. Asta include datele de antrenament, metodele de preprocesare și integrarea diferitelor sarcini pe care le poate realiza, precum identificarea limbii și traducerea.

Capabilitățile de bază ale lui Whisper

Funcția principală a lui Whisper este să transcrie vorbirea în text. Excelează în:

- Recunoaștere vocală multilingvă: Suportă 99 de limbi, fiind un instrument puternic pentru aplicații globale.

- Traducere vocală: Poate traduce vorbirea din orice limbă suportată în text în engleză.

- Identificare a limbii: Detectează automat limba vorbită fără specificare prealabilă.

- Robustețe la accente și zgomot de fundal: Antrenat pe date diverse, Whisper gestionează eficient accentele variate și mediile zgomotoase.

Cum funcționează OpenAI Whisper?

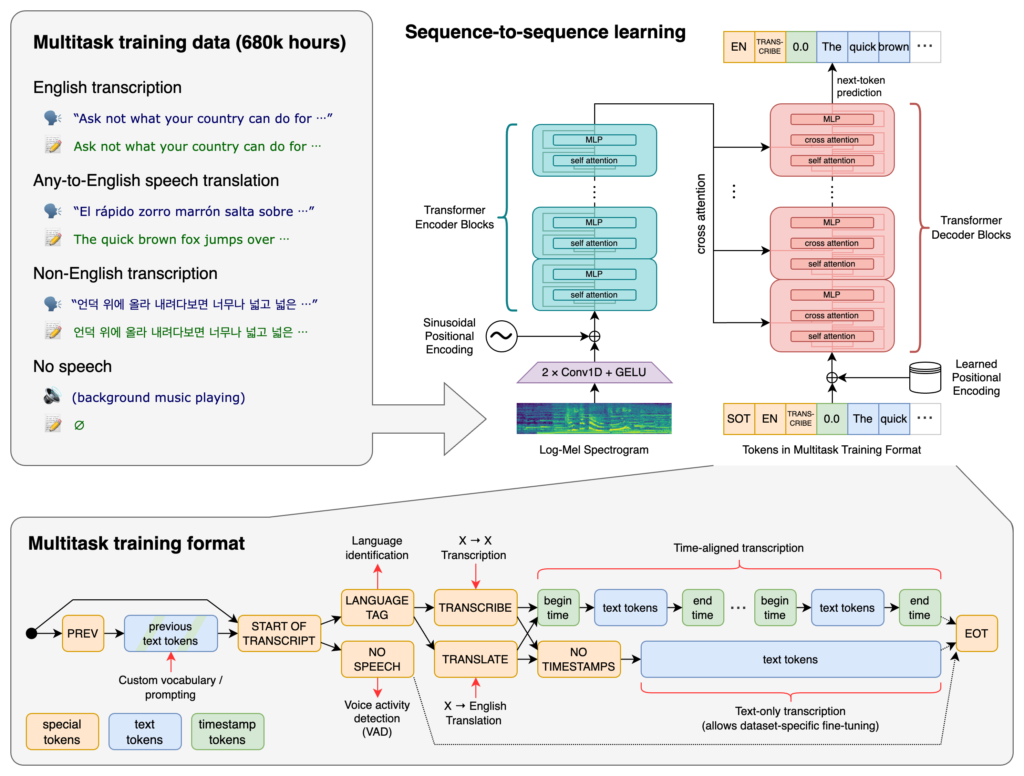

La baza lui Whisper se află arhitectura Transformer, în special un model encoder-decoder. Transformer-ele sunt rețele neuronale care excelează în procesarea datelor secvențiale și înțelegerea contextului pe secvențe lungi. Introduse în lucrarea „Attention is All You Need” în 2017, Transformer-ele au devenit fundamentale în multe sarcini NLP.

Procesul Whisper implică:

- Preprocesarea audio: Audio-ul de intrare este segmentat în bucăți de 30 de secunde și convertit într-o spectrogramă log-Mel, care surprinde frecvența și intensitatea semnalului audio în timp.

- Encoder: Procesează spectrograma pentru a genera o reprezentare numerică a audio-ului.

- Decoder: Folosește un model lingvistic pentru a prezice secvența de tokeni de text (cuvinte sau subcuvinte) corespunzătoare audio-ului de intrare.

- Utilizarea tokenilor speciali: Încorporează tokeni speciali pentru gestionarea sarcinilor precum identificarea limbii, marcaje de timp și directive specifice (ex: transcriere sau traducere).

Antrenare pe Date Multilingve și Multitask Supervizate

Whisper a fost antrenat pe un set masiv de 680.000 de ore de date supervizate colectate de pe web. Acesta include:

- Date multilingve: Aproximativ 117.000 de ore din date sunt în 99 de limbi diferite, crescând capacitatea modelului de a generaliza între limbi.

- Condiții acustice diverse: Setul de date conține audio din diverse domenii și medii, asigurând robustețe la accente, dialecte și zgomote de fundal variate.

- Învățare multitask: Prin antrenare pe mai multe sarcini simultan (transcriere, traducere, identificare a limbii), Whisper învață reprezentări comune ce îi îmbunătățesc performanța generală.

Pregătit să îți dezvolți afacerea?

Începe perioada de probă gratuită astăzi și vezi rezultate în câteva zile.

Aplicații și utilizări

Servicii de transcriere

- Întâlniri virtuale și luare de notițe: Automatizează transcrierea pe platforme dedicate audio general sau industrii specifice precum educație, sănătate, jurnalism și servicii juridice.

- Crearea de conținut: Generează transcrieri pentru podcasturi, videoclipuri și transmisiuni live pentru a crește accesibilitatea și a oferi referințe text.

Traducere vocală

- Comunicare globală: Traduce vorbirea dintr-o limbă în text în engleză, facilitând comunicarea între limbi.

- Instrumente de învățare a limbilor: Ajută cursanții să înțeleagă pronunția și sensul în diferite limbi.

Automatizare AI și chatboți

- Chatboți cu voce: Integrează Whisper în chatboți pentru a permite interacțiuni vocale, îmbunătățind experiența utilizatorului.

- Asistenți AI: Dezvoltă asistenți care pot înțelege și procesa comenzi vocale în diverse limbi.

Îmbunătățiri pentru accesibilitate

- Subtitrări automate: Generează subtitrări pentru conținut video, ajutând persoanele cu deficiențe de auz.

- Tehnologii asistive: Permite dispozitivelor să transcrie și să traducă vorbirea pentru utilizatorii care au nevoie de suport lingvistic.

Call center și suport clienți

- Transcriere în timp real: Oferă agenților transcrieri în timp real ale apelurilor pentru un serviciu mai bun.

- Analiză de sentiment: Analizează textul transcris pentru a evalua sentimentele clienților și a îmbunătăți interacțiunile.

Avantajele OpenAI Whisper

Suport multilingv

Cu acoperire pentru 99 de limbi, Whisper se remarcă prin capacitatea de a gestiona intrări lingvistice diverse. Această capacitate multilingvă îl face potrivit pentru aplicații și servicii globale ce vizează public internațional.

Acuratețe și robustețe ridicate

Antrenat pe date supervizate extinse, Whisper obține rate mari de acuratețe la transcriere. Robustețea sa la accente, dialecte și zgomote de fundal variate îl face de încredere în scenarii reale.

Versatilitate în sarcini

Dincolo de transcriere, Whisper poate realiza:

- Identificare a limbii: Detectează limba vorbită fără input prealabil.

- Traducere vocală: Traduce vorbirea dintr-o limbă în text în engleză.

- Generare de marcaje de timp: Oferă marcaje de timp la nivel de frază în transcrieri.

Disponibilitate open-source

Lansat ca software open-source, Whisper permite dezvoltatorilor să:

- Personalizeze și ajusteze: Adapteze modelul pentru sarcini sau domenii specifice.

- Integreze în aplicații: Includă Whisper în produse și servicii fără constrângeri de licențiere.

- Contribuie la comunitate: Îmbunătățească modelul și să împărtășească modificări.

Abonează-te la newsletter-ul nostru

Primește cele mai recente sfaturi, tendințe și oferte gratuit.

Limitări și aspecte de avut în vedere

Cerințe computaționale

- Consum intensiv de resurse: Modelele mari necesită multă putere de calcul și memorie (până la 10 GB VRAM pentru modelul cel mai mare).

- Timp de procesare: Viteza de transcriere poate varia; modelele mai mari sunt mai lente decât cele mici.

Predispoziție la „halucinații”

- Transcrieri inexacte: Whisper poate produce uneori text care nu a fost rostit, fenomen numit „halucinații”. Acest lucru este mai probabil în anumite limbi sau cu audio de slabă calitate.

Suport limitat pentru limbile non-engleze

- Bias de date: O parte semnificativă din datele de antrenament este în engleză, ceea ce poate afecta acuratețea în limbile mai puțin reprezentate.

- Necesitatea ajustării: Poate fi nevoie de antrenament suplimentar pentru a îmbunătăți performanța în limbi sau dialecte specifice.

- Lungimea audio: Whisper procesează audio în bucăți de 30 de secunde, ceea ce poate complica transcrierea audio-urilor continue, mai lungi.

- Restricții de dimensiune a fișierului: Modelul open-source poate avea limitări privind dimensiunea și formatul fișierelor de intrare.

OpenAI Whisper în automatizare AI și chatboți

Îmbunătățirea interacțiunii cu utilizatorii

Prin integrarea Whisper în chatboți și asistenți AI, dezvoltatorii pot activa:

- Comenzi vocale: Permit utilizatorilor să interacționeze prin vorbire în loc de text.

- Suport multilingv: Pentru utilizatorii care preferă sau au nevoie de limbi diferite.

- Accesibilitate îmbunătățită: Sprijină utilizatorii cu dizabilități sau pe cei ce nu pot folosi metode tradiționale de input.

Simplificarea fluxurilor de lucru

- Transcrieri automate: Reduce efortul manual pentru luarea de notițe sau păstrarea evidenței.

- Analiză de date: Conversia conținutului vorbit în text pentru analiză, monitorizare și obținere de perspective.

Exemple practice

- Boți pentru întâlniri virtuale: Instrumente care participă la întâlniri online pentru a transcrie discuțiile în timp real.

- Boți pentru servicii clienți: Sisteme care înțeleg și răspund la cereri rostite, îmbunătățind experiența clienților.

- Platforme educaționale: Aplicații care transcriu cursuri sau oferă traduceri pentru studenți.

Alternative la OpenAI Whisper

Alternative open-source

- Mozilla DeepSpeech: Un motor ASR open-source ce permite antrenarea de modele personalizate.

- Kaldi: Un toolkit folosit pe scară largă în cercetare și industrie pentru recunoaștere vocală.

- Wav2vec: Sistemul Meta AI pentru procesare vocală self-supervised.

API-uri comerciale

- Google Cloud Speech-to-Text: Oferă recunoaștere vocală cu suport lingvistic extins.

- Microsoft Azure AI Speech: Furnizează servicii vocale cu opțiuni de personalizare.

- AWS Transcribe: Serviciul de recunoaștere vocală al Amazon, cu funcții precum vocabular personalizat.

Furnizori specializați

- Gladia: Oferă o arhitectură Whisper hibridă și îmbunătățită, cu capabilități suplimentare.

- AssemblyAI: Oferă API-uri speech-to-text cu funcții precum moderarea conținutului.

- Deepgram: Oferă transcriere în timp real cu opțiuni pentru antrenarea de modele personalizate.

Factori de luat în calcul la alegerea Whisper

Acuratețe și viteză

- Compromisuri: Modelele mai mari oferă acuratețe mai bună, dar necesită mai multe resurse și sunt mai lente.

- Testare: Evaluează performanța cu date reale relevante pentru aplicația ta.

Volumul de audio

- Scalabilitate: Ia în calcul cerințele hardware și infrastructura pentru procesarea volumelor mari.

- Procesare batch: Implementează metode pentru gestionarea eficientă a seturilor mari de date.

Funcționalități avansate

- Funcții suplimentare: Evaluează dacă ai nevoie de funcții precum transcriere live sau diarizare vorbitor.

- Personalizare: Evaluează efortul necesar pentru a implementa funcții suplimentare.

Suport lingvistic

- Limbi țintă: Verifică performanța modelului în limbile relevante pentru aplicația ta.

- Ajustare: Planifică posibilitatea antrenamentului suplimentar pentru limbile subreprezentate.

Expertiză și resurse

- Expertiză tehnică: Asigură-te că echipa ta are competențele necesare pentru implementare și adaptare.

- Infrastructură: Evaluează cerințele hardware și posibilitățile de hosting.

Considerente de cost

- Open-source vs. comercial: Evaluează economia inițială a open-source-ului versus posibilele costuri pe termen lung cu mentenanța și scalarea.

- Costul total de deținere: Ia în calcul hardware-ul, timpul de dezvoltare și costurile continue de suport.

Cum se folosește Whisper în Python?

Whisper este implementat ca o bibliotecă Python, permițând integrarea facilă în proiecte dezvoltate cu Python. Utilizarea Whisper în Python implică pregătirea mediului potrivit, instalarea dependențelor necesare și folosirea funcțiilor bibliotecii pentru a transcrie sau traduce fișiere audio.

Configurarea Whisper în Python

Înainte de a folosi Whisper, trebuie să pregătești mediul de dezvoltare instalând Python, PyTorch, FFmpeg și biblioteca Whisper.

Cerințe preliminare

- Python: Recomandat versiunea 3.8 până la 3.11.

- PyTorch: Framework-ul de deep learning necesar pentru rularea modelului Whisper.

- FFmpeg: Instrument de linie de comandă pentru procesarea fișierelor audio și video.

- Biblioteca Whisper: Pachetul Python oferit de OpenAI.

Pasul 1: Instalează Python și PyTorch

Dacă nu ai deja Python instalat, descarcă-l de pe site-ul oficial

. Pentru a instala PyTorch, folosește pip:

pip install torch

Alternativ, vizitează site-ul PyTorch

pentru instrucțiuni specifice în funcție de sistemul de operare și versiunea de Python.

Pasul 2: Instalează FFmpeg

Whisper necesită FFmpeg pentru procesarea fișierelor audio. Instalează FFmpeg cu managerul de pachete potrivit pentru sistemul tău de operare.

Ubuntu/Debian:

sudo apt update && sudo apt install ffmpeg

MacOS (cu Homebrew):

brew install ffmpeg

Windows (cu Chocolatey):

choco install ffmpeg

Pasul 3: Instalează biblioteca Whisper

Instalează pachetul Python Whisper folosind pip:

pip install -U openai-whisper

Pentru a instala cea mai recentă versiune direct de pe repository-ul GitHub:

pip install git+https://github.com/openai/whisper.git

Notă pentru utilizatorii Windows

Asigură-te că este activat Developer Mode:

- Mergi la Settings.

- Navighează la Privacy & Security > For Developers.

- Activează Developer Mode.

Modele disponibile și specificații

Whisper oferă mai multe modele ce variază ca dimensiune și capabilități. Modelele variază de la tiny la large, fiecare echilibrând diferit viteza și acuratețea.

| Dimensiune | Parametri | Model doar pentru engleză | Model multilingv | VRAM necesar | Viteză relativă |

|---|

| tiny | 39 M | tiny.en | tiny | ~1 GB | ~32x |

| base | 74 M | base.en | base | ~1 GB | ~16x |

| small | 244 M | small.en | small | ~2 GB | ~6x |

| medium | 769 M | medium.en | medium | ~5 GB | ~2x |

| large | 1550 M | N/A | large | ~10 GB | 1x |

Alegerea modelului potrivit

- Modele doar pentru engleză (

.en): Optimizate pentru transcriere în engleză, oferind performanță îmbunătățită pentru audio în engleză. - Modele multilingve: Capabile să transcrie mai multe limbi, potrivite pentru aplicații globale.

- Dimensiunea modelului: Modelele mari oferă acuratețe mai mare, dar necesită mai multe resurse computaționale. Selectează modelul potrivit hardware-ului și cerințelor tale.

Utilizarea Whisper în Python

După ce ai configurat mediul și ai instalat componentele necesare, poți începe să folosești Whisper în proiectele tale Python.

Importarea bibliotecii și încărcarea unui model

Începe prin a importa biblioteca Whisper și a încărca un model:

import whisper

# Încarcă modelul dorit

model = whisper.load_model("base")

Înlocuiește "base" cu numele modelului potrivit aplicației tale.

Transcrierea fișierelor audio

Whisper oferă o funcție simplă transcribe pentru a converti fișiere audio în text.

Exemplu: Transcrierea unui fișier audio în engleză

# Transcrie fișierul audio

result = model.transcribe("cale/catre/audio_engleza.mp3")

# Afișează transcrierea

print(result["text"])

Explicație

model.transcribe(): Procesează fișierul audio și returnează un dicționar cu transcrierea și alte meta-date.result["text"]: Accesează textul transcris din rezultat.

Traducerea audio în engleză

Whisper poate traduce audio din diferite limbi în engleză.

Exemplu: Traducerea audio spaniol în engleză

# Transcrie și traduce audio spaniol în engleză

result = model.transcribe("cale/catre/audio_spaniola.mp3", task="translate")

# Afișează textul tradus

print(result["text"])

Explicație

task="translate": Indică modelului să traducă audio în engleză, nu doar să îl transcrie literal.

Specificarea limbii

Deși Whisper poate detecta automat limba, specificarea acesteia poate îmbunătăți acuratețea și viteza.

Exemplu: Transcrierea unui audio în franceză

# Transcrie audio francez specificând limba

result = model.transcribe("cale/catre/audio_franceza.wav", language="fr")

# Afișează transcrierea

print(result["text"])

Detectarea limbii audio

Whisper poate identifica limba vorbită într-un fișier audio folosind metoda detect_language.

Exemplu: Detectarea limbii

# Încarcă și preprocesează audio-ul

audio = whisper.load_audio("cale/catre/audio_limba_necunoscută.mp3")

audio = whisper.pad_or_trim(audio)

# Convertește în spectrogramă log-Mel

mel = whisper.log_mel_spectrogram(audio).to(model.device)

# Detectează limba

_, probs = model.detect_language(mel)

language = max(probs, key=probs.get)

print(f"Limba detectată: {language}")

Explicație

whisper.load_audio(): Încarcă fișierul audio.whisper.pad_or_trim(): Ajustează lungimea audio-ului pentru a se potrivi cerințelor modelului.whisper.log_mel_spectrogram(): Convertește audio-ul în formatul așteptat de model.model.detect_language(): Returnează probabilități pentru fiecare limbă, identificând cea mai probabilă limbă vorbită.

Utilizare avansată și personalizare

Pentru un control mai mare asupra procesului de transcriere, poți folosi funcții la nivel inferior și poți personaliza opțiunile de decodare.

Utilizarea funcției decode

Funcția decode permite specificarea unor opțiuni precum limba, sarcina și dacă să fie incluse marcaje de timp.

Exemplu: Opțiuni de decodare personalizate

# Setează opțiunile de decodare

options = whisper.DecodingOptions(language="de", without_timestamps=True)

# Decodează audio-ul

result = whisper.decode(model, mel, options)

# Afișează textul recunoscut

print(result.text)

Procesarea audio-ului live

Poți integra Whisper pentru a transcrie input audio live de la microfon.

Exemplu: Transcrierea input-ului live de la microfon

import whisper

import sounddevice as sd

# Încarcă modelul

model = whisper.load_model("base")

# Înregistrează audio de la microfon

duration = 5 # secunde

fs = 16000 # Rată de eșantionare

print("Înregistrare...")

audio = sd.rec(int(duration * fs), samplerate=fs, channels=1, dtype='float32')

sd.wait