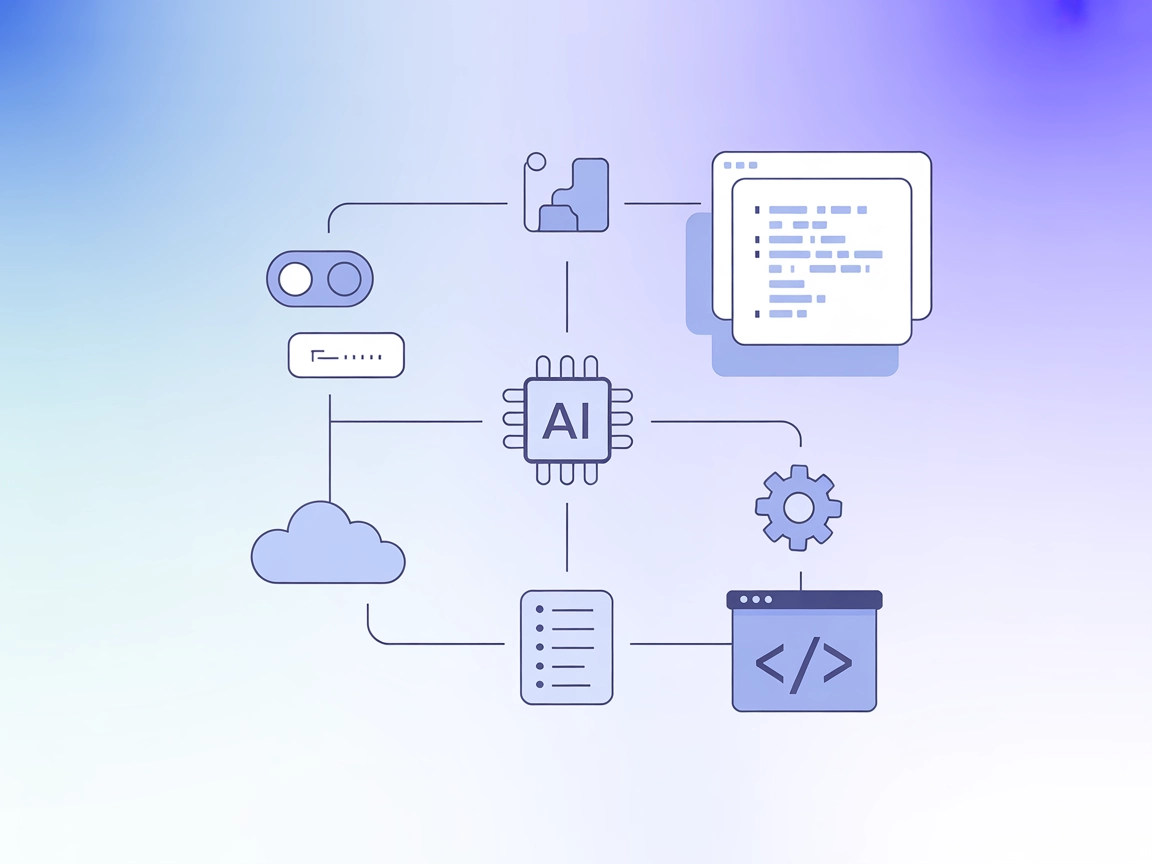

Integrarea serverului ModelContextProtocol (MCP)

Serverul ModelContextProtocol (MCP) acționează ca o punte între agenții AI și sursele externe de date, API-uri și servicii, permițând utilizatorilor FlowHunt să...

Conectează fără efort agenții tăi AI la flag-urile de funcționalitate Unleash cu Unleash MCP Server pentru decizii automate, gestionare a flag-urilor și integrare agilă a proiectelor.

FlowHunt oferă un strat suplimentar de securitate între sistemele dvs. interne și instrumentele AI, oferindu-vă control granular asupra instrumentelor care sunt accesibile de la serverele dvs. MCP. Serverele MCP găzduite în infrastructura noastră pot fi integrate fără probleme cu chatbotul FlowHunt, precum și cu platforme AI populare precum ChatGPT, Claude și diverși editori AI.

Unleash MCP Server este o implementare Model Context Protocol (MCP) care conectează asistenții AI și aplicațiile LLM cu sistemul Unleash Feature Toggle. Acționează ca o punte, permițând clienților AI să interogheze statusul flag-urilor de funcționalitate, să listeze proiecte și să gestioneze flag-urile direct din Unleash prin interfețe MCP standardizate. Această integrare permite dezvoltatorilor să automatizeze managementul funcționalităților, să expună datele flag-urilor agenților AI pentru decizii informate și să simplifice fluxurile de lucru ce depind de toggling-ul dinamic al funcționalităților în sisteme software. Prin furnizarea de unelte și resurse care interacționează cu Unleash, serverul oferă aplicațiilor conduse de AI posibilitatea de a îmbunătăți pipeline-urile de dezvoltare, de a rula verificări automate și de a participa la operațiuni de gestionare a funcționalităților.

mcpServers folosind următorul fragment JSON:"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

Folosește variabile de mediu pentru a stoca informațiile sensibile:

{

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"],

"env": {

"UNLEASH_API_KEY": "${UNLEASH_API_KEY}"

},

"inputs": {

"apiUrl": "https://unleash.example.com/api"

}

}

}

}

mcpServers:"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

Folosirea MCP în FlowHunt

Pentru a integra serverele MCP în fluxul tău FlowHunt, adaugă componenta MCP în flow și conecteaz-o la agentul tău AI:

Fă click pe componenta MCP pentru a deschide panoul de configurare. În secțiunea de configurare MCP de sistem, inserează detaliile serverului folosind acest format JSON:

{

"unleash-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

După configurare, agentul AI poate folosi acest MCP ca unealtă cu acces la toate funcțiile și capabilitățile sale. Nu uita să schimbi "unleash-mcp" cu numele real al serverului tău MCP și să adaptezi URL-ul corespunzător.

| Secțiune | Disponibilitate | Detalii/Note |

|---|---|---|

| Prezentare generală | ✅ | Oferă o privire de ansamblu asupra integrării cu Unleash și aplicații LLM |

| Lista de Prompturi | ✅ | Șablon de prompt flag-check |

| Lista de Resurse | ✅ | flags, projects |

| Lista de Unelte | ✅ | get-flag, get-projects |

| Securizarea cheilor API | ✅ | Exemplu de utilizare a variabilelor de mediu |

| Suport Sampling (mai puțin important la evaluare) | ⛔ | Nu este menționat |

Unleash MCP Server oferă o integrare clară și bine focusată pentru managementul flag-urilor de funcționalitate în fluxurile LLM. Repository-ul acoperă toate primitivele MCP esențiale, oferă instrucțiuni practice de configurare și demonstrează bune practici de securitate. Totuși, funcționalități avansate MCP precum sampling și roots nu sunt documentate explicit. Per ansamblu, este un MCP server solid și specializat, cu o valoare clară pentru dezvoltatori.

| Are o LICENȚĂ | ✅ (MIT) |

|---|---|

| Are cel puțin o unealtă | ✅ |

| Număr Fork-uri | 0 |

| Număr Stele | 8 |

Unleash MCP Server este o implementare Model Context Protocol care conectează asistenți AI și aplicații LLM cu sistemul Unleash Feature Toggle, permițând gestionarea automată a flag-urilor de funcționalitate, descoperirea proiectelor și expunerea dinamică a funcționalităților.

Oferă un șablon de prompt `flag-check`, expune `flags` și `projects` ca resurse MCP și pune la dispoziție uneltele `get-flag` și `get-projects` pentru interacțiunea cu datele Unleash.

Urmează instrucțiunile de configurare pentru platforma ta (Windsurf, Claude, Cursor sau Cline), asigurându-te că Node.js este instalat și variabilele de mediu sunt setate în siguranță pentru accesul la API.

Utilizările includ monitorizarea AI a flag-urilor de funcționalitate, gestionare automată a funcționalităților, descoperire de proiecte, expunere contextuală a flag-urilor pentru LLM-uri și integrare în pipeline-uri de deployment continuu.

Permite automatizarea toggling-ului flag-urilor de funcționalitate și managementul proiectelor ca parte a pipeline-urilor CI/CD, crescând agilitatea deploymentului și reducând intervenția manuală.

Oferă agenților tăi AI puterea de a gestiona și monitoriza programatic flag-urile de funcționalitate. Simplifică fluxurile de deployment și decizie cu integrarea Unleash MCP Server.

Serverul ModelContextProtocol (MCP) acționează ca o punte între agenții AI și sursele externe de date, API-uri și servicii, permițând utilizatorilor FlowHunt să...

Integrează FlowHunt cu Unleash Feature Toggle pentru o gestionare fără probleme a flag-urilor de funcționalitate în aplicațiile tale LLM. Verifică, creează și a...

Serverul MCP any-chat-completions-mcp conectează FlowHunt și alte unelte la orice API de Chat Completion compatibil cu SDK-ul OpenAI. Permite integrarea fără pr...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.