Integracja serwera Langfuse MCP

Serwer Langfuse MCP łączy FlowHunt i innych klientów AI z repozytoriami promptów Langfuse za pomocą Model Context Protocol, umożliwiając scentralizowane wyszuki...

Bezproblemowo połącz swoich agentów AI z flagami funkcji Unleash za pomocą serwera Unleash MCP, aby automatyzować podejmowanie decyzji, zarządzanie flagami i integrację zwinną z projektami.

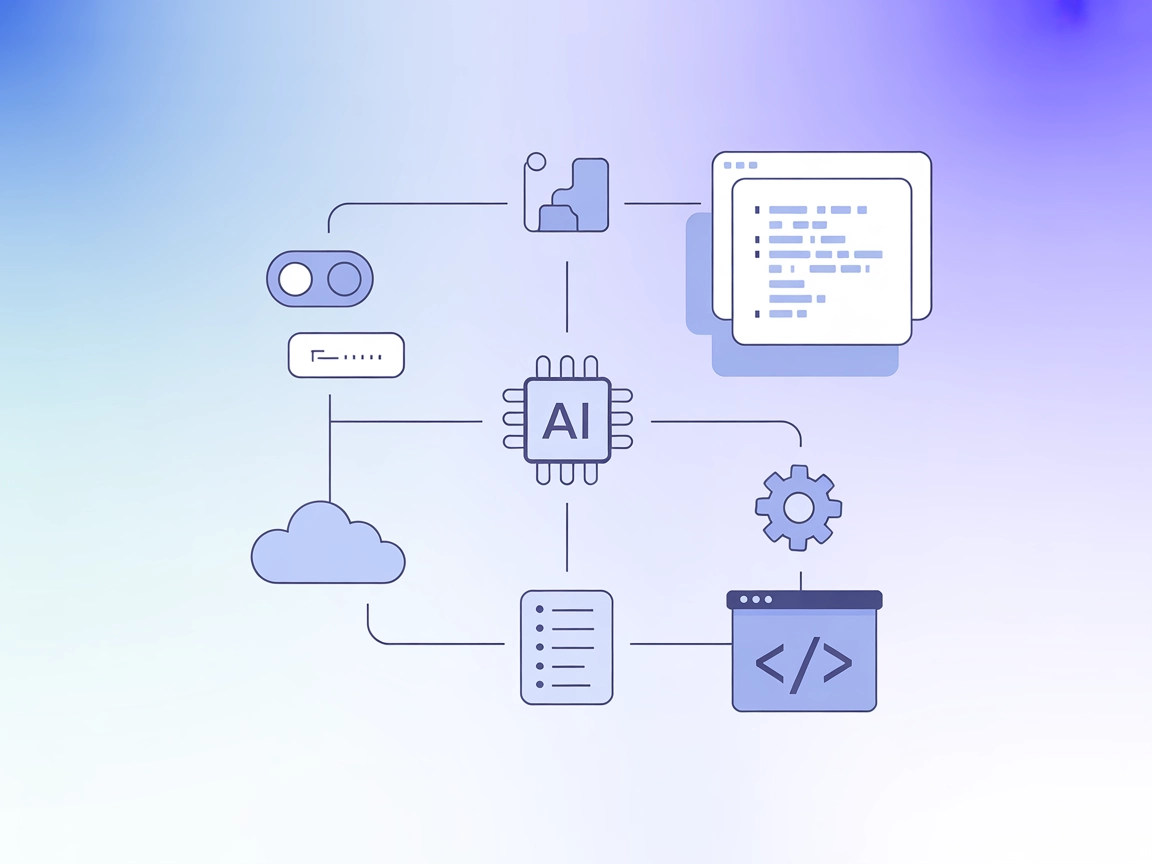

FlowHunt zapewnia dodatkową warstwę bezpieczeństwa między Twoimi systemami wewnętrznymi a narzędziami AI, dając Ci szczegółową kontrolę nad tym, które narzędzia są dostępne z Twoich serwerów MCP. Serwery MCP hostowane w naszej infrastrukturze można bezproblemowo zintegrować z chatbotem FlowHunt oraz popularnymi platformami AI, takimi jak ChatGPT, Claude i różne edytory AI.

Serwer Unleash MCP to implementacja Model Context Protocol (MCP), która łączy asystentów AI i aplikacje LLM z systemem Unleash Feature Toggle. Działa jako most, umożliwiając klientom AI zapytania o status flag funkcji, listowanie projektów i zarządzanie flagami bezpośrednio w Unleash za pomocą standaryzowanych interfejsów MCP. Ta integracja pozwala deweloperom automatyzować zarządzanie flagami, udostępniać dane o flagach agentom AI do podejmowania świadomych decyzji oraz usprawniać przepływy pracy zależne od dynamicznego przełączania funkcji w systemach programistycznych. Dzięki narzędziom i zasobom pozwalającym wchodzić w interakcję z Unleash, serwer umożliwia aplikacjom opartym na AI udoskonalanie pipeline’ów deweloperskich, wykonywanie automatycznych kontroli oraz uczestnictwo w operacjach zarządzania flagami.

mcpServers używając poniższego fragmentu JSON:"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

Użyj zmiennych środowiskowych do przechowywania poufnych informacji:

{

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"],

"env": {

"UNLEASH_API_KEY": "${UNLEASH_API_KEY}"

},

"inputs": {

"apiUrl": "https://unleash.example.com/api"

}

}

}

}

mcpServers:"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

Wykorzystanie MCP w FlowHunt

Aby zintegrować serwery MCP z przepływem FlowHunt, zacznij od dodania komponentu MCP do swojego flow i połącz go z agentem AI:

Kliknij komponent MCP, aby otworzyć panel konfiguracji. W sekcji konfiguracji systemu MCP wprowadź dane swojego serwera MCP w poniższym formacie JSON:

{

"unleash-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI będzie mógł korzystać z tego MCP jako narzędzia, mając dostęp do wszystkich jego funkcji. Pamiętaj, aby zmienić "unleash-mcp" na faktyczną nazwę swojego serwera MCP i odpowiednio podmienić URL.

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | Przegląd integracji z Unleash i aplikacjami LLM |

| Lista promptów | ✅ | Szablon prompta flag-check |

| Lista zasobów | ✅ | flags, projects |

| Lista narzędzi | ✅ | get-flag, get-projects |

| Zabezpieczanie kluczy API | ✅ | Przykład użycia zmiennych środowiskowych |

| Wsparcie dla sampling (mniej istotne) | ⛔ | Nie wspomniano |

Serwer Unleash MCP zapewnia przejrzystą, wyspecjalizowaną integrację do zarządzania flagami funkcji w przepływach opartych o LLM. Repozytorium obejmuje wszystkie kluczowe prymitywy MCP, oferuje praktyczne instrukcje konfiguracji i prezentuje dobre praktyki bezpieczeństwa. Zaawansowane funkcje MCP, takie jak sampling czy roots, nie są jednak szczegółowo opisane. Ogólnie rzecz biorąc, to solidny, wyspecjalizowany serwer MCP z wyraźną wartością dla deweloperów.

| Posiada LICENCJĘ | ✅ (MIT) |

|---|---|

| Ma przynajmniej jedno narzędzie | ✅ |

| Liczba forków | 0 |

| Liczba gwiazdek | 8 |

Umożliw swoim agentom AI programowe zarządzanie i monitorowanie flag funkcji. Usprawnij wdrażanie i przepływy decyzyjne dzięki integracji z serwerem Unleash MCP.

Serwer Langfuse MCP łączy FlowHunt i innych klientów AI z repozytoriami promptów Langfuse za pomocą Model Context Protocol, umożliwiając scentralizowane wyszuki...

Zintegruj FlowHunt z Unleash Feature Toggle, aby bezproblemowo zarządzać flagami funkcji w aplikacjach LLM. Natychmiast sprawdzaj, twórz i aktualizuj flagi prog...

Serwer Upstash MCP umożliwia asystentom i agentom AI bezproblemowe zarządzanie bazami danych w chmurze Upstash za pomocą poleceń języka naturalnego lub programo...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.