Integrare Vectorize MCP Server

Integrează Vectorize MCP Server cu FlowHunt pentru a permite recuperarea avansată a vectorilor, căutare semantică și extragere de text pentru fluxuri de lucru A...

Conectează în siguranță agenții FlowHunt la platforma RAG puternică a Vectara cu Vectara MCP Server pentru răspunsuri AI de încredere, bogate în context și regăsire avansată a cunoștințelor.

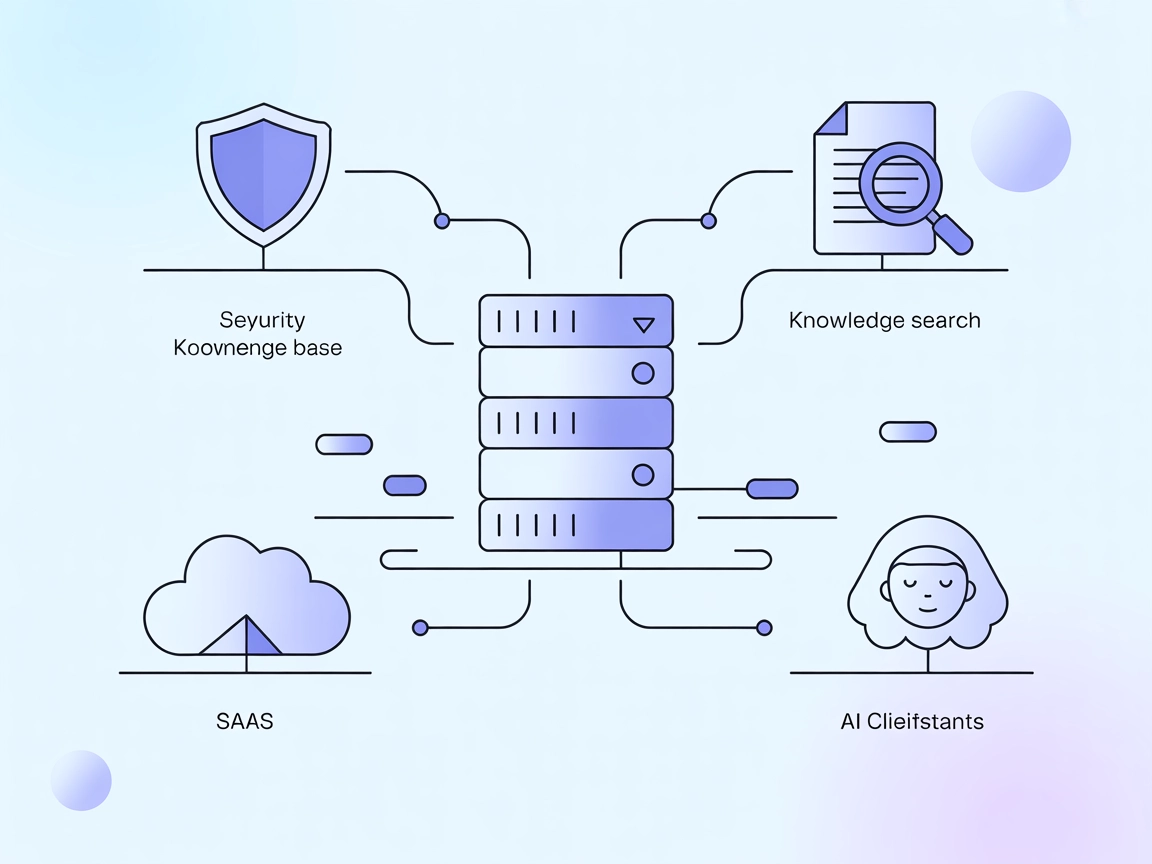

FlowHunt oferă un strat suplimentar de securitate între sistemele dvs. interne și instrumentele AI, oferindu-vă control granular asupra instrumentelor care sunt accesibile de la serverele dvs. MCP. Serverele MCP găzduite în infrastructura noastră pot fi integrate fără probleme cu chatbotul FlowHunt, precum și cu platforme AI populare precum ChatGPT, Claude și diverși editori AI.

Vectara MCP Server este o implementare open source a Model Context Protocol (MCP), proiectată pentru a conecta asistenții AI cu platforma Trusted RAG (Retrieval-Augmented Generation) a Vectara. Fiind un server MCP, permite sistemelor AI să execute în siguranță și eficient sarcini sofisticate de căutare și regăsire asupra motorului fiabil de regăsire al Vectara. Acest lucru facilitează conexiuni bidirecționale, fără întreruperi, între clienții AI și sursele externe de date, permițând dezvoltatorilor să-și îmbunătățească fluxurile cu capabilități avansate RAG, să reducă halucinațiile și să simplifice accesul la informații relevante pentru aplicațiile AI generative.

Nu sunt menționate șabloane de prompt specifice în documentația sau fișierele repository disponibile.

Nu sunt listate resurse MCP explicite în documentația sau fișierele repository disponibile.

pip install vectara-mcp.mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp).mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.mcpServers:{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

pip install vectara-mcp.{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": []

}

}

}

Se recomandă cu tărie stocarea cheilor API sensibile în variabile de mediu, nu în fișierele de configurare. Exemplu:

{

"mcpServers": {

"vectara-mcp": {

"command": "vectara-mcp",

"args": [],

"env": {

"VECTARA_API_KEY": "${VECTARA_API_KEY}"

},

"inputs": {

"api_key": "${VECTARA_API_KEY}"

}

}

}

}

Utilizarea MCP în FlowHunt

Pentru a integra serverele MCP în fluxul tău FlowHunt, începe prin a adăuga componenta MCP în flux și conecteaz-o la agentul tău AI:

Fă clic pe componenta MCP pentru a deschide panoul de configurare. În secțiunea de configurație MCP a sistemului, introdu detaliile serverului MCP folosind acest format JSON:

{

"vectara-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

După configurare, agentul AI poate utiliza acest MCP ca instrument cu acces la toate funcțiile și capabilitățile sale. Nu uita să schimbi „vectara-mcp” cu numele real al serverului tău MCP și să înlocuiești URL-ul cu cel propriu.

| Secțiune | Disponibilitate | Detalii/Note |

|---|---|---|

| Prezentare generală | ✅ | Prezentare și funcție Vectara MCP Server furnizată |

| Listă de Prompts | ⛔ | Nespecificat în documentația disponibilă |

| Listă de Resurse | ⛔ | Nespecificat în documentația disponibilă |

| Listă de Instrumente | ✅ | Doar instrumentul ask_vectara descris |

| Securizarea Cheilor API | ✅ | Documentat cu exemplu JSON/env |

| Suport pentru Sampling (mai puțin relevant) | ⛔ | Nespecificat |

Vectara MCP oferă o integrare clară și focusată pentru RAG, cu documentație solidă pentru configurare și securitatea cheilor API, dar îi lipsesc detalii despre prompts, resurse sau sampling/roots. Este excelent pentru activarea RAG în fluxuri agentice, însă lipsa unor funcții MCP mai bogate îi limitează versatilitatea.

| Are o LICENȚĂ | ✅ (Apache-2.0) |

|---|---|

| Are cel puțin un instrument | ✅ |

| Număr de Fork-uri | 2 |

| Număr de Stele | 8 |

Evaluare: 5/10 — Este solid și gata de producție pentru cazul său de utilizare RAG, dar acoperă doar un set minim de funcții MCP și îi lipsește documentația despre prompts, resurse și concepte MCP avansate.

Vectara MCP Server este o implementare open source a Model Context Protocol, conectând asistenții AI la platforma Trusted RAG a Vectara. Permite căutare și regăsire sigură și eficientă pentru fluxurile de lucru AI generative.

Instrumentul principal este `ask_vectara`, care execută o interogare RAG către Vectara și returnează rezultate de căutare cu un răspuns generat. Acest instrument necesită interogări de la utilizator, chei de corpus Vectara și o cheie API.

Cazurile cheie includ Generare Augmentată prin Regăsire (RAG) pentru minimizarea halucinațiilor, integrare în căutarea enterprise, automatizarea managementului cunoștințelor și acces securizat la date sensibile prin protecție cu cheie API.

Stochează cheile API în variabile de mediu, nu în fișiere de configurare. Folosește configurații JSON cu variabile precum `${VECTARA_API_KEY}` pentru securitate sporită.

Adaugă componenta MCP în fluxul tău FlowHunt, configureaz-o cu detaliile serverului tău Vectara MCP și conecteaz-o la agentul AI. Astfel, agentul va putea accesa capabilitățile avansate de regăsire ale Vectara.

Deși este robust pentru RAG și căutare, în prezent îi lipsește documentația detaliată despre șabloanele de prompt, resurse MCP suplimentare și funcții avansate de sampling sau MCP root.

Oferă agenților AI răspunsuri sigure, factuale și conștiente de context prin integrarea Vectara MCP Server în fluxurile de lucru FlowHunt.

Integrează Vectorize MCP Server cu FlowHunt pentru a permite recuperarea avansată a vectorilor, căutare semantică și extragere de text pentru fluxuri de lucru A...

Serverul Vertica MCP permite integrarea fără întreruperi între asistenții AI și bazele de date OpenText Vertica, susținând operațiuni SQL securizate, încărcare ...

Serverul Wikidata MCP permite agenților AI și dezvoltatorilor să interacționeze cu API-ul Wikidata prin Model Context Protocol. Oferă instrumente pentru căutare...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.