Stability AI SD3 Large: Podrobná recenzia AI generátora obrázkov

Preskúmajte našu podrobnú recenziu Stability AI SD3 Large. Analyzujte jeho silné a slabé stránky, kreativitu pri rôznych textových zadaniach a zistite, ako tent...

Stable Diffusion je popredný AI model na prevod textu na obrázok, ktorý umožňuje používateľom generovať fotorealistické vizuály z podnetov pomocou pokročilých latentných difúznych a hlbokoučiacich techník.

Stable Diffusion je AI model na prevod textu na obrázok, ktorý vytvára vysoko kvalitné obrázky z popisov pomocou hlbokého učenia. Využíva techniky ako negatívne podnety a referenčné obrázky pre lepšie výsledky, najmä pri zložitých prvkoch, ako sú ruky.

Stable Diffusion je pokročilý model generovania obrázkov z textu, ktorý využíva techniky hlbokého učenia na tvorbu vysoko kvalitných, fotorealistických obrázkov na základe textových popisov. Vyvinutý ako latentný difúzny model predstavuje významný prelom v oblasti generatívnej umelej inteligencie, keďže kombinuje princípy difúznych modelov a strojového učenia na tvorbu obrázkov, ktoré presne zodpovedajú zadaným textovým podnetom.

Stable Diffusion využíva hlboké učenie a difúzne modely na generovanie obrázkov postupným vylepšovaním náhodného šumu do ucelených vizuálov. Napriek rozsiahlemu trénovaniu na miliónoch obrázkov má stále problémy so zložitými prvkami, ako sú ruky. Postupom času, ako sú modely trénované na čoraz väčších datasetoch, sa tieto problémy minimalizujú a kvalita obrázkov je čoraz realistickejšia.

Jednou z účinných metód na riešenie problému s rukami je použitie negatívnych podnetov. Pridaním fráz ako (-bad anatomy) alebo (-bad hands -unnatural hands) do vašich podnetov môžete AI inštruovať, aby sa vyhla deformovaným črtám. Dávajte si však pozor na nadmerné používanie negatívnych podnetov, pretože môžu obmedziť kreatívny výstup modelu.

Ďalšou technikou je použitie referenčných obrázkov na usmernenie AI. Zahrnutím tagu {image} s odkazom na referenčný obrázok vo vašom podnete poskytnete AI vizuálnu šablónu pre presné vykreslenie rúk. To je obzvlášť užitočné na zachovanie správnych proporcií a pozícií rúk.

Pre najlepšie výsledky kombinujte negatívne podnety aj referenčné obrázky. Tento dvojitý prístup zabezpečí, že sa AI vyhne bežným chybám a zároveň sa bude držať kvalitných príkladov.

(-bent fingers) alebo (realistické perspektívy) na ďalšie zvýšenie kvality rúk.Ovládnutím týchto techník môžete výrazne zlepšiť vykresľovanie rúk vo vašich výtvoroch zo Stable Diffusion a dosiahnuť umelecké diela s precíznosťou skúseného umelca. Nazbierajte si referenčné obrázky, vytvorte presné podnety a sledujte, ako sa vaše AI umenie vyvíja!

V jadre Stable Diffusion funguje tak, že prevádza textové podnety na vizuálne reprezentácie prostredníctvom série výpočtových procesov. Pochopenie jeho fungovania zahŕňa ponorenie sa do konceptov difúznych modelov, latentných priestorov a neurónových sietí.

Difúzne modely sú triedou generatívnych modelov v strojovom učení, ktoré sa učia vytvárať dáta obrátením difúzneho procesu. Difúzny proces spočíva v postupnom pridávaní šumu do dát—napríklad obrázkov—až kým nie sú na nerozoznanie od náhodného šumu. Model sa potom učí tento proces obrátiť, odstraňujúc šum krok za krokom, aby obnovil pôvodné dáta. Tento spätný difúzny proces je kľúčom k generovaniu nových, ucelených dát z náhodného šumu.

Stable Diffusion konkrétne používa latentný difúzny model. Na rozdiel od tradičných difúznych modelov, ktoré pracujú priamo v vysoko-dimenzionálnom pixelovom priestore obrázkov, latentné difúzne modely fungujú v komprimovanom latentnom priestore. Tento latentný priestor je nižšia dimenzionálna reprezentácia dát, zachytávajúca podstatné črty pri zníženej výpočtovej náročnosti. Práca v latentnom priestore umožňuje Stable Diffusion efektívnejšie generovať obrázky vo vysokom rozlíšení.

Jadrom Stable Diffusion je spätný difúzny proces v latentnom priestore. Začínajúc náhodným šumovým latentným vektorom model postupne vylepšuje túto latentnú reprezentáciu predikciou a odstraňovaním šumu v každom kroku. Toto vylepšovanie je vedené textovým popisom zadaným používateľom. Proces pokračuje, kým sa latentný vektor nekonverguje do stavu, ktorý po dekódovaní vytvorí obrázok zodpovedajúci textovému podnetu.

Architektúra Stable Diffusion integruje niekoľko kľúčových komponentov, ktoré spolupracujú na prevode textových podnetov na obrázky.

VAE slúži ako enkodér-dekodér systém, ktorý komprimuje obrázky do latentného priestoru a rekonštruuje ich späť do obrázkov. Enkodér prevedie obrázok do jeho latentnej reprezentácie, zachytávajúc základné črty v zredukovanej forme. Dekodér vezme túto latentnú reprezentáciu a rekonštruuje ju do detailného obrázka.

Tento proces je kľúčový, pretože umožňuje modelu pracovať s dátami nižšej dimenzie, čo výrazne znižuje výpočtové nároky oproti práci v plnom pixelovom priestore.

U-Net je špecializovaná architektúra neurónovej siete používaná v Stable Diffusion na úlohy spracovania obrázkov. Skladá sa z enkódovacej a dekódovacej vetvy s prepojovacími spojmi medzi zrkadlovými vrstvami. V kontexte Stable Diffusion funguje U-Net ako prediktor šumu počas spätného difúzneho procesu.

V každom časovom kroku difúzneho procesu U-Net predikuje množstvo šumu prítomného v latentnej reprezentácii. Táto predikcia sa potom použije na vylepšenie latentného vektora odčítaním odhadnutého šumu, čím sa postupne odstráni šum v latentnom priestore smerom k obrázku v súlade s textovým podnetom.

Na zahrnutie textových informácií Stable Diffusion používa textový enkodér založený na modeli CLIP (Contrastive Language-Image Pretraining). CLIP je navrhnutý na pochopenie a prepojenie textových a vizuálnych informácií mapovaním do spoločného latentného priestoru.

Keď používateľ zadá textový podnet, textový enkodér ho prevedie do série embeddingov—číselných reprezentácií textových dát. Tieto embeddingy podmieňujú U-Net počas spätného difúzneho procesu, vedúc generovanie obrázka tak, aby odrážal obsah textového podnetu.

Stable Diffusion ponúka univerzálnosť v generovaní obrázkov a možno ho využívať rôznymi spôsobmi podľa potrieb používateľa.

Primárne využitie Stable Diffusion je generovanie obrázkov z textových podnetov. Používatelia zadajú opisný text a model vygeneruje obrázok, ktorý zodpovedá popisu. Napríklad používateľ môže zadať „Pokojná pláž pri západe slnka s palmami“ a získať obrázok zobrazujúci túto scénu.

Táto schopnosť je obzvlášť cenná v kreatívnom priemysle, tvorbe obsahu a dizajne, kde je rýchla vizualizácia konceptov nevyhnutná.

Okrem generovania obrázkov od nuly dokáže Stable Diffusion upravovať existujúce obrázky na základe textových inštrukcií. Poskytnutím počiatočného obrázka a textového podnetu model vytvorí nový obrázok, ktorý zahŕňa zmeny opísané v texte.

Napríklad používateľ môže zadať obrázok denného mesta s podnetom „zmeniť na nočnú scénu s neónovými svetlami“, čím získa obrázok zodpovedajúci týmto úpravám.

Dopĺňanie (inpainting) znamená vyplnenie chýbajúcich alebo poškodených častí obrázka. Stable Diffusion v tejto oblasti vyniká použitím textových podnetov na usmernenie rekonštrukcie konkrétnych oblastí obrázka. Používatelia môžu zamaskovať časti obrázka a poskytnúť textový opis toho, čo má priestor vyplniť.

Táto funkcia je užitočná pri obnove fotografií, odstraňovaní nežiaducich objektov alebo úprave konkrétnych prvkov na obrázku pri zachovaní celkovej súdržnosti.

Generovaním sekvencií obrázkov s malými variáciami je možné Stable Diffusion rozšíriť na tvorbu animácií alebo videoobsahu. Nástroje ako Deforum rozširujú možnosti Stable Diffusion na tvorbu dynamického vizuálneho obsahu vedeného textovými podnetmi v čase.

To otvára možnosti v animácii, vizuálnych efektoch a generovaní dynamického obsahu bez potreby tradičných techník snímkovania po snímke.

Schopnosť Stable Diffusion generovať obrázky z textových popisov z neho robí silný nástroj v AI automatizácii a vývoji chatbotov.

Zahrnutie Stable Diffusion do chatbotov umožňuje generovanie vizuálneho obsahu v reakcii na požiadavky používateľov. Napríklad v zákazníckom servise môže chatbot poskytovať vizuálne návody alebo ilustrácie generované v reálnom čase na pomoc používateľom.

Textové podnety sa prevádzajú na embeddingy pomocou CLIP textového enkodéra. Tieto embeddingy sú kľúčové pre podmieňovanie procesu generovania obrázkov, zabezpečujúc, že výstupný obrázok bude zodpovedať textovému opisu používateľa.

Spätný difúzny proces zahŕňa postupné vylepšovanie latentnej reprezentácie odstraňovaním predikovaného šumu. V každom časovom kroku model zohľadňuje textové embeddingy a aktuálny stav latentného vektora na presnú predikciu šumovej zložky.

Schopnosť modelu efektívne pracovať s obrázkami so šumom vyplýva z jeho trénovania na veľkých datasetoch, kde sa učí rozpoznávať a odšumovať obrázky. Toto trénovanie mu umožňuje generovať čisté obrázky aj pri štarte z náhodného šumu.

Práca v latentnom priestore prináša výpočtovú efektivitu. Keďže latentný priestor má menej rozmerov ako pixelový, operácie sú menej náročné na zdroje. Táto efektivita umožňuje Stable Diffusion generovať obrázky vo vysokom rozlíšení bez nadmerných výpočtových nárokov.

Umelci a dizajnéri môžu Stable Diffusion využiť na rýchlu tvorbu vizuálov podľa koncepčných popisov, čím podporia kreatívny proces a skrátia čas od nápadu k vizualizácii.

Marketingové tímy môžu generovať vlastné obrázky pre kampane, sociálne médiá aj reklamy bez potreby rozsiahlych grafických zdrojov.

Vývojári hier môžu tvoriť assety, prostredia a koncept art zadávaním popisov, čo zefektívni tvorbu assetov.

Predajcovia môžu generovať obrázky produktov v rôznych prostrediach alebo konfiguráciách a zlepšiť tým vizualizáciu produktov aj zákaznícky zážitok.

Vyučujúci a tvorcovia obsahu môžu vytvárať ilustrácie a diagramy na vysvetľovanie zložitých konceptov, čím urobia výučbové materiály atraktívnejšími.

Výskumníci v oblasti umelej inteligencie a počítačového videnia môžu Stable Diffusion využívať na skúmanie možností difúznych modelov a latentných priestorov.

Na efektívne využívanie Stable Diffusion treba zohľadniť určité technické predpoklady.

Ak chcete začať používať Stable Diffusion, postupujte podľa týchto krokov:

Pre vývojárov budujúcich AI automatizačné systémy a chatboty je možné Stable Diffusion integrovať na zvýšenie funkcionality.

Pri používaní Stable Diffusion je dôležité myslieť na etické dôsledky.

Stable diffusion je významnou témou v oblasti generatívnych modelov, najmä pre augmentáciu dát a syntézu obrázkov. Nedávne štúdie skúmali rôzne aspekty stable diffusion, zdôrazňujúc jeho aplikácie a efektivitu.

Diffusion Least Mean P-Power Algorithms for Distributed Estimation in Alpha-Stable Noise Environments od Fuxi Wen (2013):

Uvádza difúzny algoritmus least mean p-power (LMP) určený na distribuované odhady v prostrediach charakterizovaných alfa-stabilným šumom. Štúdia porovnáva difúznu LMP metódu s difúznou least mean squares (LMS) metódou a ukazuje lepší výkon v alfa-stabilných šumových podmienkach. Tento výskum je dôležitý pre vývoj robustných odhadovacích techník v šumových prostrediach. Čítať viac

Stable Diffusion for Data Augmentation in COCO and Weed Datasets od Boyang Deng (2024):

Skúma použitie stable diffusion modelov na generovanie vysokokvalitných syntetických obrázkov na zlepšenie malých datasetov. Využitím techník ako Image-to-image translation, Dreambooth a ControlNet výskum hodnotí efektivitu stable diffusion v klasifikačných a detekčných úlohách. Výsledky naznačujú sľubné využitie stable diffusion v rôznych oblastiach. Čítať viac

Diffusion and Relaxation Controlled by Tempered α-stable Processes od Aleksander Stanislavsky, Karina Weron a Aleksander Weron (2011):

Odvodzuje vlastnosti anomálnej difúzie a neexponenciálnej relaxácie pomocou temperovaných α-stabilných procesov. Rieši problém nekonečných momentov spojený s α-stabilným náhodným operačným časom a poskytuje model, ktorý zahŕňa subdifúziu ako špeciálny prípad. Čítať viac

Evaluating a Synthetic Image Dataset Generated with Stable Diffusion od Andreas Stöckl (2022):

Hodnotí syntetické obrázky vygenerované modelom Stable Diffusion pomocou taxonómie Wordnet. Posudzuje schopnosť modelu produkovať správne obrázky pre rôzne koncepty, ilustrujúc rozdiely v presnosti reprezentácie. Tieto hodnotenia sú dôležité pre pochopenie úlohy stable diffusion v augmentácii dát. Čítať viac

Comparative Analysis of Generative Models: Enhancing Image Synthesis with VAEs, GANs, and Stable Diffusion od Sanchayan Vivekananthan (2024):

Skúma tri generatívne frameworky: VAE, GAN a Stable Diffusion modely. Výskum zdôrazňuje silné a slabé stránky každého modelu, pričom poznamenáva, že hoci majú VAE a GAN svoje výhody, stable diffusion vyniká v určitých úlohách syntézy. Čítať viac

Pozrime sa, ako implementovať Stable Diffusion Model v Pythone pomocou knižnice Hugging Face Diffusers.

Nainštalujte požadované knižnice:

pip install torch transformers diffusers accelerate

pip install xformers # Voliteľné

Knižnica Diffusers poskytuje pohodlný spôsob načítania predtrénovaných modelov:

from diffusers import StableDiffusionPipeline

import torch

# Načítajte model Stable Diffusion

model_id = "stabilityai/stable-diffusion-2-1"

pipe = StableDiffusionPipeline.from_pretrained(model_id, torch_dtype=torch.float16)

pipe = pipe.to("cuda") # Presuňte model na GPU pre rýchlejšie inferencie

Na generovanie obrázkov stačí zadať textový podnet:

prompt = "Pokojná krajina s horami a jazerom, fotorealistická, 8K rozlíšenie"

image = pipe(prompt).images[0]

# Uložte alebo zobrazte obrázok

image.save("generated_image.png")

model_id.torch.float16 znižuje pamäťovú náročnosť.Môžete prispôsobiť rôzne parametre:

image = pipe(

prompt=prompt,

num_inference_steps=50, # Počet krokov odšumovania

guidance

Stable Diffusion je pokročilý AI model určený na generovanie vysoko kvalitných, fotorealistických obrázkov z textových podnetov. Využíva latentnú difúziu a hlboké učenie na prevod textových popisov do vizuálov.

Stable Diffusion funguje konverziou textových podnetov na obrazové vektory pomocou textového enkodéra CLIP a následným iteratívnym odstraňovaním šumu v latentnom priestore, vedeným podnetom, čo vedie k ucelenému výstupu obrázka.

Stable Diffusion sa využíva na tvorbu kreatívneho obsahu, marketingové materiály, tvorbu herných assetov, vizualizáciu produktov v e-commerce, vzdelávacie ilustrácie a AI-poháňané chatboty.

Áno, Stable Diffusion podporuje prevod obrázka na obrázok a dopĺňanie (inpainting), čo umožňuje používateľom meniť existujúce obrázky alebo dopĺňať chýbajúce časti na základe textových podnetov.

Na efektívne generovanie obrázkov pomocou Stable Diffusion sa odporúča počítač s modernou GPU. Model vyžaduje aj Python a knižnice ako PyTorch a Diffusers.

Áno, Stable Diffusion je vydaný pod permisívnou open-source licenciou, čo podporuje komunitné príspevky, prispôsobenie a širokú dostupnosť.

Uvoľnite svoju kreativitu so Stable Diffusion a zistite, ako môže AI premeniť vaše nápady na úchvatné vizuály.

Preskúmajte našu podrobnú recenziu Stability AI SD3 Large. Analyzujte jeho silné a slabé stránky, kreativitu pri rôznych textových zadaniach a zistite, ako tent...

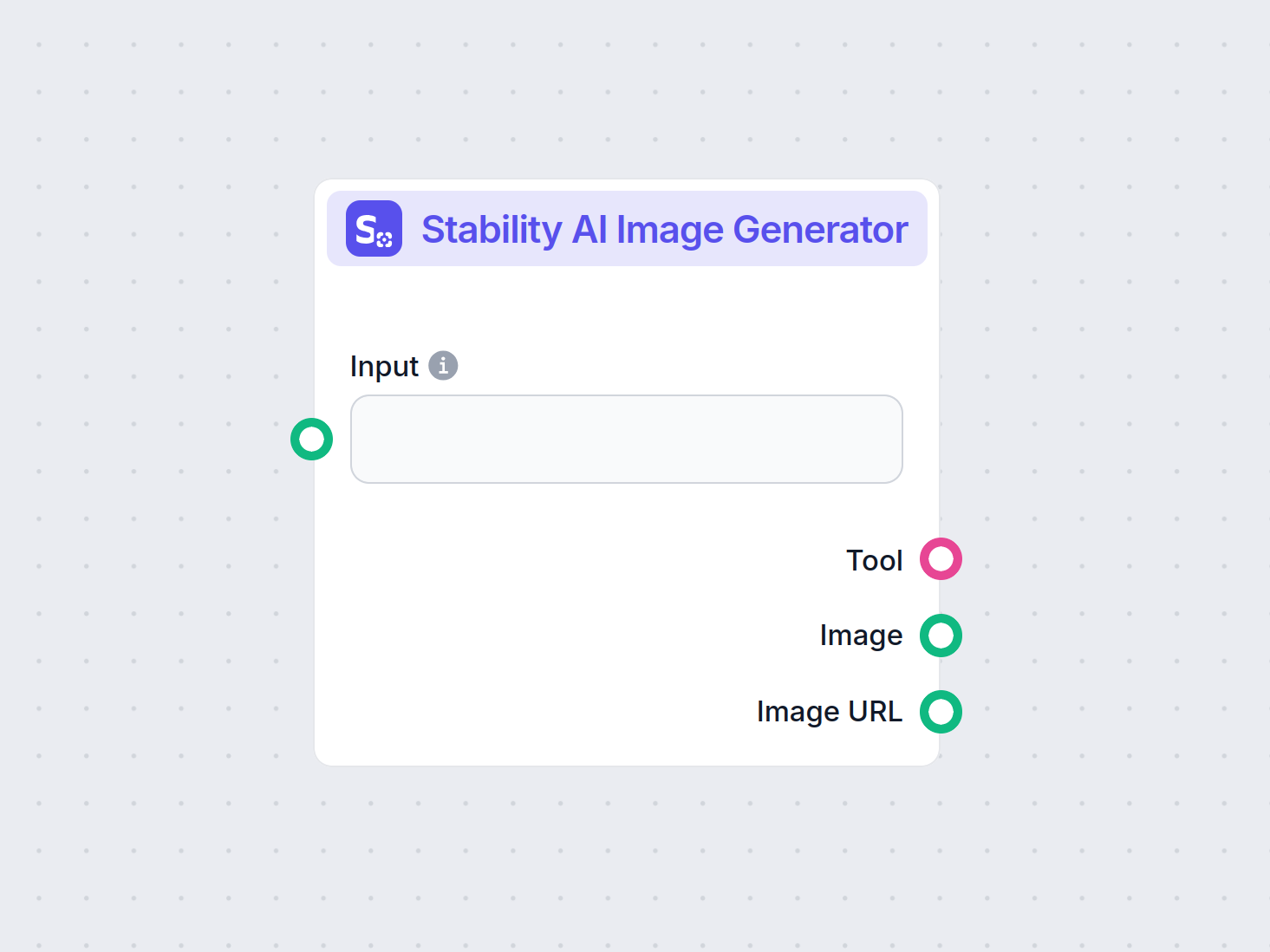

Generujte vysokokvalitné obrázky z textových zadaní pomocou komponentu Generátor obrázkov Stability AI. Tento nástroj poháňaný modelmi Stable Diffusion ponúka n...

Flux AI Model od Black Forest Labs je pokročilý systém na generovanie obrázkov z textu, ktorý premieňa prirodzené jazykové podnety na vysoko detailné, fotoreali...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.