Vektor vloženia

Vektor vloženia je hustá číselná reprezentácia údajov v multidimenzionálnom priestore, ktorá zachytáva sémantické a kontextové vzťahy. Zistite, ako vektory vlož...

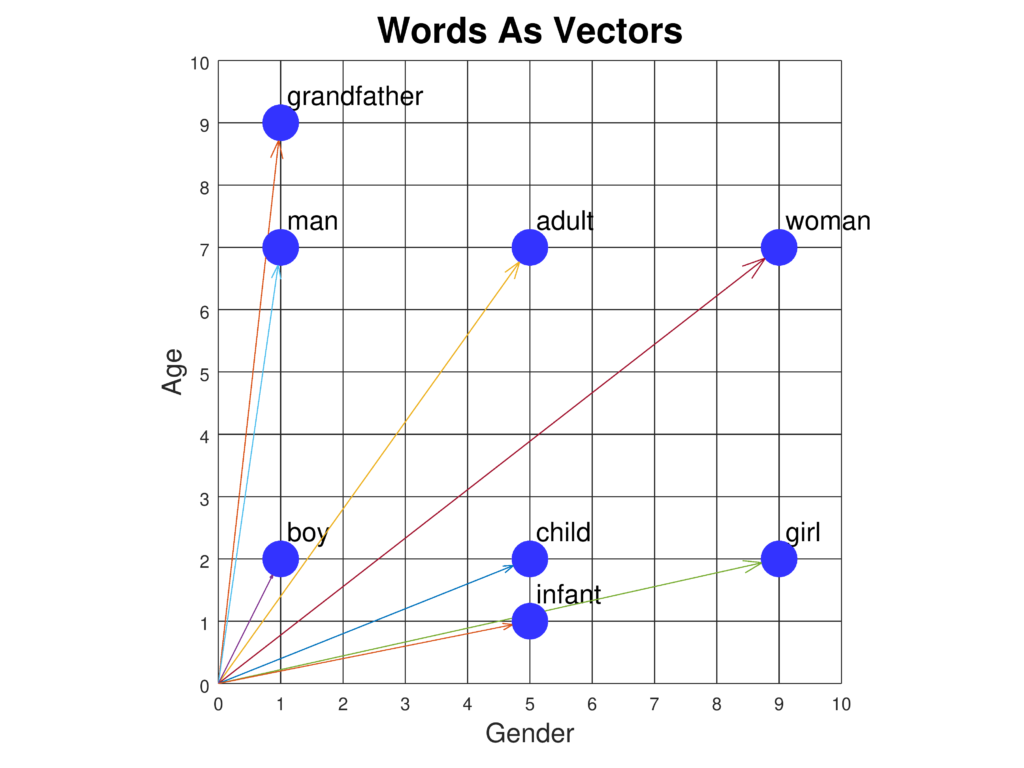

Vektorové reprezentácie slov mapujú slová na vektory v spojitom priestore, čím zachytávajú ich význam a kontext pre lepšie aplikácie NLP.

Vektorové reprezentácie slov sú kľúčové v NLP, ktoré prepája interakciu medzi človekom a počítačom. Objavte ich kľúčové aspekty, fungovanie a aplikácie ešte dnes!

Výskum v oblasti vektorových reprezentácií slov v NLP

Learning Word Sense Embeddings from Word Sense Definitions

Qi Li, Tianshi Li, Baobao Chang (2016) navrhujú metódu na riešenie problému polysémie a homonymie vo vektorových reprezentáciách slov vytvorením jedného vektora pre každý význam na základe definícií významov. Ich prístup využíva trénovanie na korpuse na dosiahnutie kvalitných vektorov významov slov. Experimentálne výsledky ukazujú zlepšenie v úlohách podobnosti slov a disambiguácie významu. Štúdia demonštruje potenciál vektorov významov pre rozvoj NLP aplikácií. Čítajte viac

Neural-based Noise Filtering from Word Embeddings

Kim Anh Nguyen, Sabine Schulte im Walde, Ngoc Thang Vu (2016) predstavujú dva modely na zlepšenie vektorových reprezentácií slov filtrovaním šumu. Identifikujú nepotrebné informácie v tradičných vektoroch a navrhujú neškolené techniky učenia na tvorbu vektorov bez šumu. Tieto modely využívajú hlboké dopredné neurónové siete na zvýraznenie dôležitých informácií a minimalizáciu šumu. Výsledky ukazujú vyššiu výkonnosť týchto vektorov na štandardných úlohách. Čítajte viac

A Survey On Neural Word Embeddings

Erhan Sezerer, Selma Tekir (2021) poskytujú komplexný prehľad neurónových vektorových reprezentácií slov, sledujú ich vývoj a vplyv na NLP. Prehľad zahŕňa základné teórie a skúma rôzne typy vektorov, ako sú vektory významov, morfém a kontextové vektory. Práca tiež diskutuje štandardné datasety a hodnotenie výkonu, pričom zdôrazňuje transformačný efekt neurónových vektorov na NLP úlohy. Čítajte viac

Improving Interpretability via Explicit Word Interaction Graph Layer

Arshdeep Sekhon, Hanjie Chen, Aman Shrivastava, Zhe Wang, Yangfeng Ji, Yanjun Qi (2023) sa zameriavajú na zvýšenie interpretovateľnosti modelov v NLP pomocou WIGRAPH, vrstvy neurónovej siete, ktorá vytvára globálny graf interakcií medzi slovami. Táto vrstva môže byť integrovaná do akéhokoľvek NLP textového klasifikátora a zlepšuje interpretovateľnosť aj predikčnú výkonnosť. Štúdia zdôrazňuje význam interakcií slov pri porozumení rozhodnutí modelu. Čítajte viac

Word Embeddings for Banking Industry

Avnish Patel (2023) skúma využitie vektorových reprezentácií slov v bankovníctve, pričom zdôrazňuje ich úlohu v analýze sentimentu a klasifikácii textu. Štúdia sa zaoberá použitím statických vektorov (napr. Word2Vec, GloVe) aj kontextových modelov a vyzdvihuje ich vplyv na odvetvovo špecifické NLP úlohy. Čítajte viac

Vektorové reprezentácie slov sú husté vektorové reprezentácie slov, ktoré mapujú sémanticky podobné slová na blízke body v spojitom priestore, čím modelom umožňujú chápať kontext a vzťahy v jazyku.

Zlepšujú NLP úlohy zachytávaním sémantických a syntaktických vzťahov, znižovaním dimenzionality, umožňovaním transferového učenia a lepším spracovaním zriedkavých slov.

Populárne techniky zahŕňajú Word2Vec, GloVe, FastText a TF-IDF. Neurónové modely, ako Word2Vec a GloVe, sa učia vektory zo veľkých textových korpusov, zatiaľ čo FastText zahŕňa informácie o podslovách.

Klasické vektory zápasia s polysémiou (slová s viacerými významami), môžu prehlbovať zaujatosti v údajoch a môžu vyžadovať značné výpočtové zdroje pri trénovaní na veľkých korpusoch.

Používajú sa pri klasifikácii textov, strojovom preklade, rozpoznávaní pomenovaných entít, vyhľadávaní informácií a systémoch otázka-odpoveď na zlepšenie presnosti a pochopenia kontextu.

Začnite vytvárať pokročilé AI riešenia s intuitívnymi nástrojmi pre NLP vrátane vektorových reprezentácií slov a ďalších možností.

Vektor vloženia je hustá číselná reprezentácia údajov v multidimenzionálnom priestore, ktorá zachytáva sémantické a kontextové vzťahy. Zistite, ako vektory vlož...

Spracovanie prirodzeného jazyka (NLP) je pododvetvie umelej inteligencie (AI), ktoré umožňuje počítačom porozumieť, interpretovať a generovať ľudský jazyk. Obja...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.