FlowHunt Observability i PowerBI

Lär dig hur du integrerar FlowHunt med PowerBI, konfigurerar övervakningsinställningar och visualiserar din FlowHunt arbetsytas mätvärden direkt i PowerBI dashb...

Den här artikeln förklarar hur du kopplar FlowHunt till Langfuse för heltäckande observabilitet, spårar AI-arbetsflödens prestanda och använder Langfuse-instrumentpaneler för att övervaka och optimera din FlowHunt-arbetsyta.

När dina AI-arbetsflöden i FlowHunt växer blir det avgörande att förstå vad som sker bakom kulisserna. Frågor som “Varför är det här arbetsflödet långsamt?”, “Hur många tokens förbrukas?” eller “Var uppstår fel?” kräver detaljerad insyn i ditt system.

Utan ordentlig observabilitet är felsökning av AI-flöden som att flyga i blindo – du ser resultatet men missar resan. Spårningsverktyg som Langfuse löser detta genom att fånga varje steg i arbetsflödets exekvering och ge djupgående insikter om prestanda, kostnader och beteende.

Den här artikeln visar hur du sömlöst kopplar FlowHunt till Langfuse för heltäckande observabilitet över alla dina AI-arbetsflöden. Du lär dig spåra exekveringsvägar, övervaka tokenanvändning, identifiera flaskhalsar och visualisera prestandamått – allt i en centraliserad instrumentpanel.

När du har läst klart har du fullständig insyn i din FlowHunt-arbetsyta och kan optimera arbetsflöden, minska kostnader och säkerställa tillförlitlighet.

Observabilitet innebär att instrumentera ditt system så att du kan förstå dess interna tillstånd utifrån externa signaler – huvudsakligen spår, mätvärden och loggar.

För FlowHunt-användare med AI-drivna arbetsflöden innebär observabilitet insyn i:

Utan observabilitet blir felsökning reaktivt och tidskrävande. Med observabilitet får du proaktiva insikter som möjliggör kontinuerlig optimering och snabbare felsökning.

Langfuse är en öppen plattform för observabilitet och analys, speciellt framtagen för LLM-applikationer. Den fångar detaljerade spår av AI-arbetsflöden och ger utvecklare och team de insikter som behövs för att felsöka, övervaka och optimera sina AI-system.

Några av Langfuses nyckelfunktioner:

Genom att koppla Langfuse till FlowHunt omvandlar du rå exekveringsdata till användbar information – och kan identifiera vad som fungerar, vad som inte fungerar och var du bör fokusera dina optimeringsinsatser.

När du har följt guiden kommer du att:

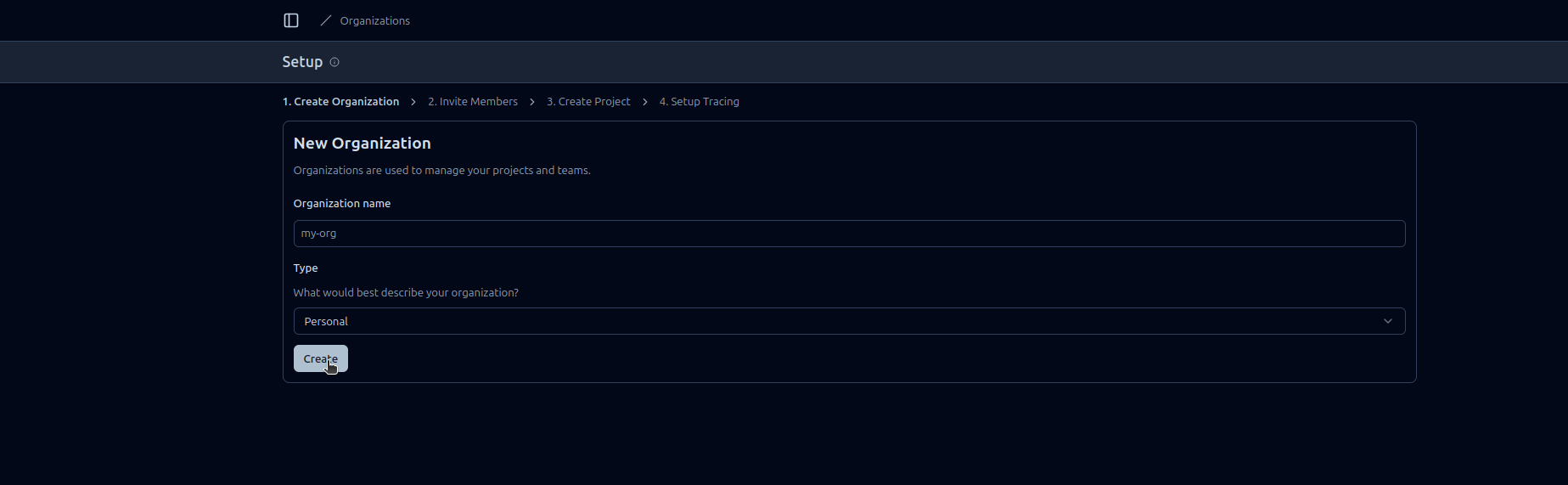

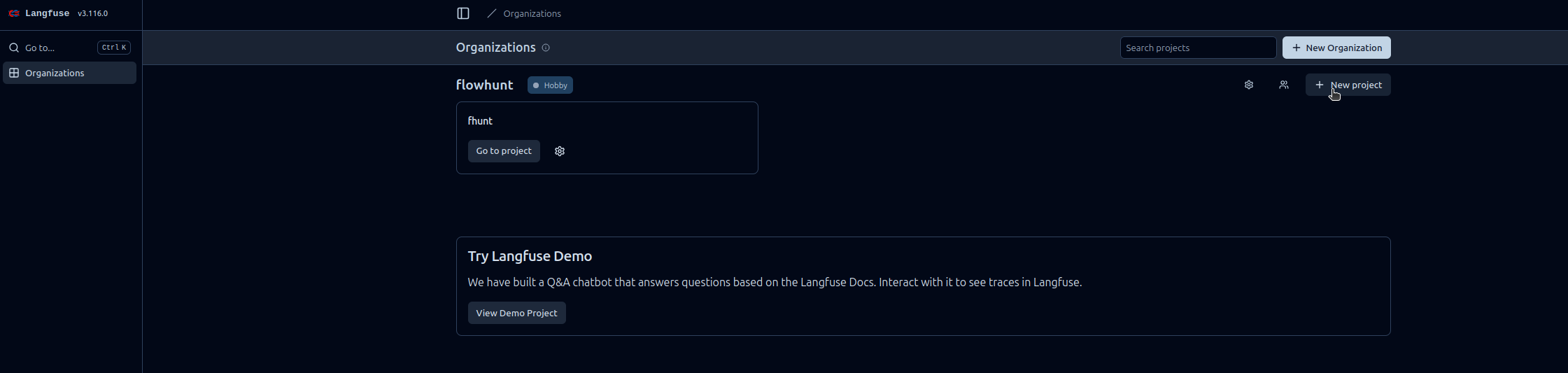

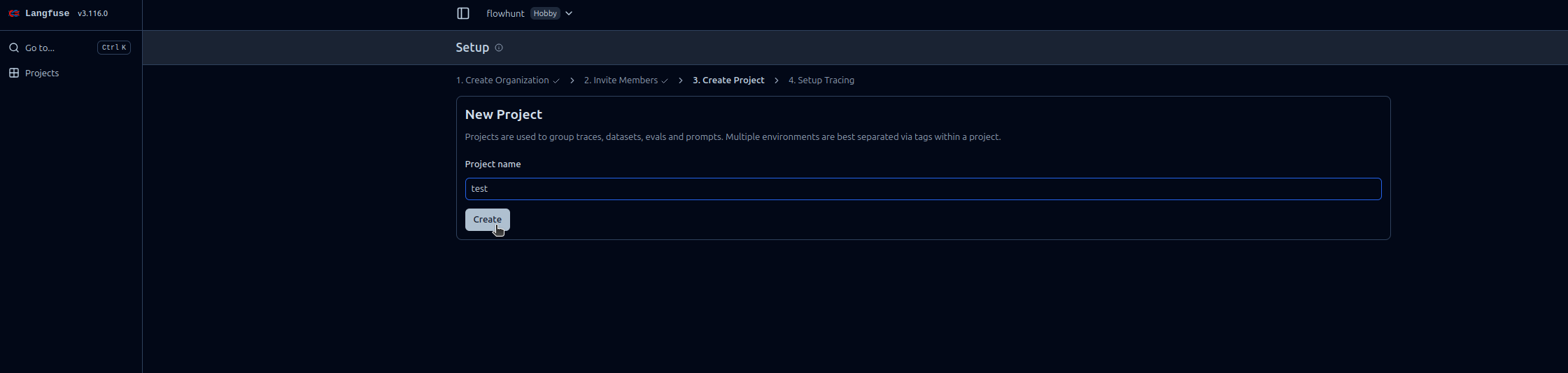

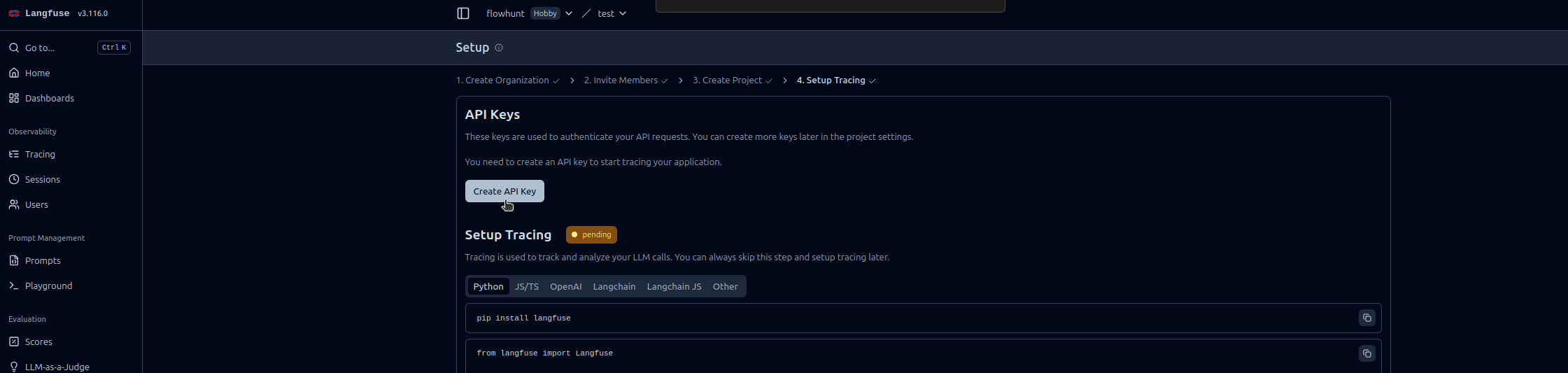

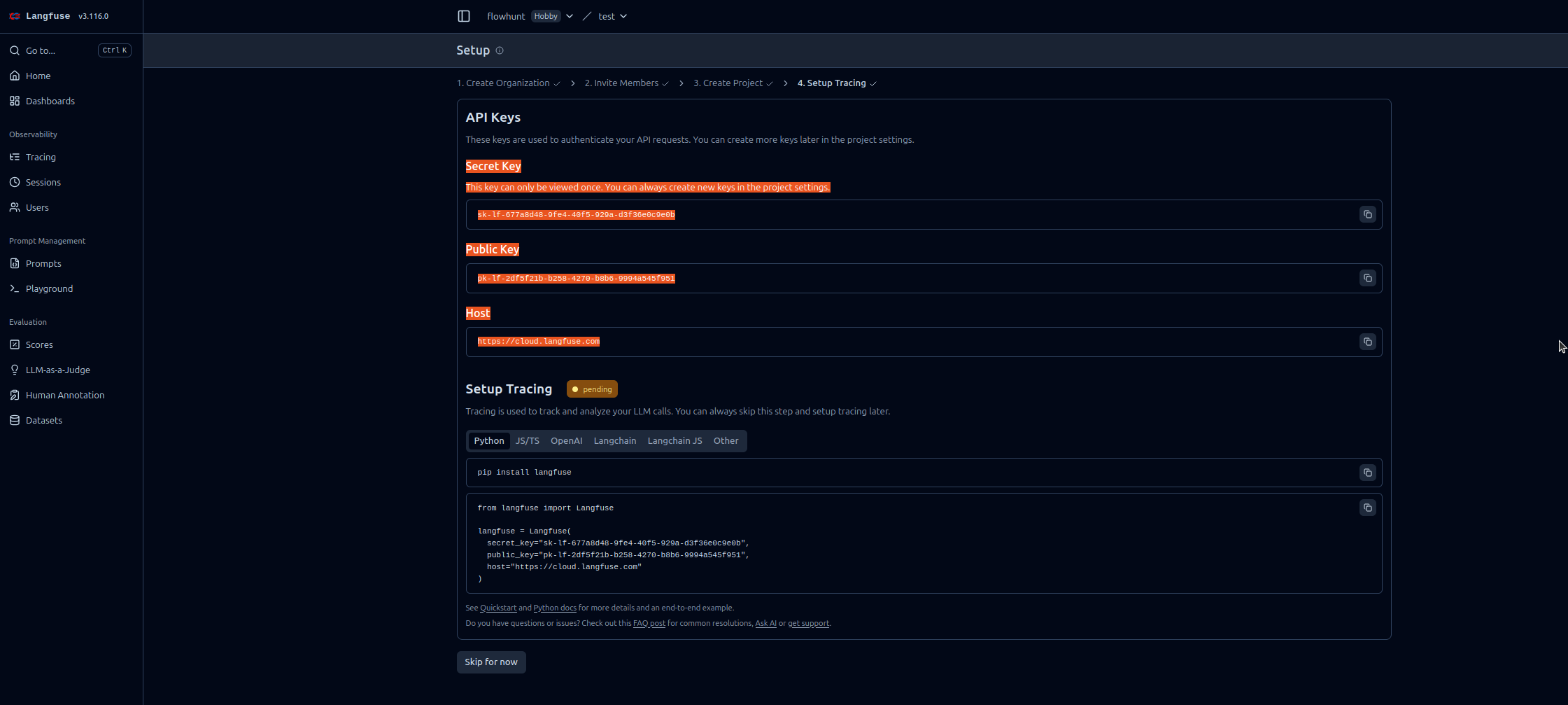

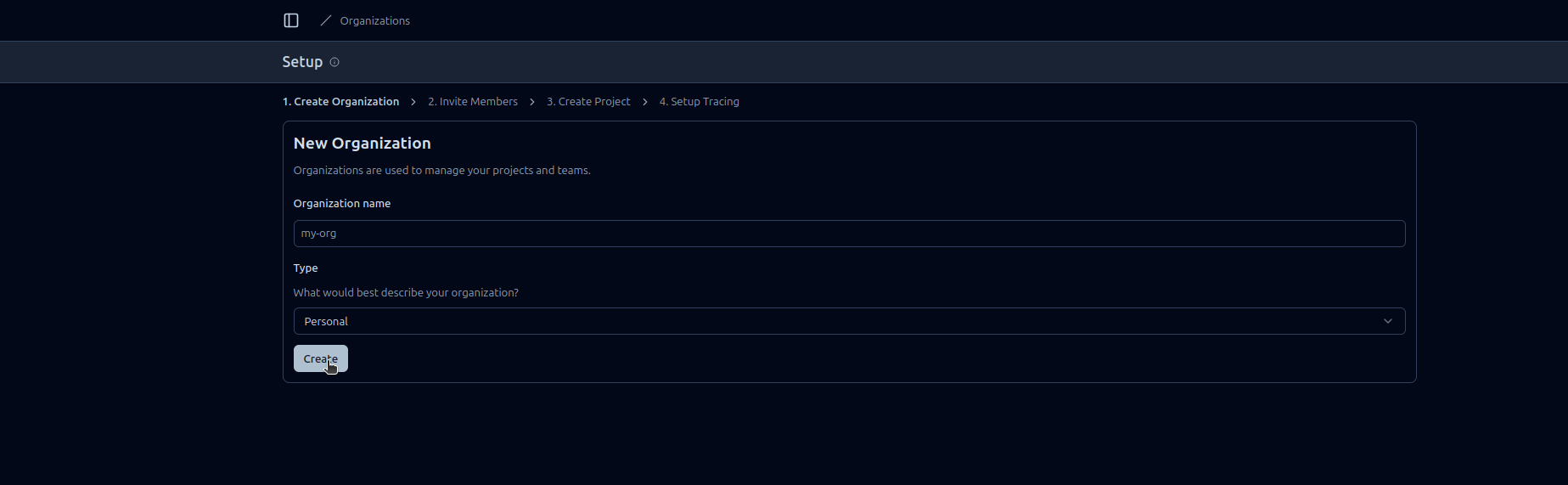

Följ dessa steg-för-steg-instruktioner för att aktivera FlowHunt Observability i Langfuse:

https://cloud.langfuse.com)

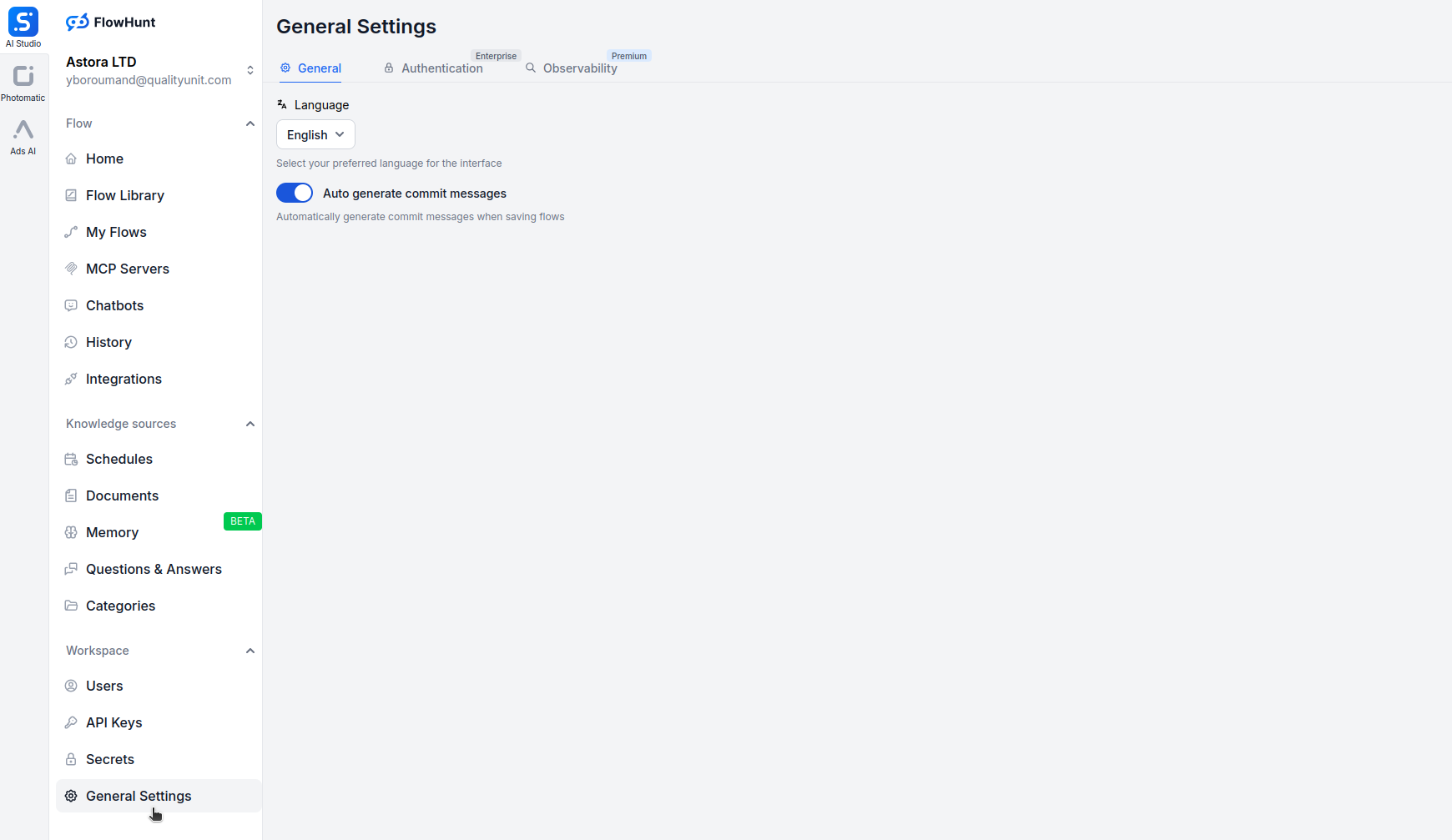

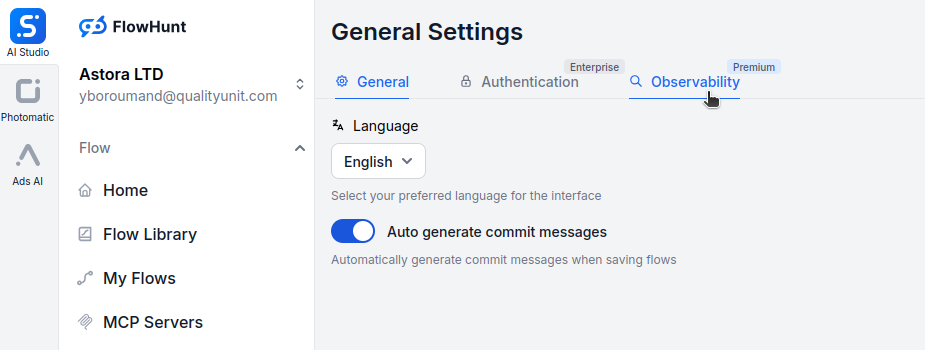

Öppna app.flowhunt.io i din webbläsare.

Navigera till Allmänna inställningar (oftast via sidomenyn eller toppmenyn).

Skrolla längst ned och klicka på fliken Observability.

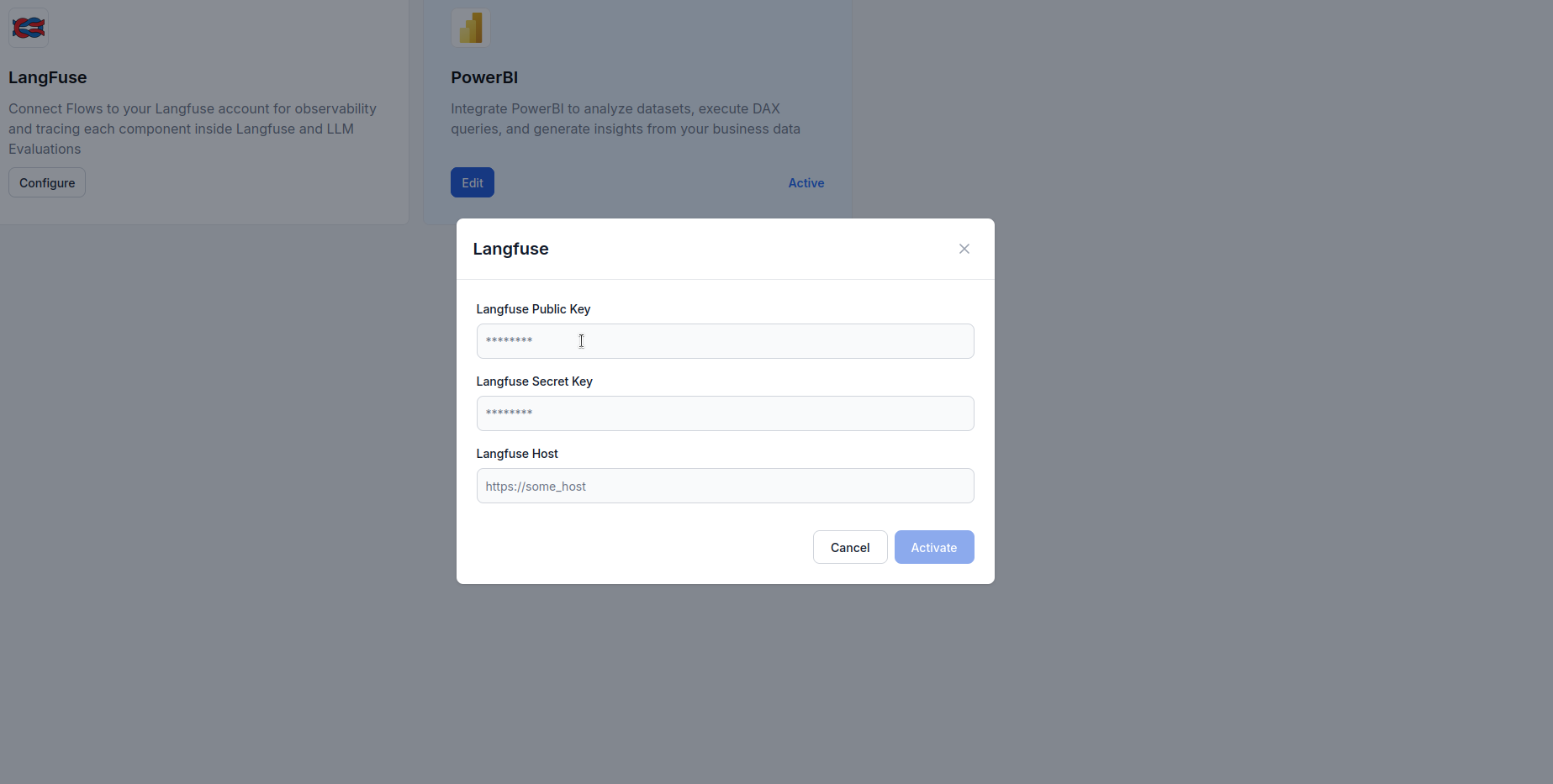

Hitta rutan Langfuse och klicka på Configure.

https://cloud.langfuse.com)

När FlowHunt är kopplat till Langfuse får du tillgång till kraftfulla visualiserings- och analysmöjligheter. Här är några insikter du kan generera:

Visa en detaljerad tidslinje för varje arbetsflödesexekvering, med:

Detta hjälper dig att identifiera flaskhalsar och förstå arbetsflödets beteende på detaljnivå.

Övervaka tokenförbrukning över arbetsflöden:

Detta möjliggör kostnadsoptimering genom att identifiera tokenkrävande processer.

Följ viktiga prestandamått:

Dessa mått hjälper dig att uppfylla SLA:er och optimera användarupplevelsen.

Identifiera och felsök fel:

Detta snabbar upp felsökningen och ökar tillförlitligheten.

För konversationsbaserade AI-agenter kan du följa:

Detta hjälper dig att optimera agentbeteende och användarupplevelse.

Jämför prestanda mellan olika LLM-leverantörer:

Detta underlättar modellval baserat på verkliga användardata.

Att integrera FlowHunt med Langfuse gör dina AI-arbetsflöden transparenta och optimerbara istället för att vara svarta lådor. Med omfattande spårning får du insyn i varje exekveringssteg och kan fatta datadrivna beslut om prestanda, kostnader och tillförlitlighet.

Integrationen för Langfuse-observabilitet gör övervakningen sömlös – från enkel API-nyckelkonfiguration till rika, handlingsbara instrumentpaneler som visar exakt hur dina arbetsflöden beter sig i produktion.

Nu när din FlowHunt-arbetsyta är kopplad till Langfuse har du grunden för kontinuerliga förbättringar: identifiera flaskhalsar, optimera tokenanvändning, minska latens och säkerställ att dina AI-system levererar maximalt värde med fullständig trygghet.

Lär dig hur du integrerar FlowHunt med PowerBI, konfigurerar övervakningsinställningar och visualiserar din FlowHunt arbetsytas mätvärden direkt i PowerBI dashb...

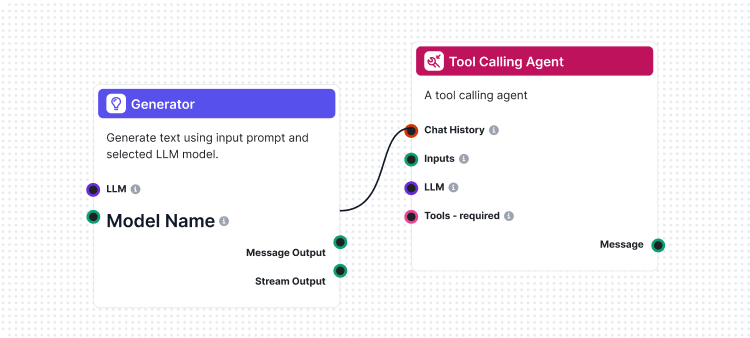

Flöden är hjärnan bakom allt i FlowHunt. Lär dig bygga dem med en visuell no-code-byggare, från att placera den första komponenten till webbplatsintegration, dr...

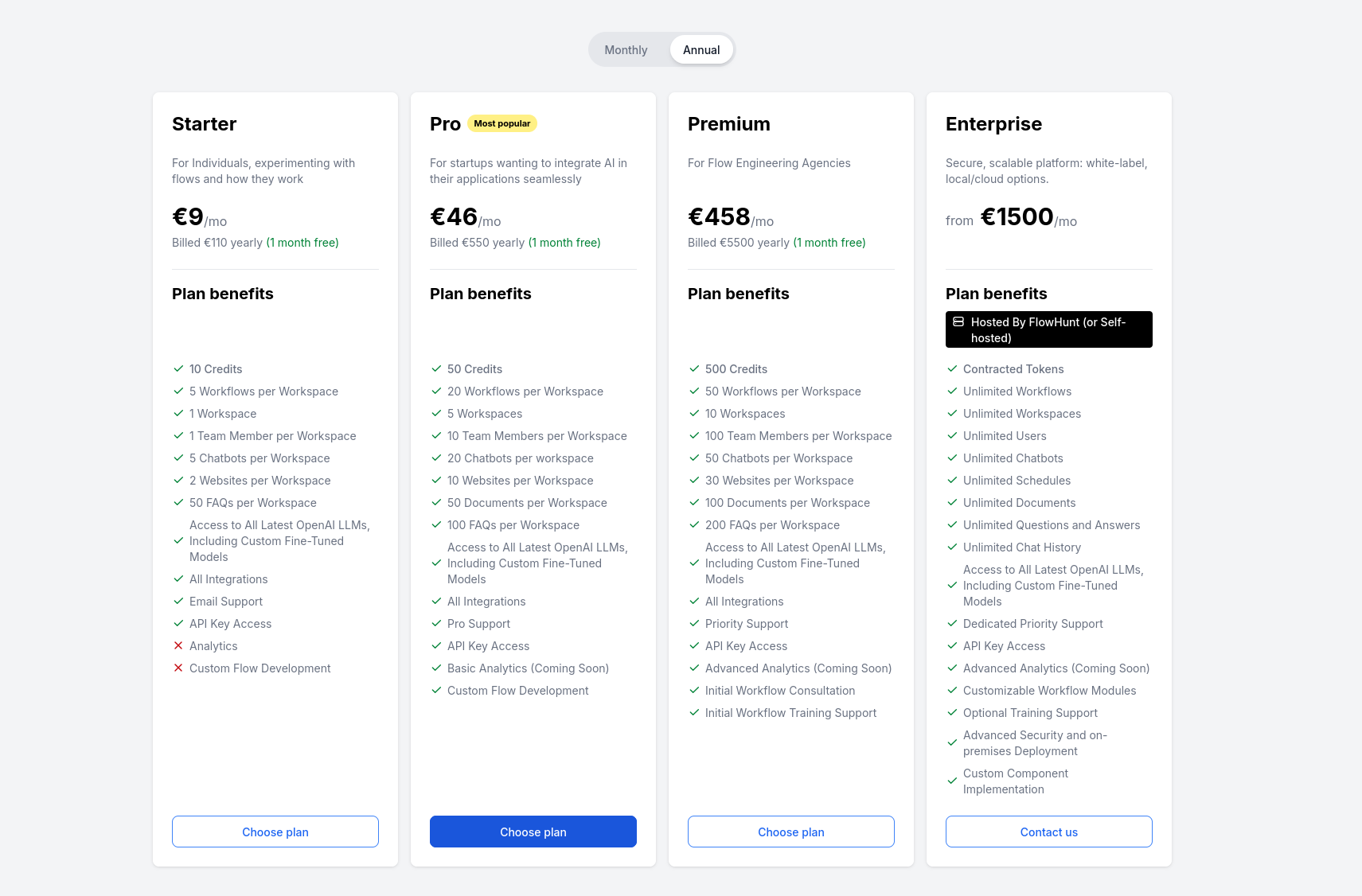

En omfattande guide till FlowHunts prissättning, inklusive hur krediter och interaktioner fungerar, hur komplexitet påverkar kostnaderna och vad som händer med ...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.