DeepSeek MCP-server

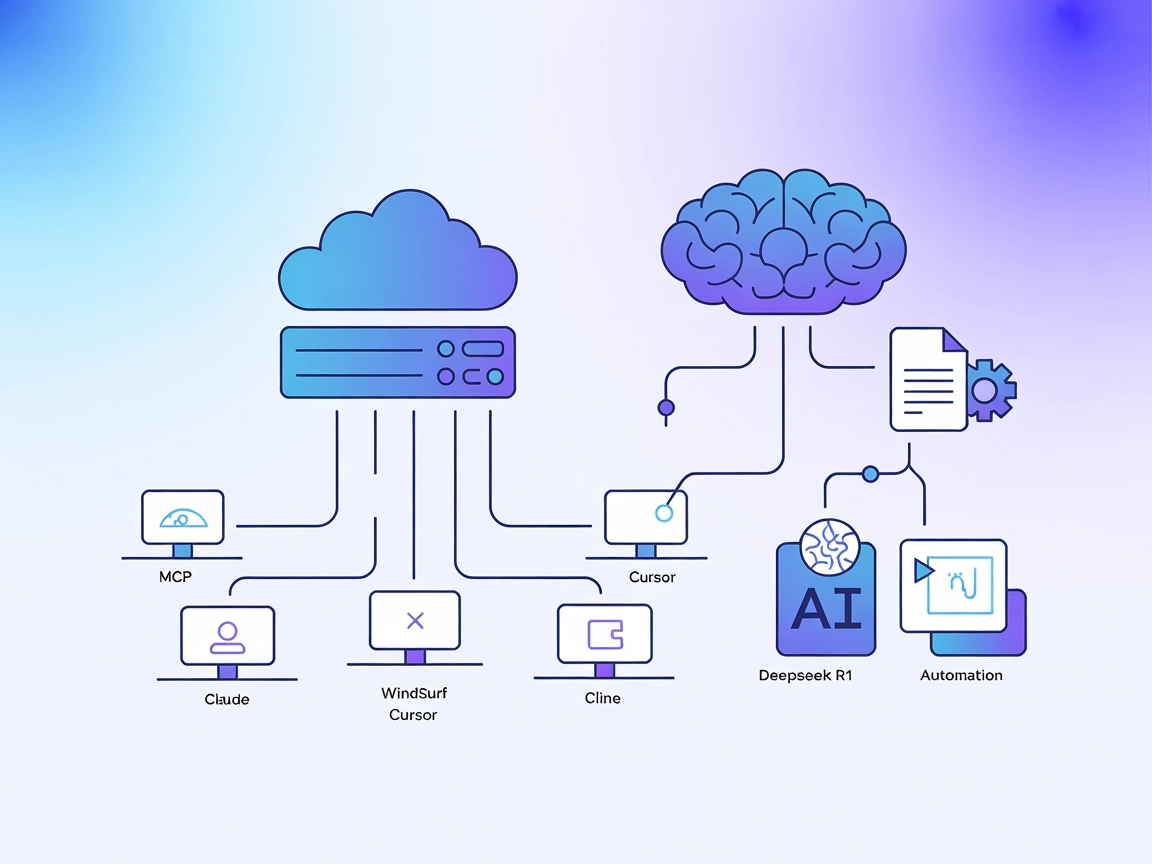

DeepSeek MCP-server fungerar som en säker proxy som kopplar DeepSeeks avancerade språkmodeller till MCP-kompatibla applikationer som Claude Desktop eller FlowHu...

Integrera DeepSeek:s modeller med stort kontext och optimerad slutledning i dina AI-arbetsflöden med Deepseek R1 MCP-server för avancerad språkhantering och automatisering.

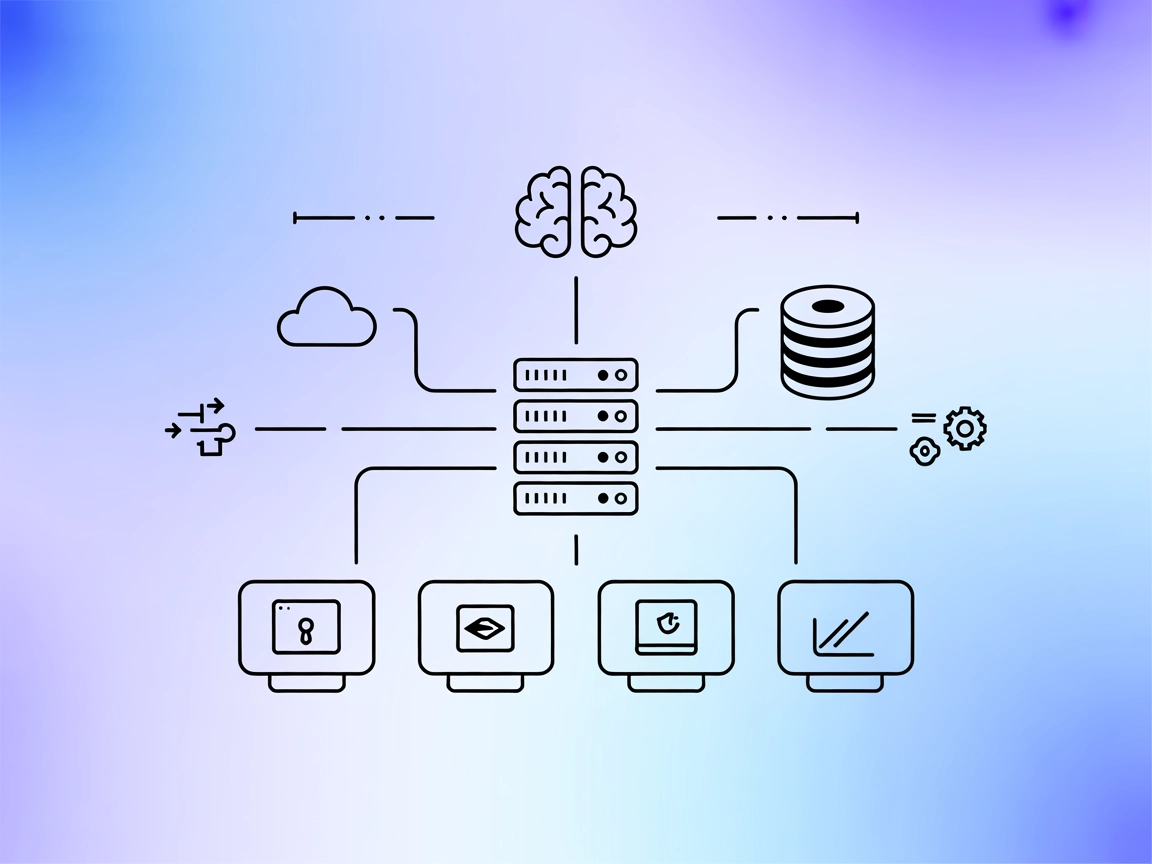

FlowHunt erbjuder ett extra säkerhetslager mellan dina interna system och AI-verktyg, vilket ger dig granulär kontroll över vilka verktyg som är tillgängliga från dina MCP-servrar. MCP-servrar som hostas i vår infrastruktur kan sömlöst integreras med FlowHunts chatbot samt populära AI-plattformar som ChatGPT, Claude och olika AI-redigerare.

Deepseek R1 MCP-server är en implementation av Model Context Protocol (MCP) utformad för att koppla ihop Claude Desktop med DeepSeek:s avancerade språkmodeller, såsom Deepseek R1 och DeepSeek V3. Genom att fungera som en brygga mellan AI-assistenter och DeepSeek:s kraftfulla, slutledningsoptimerade modeller (med ett kontextfönster på 8192 tokens), gör denna server det möjligt för AI-agenter att utföra avancerad förståelse och generering av naturligt språk. Utvecklare kan använda Deepseek R1 MCP-server för att sömlöst integrera dessa modeller i sina arbetsflöden, och därigenom möjliggöra avancerad textgenerering, slutledning och interaktion med externa datakällor eller API:er inom stödda plattformar. Implementationens fokus ligger på att erbjuda stabil, pålitlig och effektiv integration med Node.js/TypeScript för optimal kompatibilitet och typesäkerhet.

Inga prompt-mallar är dokumenterade i repot.

Inga explicita MCP-resurser är dokumenterade i repot.

git clone https://github.com/66julienmartin/MCP-server-Deepseek_R1.git

cd deepseek-r1-mcp

npm install

.env.exemple till .env och ange din DeepSeek API-nyckel.{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

Använd miljövariabler i din konfiguration för att hålla API-nycklar säkra:

{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

Använda MCP i FlowHunt

För att integrera MCP-servrar i ditt FlowHunt-arbetsflöde, börja med att lägga till MCP-komponenten i ditt flöde och koppla den till din AI-agent:

Klicka på MCP-komponenten för att öppna konfigurationspanelen. I systemets MCP-konfigurationssektion anger du dina MCP-serverdetaljer med detta JSON-format:

{

"deepseek_r1": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

När det är konfigurerat kan AI-agenten nu använda denna MCP som ett verktyg med tillgång till alla dess funktioner och kapaciteter. Kom ihåg att byta ut “deepseek_r1” mot det faktiska namnet på din MCP-server och ersätt URL:en med din egen MCP-server-URL.

| Sektion | Tillgänglig | Detaljer/Noteringar |

|---|---|---|

| Översikt | ✅ | |

| Lista över prompts | ⛔ | Inga prompt-mallar dokumenterade |

| Lista över resurser | ⛔ | Inga explicita MCP-resurser dokumenterade |

| Lista över verktyg | ✅ | Avancerat textgenereringsverktyg |

| Skydda API-nycklar | ✅ | Använd miljövariabler i konfigurationen |

| Sampling-stöd (mindre viktigt i utvärdering) | ⛔ | Inte dokumenterat |

| Stödjer Roots | ⛔ | Inte dokumenterat |

Baserat på tillgänglig dokumentation erbjuder Deepseek R1 MCP-server en ren, fokuserad implementation som är enkel att konfigurera och använda, men saknar dokumentation för prompts, resurser eller avancerade MCP-funktioner som roots och sampling. Det gör den mycket praktisk för textgenerering men mindre funktionsrik för mer komplexa arbetsflöden.

| Har en LICENSE | ✅ (MIT) |

|---|---|

| Har minst ett verktyg | ✅ |

| Antal forks | 12 |

| Antal stjärnor | 58 |

Det är en Model Context Protocol (MCP)-server som fungerar som en brygga mellan Claude Desktop (eller andra plattformar) och DeepSeek:s avancerade språkmodeller (R1, V3), vilket möjliggör förbättrad textgenerering, slutledning och automatisering i dina AI-arbetsflöden.

Servern stöder Deepseek R1 och DeepSeek V3—båda modellerna är optimerade för stora kontextfönster och komplexa slutledningsuppgifter.

Användningsområden inkluderar avancerad textgenerering (långform, tekniskt eller kreativt), logiktung slutledning, sömlös AI-assistentförstärkning i Claude Desktop samt automatisering av innehållsskapande eller kunskapshantering via API.

Använd alltid miljövariabler i din MCP-serverkonfiguration för att undvika oavsiktlig exponering av din DeepSeek API-nyckel.

Inga prompt-mallar eller explicita MCP-resurser är dokumenterade i repot; servern är fokuserad på direkt modellåtkomst och integrering.

DeepSeek R1 erbjuder ett kontextfönster på 8192 tokens, vilket möjliggör hantering av långa och komplexa uppgifter.

Ja, det är MIT-licensierat och finns på GitHub.

Lås upp avancerad textgenerering och slutledning genom att ansluta FlowHunt eller Claude Desktop till DeepSeek R1:s kraftfulla modeller. Börja bygga smartare arbetsflöden redan idag.

DeepSeek MCP-server fungerar som en säker proxy som kopplar DeepSeeks avancerade språkmodeller till MCP-kompatibla applikationer som Claude Desktop eller FlowHu...

DeepSeek MCP-server integrerar DeepSeek's avancerade språkmodeller med MCP-kompatibla applikationer, och erbjuder säker, anonymiserad API-åtkomst samt möjliggör...

Deepseek Thinker MCP-server integrerar Deepseek-modellens resonemang i MCP-aktiverade AI-klienter som Claude Desktop, och ger avancerade chain-of-thought-utdata...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.