Lara Translate MCP

Integrera FlowHunt med Lara Translate MCP för att leverera avancerade, kontextmedvetna översättningar i dina AI-arbetsflöden. Automatisera flerspråkigt innehåll...

Koppla dina AI-agenter till professionell översättning med Lara Translate MCP-server—möjliggör säkra, högkvalitativa och kontextmedvetna språktjänster i dina FlowHunt-arbetsflöden.

FlowHunt erbjuder ett extra säkerhetslager mellan dina interna system och AI-verktyg, vilket ger dig granulär kontroll över vilka verktyg som är tillgängliga från dina MCP-servrar. MCP-servrar som hostas i vår infrastruktur kan sömlöst integreras med FlowHunts chatbot samt populära AI-plattformar som ChatGPT, Claude och olika AI-redigerare.

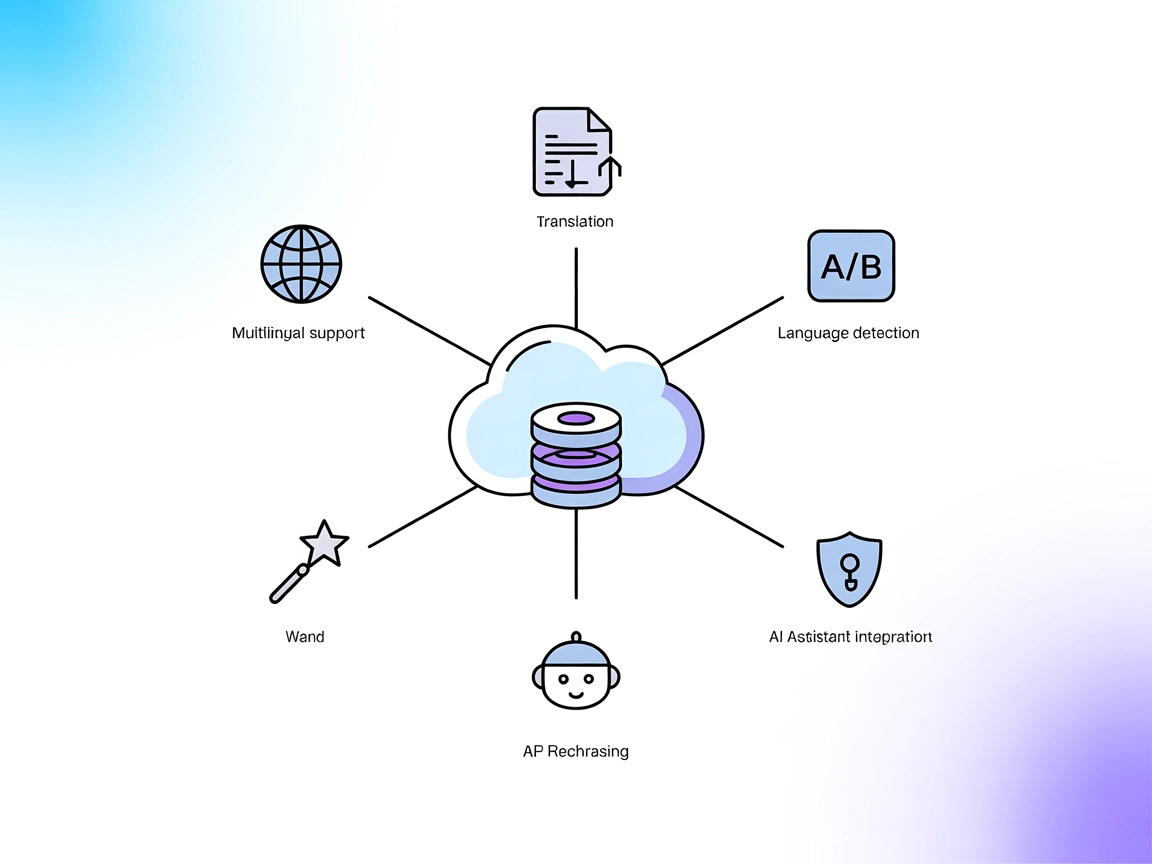

Lara Translate MCP-server är en Model Context Protocol (MCP)-server som kopplar AI-assistenter och applikationer till Lara Translate API och möjliggör professionell översättningsfunktionalitet. Genom att fungera som en brygga mellan AI-modeller och översättningstjänsten möjliggör den sömlös integration för uppgifter som språkidentifiering, kontextmedvetna översättningar och användning av översättningsminnen. Servern gör det möjligt för AI-applikationer att säkert och flexibelt utföra översättningar, upptäcka tillgängliga verktyg och resurser samt hantera översättningsförfrågningar med strukturerade parametrar. Detta tillvägagångssätt förbättrar utvecklingsflöden och låter applikationer erbjuda högkvalitativa översättningar utan att direkt behöva hantera det underliggande API:et, samtidigt som säkerheten för API-uppgifter upprätthålls och avancerade funktioner för icke-engelska språk stöds.

Inga uttryckliga promptmallar är listade i tillgänglig dokumentation eller i arkivfilerna.

Inga uttryckliga MCP-resurser är beskrivna i tillgänglig dokumentation eller i arkivfilerna.

windsurf.json eller motsvarande konfigurationsfil.mcpServers:{

"mcpServers": {

"lara-mcp": {

"command": "npx",

"args": ["@translated/lara-mcp@latest"]

}

}

}

Säkra API-nycklar:

{

"lara-mcp": {

"env": {

"LARA_API_KEY": "din-api-nyckel"

},

"inputs": {

"apiKey": "${LARA_API_KEY}"

}

}

}

mcpServers-konfigurationen:{

"mcpServers": {

"lara-mcp": {

"command": "npx",

"args": ["@translated/lara-mcp@latest"]

}

}

}

Säkra API-nycklar:

{

"lara-mcp": {

"env": {

"LARA_API_KEY": "din-api-nyckel"

},

"inputs": {

"apiKey": "${LARA_API_KEY}"

}

}

}

{

"mcpServers": {

"lara-mcp": {

"command": "npx",

"args": ["@translated/lara-mcp@latest"]

}

}

}

Säkra API-nycklar:

{

"lara-mcp": {

"env": {

"LARA_API_KEY": "din-api-nyckel"

},

"inputs": {

"apiKey": "${LARA_API_KEY}"

}

}

}

mcpServers:{

"mcpServers": {

"lara-mcp": {

"command": "npx",

"args": ["@translated/lara-mcp@latest"]

}

}

}

Säkra API-nycklar:

{

"lara-mcp": {

"env": {

"LARA_API_KEY": "din-api-nyckel"

},

"inputs": {

"apiKey": "${LARA_API_KEY}"

}

}

}

Använda MCP i FlowHunt

För att integrera MCP-servrar i ditt FlowHunt-arbetsflöde, börja med att lägga till MCP-komponenten i ditt flöde och koppla den till din AI-agent:

Klicka på MCP-komponenten för att öppna konfigurationspanelen. I avsnittet för system-MCP-konfiguration, lägg in dina MCP-serverdetaljer med detta JSON-format:

{

"lara-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

När det är konfigurerat kan AI-agenten nu använda denna MCP som ett verktyg med tillgång till alla dess funktioner och kapabiliteter. Kom ihåg att ändra “lara-mcp” till det faktiska namnet på din MCP-server och byt ut URL:en mot din egen MCP-server-URL.

| Avsnitt | Tillgänglighet | Detaljer/Noteringar |

|---|---|---|

| Översikt | ✅ | Detaljerad introduktion tillgänglig |

| Lista över promptar | ⛔ | Inga uttryckliga promptmallar listade |

| Lista över resurser | ⛔ | Inga uttryckliga MCP-resurser beskrivna |

| Lista över verktyg | ✅ | Översättningsverktyg detaljerat |

| Säkra API-nycklar | ✅ | Instruktioner för miljövariabler finns |

| Samplingstöd (mindre viktigt i utvärdering) | ⛔ | Ej nämnt |

Baserat på tillgänglig dokumentation erbjuder Lara Translate MCP ett robust översättningsverktyg och tydliga installationsinstruktioner, men saknar uttryckliga promptmallar, MCP-resurslistor och dokumentation för sampling/root-stöd. Sammantaget är det en fokuserad, praktisk MCP-server för översättningsuppgifter.

| Har LICENSE | ✅ (MIT) |

|---|---|

| Har minst ett verktyg | ✅ |

| Antal forkar | 9 |

| Antal stjärnor | 57 |

Lara Translate MCP-server är en brygga mellan AI-assistenter och Lara Translate API och möjliggör säkra, kontextmedvetna översättningar, språkidentifiering och professionell flerspråkig innehållsgenerering inom AI-arbetsflöden.

Den tillhandahåller ett Översättningsverktyg som erbjuder strukturerad åtkomst till Lara Translate’s kärnfunktioner för översättning, inklusive textöversättning, språkidentifiering och kontextmedveten översättningsbehandling.

Lagra din API-nyckel som en miljövariabel i din MCP-serverkonfiguration. Detta håller känsliga inloggningsuppgifter säkra och utanför klientkod.

Ja, Lara Translate MCP stöder kontextmedvetna översättningar och kan använda översättningsminnen för att förbättra träffsäkerheten i domänspecifika sammanhang.

Vanliga användningsområden är flerspråkig innehållsgenerering, integration av översättning i AI-drivna arbetsflöden, språkidentifiering för AI-agenter och säker hantering av översättningsuppgifter.

Inga uttryckliga promptmallar eller samplingstöd finns dokumenterade i den nuvarande dokumentationen.

Stärk dina AI-arbetsflöden med sömlös, säker och professionell språköversättning med Lara Translate MCP-server.

Integrera FlowHunt med Lara Translate MCP för att leverera avancerade, kontextmedvetna översättningar i dina AI-arbetsflöden. Automatisera flerspråkigt innehåll...

DeepL MCP-servern integrerar avancerad översättning, omformulering och språkdetektering i AI-arbetsflöden via DeepL API. Den ger FlowHunt och andra AI-assistent...

ModelContextProtocol (MCP) Server fungerar som en brygga mellan AI-agenter och externa datakällor, API:er och tjänster, vilket gör det möjligt för FlowHunt-anvä...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.