Lara Translate MCP

将 FlowHunt 与 Lara Translate MCP 集成,在您的 AI 工作流中实现先进的、具备上下文感知能力的翻译。自动化多语言内容,利用翻译记忆库,并通过安全、可扩展的部署优化全球运营。...

FlowHunt在您的内部系统和AI工具之间提供额外的安全层,让您能够精细控制从MCP服务器可访问哪些工具。托管在我们基础设施中的MCP服务器可以与FlowHunt的聊天机器人以及ChatGPT、Claude和各种AI编辑器等热门AI平台无缝集成。

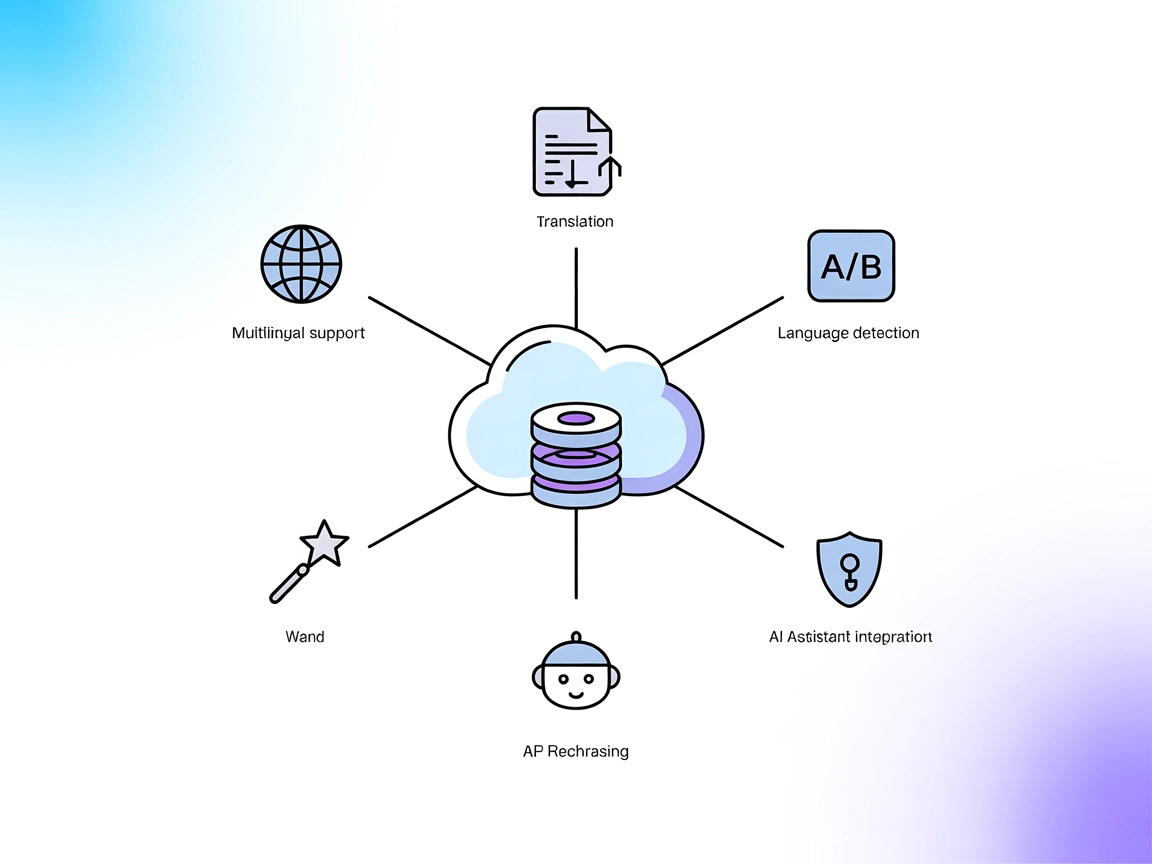

Lara Translate MCP 服务器是一个模型上下文协议(MCP)服务器,可将 AI 助手和应用程序连接到 Lara Translate API,实现专业级的翻译能力。它作为 AI 模型与翻译服务之间的桥梁,可无缝集成语言检测、上下文感知翻译及利用翻译记忆等任务。该服务器让 AI 应用能够安全灵活地执行翻译、发现可用工具与资源,并用结构化参数处理翻译请求。这种方式提升了开发工作流,使应用能够提供高质量翻译,而无需直接管理底层 API,同时保障 API 凭证安全,并支持非英语语言的高级功能。

当前文档或仓库文件中未列出明确的提示模板。

当前文档或仓库文件中未描述明确的 MCP 资源。

windsurf.json 或等效配置文件。mcpServers 部分添加 Lara Translate MCP 服务器:{

"mcpServers": {

"lara-mcp": {

"command": "npx",

"args": ["@translated/lara-mcp@latest"]

}

}

}

API 密钥安全设置:

{

"lara-mcp": {

"env": {

"LARA_API_KEY": "your-api-key"

},

"inputs": {

"apiKey": "${LARA_API_KEY}"

}

}

}

mcpServers 配置中添加 Lara Translate MCP:{

"mcpServers": {

"lara-mcp": {

"command": "npx",

"args": ["@translated/lara-mcp@latest"]

}

}

}

API 密钥安全设置:

{

"lara-mcp": {

"env": {

"LARA_API_KEY": "your-api-key"

},

"inputs": {

"apiKey": "${LARA_API_KEY}"

}

}

}

{

"mcpServers": {

"lara-mcp": {

"command": "npx",

"args": ["@translated/lara-mcp@latest"]

}

}

}

API 密钥安全设置:

{

"lara-mcp": {

"env": {

"LARA_API_KEY": "your-api-key"

},

"inputs": {

"apiKey": "${LARA_API_KEY}"

}

}

}

mcpServers 部分添加 Lara Translate MCP:{

"mcpServers": {

"lara-mcp": {

"command": "npx",

"args": ["@translated/lara-mcp@latest"]

}

}

}

API 密钥安全设置:

{

"lara-mcp": {

"env": {

"LARA_API_KEY": "your-api-key"

},

"inputs": {

"apiKey": "${LARA_API_KEY}"

}

}

}

在 FlowHunt 中使用 MCP

要将 MCP 服务器集成到您的 FlowHunt 工作流中,请先将 MCP 组件添加到流程,并将其连接到您的 AI 代理:

点击 MCP 组件以打开配置面板。在系统 MCP 配置部分,使用如下 JSON 格式填写您的 MCP 服务器信息:

{

"lara-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

配置完成后,AI 代理即可作为工具使用该 MCP,获取其所有功能和能力。请记得将 “lara-mcp” 替换为您 MCP 服务器的实际名称,并将 URL 替换为您自己的 MCP 服务器地址。

| 部分 | 可用性 | 说明/备注 |

|---|---|---|

| 概览 | ✅ | 提供详细介绍 |

| 提示词列表 | ⛔ | 未列出明确的提示模板 |

| 资源列表 | ⛔ | 未描述明确的 MCP 资源 |

| 工具列表 | ✅ | 详细介绍了翻译工具 |

| API 密钥安全设置 | ✅ | 提供环境变量设置说明 |

| 采样支持(评估时可忽略) | ⛔ | 未提及 |

根据现有文档,Lara Translate MCP 提供了强大的翻译工具和清晰的安装指导,但缺少明确的提示模板、MCP 资源列表及采样/模板相关文档。总体而言,它是一个专注实用的翻译 MCP 服务器。

| 有 LICENSE | ✅ (MIT) |

|---|---|

| 有至少一个工具 | ✅ |

| Fork 数量 | 9 |

| Star 数量 | 57 |

将 FlowHunt 与 Lara Translate MCP 集成,在您的 AI 工作流中实现先进的、具备上下文感知能力的翻译。自动化多语言内容,利用翻译记忆库,并通过安全、可扩展的部署优化全球运营。...

DeepL MCP 服务器通过 DeepL API 在 AI 工作流中集成了先进的翻译、改写和语言检测功能。它为 FlowHunt 及其他 AI 助手赋予实时多语言能力、自动语言识别和语气定制,实现无缝的全球交流。...

LlamaCloud MCP 服务器将 AI 助手连接至 LlamaCloud 上的多个托管索引,通过简洁、基于工具的 Model Context Protocol 接口,实现企业级文档检索、搜索与知识增强。...

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.