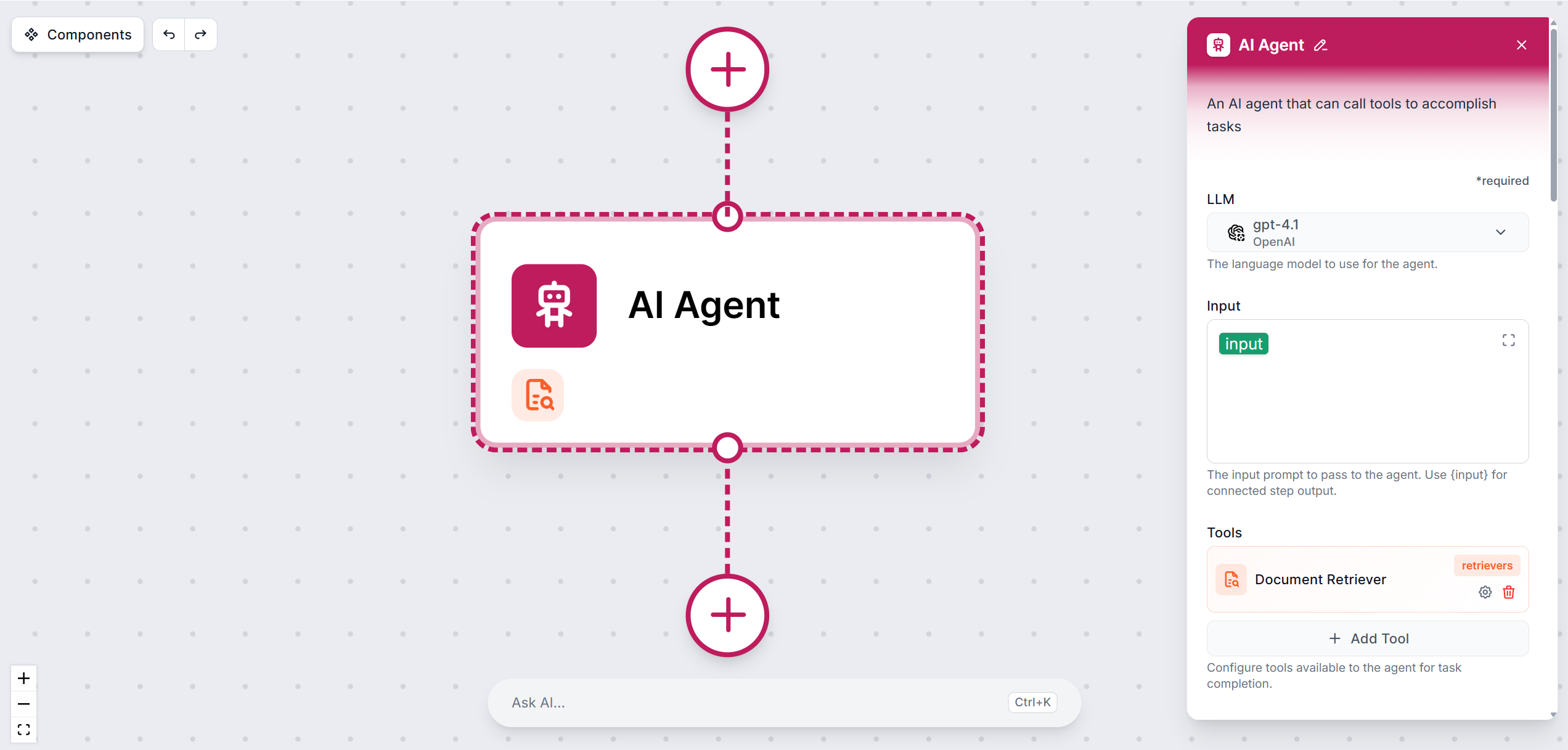

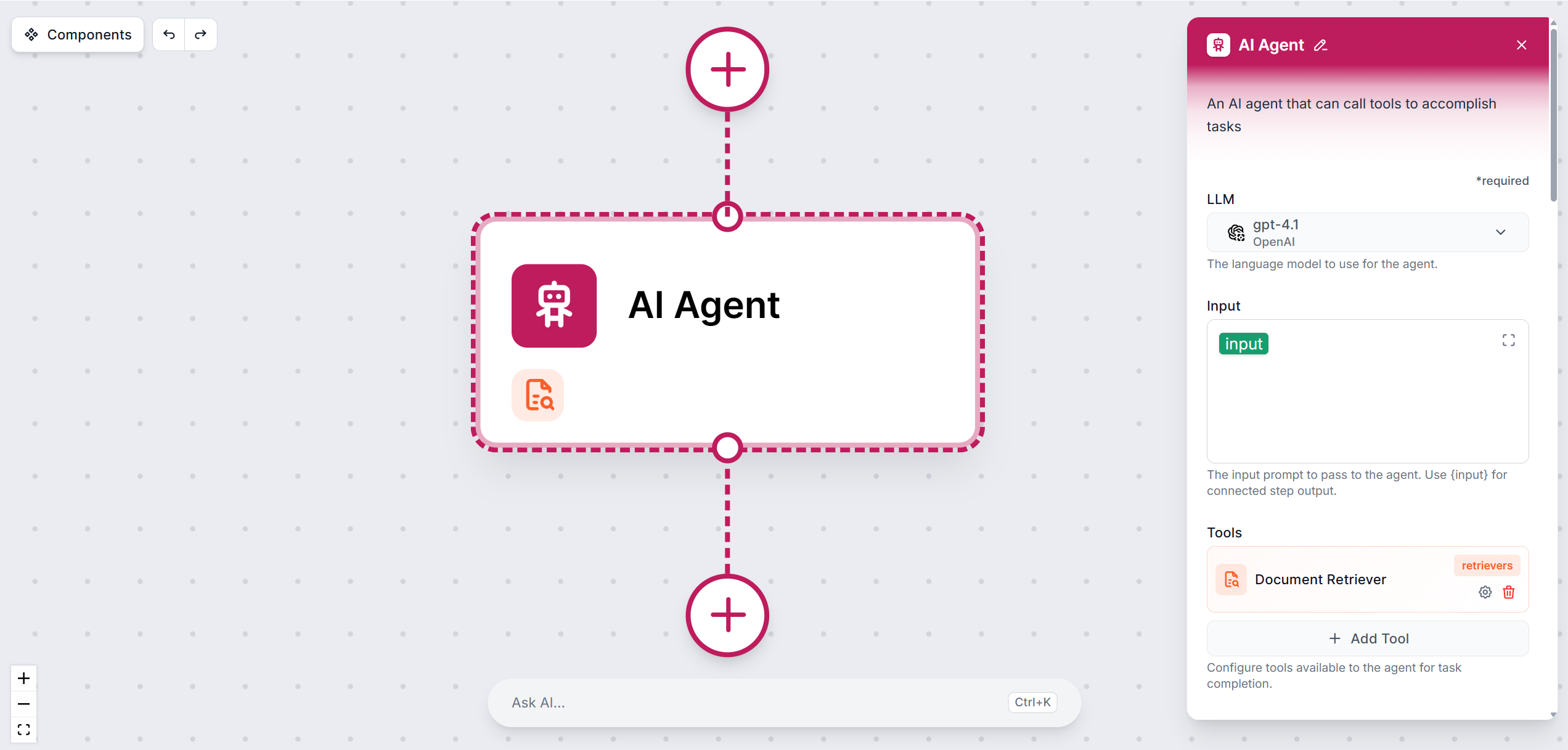

AI Ajanı

FlowHunt iş akışlarında AI Ajanı bileşenini öğrenin. Sistem mesajlarını yapılandırmayı, araçları bağlamayı, modelleri seçmeyi ve ajan performansını optimize etm...

11 yapay zeka ajan platformunun enjeksiyon mekanizmalarına derinlemesine bakış: yeteneklerin istemde nereye düştüğü, ne zaman yüklendiği, token cinsinden maliyetleri ve bağlam sıkıştırmasından nasıl kurtulduğu.

Her yapay zeka ajan çerçevesi aynı temel soruyla karşı karşıyadır: Bir LLM’i belirli bir konuda nasıl iyi hale getirirsiniz? Modelin kendisi geniş bir genel bilgiye sahiptir, ancak kod incelemesi yapması, altyapı dağıtması veya Minecraft’ta gezinmesi gerektiğinde — uzmanlaşmış talimatlara, araç erişimine ve alan bağlamına ihtiyaç duyar.

Bu, yetenek enjeksiyonu problemidir. Ve her büyük çerçeve bunu farklı şekilde çözer.

Bazı platformlar her şeyi baştan sistem istemine yükler. Diğerleri tembel yükleme kullanarak yetenekleri yalnızca ajan ihtiyaç duyduğunda ortaya çıkarır. Birkaçı ise anlamsal benzerliğe dayalı olarak ilgili yetenekleri almak için vektör veritabanları kullanır. Farklar akademik değildir — doğrudan token maliyetlerini, ajan güvenilirliğini ve bir ajanın gerçekçi olarak kaç yeteneği yönetebileceğini etkiler.

Yeteneklerin istemde tam olarak nereye düştüğünü, ne zaman yüklendiğini, token cinsinden ne kadara mal olduğunu ve bağlam penceresi dolduğunda nasıl hayatta kaldığını anlamak için 11 büyük yapay zeka ajan platformunu analiz ettik. Bu, yüzeysel bir özellik karşılaştırması değildir. Her platformun kesin enjeksiyon mekanizmalarını haritalamak için kaynak koda, belgelere ve mimari diyagramlara derinlemesine indik.

Ayrıntılara geçmeden önce işte genel bakış.

| Platform | Enjeksiyon Noktası | Ne Zaman Yüklenir | Mekanizma |

|---|---|---|---|

| Claude Code | Sistem hatırlatıcısı (meta veri) + konuşma mesajı (gövde) | Meta veri oturum başlangıcında; gövde /command veya otomatik eşleşmede | Çerçeve meta veriyi enjekte eder; Skill aracı etkinleştirmede tam gövdeyi yükler |

| CrewAI | Görev istemi (LLM çağrısından önce eklenir) | Her görev yürütmesinde _finalize_task_prompt() aracılığıyla | format_skill_context() tüm yetenek gövdelerini isteme ekler |

| LangChain Deep Agents | Sistem istemi (meta veri) + konuşma geçmişi (gövde) | Meta veri başlangıçta; gövde ajan read_file() çağırdığında | SkillsMiddleware dizini enjekte eder; ajan dosya sistemi aracıyla gövdeyi yükler |

| OpenAI Responses API | Kullanıcı istemi bağlamı (platform yönetimli) | API çağrısında skill_reference ile | Platform meta veriyi ekler; model çağrıda tam SKILL.md’yi okur |

| OpenAI Agents SDK | Araç tanımları (ToolSearchTool ile ertelenen) | Oluşturmada ad alanı adları; ToolSearchTool çağrısında şemalar | tool_namespace() + kademeli keşif için ToolSearchTool() |

| AutoGen Teachability | Değiştirilmiş kullanıcı mesajı (alınan notlar enjekte edilir) | Her turda — her LLM çağrısından önce vektör DB alımı | Ara yazılım mesajı yakalar, ChromaDB’yi sorgular, en iyi K eşleşmeyi enjekte eder |

| Semantic Kernel | Fonksiyon çağırma şemaları + istem şablonu içeriği | Tüm şemalar başlangıçta; şablon içeriği fonksiyon çağrısında | kernel.add_plugin() tümünü kaydeder; kernel.invoke() şablonları işler |

| MetaGPT | Aksiyon istem şablonu (LLM çağrısına işlenir) | Rolün _act() metodu belirli bir Aksiyon için tetiklendiğinde | Action.run() PROMPT_TEMPLATE‘i biçimlendirir, aask() ile gönderir |

| Voyager | Kod üretim istemi (alınan yetenek kodu) | Her kod üretiminden önce; gömme benzerlik araması | SkillLibrary.retrieve_skills() en iyi 5’i az sayıda örnek olarak enjekte eder |

| DSPy | Predict modülü istemlerinde derlenmiş az sayıda örnek demolar | Optimize edici tarafından çevrimdışı derlenir; çalışma zamanında sabit | BootstrapFewShot / MIPROv2 en iyi demoları seçer; Predict isteme işler |

| SuperAGI | Ajanın araç listesindeki araç şemaları | Ajan oluşturmada — tüm araç seti araçları önceden kaydedilir | BaseToolkit.get_tools() tümünü fonksiyon çağırma araçları olarak kaydeder |

| CAMEL-AI | Fonksiyon şemaları + rol sistem mesajı | Ajan oluşturmada — tüm araçlar önceden kaydedilir | ChatAgent(tools=[*toolkit.get_tools()]) başlatmada her şeyi yükler |

| Platform | Her Zaman Mevcut mu? | Kalıcılık | Token Maliyeti |

|---|---|---|---|

| Claude Code | Meta veri: EVET. Gövde: yalnızca etkinleştirmeden sonra | Oturum kapsamlı. Sıkıştırmada: yeniden eklenir (5K/yetenek, 25K üst sınır) | ~250 karakter/yetenek meta verisi; bağlam bütçesinin %1’i |

| CrewAI | EVET — her görev isteminde tam gövde | Her görevde taze enjeksiyon; görevler arası kalıcılık yok | Her çağrıda tam gövde. 50K karakter yumuşak sınır |

| LangChain Deep Agents | Meta veri: EVET. Gövde: talep üzerine | Gövde konuşma geçmişinde kalır; alt ajan yetenekleri izole | ~100 token/yetenek meta verisi; gövde bir kez ödenir (~3.302 token) |

| OpenAI Responses API | Ad+açıklama: EVET. Tam gövde: çağrıda | Yalnızca tek API yanıtı; çağrılar arası kalıcılık yok | Platform yönetimli |

| OpenAI Agents SDK | Ad alanı listesi: EVET. Şemalar: talep üzerine | Yalnızca tek çalışma; her oturumda yeniden keşif | Etkinleştirilene kadar minimum |

| AutoGen Teachability | HAYIR — her turda yalnızca ilgili notlar | ChromaDB ile oturumlar arası; süresiz kalıcılık | ~3-5 not/tur (değişken) |

| Semantic Kernel | Tüm şemalar: EVET. Şablonlar: çağrıda | Çekirdek örneği başına bellekte; oturumlar arası yok | Tüm şemalar her zaman mevcut |

| MetaGPT | HAYIR — yalnızca mevcut Aksiyonun şablonu | Yalnızca tek aksiyon yürütmesi | Tur başına tek şablon |

| Voyager | HAYIR — görev başına en iyi 5 alınır | Vektör DB’de ömür boyu kalıcılık | ~500-2.000 token/yetenek örneği |

| DSPy | EVET — derlenmiş demolar sabitlenmiş | JSON’a serileştirilebilir; oturumlar arası kalıcılık | Derlemeden sonra sabit (3-8 demo/modül) |

| SuperAGI | EVET — tüm şemalar her zaman mevcut | Ajan oturumu içinde | Tüm şemalar her zaman mevcut |

| CAMEL-AI | EVET — tüm şemalar + rol istemi | Konuşma oturumu içinde | Tüm şemalar her zaman mevcut |

Karşılaştırmaya geçmeden önce problem alanını tanımlayalım. Bir yapay zeka ajanının bağlam penceresi — LLM’in her çağrıda gördüğü toplam metin — sabit bir boyuta sahiptir. Her talimat tokeni, konuşma geçmişi, araç tanımı ve alınan veri, o pencerede yer için yarışır.

Ajan bağlamında bir “yetenek”, ajanın davranışını değiştiren herhangi bir yapılandırılmış uzmanlık paketidir. Bu şunlar olabilir:

Enjeksiyon mekanizması — bu içeriğin bağlama nerede ve ne zaman girdiği — üç kritik özelliği belirler:

Her çerçeve bu üç boyut arasında farklı ödünleşimler yapar. Her birini inceleyelim.

11 platformun tamamında, yetenek enjeksiyonu yaklaşımları “her şey önceden yüklü” ile “açıkça gerekli olana kadar hiçbir şey yüklü değil” arasında bir yelpazede yer alır.

Bir uçta, CrewAI, SuperAGI ve CAMEL-AI gibi platformlar, etkinleştirilmiş her yeteneğin tam içeriğini her LLM çağrısına enjekte eder. Ajan her zaman tam uzmanlığına sahiptir. Basit, güvenilir, ama token açısından pahalı.

Diğer uçta, Claude Code, LangChain Deep Agents ve OpenAI’ın Responses API’si kademeli açıklama kullanır — ajan başlangıçta yalnızca yetenek adlarını ve kısa açıklamaları görür, tam içerik ise talep üzerine yüklenir. Verimli, ölçeklenebilir, ancak ajanın bir yeteneğe ne zaman ihtiyaç duyduğunu fark etmesini gerektirir.

Ortada, AutoGen Teachability ve Voyager her turda yalnızca en ilgili yetenekleri enjekte etmek için anlamsal alma kullanarak dinamik, bağlama duyarlı bir enjeksiyon kalıbı oluşturur.

Sonra da benzersiz yaklaşımlar vardır: DSPy optimize edilmiş az sayıda örnek demoları çevrimdışı derler ve bunları kalıcı olarak modül istemlerine yerleştirir. MetaGPT yetenekleri, yalnızca belirli bir rol belirli bir aksiyona geçtiğinde etkinleşen aksiyon şablonları olarak kodlar.

Her birini ayrıntılı olarak inceleyelim.

Claude Code, farkındalığı token verimliliğiyle dengeleyen üç katmanlı kademeli açıklama sistemi ile en gelişmiş yetenek enjeksiyon mimarilerinden birini uygular.

Oturum başlangıcında, mevcut her yeteneğin adı ve açıklaması bir system-reminder mesajına — modelin her zaman gördüğü bir meta veri bloğuna — enjekte edilir. Bu, yetenek başına yaklaşık 250 karakter maliyetine sahiptir ve tüm yetenek açıklamaları için bağlam penceresi bütçesinin yaklaşık %1’ini tüketir (yedek bütçe olarak yaklaşık 8K karakter, SLASH_COMMAND_TOOL_CHAR_BUDGET ortam değişkeniyle geçersiz kılınabilir).

Benzer şekilde, ertelenmiş araçlar — tam JSON şemaları henüz yüklenmemiş araçlar — sistem hatırlatıcısı bloklarında yalnızca isim listesi olarak görünür. Claude Code v2.1.69 itibarıyla, Bash, Read, Edit, Write, Glob ve Grep gibi yerleşik sistem araçları bile ToolSearch arkasında ertelenerek, sistem araç bağlamı yaklaşık 14-16K tokenden yaklaşık 968 tokene düşürülmüştür.

Ajan, tam tanımların token maliyetini ödemeden nelerin mevcut olduğunu bilecek kadar bilgi görür.

Bir kullanıcı eğik çizgi komutu yazdığında (örn. /commit) veya model açıklamasına dayalı olarak bir yeteneği otomatik eşleştirdiğinde, tam SKILL.md gövdesi Skill aracı aracılığıyla bir konuşma mesajı olarak yüklenir. Bu gövde, bazen binlerce token ayrıntılı rehberlik içeren tam talimatları barındırır.

Önemli detay: Önce kabuk ön işlemesi çalışır (yetenek dosyasındaki herhangi bir !command direktifi yürütülür ve çıktıları direktifin yerini alır) ve yüklendikten sonra yetenek gövdesi oturumun geri kalanında konuşmada kalır.

Ek kaynaklar — referans belgeler, betikler, varlık dosyaları — yalnızca model açıkça Read aracını kullanarak erişmeye karar verdiğinde okunur. Bunlar asla otomatik olarak yüklenmez.

Konuşma bağlam sınırına yaklaştığında ve sıkıştırma tetiklendiğinde, Claude Code en son çağrılan yetenekleri yetenek başına 5K token ve toplam 25K maksimum bütçeyle yeniden ekler. En son çağrılan yetenekler öncelik alır. Daha eski yetenekler tamamen düşürülebilir.

Bu üç katmanlı mimari, 20’den fazla mevcut yeteneğe sahip bir ajanın minimum ön maliyet ödemesini ancak herhangi birinin tam uzmanlığına tek bir turda erişebilmesini sağlar.

CrewAI, kademeli açıklamanın tam tersi yaklaşımı benimser. Bir ajan için bir yetenek etkinleştirildiğinde, tam içeriği ajanın yürüttüğü her görev istemine enjekte edilir.

CrewAI’daki yetenekler, her biri YAML ön bilgisi (ad, açıklama, lisans, uyumluluk, izin verilen araçlar) ve bir markdown gövdesi içeren SKILL.md dosyasına sahip bağımsız dizinlerdir. Yetenek sistemi, yetenekler ve araçlar arasında ayrım yapar: yetenekler, ajanın nasıl düşündüğünü şekillendiren talimatlar ve bağlam enjekte ederken, araçlar eylemler için çağrılabilir fonksiyonlar sağlar.

Ajan başlatma sırasında, Agent.set_skills() meta veri düzeyinde yetenek dizinlerini taramak için discover_skills() çağırır, ardından tam yetenek gövdelerini okumak için activate_skill() çağırır. Görev yürütme zamanında, _finalize_task_prompt() her etkinleştirilmiş yetenek için format_skill_context() çağırır ve tüm biçimlendirilmiş yetenek içeriğini görev istemine ekler.

LLM şunu alır: [sistem mesajı] + [görev istemi + TÜM yetenek gövdeleri]

CrewAI yetenek başına 50.000 karakterde yumuşak bir uyarı uygular ancak katı sınır yoktur. Belgeler, büyük istem enjeksiyonlarının modelin dikkatini dağıttığı için yeteneklerin odaklı ve özlü tutulmasını önerir — bağlam çürümesi araştırmaları göz önüne alındığında gerçek bir endişe.

Ödünleşim basittir: ajan her zaman tam uzmanlığa sahiptir (yüksek güvenilirlik), ancak token maliyeti görev başına yetenek sayısıyla doğrusal olarak artar (düşük verimlilik). 1-2 odaklı yeteneğe sahip ajanlar için bu iyi çalışır. Geniş yetenek setlerine ihtiyaç duyan ajanlar için hızla pahalılaşır.

Her görev taze bir enjeksiyon alır. Görevler arasında yetenek içeriği birikimiyle yoktur — bu aslında bir hata değil, bir özelliktir. Her görevin temiz bir bağlamla başladığı anlamına gelir ve oturum tabanlı kalıcılığın yaratabileceği bayatlama sorunlarını önler.

LangChain Deep Agents, ajanın kendisinin tam yetenek içeriğini ne zaman yükleyeceğine karar verdiği gelişmiş bir ara yazılım tabanlı yetenek sistemi uygular — ajanın etkinleştirmeyi kontrol ettiği gerçek bir kademeli açıklama modeli.

Katman 1 (Dizin): SkillsMiddleware başlangıçta tüm SKILL.md ön bilgilerini ayrıştırır ve sistem istemine hafif bir dizin enjekte eder. Bu dizin yalnızca adları ve açıklamaları içerir ve yetenek başına tam içerik için yaklaşık 3.302 token yerine yaklaşık 278 tokene mal olur.

Katman 2 (Tam İçerik): Ajan bir yeteneğin ilgili olduğunu belirlediğinde, yeteneğin SKILL.md yolu üzerinde read_file() çağırır. Bu normal bir araç çağrısıdır — çerçeve gövdeyi enjekte etmez; ajan onu yüklemek için bilinçli bir karar verir. Tam içerik, bir araç sonucu olarak konuşma geçmişine girer.

Katman 3 (Derinlemesine İnceleme): Destekleyici materyaller, referans belgeler ve betikler yalnızca ajan bunları açıkça okuduğunda erişilir.

12 yetenekle, kademeli açıklama bağlamı yaklaşık 30.000 tokenden (tümü yüklü) yaklaşık 600 tokene (yalnızca dizin) düşürür ve belirli bir görev için ilgili yetenekler yüklendiğinde 2.000-5.000’e genişler. Bu, yeteneğe bağlı token tüketiminde potansiyel %83-98 oranında bir azalmadır.

Birden fazla yetenek kaynağı katmanlanabilir ve adlar çakıştığında son kaynak kazanır. 10 MB’ın üzerindeki dosyalar otomatik olarak atlanır.

Claude Code yüklemeyi tetiklemek için özel bir Skill aracı kullanırken, Deep Agents ajanın mevcut read_file aracını yeniden kullanır. Bu, yükleme mekanizmasının şeffaf olduğu anlamına gelir — ajan yetenek dosyalarını diğer dosyaları okuduğu gibi okur. Dezavantajı, özel sıkıştırma davranışının olmamasıdır: konuşma geçmişine giren yetenek içeriği, öncelik sırası olmaksızın standart LangChain mesaj kırpmaya tabidir.

OpenAI, yetenek enjeksiyonunu iki farklı ama felsefi olarak uyumlu mekanizma aracılığıyla uygular: Responses API’nin tool_search araç türü ve Agents SDK’nın ToolSearchTool‘u.

tool_search araç türü (GPT-5.4+ sürümünde mevcuttur) geliştiricilerin büyük araç yüzeylerini çalışma zamanına kadar ertelemesine olanak tanır. Üç erteleme stratejisi mevcuttur:

@function_tool(defer_loading=True) — model fonksiyon adını ve açıklamasını görür ancak parametre şeması ertelenir. Parametre düzeyinde token tasarrufu sağlar.tool_namespace(name=..., description=..., tools=[...]) — fonksiyonları tek bir ad alanı altında gruplar. Model yalnızca ad alanı adını ve açıklamasını görür, önemli ölçüde daha fazla token tasarrufu sağlar.HostedMCPTool(tool_config={..., "defer_loading": True}) — tüm MCP sunucu araç yüzeylerini erteler.Model belirli bir araca ihtiyaç duyduğunu belirlediğinde, bir tool_search çağrısı yapar. API, istem önbelleğini korumak için bağlam penceresinin sonuna enjekte edilen 3-5 ilgili araç tanımı döndürür.

Agents SDK programatik bir eşdeğer sağlar. Araç ad alanları kaydedilir ancak yüklenmez:

crm_tools = tool_namespace(

name="crm",

description="CRM management tools",

tools=[...]

)

agent = Agent(tools=[*crm_tools, ToolSearchTool()])

Çalışma zamanında ajan yalnızca ad alanı adlarını görür. Tam şemaları keşfetmek ve yüklemek için ToolSearchTool("crm") çağırır, ardından o ad alanı içindeki bireysel araçları çağırabilir.

Her API isteği bağımsızdır. Keşfedilen araçlar çağrılar arasında kalıcı değildir. Bu, karşılaştırmamızdaki en durumsuz yaklaşımdır — temiz, öngörülebilir, ancak araçlar değişirse her istekte yeniden keşif gerektirir.

AutoGen’in Teachability yeteneği, bu karşılaştırmadaki diğer tüm çerçevelerden temelden farklı bir yaklaşım benimser. Statik yetenek içeriği enjekte etmek yerine, her turda ChromaDB vektör veritabanından ilgili “notları” dinamik olarak alır.

Teachability, ajan işlemeden önce gelen her kullanıcı mesajını yakalayan process_last_received_message üzerinde bir kanca kaydeder:

TextAnalyzerAgent gelen mesajdan anahtar kavramları çıkarırmax_num_retrievals ile yapılandırılabilir, varsayılan 10)Kritik olarak, değiştirilmiş mesaj saklanan konuşma geçmişine yayılmaz — yalnızca orijinal mesaj saklanır. Bu, not içeriğinin turlar arasında birikmesini önler.

LLM yanıt verdikten sonra, ikinci bir kanca yanıtı yeni öğrenmeler açısından analiz eder:

TextAnalyzerAgent yanıttaki yeni bilgiyi tanımlarBu, ajanın zamanla uzmanlık biriktirdiği gerçek bir öğrenme döngüsü oluşturur.

AutoGen Teachability, karşılaştırmamızdaki yetenekleri oturumlar arası kalıcı kılan yalnızca üç platformdan biridir (Voyager ve DSPy ile birlikte). ChromaDB veritabanı diskte bulunur, yani bir ajan Pazartesi etkileşimlerinden öğrenebilir ve bu bilgiyi Cuma günü uygulayabilir.

recall_threshold parametresi (varsayılan 1.5), bir mesajın alma için saklanan bir nota ne kadar benzer olması gerektiğini kontrol eder ve reset_db gerektiğinde tüm belleği temizleyebilir.

Her turda yalnızca ilgili notlar enjekte edildiğinden (genellikle 3-5), token maliyeti, not veritabanı ne kadar büyürse büyüsün doğal olarak sınırlıdır. 10.000 saklanan nota sahip bir ajan, yalnızca mevcut turla en ilgili birkaç tanesinin maliyetini öder.

Microsoft’un Semantic Kernel’i basit bir yaklaşım benimser: eklentiler, Kernel’e kaydedilen KernelFunction nesnelerinin koleksiyonlarıdır ve şemaları LLM’e fonksiyon çağırma araç tanımları olarak sunulur.

Fonksiyon Çağırma: ToolCallBehavior.AutoInvokeKernelFunctions ayarlandığında, tüm kayıtlı fonksiyonlar her API isteğinde mevcut araçlar olarak LLM’e gönderilir. LLM hangisini çağıracağına karar verir; Semantic Kernel çağrıyı ve sonuç yönlendirmesini yönetir.

İstem Şablonları: Semantic Kernel’in şablon söz dizimi ({{plugin.function}}, Handlebars veya Liquid) fonksiyonların istem işleme sırasında satır içi çağrılmasına olanak tanır. Sonuçlar, LLM’e ulaşmadan önce doğrudan istem metnine gömülür — tembel araç çağırma yerine bir tür hevesli değerlendirme.

Her kayıtlı eklentinin şeması her API çağrısına dahil edilir. Yerleşik ertelenmiş yükleme, ad alanı gruplama veya talep üzerine etkinleştirme yoktur. Belgeler, token tüketimini ve hatalı çağrıları azaltmak için yalnızca belirli bir senaryo için gereken eklentilerin içe aktarılmasını açıkça önerir.

Bu, Semantic Kernel’i en öngörülebilir platformlardan biri yapar — ajanın neye erişimi olduğunu her zaman tam olarak bilirsiniz — ancak ölçeklenebilirliği sınırlar. 50 kayıtlı fonksiyona sahip bir ajan, her çağrıda tam şema maliyetini öder.

Eklenti kaydı Kernel örneği başınadır ve bellektedir. Oturumlar arası yetenek kalıcılığı için yerleşik bir mekanizma yoktur.

MetaGPT, yetenekleri bağımsız paketler olarak değil, rol davranışını yöneten Standart İşlem Prosedürleri (SOP’lar) içine gömülü aksiyon şablonları olarak kodlar.

MetaGPT’deki her Role, istemlere enjekte edilen bir persona ön eki ve bir dizi Action sınıfına sahiptir. Her Action, LLM çağrısını yapılandırmak için doğal dil istem şablonları kullanan aask() aracılığıyla çağrılan bir LLM vekili içerir.

Role._act() tetiklendiğinde, üç tepki modunu destekler:

"react": LLM, düşün-hareket et döngülerinde dinamik olarak aksiyonlar seçer"by_order": Aksiyonlar önceden belirlenmiş bir sırada sıralı olarak yürütülür"plan_and_act": Ajan önce plan yapar, ardından plana göre aksiyonları yürütürHerhangi bir anda yalnızca mevcut Aksiyonun istem şablonu aktiftir. Ajan diğer aksiyonların şablonlarını görmez — yalnızca rol ön eki ve belirli aksiyonun bağlamını görür. Bu, incelediğimiz tüm çerçeveler arasındaki en dar enjeksiyon penceresidir.

Action sınıfları içindeki bağlam ayrıştırma fonksiyonları, girişlerden ilgili bilgiyi çıkarır, böylece her aksiyon tam konuşma geçmişi yerine mevcut bağlamın seçilmiş bir alt kümesini alır.

Şablon her aksiyon yürütmesi için taze işlenir. Birikim veya oturumlar arası kalıcılık yoktur. Bu, her aksiyonu odaklı tutar ancak ajanın tek bir iş akışı içinde daha önce yüklenmiş yetenek içeriği üzerine inşa edemeyeceği anlamına gelir.

NVIDIA ve Caltech’ten Minecraft keşif ajanı Voyager, en zarif yetenek enjeksiyon mimarilerinden birini uygular: gömme benzerliğiyle alınan, büyüyen bir doğrulanmış program kütüphanesi.

Voyager, öz doğrulamayı geçen kod yazdığında (üretilen Mineflayer JavaScript oyunda gerçekten çalıştığında), kod ve belgeleme dizesi bir vektör veritabanında saklanır. Belgeleme dizesi gömmesi alma anahtarı olur.

Otomatik müfredatın önerdiği her yeni görevde:

İstem şöyle görünür:

You are a Minecraft bot. Here are some relevant skills you've learned:

// Skill: mineWoodLog

async function mineWoodLog(bot) { ... }

// Skill: craftPlanks

async function craftPlanks(bot) { ... }

Now write code to: build a wooden pickaxe

Üretilen kod, alınan yetenekleri ada göre çağırabilir ve birleşimsel yetenek oluşturmayı mümkün kılar — daha basit, doğrulanmış ilkellerden oluşturulan karmaşık davranışlar.

Yetenek kütüphanesi temel “ömür boyu öğrenme” mekanizmasıdır. Ajanın tüm yaşam süresi boyunca büyür ve yeni yetenekler eskilerin üzerine inşa edilir. Yeteneklerin insanlar tarafından yazıldığı çoğu çerçevenin aksine, Voyager’ın yetenekleri ajanın kendisi tarafından üretilir, doğrulanır ve saklanır.

Token maliyeti doğal olarak sınırlıdır: kütüphane 50 veya 5.000 yetenek içersin, her görev yalnızca en ilgili 5 almanın maliyetini öder.

DSPy, diğer tüm çerçevelerden kökten farklı bir yaklaşım benimser. Çalışma zamanında yetenek enjekte etmek yerine, DSPy optimal az sayıda örnek gösterimleri çevrimdışı derler ve bunları kalıcı olarak modül istemlerine yerleştirir.

İki ana optimize edici derlemeyi yönetir:

BootstrapFewShot: Program boyunca izler oluşturmak için bir öğretmen modülü kullanır. Kullanıcı tanımlı bir metriği geçen izler gösterim olarak tutulur. Program içindeki her dspy.Predict modülü kendi seçilmiş gösterim setini alır.

MIPROv2 (Multi-prompt Instruction Proposal Optimizer v2): Üç aşamalı bir süreç:

max_bootstrapped_demos (üretilen örnekler) ve max_labeled_demos (eğitim verilerinden) gibi parametreler her modülün istemine kaç örneğin gireceğini kontrol eder.

Derlendikten sonra, gösterimler her Predict modülünün demos özniteliğinde saklanır ve her LLM çağrısında isteme biçimlendirilir. Çalışma zamanında değişmezler — “yetenek” dondurulmuştur.

Bu, DSPy yeteneklerinin karşılaştırmamızda en öngörülebilir olduğu anlamına gelir: token maliyeti derlemeden sonra bilinir, turlar arasında varyans yoktur ve ajan her zaman aynı gösterimleri görür. Dezavantajı esneksizliktir — yetenekleri değiştirmek için yeniden derleme yapmanız gerekir.

Derlenmiş programlar, tüm gösterimler dahil olmak üzere JSON’a serileştirilir. Tamamen kalıcıdır ve oturumlar arası yüklenebilir, bu da DSPy’yi en dayanıklı yetenek saklama mekanizmalarından biri yapar.

SuperAGI, tüm araçların ajan başlatma sırasında kaydedildiği geleneksel bir araç seti kalıbı kullanır.

Her araç seti BaseToolkit‘i şunlarla genişletir:

name ve description öznitelikleriBaseTool örneklerinin listesini döndüren get_tools() metoduget_env_keys()Araç setleri, SuperAGI’nın araç yöneticisi aracılığıyla GitHub depolarından yüklenir. Ajan başlatma sırasında, BaseToolkit.get_tools() tüm araçları döndürür ve tam şemaları LLM’e fonksiyon çağırma tanımları olarak sunulur.

Ertelenmiş yükleme, kademeli açıklama veya tur başına filtreleme yoktur. Her kayıtlı aracın şeması her çağrıda mevcuttur. Bu en basit enjeksiyon modelidir ve odaklı, küçük araç setlerine sahip ajanlar için iyi çalışır ancak düzinelerce yeteneğe ihtiyaç duyan ajanlara ölçeklenmez.

CAMEL-AI benzer bir önceden kayıt kalıbı izler. Çeşitli araç setlerinden (örn. MathToolkit, SearchToolkit) araçlar, başlatma sırasında ChatAgent(tools=[...]) olarak bir liste halinde iletilir.

Çerçeve, modelin kullanımı anlayabilmesi için özel fonksiyonların net argüman adlarına ve kapsamlı belgeleme dizelerine ihtiyaç duyduğunu vurgular — araç şeması, modelin gördüğü tek “yetenek” içeriğidir. Ayrı bir talimat enjeksiyon mekanizması yoktur.

Son eklentiler arasında MCPToolkit aracılığıyla MCP (Model Context Protocol) desteği bulunur; bu, ChatAgent‘ın MCP sunucularına bağlanmasına ve harici araçları kaydetmesine olanak tanır. Bu, mevcut araç yüzeyini genişletir ancak enjeksiyon modelini değiştirmez — keşfedilen tüm MCP araçları yine önceden kaydedilir.

| Zamanlama | Platformlar | Ne Enjekte Edilir |

|---|---|---|

| Her zaman mevcut (oturum başlangıcı) | Claude Code, CrewAI, Deep Agents, Semantic Kernel, SuperAGI, CAMEL-AI, DSPy | Meta veri (ad + açıklama) veya tam şemalar |

| Etkinleştirmede (kullanıcı veya ajan tetikli) | Claude Code, Deep Agents, OpenAI | Tam yetenek gövdesi |

| Her görev/tur | CrewAI, AutoGen Teachability | Tam gövde (CrewAI) veya alınan notlar (AutoGen) |

| LLM seçiminde | Semantic Kernel, MetaGPT | İstem şablonu içeriği |

| Benzerlik eşleşmesinde | Voyager, AutoGen Teachability | Alınan kod veya notlar |

| Derlenmiş/sabit | DSPy | Optimize edilmiş az sayıda örnek demolar |

| Kalıcılık | Platformlar | Mekanizma |

|---|---|---|

| Yalnızca tek tur | MetaGPT, Voyager | Aksiyon/üretim başına işlenen şablon |

| Oturum içinde | Claude Code, Deep Agents, OpenAI, Semantic Kernel | Gövde mesaj geçmişinde kalır |

| Her görevde yeniden enjekte edilir | CrewAI, SuperAGI, CAMEL-AI | Her görev yürütmesinde taze eklenir |

| Oturumlar arası (kalıcı depolama) | AutoGen Teachability, Voyager, DSPy | Vektör DB / derlenmiş modüller / yetenek kütüphanesi |

| Platform | Bağlam Dolduğunda Ne Olur |

|---|---|

| Claude Code | En son yetenekleri yeniden ekler (her biri 5K token, 25K üst sınır). Eski yetenekler düşürülür |

| CrewAI | Uygulanamaz — görev başına taze enjekte edilir, birikim yok |

| Deep Agents | Gövde konuşma geçmişinde, standart LangChain kırpmaya tabi |

| OpenAI | Uygulanamaz — her API çağrısı bağımsız |

| AutoGen | Her turda yalnızca ilgili notlar alınır, doğal olarak sınırlı |

| Voyager | Görev başına yalnızca en iyi K yetenek alınır, doğal olarak sınırlı |

Bu platformlar genelinde en önemli mimari eğilim, kademeli açıklamanın benimsenmesidir — bilginin ihtiyaca göre kademeli olarak ortaya çıkarıldığı, arayüz tasarımından ödünç alınmış bir kavram.

Yetenek enjeksiyonuna saf bir yaklaşım — her şeyi önceden yükleme — iki sorun yaratır:

Kademeli açıklama, mevcut yeteneklerin hafif bir dizinini korurken tam içeriği yalnızca gerektiğinde yükleyerek her iki sorunu da çözer.

Claude Code özel bir sistem kullanır: sistem hatırlatıcısı mesajlarında yetenek meta verisi, etkinleştirme için bir Skill aracı ve ertelenmiş araç şemaları için ToolSearch. Çerçeve, öncelik tabanlı sıkıştırma ile enjeksiyonu otomatik olarak yönetir.

LangChain Deep Agents ajanın mevcut dosya okuma yeteneğini kullanır: SkillsMiddleware dizini enjekte eder ve ajan tam içeriği read_file() aracılığıyla yükler. Bu daha şeffaftır ancak daha az çerçeve düzeyinde optimizasyon sunar.

OpenAI Responses API platform yönetimli arama ile ad alanı tabanlı gruplama kullanır: araç ad alanları üst düzey açıklamalar sağlar ve tool_search ilgili şemaları döndürür. Platform arama mantığını tamamen yönetir.

Rakamlar ikna edicidir. 12 yetenekle:

Bu, tur başına yeteneğe bağlı token tüketiminde %83-98 oranında bir azalmadır. Yüzlerce turlu uzun bir oturumda, tasarruflar dramatik biçimde birikir.

11 platformun tamamına bakıldığında, dört farklı mimari kalıp ortaya çıkar:

Kullananlar: CrewAI, SuperAGI, CAMEL-AI, Semantic Kernel

Nasıl çalışır: Tam yetenek içeriği veya araç şemaları her LLM çağrısında mevcuttur.

Artıları:

Eksileri:

En uygun: Her zaman ilgili olan 1-3 temel yeteneğe sahip odaklı ajanlar.

Kullananlar: Claude Code, LangChain Deep Agents, OpenAI Responses API/Agents SDK

Nasıl çalışır: Hafif meta veri her zaman mevcut; tam içerik talep üzerine yüklenir.

Artıları:

Eksileri:

En uygun: Birçok yeteneğe erişmesi gereken ancak görev başına yalnızca birkaçını kullanan genel amaçlı ajanlar.

Kullananlar: AutoGen Teachability, Voyager

Nasıl çalışır: Vektör veritabanı sorguları, mevcut bağlamla anlamsal benzerliğe dayalı olarak ilgili yetenekleri/bilgiyi ortaya çıkarır.

Artıları:

Eksileri:

En uygun: Deneyimden öğrenen ve zamanla alan bilgisi biriktirmesi gereken ajanlar.

Kullananlar: DSPy, MetaGPT

Nasıl çalışır: Yetenekler sabit istem içeriğine derlenir (DSPy) veya katı aksiyon şablonları aracılığıyla etkinleştirilir (MetaGPT).

Artıları:

Eksileri:

En uygun: Güvenilirliğin esneklikten önce geldiği, iyi tanımlanmış görevlere sahip üretim pipeline’ları.

Doğru yetenek enjeksiyon mimarisi ajanınızın profiline bağlıdır:

Ajanınız dar, iyi tanımlanmış bir role sahipse (örn. bir kod inceleme botu, tek bir ürün için müşteri destek ajanı), sürekli aktif enjeksiyon (CrewAI/SuperAGI kalıbı) en basit ve en güvenilirdir. 2-3 sürekli mevcut yeteneğin token maliyeti yönetilebilirdir ve etkinleştirme mantığının karmaşıklığından kaçınırsınız.

Ajanınız geniş yeteneklere ihtiyaç duyuyor ancak etkileşim başına yalnızca birkaçını kullanıyorsa (örn. bir geliştirici asistanı, genel amaçlı bir otomasyon ajanı), kademeli açıklama (Claude Code/Deep Agents kalıbı) açık bir kazanandır. Ölçekte %83-98 token tasarrufu göz ardı edilemeyecek kadar önemlidir.

Ajanınız etkileşimlerden öğrenmesi ve gelişmesi gerekiyorsa (örn. kişisel asistan, bilgi biriktiren bir alan uzmanı), anlamsal alma (AutoGen Teachability kalıbı) diğer kalıpların sunmadığı öğrenme döngüsünü sağlar. Yalnızca bilgi tabanına nelerin girdiği konusunda kalite kontrolleriniz olduğundan emin olun.

Ajanınız iyi tanımlanmış pipeline’lar çalıştırıyorsa (örn. veri işleme, rapor oluşturma, standartlaştırılmış iş akışları), derlenmiş enjeksiyon (DSPy kalıbı) en öngörülebilir, optimize edilmiş davranışı sağlar.

Ajanların kutudan çıkar çıkmaz çalışması gereken üretim ajan ekipleri için hibrit bir yaklaşım öneriyoruz:

Temel yetenekler (ajan başına 1-2, birincil alan uzmanlığını tanımlayan): CrewAI tarzı, her zaman sistem istemine enjekte edilir. Bunlar, ajanın her turda ihtiyaç duyduğu vazgeçilmez yeteneklerdir.

Genişletilmiş yetenekler (ajanın ihtiyaç duyabileceği ek yetenekler): sistem isteminde yalnızca meta veri, gerektiğinde bir arama/yükleme mekanizması ile yüklenir, Deep Agents tarzı. Bunlar, ajanın yetenek setini ilgili olmadıklarında token maliyeti ödemeden genişletir.

Öğrenilmiş bilgi (birikmiş alan uzmanlığı): bir vektör veritabanında saklanır ve tur başına anlamsal olarak alınır, AutoGen tarzı. Bu, ajanın manuel yetenek yazımı olmadan zamanla gelişmesini sağlar.

Bu katmanlı mimari, bir sistem isteminin nasıl oluşturulduğuyla doğal olarak eşleşir: tarih → persona → sistem talimatları → temel yetenekler → yetenek dizini → rol/ekip bağlamı. Temel yetenekler ve dizin öngörülebilir, yönetilebilir bir token maliyeti eklerken, tam yetenek gövdeleri yalnızca gerektiğinde görünür.

Hangi enjeksiyon kalıbını kullanırsanız kullanın, bu token yönetimi stratejileri evrensel olarak geçerlidir:

Değişmeyen bağlamı (sistem talimatları, araç şemaları) istemin başına yerleştirin. İstem önbelleğini destekleyen sağlayıcılarda, önbelleğe alınan tokenler %75 daha az maliyetlidir. Claude Code ve OpenAI, keşfedilen araç şemalarını statik ön ek üzerindeki önbellek isabetlerini korumak için özellikle bağlam penceresinin sonuna enjekte eder.

Araç yanıtlarını tam sonuçları bağlamda tutmak yerine özetleyin. Tam veriyi, ajanın talep üzerine okuyabileceği harici referanslarda saklayın. Bu, özellikle oturum başına çok sayıda araç çağrısı yapan ajanlar için önemlidir.

Konuşma geçmişini özetleme yoluyla sıkıştırın. Uzun diyaloglardan temel gerçekleri yoğunlaştırılmış temsillere çıkarın. Oturum tabanlı kalıcılığa sahip her çerçeve, agresif geçmiş yönetiminden faydalanır.

Bilgiyi her şeyi önceden yüklemek yerine çalışma zamanında dinamik olarak alın. Bu, yetenekler, bilgi tabanları ve hatta konuşma geçmişi için geçerlidir. Araştırmalar bunun istem boyutlarını %70’e kadar azaltabileceğini göstermektedir.

Belirli görevler için alt ajanlar kullanarak her ajanın bağlamını odaklı tutun. Bir ajana 20 yetenek vermek yerine, her biri 4 yetenekli 5 ajanlık bir ekip oluşturun. Her ajan dar bir bağlam penceresi korur ve ekip toplu olarak tam yetenek setini kapsar.

Yapay zeka ajan çerçevelerinin yetenekleri bağlama enjekte etme şekli, ajan tasarımındaki en etkili mimari kararlardan biridir — ancak bu düzeyde ayrıntıyla nadiren tartışılır.

Alan, genel amaçlı ajanlar için tercih edilen kalıp olarak kademeli açıklama üzerinde açıkça yakınsıyor; Claude Code, LangChain Deep Agents ve OpenAI’ın tümü bağımsız olarak benzer üç katmanlı mimarilere ulaşıyor. Bu arada, anlamsal alma (AutoGen, Voyager) ve derlenmiş enjeksiyon (DSPy) gibi uzmanlaşmış kalıplar, kademeli açıklamanın tek başına ele almadığı önemli nişlere hizmet ediyor.

Bugün ajan sistemleri oluşturan uygulayıcılar için temel içgörü, yetenek enjeksiyonunun herkese uyan tek boyutlu bir sorun olmadığıdır. Doğru yaklaşım, ajanınızın rolüne, ihtiyaç duyduğu yetenek sayısına, zamanla öğrenip öğrenmesi gerektiğine ve token maliyetleri ile güvenilirlik ödünleşimlerine karşı toleransınıza bağlıdır.

En sağlam üretim sistemleri muhtemelen birden fazla kalıbı birleştirecektir — temel yetenekler için sürekli aktif, genişletilmiş yetenekler için kademeli açıklama ve birikmiş bilgi için anlamsal alma — hem verimli hem de uzman ajanlar yaratarak.

Yasha, Python, Java ve makine öğrenimi konusunda uzmanlaşmış yetenekli bir yazılım geliştiricisidir. Yasha, yapay zeka, prompt mühendisliği ve sohbet botu geliştirme konularında teknik makaleler yazar.

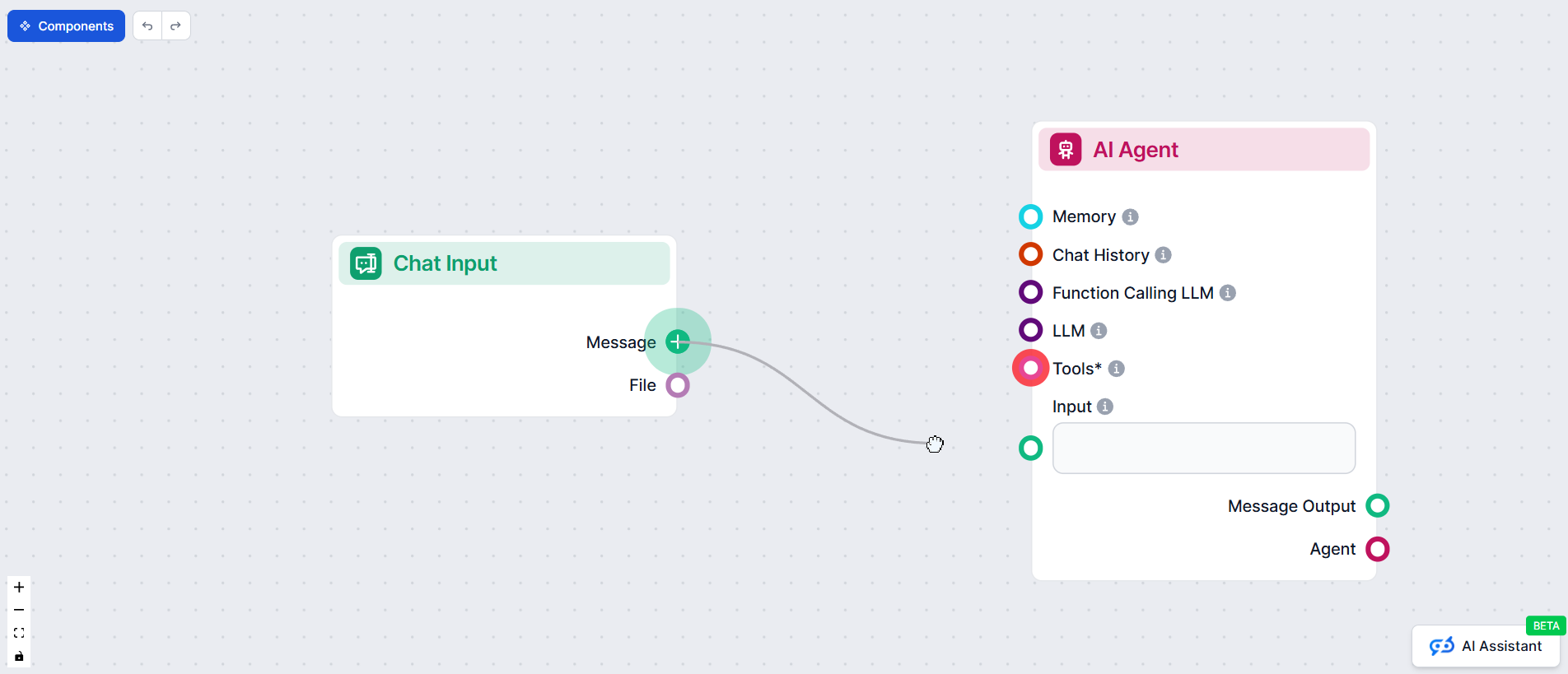

Akıllı yetenek enjeksiyonu ve bağlam yönetimi ile yapay zeka ajan ekipleri tasarlayın. Kod yazmaya gerek yok.

FlowHunt iş akışlarında AI Ajanı bileşenini öğrenin. Sistem mesajlarını yapılandırmayı, araçları bağlamayı, modelleri seçmeyi ve ajan performansını optimize etm...

2025’in en iyi yapay zekâ ajanı oluşturma platformlarının kapsamlı rehberi: FlowHunt.io, OpenAI ve Google Cloud’un ayrıntılı incelemeleri, sıralamaları ve karşı...

AI ajanları için bağlamı nasıl mühendislik edeceğinizi; araç geri bildirimini yöneterek, token kullanımını optimize ederek ve üretime hazır, güvenilir ajanlar o...

Çerez Onayı

Göz atma deneyiminizi geliştirmek ve trafiğimizi analiz etmek için çerezleri kullanıyoruz. See our privacy policy.