AI Shrnutí z vloženého textu

Tento nástroj je ideální pro profesionály, studenty i každého, kdo pracuje s rozsáhlými informacemi. Pomůže vám převést dlouhé texty do krátkých shrnutí....

Shrnutí textu je zásadní AI proces, který zhušťuje rozsáhlé dokumenty do stručných souhrnů při zachování klíčových informací a významu. Díky využití velkých jazykových modelů jako GPT-4 a BERT umožňuje efektivní správu a porozumění rozsáhlému digitálnímu obsahu pomocí abstraktních, extraktivních i hybridních metod.

Shrnutí textu je zásadní proces v oblasti umělé inteligence, jehož cílem je zhušťovat rozsáhlé dokumenty do stručných souhrnů při zachování důležitých informací a významu. S explozí digitálního obsahu tato schopnost umožňuje jednotlivcům i organizacím efektivně spravovat a chápat rozsáhlé datové sady bez nutnosti pročítání dlouhých textů. Velké jazykové modely (LLM), jako jsou GPT-4 a BERT, tuto oblast významně posunuly díky využití pokročilých technik zpracování přirozeného jazyka (NLP) pro tvorbu srozumitelných a přesných shrnutí.

Abstraktivní shrnutí:

Generuje nové věty, které vystihují hlavní myšlenky zdrojového textu. Na rozdíl od extraktivního shrnutí, které vybírá existující části textu, abstraktivní shrnutí obsah interpretuje a přeformuluje, čímž vytváří shrnutí připomínající lidskou tvorbu. Například dokáže zkrátit výsledky výzkumu do nových, stručných vět.

Extraktivní shrnutí:

Vybírá a kombinuje významné věty nebo fráze z původního textu na základě metrik, jako je četnost nebo důležitost. Zachovává původní strukturu, ale může postrádat kreativitu a plynulost lidských shrnutí. Tato metoda spolehlivě zachovává faktickou přesnost.

Hybridní shrnutí:

Spojuje silné stránky extraktivních i abstraktivních metod, zachycuje detailní informace a zároveň přeformuluje obsah pro větší srozumitelnost a plynulost.

Shrnutí textu pomocí LLM:

LLM automatizují shrnutí, nabízejí lidsky podobné porozumění a generování textu pro tvorbu shrnutí, která jsou přesná i čtivá.

Map-Reduce technika:

Rozdělí text na zvládnutelné části, každou část shrne a poté je spojí do výsledného shrnutí. Je obzvlášť účinná u dlouhých dokumentů, které přesahují kontextové okno modelu.

Refine technika:

Iterativní přístup, který začne počátečním shrnutím a následně jej zpřesňuje přidáváním dalších dat z následujících částí, a tím udržuje kontextovou návaznost.

Stuff technika:

Vloží celý text s promptem a vygeneruje shrnutí přímo. Je sice jednoduchá, ale omezená kontextovým oknem LLM a nejvhodnější pro kratší texty.

Klíčové aspekty při hodnocení shrnutí:

Složitost přirozeného jazyka:

LLM musí rozumět idiomům, kulturním odkazům a ironii, což může vést k chybným interpretacím.

Kvalita a přesnost:

Zajištění toho, aby shrnutí přesně odrážela původní obsah, je zásadní, zejména v právu nebo medicíně.

Různorodost zdrojů:

Různé typy textů (technické vs. narativní) mohou vyžadovat odlišné strategie shrnutí.

Škálovatelnost:

Efektivní zpracování velkých datových sad bez ztráty výkonu.

Ochrana osobních údajů:

Zajištění souladu s předpisy o ochraně dat při zpracování citlivých informací.

Agregace zpráv:

Automaticky zhušťuje zpravodajské články pro rychlé čtení.

Shrnutí právních dokumentů:

Usnadňuje revizi právních dokumentů a soudních spisů.

Zdravotnictví:

Shrnuje pacientské záznamy a lékařské výzkumy pro podporu diagnostiky a plánování léčby.

Business intelligence:

Analyzuje velké objemy tržních zpráv a finančních výkazů pro strategická rozhodnutí.

Shrnutí textu s velkými jazykovými modely (LLM) je rychle se rozvíjející oblast, kterou pohání obrovské množství digitálního textu dostupného dnes. Tento výzkum zkoumá, jak mohou LLM generovat stručná a srozumitelná shrnutí z rozsáhlých textů, a to jak extraktivně, tak abstraktivně.

Začněte tvořit vlastní AI řešení s pokročilými nástroji pro shrnutí textu od FlowHunt. Snadno zhušťujte a pochopte velké objemy obsahu.

Tento nástroj je ideální pro profesionály, studenty i každého, kdo pracuje s rozsáhlými informacemi. Pomůže vám převést dlouhé texty do krátkých shrnutí....

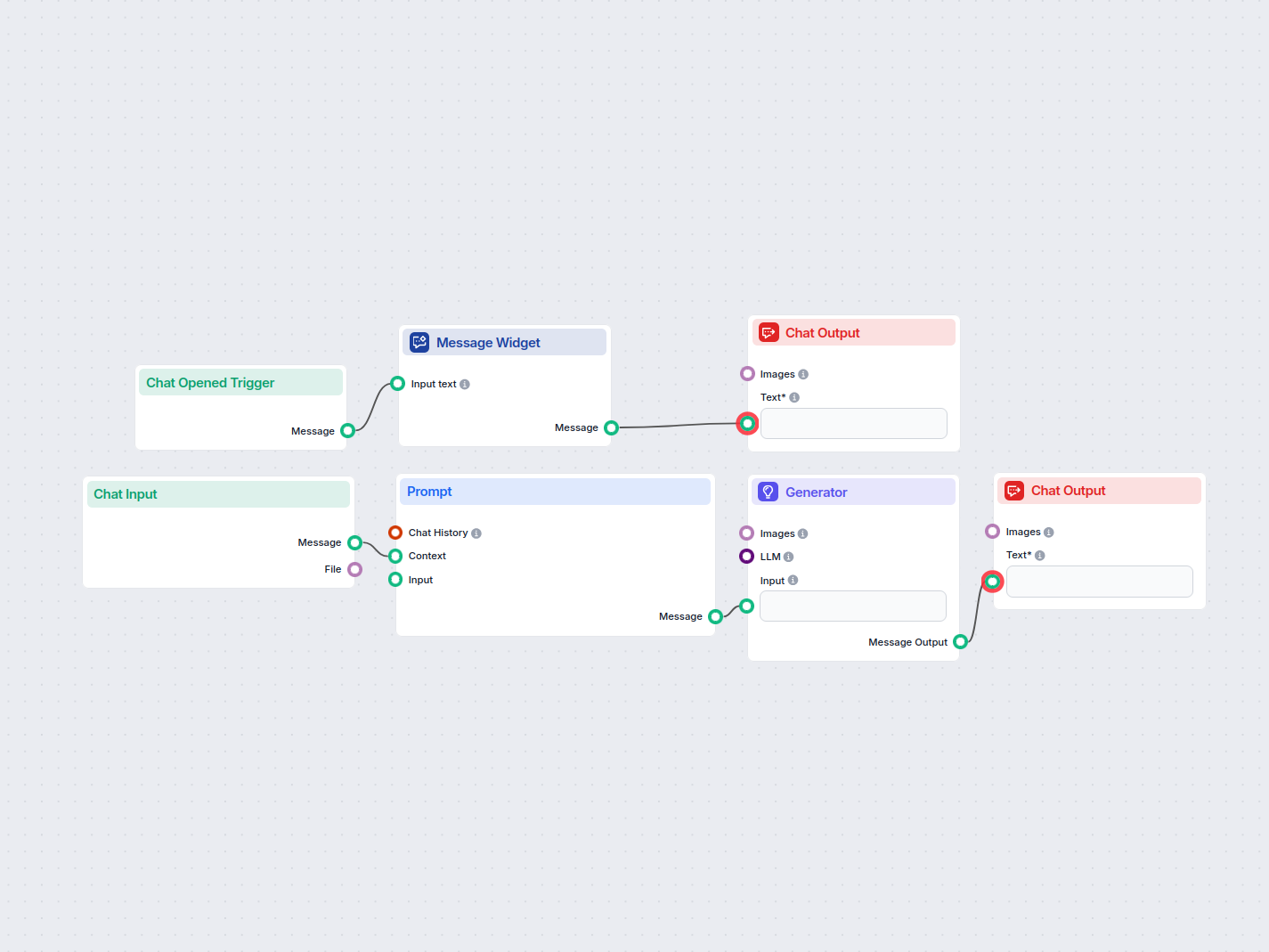

Snadno shrňte jakýkoli zadaný text do stručných klíčových bodů pomocí AI. Tento workflow přijímá uživatelský vstup, vygeneruje krátké shrnutí a zobrazí ho v pře...

Generování textu pomocí velkých jazykových modelů (LLM) označuje pokročilé využití strojového učení k produkci textu podobného lidskému na základě zadaných podn...

Souhlas s cookies

Používáme cookies ke zlepšení vašeho prohlížení a analýze naší návštěvnosti. See our privacy policy.