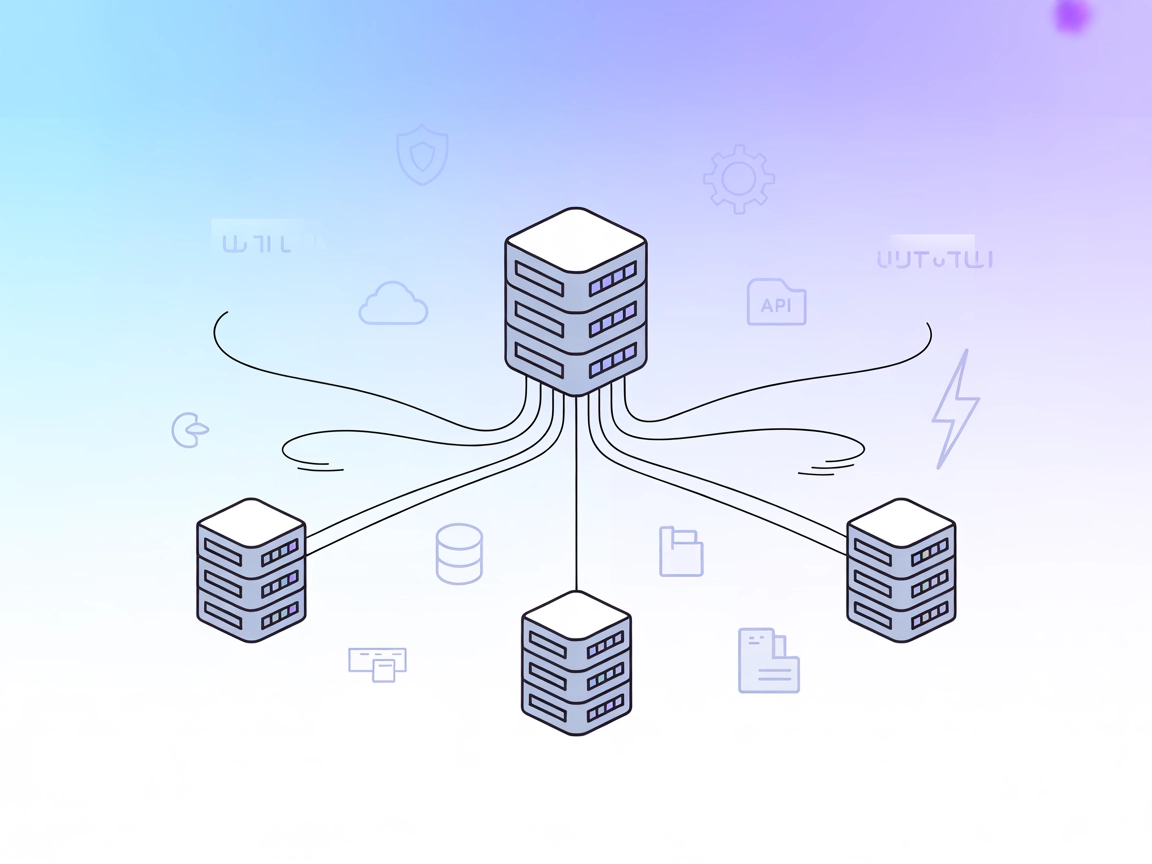

MCP Proxy Server

MCP Proxy Server samler flere MCP-ressourceservere i én HTTP-server, hvilket forenkler forbindelser for AI-assistenter og udviklere. Den muliggør samlet adgang ...

Forbind AI-assistenter til værktøjer og systemer på tværs af forskellige MCP transportprotokoller ved hjælp af mcp-proxy MCP Server til FlowHunt.

FlowHunt giver et ekstra sikkerhedslag mellem dine interne systemer og AI-værktøjer, hvilket giver dig granulær kontrol over hvilke værktøjer der er tilgængelige fra dine MCP-servere. MCP-servere hostet i vores infrastruktur kan problemfrit integreres med FlowHunts chatbot samt populære AI-platforme som ChatGPT, Claude og forskellige AI-editorer.

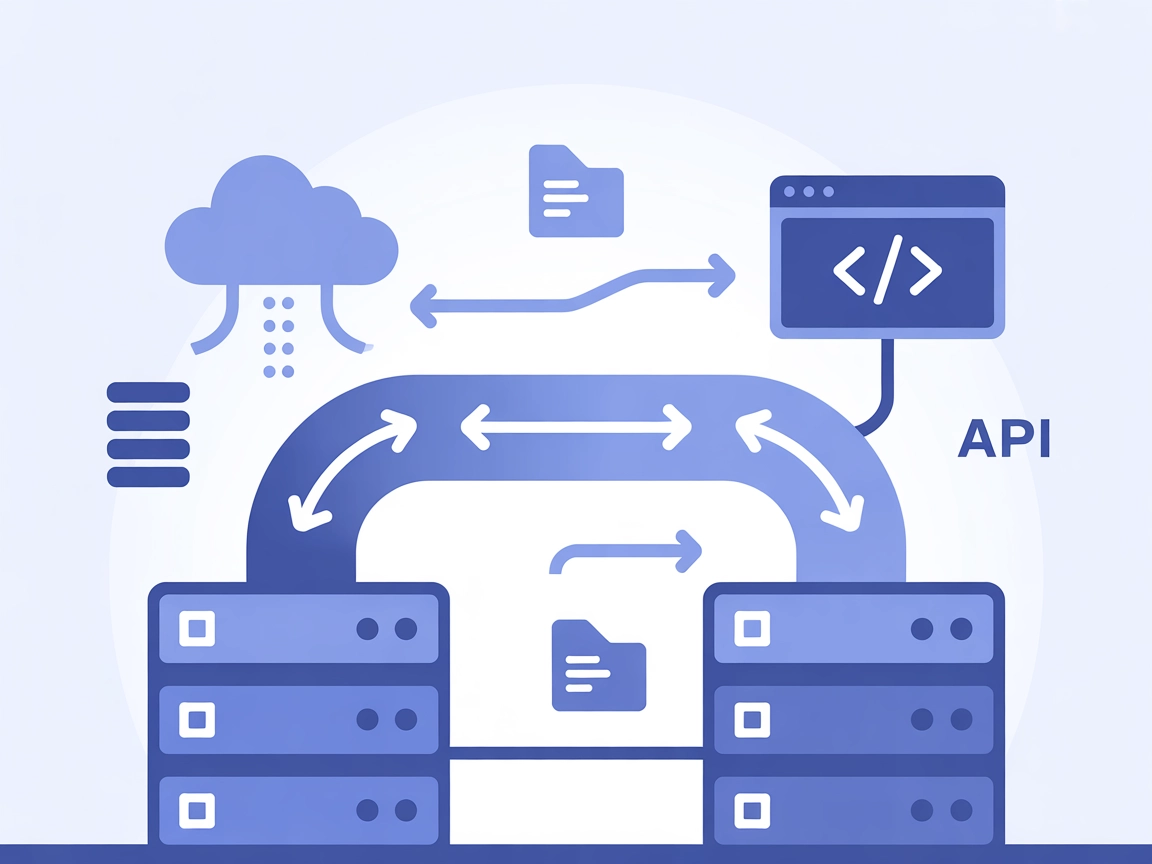

mcp-proxy MCP Server fungerer som en bro mellem Streamable HTTP og stdio MCP-transporter og muliggør problemfri kommunikation mellem AI-assistenter og forskellige typer Model Context Protocol (MCP) servere eller klienter. Dens kernefunktion er at oversætte mellem disse to udbredte transportprotokoller og gøre det muligt at tilgå værktøjer, ressourcer og arbejdsgange fra én protokol via den anden uden ændringer. Dette forbedrer udviklingsarbejdsgange ved at gøre det muligt for AI-assistenter at interagere med eksterne datakilder, API’er eller tjenester, der bruger forskellige transportmekanismer, og muliggør dermed opgaver som databaseforespørgsler, filhåndtering eller API-interaktioner på tværs af forskellige systemer.

Ingen prompt-skabeloner er nævnt i repoet.

Ingen eksplicitte MCP-ressourcer er beskrevet i repoets dokumentation eller kode.

Ingen værktøjer er defineret i repoets dokumentation eller synlig kode (f.eks. ingen eksplicitte funktioner, værktøjer eller server.py med værktøjsdefinitioner til stede).

mcp-proxy-repoet, eller installer via PyPI, hvis tilgængelig.{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": []

}

}

}

Sikring af API-nøgler

Du kan sikre miljøvariabler (f.eks. API-nøgler) ved at bruge env i din konfiguration:

{

"mcpServers": {

"mcp-proxy": {

"command": "mcp-proxy",

"args": [],

"env": {

"API_KEY": "${API_KEY}"

},

"inputs": {

"api_key": "${API_KEY}"

}

}

}

}

Brug af MCP i FlowHunt

For at integrere MCP-servere i din FlowHunt-arbejdsgang skal du starte med at tilføje MCP-komponenten til dit flow og forbinde den til din AI-agent:

Klik på MCP-komponenten for at åbne konfigurationspanelet. I systemets MCP-konfigurationssektion indsæt dine MCP-serveroplysninger med dette JSON-format:

{

"mcp-proxy": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Når det er konfigureret, kan AI-agenten nu bruge denne MCP som et værktøj med adgang til alle dens funktioner og muligheder. Husk at ændre “mcp-proxy” til det faktiske navn på din MCP-server og erstatte URL’en med din egen MCP-server-URL.

| Sektion | Tilgængelighed | Detaljer/Noter |

|---|---|---|

| Overblik | ✅ | |

| Liste over Prompts | ⛔ | Ingen fundet |

| Liste over Ressourcer | ⛔ | Ingen fundet |

| Liste over Værktøjer | ⛔ | Ingen eksplicitte værktøjer defineret |

| Sikring af API-nøgler | ✅ | Via env i konfiguration |

| Sampling Support (mindre vigtigt i vurderingen) | ⛔ | Ingen nævnelse |

| Roots Support | ⛔ | Ingen nævnelse |

Baseret på ovenstående er mcp-proxy højt specialiseret til protokoloversættelse, men tilbyder ikke værktøjer, prompts eller ressourcer ud af boksen. Dens værdi ligger i integration og konnektivitet, ikke i at levere direkte LLM-funktioner.

mcp-proxy er et kritisk værktøj til at bygge bro mellem MCP-transportprotokoller, hvilket gør det særdeles værdifuldt i miljøer, hvor protokol-mismatch begrænser AI/LLM-værktøjers interoperabilitet. Dog tilbyder det ikke direkte LLM-forbedringer som ressourcer, prompts eller værktøjer. Til det tilsigtede formål er det et robust og velunderstøttet projekt. Bedømmelse: 6/10 for generel MCP-nytte, 9/10 hvis du specifikt har brug for protokolbro.

| Har en LICENSE | ✅ (MIT) |

|---|---|

| Har mindst ét værktøj | ⛔ |

| Antal Forks | 128 |

| Antal Stars | 1.1k |

mcp-proxy MCP Server forbinder Streamable HTTP og stdio MCP transports og muliggør problemfri kommunikation mellem AI-assistenter og forskellige MCP-servere eller klienter. Dette gør det muligt for arbejdsgange og værktøjer, der er bygget til forskellige protokoller, at fungere sammen uden ændringer.

mcp-proxy er ideel til protokolbro mellem forskellige MCP-transporter, integration af ældre systemer med moderne AI-platforme, forbedring af AI-arbejdsgange og understøttelse af udvikling og test på tværs af platforme.

Nej, mcp-proxy fokuserer udelukkende på protokoloversættelse og tilbyder ikke indbyggede værktøjer, prompt-skabeloner eller ressourcer. Dens værdi ligger i at muliggøre interoperabilitet og integration.

Du kan bruge miljøvariabler i din MCP-serverkonfiguration til at sikre API-nøgler. Brug f.eks. et 'env'-blok og henvis til variablerne i din konfigurations-JSON.

Tilføj MCP-komponenten til dit FlowHunt-flow, og konfigurer derefter mcp-proxy MCP-serveren i systemets MCP-konfiguration ved at bruge det relevante JSON-udsnit. Dette gør det muligt for din AI-agent at få adgang til alle funktioner, der stilles til rådighed via de forbundne MCP-protokoller.

Bro dine AI-arbejdsgange og opnå problemfri protokolinteroperabilitet med mcp-proxy. Integrer ældre systemer og udvid din AI's rækkevidde med det samme.

MCP Proxy Server samler flere MCP-ressourceservere i én HTTP-server, hvilket forenkler forbindelser for AI-assistenter og udviklere. Den muliggør samlet adgang ...

ModelContextProtocol (MCP) Server fungerer som et bindeled mellem AI-agenter og eksterne datakilder, API’er og tjenester, så FlowHunt-brugere kan bygge kontekst...

lingo.dev MCP Server forbinder AI-assistenter med eksterne datakilder, API'er og tjenester, hvilket muliggør struktureret ressourceadgang, promptskabeloner og v...

Cookie Samtykke

Vi bruger cookies til at forbedre din browsingoplevelse og analysere vores trafik. See our privacy policy.