Absatzgenerator für verwandte Artikel

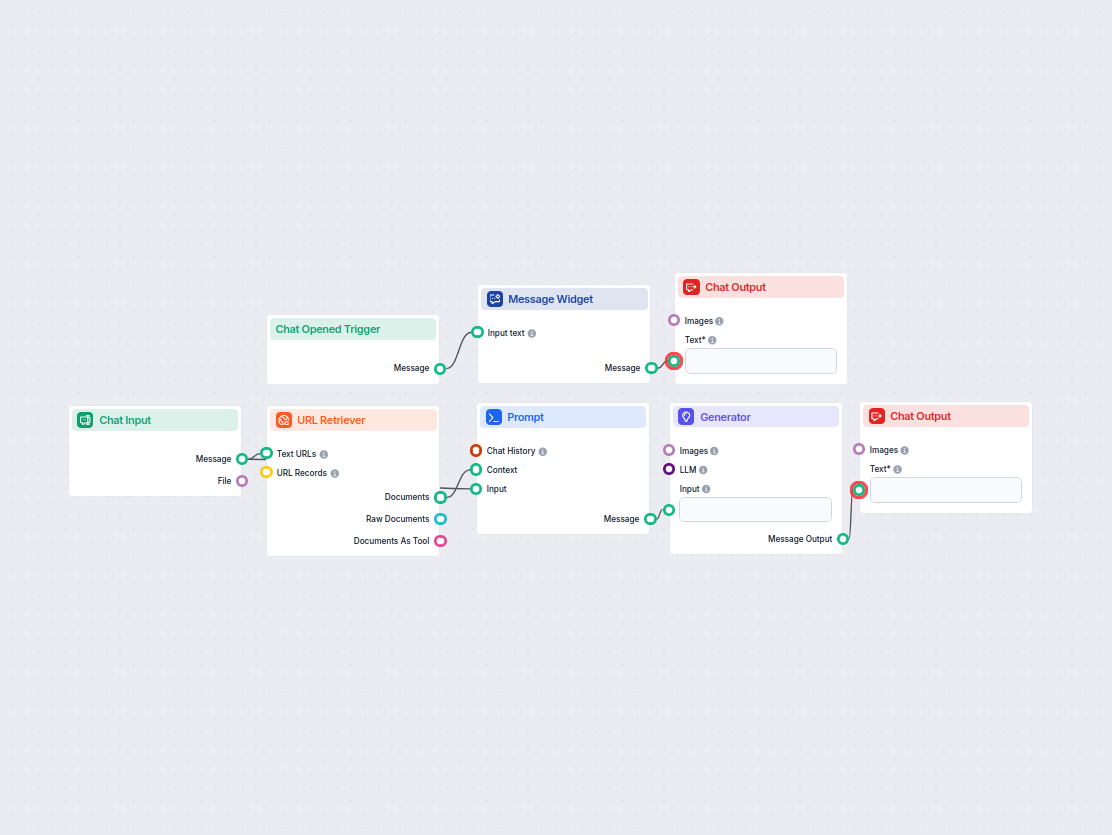

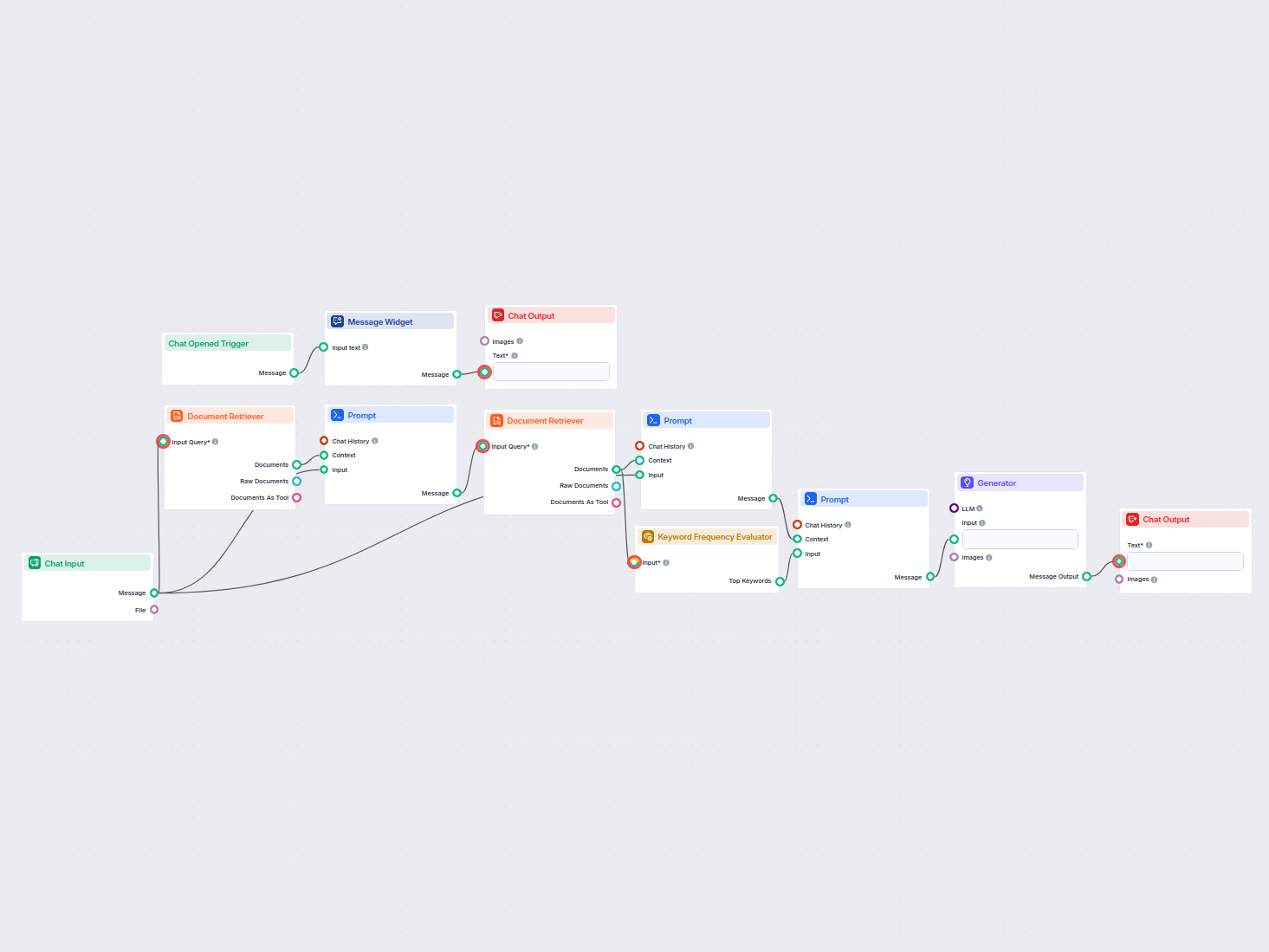

Erzeugt automatisch einen kurzen, ansprechenden Absatz für Ihre Website, der Links zu den relevantesten verwandten Artikeln enthält. Dieser KI-gestützte Workflo...

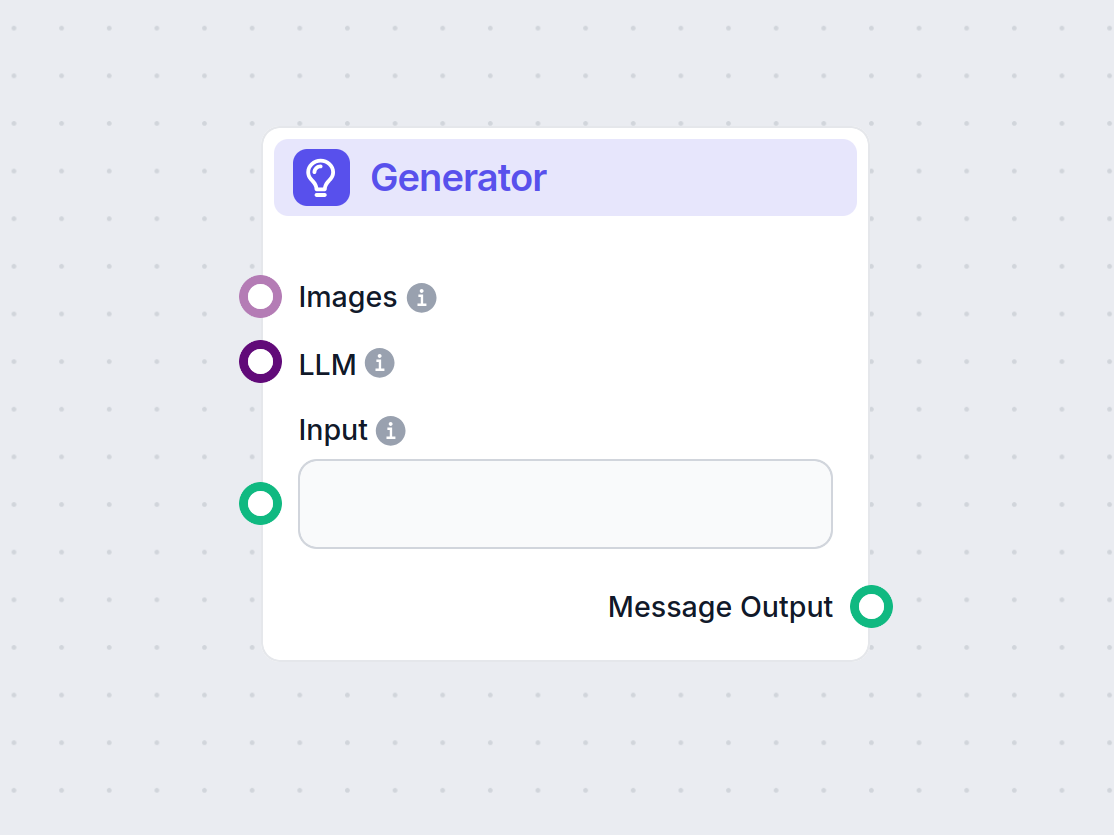

Die Generator-Komponente verwendet ein ausgewähltes LLM-Modell, um Text auf Basis von Prompts, optionalen Systemnachrichten und Bildern zu generieren – ideal für dynamische Chatbot-Antworten.

Komponentenbeschreibung

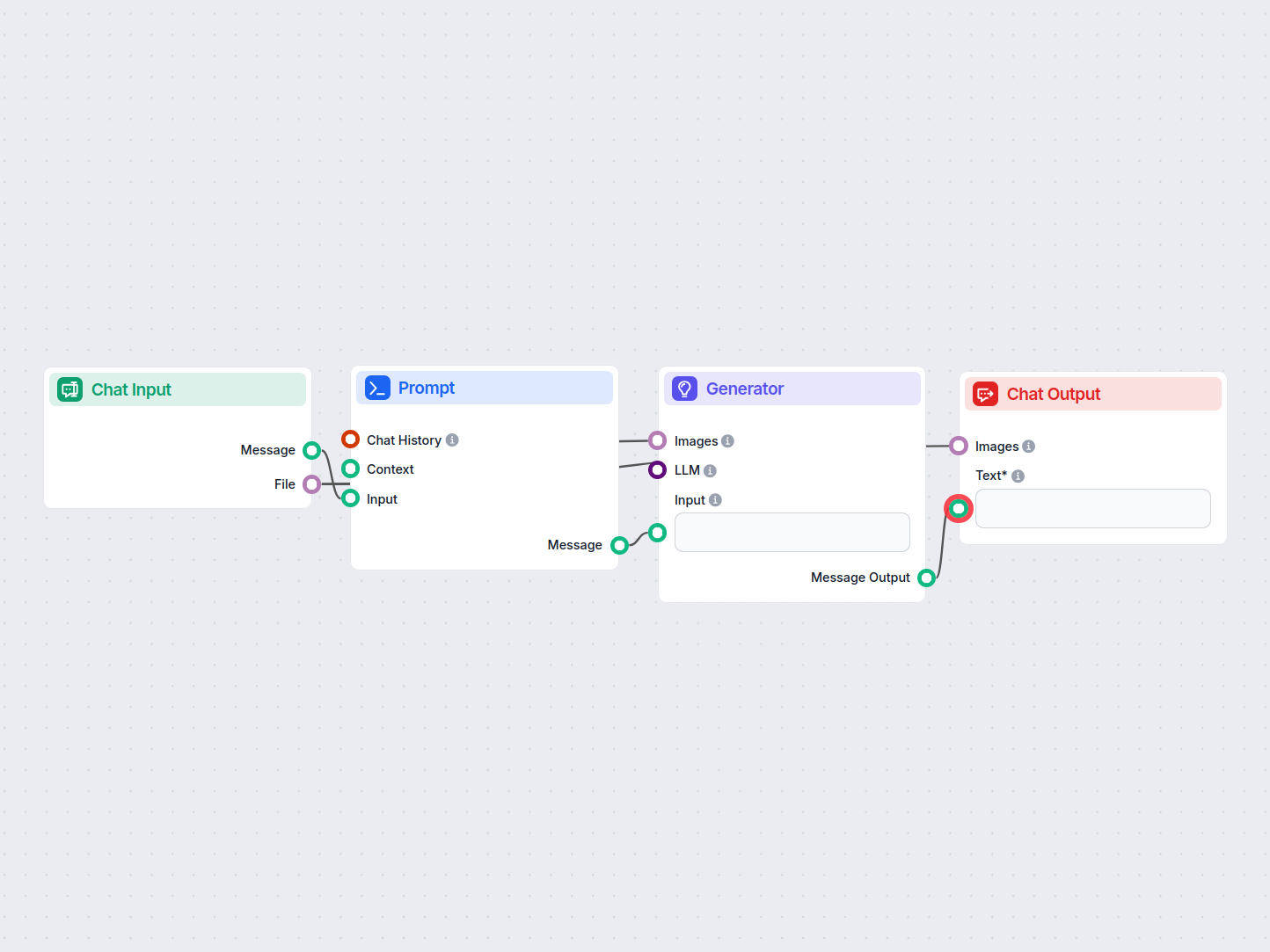

The Generator component is designed to create text responses using a user-provided prompt and a selected Large Language Model (LLM). It is a central part of AI workflows where natural language generation or augmentation is required.

This component takes an input prompt (text) and optionally images or a system message, then sends these inputs to a chosen LLM to generate a relevant text-based output. It is versatile and can be used for automating content creation, generating conversational replies, or enriching data with AI-generated language.

The Generator component accepts the following inputs:

| Input Name | Type | Description | Required | Advanced |

|---|---|---|---|---|

| Input | Message (text) | The main prompt or message to send to the LLM. | No | No |

| LLM | Model (BaseChatModel) | The language model used for text generation. | No | No |

| Images | FlowSessionAttachmentResponse | Optional images to include as context for the model. | No | No |

| System Message | String (multiline text) | An optional system-level instruction for the model (advanced). | No | Yes |

The Generator component produces:

| Output Name | Type | Description |

|---|---|---|

| Message Output | Message | The generated text from the LLM |

The output is a text-based message, ready for use in subsequent workflow steps, UI display, or further processing.

| Feature | Supported? |

|---|---|

| Text input | Yes |

| Image input | Optional |

| LLM selection | Yes |

| System instructions | Optional |

| Text output | Yes |

The Generator component is a foundational building block for workflows that require dynamic, AI-generated text, offering flexibility and configurability for a wide range of applications.

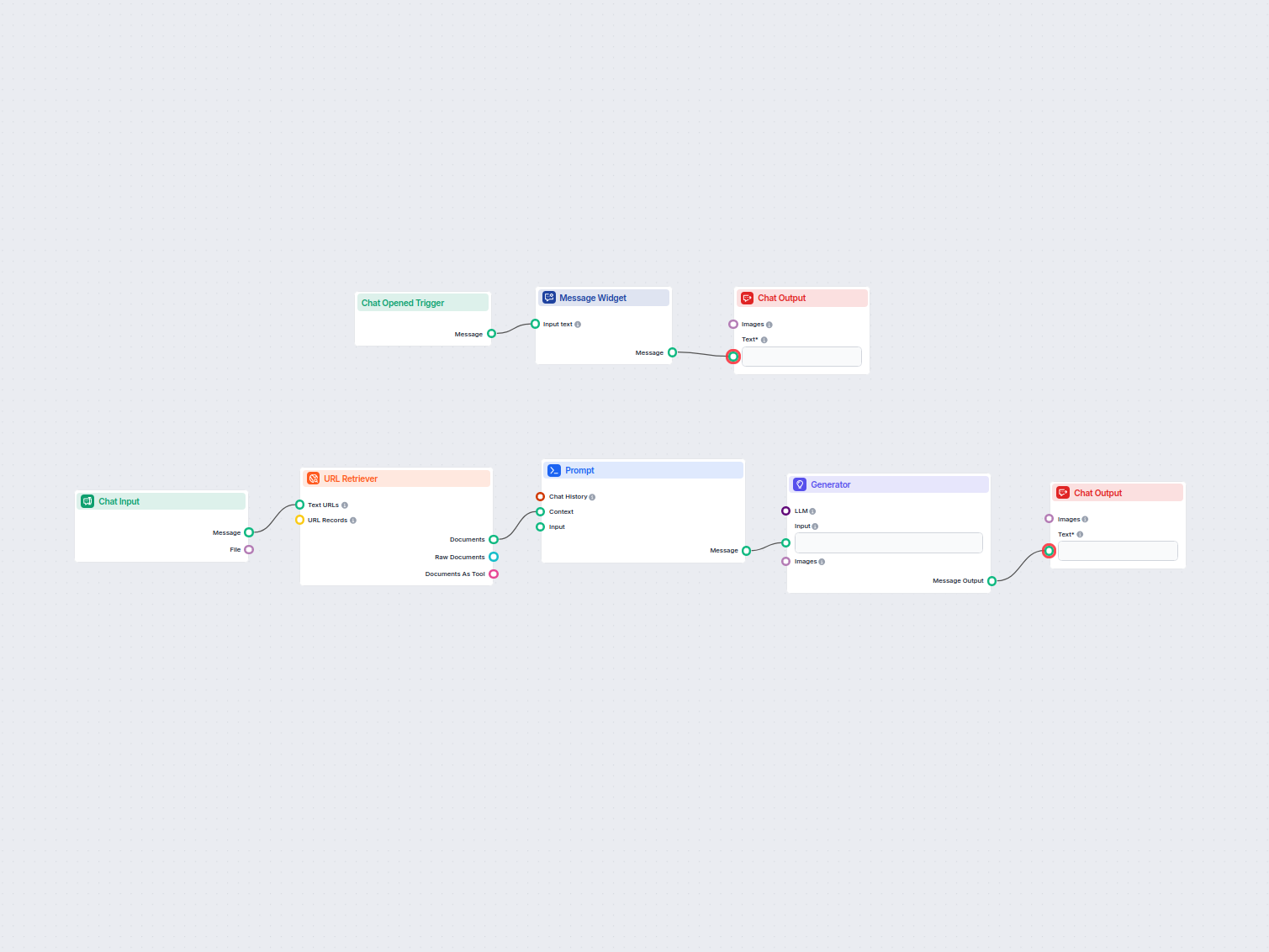

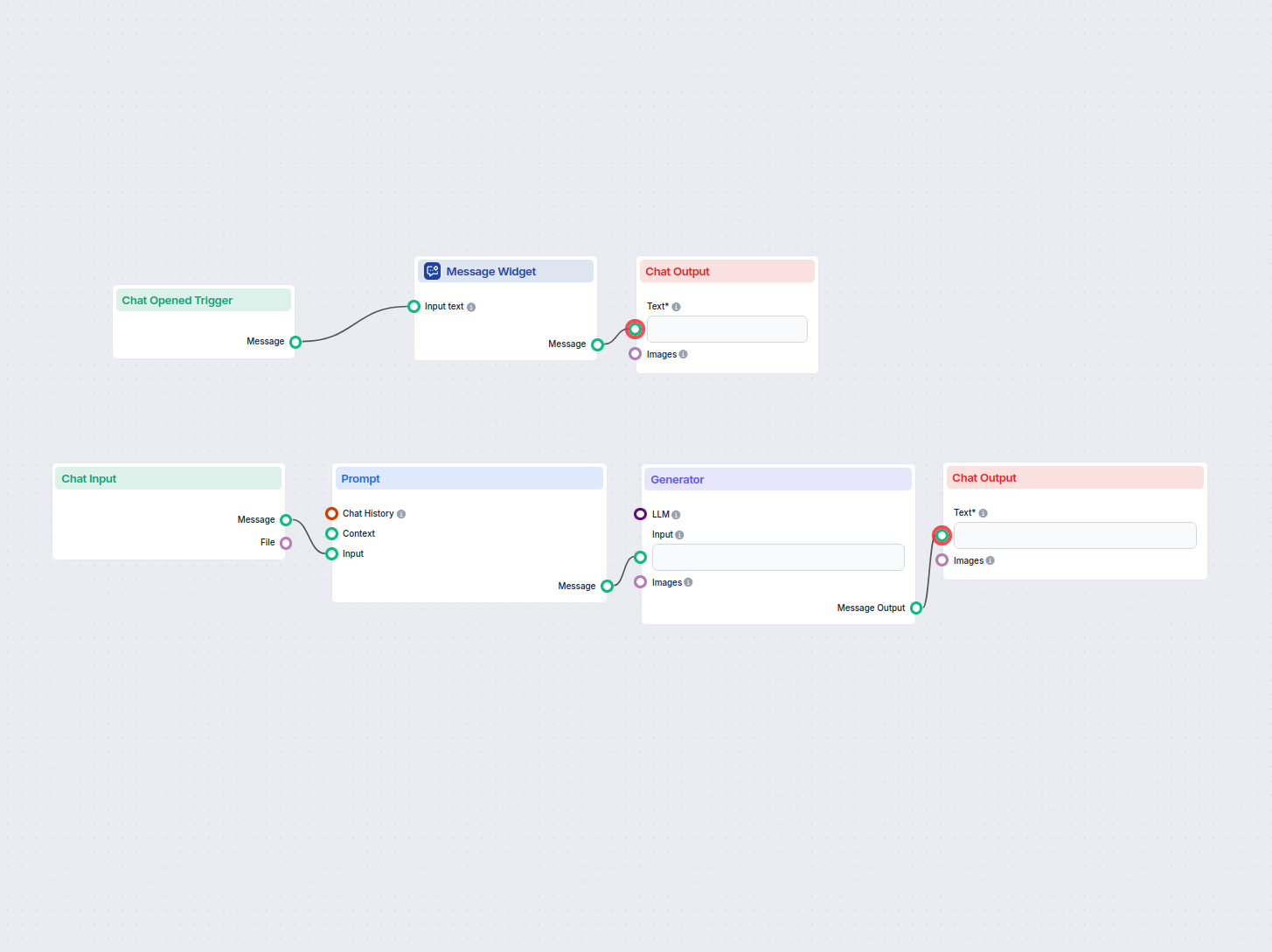

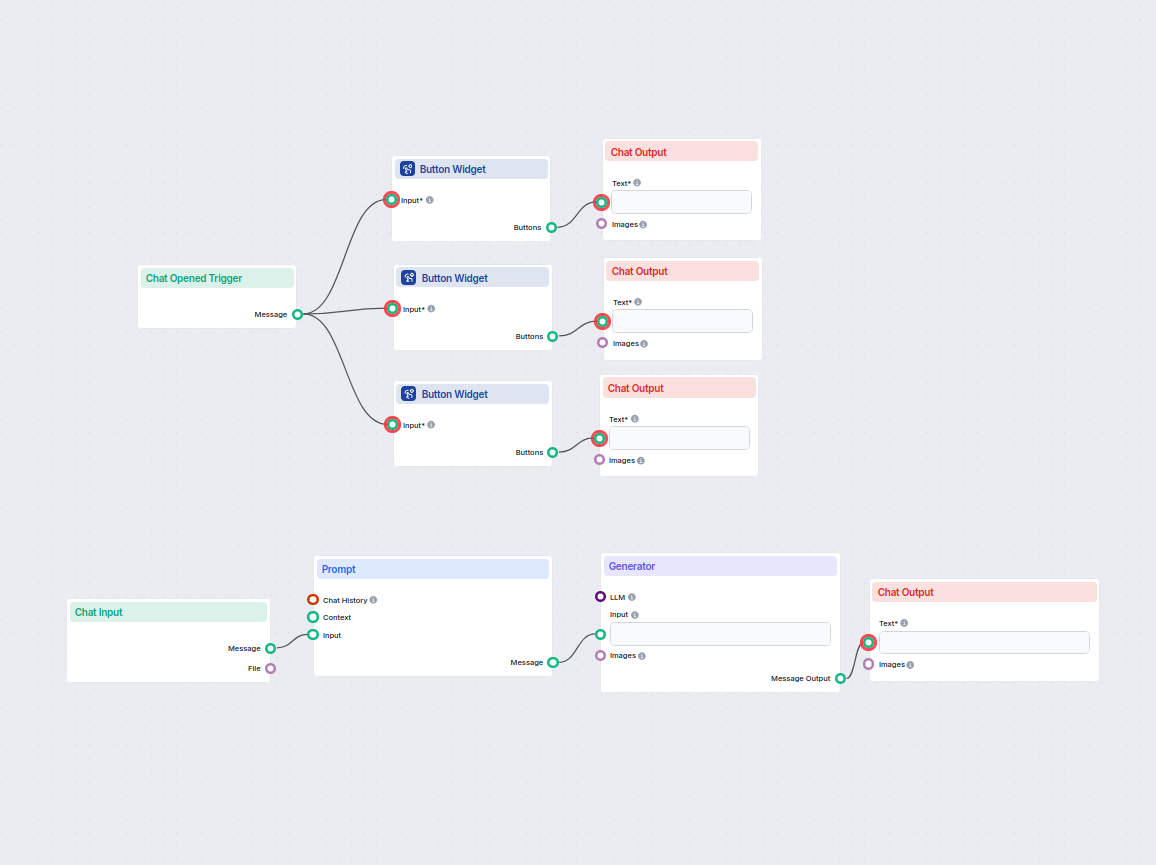

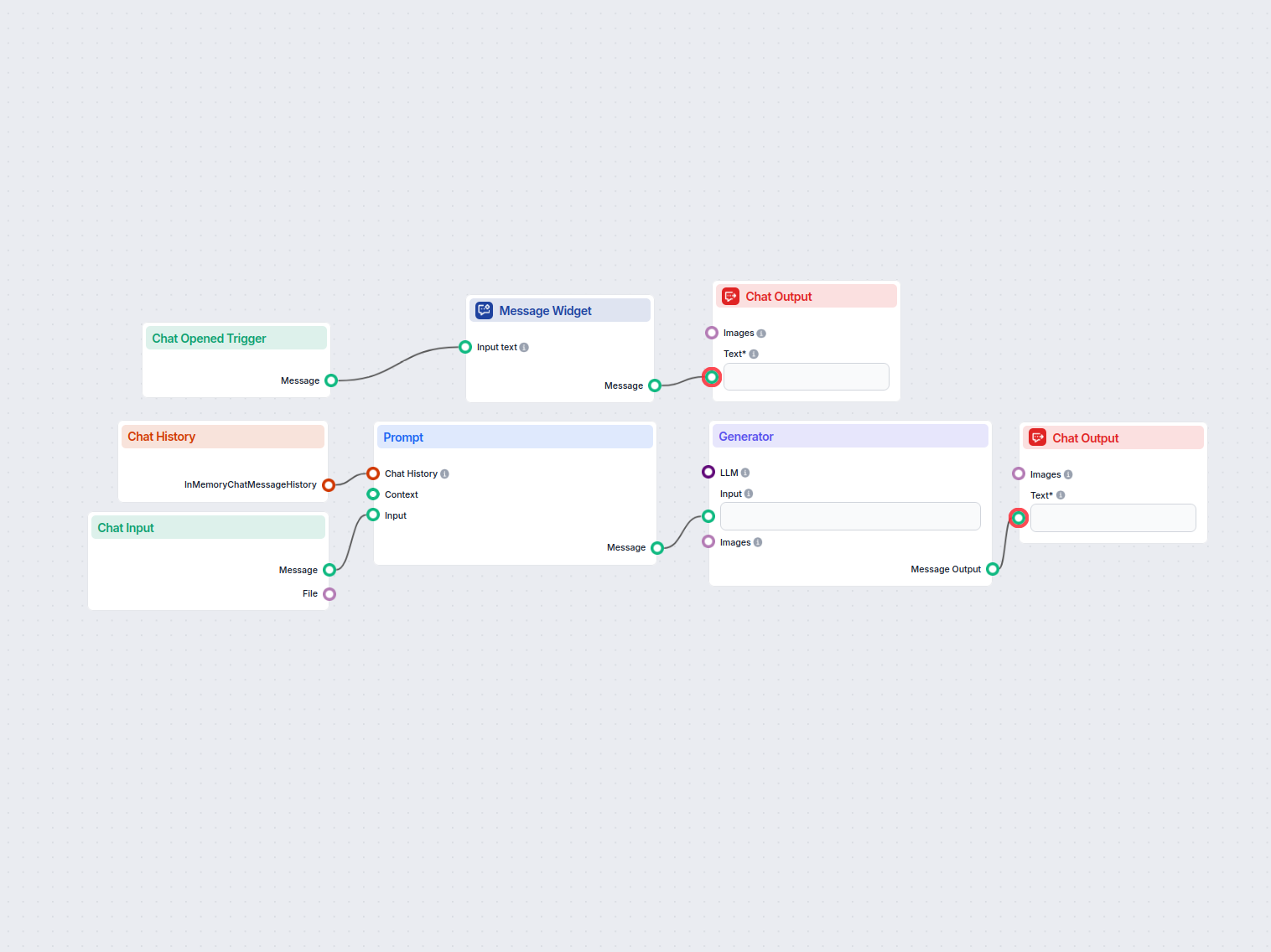

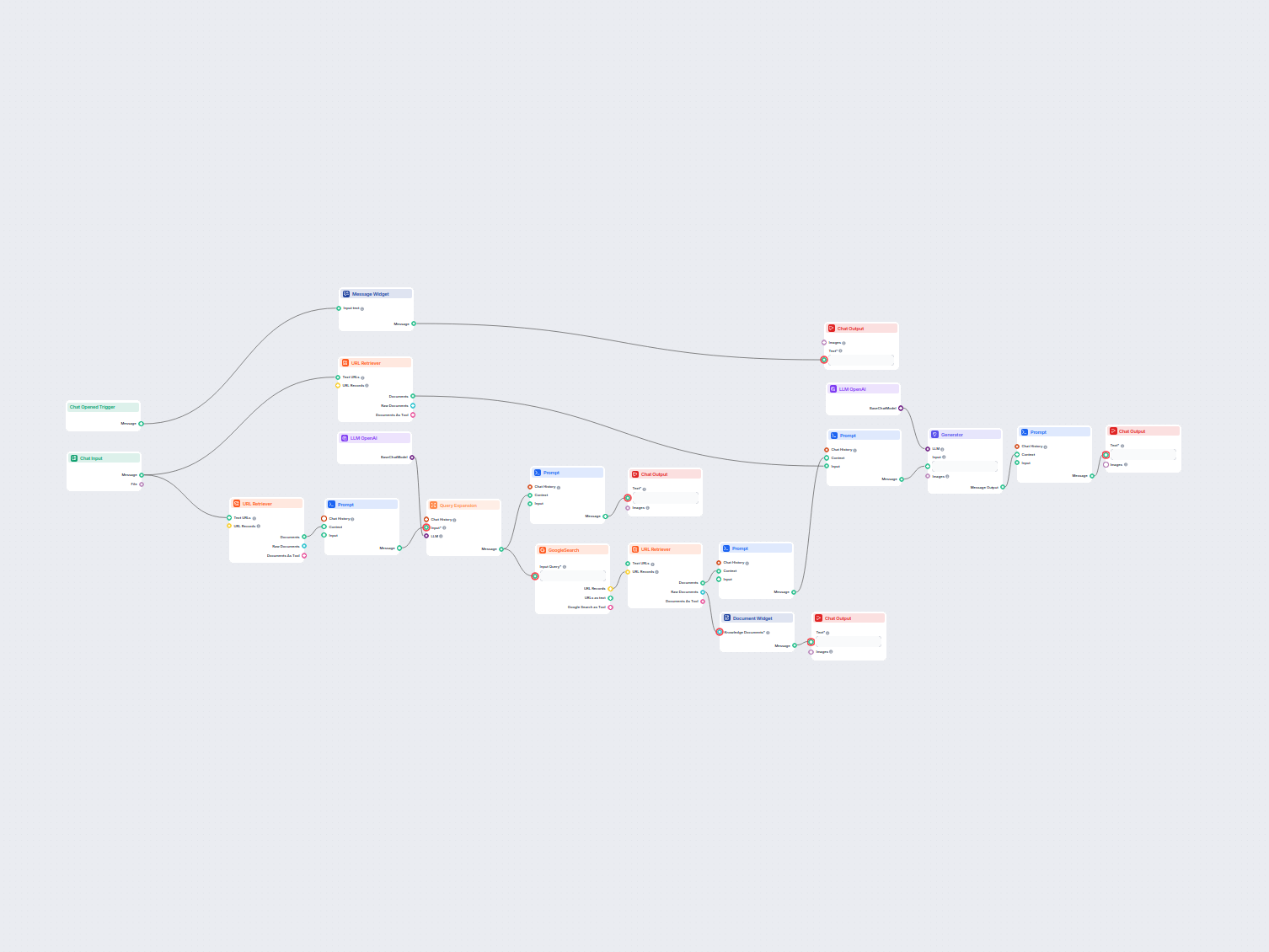

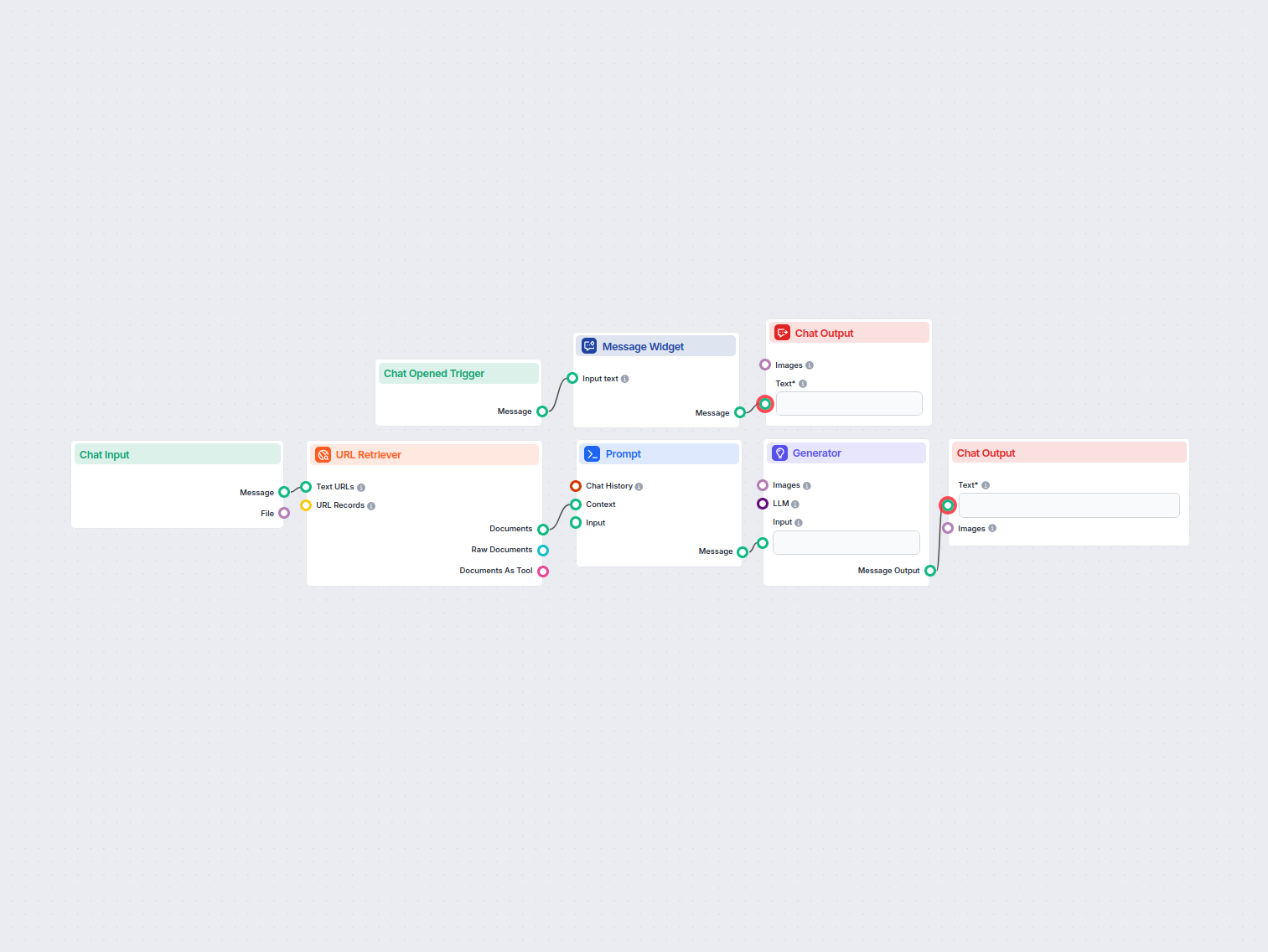

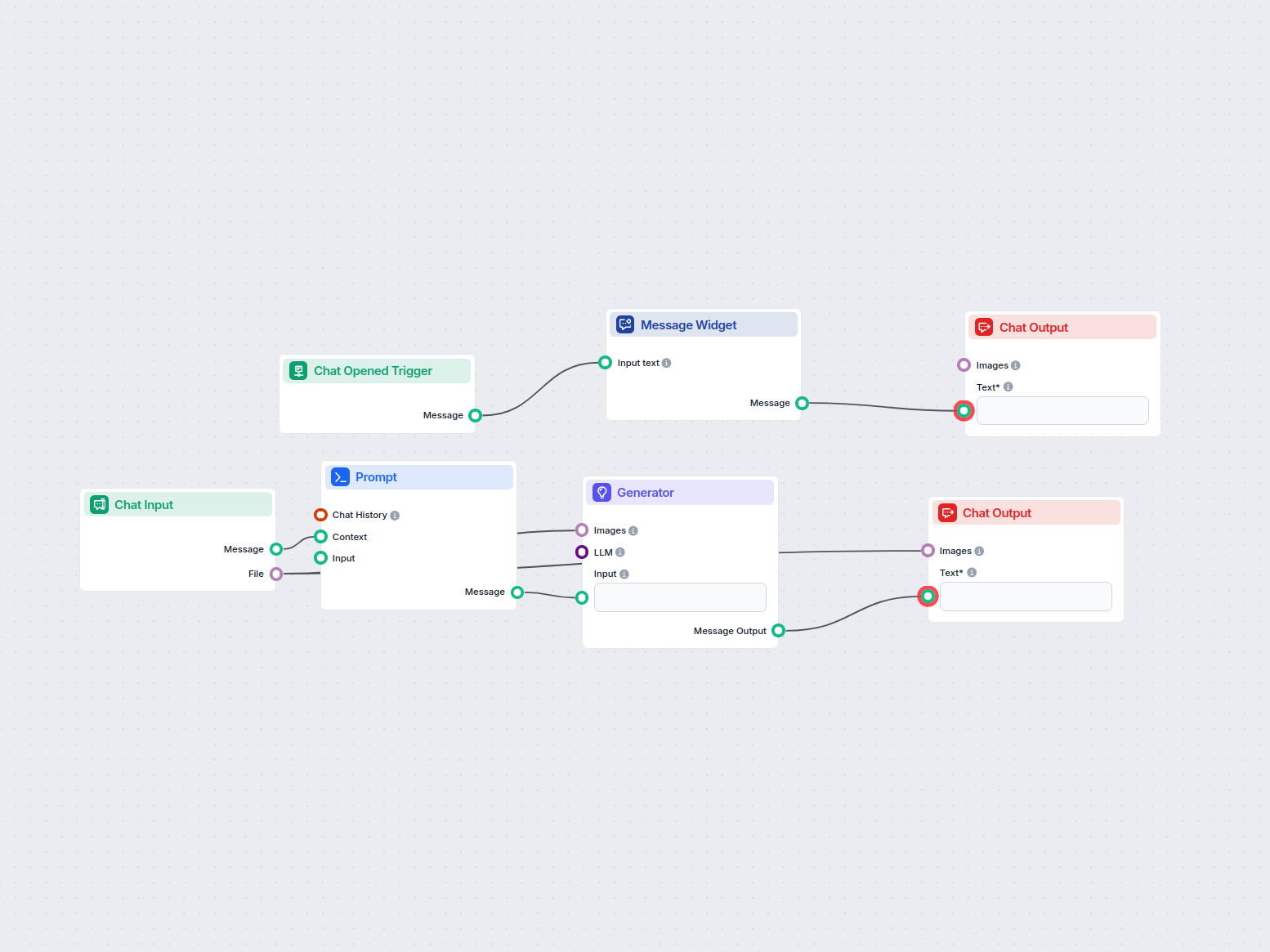

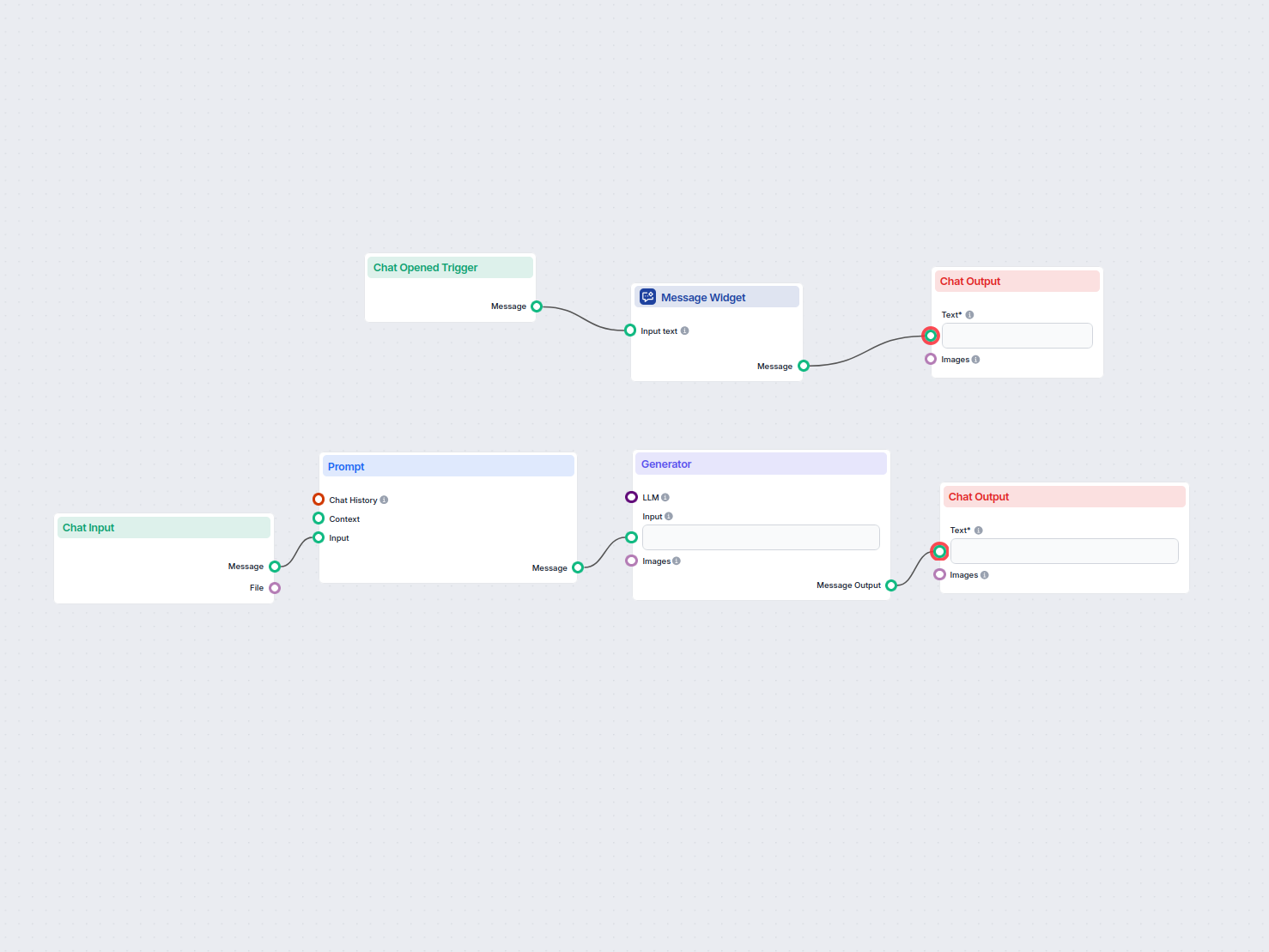

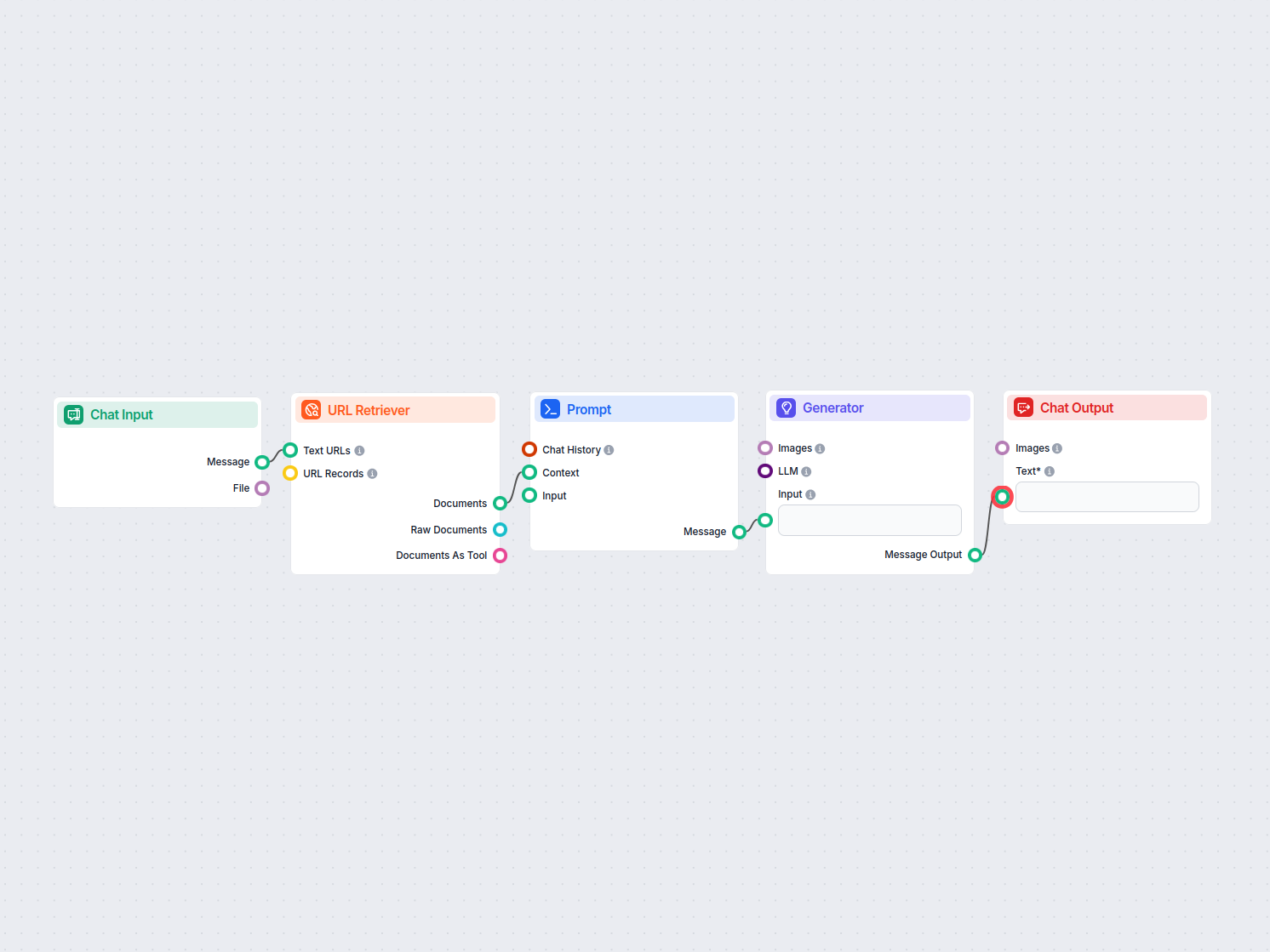

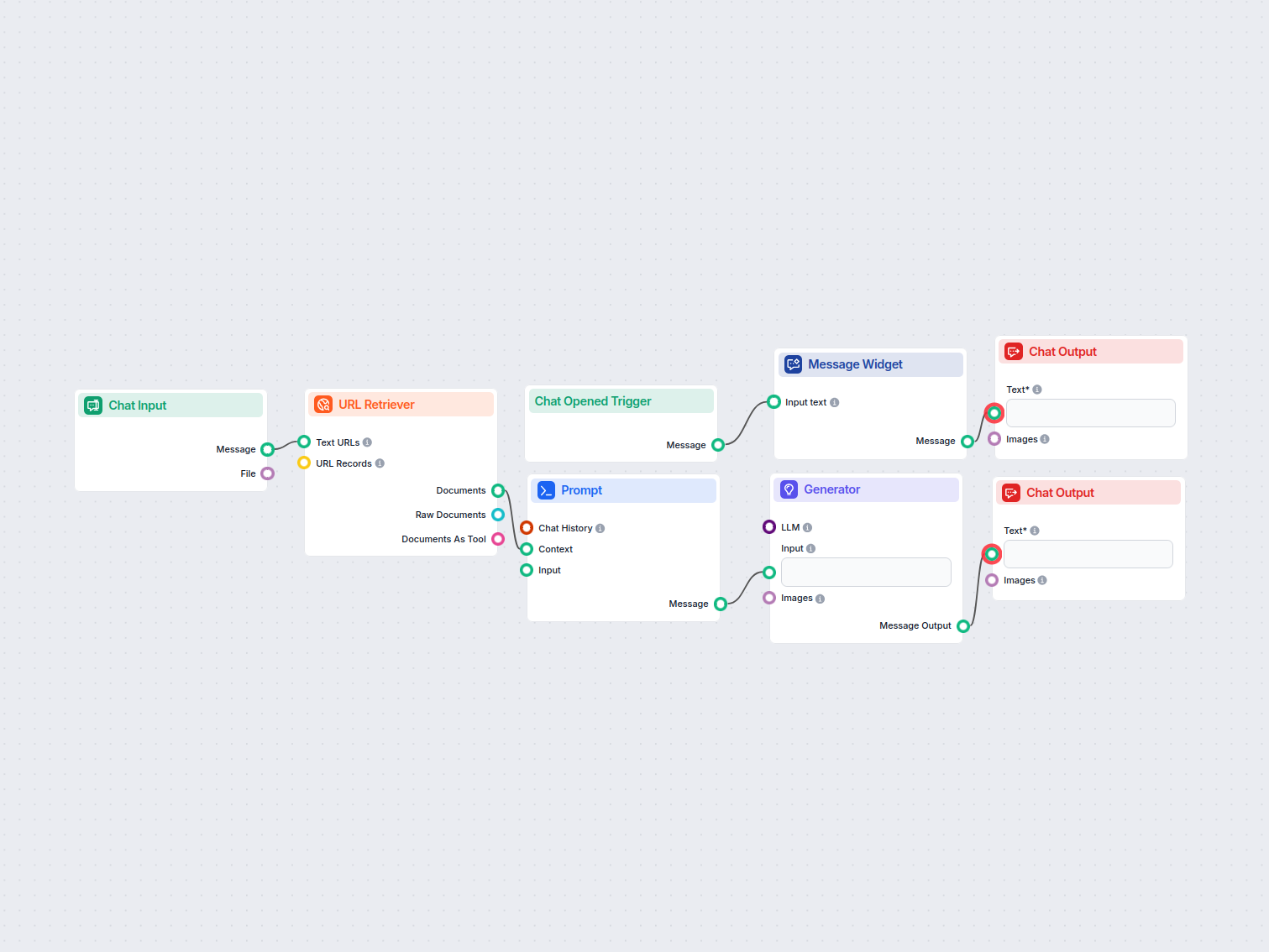

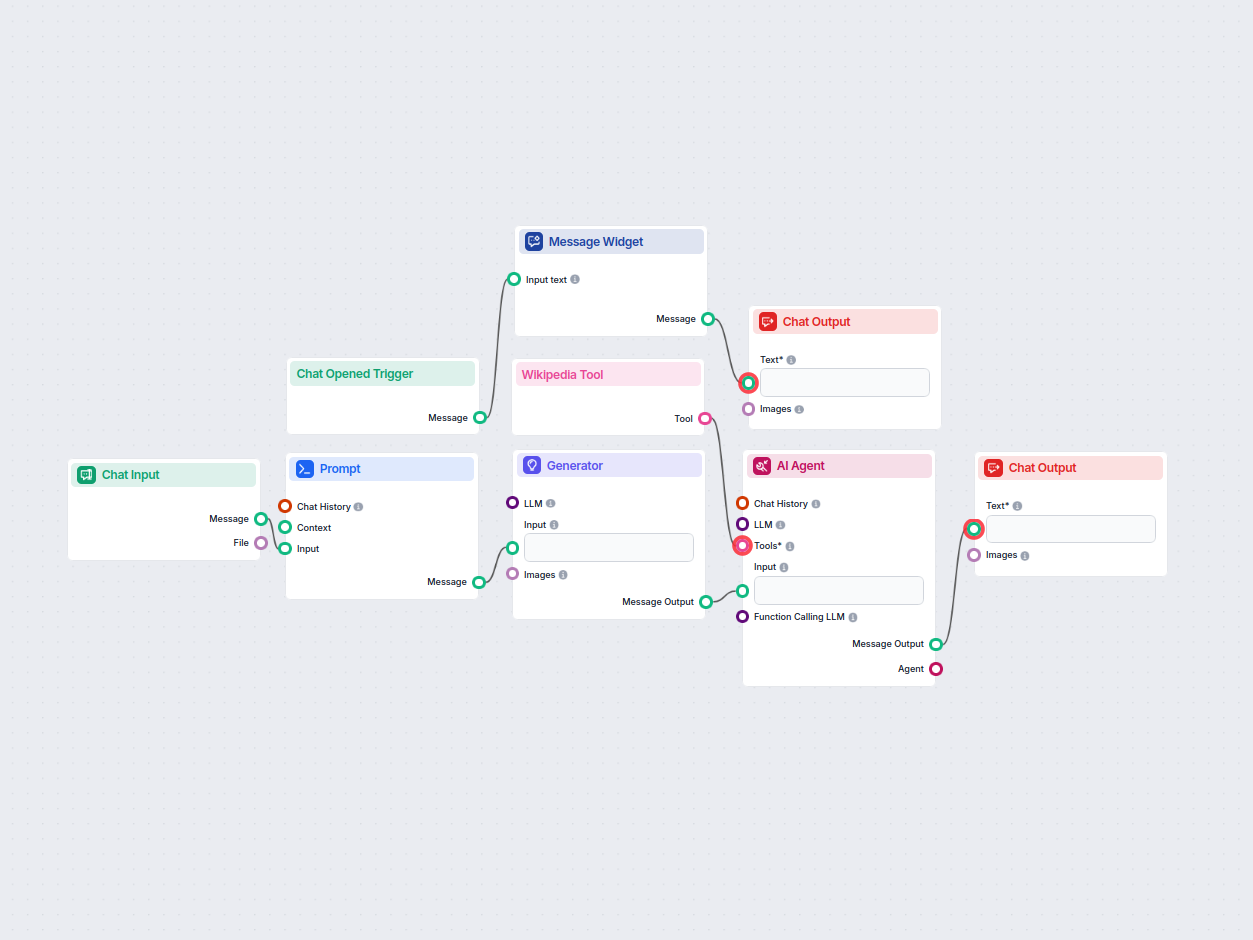

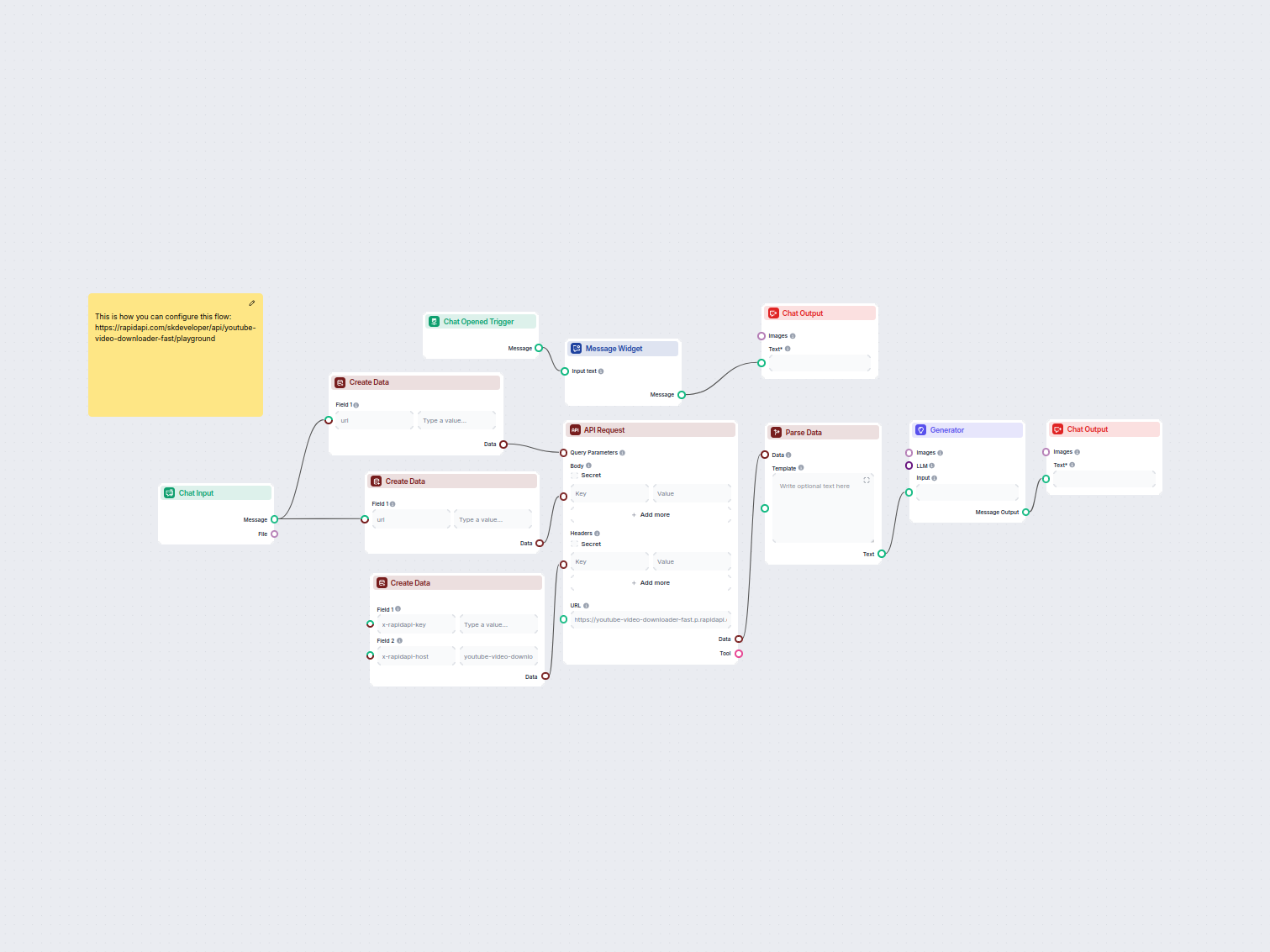

Um Ihnen den schnellen Einstieg zu erleichtern, haben wir mehrere Beispiel-Flow-Vorlagen vorbereitet, die zeigen, wie die Generator-Komponente effektiv genutzt wird. Diese Vorlagen präsentieren verschiedene Anwendungsfälle und Best Practices und erleichtern Ihnen das Verständnis und die Implementierung der Komponente in Ihren eigenen Projekten.

Erzeugt automatisch einen kurzen, ansprechenden Absatz für Ihre Website, der Links zu den relevantesten verwandten Artikeln enthält. Dieser KI-gestützte Workflo...

Formulieren Sie mühelos jeden Text um, indem Wörter durch Synonyme ersetzt werden und die ursprüngliche Bedeutung erhalten bleibt. Perfekt für Marketer, Autoren...

Verwandeln Sie Ihre Meeting-Anhänge mit KI in umsetzbare Zusammenfassungen, Follow-up-E-Mails und Blogartikel. Dieser Workflow automatisiert die Inhaltserstellu...

Dieser KI-gestützte Workflow erstellt prägnante, hochwertige FAQ-Antworten für jede beliebige Frage, indem er das Web durchsucht, relevante Inhalte extrahiert u...

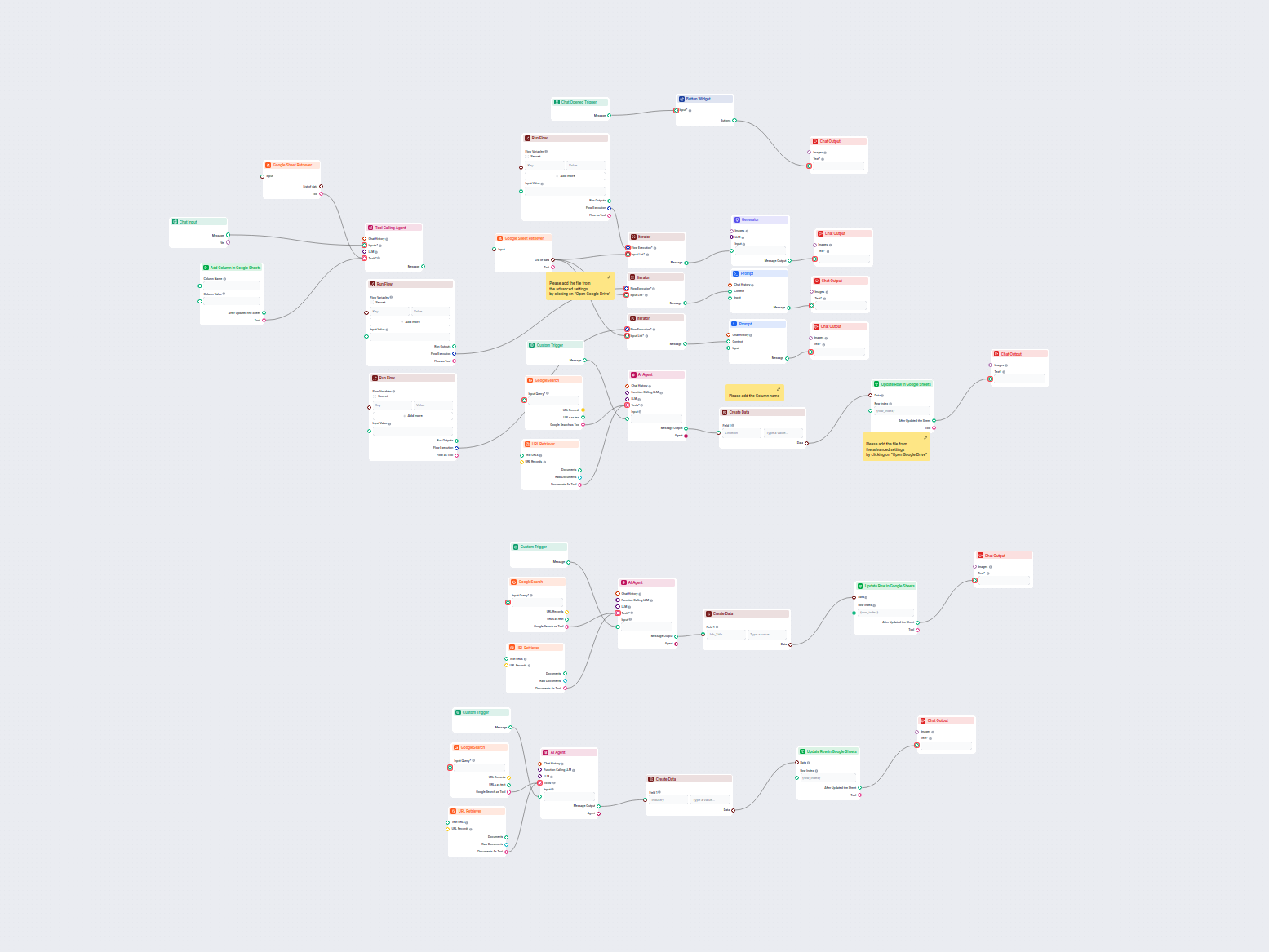

Dieser Workflow reichert automatisch Google Sheets-Kontaktdaten an, indem er LinkedIn-Profile findet, Jobtitel und Branchen extrahiert und das Sheet mithilfe vo...

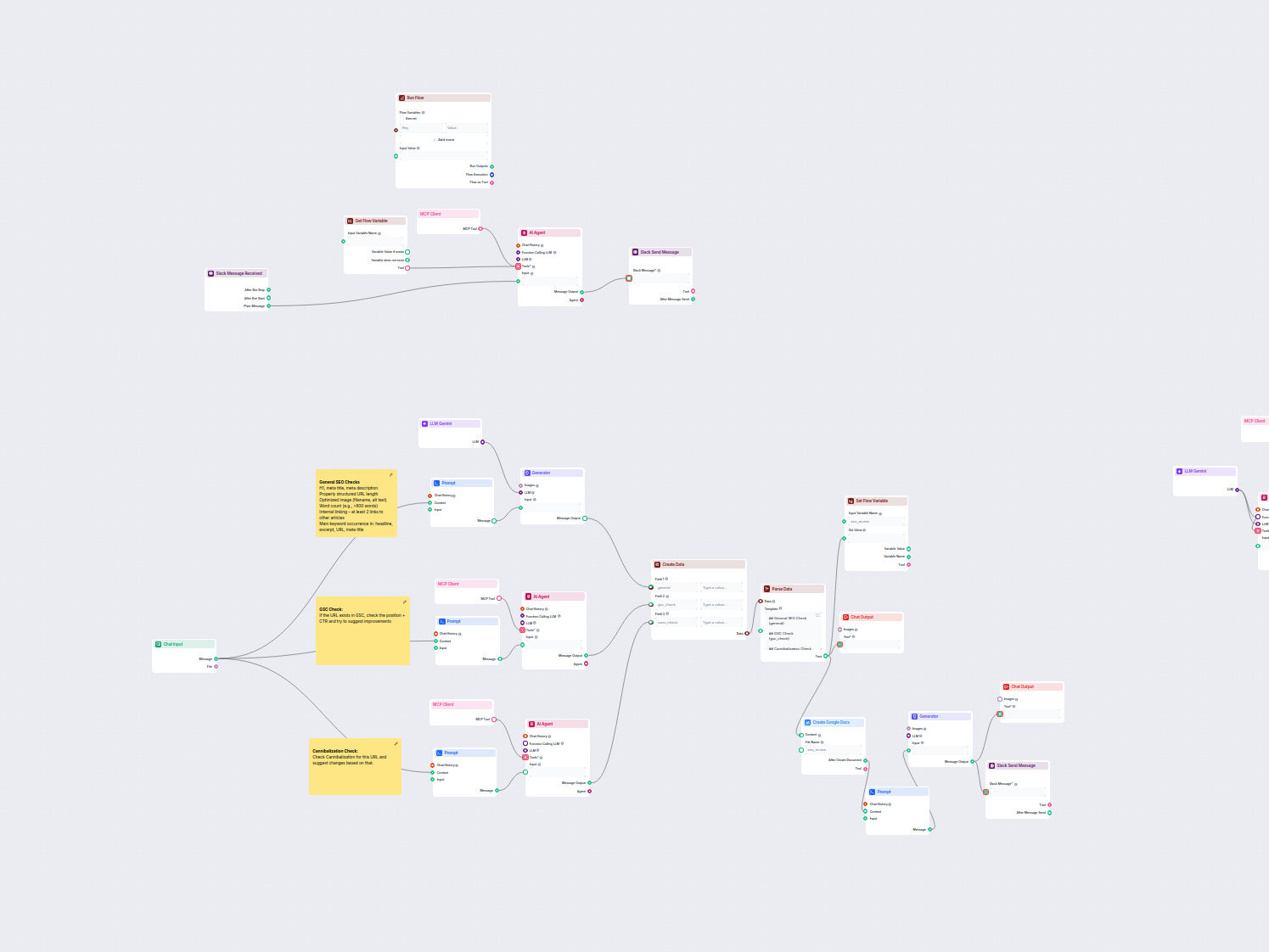

Dieser Workflow automatisiert die SEO-Prüfung und den Audit-Prozess für Webseiten. Er analysiert den Seiteninhalt hinsichtlich SEO-Best Practices, führt Prüfung...

Ein Chatbot, der es Nutzern ermöglicht, Bilder hochzuladen und Fragen zu deren Inhalt zu stellen. Mithilfe von OCR und visueller Erkennung analysiert er das Bil...

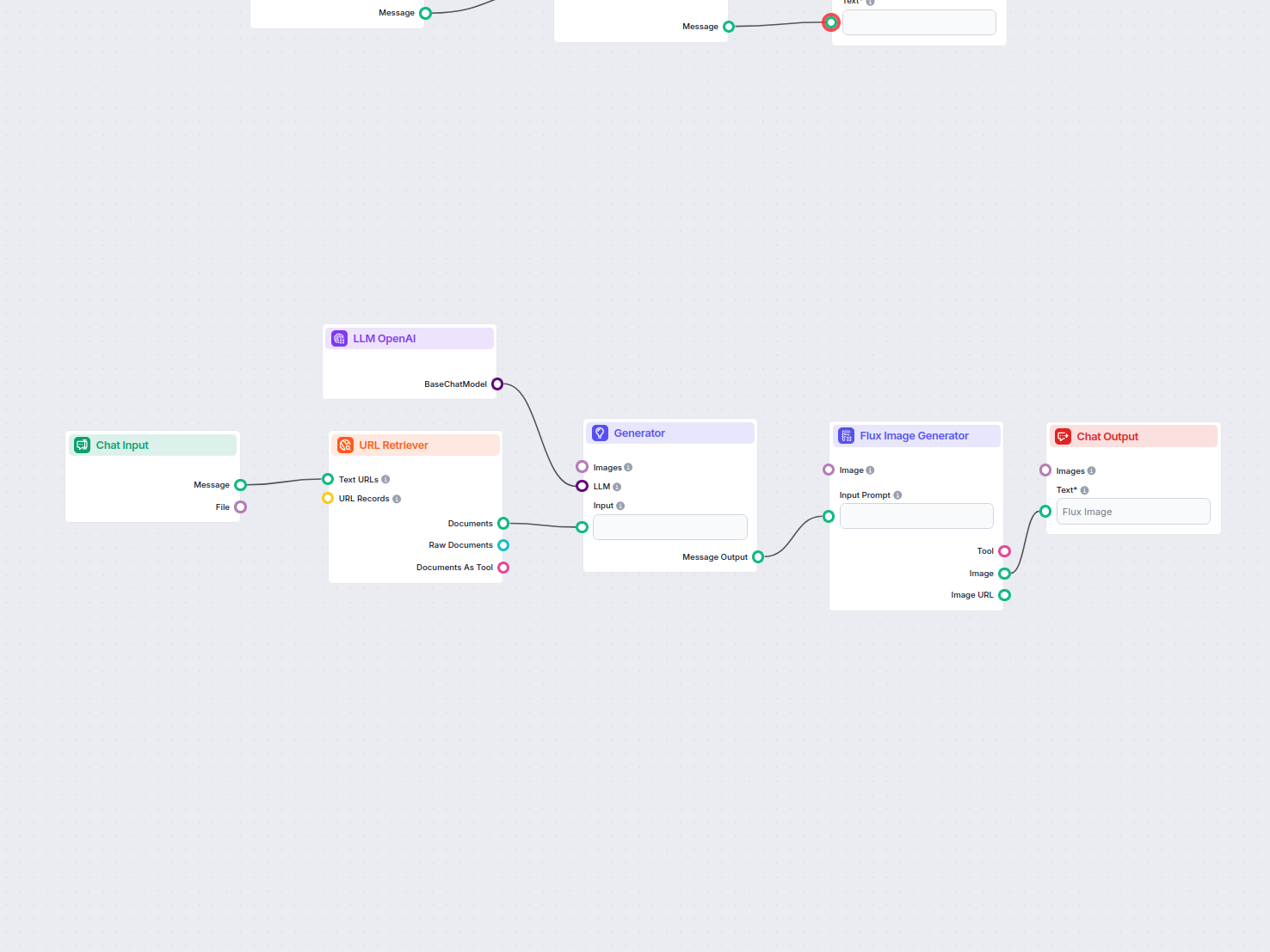

Erzeugt automatisch ein ansprechendes Feature-Bild für jeden Blogbeitrag, indem der Inhalt analysiert wird. Gib einfach die Blog-URL an, und der Workflow nutzt ...

Dieser Workflow ermittelt, ob eine E-Mail-Adresse von einem generischen, kostenlosen E-Mail-Anbieter oder von einer eigenen geschäftlichen Domain stammt. Er ist...

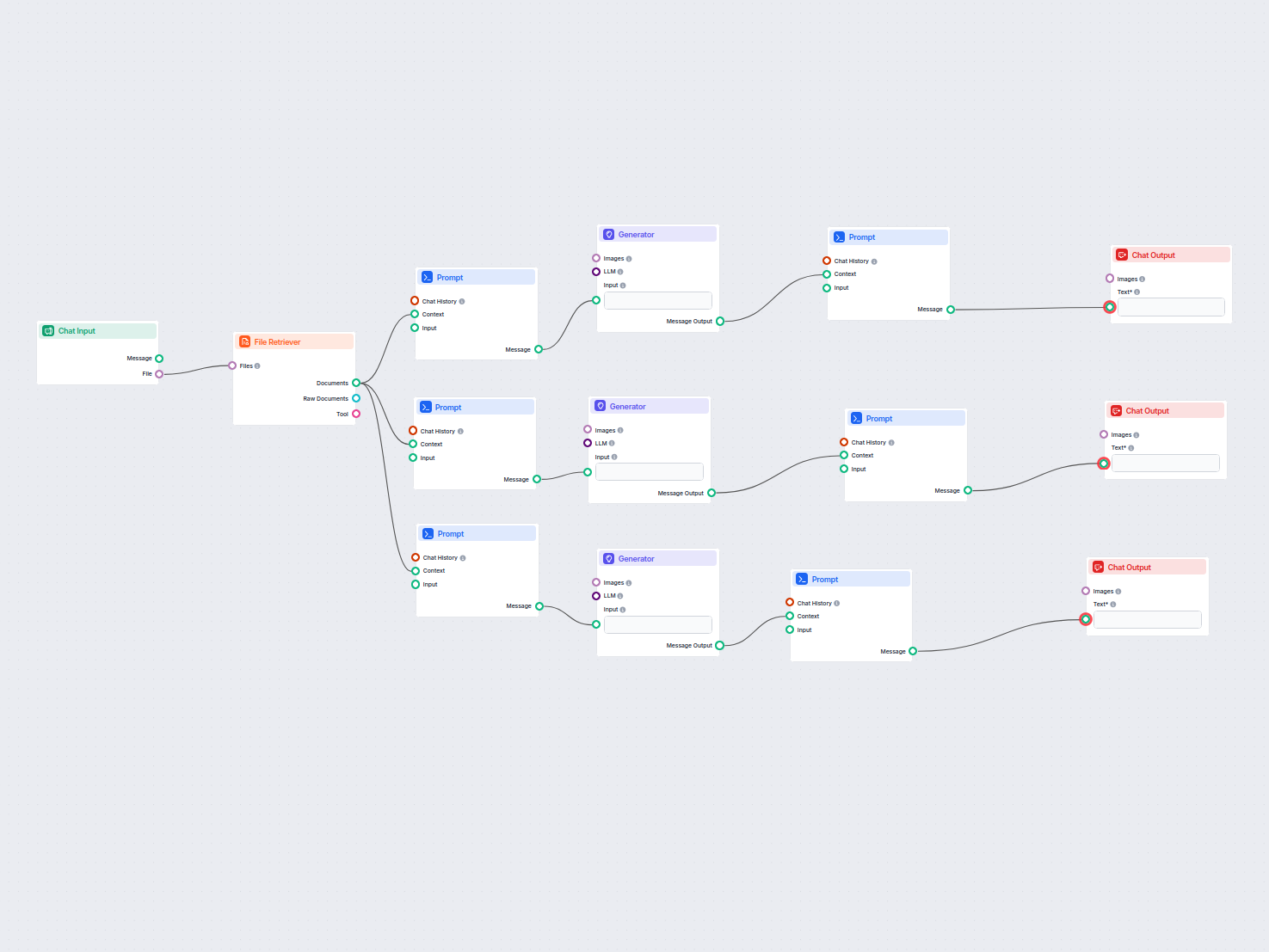

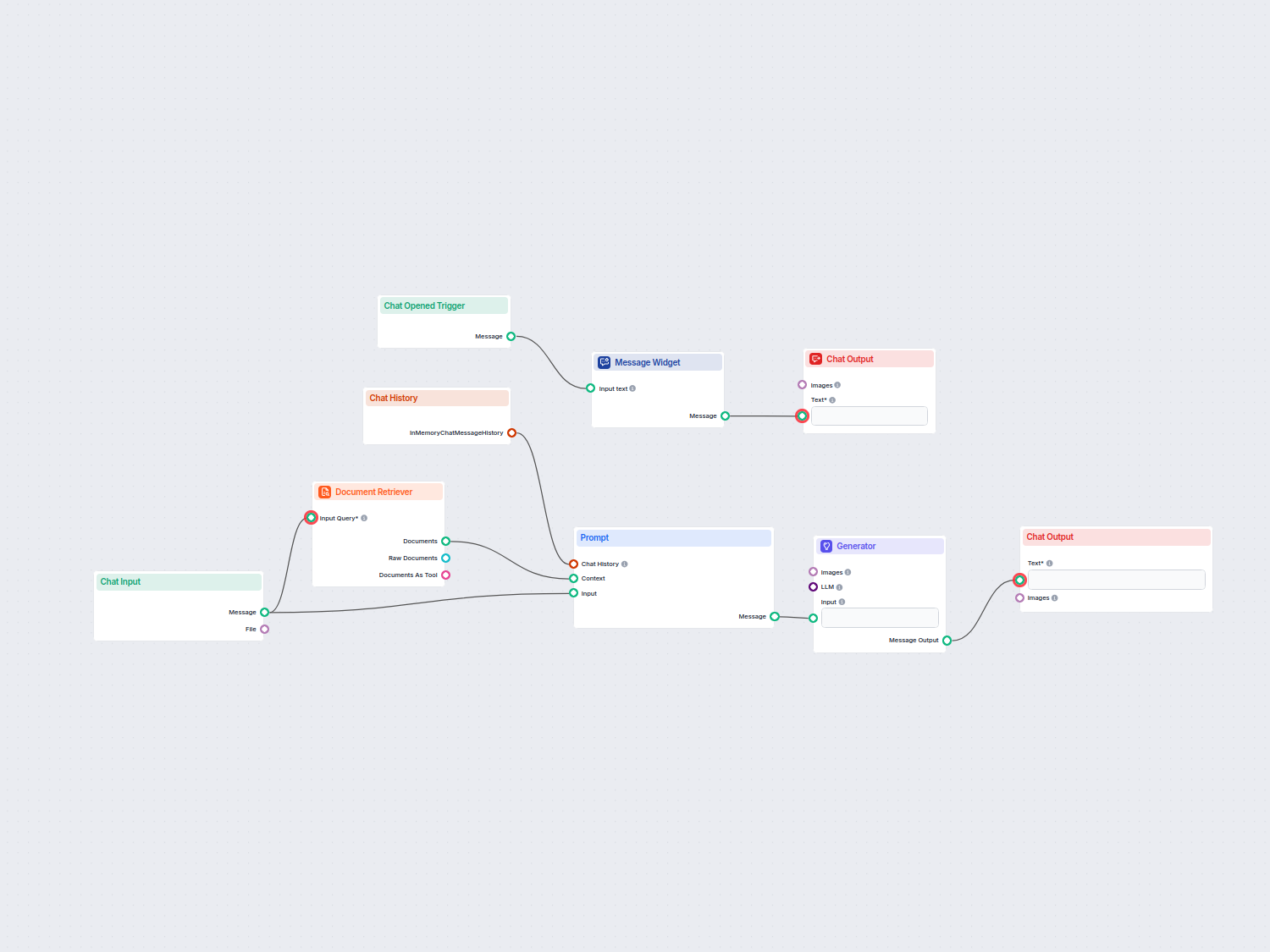

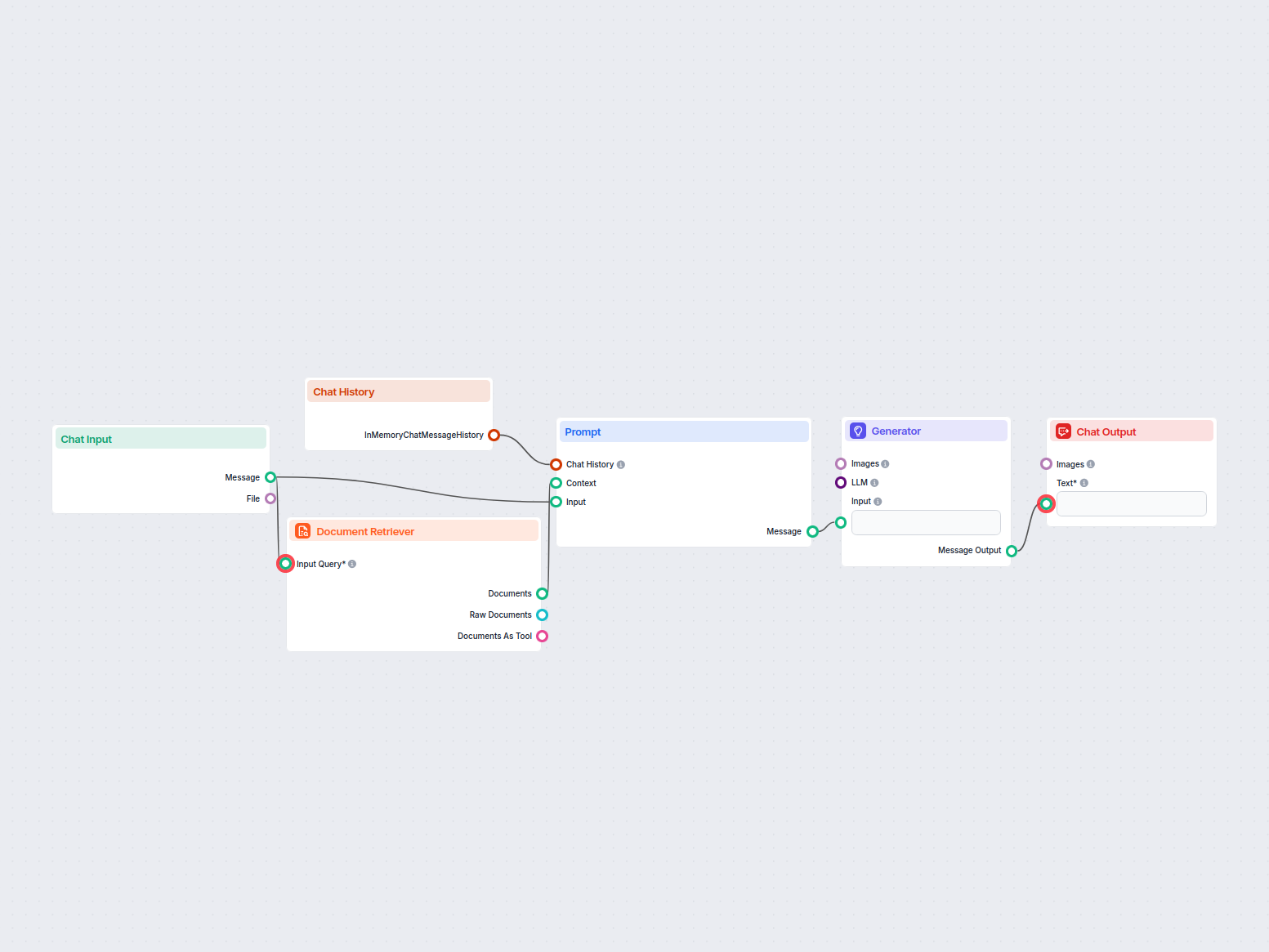

KI-Chatbot-Assistent auf Basis von OpenAI GPT-4o, der automatisch interne Firmendokumente durchsucht und nutzt, um Benutzerfragen zu beantworten. Liefert kontex...

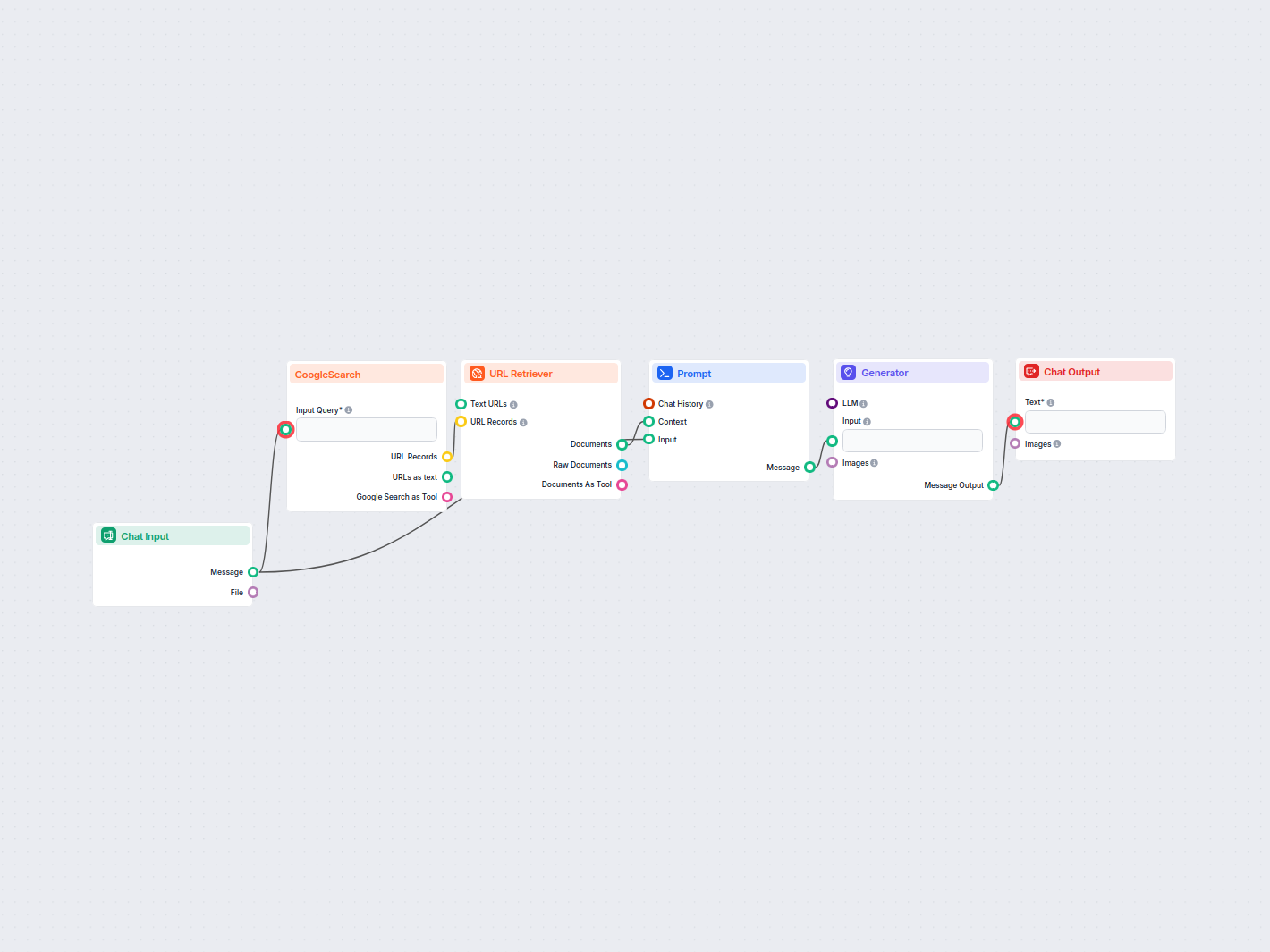

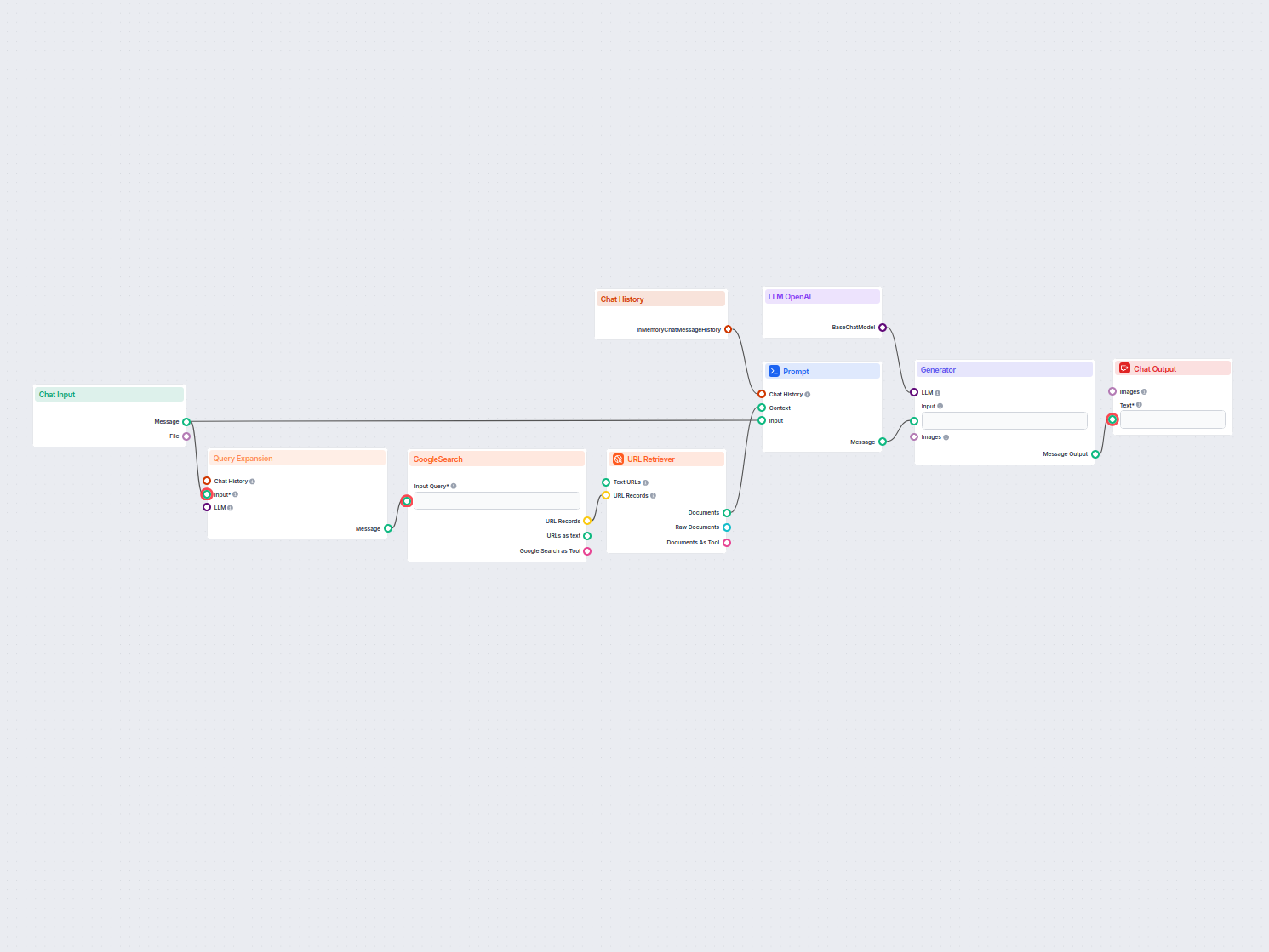

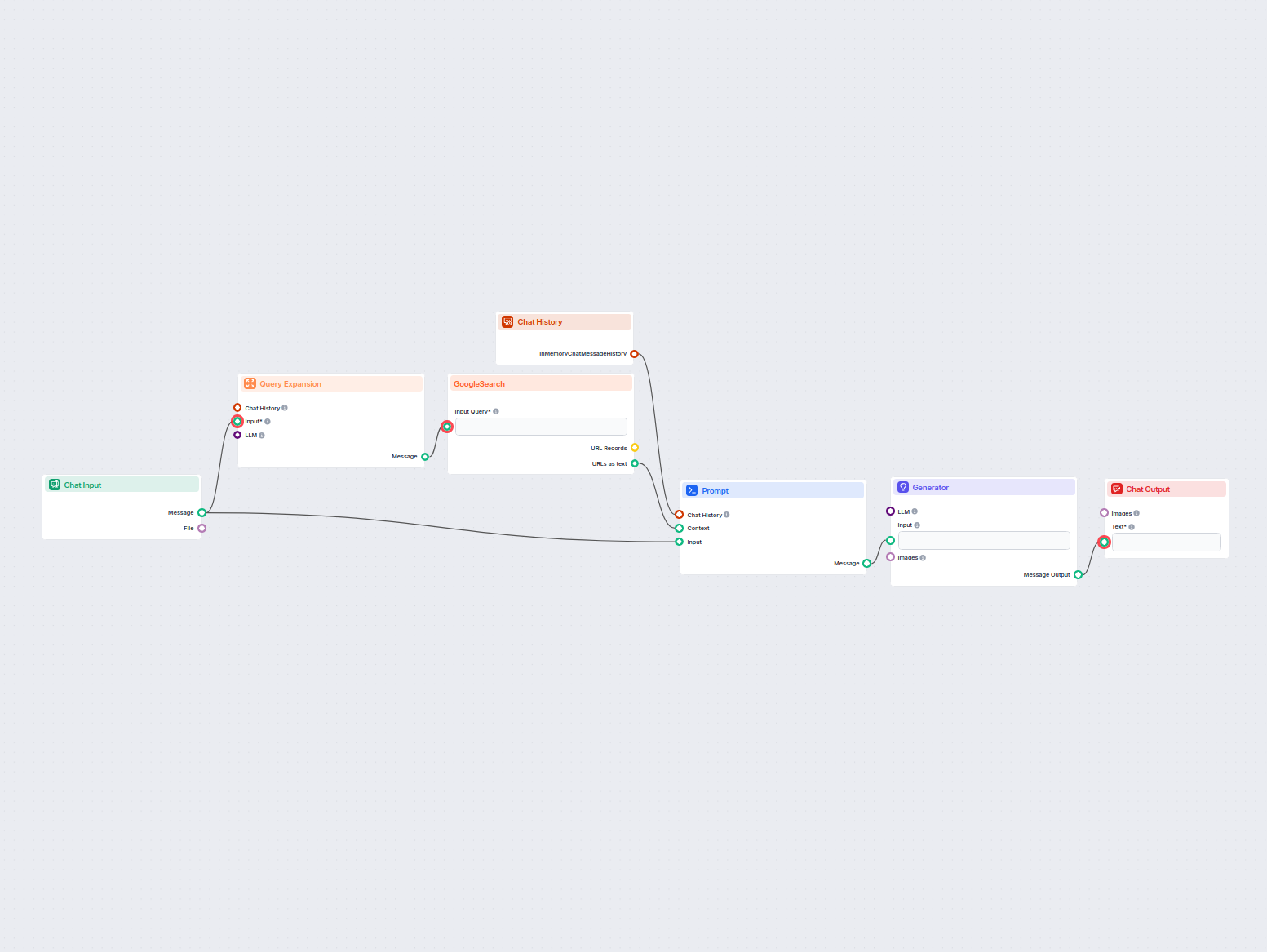

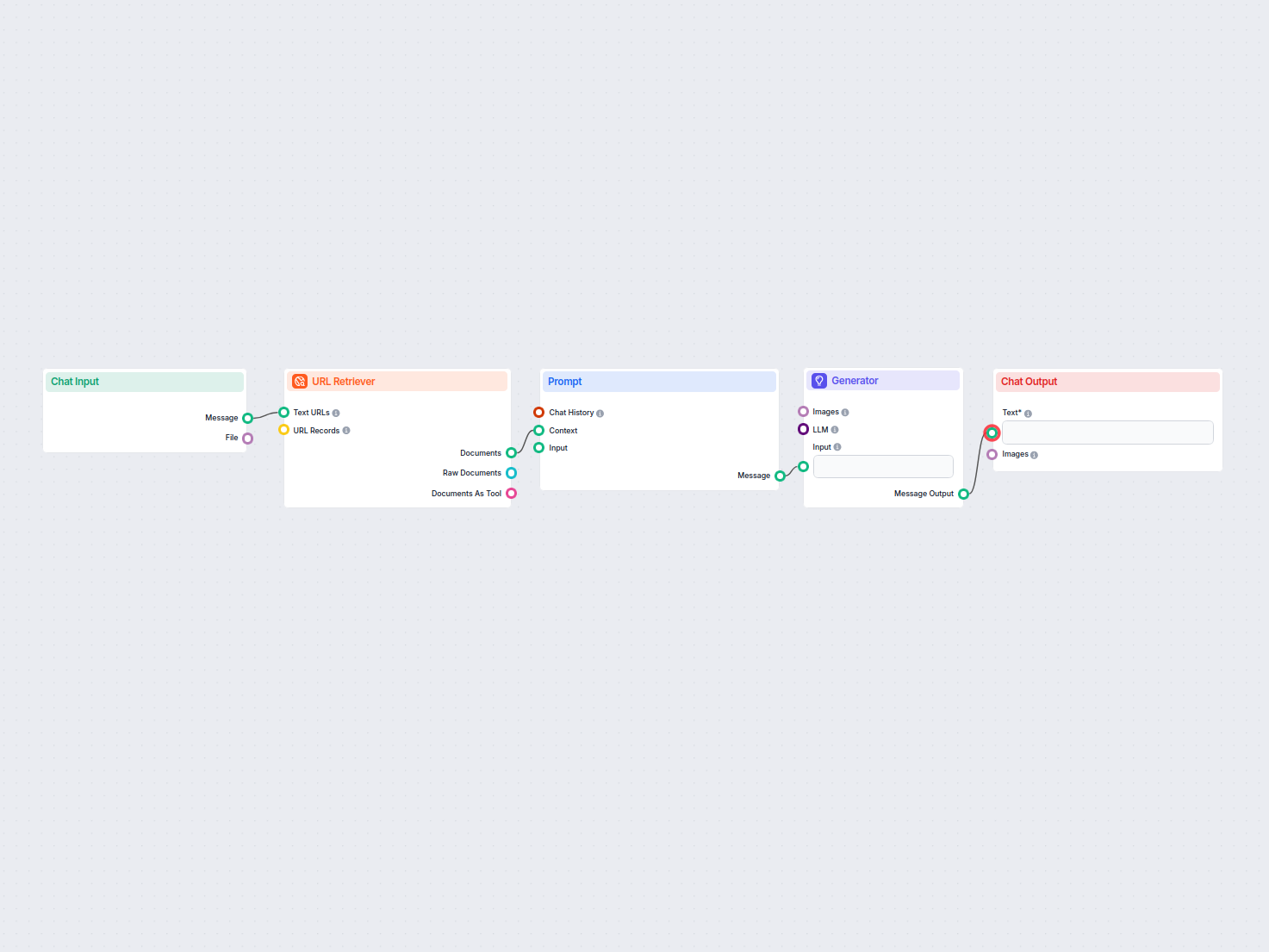

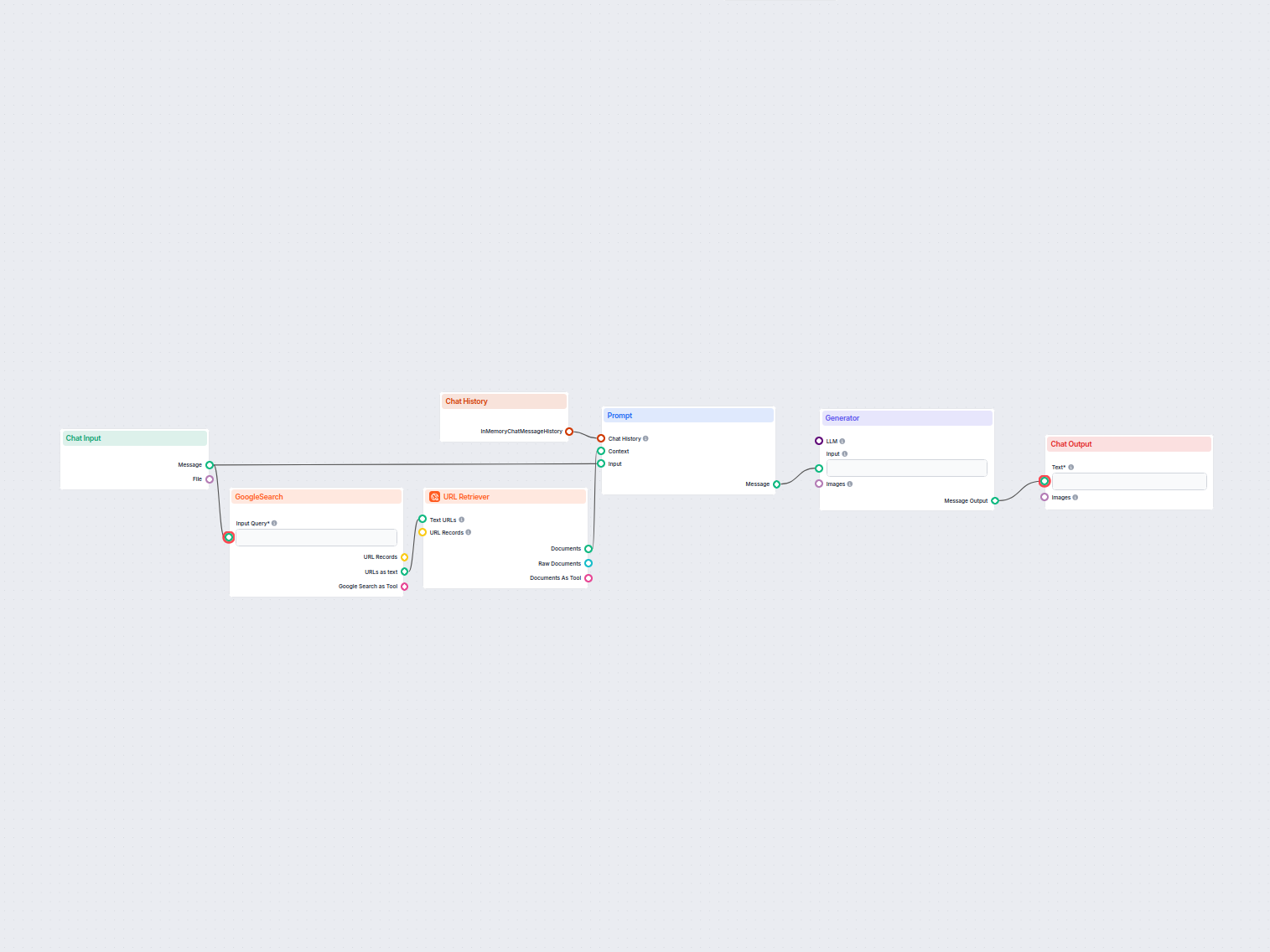

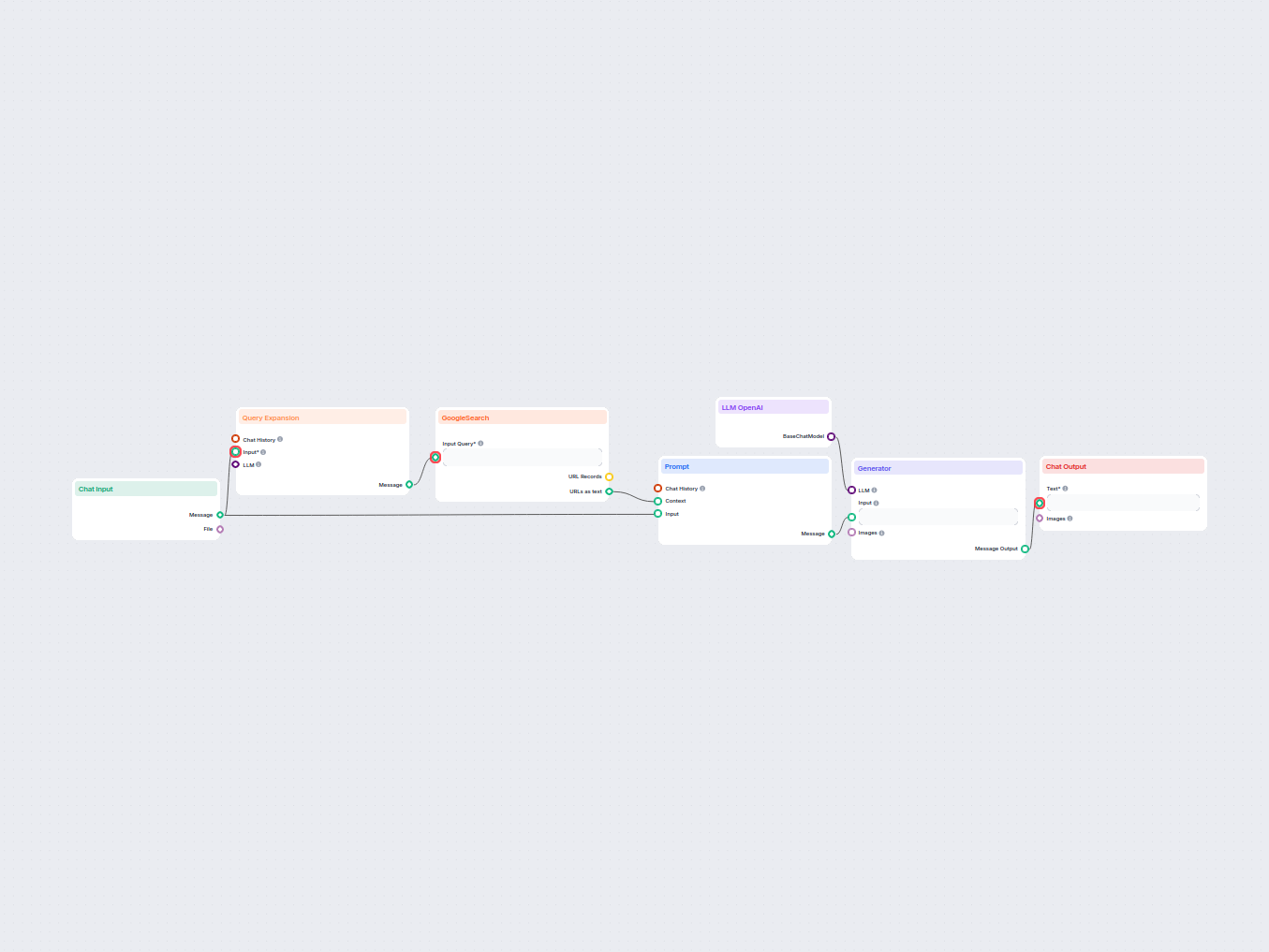

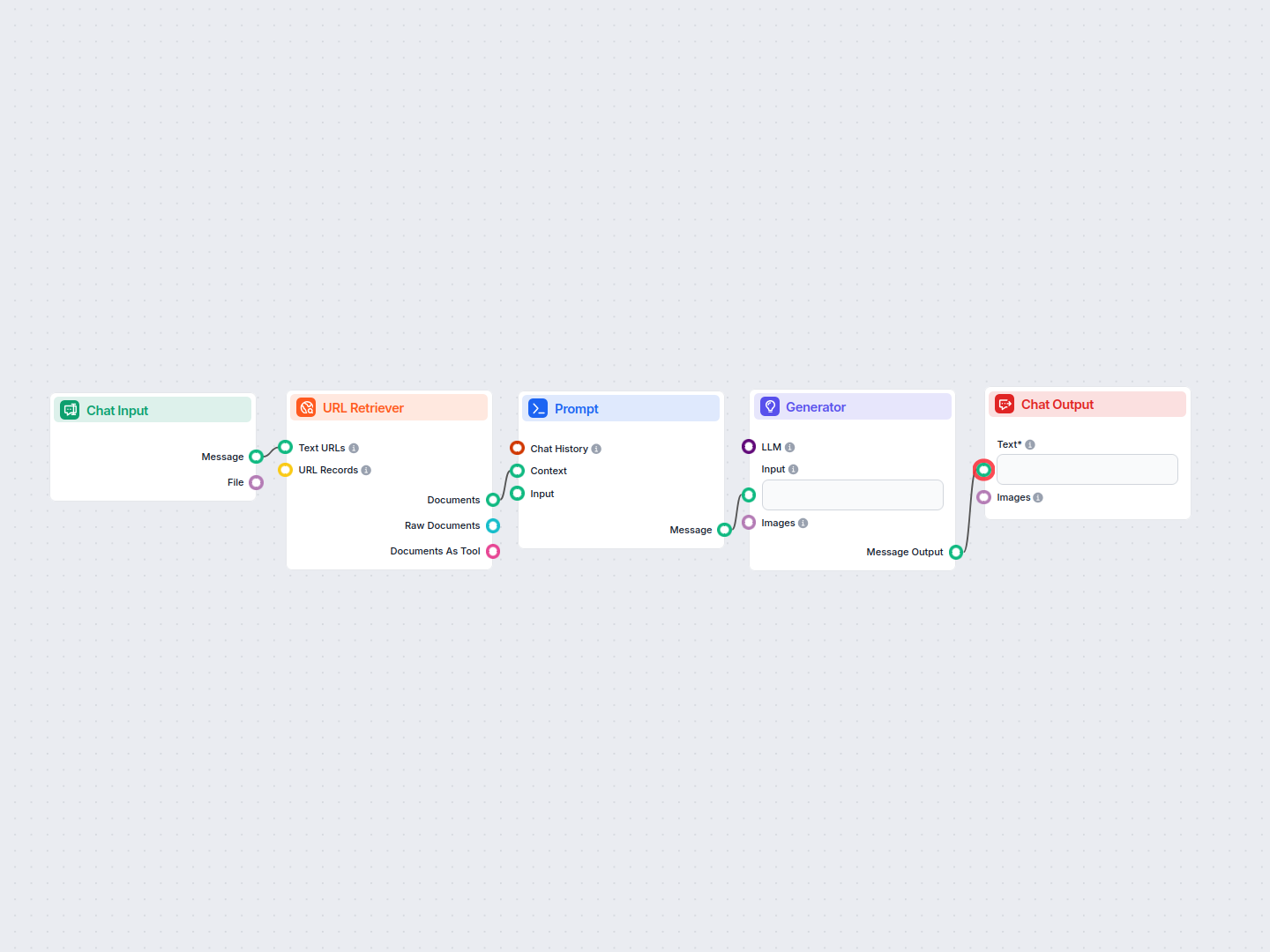

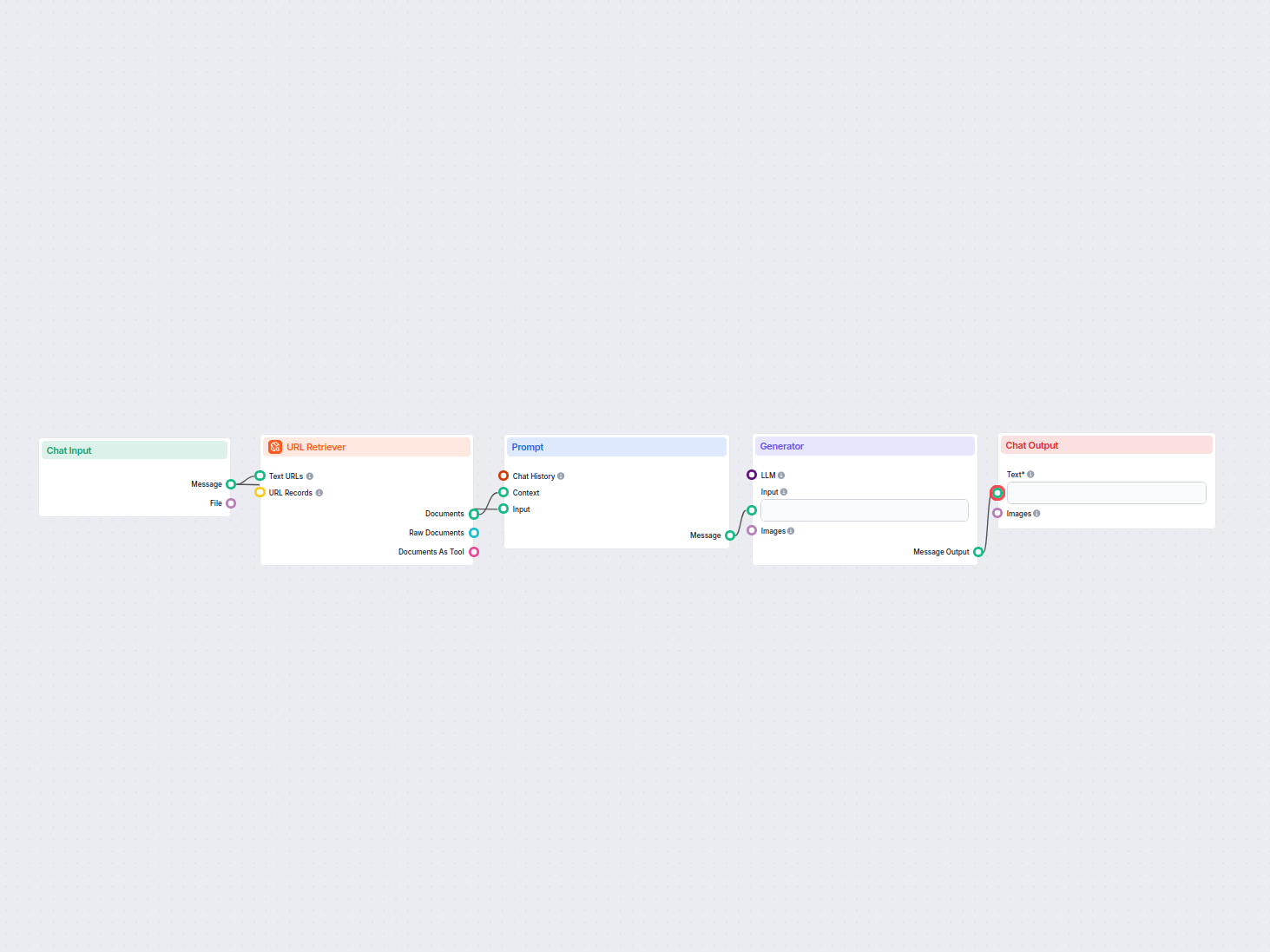

Ein Echtzeit-Chatbot, der Google Search auf Ihre eigene Domain beschränkt, relevante Webinhalte abruft und das OpenAI LLM nutzt, um Benutzeranfragen mit aktuell...

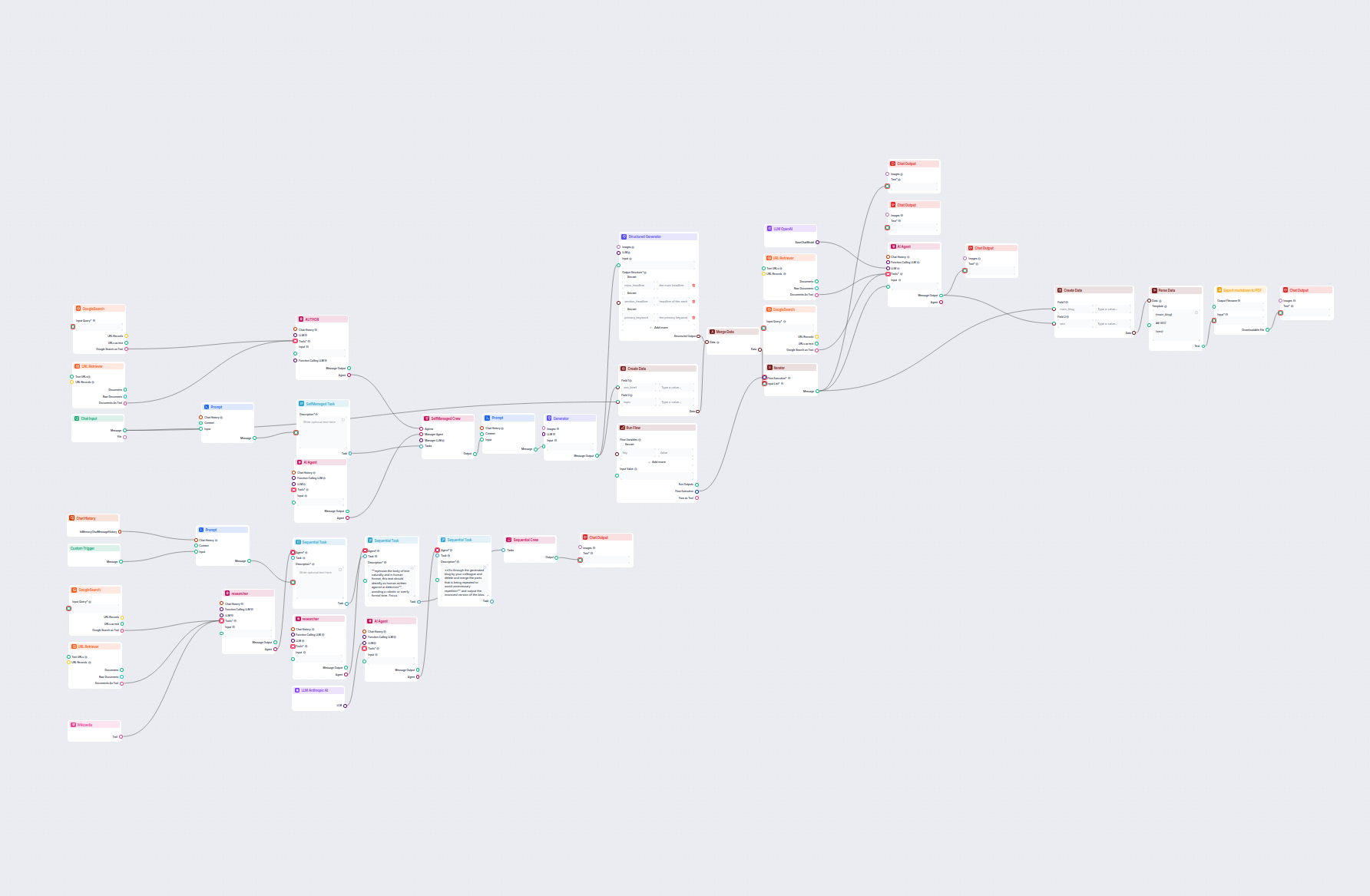

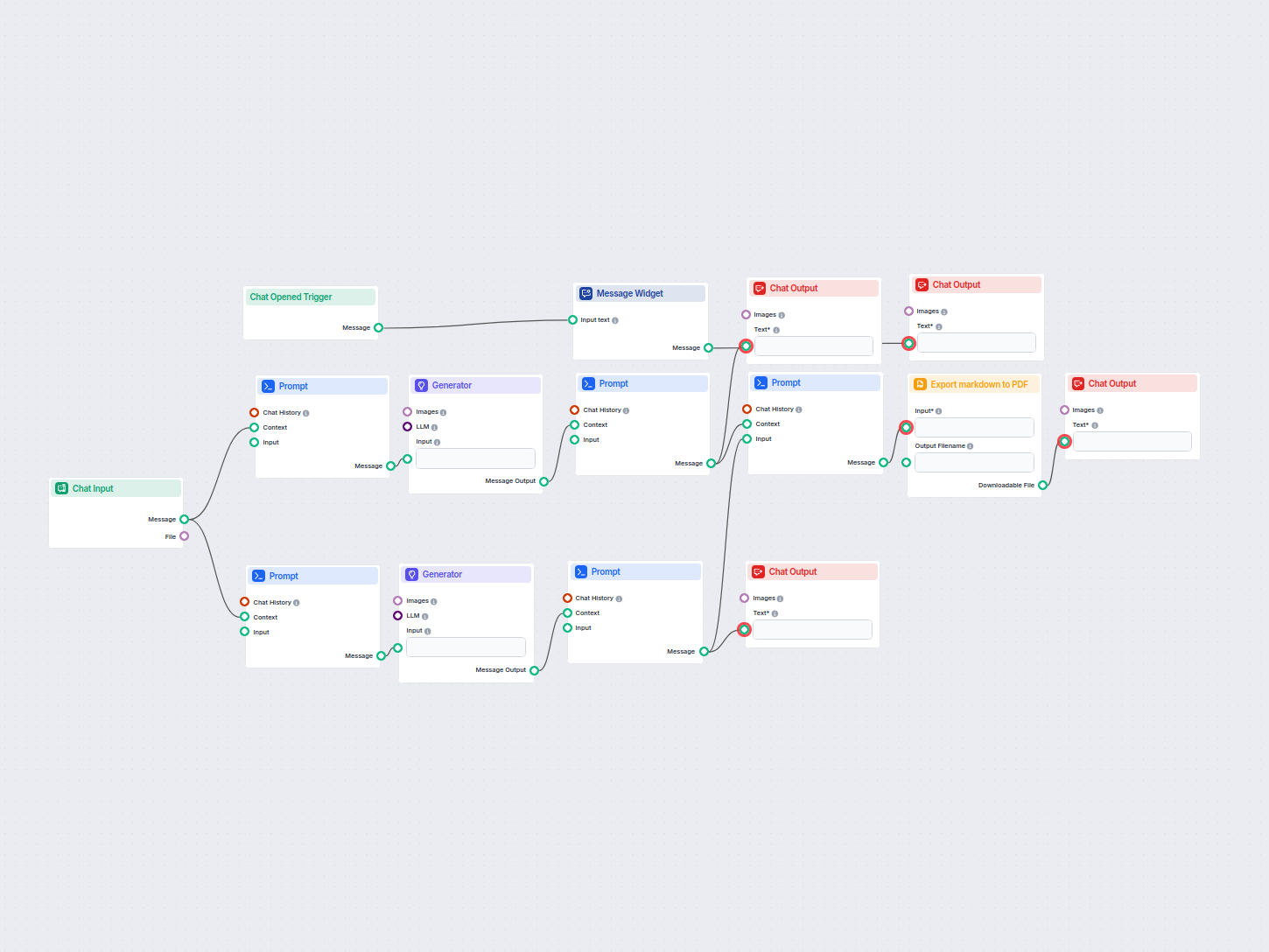

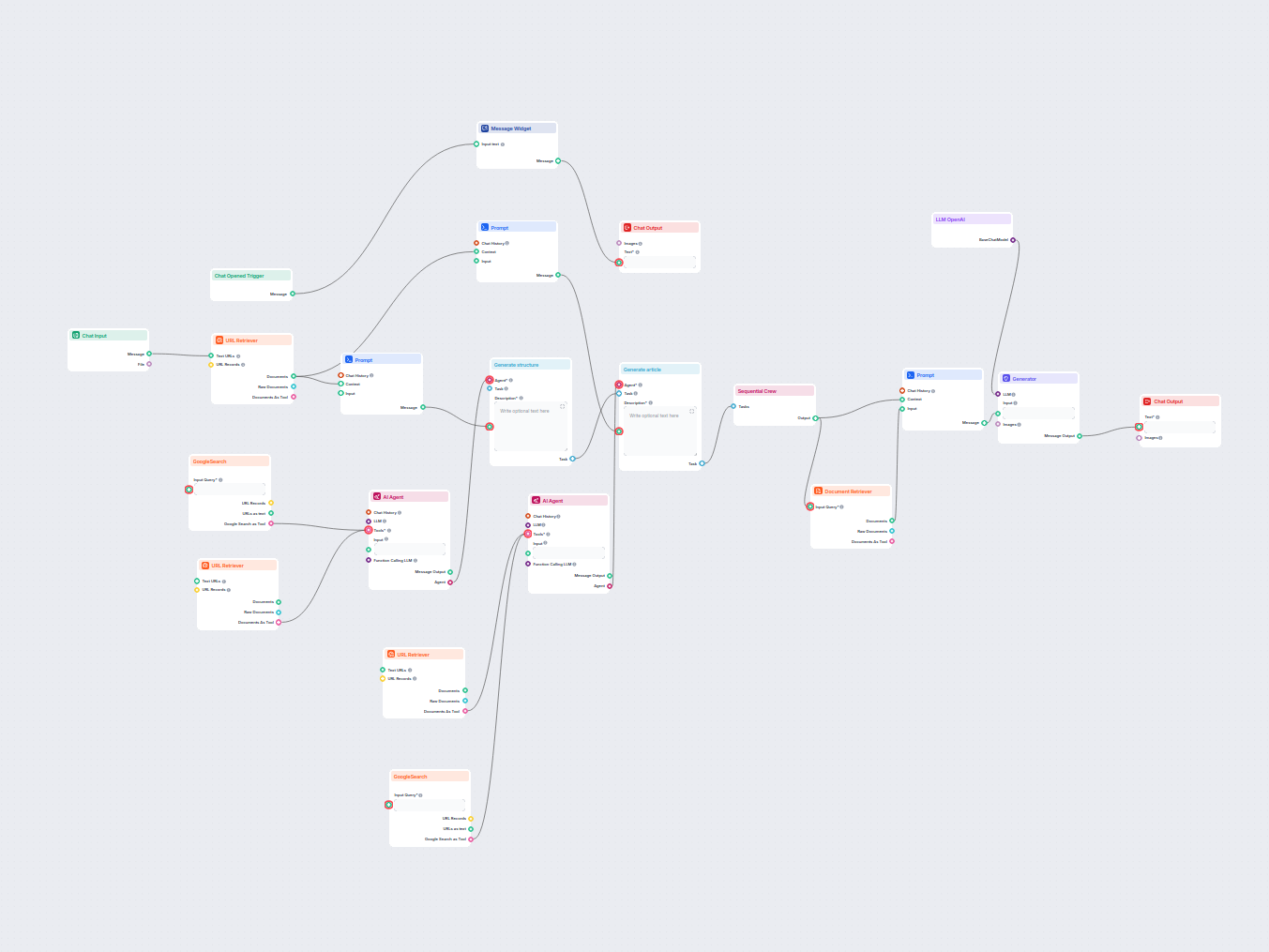

Erstellen Sie umfassende, SEO-optimierte Blogposts mit fortschrittlicher Struktur und hoher Wortanzahl mithilfe mehrerer KI-Agenten. Der Workflow umfasst automa...

Erstellen Sie umfassende, SEO-optimierte Glossarartikel mithilfe von KI und Echtzeit-Webrecherche. Dieser Flow analysiert die bestplatzierten Inhalte und Schrei...

Generieren Sie automatisch mehrere Google Ads-Variationen für jede URL. Fügen Sie Ihren Webseiten-Link ein und erhalten Sie gebrauchsfertige Anzeigentitel und -...

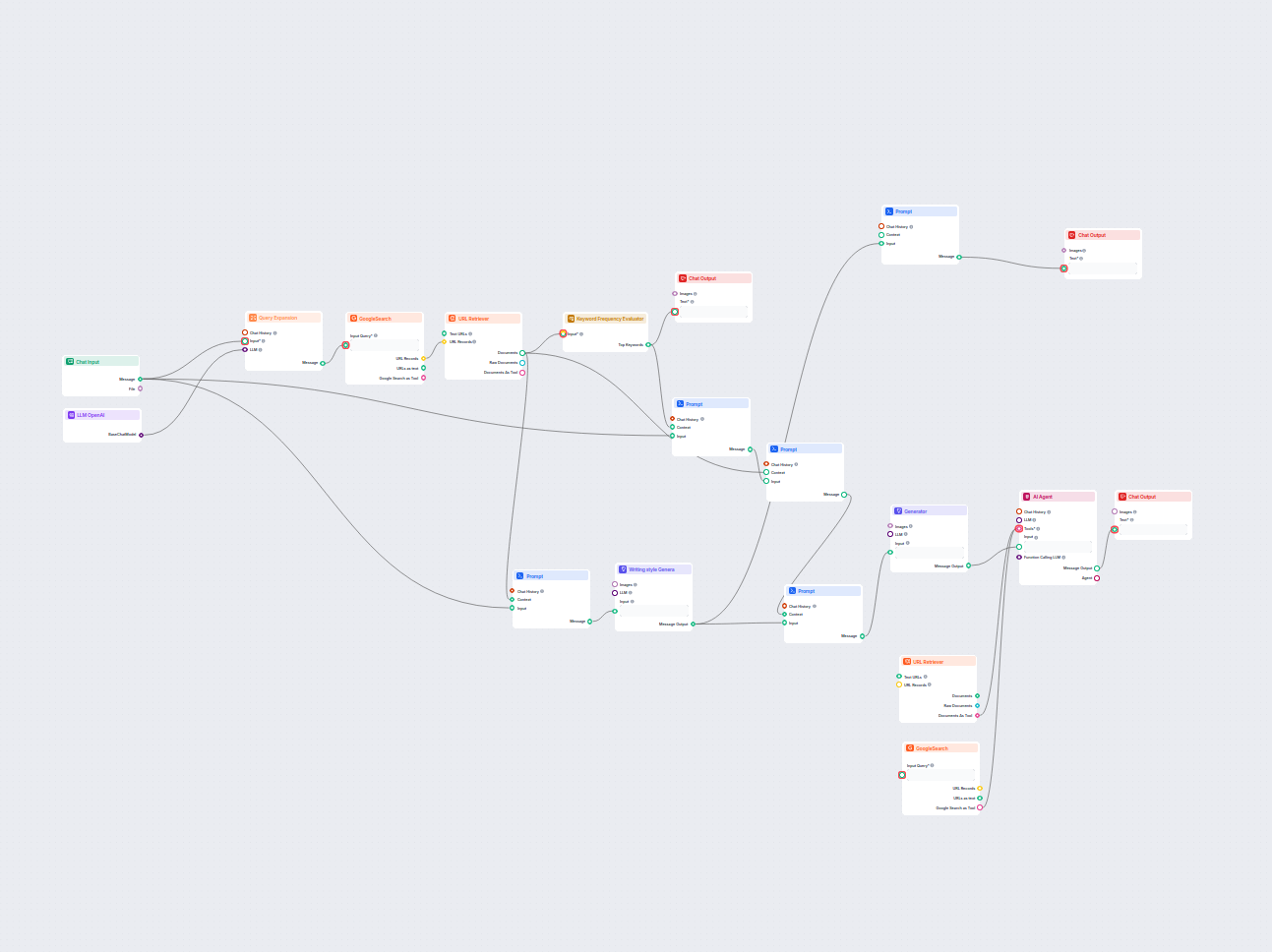

Dieser Workflow analysiert die Google-Suchergebnisse für ein bestimmtes Keyword und extrahiert Erkenntnisse über Suchintention, Wettbewerbsstrategien und Conten...

Erstellen Sie Google Sheets-Formeln sofort aus Anfragen in natürlicher Sprache. Dieser KI-gestützte Workflow hilft Nutzern, präzise Tabellenformeln zu erstellen...

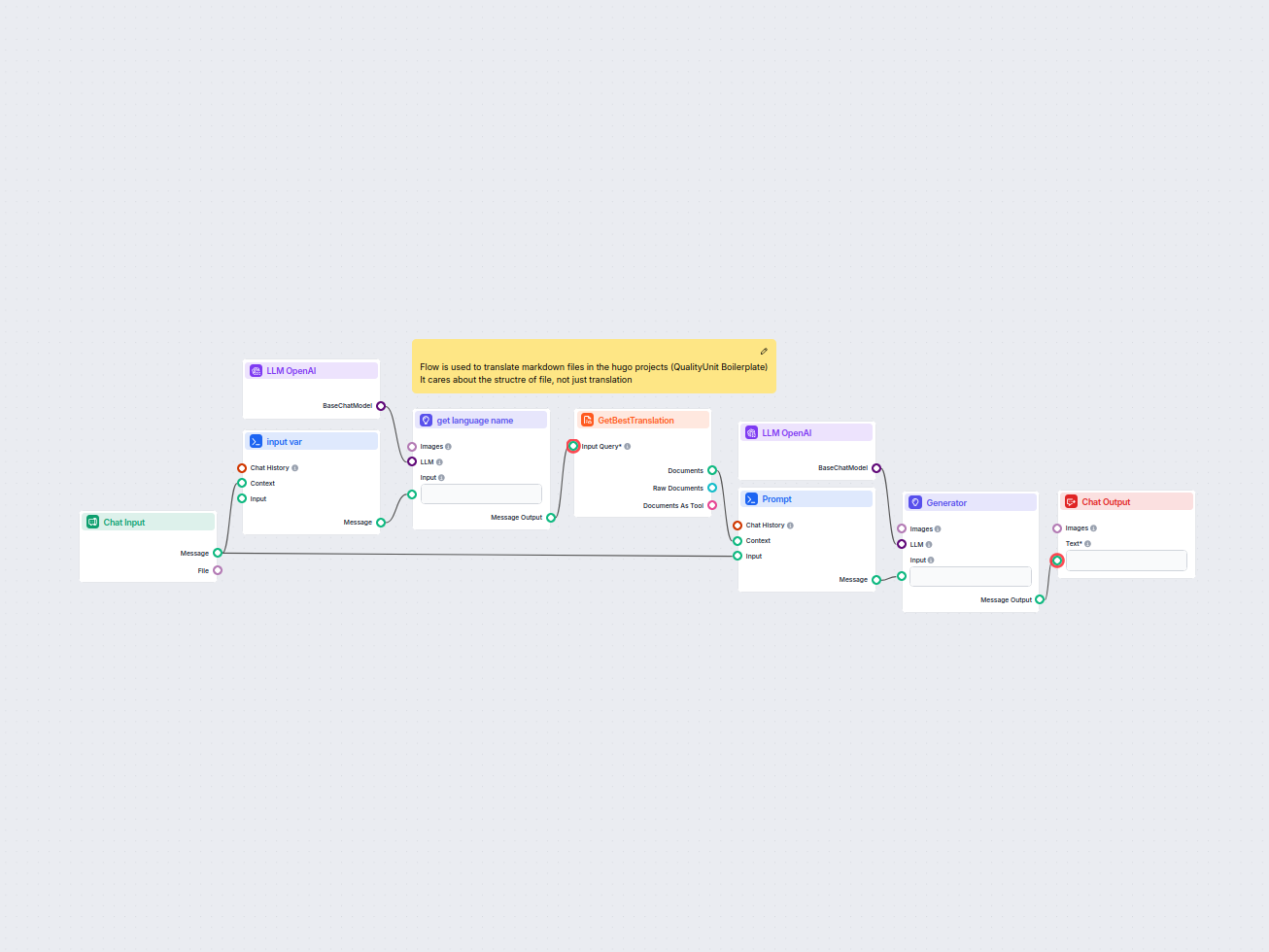

Dieser Workflow optimiert die Übersetzung von HUGO-Markdown-Dateien in Zielsprache, wobei die Dateistruktur und das Format erhalten bleiben. Durch den Einsatz v...

Erstellt automatisch eine ansprechende, SEO-freundliche Meta-Beschreibung für jede Webseite, PDF, YouTube-Video oder Dokumentenlink, indem der Inhalt analysiert...

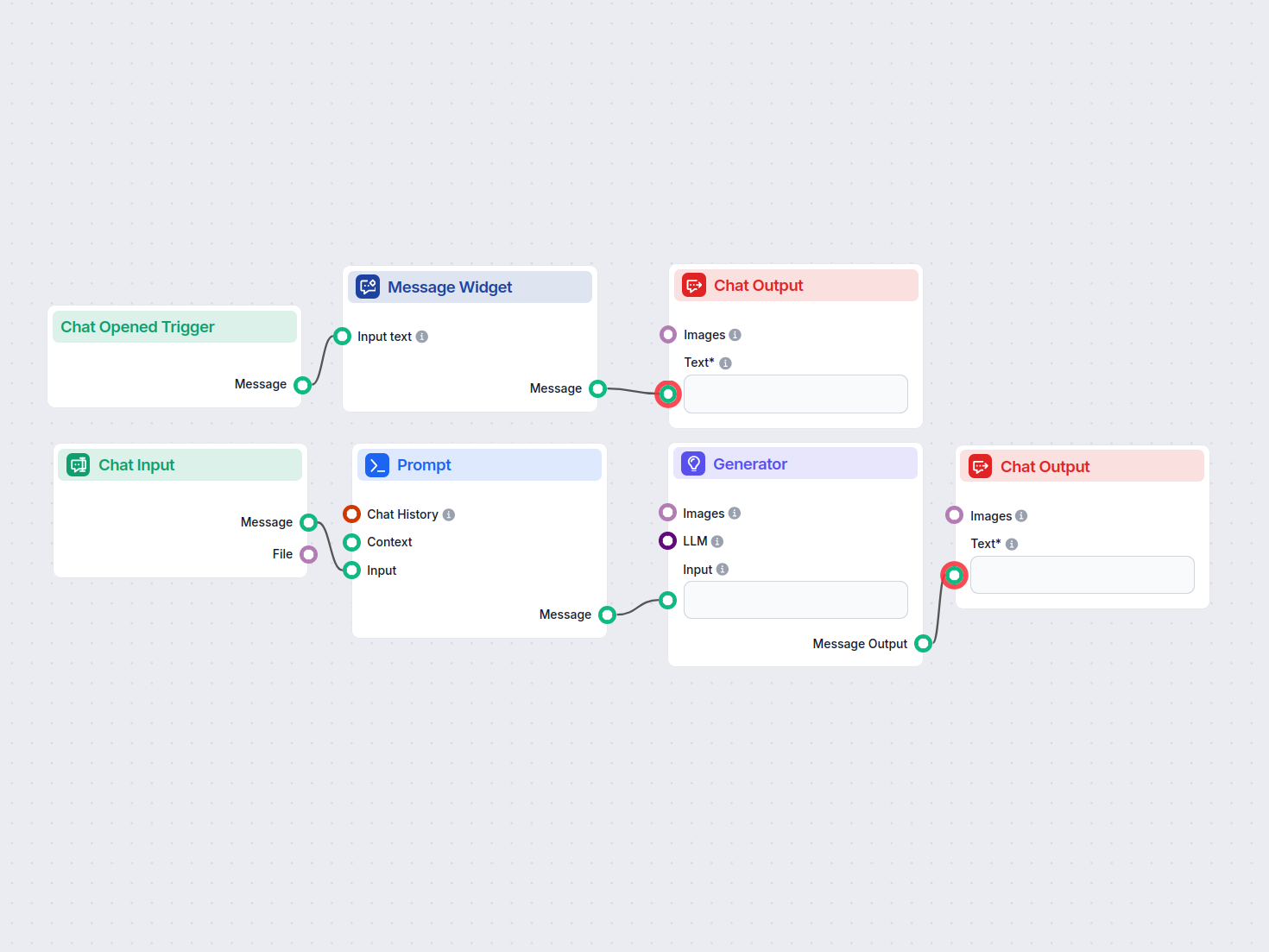

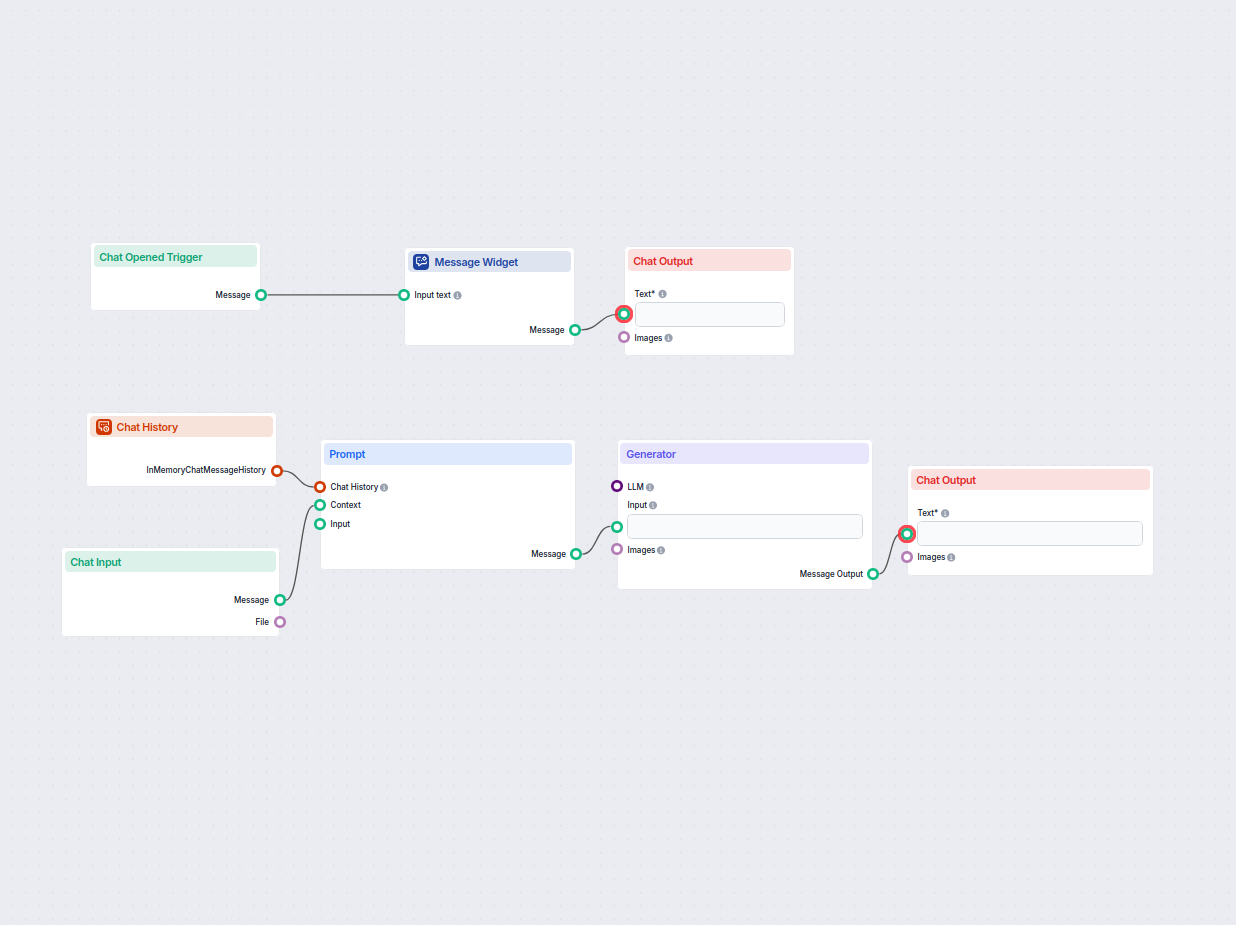

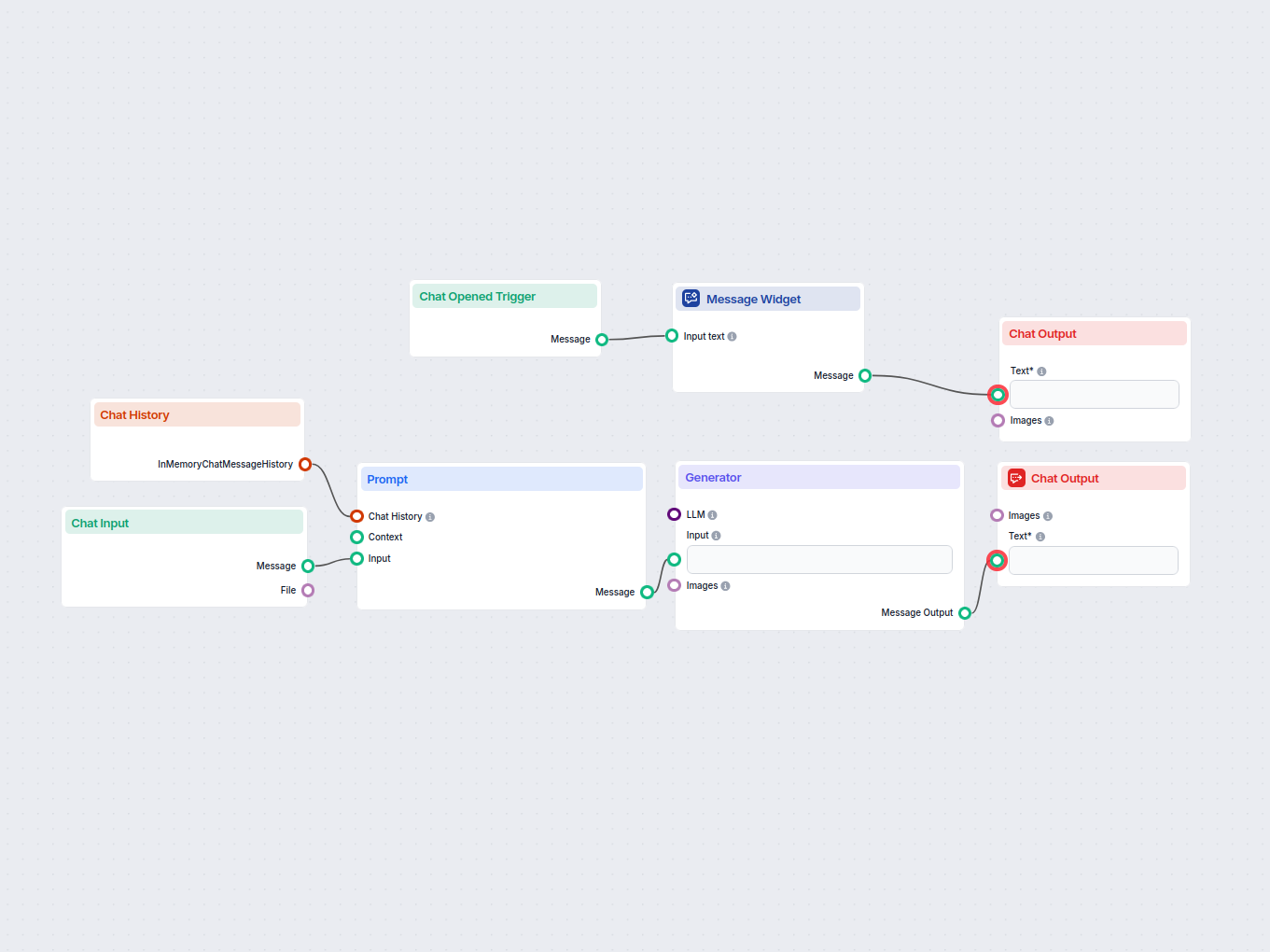

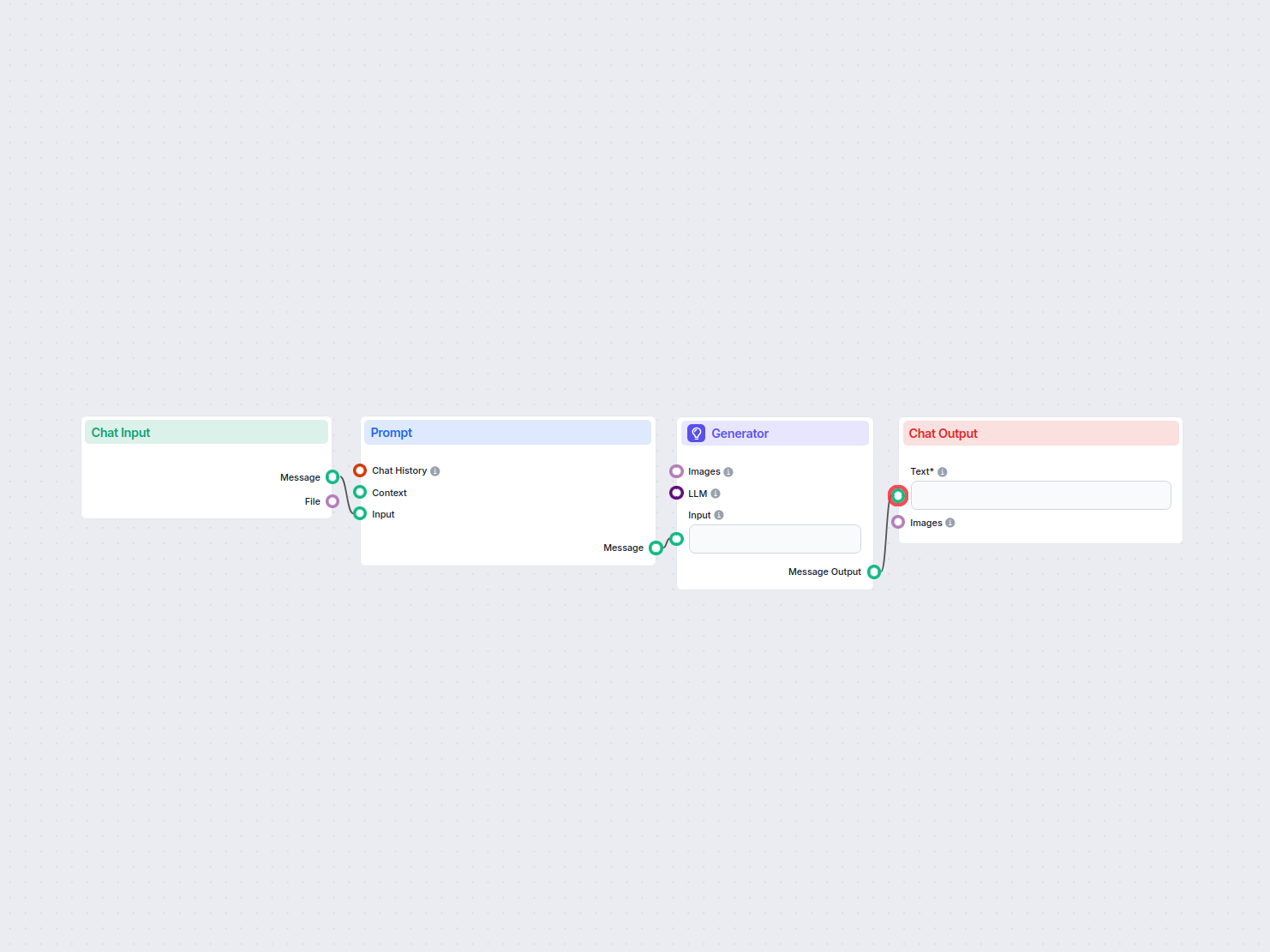

Erstellen Sie mühelos umfassende Businesspläne mit KI. Dieser Workflow sammelt Benutzereingaben, nutzt den Chatverlauf für Kontext und verwendet eine Prompt-Vor...

Generieren Sie mit KI ganz einfach kreative und relevante Firmennamen-Ideen. Nutzer geben eine kurze Beschreibung ihres Unternehmens an und erhalten sofort fünf...

Erzeuge innovative Geschäftsideen, die auf Benutzereingaben oder ausgewählten Branchen basieren, mithilfe von KI. Dieser interaktive Flow liefert Vorschläge ent...

Erstellen Sie automatisch ansprechende und professionelle LinkedIn-Headlines mit KI. Geben Sie einfach eine kurze Beschreibung Ihrer Erfahrung an, und dieser Fl...

Erstellen Sie mühelos formelle, informelle oder juristische Briefe, die auf Ihre Bedürfnisse zugeschnitten sind. Dieser KI-gestützte Workflow nimmt Ihre Eingabe...

Dieser KI-gestützte Workflow löst automatisch CAPTCHA-Bilder, die von Benutzern hochgeladen werden. Er führt die Nutzer mit Anweisungen, verarbeitet das hochgel...

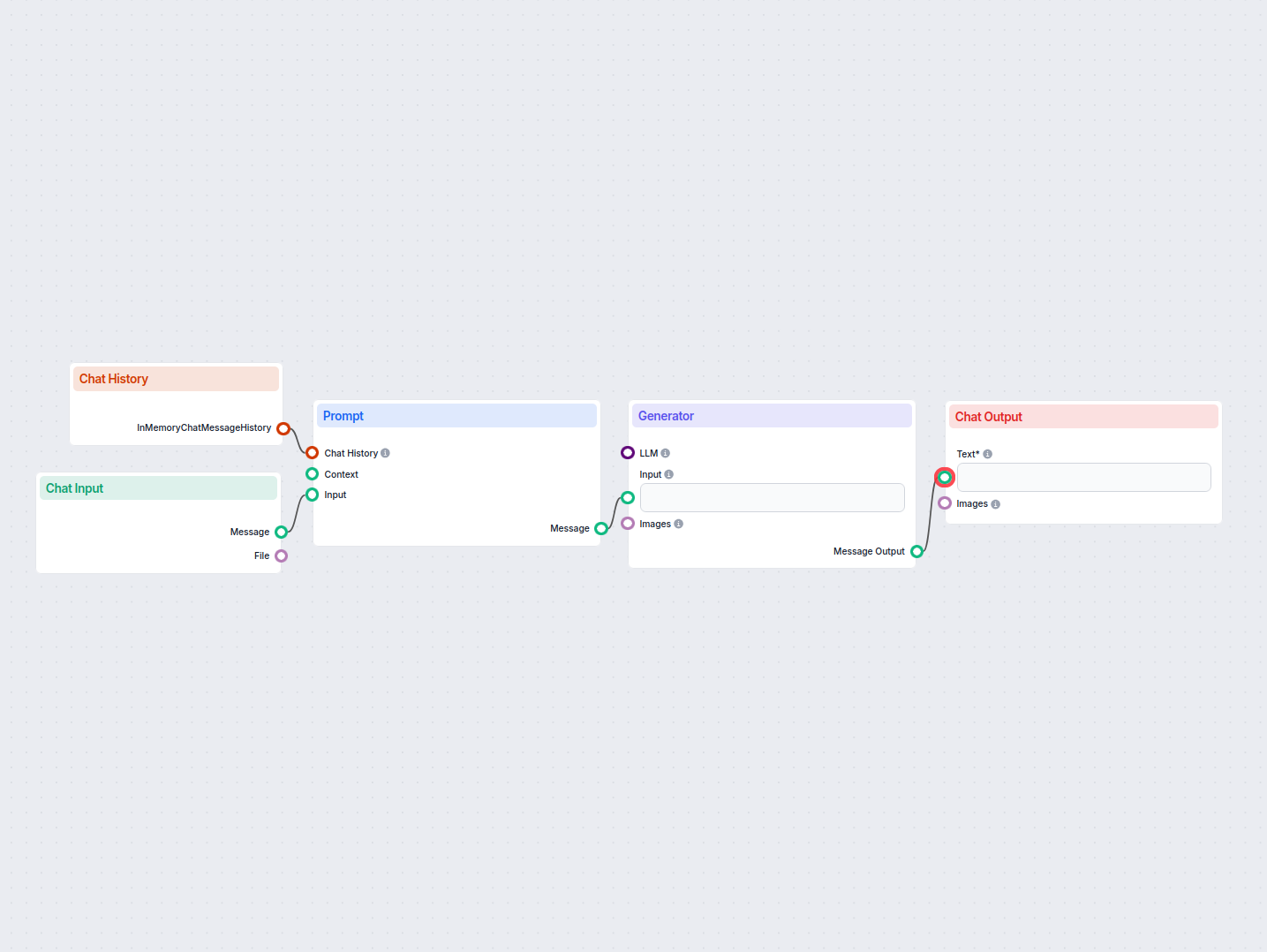

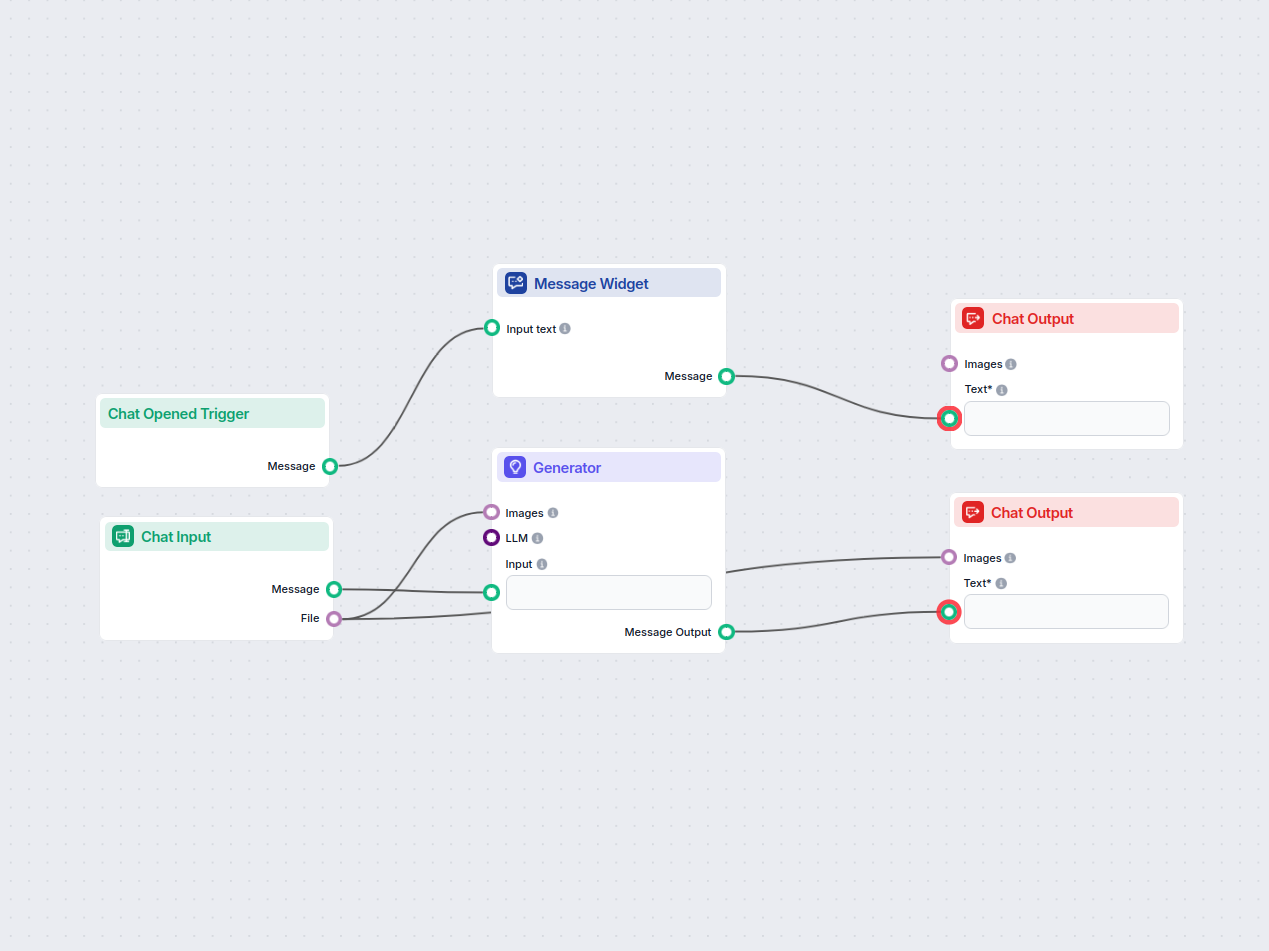

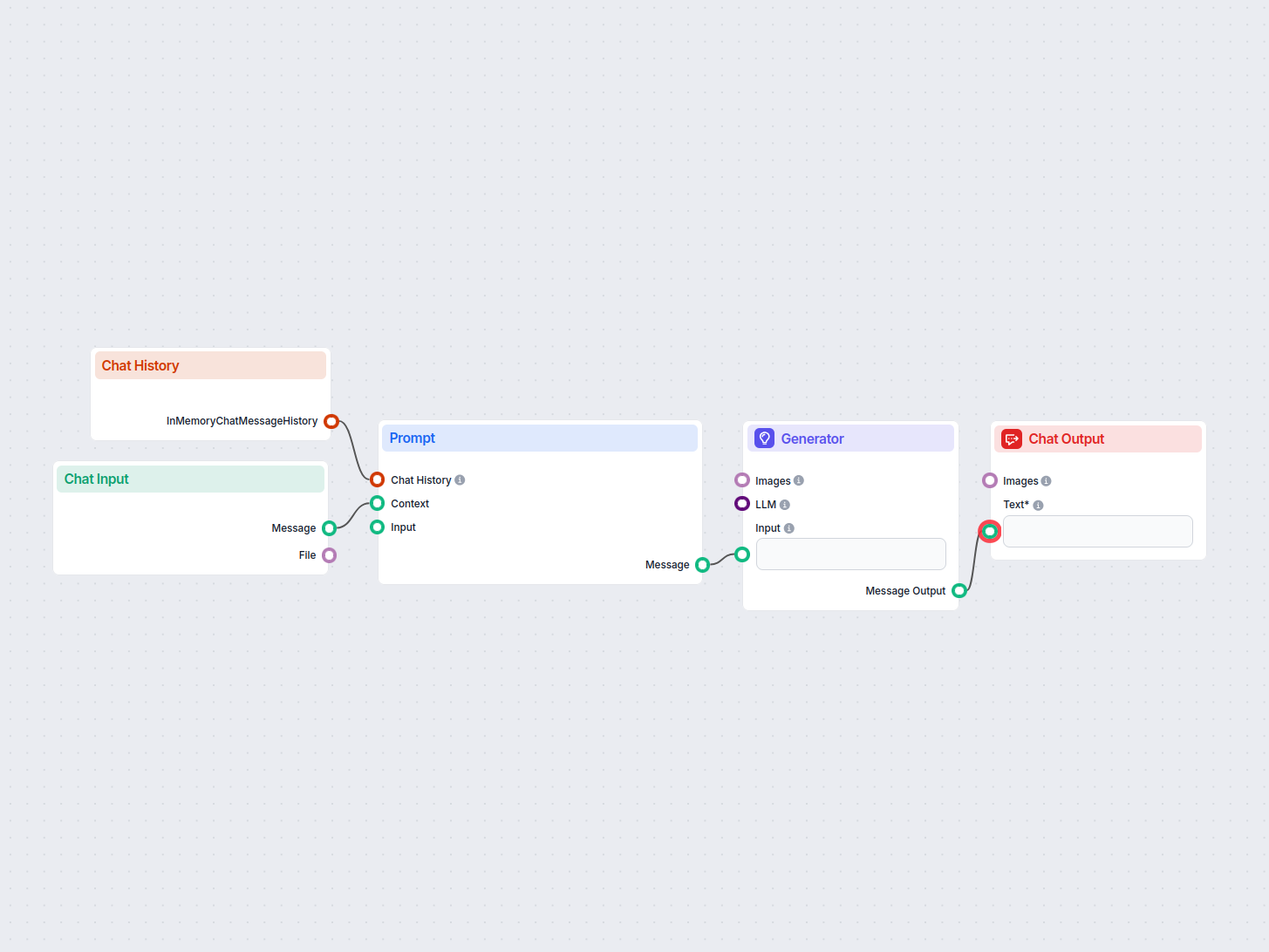

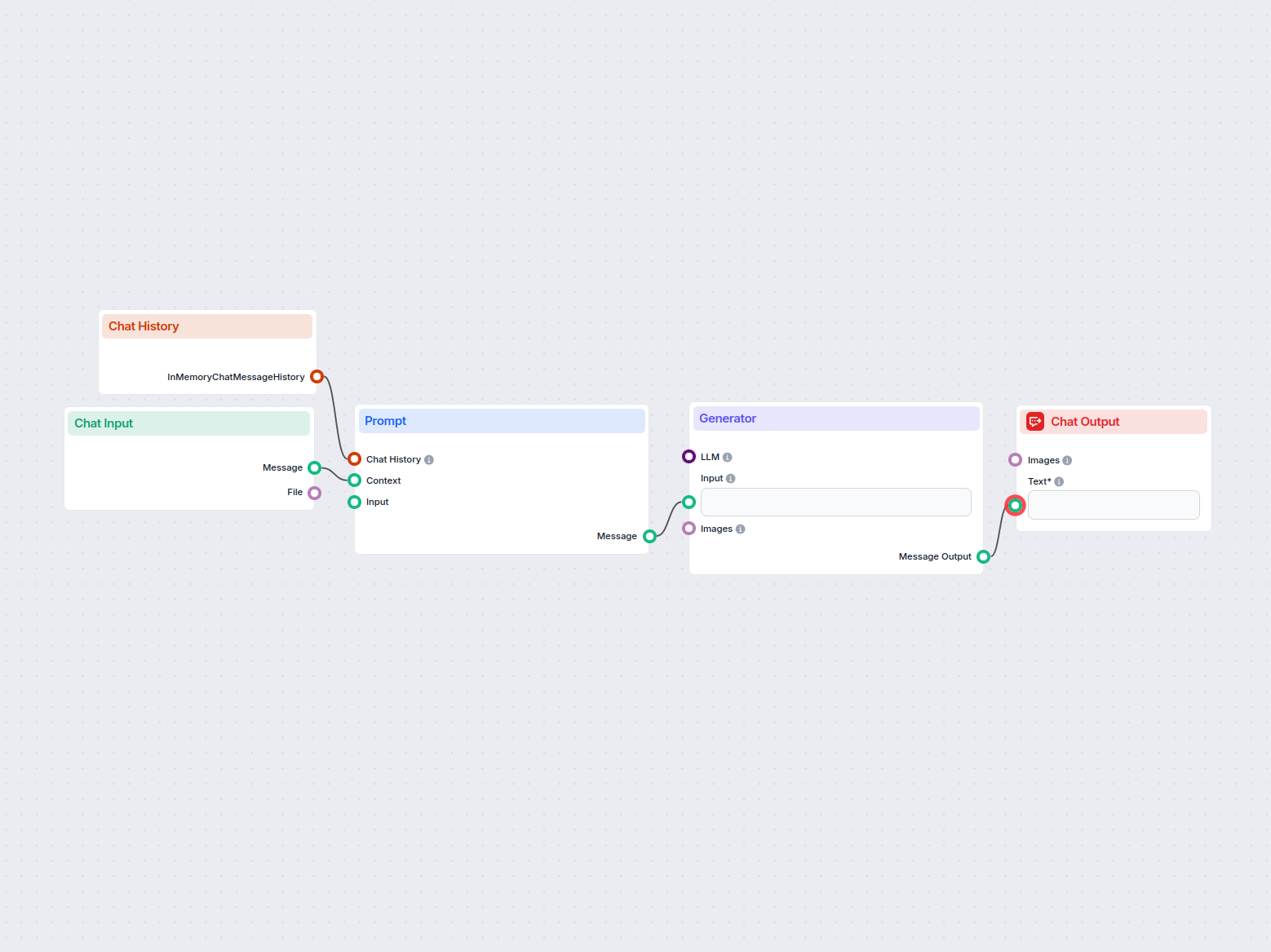

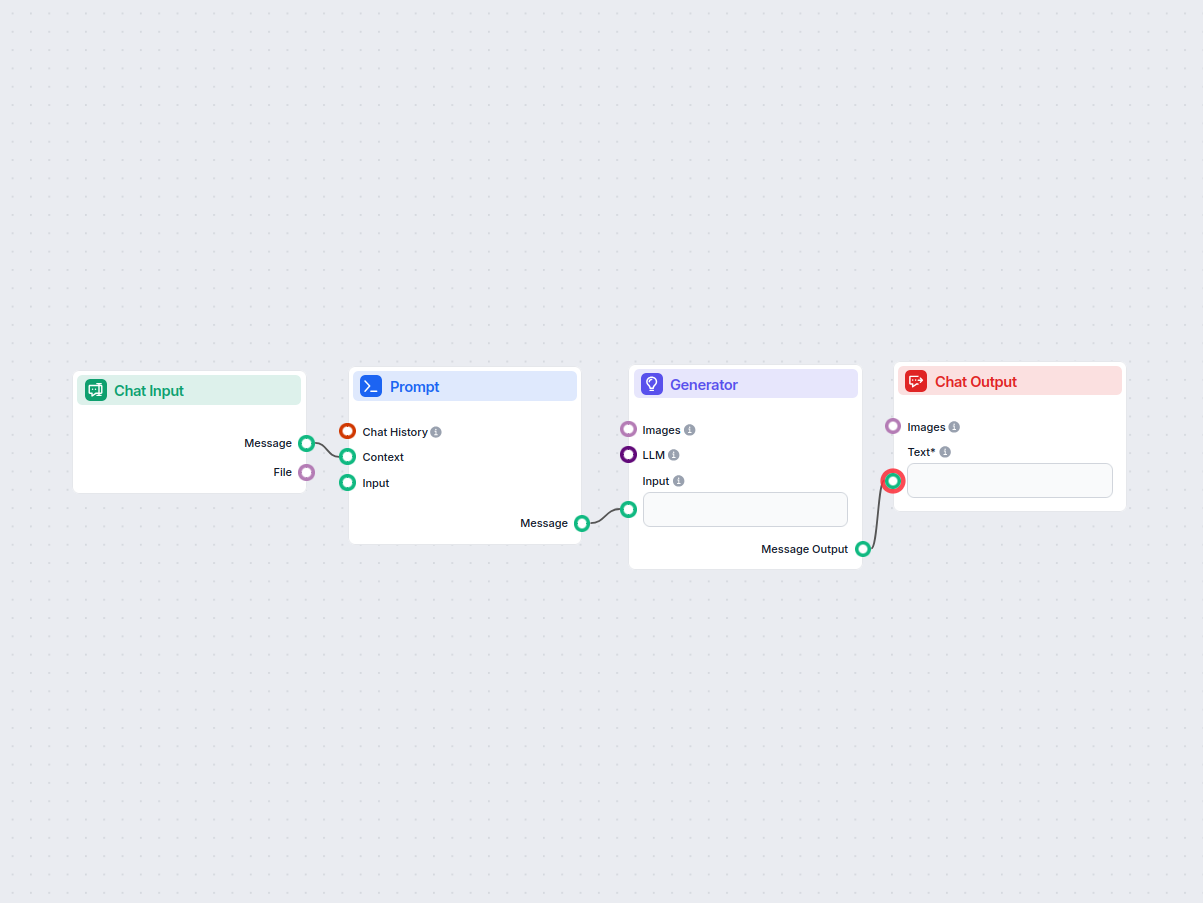

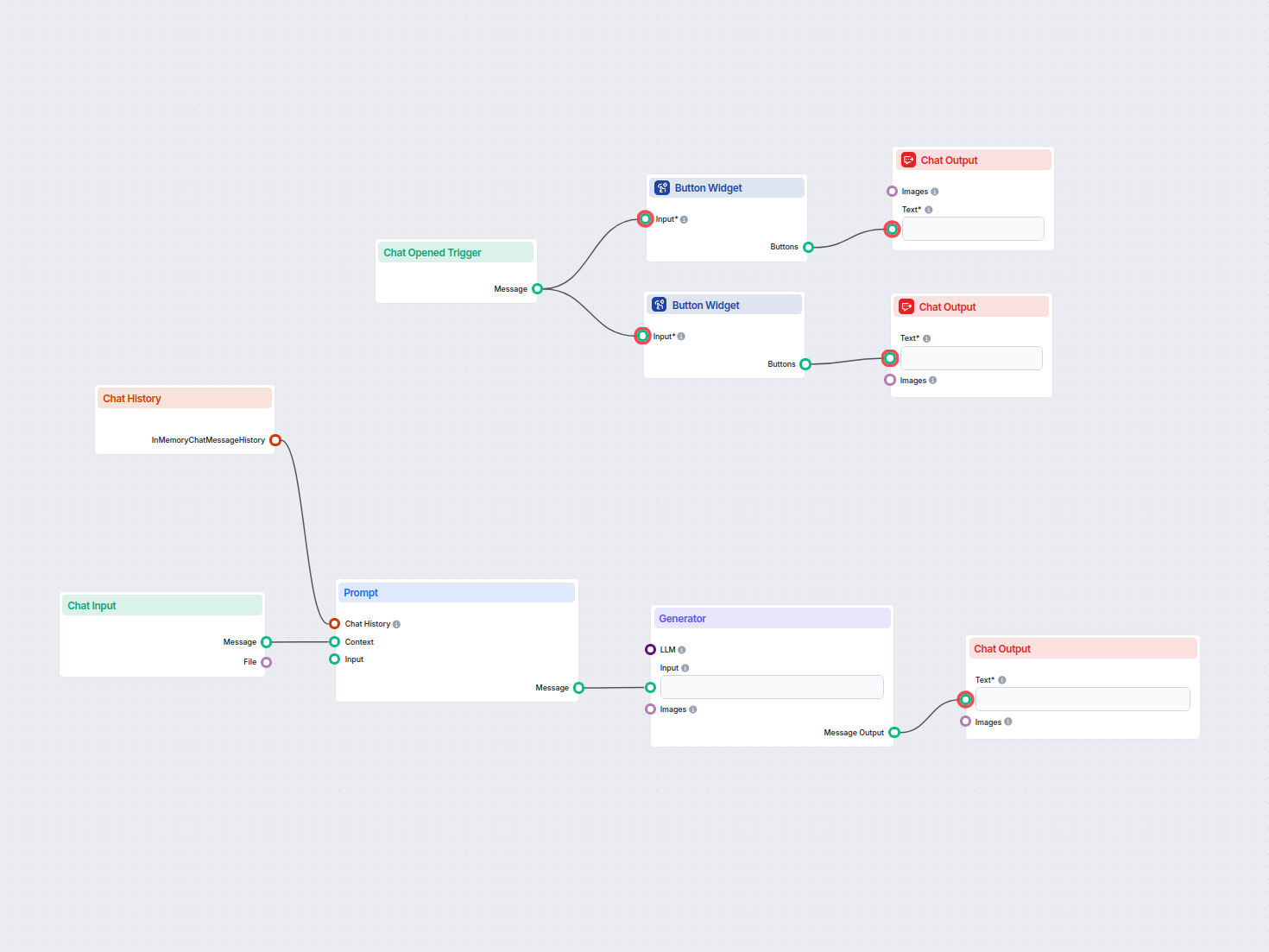

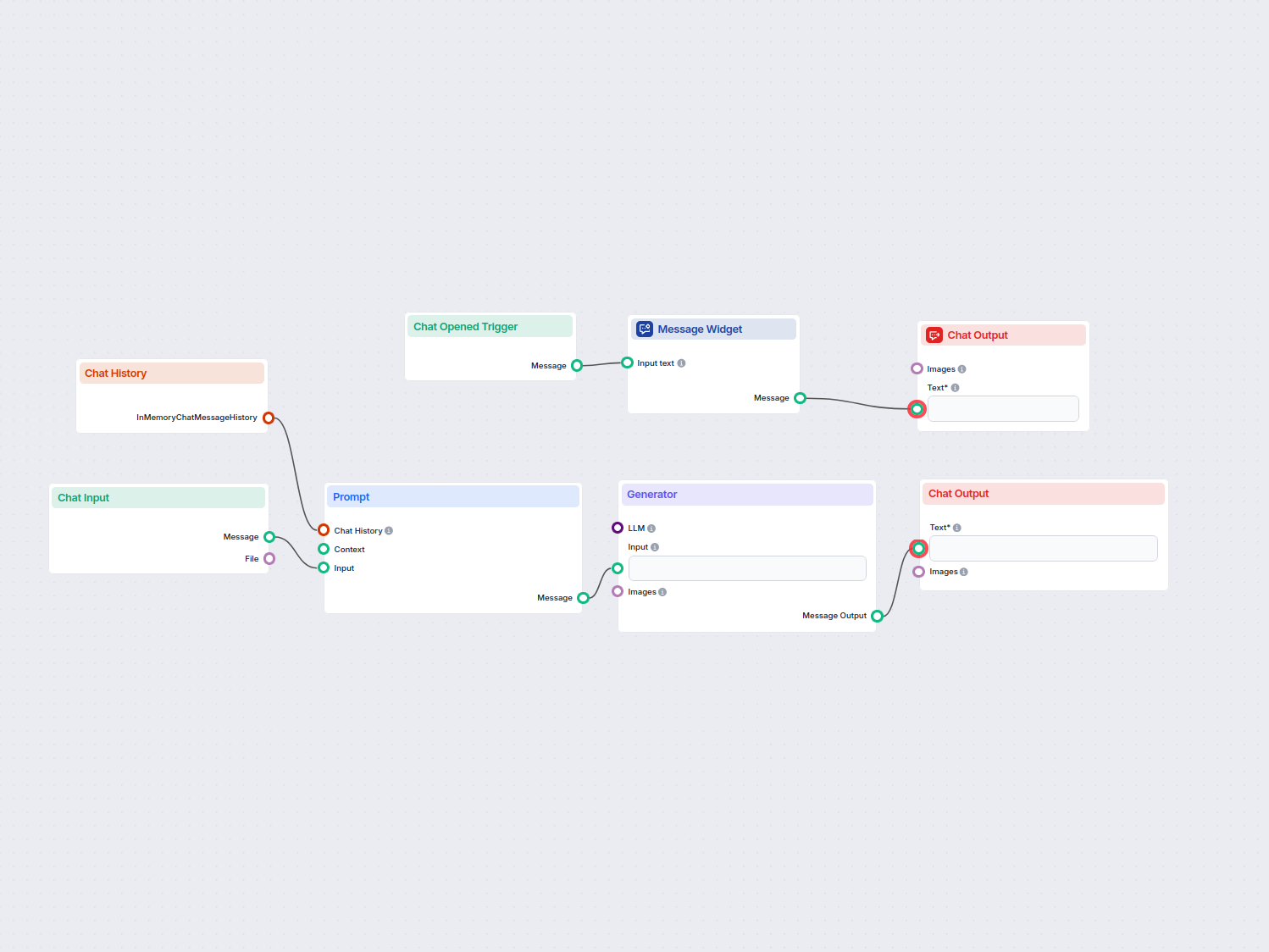

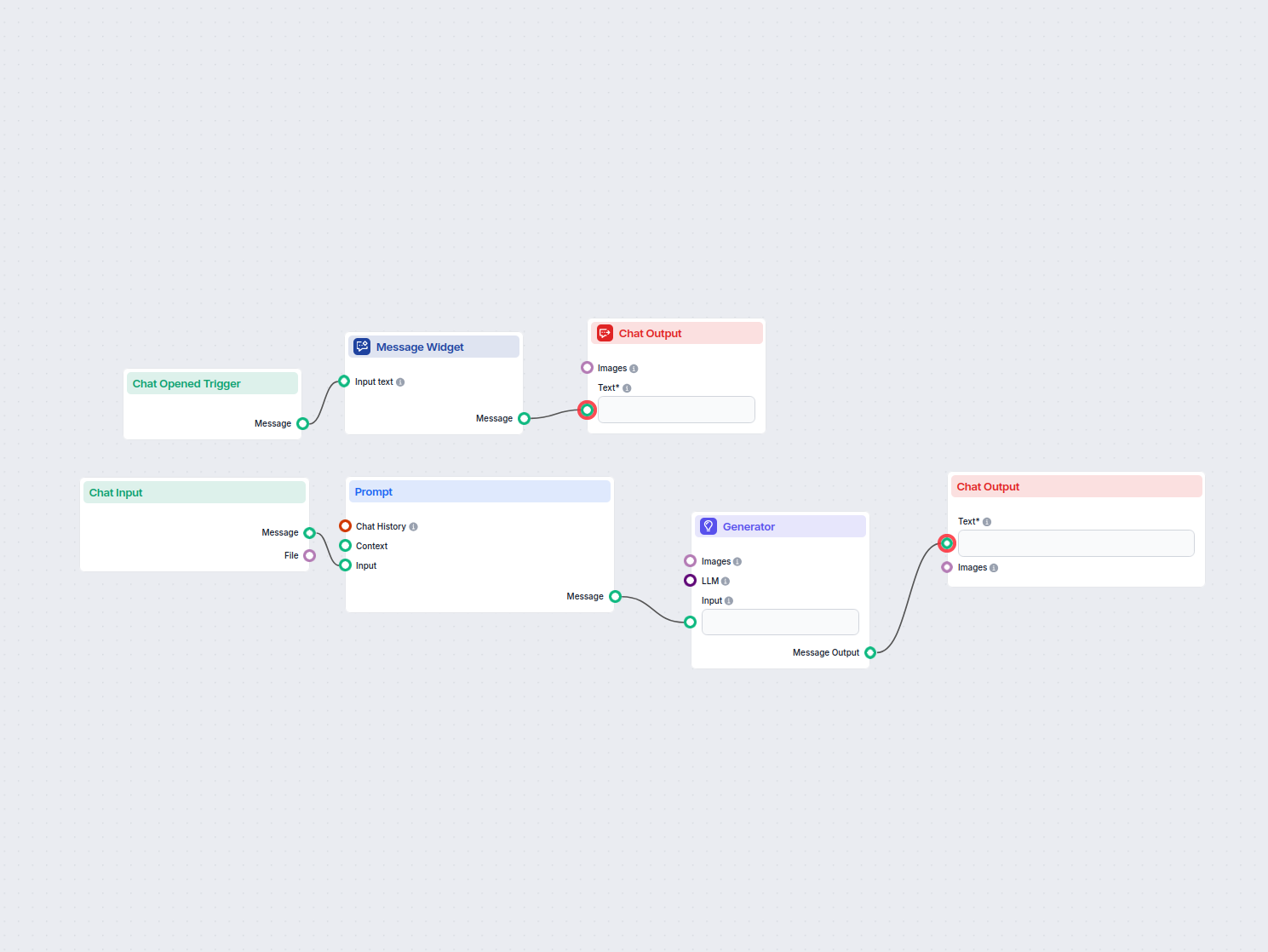

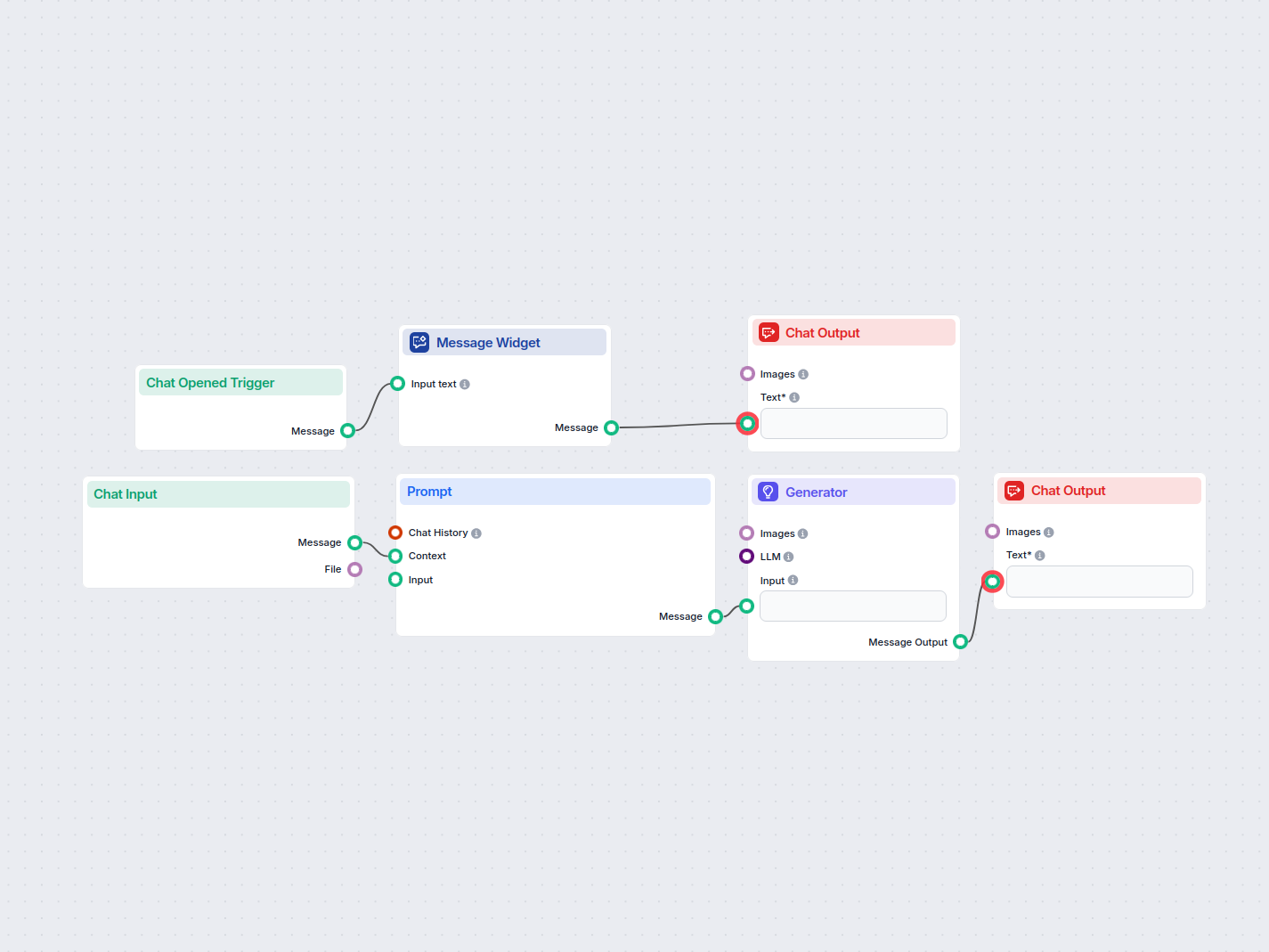

Ein einfacher Workflow für einen KI-Chat-Assistenten, der den bisherigen Gesprächsverlauf nutzt, um relevante Antworten auf Benutzereingaben zu generieren. Enth...

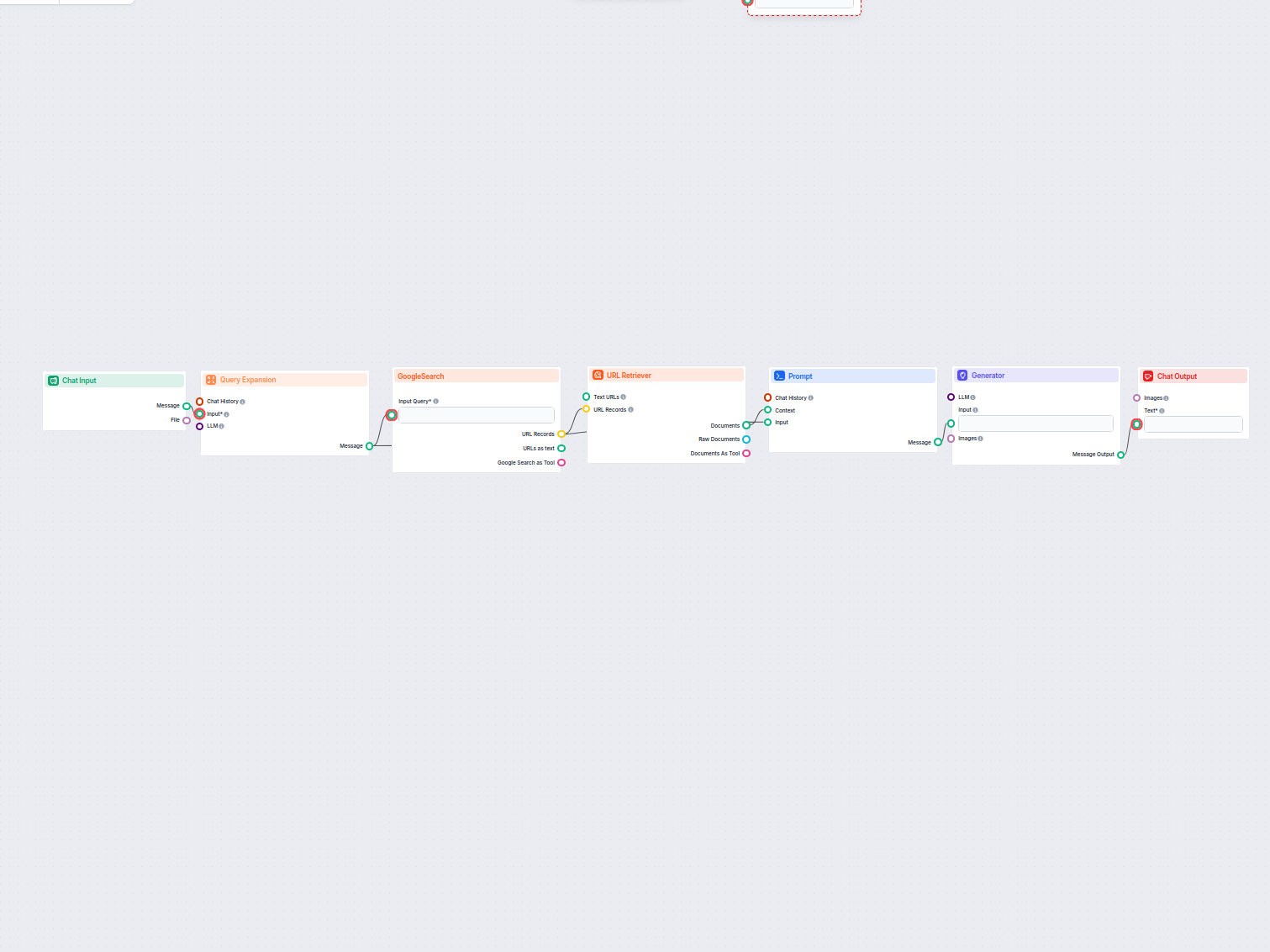

Erstellen Sie einzigartige Content-Ideen und Zusammenfassungen mithilfe von KI, indem Sie die Top-Google-Ergebnisse zu einem beliebigen Keyword recherchieren. I...

Erzeuge hochwertige KI-Bild-Prompts nach bewährten Methoden. Dieser Workflow nimmt Benutzereingaben entgegen, formatiert sie zu einem effektiven Prompt für die ...

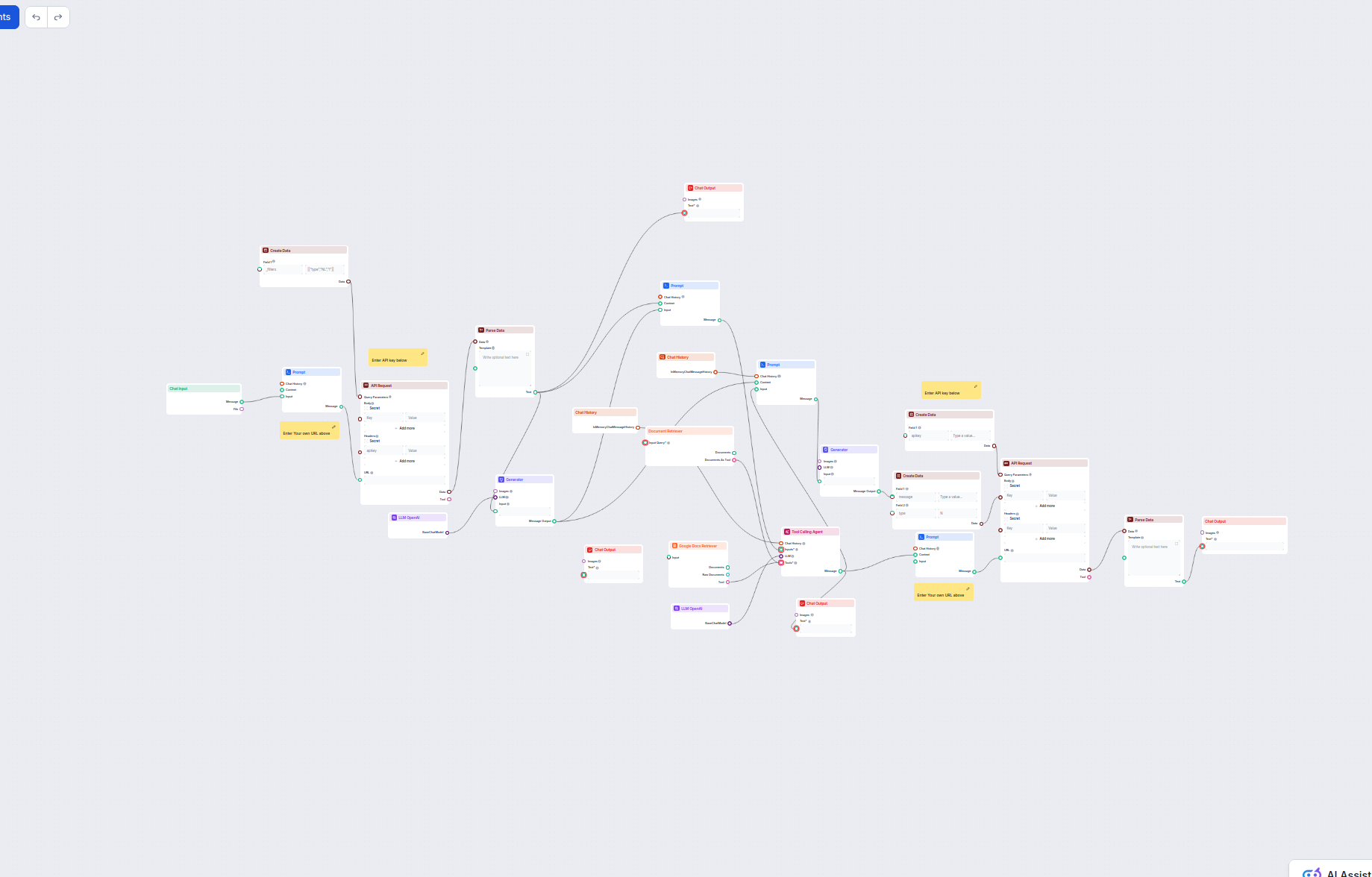

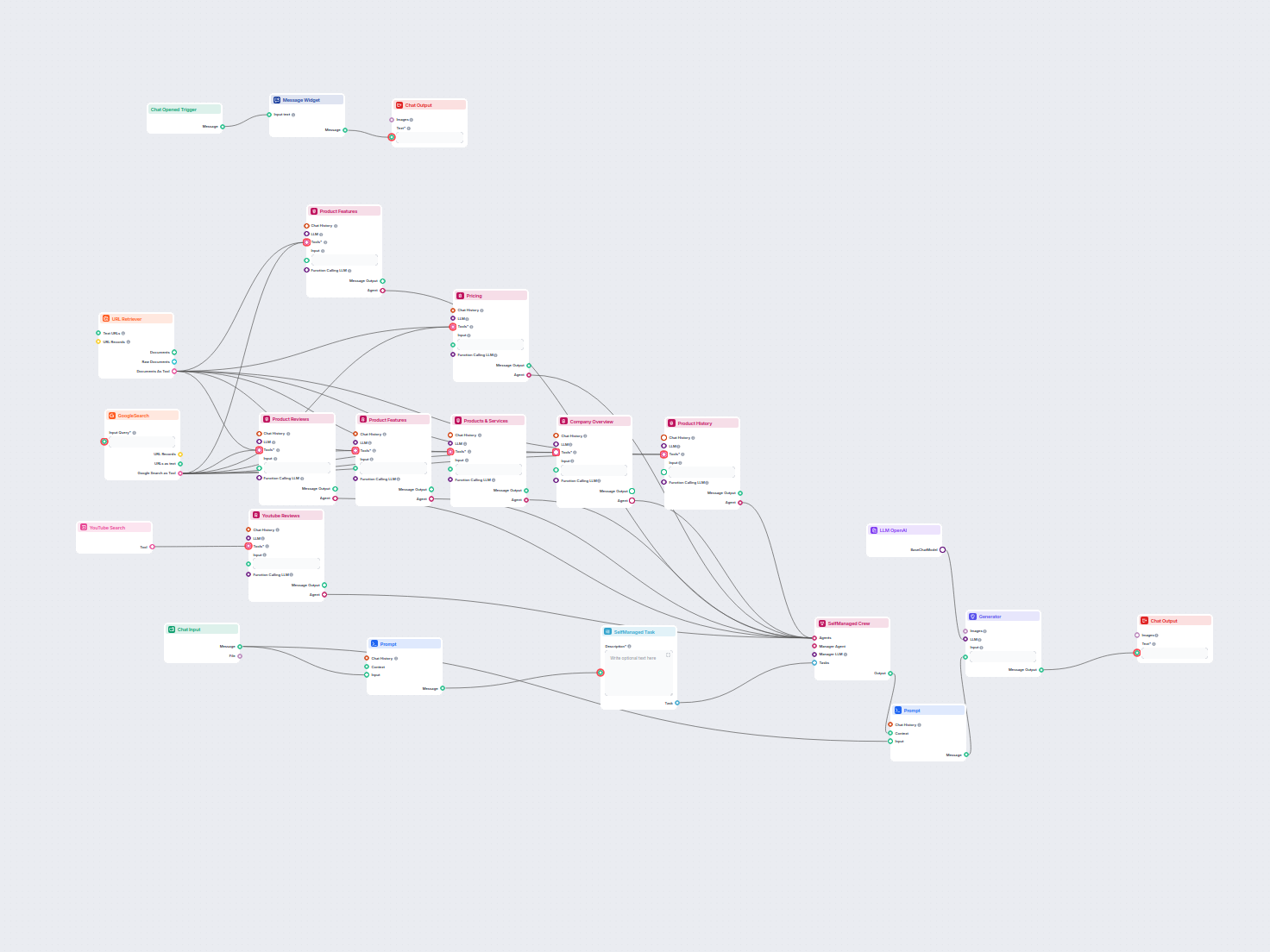

Ein KI-gestützter Kundenservice-Chatbot, der Ihre internen Wissensquellen nutzt, um sofortige, genaue und hilfreiche Antworten auf Kundenanfragen zu liefern. Er...

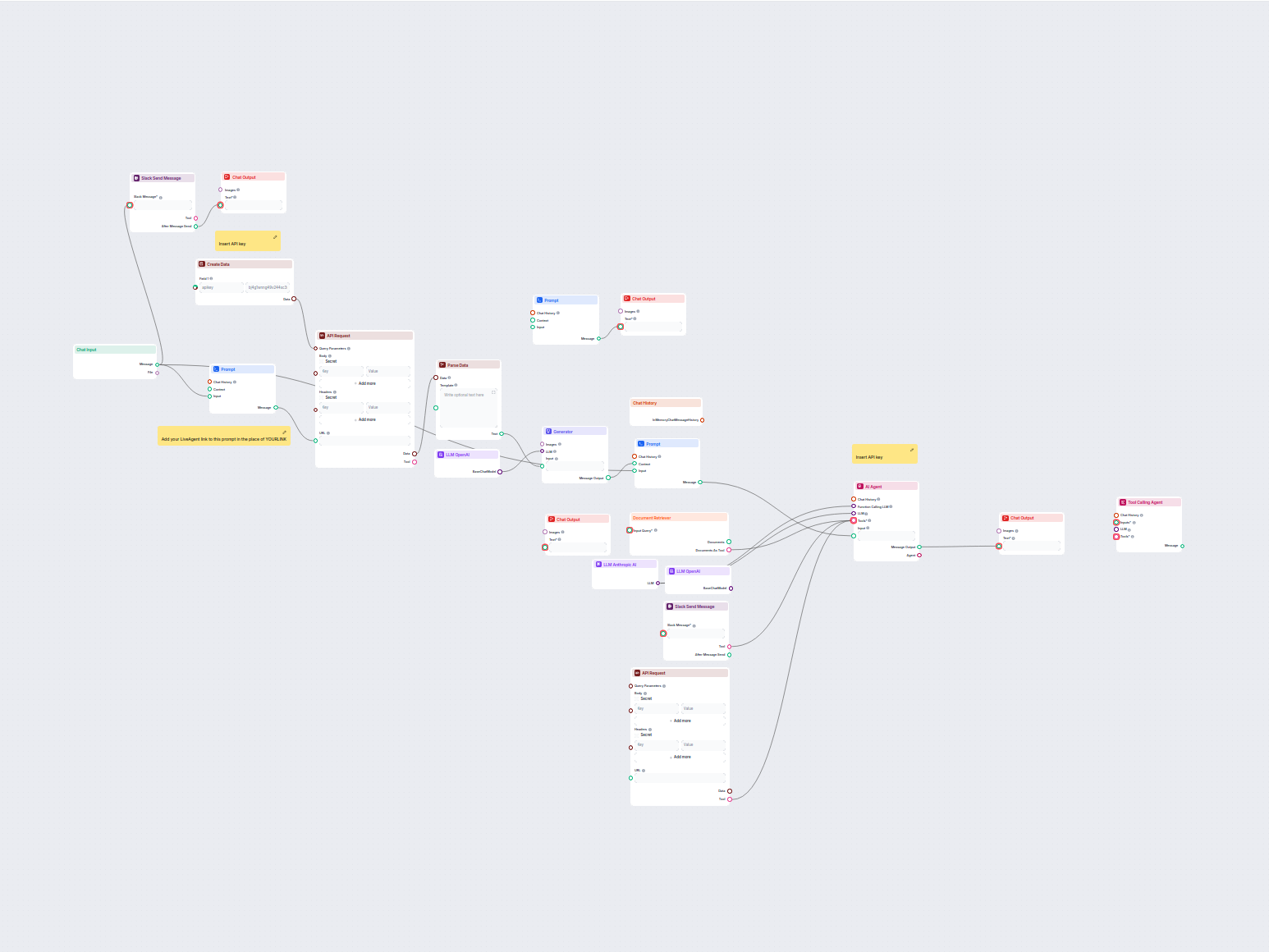

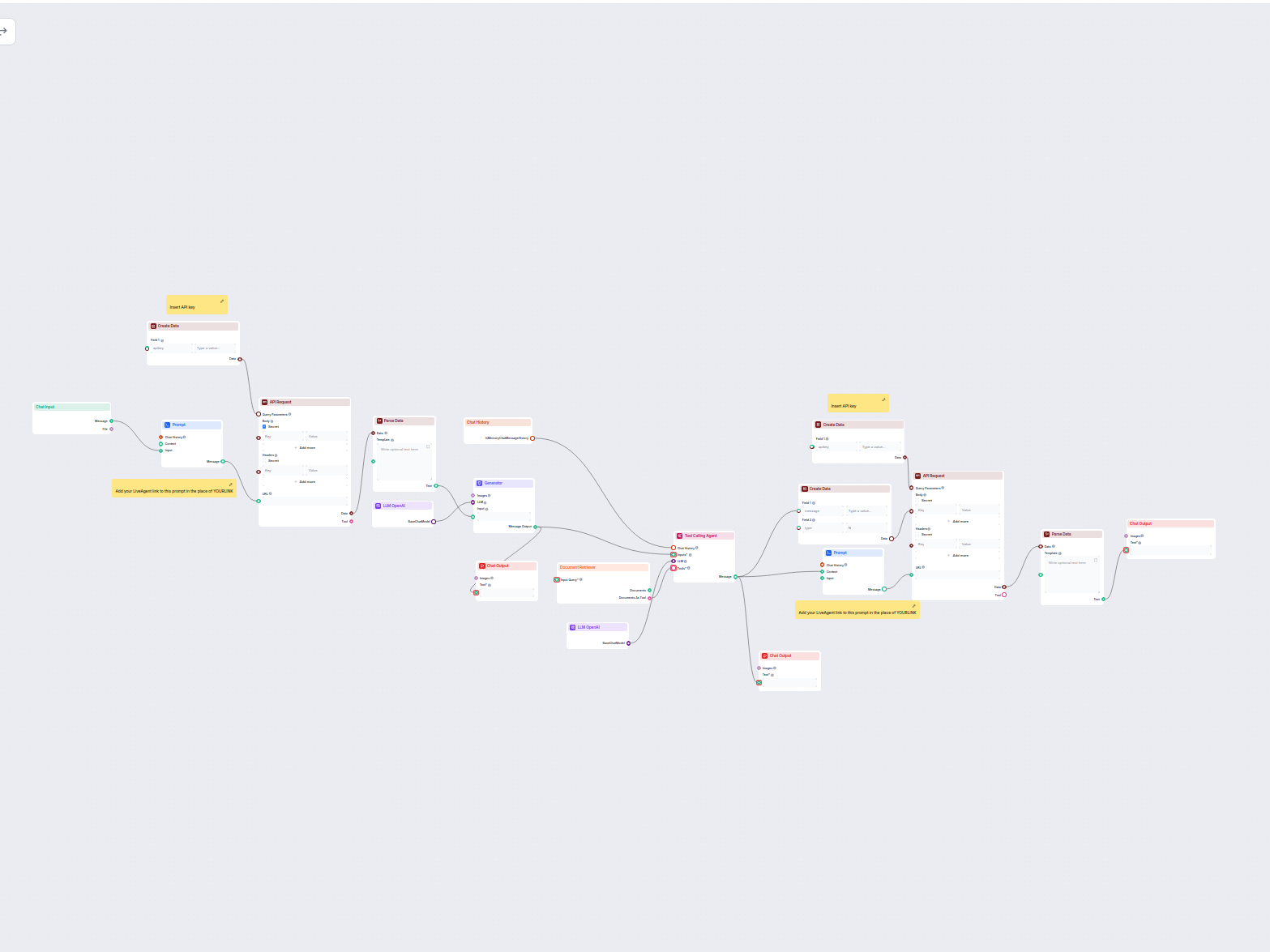

Dieser Workflow automatisiert den Kundensupport für Ihr Unternehmen, indem er LiveAgent-Konversationen integriert, relevante Konversationsdaten extrahiert, Antw...

Dieser KI-gestützte Workflow automatisiert den Kundensupport, indem er Benutzeranfragen mit Wissensquellen des Unternehmens, externen APIs (wie LiveAgent) und e...

Dieser KI-gestützte Workflow automatisiert den Kundensupport durch die Kombination aus interner Wissensdatenbank-Suche, Google Docs-Wissensabruf, API-Integratio...

Erstellt automatisch ein maßgeschneidertes Mission Statement basierend auf Benutzereingaben und Chat-Kontext. Ideal für Startups, Unternehmer und Marketer, die ...

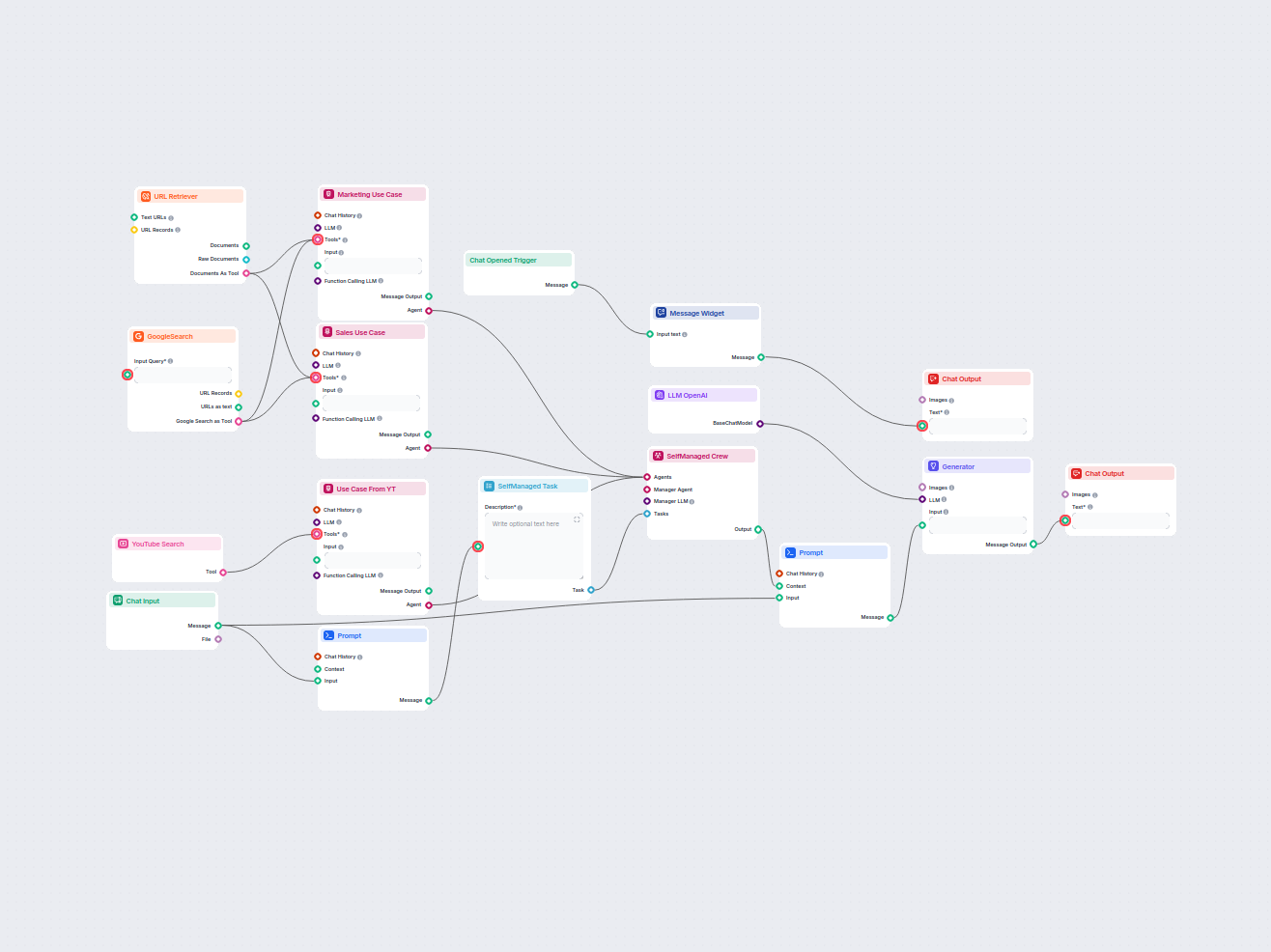

Erstellen Sie umfassende, KI-gesteuerte Berichte zu Anwendungsfällen von Softwareprodukten für Marketing und Vertrieb. Dieser Workflow recherchiert das Produkt ...

Erstellen Sie umfassende Produktanalysen mit KI-Agenten, die Produktinformationen, Preise, Funktionen, Bewertungen, Alternativen und mehr aus öffentlichen Inter...

Erstellt automatisch umsetzbare Meeting-Protokolle und Follow-up-E-Mails aus Ihren Meeting-Anhängen mithilfe von KI und exportiert die Ergebnisse als PDF. Ideal...

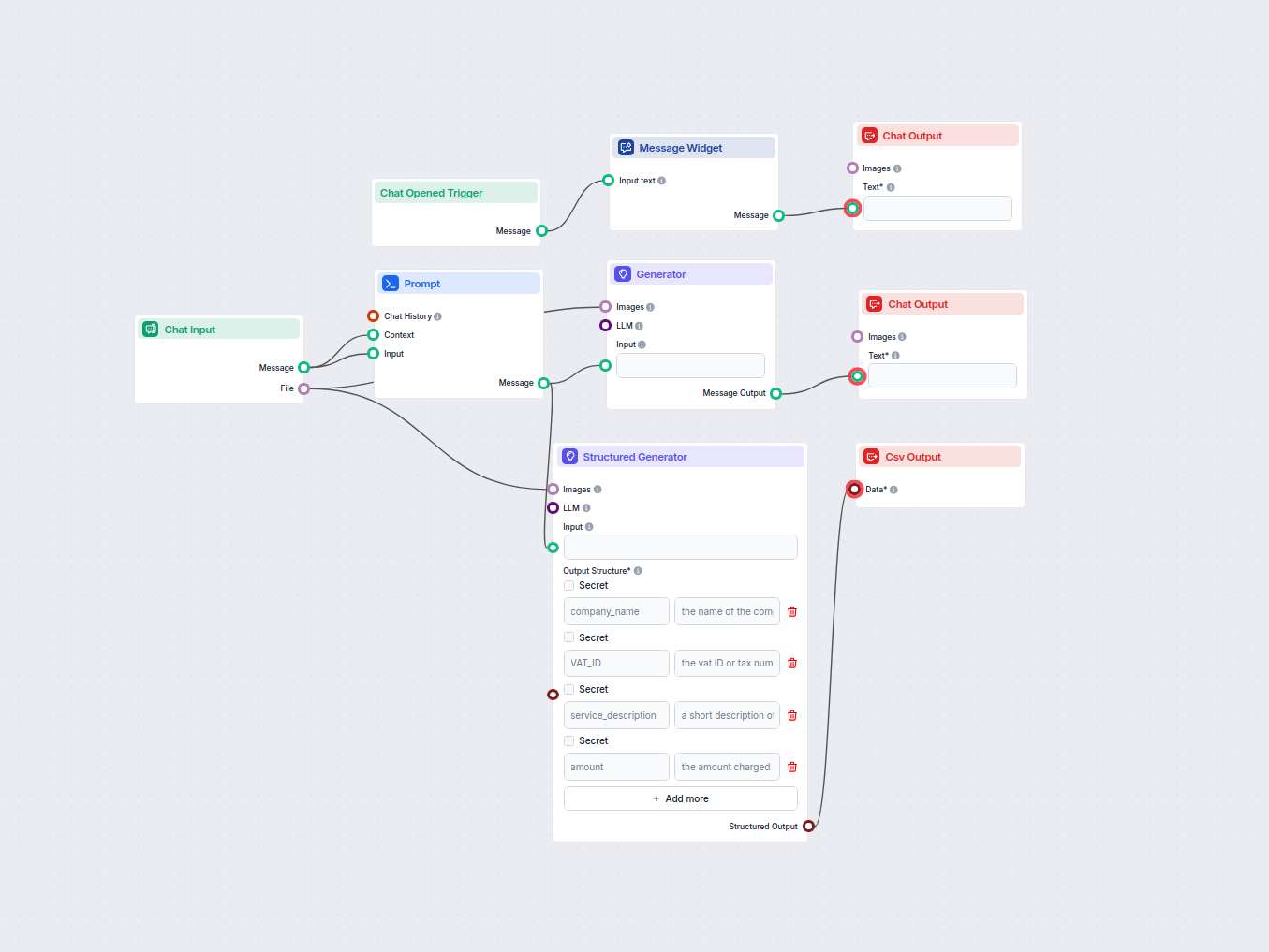

Automatisieren Sie die Rechnungsverarbeitung, indem Sie Rechnungsbilder hochladen und die wichtigsten Rechnungsdaten extrahieren, wie Rechnungsnummer, Typ, Spra...

Erzeugen Sie einzigartige, SEO-optimierte Webseitentitel mit KI und aktuellen Google-Suchdaten. Geben Sie Ihre Ziel-Keywords ein und erhalten Sie einen auf aktu...

Organisiert Ihre Keyword-Liste automatisch mithilfe von KI in Themen-Cluster und erstellt eine strukturierte, leicht analysierbare Tabelle für eine verbesserte ...

Erstellen Sie mühelos ansprechende LinkedIn-Post-Texte aus jeder Webseiten-URL. Dieser automatisierte Workflow extrahiert Inhalte von Ihrer Seite und verwandelt...

Übersetzen Sie Webinhalte zwischen verschiedenen Sprachen und bewahren Sie dabei die HTML-Struktur, mithilfe von KI und UrlsLab-Plugin. E-Mail-Adressen und URLs...

Generiert automatisch Schema.org-Strukturierte Daten im JSON-Format für jede Website-URL und erleichtert so Suchmaschinen das Verständnis und die Indizierung Ih...

Dieser KI-gestützte Workflow analysiert die Inhaltsstruktur Ihrer Webseite, vergleicht sie mit den bestplatzierten Wettbewerberseiten und liefert maßgeschneider...

Verwandeln Sie automatisch jedes YouTube-Video-Transkript in SEO-freundlichen Webseiten-Content. Geben Sie eine YouTube-URL ein und erhalten Sie einen vollständ...

Erstellen Sie mühelos kreative Bildunterschriften mit KI. Laden Sie ein Bild hoch und erhalten Sie sofort eine einprägsame Bildunterschrift – perfekt für sozial...

Erstellen Sie mühelos vollständig formatierte Markdown-Tabellen aus Ihren Eingaben – ideal für Dokumentationen, Präsentationen und Notizen. Dieser KI-gestützte ...

Dieser Workflow ermöglicht es Nutzern, beliebigen eingegebenen Text sofort mithilfe von KI ins Englische zu übersetzen. Nutzer geben Text ein oder laden ihn hoc...

Verwandeln Sie technische Dokumentation von einer URL in einen überzeugenden, SEO-optimierten Artikel für Ihre Website. Dieser Flow analysiert die bestplatziert...

Fassen Sie beliebigen eingegebenen Text mithilfe von KI ganz einfach in prägnante Kernpunkte zusammen. Dieser Workflow nimmt Benutzereingaben entgegen, erstellt...

Erstellen Sie gut strukturierte Webseiteninhalte auf Basis der Analyse der bestplatzierten Google-Seiten für ein beliebiges Keyword. Dieser Flow automatisiert d...

Verwandle jede Artikel- oder Webseiten-URL in einen detaillierten, kreativen Prompt für Text-zu-Bild-Modelle. Dieser Workflow ruft Inhalte von einer angegebenen...

Verwandelt den Inhalt jeder angegebenen URL automatisch in einen prägnanten, ansprechenden Beitrag, der für X (Twitter) geeignet ist, und hilft Vermarktern und ...

Ein KI-Assistent, der Benutzerfragen mit faktenbasierten und gut recherchierten Informationen beantwortet. Dabei nutzt er den RIG-Ansatz, um Antworten in Wikipe...

Erstellen Sie mühelos Download-Links in mehreren Formaten (MP4, Audio, HD usw.) für jedes YouTube-Video über eine einfache Chat-Oberfläche. Der Workflow sammelt...

Erzeugen Sie automatisch SEO-optimierte YouTube-Videotitel, Beschreibungen und Hashtags aus jeder Webseiten-URL. Perfekt für Marketer, Content-Ersteller und Unt...

Die Generator-Komponente erstellt Text, indem sie einen Benutzer-Prompt, eine optionale Systemnachricht und Bilder an ein ausgewähltes großes Sprachmodell (LLM) sendet und eine dynamisch KI-generierte Nachricht zurückgibt.

Ja, Sie können aus verfügbaren LLM-Modellen für Ihre Textgenerierung auswählen und so Flexibilität und Anpassung in Ihrem Workflow ermöglichen.

Ja, Sie können Bilder einbinden, um den Eingabekontext für das Modell zu erweitern und so reichhaltigere und informiertere KI-Antworten zu ermöglichen.

Nein, Systemnachrichten sind optional und können verwendet werden, um das Verhalten oder den Ton des Modells bei Bedarf zu steuern.

Er funktioniert als zentrale Logik-Engine, die Benutzereingaben und Kontextdaten in intelligente, KI-generierte Antworten innerhalb Ihres Chatbots oder Automatisierungsablaufs umwandelt.

Beginnen Sie noch heute mit dem Aufbau intelligenterer Chatbots und Automatisierungs-Workflows mit der Generator-Komponente – nutzen Sie die Kraft fortschrittlicher KI-Textgenerierung.

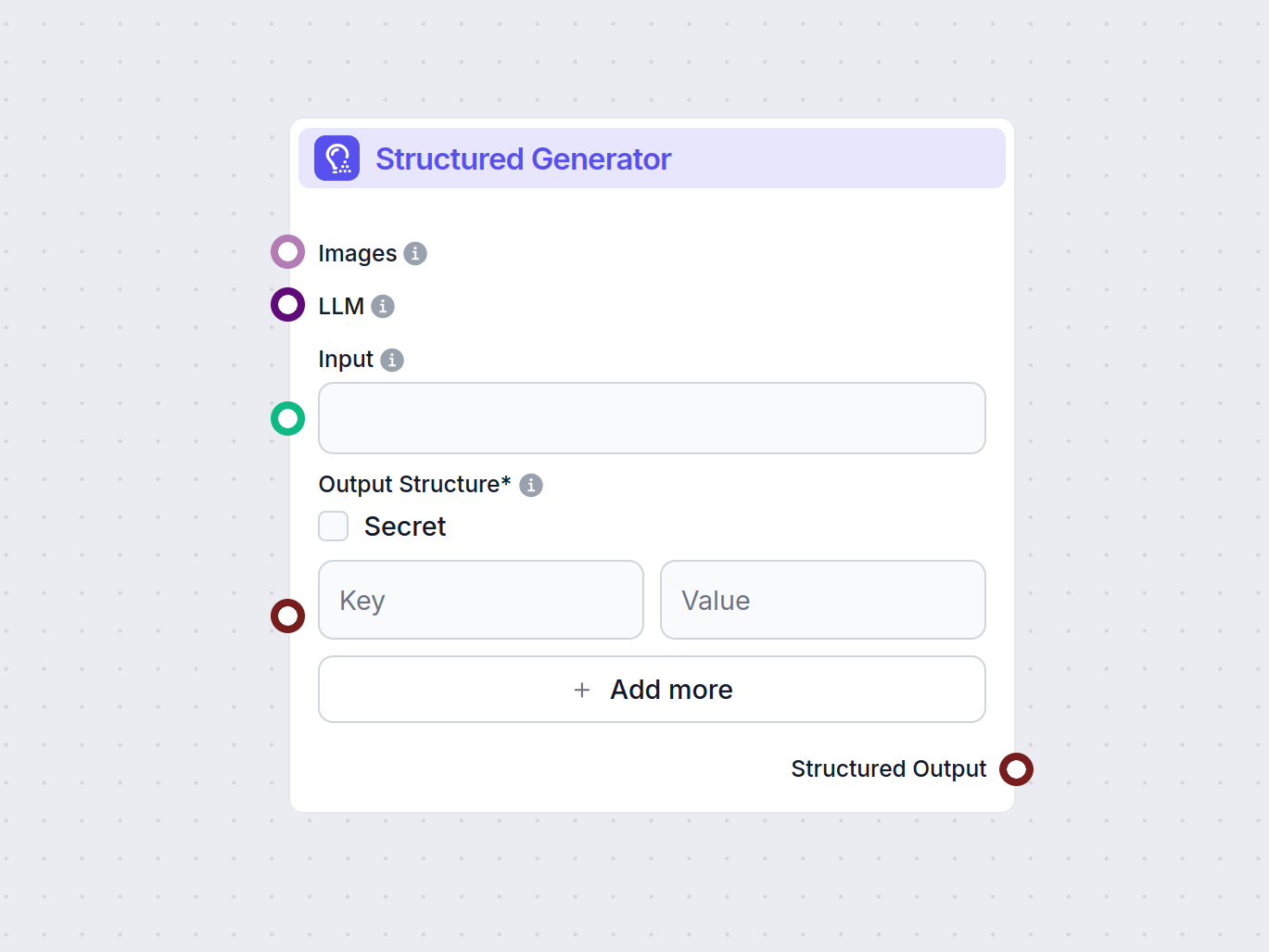

Die Komponente Strukturierter Ausgabe-Generator ermöglicht es Ihnen, mit Ihrem gewählten LLM-Modell präzise und strukturierte Daten aus jeder Eingabeaufforderun...

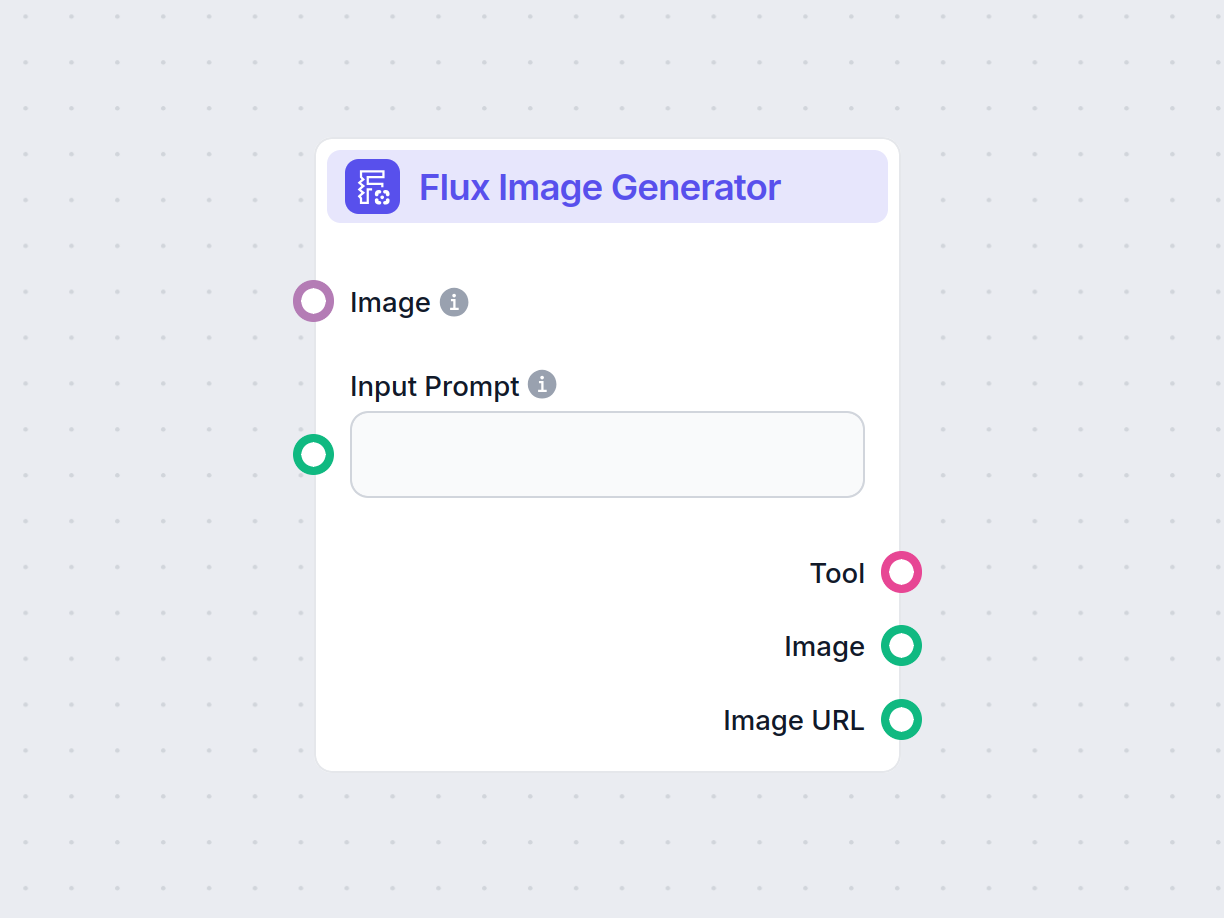

Erzeugen Sie beeindruckende Bilder aus Texteingaben mit der Flux Bildgenerator-Komponente in FlowHunt. Passen Sie das Ergebnis mit Modellauswahl, Bildformat und...

Die Chat Input-Komponente in FlowHunt initiiert Benutzerinteraktionen, indem sie Nachrichten aus dem Playground erfasst. Sie dient als Startpunkt für Flows und ...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.