Cómo un modelo de 7M parámetros está superando a los modelos AI de frontera

Descubre cómo un pequeño modelo de 7 millones de parámetros supera a Gemini, DeepSeek y Claude usando razonamiento recursivo y supervisión profunda. Conoce el e...

Dario Amodei, CEO de Anthropic, se une a Lex Fridman para hablar sobre el futuro de la IA, incluyendo leyes de escalado, cronogramas de AGI, seguridad, interpretabilidad y regulación.

El escalado es importante para crear modelos de IA más efectivos y capaces. La Ley de Escalado es la idea de que aumentar el tamaño de los modelos con más parámetros mejora el rendimiento de la IA. Amodei analiza cómo el escalado afecta las capacidades de los modelos, señalando que los modelos más grandes muestran mejores habilidades de aprendizaje y razonamiento. La discusión resalta la necesidad de equilibrar el tamaño y la eficiencia de las redes neuronales, lo que podría llevar a grandes avances en las aplicaciones de la IA.

Amodei predice que la IA podría alcanzar inteligencia a nivel humano para 2026-2027. Este pronóstico se basa en las tendencias actuales de potencia informática, acceso a datos y el rápido avance de la tecnología de IA. Sus ideas cubren no solo los hitos tecnológicos para lograr este nivel de inteligencia, sino también las cuestiones éticas y filosóficas que lo acompañan.

Un gran desafío es la concentración del poder de la IA en unas pocas entidades fuertes. Amodei advierte que esto puede llevar a un acceso desigual a la tecnología y posibles usos indebidos, agravando las desigualdades globales y amenazando la democracia. Para abordar esto, es necesario una distribución justa de los avances en IA para asegurar que todos se beneficien y ninguna entidad monopolice la tecnología.

Es crucial entender cómo funciona la IA internamente, conocido como interpretabilidad mecanicista, para desplegar la IA de manera segura. Amodei destaca la necesidad de comprender cómo la IA toma decisiones y hace predicciones. Mejorando la transparencia y la interpretabilidad, los investigadores pueden predecir mejor los comportamientos de la IA, detectar sesgos y reducir riesgos, especialmente a medida que estos sistemas se vuelven más autónomos en sectores importantes como la salud, las finanzas y la seguridad nacional.

La jerarquía de modelos es una parte clave del enfoque de IA de Anthropic. Amodei describe cómo los diferentes tamaños de modelos sirven a diversas aplicaciones, desde modelos más pequeños para tareas cotidianas hasta modelos más grandes para necesidades especializadas. Esta estrategia estructurada permite un uso adaptable de la IA en varios campos, asegurando soluciones que se ajusten a los distintos requisitos industriales y sociales.

El marco RSP de Anthropic destaca su dedicación a la seguridad de la IA mediante el escalado responsable. Este marco incluye pasos sistemáticos para escalar modelos de IA, asegurando que a medida que crecen las capacidades de la IA, su uso siga siendo seguro, ético y socialmente responsable. Mediante este enfoque, Anthropic busca abordar los posibles desafíos éticos en el desarrollo de la IA, promoviendo un progreso cuidadoso e innovador.

Regular la IA es crucial para guiar su desarrollo hacia fines positivos y seguros. Amodei aboga por marcos legales integrales para gobernar las tecnologías de IA, enfatizando regulaciones que establezcan estándares claros de seguridad y supervisión. Este enfoque proactivo busca prevenir el mal uso de la IA y al mismo tiempo promover avances tecnológicos que protejan los intereses públicos y el bienestar.

La discusión también aborda los límites causados por la potencia informática y la disponibilidad de datos actuales, que podrían obstaculizar el progreso futuro de la IA. Superar estos límites implica explorar nuevos métodos de cómputo, como la computación cuántica, para apoyar los próximos desarrollos de la IA. Encontrar soluciones sostenibles y escalables para la gestión de datos también es esencial para superar barreras y proteger la privacidad.

Las leyes de escalado de IA se refieren a la tendencia de que aumentar el tamaño y los parámetros de los modelos de IA conduce a un mejor rendimiento. Dario Amodei destaca que los modelos más grandes generalmente muestran mejores habilidades de aprendizaje y razonamiento, pero equilibrar el tamaño con la eficiencia sigue siendo crucial.

Dario Amodei predice que la IA podría alcanzar la inteligencia a nivel humano entre 2026 y 2027, basándose en tendencias de potencia informática, acceso a datos y rápido avance tecnológico.

La interpretabilidad mecanicista es crucial porque ayuda a los investigadores a entender cómo los modelos de IA toman decisiones y hacen predicciones. Esta transparencia permite predecir mejor el comportamiento de la IA, identificar sesgos y reducir riesgos a medida que la IA se vuelve más autónoma en sectores críticos.

Los desafíos clave incluyen la concentración del poder de la IA en pocas entidades, el posible mal uso, las desigualdades globales y las amenazas a la democracia. Garantizar una distribución justa y una escalabilidad responsable de las tecnologías de IA es necesario para mitigar estos desafíos.

Dario Amodei aboga por marcos legales integrales y regulación para establecer estándares claros de seguridad y supervisión en el desarrollo de IA, con el objetivo de prevenir el mal uso mientras se protege el interés público y se promueve el progreso tecnológico responsable.

Viktor Zeman es copropietario de QualityUnit. Incluso después de 20 años liderando la empresa, sigue siendo principalmente un ingeniero de software, especializado en IA, SEO programático y desarrollo backend. Ha contribuido a numerosos proyectos, incluidos LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab y muchos otros.

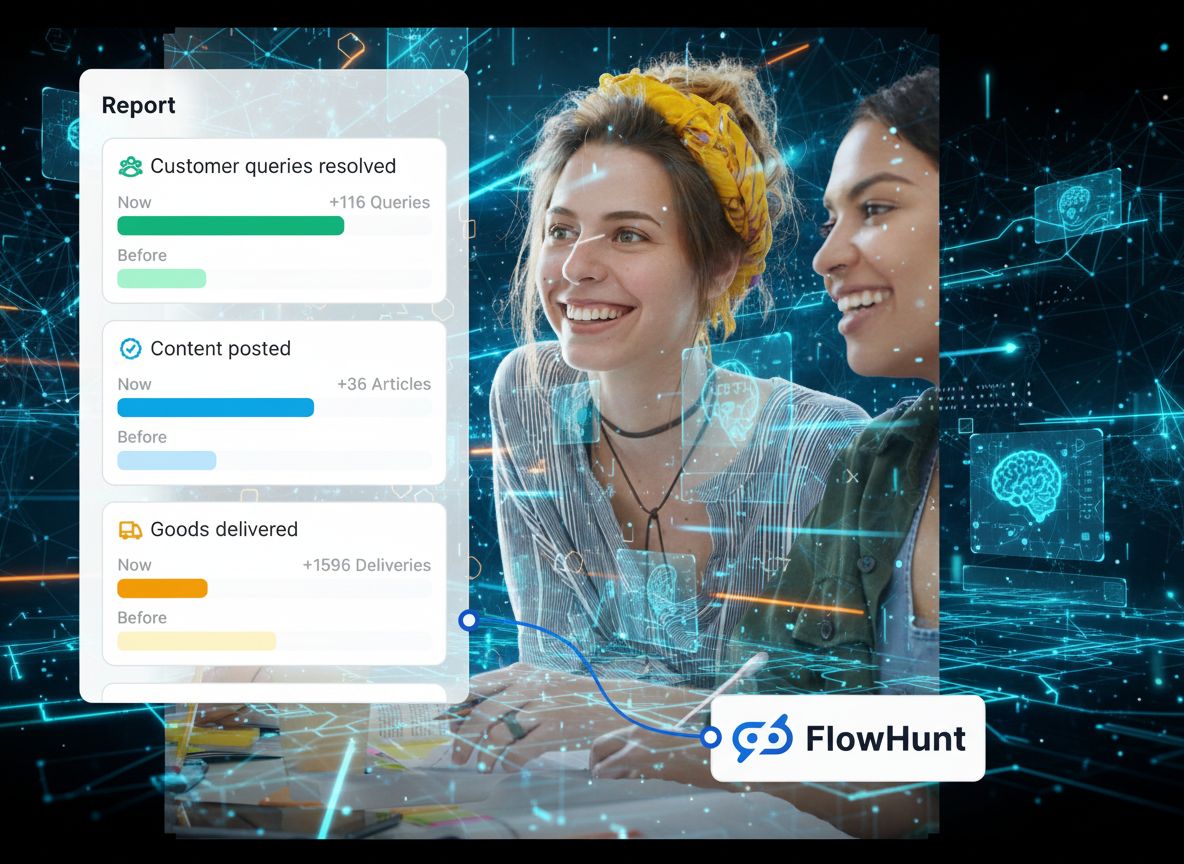

Descubre cómo puedes usar FlowHunt para crear chatbots y herramientas de IA personalizadas. Comienza a construir Flujos automatizados sin esfuerzo.

Descubre cómo un pequeño modelo de 7 millones de parámetros supera a Gemini, DeepSeek y Claude usando razonamiento recursivo y supervisión profunda. Conoce el e...

Explora la perspectiva matizada de Andrej Karpathy sobre los horizontes temporales de la AGI, los agentes de IA y por qué la próxima década será crítica para el...

Explora las capacidades avanzadas de Llama 3.3 70B Versatile 128k como Agente de IA. Esta revisión en profundidad examina sus habilidades de razonamiento, resol...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.