La Décennie des Agents IA : Karpathy sur la feuille de route de l'AGI

Explorez la perspective nuancée d'Andrej Karpathy sur les échéances de l'AGI, les agents IA et pourquoi la prochaine décennie sera décisive pour le développemen...

Dario Amodei, PDG d’Anthropic, rejoint Lex Fridman pour discuter de l’avenir de l’IA, notamment des lois de passage à l’échelle, des échéances de l’AGI, de la sécurité, de l’interprétabilité et de la régulation.

Le passage à l’échelle est essentiel pour rendre les modèles d’IA plus efficaces et performants. La Loi de passage à l’échelle est l’idée selon laquelle l’augmentation de la taille des modèles avec plus de paramètres améliore les performances de l’IA. Amodei explique comment le passage à l’échelle affecte les capacités des modèles, en soulignant que les modèles plus grands manifestent de meilleures aptitudes d’apprentissage et de raisonnement. Cette discussion met en avant la nécessité de trouver un équilibre entre la taille et l’efficacité du réseau de neurones, ce qui pourrait mener à des avancées majeures dans les applications de l’IA.

Amodei prédit que l’IA pourrait atteindre l’intelligence de niveau humain d’ici 2026-2027. Cette prévision repose sur les tendances actuelles en puissance de calcul, en accès aux données et sur le rythme rapide des avancées technologiques en IA. Ses réflexions couvrent non seulement les étapes technologiques pour atteindre ce niveau d’intelligence, mais aussi les questions éthiques et philosophiques qui l’accompagnent.

L’un des principaux défis est la concentration du pouvoir de l’IA entre quelques grandes entités. Amodei avertit que cela peut conduire à un accès inégal à la technologie et à des usages abusifs, aggravant les inégalités mondiales et menaçant la démocratie. Pour y remédier, une distribution équitable des avancées de l’IA est nécessaire afin de garantir que tous en bénéficient et qu’aucune entité ne monopolise la technologie.

Il est crucial de comprendre le fonctionnement interne de l’IA, appelé interprétabilité mécaniste, pour un déploiement sûr. Amodei insiste sur la nécessité de comprendre comment l’IA prend des décisions et fait des prédictions. En améliorant la transparence et l’interprétabilité, les chercheurs peuvent mieux prévoir les comportements de l’IA, détecter les biais et réduire les risques, surtout à mesure que ces systèmes deviennent plus autonomes dans des secteurs importants comme la santé, la finance ou la sécurité nationale.

La hiérarchie des modèles est un élément clé de l’approche d’Anthropic en matière d’IA. Amodei décrit comment différentes tailles de modèles répondent à des besoins variés, des plus petits pour les tâches quotidiennes aux plus grands pour des besoins spécialisés. Cette stratégie structurée permet une utilisation adaptable de l’IA dans divers domaines, garantissant des solutions adaptées aux besoins des industries et de la société.

Le cadre RSP (Responsible Scaling Plans) d’Anthropic met en avant leur engagement pour la sécurité de l’IA via un passage à l’échelle responsable. Ce cadre inclut des étapes systématiques pour agrandir les modèles d’IA, en veillant à ce que l’augmentation des capacités s’accompagne d’une utilisation sûre, éthique et socialement responsable. Par cette approche, Anthropic entend répondre aux enjeux éthiques du développement de l’IA, en favorisant un progrès réfléchi et innovant.

Réguler l’IA est essentiel pour orienter son développement vers des finalités positives et sûres. Amodei plaide pour des cadres juridiques complets afin de réguler les technologies de l’IA, mettant l’accent sur des normes de sécurité claires et une supervision appropriée. Cette démarche proactive vise à prévenir les abus de l’IA tout en encourageant des avancées technologiques qui protègent l’intérêt général et le bien-être public.

La discussion aborde également les limites imposées par la puissance de calcul et la disponibilité des données actuelles, qui pourraient freiner les progrès futurs de l’IA. Surmonter ces obstacles implique d’explorer de nouvelles méthodes de calcul, comme l’informatique quantique, pour accompagner les prochaines évolutions de l’IA. Trouver des solutions de gestion des données à la fois durables et évolutives est aussi essentiel pour dépasser ces barrières tout en garantissant la protection de la vie privée.

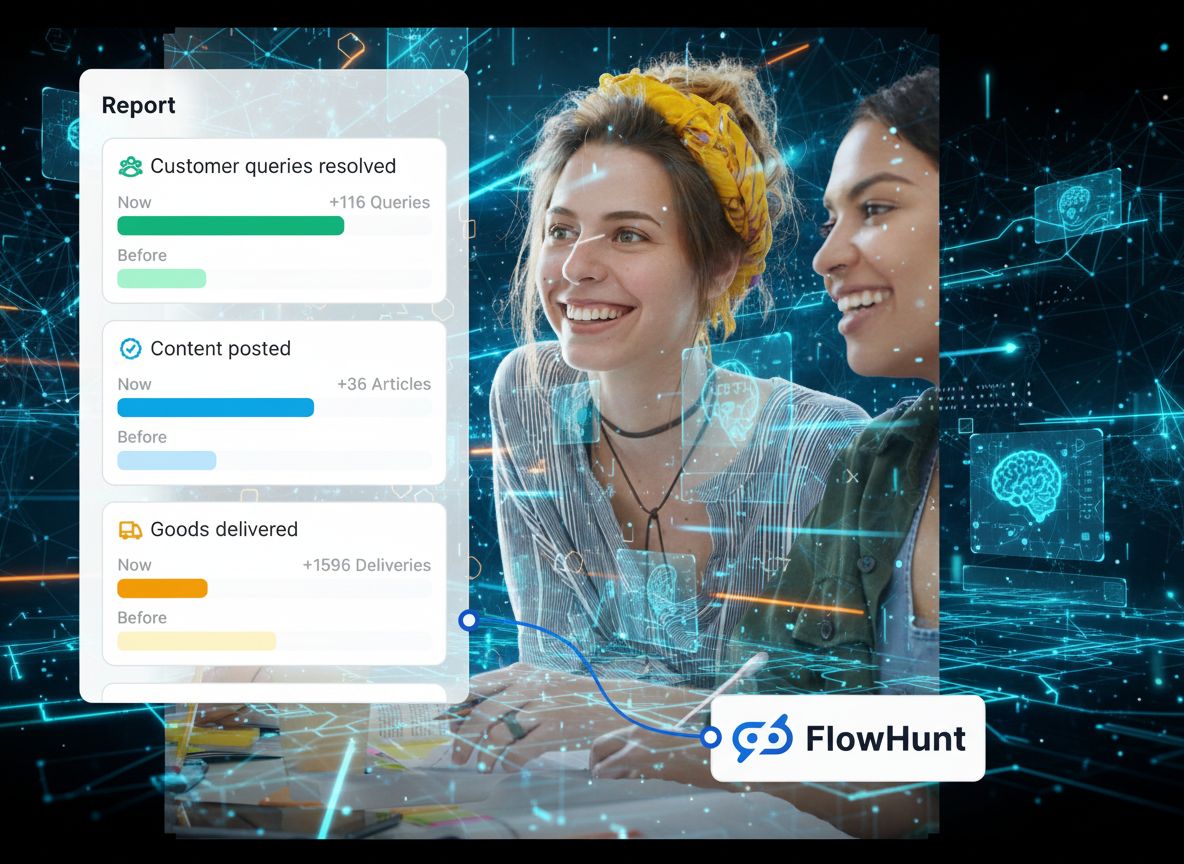

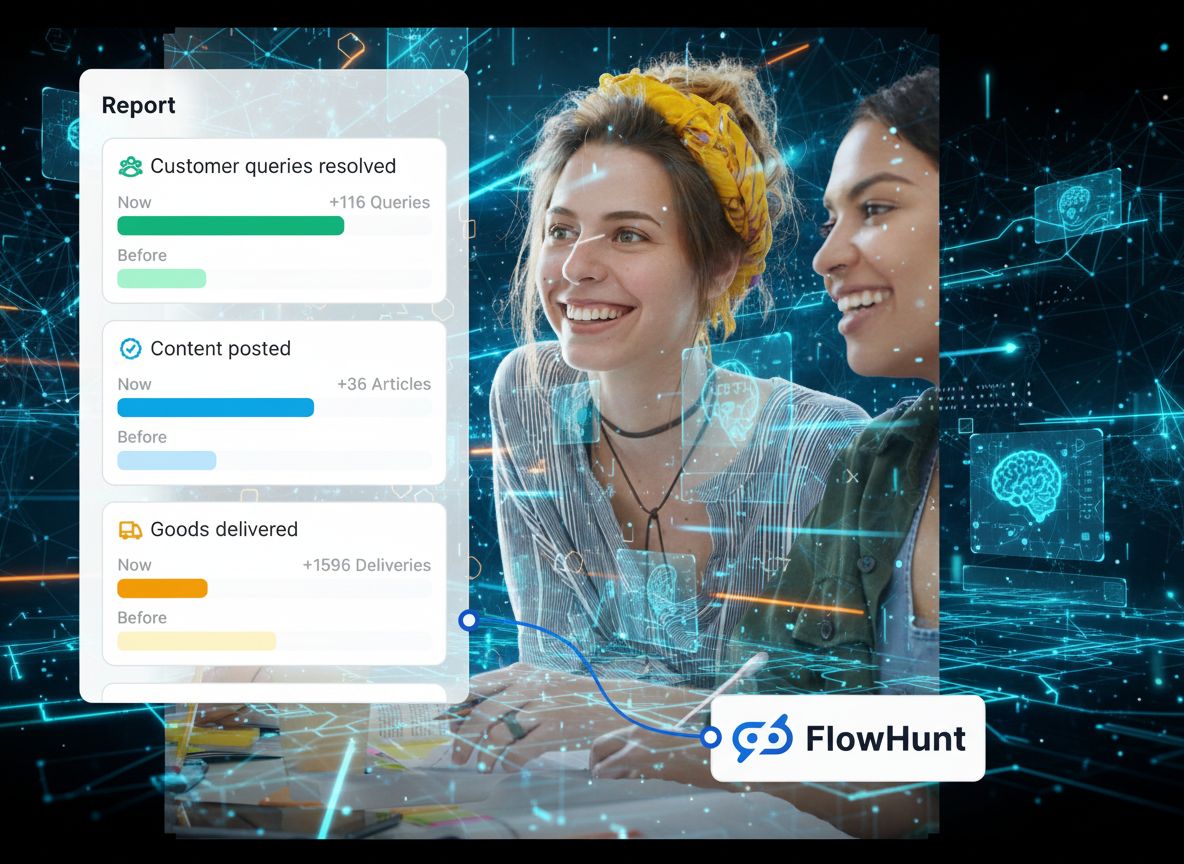

Viktor Zeman est co-propriétaire de QualityUnit. Même après 20 ans à la tête de l'entreprise, il reste avant tout un ingénieur logiciel, spécialisé en IA, SEO programmatique et développement back-end. Il a contribué à de nombreux projets, dont LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab et bien d'autres.

Découvrez comment utiliser FlowHunt pour créer des chatbots et outils d’IA personnalisés. Commencez à créer des Flows automatisés sans effort.

Explorez la perspective nuancée d'Andrej Karpathy sur les échéances de l'AGI, les agents IA et pourquoi la prochaine décennie sera décisive pour le développemen...

Explorez les préoccupations de Jack Clark, cofondateur d’Anthropic, sur la sécurité de l’IA, la conscience situationnelle des grands modèles de langage et le pa...

Découvrez comment les modèles du monde représentent la prochaine avancée majeure en IA, permettant aux machines de comprendre l’intelligence spatiale, de prédir...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.