Deceniul Agenților AI: Karpathy despre calendarul AGI

Explorează perspectiva nuanțată a lui Andrej Karpathy asupra calendarului AGI, agenților AI și de ce următorul deceniu va fi critic pentru dezvoltarea inteligen...

Dario Amodei, CEO al Anthropic, se alătură lui Lex Fridman pentru a discuta despre viitorul AI, inclusiv legile de scalare, orizonturile AGI, siguranță, interpretabilitate și reglementare.

Scalarea este importantă pentru crearea unor modele AI mai eficiente și mai capabile. Legea de scalare este ideea conform căreia mărirea dimensiunii modelelor, cu mai mulți parametri, îmbunătățește performanța AI. Amodei discută despre modul în care scalarea influențează capacitățile modelelor, subliniind că modelele mai mari demonstrează abilități superioare de învățare și raționament. Discuția evidențiază necesitatea de a echilibra dimensiunea și eficiența rețelelor neuronale, fapt care poate duce la progrese majore în aplicațiile AI.

Amodei prezice că AI ar putea atinge inteligența la nivel uman până în 2026-2027. Această prognoză se bazează pe tendințele actuale ale puterii de calcul, accesului la date și avansului rapid al tehnologiei AI. Perspectivele sale acoperă nu doar etapele tehnologice pentru atingerea acestui nivel de inteligență, ci și întrebările etice și filosofice care îl însoțesc.

O provocare majoră este concentrarea puterii AI în cadrul câtorva entități puternice. Amodei avertizează că acest lucru poate duce la acces inegal la tehnologie și la posibile utilizări abuzive, accentuând inegalitățile globale și amenințând democrația. Pentru a combate aceste riscuri, este necesară o distribuție echitabilă a progresului AI, astfel încât toată lumea să beneficieze și nicio entitate să nu monopolizeze tehnologia.

Este esențial să înțelegem modul intern de funcționare al AI, cunoscut sub numele de interpretabilitate mecanistică, pentru a implementa AI în siguranță. Amodei subliniază necesitatea de a înțelege cum ia AI decizii și emite predicții. Prin creșterea transparenței și a interpretabilității, cercetătorii pot anticipa mai bine comportamentele AI, pot identifica prejudecăți și pot reduce riscurile, mai ales pe măsură ce aceste sisteme devin tot mai autonome în sectoare importante precum sănătatea, finanțele și securitatea națională.

Ierarhia modelelor este o componentă cheie a abordării AI de la Anthropic. Amodei descrie modul în care dimensiunile diferite ale modelelor răspund diverselor aplicații, de la modele mai mici pentru sarcini cotidiene la modele mari, pentru nevoi specializate. Această strategie structurată permite folosirea adaptabilă a AI în diferite domenii, asigurând soluții potrivite pentru cerințele variate ale industriei și societății.

Cadrul RSP al Anthropic evidențiază angajamentul lor față de siguranța AI prin scalare responsabilă. Acest cadru include pași sistematici pentru scalarea modelelor AI, asigurând că, pe măsură ce capacitățile AI cresc, utilizarea lor rămâne sigură, etică și responsabilă social. Prin această abordare, Anthropic urmărește să răspundă provocărilor etice potențiale în dezvoltarea AI, promovând un progres atent și inovator.

Reglementarea AI este esențială pentru a ghida dezvoltarea acesteia spre rezultate pozitive și sigure. Amodei pledează pentru adoptarea unor cadre legale cuprinzătoare pentru reglementarea tehnologiilor AI, punând accent pe reguli care stabilesc standarde clare de siguranță și supraveghere. Această abordare proactivă urmărește să prevină utilizarea abuzivă a AI, promovând în același timp progrese tehnologice care protejează interesele și bunăstarea publică.

Discuția abordează și limitele impuse de puterea de calcul și disponibilitatea datelor, care pot încetini progresul AI în viitor. Depășirea acestor obstacole implică explorarea unor noi metode de calcul, precum calculul cuantic, pentru a susține următoarele dezvoltări AI. Găsirea unor soluții sustenabile și scalabile de gestionare a datelor este, de asemenea, esențială pentru depășirea barierelor, protejând în același timp confidențialitatea.

Viktor Zeman este co-proprietar al QualityUnit. Chiar și după 20 de ani de conducere a companiei, rămâne în primul rând un inginer software, specializat în AI, SEO programatic și dezvoltare backend. A contribuit la numeroase proiecte, inclusiv LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab și multe altele.

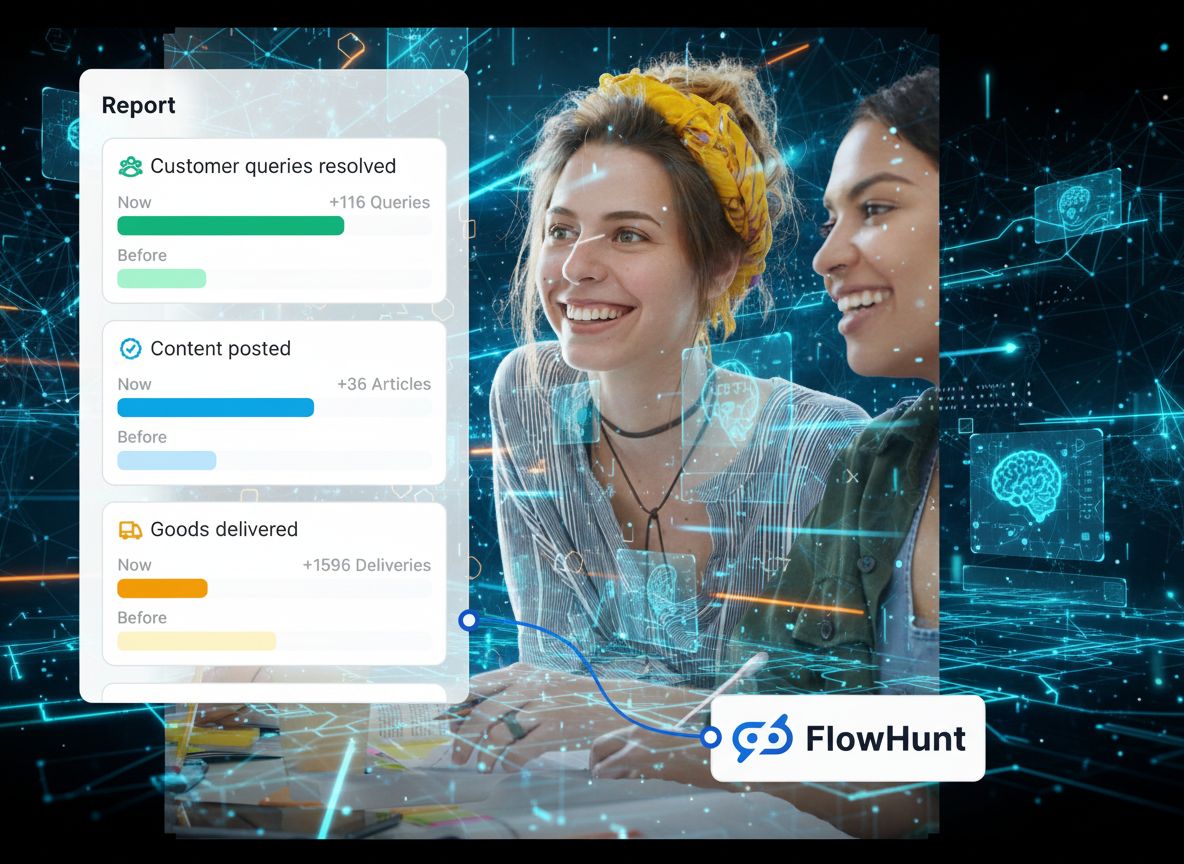

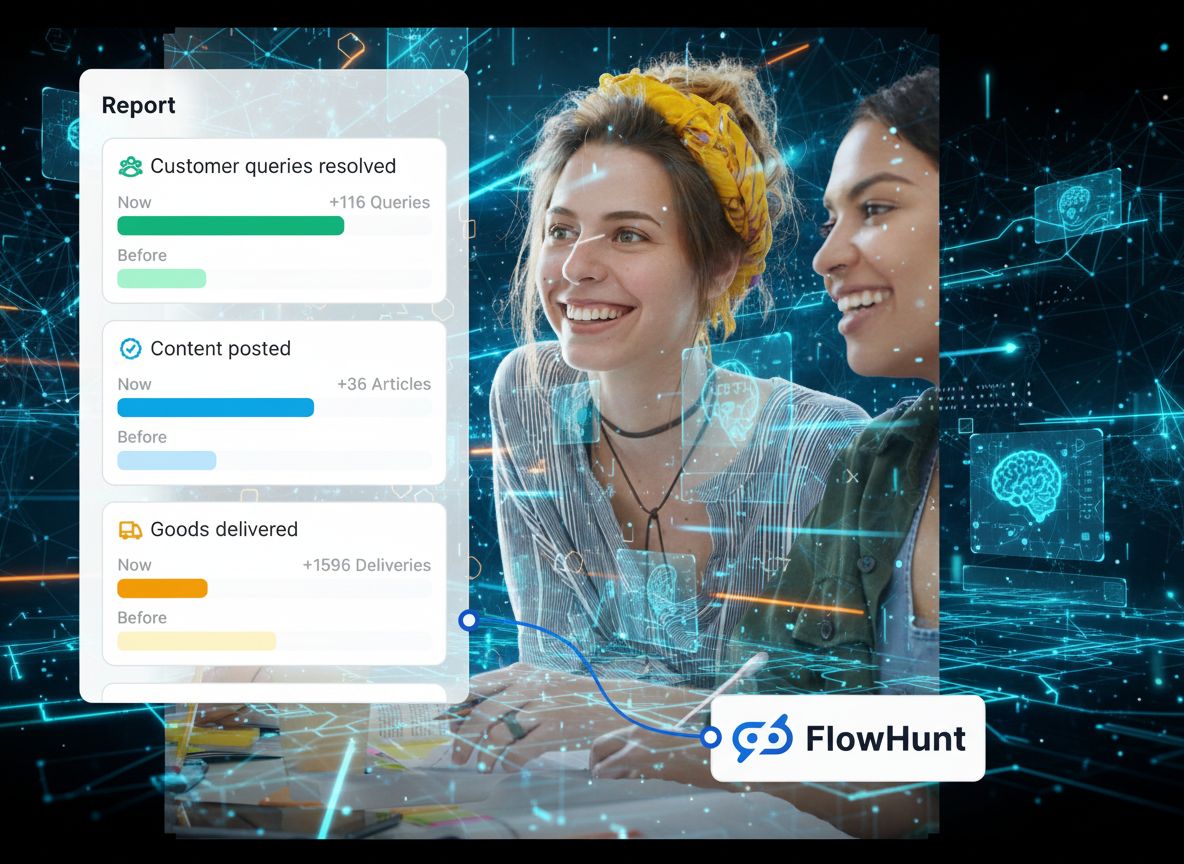

Descoperă cum poți folosi FlowHunt pentru a crea chatbot-uri și instrumente AI personalizate. Începe să construiești Flows automatizate fără efort.

Explorează perspectiva nuanțată a lui Andrej Karpathy asupra calendarului AGI, agenților AI și de ce următorul deceniu va fi critic pentru dezvoltarea inteligen...

Explorați îngrijorările cofondatorului Anthropic, Jack Clark, despre siguranța AI, conștientizarea situațională în modelele lingvistice mari și peisajul de regl...

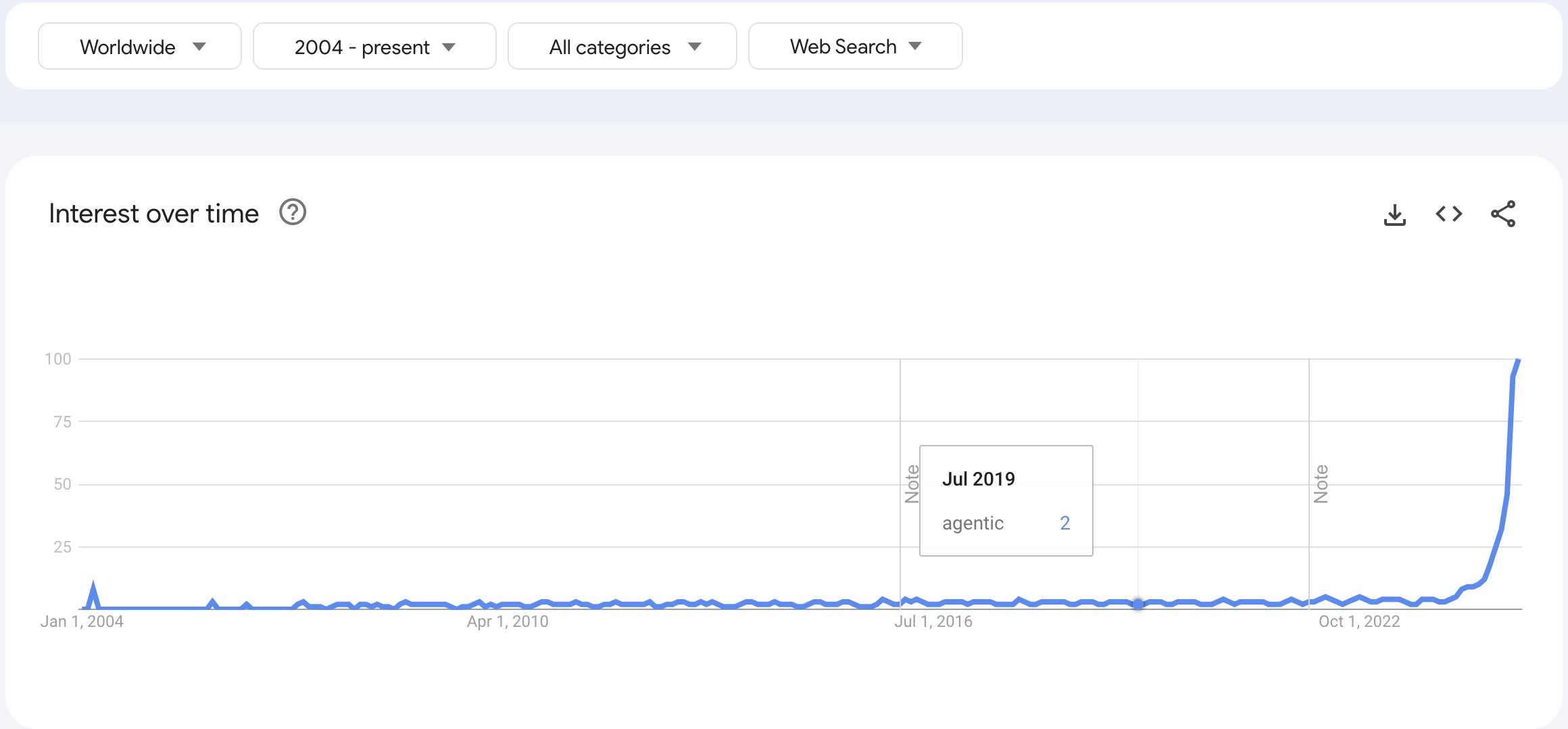

Explorează principalele tendințe AI pentru 2025, inclusiv ascensiunea agenților AI și a echipelor AI, și descoperă cum aceste inovații transformă industriile pr...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.