Yapay Zekâ Ajanlarının On Yılı: Karpathy'nin AGI Zaman Çizelgesi Üzerine

Andrej Karpathy'nin AGI zaman çizelgeleri, yapay zekâ ajanları ve önümüzdeki on yılın yapay zekâ gelişimi açısından neden kritik olacağına dair incelikli bakış ...

Anthropic CEO’su Dario Amodei, Lex Fridman ile yapay zekânın geleceğini; ölçekleme yasalarını, AGI zaman çizelgelerini, güvenlik, yorumlanabilirlik ve düzenlemeyi tartışmak için bir araya geliyor.

Ölçekleme, daha etkili ve yetenekli yapay zekâ modelleri oluşturmak için önemlidir. Ölçekleme Yasası, parametre sayısı arttıkça modellerin performansının iyileştiği fikridir. Amodei, ölçeklemenin model yeteneklerine nasıl etki ettiğini tartışarak, daha büyük modellerin daha iyi öğrenme ve akıl yürütme yetenekleri sergilediğini belirtiyor. Tartışmada, boyut ile sinir ağı verimliliği arasında denge kurulmasının gerekliliği vurgulanıyor ve bu dengenin yapay zekâ uygulamalarında büyük ilerlemelere yol açabileceğine dikkat çekiliyor.

Amodei, yapay zekânın 2026-2027 yıllarında insan seviyesinde zekâya ulaşabileceğini öngörüyor. Bu öngörü, mevcut bilgi işlem gücü, veri erişimi ve yapay zekâ teknolojisindeki hızlı gelişim trendlerine dayanıyor. Onun içgörüleri, bu zekâ seviyesine ulaşmak için teknolojik kilometre taşlarının yanı sıra beraberinde gelen etik ve felsefi soruları da kapsıyor.

Başlıca zorluklardan biri, yapay zekâ gücünün birkaç güçlü kurumda toplanmasıdır. Amodei, bunun teknolojiye erişimde eşitsizlik ve olası kötüye kullanıma yol açabileceği, küresel eşitsizlikleri artırıp demokrasiyi tehdit edebileceği konusunda uyarıyor. Bunun üstesinden gelmek için, yapay zekâ ilerlemelerinin adil şekilde dağıtılması ve kimsenin teknolojinin tekeline sahip olmamasının sağlanması gereklidir.

Yapay zekânın nasıl çalıştığını, yani mekanik yorumlanabilirliğini anlamak, yapay zekâyı güvenli bir şekilde kullanabilmek için çok önemlidir. Amodei, yapay zekânın nasıl kararlar verdiğini ve tahminlerde bulunduğunu kavramanın gerekliliğini vurguluyor. Şeffaflık ve yorumlanabilirlik arttıkça, araştırmacılar yapay zekânın davranışlarını daha iyi öngörebilir, önyargıları tespit edebilir ve özellikle sağlık, finans ve ulusal güvenlik gibi önemli sektörlerde bu sistemler daha özerk hale geldikçe riskleri azaltabilir.

Model hiyerarşisi, Anthropic’in yapay zekâ yaklaşımının temel bir parçasıdır. Amodei, farklı model boyutlarının farklı uygulamalara nasıl hizmet ettiğini anlatıyor; küçük modeller günlük işler için, daha büyük modeller ise özel ihtiyaçlar için kullanılıyor. Bu yapılandırılmış strateji, çeşitli alanlarda uyarlanabilir yapay zekâ kullanımı sağlarken, farklı sektör ve toplumsal ihtiyaçlara uygun çözümler üretilmesini mümkün kılıyor.

Anthropic’in RSP çerçevesi, yapay zekâ güvenliğine olan bağlılıklarını sorumlu ölçekleme yoluyla vurguluyor. Bu çerçeve, yapay zekâ modellerinin ölçeklenmesi için sistematik adımlar içeriyor ve yapay zekâ yetenekleri büyüdükçe kullanımının güvenli, etik ve toplumsal açıdan sorumlu kalmasını sağlıyor. Bu yaklaşımla Anthropic, yapay zekâ geliştirmedeki olası etik sorunları ele almayı ve dikkatli, yenilikçi bir ilerlemeyi teşvik etmeyi amaçlıyor.

Yapay zekânın geliştirilmesini olumlu ve güvenli bir yöne yönlendirmek için düzenleme çok önemlidir. Amodei, yapay zekâ teknolojilerini düzenleyecek kapsamlı yasal çerçeveleri savunuyor ve net güvenlik standartları ile denetimi vurguluyor. Bu proaktif yaklaşım, kamu yararını ve refahını koruyan teknolojik ilerlemeleri teşvik ederken, yapay zekânın kötüye kullanımını önlemeyi amaçlıyor.

Tartışmada ayrıca, mevcut bilgi işlem gücü ve veri erişiminin neden olduğu sınırların, yapay zekânın gelecekteki ilerlemesini engelleyebileceğine değiniliyor. Bu sınırlamaların aşılması, yeni hesaplama yöntemlerinin (örneğin kuantum bilişim) keşfedilmesini ve bir sonraki yapay zekâ gelişmelerini desteklemeyi gerektiriyor. Aynı zamanda, sürdürülebilir ve ölçeklenebilir veri yönetimi çözümleri bulmak ve gizliliği korumak da bu engellerin aşılmasında temel öneme sahip.

Viktor Zeman, QualityUnit'in ortaklarından biridir. Şirketi 20 yıl boyunca yönettikten sonra bile, öncelikli olarak bir yazılım mühendisi olarak kalmaya devam etmektedir; yapay zeka, programatik SEO ve arka uç geliştirme konularında uzmanlaşmıştır. LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab ve daha birçok projeye katkıda bulunmuştur.

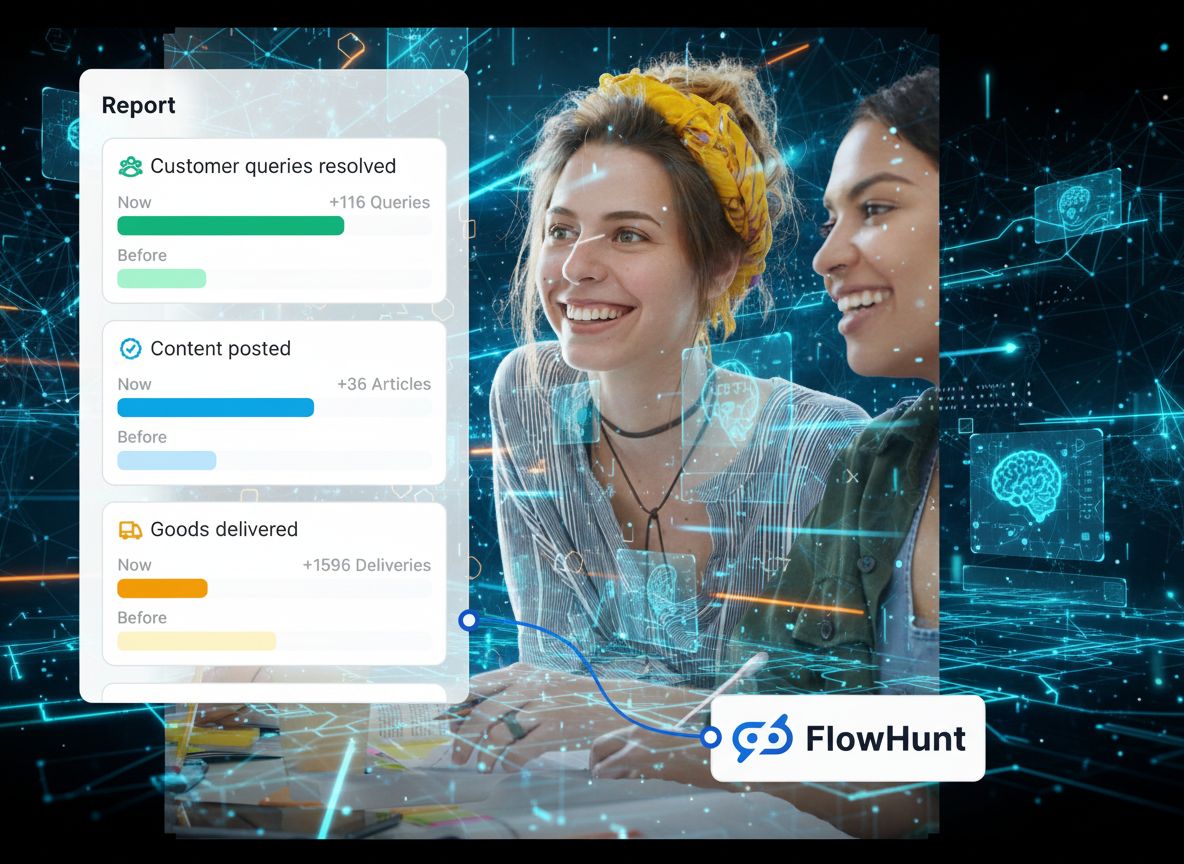

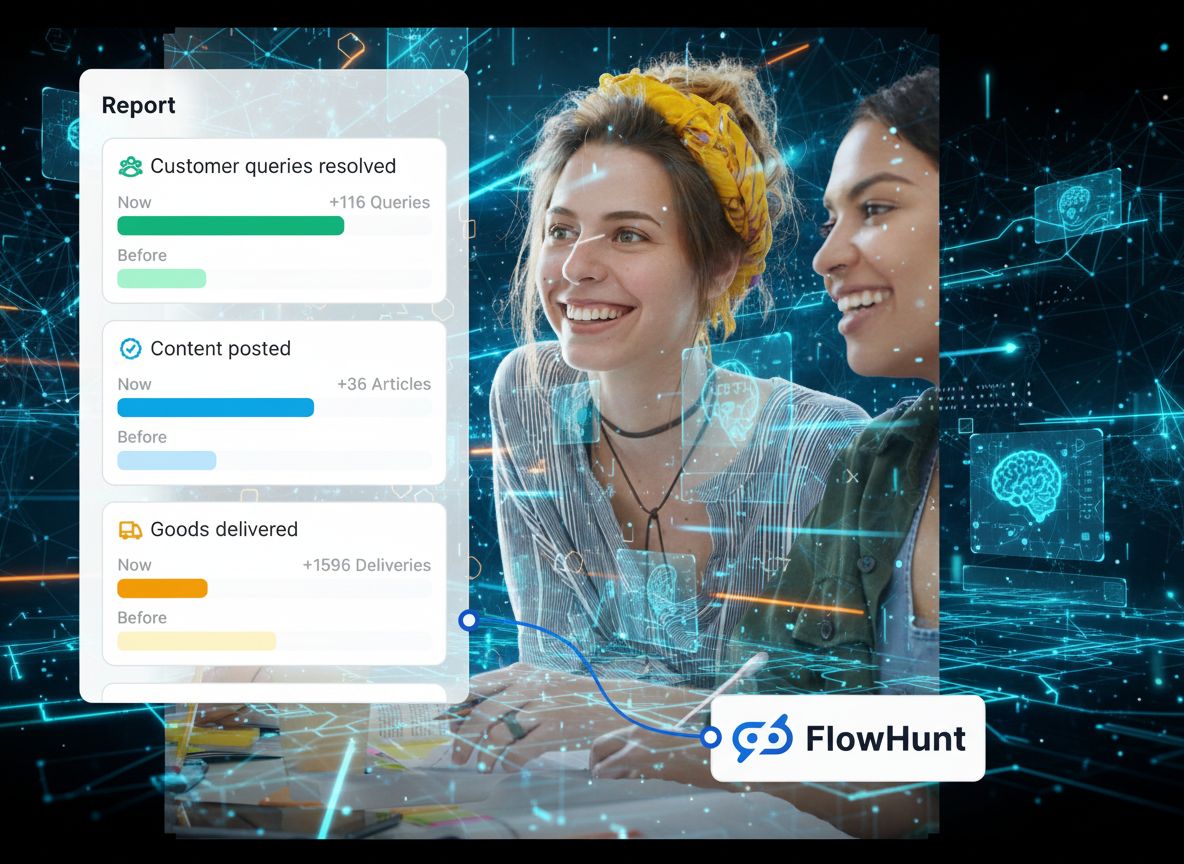

FlowHunt ile özel yapay zekâ sohbet botları ve araçları oluşturmanın yollarını keşfedin. Otomatik Akışları zahmetsizce oluşturmaya başlayın.

Andrej Karpathy'nin AGI zaman çizelgeleri, yapay zekâ ajanları ve önümüzdeki on yılın yapay zekâ gelişimi açısından neden kritik olacağına dair incelikli bakış ...

Anthropic'in kurucu ortağı Jack Clark'ın yapay zeka güvenliği konusundaki endişelerini, büyük dil modellerinde durumsal farkındalığı ve yapay genel zekanın gele...

Meta'nın gelişmiş Ray-Ban gözlükleri, OpenAI'ın insanüstü akıl yürütme modelleri, 3B dünya üretimi ve teknolojiyi kullanma ve işlerimizi otomatikleştirme biçimi...

Çerez Onayı

Göz atma deneyiminizi geliştirmek ve trafiğimizi analiz etmek için çerezleri kullanıyoruz. See our privacy policy.