Traitement automatique du langage naturel (TALN)

Le traitement automatique du langage naturel (TALN) est un sous-domaine de l'intelligence artificielle (IA) qui permet aux ordinateurs de comprendre, d'interpré...

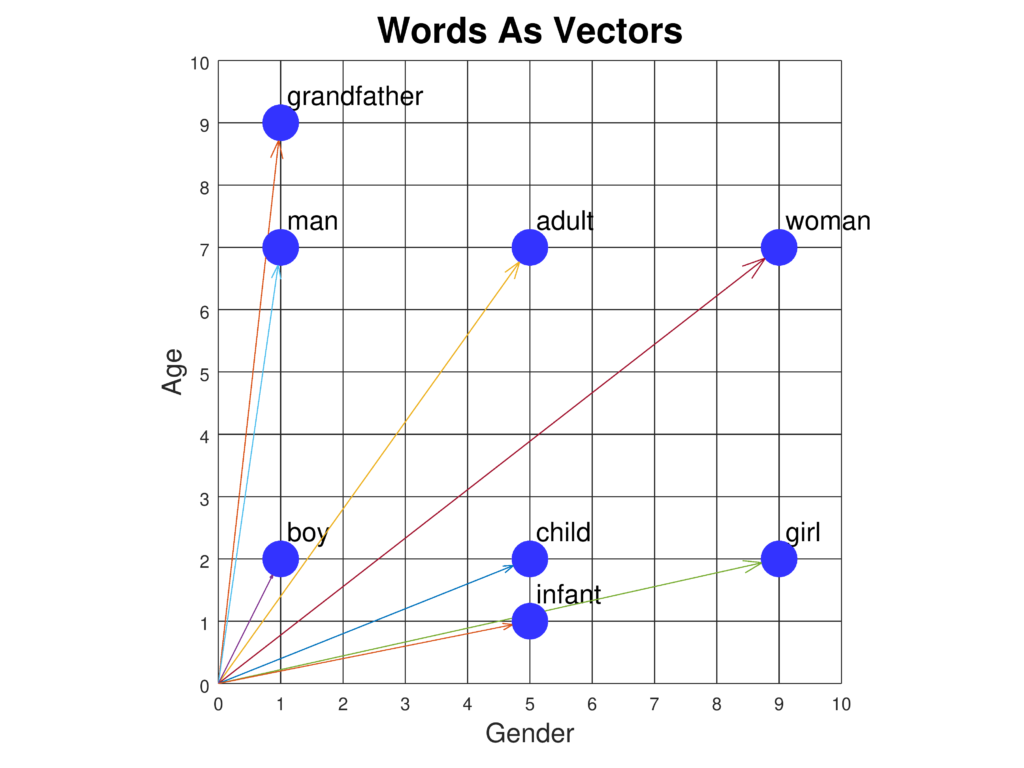

Les représentations vectorielles de mots associent les mots à des vecteurs dans un espace continu, capturant leur signification et leur contexte pour améliorer les applications de TAL.

Les représentations vectorielles de mots sont essentielles dans le TAL, servant de pont entre l’interaction homme-machine. Découvrez aujourd’hui ses aspects clés, son fonctionnement et ses applications pour plusieurs raisons :

Recherche sur les représentations vectorielles de mots en TAL

Apprentissage de représentations de sens de mots à partir de définitions de sens

Qi Li, Tianshi Li, Baobao Chang (2016) proposent une méthode pour relever le défi des mots polysémiques et homonymes en créant une représentation par sens de mot à partir de définitions. Leur approche s’appuie sur un apprentissage à partir de corpus pour obtenir des représentations de sens de haute qualité. Les résultats expérimentaux montrent une amélioration sur les tâches de similarité de mots et de désambiguïsation du sens. L’étude démontre le potentiel des représentations de sens pour améliorer les applications de TAL. En savoir plus

Filtrage de bruit basé sur les réseaux neuronaux pour les représentations de mots

Kim Anh Nguyen, Sabine Schulte im Walde, Ngoc Thang Vu (2016) présentent deux modèles pour améliorer les représentations par filtrage du bruit. Ils identifient les informations inutiles dans les représentations traditionnelles et proposent des techniques d’apprentissage non supervisé pour créer des représentations débruitées. Ces modèles utilisent un réseau de neurones profond pour renforcer l’information pertinente tout en minimisant le bruit. Les résultats montrent de meilleures performances sur les tâches de référence. En savoir plus

Revue sur les représentations neuronales de mots

Erhan Sezerer, Selma Tekir (2021) offrent un panorama complet des représentations neuronales de mots, retraçant leur évolution et leur impact sur le TAL. L’article couvre les théories fondamentales et explore divers types de représentations, comme celles du sens, des morphèmes et les représentations contextuelles. Il discute aussi des jeux de données de référence et des évaluations de performance, mettant en avant l’effet transformateur des représentations neuronales sur les tâches de TAL. En savoir plus

Améliorer l’interprétabilité par une couche de graphe d’interaction explicite entre mots

Arshdeep Sekhon, Hanjie Chen, Aman Shrivastava, Zhe Wang, Yangfeng Ji, Yanjun Qi (2023) se concentrent sur l’amélioration de l’interprétabilité des modèles TAL grâce à WIGRAPH, une couche de réseau de neurones construisant un graphe global d’interactions entre les mots. Cette couche peut être intégrée à tout classificateur de texte TAL, améliorant à la fois l’interprétabilité et la performance des prédictions. L’étude souligne l’importance des interactions entre mots dans la compréhension des décisions du modèle. En savoir plus

Représentations vectorielles de mots pour le secteur bancaire

Avnish Patel (2023) explore l’application des représentations vectorielles dans la banque, mettant en avant leur rôle dans des tâches comme l’analyse de sentiments et la classification de texte. L’étude examine l’utilisation de représentations statiques (par exemple Word2Vec, GloVe) et de modèles contextuels, soulignant leur impact pour des tâches TAL spécifiques au secteur. En savoir plus

Les représentations vectorielles de mots sont des représentations vectorielles denses des mots, associant les mots sémantiquement similaires à des points proches dans un espace continu, permettant aux modèles de comprendre le contexte et les relations dans la langue.

Elles améliorent les tâches de TAL en capturant les relations sémantiques et syntaxiques, en réduisant la dimensionnalité, en permettant l'apprentissage par transfert et en améliorant la gestion des mots rares.

Les techniques populaires incluent Word2Vec, GloVe, FastText et TF-IDF. Les modèles neuronaux comme Word2Vec et GloVe apprennent les représentations à partir de grands corpus de texte, tandis que FastText intègre des informations sur les sous-mots.

Les représentations classiques ont du mal avec la polysémie (mots avec plusieurs sens), peuvent perpétuer les biais des données et nécessitent parfois d'importantes ressources de calcul pour l'entraînement sur de grands corpus.

Elles sont utilisées dans la classification de texte, la traduction automatique, la reconnaissance d'entités nommées, la recherche d'informations et les systèmes de questions-réponses pour améliorer la précision et la compréhension du contexte.

Commencez à créer des solutions IA avancées avec des outils intuitifs pour le TAL, y compris les représentations vectorielles de mots et bien plus.

Le traitement automatique du langage naturel (TALN) est un sous-domaine de l'intelligence artificielle (IA) qui permet aux ordinateurs de comprendre, d'interpré...

Le traitement automatique du langage naturel (TALN) permet aux ordinateurs de comprendre, d’interpréter et de générer le langage humain à l’aide de la linguisti...

Un vecteur d'intégration est une représentation numérique dense de données dans un espace multidimensionnel, capturant les relations sémantiques et contextuelle...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.