LLM Context MCP Server

Il server LLM Context MCP collega gli assistenti AI a progetti di codice e testo esterni, abilitando flussi di lavoro contestuali per revisione del codice, gene...

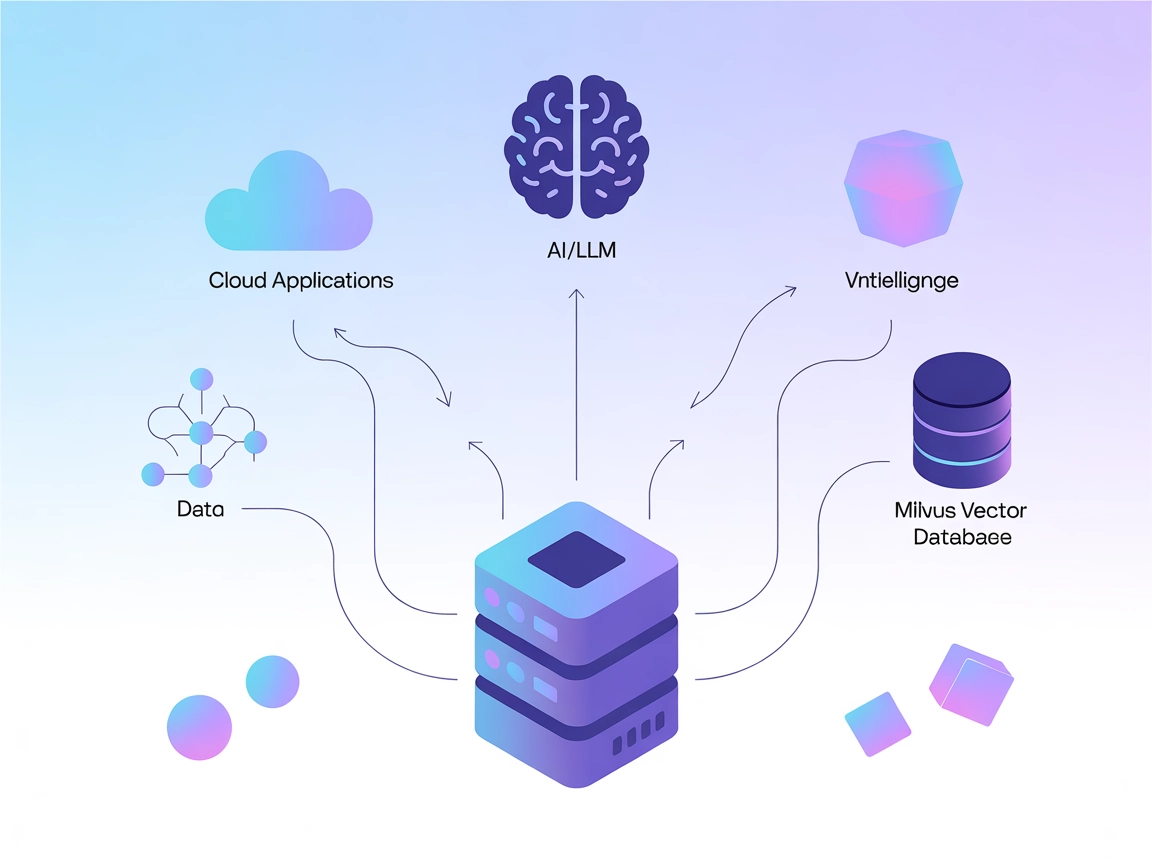

Collega LLM e agenti AI a dispositivi IoT industriali tramite Litmus Edge per una gestione, monitoraggio e automazione robusti dei dispositivi utilizzando il Litmus MCP Server.

FlowHunt fornisce un livello di sicurezza aggiuntivo tra i tuoi sistemi interni e gli strumenti AI, dandoti controllo granulare su quali strumenti sono accessibili dai tuoi server MCP. I server MCP ospitati nella nostra infrastruttura possono essere integrati perfettamente con il chatbot di FlowHunt così come con le piattaforme AI popolari come ChatGPT, Claude e vari editor AI.

Il Litmus MCP (Model Context Protocol) Server è il server ufficiale sviluppato da Litmus Automation che consente ai Large Language Model (LLM) e ai sistemi intelligenti di interagire senza soluzione di continuità con Litmus Edge per la configurazione, il monitoraggio e la gestione dei dispositivi. Basato su MCP SDK e conforme alla specifica Model Context Protocol, Litmus MCP Server permette agli assistenti AI di collegarsi a fonti dati industriali esterne e dispositivi IoT, potenziando così i flussi di sviluppo. Questo server svolge un ruolo fondamentale nel facilitare attività come interrogazioni sui dati dei dispositivi, gestione remota, monitoraggio in tempo reale e automazione dei workflow, rappresentando uno strumento potente per soluzioni IoT industriali e automazione intelligente.

Nessun template di prompt specifico è stato menzionato o documentato nel repository.

Nessuna risorsa MCP esplicita è documentata nel repository.

Nessuna definizione di strumenti trovata in server.py o file equivalenti in questo repository.

"mcpServers": {

"litmus-mcp": {

"command": "npx",

"args": ["@litmus/mcp-server@latest"]

}

}

"mcpServers": {

"litmus-mcp": {

"command": "npx",

"args": ["@litmus/mcp-server@latest"],

"env": {

"LITMUS_API_KEY": "${LITMUS_API_KEY}"

},

"inputs": {

"apiKey": "${LITMUS_API_KEY}"

}

}

}

mcpServers:"mcpServers": {

"litmus-mcp": {

"command": "npx",

"args": ["@litmus/mcp-server@latest"]

}

}

"mcpServers": {

"litmus-mcp": {

"command": "npx",

"args": ["@litmus/mcp-server@latest"],

"env": {

"LITMUS_API_KEY": "${LITMUS_API_KEY}"

},

"inputs": {

"apiKey": "${LITMUS_API_KEY}"

}

}

}

"mcpServers": {

"litmus-mcp": {

"command": "npx",

"args": ["@litmus/mcp-server@latest"]

}

}

"mcpServers": {

"litmus-mcp": {

"command": "npx",

"args": ["@litmus/mcp-server@latest"],

"env": {

"LITMUS_API_KEY": "${LITMUS_API_KEY}"

},

"inputs": {

"apiKey": "${LITMUS_API_KEY}"

}

}

}

"mcpServers": {

"litmus-mcp": {

"command": "npx",

"args": ["@litmus/mcp-server@latest"]

}

}

"mcpServers": {

"litmus-mcp": {

"command": "npx",

"args": ["@litmus/mcp-server@latest"],

"env": {

"LITMUS_API_KEY": "${LITMUS_API_KEY}"

},

"inputs": {

"apiKey": "${LITMUS_API_KEY}"

}

}

}

Utilizzo di MCP in FlowHunt

Per integrare i server MCP nel tuo workflow FlowHunt, inizia aggiungendo il componente MCP al tuo flow e collegandolo al tuo agente AI:

Clicca sul componente MCP per aprire il pannello di configurazione. Nella sezione di configurazione MCP di sistema, inserisci i dettagli del tuo server MCP usando questo formato JSON:

{

"litmus-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Una volta configurato, l’agente AI sarà in grado di utilizzare questo MCP come strumento con accesso a tutte le sue funzioni e capacità. Ricorda di cambiare "litmus-mcp" con il vero nome del tuo server MCP e di sostituire l’URL con quello del tuo MCP server.

| Sezione | Disponibilità | Dettagli/Note |

|---|---|---|

| Panoramica | ✅ | |

| Elenco dei Prompt | ⛔ | Nessun template di prompt elencato |

| Elenco delle Risorse | ⛔ | Nessuna risorsa esplicita documentata |

| Elenco degli Strumenti | ⛔ | Nessun strumento elencato in codice o documenti |

| Protezione delle chiavi API | ✅ | Esempio con env e inputs |

| Supporto sampling (meno importante in valutazione) | ⛔ | Non menzionato |

Un’attenta revisione di questo repository mostra che, sebbene le istruzioni di configurazione e integrazione siano chiare e i casi d’uso ben definiti, attualmente non ci sono documentazioni o codice che dettaglino template di prompt, risorse MCP esplicite o implementazioni di strumenti.

Questo server MCP è ben documentato per quanto riguarda setup e integrazione, in particolare per casi d’uso IoT industriali. Tuttavia, rispetto a server più ricchi di funzionalità, attualmente manca di dettagli su template di prompt, esposizione di risorse e strumenti eseguibili, che sono i principali primitivi MCP. Pertanto, sebbene sia forte per scenari di gestione dispositivi e automazione, gli sviluppatori che cercano workflow LLM più approfonditi potrebbero trovarlo limitato allo stato attuale.

| Ha una LICENSE | ✅ (Apache-2.0) |

|---|---|

| Ha almeno uno strumento | ⛔ |

| Numero di Fork | 0 |

| Numero di Stelle | 2 |

Migliora i tuoi flussi di lavoro IoT industriali collegando i tuoi agenti AI a Litmus Edge con il server ufficiale Litmus MCP. Sperimenta una gestione e automazione dei dispositivi senza interruzioni.

Il server LLM Context MCP collega gli assistenti AI a progetti di codice e testo esterni, abilitando flussi di lavoro contestuali per revisione del codice, gene...

Il Patronus MCP Server semplifica la valutazione e la sperimentazione degli LLM per sviluppatori e ricercatori, offrendo automazione, elaborazione in batch e un...

Il Milvus MCP Server collega assistenti AI e applicazioni basate su LLM con il database vettoriale Milvus, abilitando ricerca vettoriale avanzata, gestione degl...

Consenso Cookie

Usiamo i cookie per migliorare la tua esperienza di navigazione e analizzare il nostro traffico. See our privacy policy.