Patronus MCP

Integra FlowHunt con il server Patronus MCP per ottimizzare, valutare e sperimentare sistemi LLM in modo efficiente. Standardizza il testing dei modelli AI, aut...

Patronus MCP Server automatizza le valutazioni e gli esperimenti LLM, consentendo benchmarking AI semplificato e integrazione dei flussi di lavoro per team tecnici che utilizzano FlowHunt.

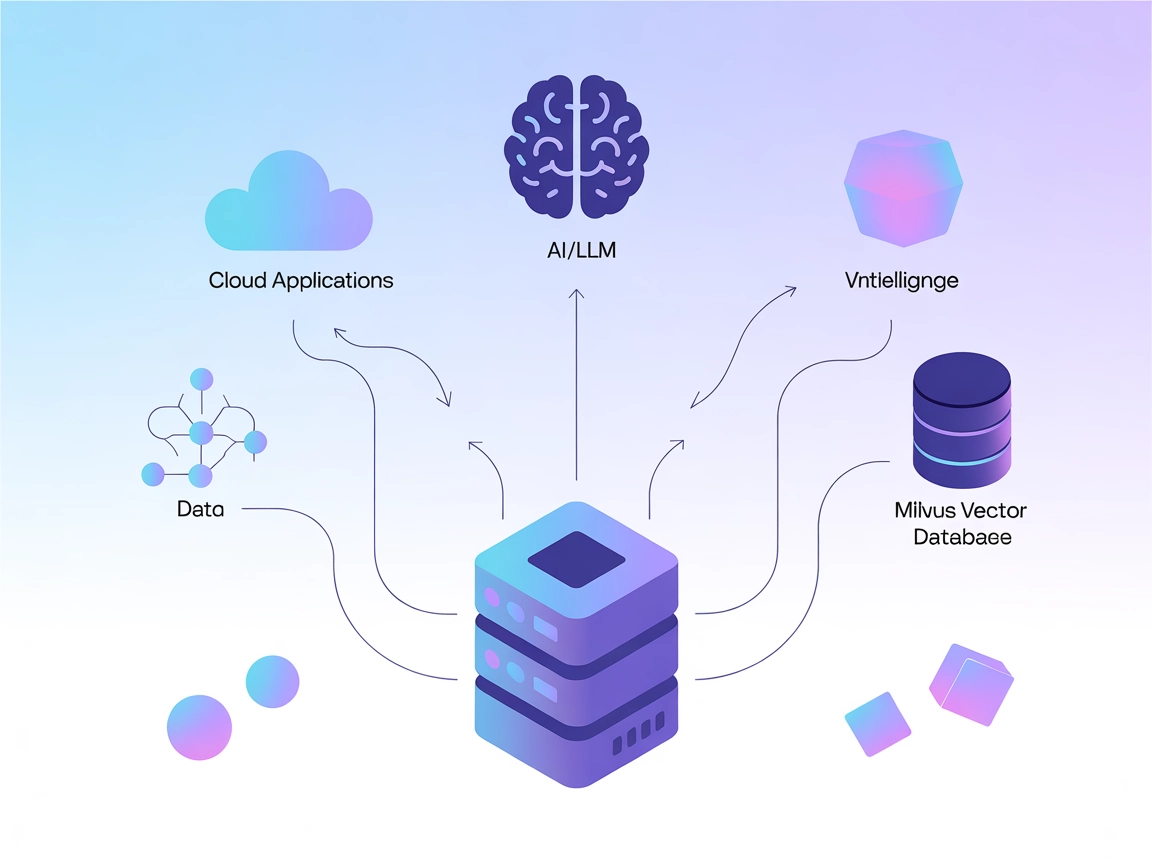

FlowHunt fornisce un livello di sicurezza aggiuntivo tra i tuoi sistemi interni e gli strumenti AI, dandoti controllo granulare su quali strumenti sono accessibili dai tuoi server MCP. I server MCP ospitati nella nostra infrastruttura possono essere integrati perfettamente con il chatbot di FlowHunt così come con le piattaforme AI popolari come ChatGPT, Claude e vari editor AI.

Il Patronus MCP (Model Context Protocol) Server è un’implementazione server standardizzata costruita per l’SDK Patronus, progettata per facilitare ottimizzazioni avanzate, valutazioni ed esperimenti sui sistemi LLM (Large Language Model). Collegando gli assistenti AI a fonti dati e servizi esterni, Patronus MCP Server consente flussi di lavoro ottimizzati per sviluppatori e ricercatori. Permette di eseguire valutazioni singole o batch, esperimenti su dataset e di inizializzare progetti con chiavi API e impostazioni specifiche. Questa piattaforma estendibile aiuta ad automatizzare compiti valutativi ripetitivi, supporta l’integrazione di valutatori personalizzati e offre un’interfaccia solida per la gestione e l’analisi del comportamento degli LLM, migliorando così il ciclo di vita dello sviluppo AI.

Nessun template di prompt è esplicitamente elencato nel repository o nella documentazione.

Nessuna risorsa esplicita è dettagliata nella documentazione o nei file del repository disponibili.

initialize

Inizializza Patronus con chiave API, progetto e impostazioni dell’applicazione. Prepara il sistema per valutazioni ed esperimenti successivi.

evaluate

Esegue una singola valutazione utilizzando un valutatore configurabile su task, output e contesto forniti.

batch_evaluate

Esegue valutazioni in batch con più valutatori sui task forniti, producendo risultati collettivi.

run_experiment

Esegue esperimenti utilizzando dataset e valutatori specificati, utile per benchmarking e confronti.

Automazione della Valutazione LLM

Automatizza la valutazione di modelli linguistici di grandi dimensioni raggruppando task e applicando più valutatori, riducendo lo sforzo manuale nel controllo qualità e benchmarking.

Sperimentazione Personalizzata

Esegui esperimenti su misura con dataset e valutatori personalizzati per valutare nuove architetture LLM e confrontare le prestazioni secondo criteri diversi.

Inizializzazione Progetti per Team

Configura rapidamente ambienti di valutazione per più progetti usando chiavi API e impostazioni di progetto, semplificando onboarding e collaborazione.

Test Interattivi Live

Utilizza gli script forniti per testare in modo interattivo gli endpoint di valutazione, rendendo più semplice il debug e la validazione dei flussi di lavoro di valutazione per gli sviluppatori.

.windsurf o windsurf.json).{

"mcpServers": [

{

"command": "python",

"args": ["src/patronus_mcp/server.py"],

"env": {

"PATRONUS_API_KEY": "your_api_key_here"

}

}

]

}

{

"mcpServers": [

{

"command": "python",

"args": ["src/patronus_mcp/server.py"],

"env": {

"PATRONUS_API_KEY": "your_api_key_here"

}

}

]

}

{

"mcpServers": [

{

"command": "python",

"args": ["src/patronus_mcp/server.py"],

"env": {

"PATRONUS_API_KEY": "your_api_key_here"

}

}

]

}

{

"mcpServers": [

{

"command": "python",

"args": ["src/patronus_mcp/server.py"],

"env": {

"PATRONUS_API_KEY": "your_api_key_here"

}

}

]

}

Proteggere le chiavi API:

Inserisci credenziali sensibili come PATRONUS_API_KEY nell’oggetto env della tua configurazione. Esempio:

{

"command": "python",

"args": ["src/patronus_mcp/server.py"],

"env": {

"PATRONUS_API_KEY": "your_api_key_here"

},

"inputs": {}

}

Usare MCP in FlowHunt

Per integrare i server MCP nel flusso di lavoro FlowHunt, inizia aggiungendo il componente MCP al tuo flow e collegandolo al tuo agente AI:

Clicca sul componente MCP per aprire il pannello di configurazione. Nella sezione di configurazione MCP di sistema, inserisci i dettagli del tuo server MCP usando questo formato JSON:

{

"patronus-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Una volta configurato, l’agente AI potrà usare questo MCP come uno strumento con accesso a tutte le sue funzioni e capacità. Ricordati di sostituire “patronus-mcp” con il vero nome del tuo server MCP e di inserire la tua URL MCP personale.

| Sezione | Disponibilità | Dettagli/Note |

|---|---|---|

| Panoramica | ✅ | Descrizione chiara nel README |

| Elenco dei Prompt | ⛔ | Nessun template di prompt trovato |

| Elenco delle Risorse | ⛔ | Nessuna risorsa esplicita elencata |

| Elenco degli Strumenti | ✅ | Presenti in uso API e README |

| Protezione Chiavi API | ✅ | Descritta nel README e nelle istruzioni di configurazione |

| Supporto Sampling (meno importante in valutaz.) | ⛔ | Non menzionato |

Supporto Roots: Non menzionato nella documentazione o nel codice.

In base alle informazioni sopra, Patronus MCP Server offre una solida base e funzioni essenziali per la valutazione e la sperimentazione LLM, ma manca di dettagli su template di prompt, risorse e funzioni MCP avanzate come Roots e Sampling.

Il Patronus MCP Server offre strumenti di valutazione robusti e istruzioni di configurazione chiare, ma mancano prompt standardizzati, definizioni di risorse e alcune funzioni MCP avanzate. È più indicato per utenti tecnici focalizzati sulla valutazione e sperimentazione LLM. Punteggio: 6/10

| Possiede una LICENSE | ✅ (Apache-2.0) |

|---|---|

| Ha almeno uno strumento | ✅ |

| Numero di Fork | 3 |

| Numero di Stelle | 13 |

Integra Patronus MCP Server nel tuo flusso di lavoro FlowHunt per valutazioni ed esperimenti di modelli AI automatizzati, solidi e scalabili.

Integra FlowHunt con il server Patronus MCP per ottimizzare, valutare e sperimentare sistemi LLM in modo efficiente. Standardizza il testing dei modelli AI, aut...

Il Milvus MCP Server collega assistenti AI e applicazioni basate su LLM con il database vettoriale Milvus, abilitando ricerca vettoriale avanzata, gestione degl...

Il server LLM Context MCP collega gli assistenti AI a progetti di codice e testo esterni, abilitando flussi di lavoro contestuali per revisione del codice, gene...

Consenso Cookie

Usiamo i cookie per migliorare la tua esperienza di navigazione e analizzare il nostro traffico. See our privacy policy.