Planningen

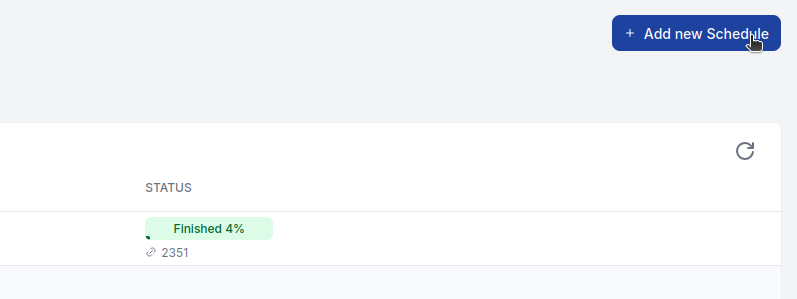

De Planningen-functie in FlowHunt stelt je in staat om periodiek domeinen en YouTube-kanalen te crawlen, zodat je chatbots en flows altijd up-to-date blijven me...

Leer hoe je automatische schema’s instelt voor het crawlen van websites, sitemaps, domeinen en YouTube-kanalen om je AI Agent kennisbank up-to-date te houden.

Met de Schema-functie van FlowHunt kun je het crawlen en indexeren van websites, sitemaps, domeinen en YouTube-kanalen automatiseren. Zo blijft de kennisbank van je AI Agent altijd actueel met verse content, zonder handmatige tussenkomst.

Automatisch crawlen:

Stel terugkerende crawls in die dagelijks, wekelijks, maandelijks of jaarlijks worden uitgevoerd om je kennisbank up-to-date te houden.

Meerdere crawltypen:

Kies uit Domein crawl, Sitemap crawl, URL crawl of YouTube-kanaal crawl, afhankelijk van je contentbron.

Geavanceerde opties:

Stel browser rendering, linkvolgen, screenshots, proxy-rotatie en URL-filtering in voor optimale resultaten.

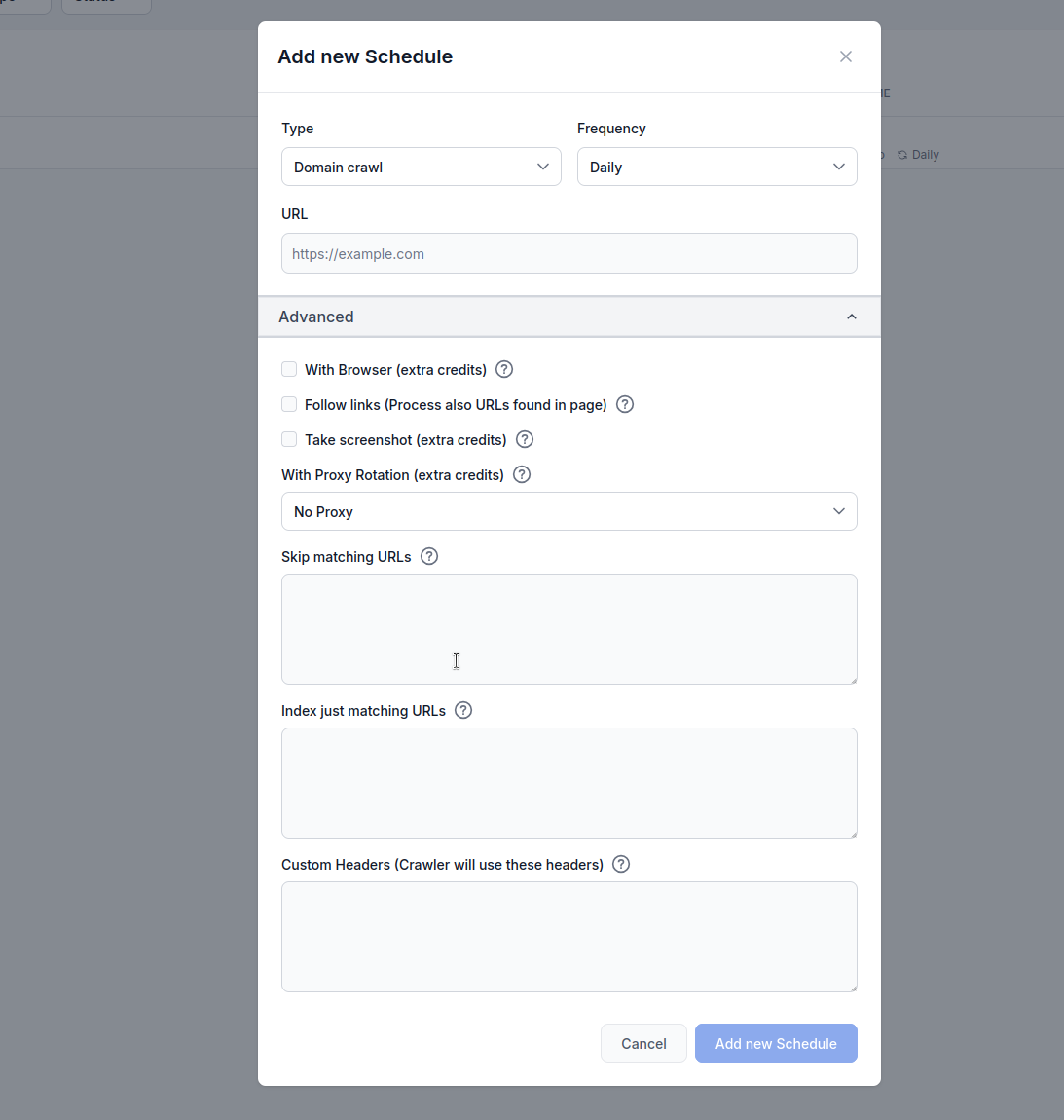

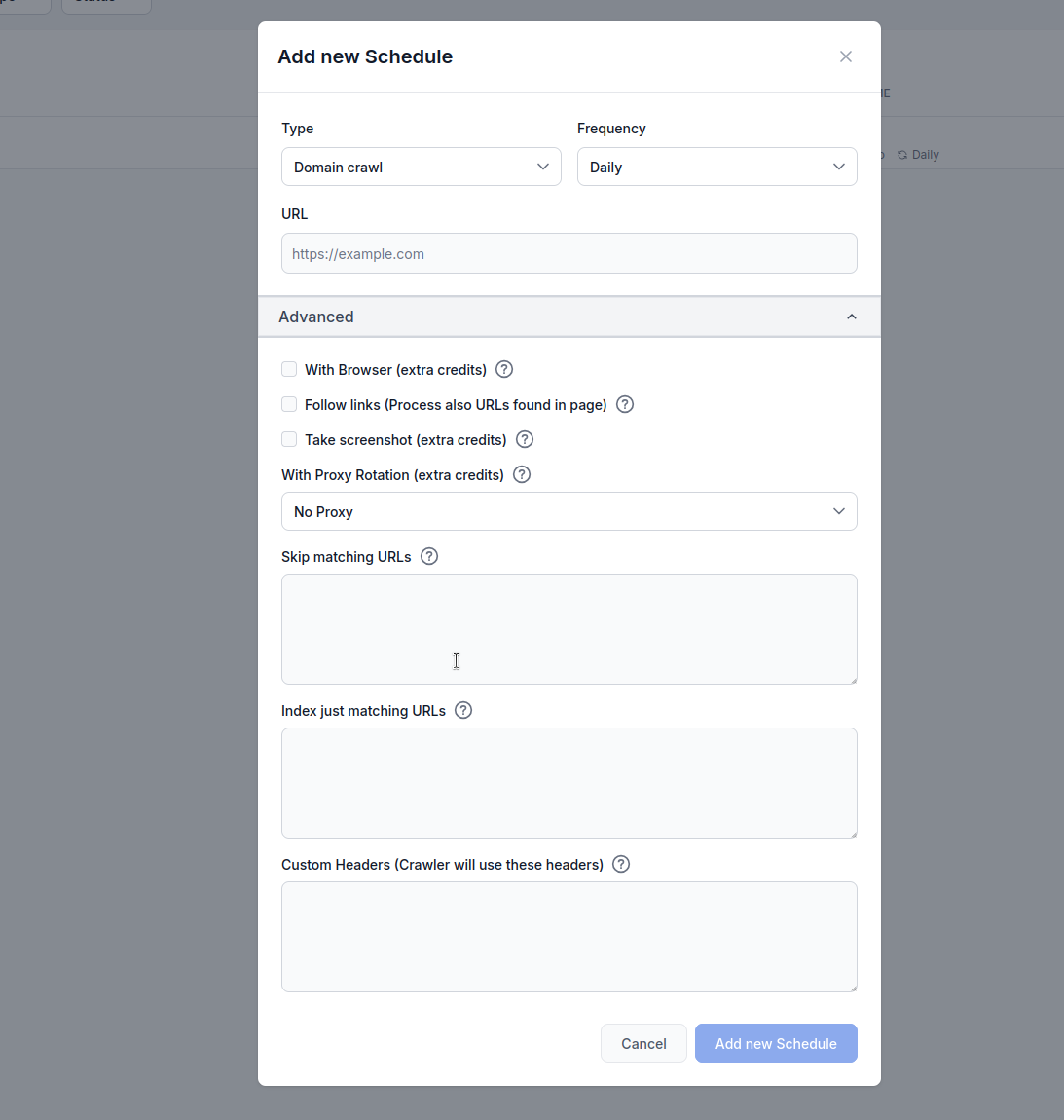

Type: Kies je crawl-methode:

Frequentie: Stel in hoe vaak de crawl moet lopen:

URL: Voer de doel-URL, het domein of YouTube-kanaal in om te crawlen

Met Browser (extra credits): Inschakelen bij het crawlen van JavaScript-intensieve websites die volledige browser rendering vereisen. Deze optie is langzamer en duurder, maar noodzakelijk voor sites die content dynamisch laden.

Links volgen (extra credits): Verwerk extra URL’s gevonden binnen pagina’s. Handig als sitemaps niet alle URL’s bevatten, maar kan veel credits kosten omdat het ontdekte links crawlt.

Screenshot maken (extra credits): Maak tijdens het crawlen visuele screenshots. Nuttig voor websites zonder og:images of als visuele context nodig is voor AI-verwerking.

Met Proxy-rotatie (extra credits): Wissel IP-adressen per verzoek om detectie door Web Application Firewalls (WAF) of anti-botsystemen te voorkomen.

Sla overeenkomende URL’s over: Voer strings in (één per regel) om URL’s uit te sluiten die deze patronen bevatten. Voorbeeld:

/admin/

/login

.pdf

Dit voorbeeld legt uit wat er gebeurt wanneer je de Schema-functie van FlowHunt gebruikt om het domein flowhunt.io te crawlen terwijl je /blog als overeenkomend URL-patroon instelt om te overslaan in de URL-filterinstellingen.

Configuratie-instellingen

flowhunt.io/blogWat gebeurt er

Crawl Start:

flowhunt.io en richt zich op alle toegankelijke pagina’s van het domein (zoals flowhunt.io, flowhunt.io/features, flowhunt.io/pricing, etc.).URL-filtering toegepast:

/blog./blog bevat (zoals flowhunt.io/blog, flowhunt.io/blog/post1, flowhunt.io/blog/category) wordt uitgesloten van de crawl.flowhunt.io/about, flowhunt.io/contact of flowhunt.io/docs worden wel gecrawld omdat ze niet aan het /blog-patroon voldoen.Crawl Uitvoering:

flowhunt.io en indexeert hun inhoud voor de kennisbank van je AI Agent.Resultaat:

flowhunt.io, met uitzondering van alles onder het /blog-pad./blog), zonder handmatig werk.Indexeer alleen overeenkomende URL’s: Voer strings in (één per regel) om alleen URL’s te crawlen die deze patronen bevatten. Voorbeeld:

/blog/

/articles/

/knowledge/

Configuratie-instellingen

flowhunt.io/blog/

/articles/

/knowledge/

Crawl Start:

flowhunt.io en richt zich op alle toegankelijke pagina’s op het domein (zoals flowhunt.io, flowhunt.io/blog, flowhunt.io/articles, etc.).URL-filtering toegepast:

/blog/, /articles/ en /knowledge/.flowhunt.io/blog/post1, flowhunt.io/articles/news, flowhunt.io/knowledge/guide) worden opgenomen in de crawl.flowhunt.io/about, flowhunt.io/pricing of flowhunt.io/contact, worden uitgesloten omdat ze niet aan de opgegeven patronen voldoen.Crawl Uitvoering:

/blog/, /articles/ of /knowledge/ en indexeert hun inhoud voor de kennisbank van je AI Agent.Resultaat:

flowhunt.io-pagina’s onder de paden /blog/, /articles/ en /knowledge/.Aangepaste Headers:

Voeg aangepaste HTTP-headers toe voor crawlverzoeken. Formatteer als HEADER=Value (één per regel):

Deze functie is erg handig om crawls af te stemmen op specifieke websitebehoeften. Door aangepaste headers in te schakelen, kunnen gebruikers verzoeken authentiseren om toegang te krijgen tot afgeschermde content, specifiek browsergedrag nabootsen of voldoen aan het API- of toegangsbeleid van een website. Door bijvoorbeeld een Authorization-header in te stellen, kan toegang worden verkregen tot beschermde pagina’s, terwijl een aangepaste User-Agent kan helpen om botdetectie te voorkomen of compatibiliteit te waarborgen bij sites die bepaalde crawlers weren. Deze flexibiliteit zorgt voor een nauwkeurigere en uitgebreidere dataverzameling, waardoor het eenvoudiger wordt om relevante content te indexeren voor de kennisbank van een AI Agent en tegelijkertijd te voldoen aan de beveiligings- of toegangsprotocollen van een website.

MYHEADER=Any value

Authorization=Bearer token123

User-Agent=Custom crawler

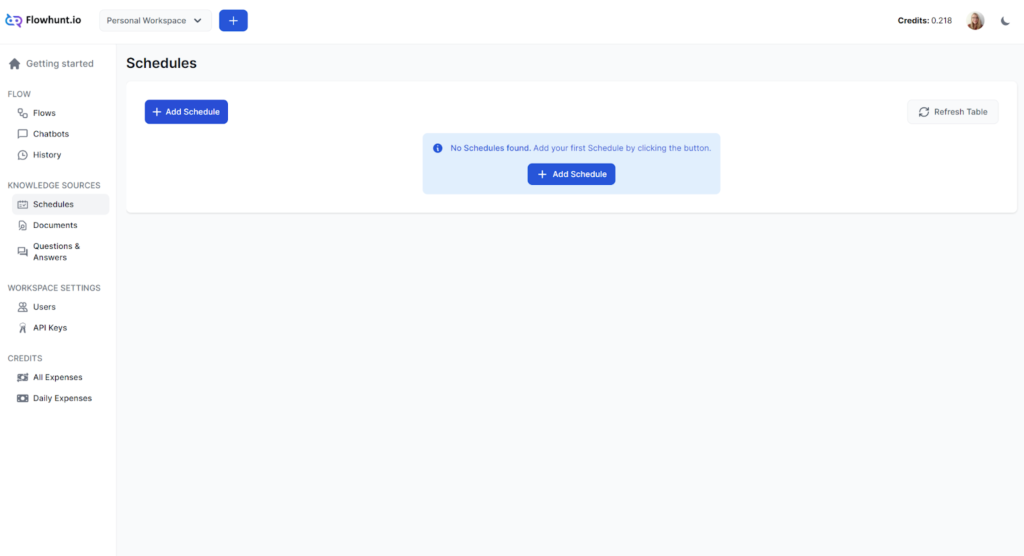

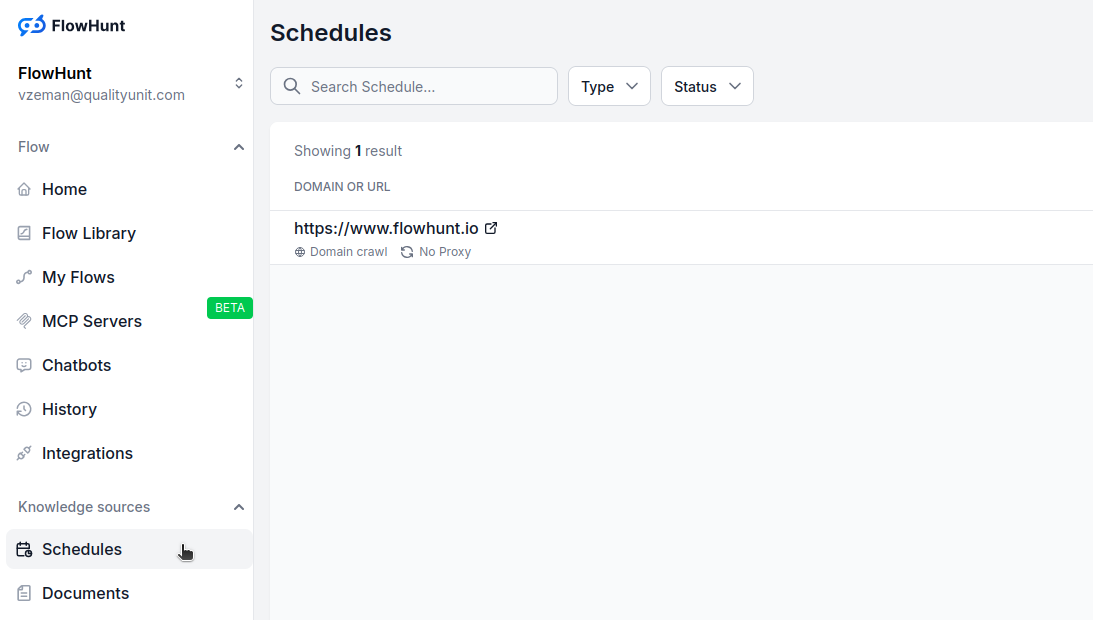

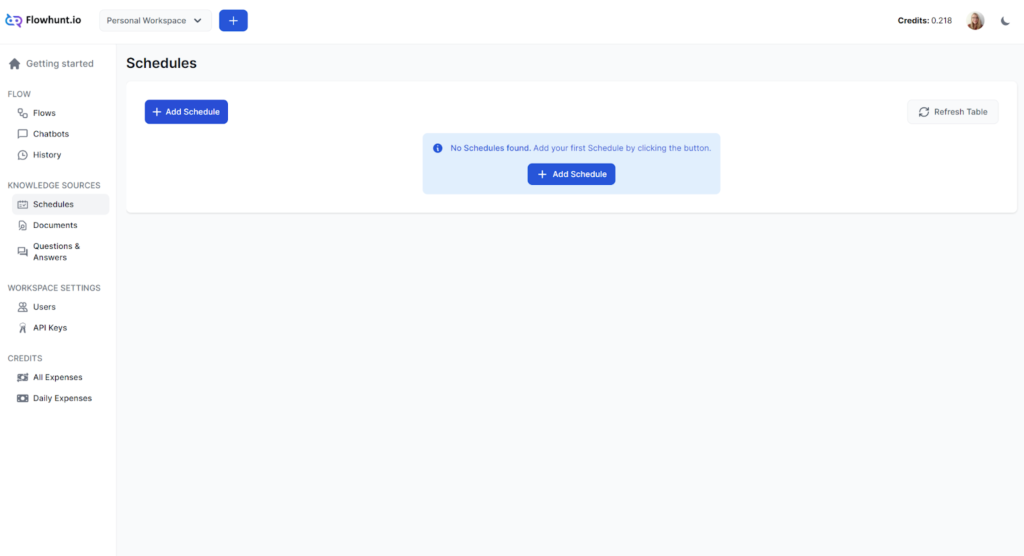

Navigeer naar Schema’s in je FlowHunt-dashboard

Klik op “Nieuw Schema toevoegen”

Configureer basisinstellingen:

Vouw Geavanceerde opties uit indien nodig:

Klik op “Nieuw Schema toevoegen” om te activeren

Voor de meeste websites:

Voor JavaScript-intensieve sites:

Voor grote sites:

Voor e-commerce of dynamische content:

Geavanceerde functies verbruiken extra credits:

Houd je creditverbruik in de gaten en pas schema’s aan op basis van je behoeften en budget.

Crawl mislukt:

Te veel/weinig pagina’s:

Ontbrekende content:

De Planningen-functie in FlowHunt stelt je in staat om periodiek domeinen en YouTube-kanalen te crawlen, zodat je chatbots en flows altijd up-to-date blijven me...

Ontdek hoe je automatisch uitgebreide, SEO-geoptimaliseerde verklarende woordenlijstpagina's genereert met AI-agents en workflowautomatisering in FlowHunt. Leer...

Verminder AI-hallucinaties en zorg voor nauwkeurige chatbotantwoorden door gebruik te maken van de Schedule-functie van FlowHunt. Ontdek de voordelen, praktisch...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.