Model Context Protocol (MCP) Server

De Model Context Protocol (MCP) Server vormt de brug tussen AI-assistenten en externe databronnen, API's en diensten, waardoor een gestroomlijnde integratie van...

Cognee MCP Server vormt een brug tussen AI en externe bronnen, waarmee FlowHunt-ontwikkelaars worden versterkt met naadloze integratie, workflowautomatisering en programmatische taakuitvoering.

FlowHunt biedt een extra beveiligingslaag tussen uw interne systemen en AI-tools, waardoor u granulaire controle heeft over welke tools toegankelijk zijn vanaf uw MCP-servers. MCP-servers die in onze infrastructuur worden gehost, kunnen naadloos worden geïntegreerd met FlowHunt's chatbot evenals populaire AI-platforms zoals ChatGPT, Claude en verschillende AI-editors.

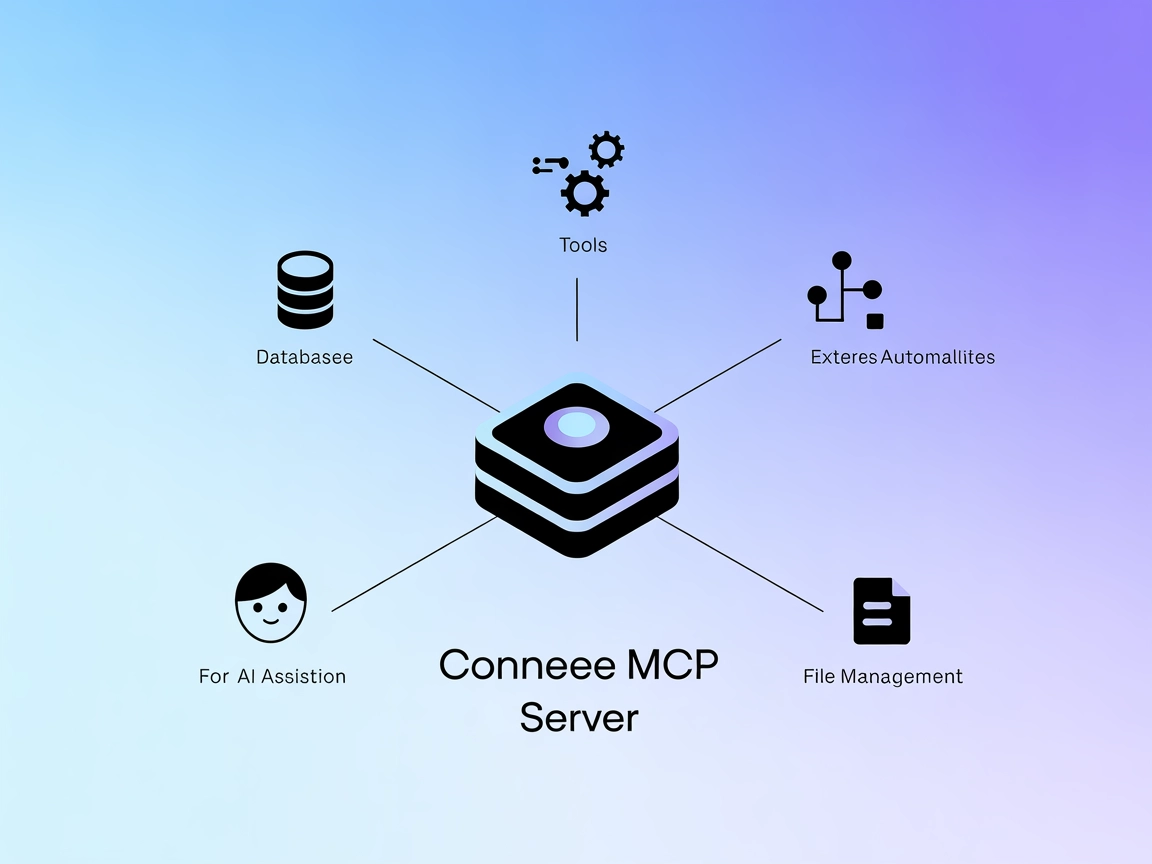

De Cognee MCP (Model Context Protocol) Server fungeert als brug tussen AI-assistenten en externe databronnen, API’s of services om ontwikkelworkflows te stroomlijnen en te verbeteren. Door middelen, tools en prompt-templates via gestandaardiseerde interfaces aan te bieden, stelt Cognee MCP AI-gestuurde interacties mogelijk zoals het uitvoeren van databasequery’s, bestandsbeheer of integraties met externe API’s. Deze interoperabiliteit maakt het voor ontwikkelaars en AI-systemen mogelijk om complexe taken programmatisch uit te voeren, de mogelijkheden van de assistent uit te breiden en meerstapsprocessen te automatiseren—wat uiteindelijk de productiviteit verhoogt en een naadloze interactie met uiteenlopende data en services vergemakkelijkt.

MCP gebruiken in FlowHunt

Om MCP-servers in je FlowHunt-workflow te integreren, voeg je het MCP-component toe aan je flow en verbind je het met je AI-agent:

Klik op het MCP-component om het configuratiescherm te openen. Voeg in het systeem-MCP-configuratiegedeelte je MCP-servergegevens toe in het volgende JSON-formaat:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Na configuratie kan de AI-agent deze MCP nu als tool gebruiken met toegang tot alle functies en mogelijkheden. Vergeet niet “MCP-name” te vervangen door de daadwerkelijke naam van je MCP-server (bijv. “github-mcp”, “weather-api”, enz.) en de URL te vervangen door de eigen MCP-server-URL.

| Sectie | Beschikbaarheid | Details/Opmerkingen |

|---|---|---|

| Overzicht | ✅ | Tekst afgeleid van prompt; geen directe info in repo |

| Lijst met prompts | ⛔ | Geen info gevonden in repo |

| Lijst met resources | ⛔ | Geen info gevonden in repo |

| Lijst met tools | ⛔ | Geen info gevonden in repo |

| API-sleutels beveiligen | ⛔ | Geen info gevonden in repo |

| Sampling-ondersteuning (minder belangrijk) | ⛔ | Geen info gevonden in repo |

Op basis van de openbare inhoud van de repository ontbreekt het de Cognee MCP-server aan documentatie of codevoorbeelden voor de meeste vereiste secties. De bruikbaarheid en integratiepotentie van deze MCP kan niet goed worden beoordeeld zonder meer informatie.

| Heeft een LICENSE | ⛔ |

|---|---|

| Heeft minstens één tool | ⛔ |

| Aantal forks | |

| Aantal sterren |

Algemene beoordeling: 1/10

Er is vrijwel geen bruikbare documentatie of code aanwezig op de opgegeven URL die prompts, resources, tools of installatie-instructies weergeeft, en er is geen metadata zoals sterren, forks of LICENSE zichtbaar. De MCP is op basis van de beschikbare informatie niet praktisch bruikbaar voor ontwikkelaars.

Integreer de Cognee MCP Server in FlowHunt om programmeerbare toegang tot externe data, API's en services voor je AI-agenten te ontgrendelen.

De Model Context Protocol (MCP) Server vormt de brug tussen AI-assistenten en externe databronnen, API's en diensten, waardoor een gestroomlijnde integratie van...

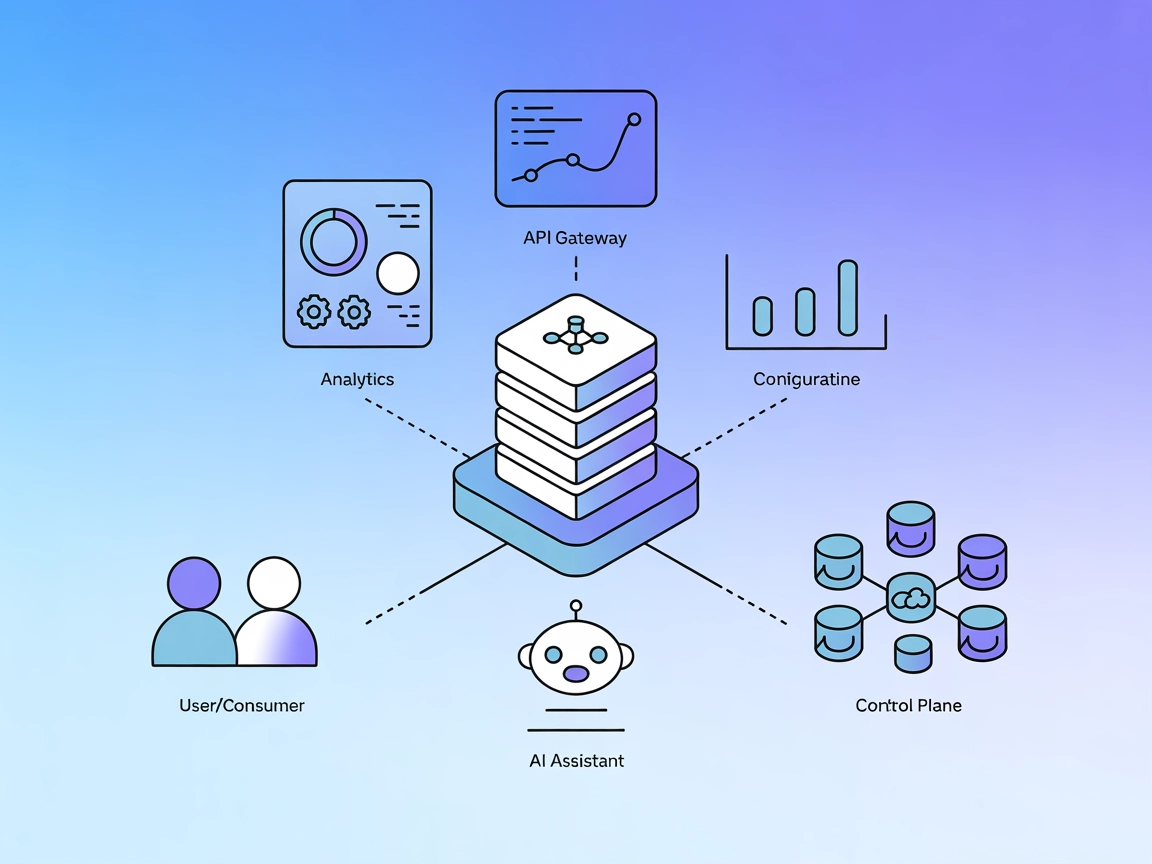

De Kong Konnect MCP Server integreert AI-assistenten met de API Gateway van Kong Konnect, waardoor natuurlijke taalvragen voor analytics, configuratie en contro...

De lingo.dev MCP Server verbindt AI-assistenten met externe databronnen, API's en services, waardoor gestructureerde toegang tot bronnen, prompt-sjablonen en to...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.