DeepSeek MCP Server

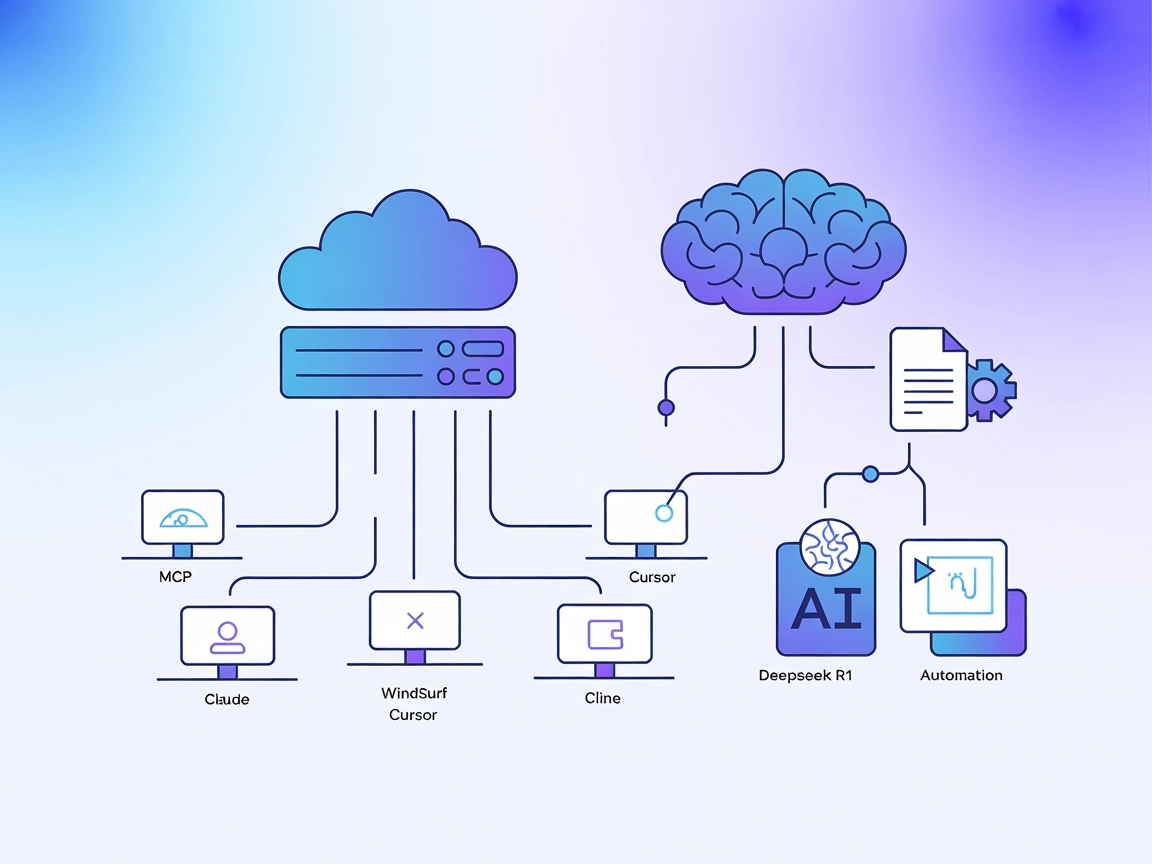

De DeepSeek MCP Server integreert DeepSeek's geavanceerde taalmodellen met MCP-compatibele applicaties en biedt veilige, geanonimiseerde API-toegang, waardoor s...

Integreer DeepSeek’s contextrijke, redeneer-geoptimaliseerde modellen in je AI-workflows met de Deepseek R1 MCP Server voor geavanceerde taalopdrachten en automatisering.

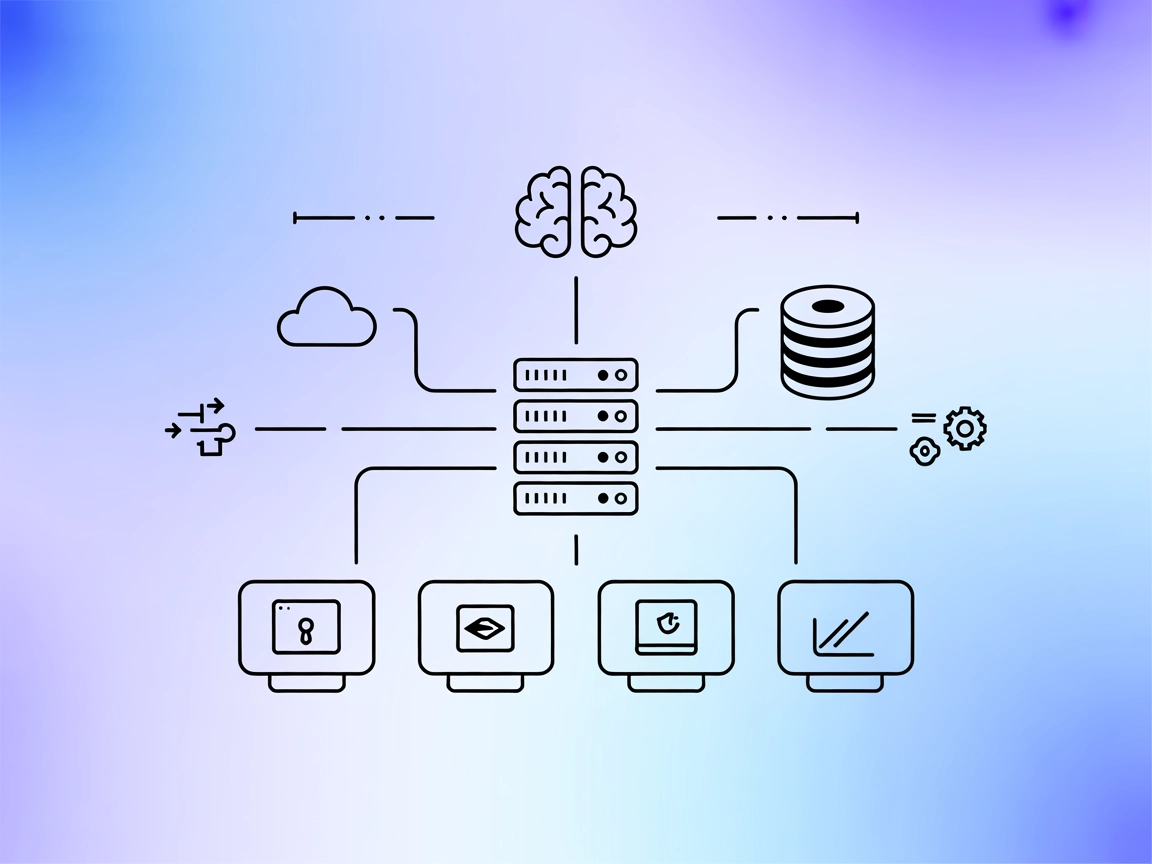

FlowHunt biedt een extra beveiligingslaag tussen uw interne systemen en AI-tools, waardoor u granulaire controle heeft over welke tools toegankelijk zijn vanaf uw MCP-servers. MCP-servers die in onze infrastructuur worden gehost, kunnen naadloos worden geïntegreerd met FlowHunt's chatbot evenals populaire AI-platforms zoals ChatGPT, Claude en verschillende AI-editors.

De Deepseek R1 MCP Server is een Model Context Protocol (MCP) serverimplementatie die is ontworpen om Claude Desktop te verbinden met DeepSeek’s geavanceerde taalmodellen, zoals Deepseek R1 en DeepSeek V3. Door als brug te fungeren tussen AI-assistenten en DeepSeek’s krachtige, redeneer-geoptimaliseerde modellen (met een contextvenster van 8192 tokens), stelt deze server AI-agenten in staat verbeterde natuurlijke taalbegrip- en generatieopdrachten uit te voeren. Ontwikkelaars kunnen de Deepseek R1 MCP Server inzetten om deze modellen naadloos te integreren in hun workflows, waardoor geavanceerde tekstgeneratie, redeneren en interactie met externe databronnen of API’s binnen ondersteunde platforms mogelijk worden. De implementatie is gericht op het bieden van een stabiele, betrouwbare en efficiënte integratie met behulp van Node.js/TypeScript voor optimale compatibiliteit en typeveiligheid.

Er zijn geen prompt templates gedocumenteerd in de repository.

Er zijn geen expliciete MCP-resources gedocumenteerd in de repository.

git clone https://github.com/66julienmartin/MCP-server-Deepseek_R1.git

cd deepseek-r1-mcp

npm install

.env.exemple naar .env en stel je DeepSeek API-sleutel in.{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

Gebruik omgevingsvariabelen in je configuratie om API-sleutels veilig te houden:

{

"mcpServers": {

"deepseek_r1": {

"command": "node",

"args": ["/path/to/deepseek-r1-mcp/build/index.js"],

"env": {

"DEEPSEEK_API_KEY": "your-api-key"

}

}

}

}

MCP gebruiken in FlowHunt

Om MCP-servers in je FlowHunt-workflow te integreren, voeg je het MCP-component toe aan je flow en verbind je deze met je AI-agent:

Klik op het MCP-component om het configuratievenster te openen. Voeg in de systeem-MCP-configuratie je MCP-servergegevens in met dit JSON-formaat:

{

"deepseek_r1": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Na configuratie kan de AI-agent deze MCP nu als tool gebruiken met toegang tot alle functies en mogelijkheden. Vergeet niet “deepseek_r1” te wijzigen naar de daadwerkelijke naam van je MCP-server en de URL te vervangen door je eigen MCP-server URL.

| Sectie | Beschikbaarheid | Details/Opmerkingen |

|---|---|---|

| Overzicht | ✅ | |

| Lijst van Prompts | ⛔ | Geen prompt templates gedocumenteerd |

| Lijst van Resources | ⛔ | Geen expliciete MCP-resources gedocumenteerd |

| Lijst van Tools | ✅ | Geavanceerde tekstgeneratie-tool |

| API-sleutels beveiligen | ✅ | Gebruik env-variabelen in configuratie |

| Sampling-ondersteuning (minder belangrijk) | ⛔ | Niet gedocumenteerd |

| Ondersteunt Roots | ⛔ | Niet gedocumenteerd |

Op basis van de beschikbare documentatie biedt de Deepseek R1 MCP Server een schone, gerichte implementatie die eenvoudig te configureren en te gebruiken is, maar ontbreekt het aan documentatie voor prompts, resources of geavanceerde MCP-functies zoals roots en sampling. Dit maakt hem zeer praktisch voor tekstgeneratie, maar minder rijk aan features voor complexe workflows.

| Heeft een LICENSE | ✅ (MIT) |

|---|---|

| Heeft minstens één tool | ✅ |

| Aantal Forks | 12 |

| Aantal Stars | 58 |

Het is een Model Context Protocol (MCP) server die fungeert als brug tussen Claude Desktop (of andere platforms) en DeepSeek’s geavanceerde taalmodellen (R1, V3), waarmee verbeterde tekstgeneratie, redeneren en automatisering in je AI-workflows mogelijk worden.

De server ondersteunt Deepseek R1 en DeepSeek V3—beide modellen zijn geoptimaliseerd voor grote contextvensters en complexe redeneertaken.

Toepassingen zijn onder andere geavanceerde tekstgeneratie (langvormig, technisch of creatief), redeneerintensieve taken, naadloze AI-assistent-verbetering in Claude Desktop en het automatiseren van contentcreatie of kennisbeheer via API.

Gebruik altijd omgevingsvariabelen in je MCP-serverconfiguratie om onbedoelde blootstelling van je DeepSeek API-sleutel te voorkomen.

Er zijn geen prompt templates of expliciete MCP-resources gedocumenteerd in de repository; de server is gericht op directe modeltoegang en integratie.

DeepSeek R1 biedt een contextvenster van 8192 tokens, waarmee lange en complexe taken kunnen worden verwerkt.

Ja, het is MIT-gelicentieerd en beschikbaar op GitHub.

Ontgrendel geavanceerde tekstgeneratie en redeneren door FlowHunt of Claude Desktop te verbinden met DeepSeek R1’s krachtige modellen. Begin vandaag nog met het bouwen van slimmere workflows.

De DeepSeek MCP Server integreert DeepSeek's geavanceerde taalmodellen met MCP-compatibele applicaties en biedt veilige, geanonimiseerde API-toegang, waardoor s...

De DeepSeek MCP Server fungeert als een veilige proxy en verbindt DeepSeek's geavanceerde taalmodellen met MCP-compatibele applicaties zoals Claude Desktop of F...

Deepseek Thinker MCP Server integreert Deepseek-modelredenering in MCP-geschikte AI-clients zoals Claude Desktop, en biedt geavanceerde chain-of-thought-uitvoer...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.