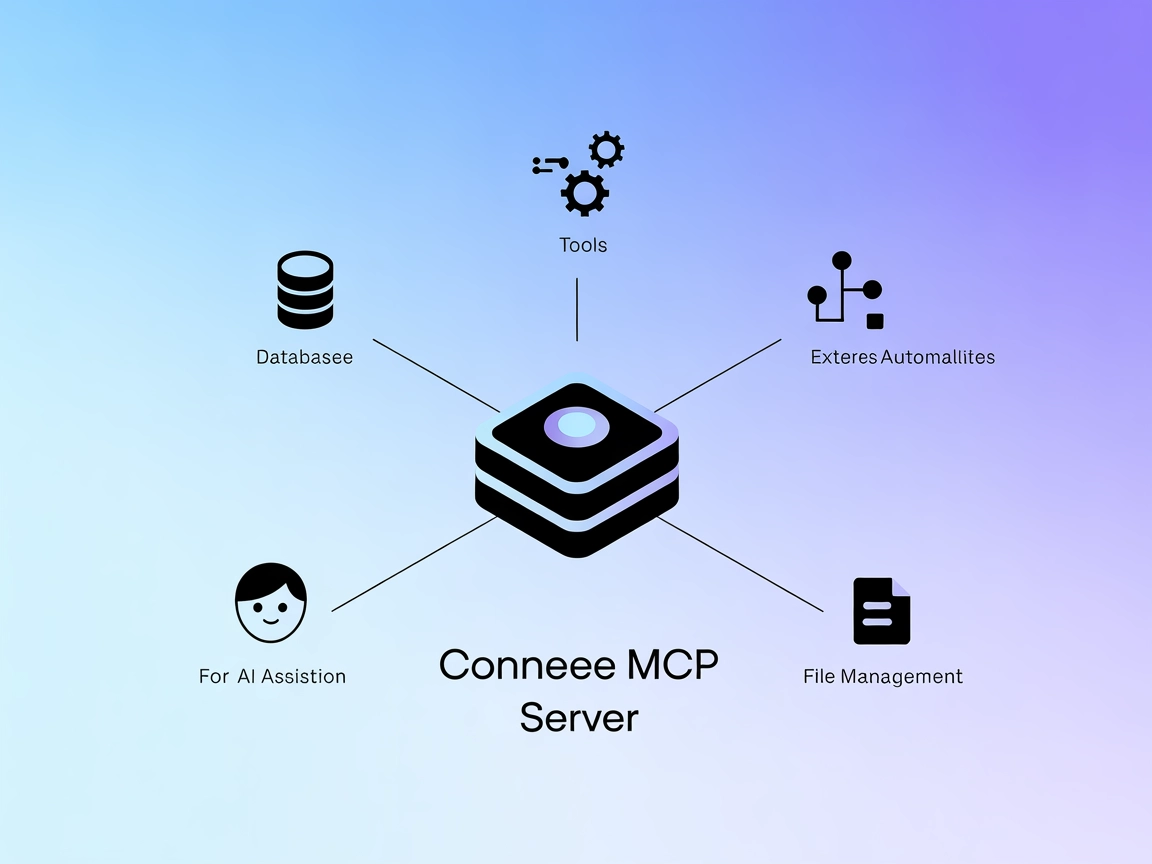

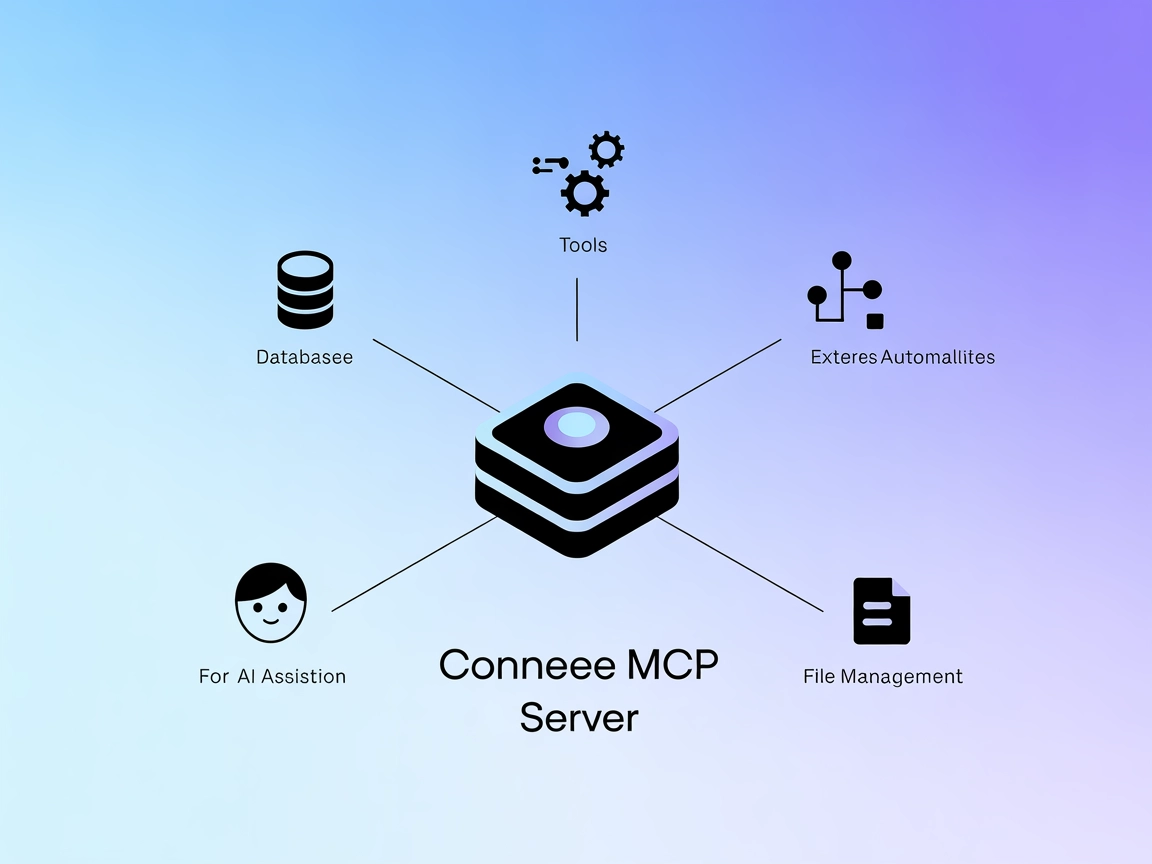

Cognee MCP-server

Cognee MCP (Model Context Protocol) Server kobler AI-assistenter med eksterne datakilder, API-er og tjenester—og muliggjør strømlinjeformede arbeidsflyter, auto...

Koble dine KI-agenter til eksterne API-er og ressurser med lingo.dev MCP-serveren, forenkler tilgangen og standardiserer interaksjoner i FlowHunt.

FlowHunt gir et ekstra sikkerhetslag mellom dine interne systemer og AI-verktøy, og gir deg granulær kontroll over hvilke verktøy som er tilgjengelige fra dine MCP-servere. MCP-servere som er hostet i vår infrastruktur kan sømløst integreres med FlowHunts chatbot samt populære AI-plattformer som ChatGPT, Claude og forskjellige AI-editorer.

lingo.dev MCP (Model Context Protocol) serveren fungerer som en bro mellom KI-assistenter og et bredt spekter av eksterne datakilder, API-er og tjenester. Ved å eksponere strukturerte ressurser, prompt-maler og kjørbare verktøy, gjør den det mulig for KI-modeller å utføre avanserte oppgaver som å spørre databaser, håndtere filer og samhandle med API-er. Denne serveren forbedrer utviklerens arbeidsflyt ved å gjøre det enklere å standardisere og dele vanlige LLM-interaksjoner, og effektiviserer alt fra utforsking av kodebaser til sanntids datainnhenting i KI-drevne miljøer.

Bruke MCP i FlowHunt

For å integrere MCP-servere i FlowHunt-arbeidsflyten din, start med å legge til MCP-komponenten i flyten og koble den til KI-agenten din:

Klikk på MCP-komponenten for å åpne konfigurasjonspanelet. I systemets MCP-konfigurasjonsseksjon setter du inn MCP-serverdetaljene dine med dette JSON-formatet:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Når dette er konfigurert, kan KI-agenten bruke denne MCP-en som et verktøy med tilgang til alle dens funksjoner og kapasiteter. Husk å endre “MCP-name” til det faktiske navnet på MCP-serveren din (f.eks. “github-mcp”, “weather-api”, osv.) og bytt ut URL-en med din egen MCP-server-URL.

| Seksjon | Tilgjengelighet | Detaljer/Notater |

|---|---|---|

| Oversikt | ✅ | |

| Liste over prompts | ⛔ | |

| Liste over ressurser | ⛔ | |

| Liste over verktøy | ⛔ | |

| Sikring av API-nøkler | ⛔ | |

| Støtte for sampling (mindre viktig i vurdering) | ⛔ |

Mellom den tilgjengelige informasjonen og de manglende seksjonene gir denne MCP-dokumentasjonen kun en veldig kort oversikt, uten tekniske detaljer, prompts, verktøy eller ressurser listet.

Basert på informasjonen som er tilgjengelig i den medfølgende filen, er dokumentasjonen til lingo.dev MCP-repositoriet minimal og mangler det praktiske og tekniske innholdet utviklere trenger for raskt å forstå, sette opp eller bruke MCP-serveren. Dette ville blitt vurdert som lite nyttig.

| Har en LISENS | |

|---|---|

| Har minst ett verktøy | |

| Antall forks | |

| Antall stjerner |

lingo.dev MCP-serveren fungerer som en bro mellom KI-assistenter og eksterne datakilder, API-er og tjenester, og eksponerer strukturerte ressurser og verktøy for avanserte LLM-arbeidsflyter.

Legg til MCP-komponenten i FlowHunt-flyten din, åpne konfigurasjonspanelet, og sett inn MCP-serverdetaljene dine i systemets MCP-konfigurasjonsseksjon med riktig JSON-format.

Typiske bruksområder inkluderer å spørre databaser, håndtere filer og samhandle med API-er i KI-drevne miljøer, noe som forbedrer og standardiserer utviklerarbeidsflyter.

Nei, den nåværende dokumentasjonen er minimal og mangler teknisk innhold som lister over prompts, verktøy eller ressurser.

Se beste praksis for håndtering av miljøvariabler for å lagre sensitiv informasjon sikkert, ettersom den medfølgende dokumentasjonen ikke dekker dette aspektet.

Utvid dine KI-agenters muligheter ved å koble dem til eksterne ressurser og API-er med lingo.dev MCP-serveren i FlowHunt.

Cognee MCP (Model Context Protocol) Server kobler AI-assistenter med eksterne datakilder, API-er og tjenester—og muliggjør strømlinjeformede arbeidsflyter, auto...

Skyvern MCP (Model Context Protocol) Server fungerer som en bro mellom AI-assistenter og eksterne systemer, og muliggjør sømløs integrasjon med databaser, API-e...

wxflows MCP Server fungerer som en bro mellom AI-assistenter og eksterne datakilder og API-er, og muliggjør sikker, modulær og AI-drevet arbeidsflytautomatiseri...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.