Jak model z 7 milionami parametrów pokonuje czołowe modele AI

Dowiedz się, jak niewielki model z 7 milionami parametrów przewyższa Gemini, DeepSeek i Claude dzięki rekursywnemu rozumowaniu i głębokiemu nadzorowi. Poznaj re...

Dario Amodei, CEO Anthropic, rozmawia z Lexem Fridmanem o przyszłości AI, w tym o prawach skalowania, harmonogramach AGI, bezpieczeństwie, interpretowalności i regulacjach.

Skalowanie ma kluczowe znaczenie dla tworzenia bardziej wydajnych i zaawansowanych modeli AI. Prawo skalowania to koncepcja, zgodnie z którą zwiększanie rozmiaru modeli i liczby parametrów prowadzi do poprawy wydajności AI. Amodei omawia wpływ skalowania na możliwości modeli, wskazując, że większe modele wykazują lepsze umiejętności uczenia się i rozumowania. Wskazuje także na konieczność znalezienia równowagi między wielkością a efektywnością sieci neuronowych, co może prowadzić do przełomowych osiągnięć w zastosowaniach AI.

Amodei przewiduje, że AI może osiągnąć inteligencję na poziomie człowieka już w latach 2026-2027. Prognoza ta opiera się na obecnych trendach w zakresie mocy obliczeniowej, dostępu do danych i dynamicznego rozwoju technologii AI. Jego przemyślenia obejmują nie tylko kamienie milowe technologiczne na drodze do tej inteligencji, ale również kwestie etyczne i filozoficzne, które się z tym wiążą.

Jednym z głównych wyzwań jest koncentracja władzy AI w rękach kilku silnych podmiotów. Amodei ostrzega, że może to prowadzić do nierównego dostępu do technologii i potencjalnych nadużyć, pogłębiając globalne nierówności i zagrażając demokracji. Aby temu zaradzić, konieczna jest sprawiedliwa dystrybucja postępów AI, by każdy mógł odnieść korzyści i żadna pojedyncza organizacja nie zmonopolizowała tej technologii.

Kluczowe jest zrozumienie wewnętrznego działania AI, czyli mechanistycznej interpretowalności, aby bezpiecznie wdrażać sztuczną inteligencję. Amodei podkreśla potrzebę zrozumienia, jak AI podejmuje decyzje i przewiduje wyniki. Poprawiając przejrzystość i interpretowalność, badacze mogą lepiej przewidywać zachowania AI, wykrywać uprzedzenia i zmniejszać ryzyko, zwłaszcza gdy systemy te stają się coraz bardziej autonomiczne w ważnych sektorach, takich jak opieka zdrowotna, finanse czy bezpieczeństwo narodowe.

Hierarchia modeli jest kluczowym elementem podejścia Anthropic do AI. Amodei opisuje, w jaki sposób różne rozmiary modeli służą różnym zastosowaniom – od mniejszych modeli do codziennych zadań po większe do specjalistycznych potrzeb. Ta uporządkowana strategia umożliwia elastyczne wykorzystanie AI w różnych dziedzinach, zapewniając rozwiązania dopasowane do wymagań branżowych i społecznych.

Framework RSP Anthropic podkreśla ich zaangażowanie w bezpieczeństwo AI poprzez odpowiedzialne skalowanie. Ten framework obejmuje systematyczne kroki w skalowaniu modeli AI, dbając o to, by wraz ze wzrostem możliwości sztucznej inteligencji jej wykorzystanie pozostawało bezpieczne, etyczne i społecznie odpowiedzialne. Dzięki temu podejściu Anthropic stara się sprostać potencjalnym wyzwaniom etycznym w rozwoju AI, promując postęp ostrożny, ale innowacyjny.

Regulacja AI jest kluczowa, by nakierować jej rozwój na pozytywne i bezpieczne tory. Amodei opowiada się za kompleksowymi ramami prawnymi regulującymi technologie AI, podkreślając przepisy ustanawiające jasne standardy bezpieczeństwa i nadzoru. To proaktywne podejście ma na celu zapobieganie nadużyciom AI, a jednocześnie wspieranie postępu technologicznego chroniącego interes publiczny i dobro społeczne.

W dyskusji pojawiają się także ograniczenia wynikające z obecnych możliwości obliczeniowych i dostępności danych, które mogą zahamować przyszły rozwój AI. Pokonanie tych barier wymaga poszukiwania nowych metod obliczeniowych, jak np. komputery kwantowe, aby wesprzeć kolejne etapy rozwoju AI. Kluczowe jest także znalezienie zrównoważonych i skalowalnych rozwiązań do zarządzania danymi przy jednoczesnej ochronie prywatności.

Prawa skalowania AI odnoszą się do tendencji, według której zwiększanie rozmiaru i liczby parametrów modeli AI prowadzi do poprawy ich wydajności. Dario Amodei podkreśla, że większe modele zazwyczaj wykazują lepsze zdolności uczenia się i rozumowania, lecz kluczowe pozostaje zachowanie równowagi między wielkością modelu a jego efektywnością.

Dario Amodei przewiduje, że AI może osiągnąć inteligencję na poziomie człowieka między 2026 a 2027 rokiem, opierając się na trendach w zakresie mocy obliczeniowej, dostępu do danych i szybkiego rozwoju technologicznego.

Mechanistyczna interpretowalność jest kluczowa, ponieważ pomaga badaczom zrozumieć, w jaki sposób modele AI podejmują decyzje i przewidują wyniki. Ta przejrzystość umożliwia lepsze przewidywanie zachowań AI, identyfikację uprzedzeń i ograniczanie ryzyka, gdy AI staje się coraz bardziej autonomiczna w kluczowych sektorach.

Kluczowe wyzwania obejmują koncentrację władzy AI w rękach nielicznych podmiotów, potencjalne nadużycia, globalne nierówności oraz zagrożenia dla demokracji. Aby przeciwdziałać tym problemom, konieczne jest sprawiedliwe rozłożenie i odpowiedzialne skalowanie technologii AI.

Dario Amodei opowiada się za kompleksowymi ramami prawnymi i regulacjami, które wyznaczają jasne standardy bezpieczeństwa i nadzoru nad rozwojem AI, mając na celu zapobieganie nadużyciom przy jednoczesnej ochronie interesu publicznego oraz wspieraniu odpowiedzialnego postępu technologicznego.

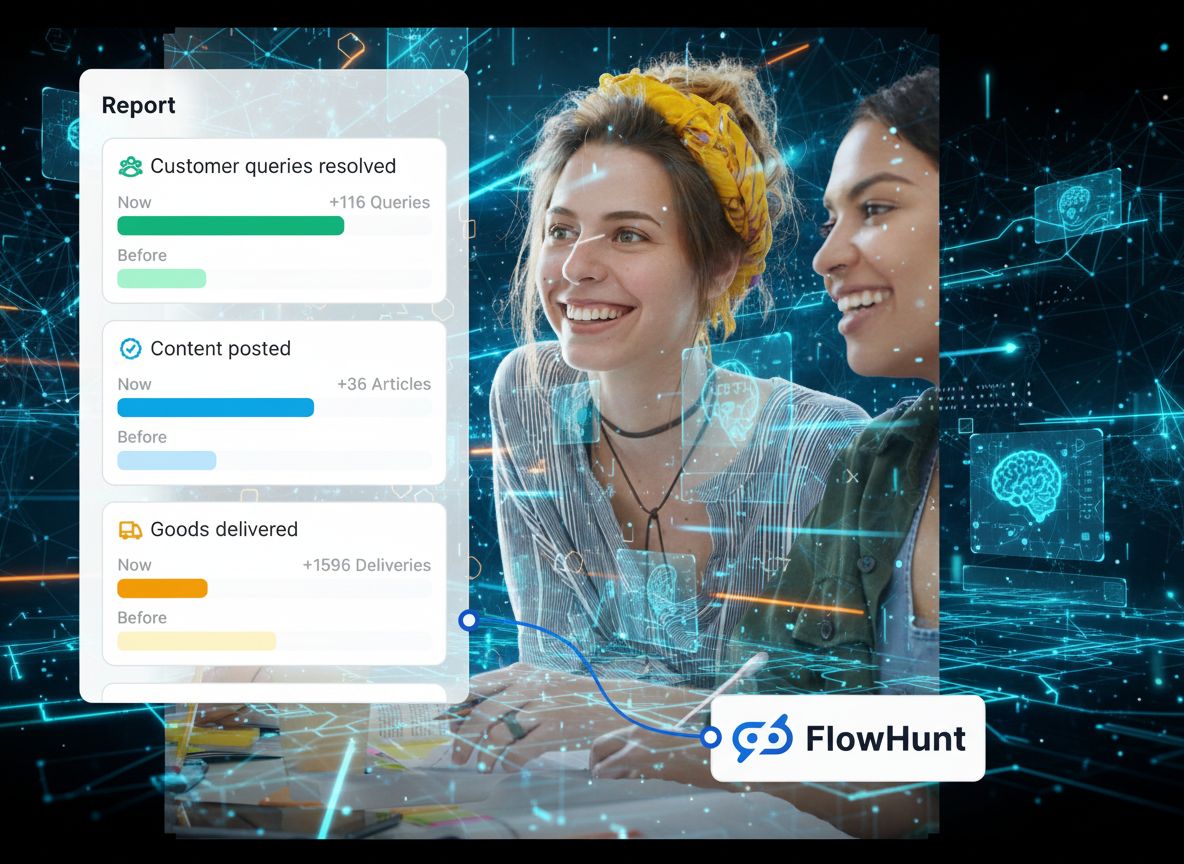

Viktor Zeman jest współwłaścicielem QualityUnit. Nawet po 20 latach kierowania firmą pozostaje przede wszystkim inżynierem oprogramowania, specjalizującym się w AI, programatycznym SEO i programowaniu backendu. Przyczynił się do powstania wielu projektów, w tym LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab i wielu innych.

Odkryj, jak możesz korzystać z FlowHunt do tworzenia własnych chatbotów i narzędzi AI. Zacznij budować zautomatyzowane Flows bez wysiłku.

Dowiedz się, jak niewielki model z 7 milionami parametrów przewyższa Gemini, DeepSeek i Claude dzięki rekursywnemu rozumowaniu i głębokiemu nadzorowi. Poznaj re...

Poznaj wyważoną perspektywę Andreja Karpathy'ego na temat harmonogramu AGI, agentów AI i dlaczego nadchodząca dekada będzie kluczowa dla rozwoju sztucznej intel...

Wyjaśnialna Sztuczna Inteligencja (XAI) to zestaw metod i procesów mających na celu uczynienie wyników modeli AI zrozumiałymi dla ludzi, co sprzyja przejrzystoś...