mcp-proxy Serwer MCP

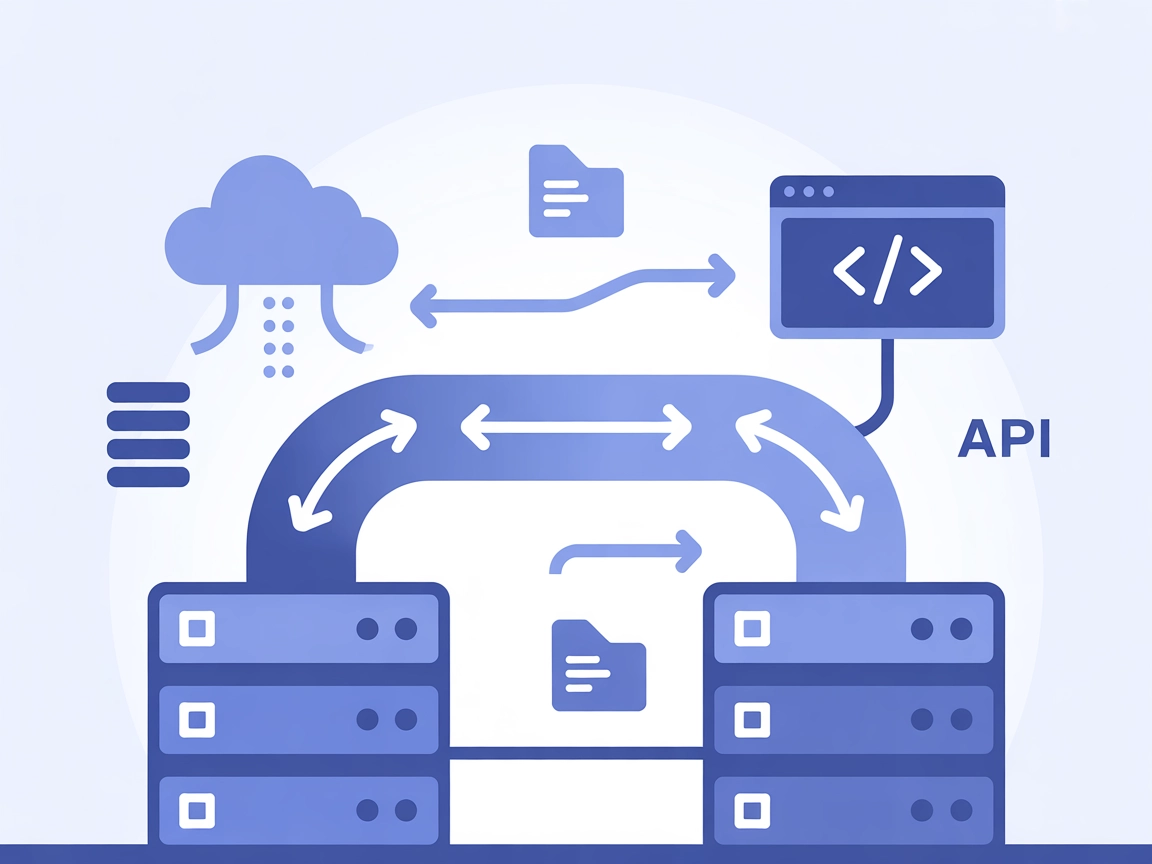

Serwer mcp-proxy MCP łączy Streamable HTTP i stdio MCP transports, umożliwiając płynną integrację pomiędzy asystentami AI a różnorodnymi serwerami lub klientami...

Agreguj wiele serwerów MCP w jeden, zunifikowany punkt końcowy, usprawniając przepływy pracy AI z transmisją na żywo i scentralizowaną konfiguracją.

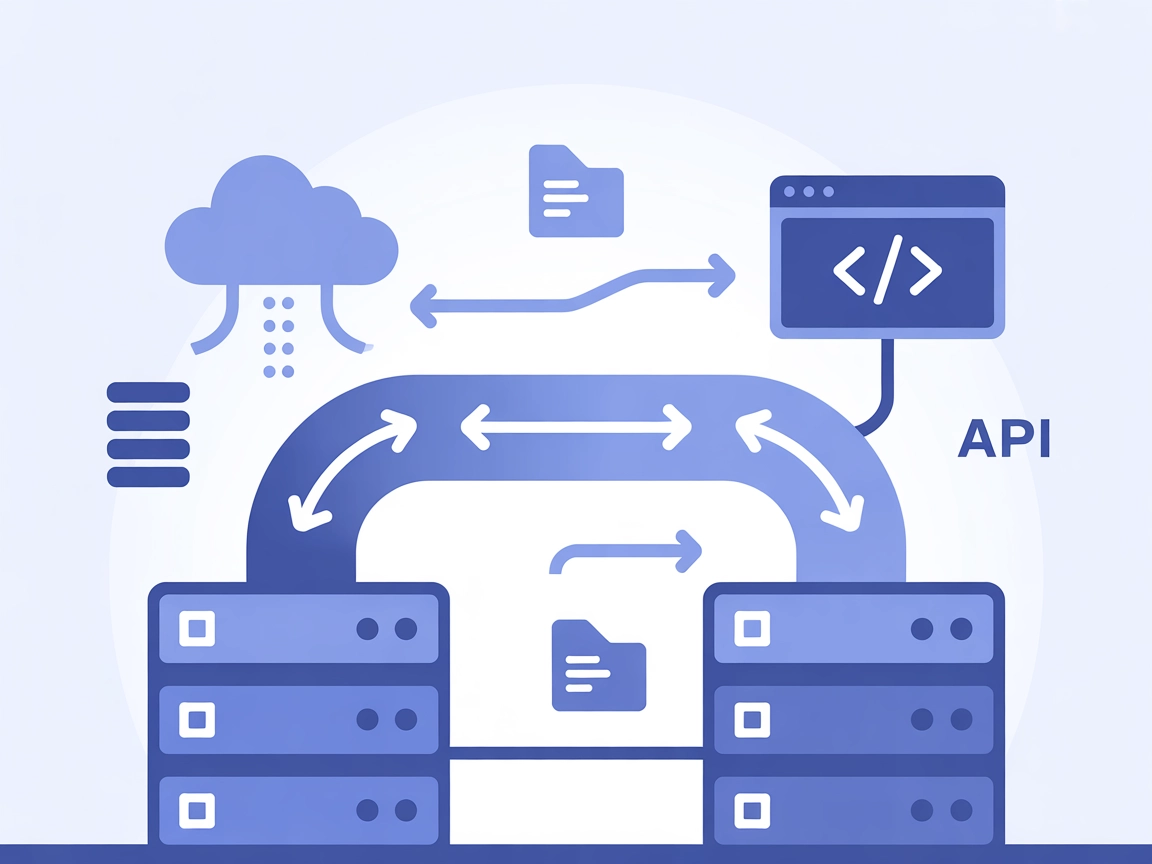

FlowHunt zapewnia dodatkową warstwę bezpieczeństwa między Twoimi systemami wewnętrznymi a narzędziami AI, dając Ci szczegółową kontrolę nad tym, które narzędzia są dostępne z Twoich serwerów MCP. Serwery MCP hostowane w naszej infrastrukturze można bezproblemowo zintegrować z chatbotem FlowHunt oraz popularnymi platformami AI, takimi jak ChatGPT, Claude i różne edytory AI.

Serwer MCP Proxy to narzędzie, które agreguje i udostępnia wiele serwerów zasobów MCP (Model Context Protocol) poprzez jeden serwer HTTP. Działając jako proxy, pozwala asystentom AI i klientom łączyć się z kilkoma różnymi serwerami MCP jednocześnie, łącząc ich narzędzia, zasoby i możliwości w jednym interfejsie. Takie rozwiązanie upraszcza integrację, ponieważ deweloperzy i przepływy pracy AI mogą uzyskać dostęp do różnych zewnętrznych źródeł danych, API lub usług przez jeden punkt końcowy. Serwer MCP Proxy obsługuje aktualizacje na żywo poprzez SSE (Server-Sent Events) lub streaming HTTP i jest wysoko konfigurowalny, co ułatwia realizację złożonych zadań, takich jak zapytania do baz danych, zarządzanie plikami czy integracje API, kierując je przez odpowiednie, podłączone serwery MCP.

Brak informacji o szablonach promptów w repozytorium ani w dokumentacji.

Brak jawnie udokumentowanych zasobów w repozytorium ani w przykładowej konfiguracji. Serwer agreguje zasoby z podłączonych serwerów MCP, ale żadne nie są wymienione bezpośrednio.

Serwer MCP Proxy nie udostępnia własnych narzędzi; działa jako proxy dla narzędzi z innych skonfigurowanych serwerów MCP (np. github, fetch, amap – patrz przykład konfiguracji).

mcpServers."mcpServers": {

"mcp-proxy": {

"command": "npx",

"args": ["@TBXark/mcp-proxy@latest"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "<YOUR_TOKEN>"

}

}

}

Uwaga: Klucze API przechowuj w zmiennych środowiskowych tak jak powyżej.

mcpServers:"mcpServers": {

"mcp-proxy": {

"command": "npx",

"args": ["@TBXark/mcp-proxy@latest"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "<YOUR_TOKEN>"

}

}

}

Uwaga: Używaj zmiennych środowiskowych dla tajnych tokenów.

"mcpServers": {

"mcp-proxy": {

"command": "npx",

"args": ["@TBXark/mcp-proxy@latest"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "<YOUR_TOKEN>"

}

}

}

Uwaga: Używaj zmiennych środowiskowych do przechowywania wrażliwych danych.

"mcpServers": {

"mcp-proxy": {

"command": "npx",

"args": ["@TBXark/mcp-proxy@latest"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "<YOUR_TOKEN>"

}

}

}

Uwaga: Klucze API przechowuj w parametrze env jak w przykładzie.

"mcpServers": {

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "<YOUR_TOKEN>"

}

}

}

Użycie MCP w FlowHunt

Aby zintegrować serwery MCP z przepływem pracy FlowHunt, zacznij od dodania komponentu MCP do swojego flow i połącz go z agentem AI:

Kliknij na komponent MCP, aby otworzyć panel konfiguracji. W sekcji konfiguracji systemowej MCP wstaw szczegóły swojego serwera MCP w poniższym formacie JSON:

{

"mcp-proxy": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI może korzystać z tego MCP jako narzędzia z dostępem do wszystkich jego funkcji i możliwości. Pamiętaj, aby zamienić “mcp-proxy” na faktyczną nazwę swojego serwera MCP oraz podać własny adres URL serwera.

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | |

| Lista promptów | ⛔ | Brak szablonów promptów w repozytorium. |

| Lista zasobów | ⛔ | Brak jawnych zasobów; agreguje z innych serwerów MCP. |

| Lista narzędzi | ⛔ | Brak własnych narzędzi; pośredniczy w narzędziach z innych serwerów. |

| Zabezpieczanie kluczy API | ✅ | Konfiguracja wspiera env dla tajnych danych. |

| Sampling Support (mniej istotne w ocenie) | ⛔ | Nie wspomniane w dostępnej dokumentacji. |

Na podstawie powyższego, MCP Proxy to użyteczna warstwa agregacji zasobów MCP, ale nie udostępnia własnych narzędzi, zasobów ani szablonów promptów; jest to głównie rozwiązanie konfiguracyjne i routujące.

Ten serwer MCP najlepiej sprawdza się jako narzędzie backendowe, niewskazany do samodzielnego użytku, ale doskonały do agregacji i zarządzania wieloma serwerami MCP w jednym przepływie pracy. Dokumentacja jest czytelna w zakresie konfiguracji i bezpieczeństwa, ale brakuje szczegółów dot. promptów, narzędzi i zasobów. Ogólnie rzecz biorąc, to solidny element infrastruktury dla zaawansowanych użytkowników. Ocena: 5/10.

| Ma LICENCJĘ | ✅ (MIT) |

|---|---|

| Przynajmniej jedno narzędzie | ⛔ (Tylko proxy, brak narzędzi) |

| Liczba forków | 43 |

| Liczba gwiazdek | 315 |

MCP Proxy Server to narzędzie backendowe agregujące wiele serwerów zasobów MCP (Model Context Protocol) w jeden serwer HTTP. Umożliwia asystentom AI i deweloperom dostęp do narzędzi, API i źródeł danych z kilku serwerów MCP przez zunifikowany punkt końcowy, upraszczając integrację i zarządzanie.

Najważniejsze zastosowania to: agregowanie wielu serwerów MCP dla uproszczonego dostępu, działanie jako zunifikowana brama API dla różnych źródeł danych, obsługa transmisji danych w czasie rzeczywistym przez SSE/HTTP, umożliwienie elastycznej integracji klientów oraz scentralizowane uwierzytelnianie i logowanie dla bezpieczeństwa.

Nie, MCP Proxy Server nie udostępnia bezpośrednio narzędzi ani zasobów. Zamiast tego pośredniczy i agreguje narzędzia oraz zasoby z podłączonych serwerów MCP skonfigurowanych w Twoim środowisku.

Zawsze używaj zmiennych środowiskowych (właściwość `env` w konfiguracji) do przechowywania tajnych danych jak tokeny API, jak pokazano w przykładzie konfiguracji dla każdego klienta. Pomaga to zapewnić, że Twoje dane uwierzytelniające pozostaną bezpieczne i nie zostaną ujawnione w plikach konfiguracyjnych.

Dodaj komponent MCP do swojego flow i w konfiguracji systemowej MCP wstaw szczegóły swojego MCP Proxy Server w formacie JSON. Dzięki temu Twój agent AI uzyska dostęp do wszystkich zintegrowanych narzędzi i zasobów przez jeden punkt końcowy. Upewnij się, że zaktualizujesz nazwę serwera oraz adres URL zgodnie z własną konfiguracją.

Ujednolić swoje przepływy pracy AI i automatyzacji, łącząc wiele serwerów MCP przez potężny MCP Proxy. Uprość integrację już dziś.

Serwer mcp-proxy MCP łączy Streamable HTTP i stdio MCP transports, umożliwiając płynną integrację pomiędzy asystentami AI a różnorodnymi serwerami lub klientami...

Serwer Model Context Protocol (MCP) łączy asystentów AI z zewnętrznymi źródłami danych, API i usługami, umożliwiając płynną integrację złożonych przepływów prac...

Serwer DeepSeek MCP integruje zaawansowane modele językowe DeepSeek z aplikacjami zgodnymi z MCP, zapewniając bezpieczny, zanonimizowany dostęp do API i umożliw...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.