Pinecone Assistant MCP Server

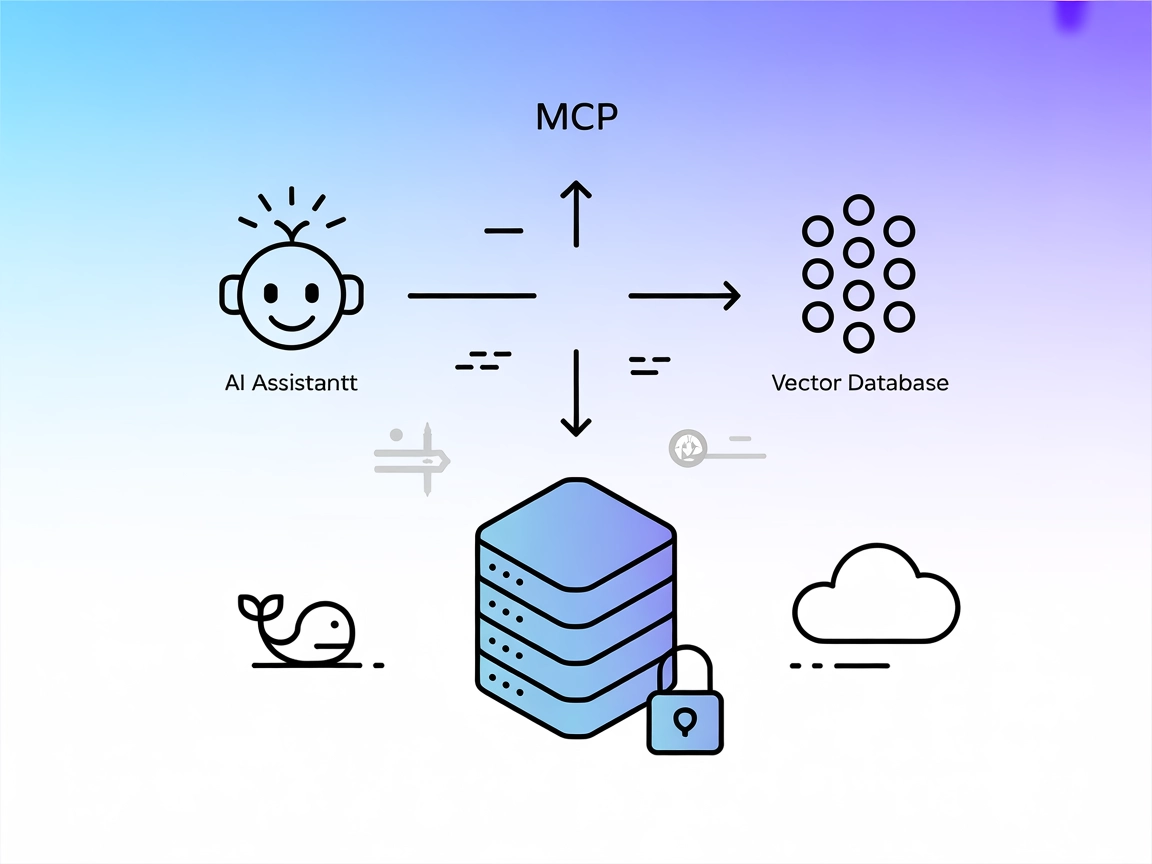

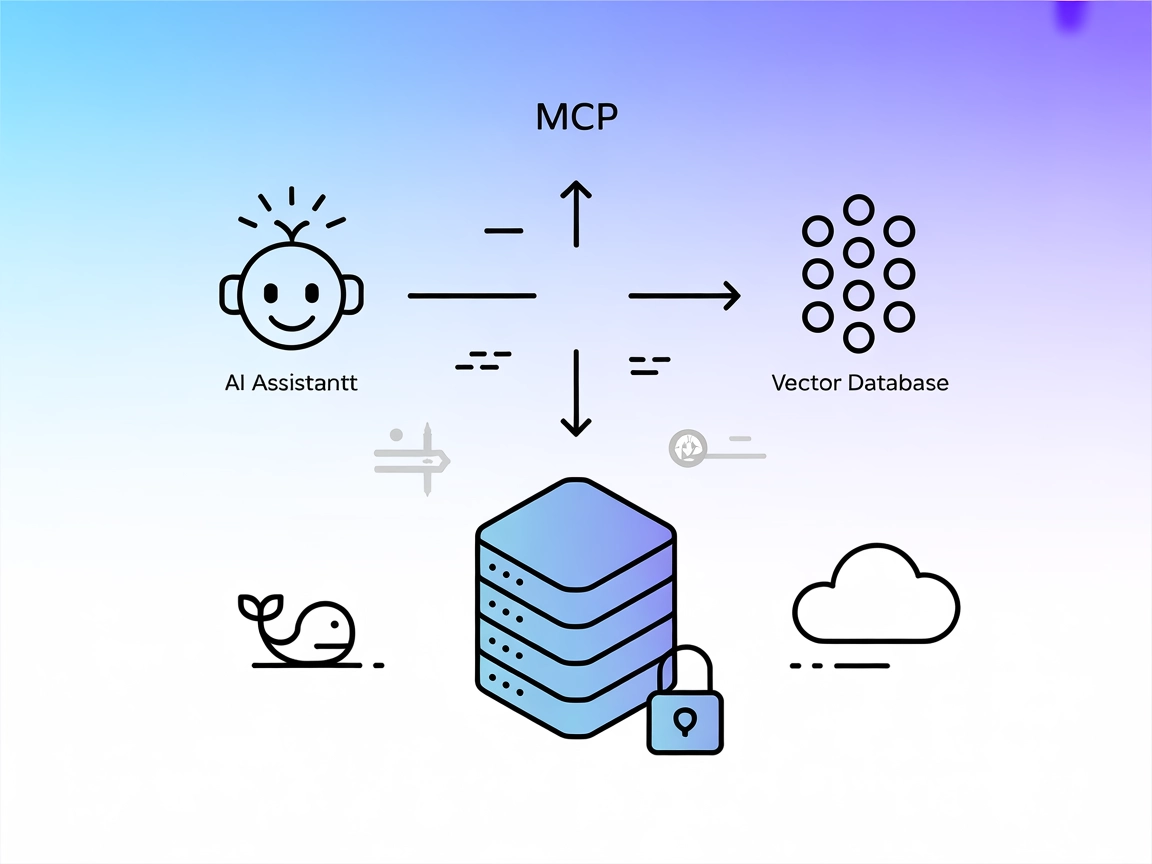

O Pinecone Assistant MCP Server faz a ponte entre assistentes de IA e o banco de dados vetorial da Pinecone, permitindo busca semântica, recuperação de múltiplo...

Automação de IA

Conecte o FlowHunt ao Pinecone para busca semântica avançada, gerenciamento de dados vetoriais e aplicações de IA impulsionadas por RAG.

O FlowHunt fornece uma camada de segurança adicional entre seus sistemas internos e ferramentas de IA, dando-lhe controle granular sobre quais ferramentas são acessíveis a partir de seus servidores MCP. Os servidores MCP hospedados em nossa infraestrutura podem ser perfeitamente integrados com o chatbot do FlowHunt, bem como com plataformas de IA populares como ChatGPT, Claude e vários editores de IA.

O Pinecone MCP (Model Context Protocol) Server é uma ferramenta especializada que conecta assistentes de IA a bancos de dados vetoriais Pinecone, permitindo leitura e escrita de dados de forma integrada para fluxos de desenvolvimento aprimorados. Atuando como intermediário, o Pinecone MCP Server possibilita que clientes de IA executem tarefas como busca semântica, recuperação de documentos e gerenciamento de banco de dados dentro de um índice Pinecone. Ele suporta operações como busca por registros similares, gerenciamento de documentos e inserção de novos embeddings. Essa capacidade é especialmente valiosa para aplicações que envolvem Geração Aumentada por Recuperação (RAG), pois facilita a integração de dados contextuais nos fluxos de trabalho de IA e automatiza interações complexas com dados.

Nenhum template de prompt explícito é mencionado no repositório.

{

"mcpServers": {

"pinecone-mcp": {

"command": "mcp-pinecone",

"args": []

}

}

}

Protegendo chaves de API com variáveis de ambiente:

{

"mcpServers": {

"pinecone-mcp": {

"command": "mcp-pinecone",

"env": {

"PINECONE_API_KEY": "sua_chave_api"

},

"inputs": {

"index_name": "seu_index"

}

}

}

}

pip install mcp-pinecone).{

"mcpServers": {

"pinecone-mcp": {

"command": "mcp-pinecone",

"args": []

}

}

}

{

"mcpServers": {

"pinecone-mcp": {

"command": "mcp-pinecone",

"args": []

}

}

}

{

"mcpServers": {

"pinecone-mcp": {

"command": "mcp-pinecone",

"args": []

}

}

}

Nota: Sempre proteja suas chaves de API e valores sensíveis com variáveis de ambiente como mostrado acima.

Usando MCP no FlowHunt

Para integrar MCP servers ao seu fluxo do FlowHunt, comece adicionando o componente MCP ao seu fluxo e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração do sistema MCP, insira os detalhes do seu servidor MCP usando este formato JSON:

{

"pinecone-mcp": {

"transport": "streamable_http",

"url": "https://seumcpserver.exemplo/caminhoparamcp/url"

}

}

Uma vez configurado, o agente de IA poderá usar este MCP como uma ferramenta com acesso a todas as suas funções e capacidades. Lembre-se de alterar “pinecone-mcp” para o nome real do seu MCP server e substituir a URL pela URL do seu próprio servidor MCP.

| Seção | Disponível | Detalhes/Notas |

|---|---|---|

| Visão Geral | ✅ | Descreve a integração do banco vetorial Pinecone MCP |

| Lista de Prompts | ⛔ | Nenhum template de prompt explícito encontrado |

| Lista de Recursos | ✅ | Índice Pinecone, documentos, registros, estatísticas |

| Lista de Ferramentas | ✅ | semantic-search, read-document, list-documents, pinecone-stats, process-document |

| Proteção de Chaves de API | ✅ | Exemplo fornecido com variáveis de ambiente na configuração |

| Suporte a Amostragem (menos importante) | ⛔ | Nenhuma menção ou evidência encontrada |

O Pinecone MCP Server é bem documentado, expõe recursos e ferramentas de forma clara e inclui instruções sólidas para integração e segurança de chaves de API. No entanto, faltam templates de prompt explícitos e documentação sobre suporte a amostragem ou roots. No geral, é um servidor prático e valioso para fluxos de trabalho RAG e Pinecone, mas poderia ser aprimorado com mais exemplos de uso e recursos avançados.

Avaliação: 8/10

| Possui LICENSE | ✅ (MIT) |

|---|---|

| Possui ao menos uma ferramenta | ✅ |

| Número de Forks | 25 |

| Número de Estrelas | 124 |

O Pinecone MCP Server conecta assistentes de IA a bancos de dados vetoriais Pinecone, permitindo busca semântica, gerenciamento de documentos e fluxos de trabalho de incorporação dentro de aplicações de IA como o FlowHunt.

Ele expõe ferramentas para busca semântica, leitura e listagem de documentos, recuperação de estatísticas de índices e processamento de documentos em embeddings para inserção no índice Pinecone.

O servidor permite que agentes de IA recuperem contexto relevante do Pinecone, permitindo que LLMs gerem respostas fundamentadas em fontes externas de conhecimento.

Armazene sua chave de API Pinecone e nome do índice como variáveis de ambiente no seu arquivo de configuração, conforme mostrado nas instruções de integração, para manter suas credenciais seguras.

Casos de uso comuns incluem busca semântica em grandes coleções de documentos, pipelines RAG, divisão e incorporação automática de documentos, e monitoramento de estatísticas do índice Pinecone.

Habilite busca semântica e Geração Aumentada por Recuperação no FlowHunt conectando seus agentes de IA a bancos de dados vetoriais Pinecone.

O Pinecone Assistant MCP Server faz a ponte entre assistentes de IA e o banco de dados vetorial da Pinecone, permitindo busca semântica, recuperação de múltiplo...

Integre o FlowHunt com o Pinecone Model Context Protocol (MCP) Server para uma busca vetorial impulsionada por IA, processamento de documentos e gestão avançada...

Integre e automatize os dashboards, fontes de dados e ferramentas de monitoramento do Grafana em fluxos de trabalho de desenvolvimento orientados por IA usando ...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.