Retrieval vs Cache Augmented Generation (CAG vs. RAG)

Objavte kľúčové rozdiely medzi Retrieval-Augmented Generation (RAG) a Cache-Augmented Generation (CAG) v AI. Zistite, ako RAG dynamicky získava informácie v reá...

Preusporiadanie dokumentov zdokonaľuje získané výsledky vyhľadávania uprednostnením dokumentov najrelevantnejších k dopytu používateľa, čím zlepšuje presnosť AI a RAG systémov.

Preusporiadanie dokumentov preusporadúva získané dokumenty podľa relevantnosti k dopytu, čím zdokonaľuje výsledky vyhľadávania. Rozšírenie dopytu vylepšuje vyhľadávanie pridaním súvisiacich pojmov, zvyšuje pokrytie a rieši nejednoznačnosť. Kombinácia týchto techník v RAG systémoch zvyšuje presnosť vyhľadávania a kvalitu odpovedí.

Preusporiadanie dokumentov je proces preusporiadania získaných dokumentov na základe ich relevantnosti k dopytu používateľa. Po počiatočnom vyhľadávaní preusporiadanie spresňuje výsledky presnejším hodnotením relevantnosti každého dokumentu, čím zabezpečuje, že sú uprednostnené najpodstatnejšie dokumenty.

Retrieval-Augmented Generation (RAG) je pokročilý rámec, ktorý kombinuje schopnosti veľkých jazykových modelov (LLM) s informačnými vyhľadávacími systémami. V RAG systéme, keď používateľ zadá dopyt, systém vyhľadá relevantné dokumenty z rozsiahlej znalostnej bázy a tieto informácie poskytne LLM na generovanie informovaných a kontextovo presných odpovedí. Tento prístup zvyšuje presnosť a relevantnosť AI generovaného obsahu tým, že ho zakotvuje vo faktických údajoch.

Definícia

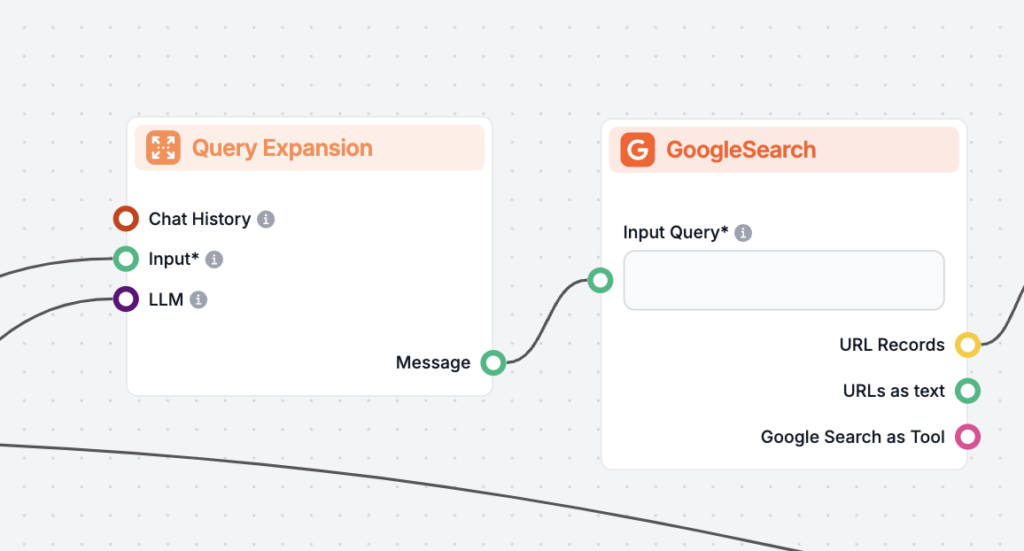

Rozšírenie dopytu je technika používaná v informačnom vyhľadávaní na zvýšenie efektivity vyhľadávacích dopytov. Zahŕňa rozšírenie pôvodného dopytu o ďalšie pojmy alebo frázy, ktoré sú sémanticky príbuzné. Hlavným cieľom je preklenúť medzeru medzi zámerom používateľa a jazykom použitým v relevantných dokumentoch, čím sa zlepšuje vyhľadanie podstatných informácií.

Ako to funguje

V praxi možno rozšírenie dopytu dosiahnuť viacerými metódami:

Rozšírením dopytu môže vyhľadávací systém zachytiť dokumenty, ktoré by mohli byť vynechané kvôli odlišnostiam v terminológii alebo formuláciách.

Zlepšovanie pokrytia

Pokrytie označuje schopnosť vyhľadávacieho systému nájsť všetky relevantné dokumenty. Rozšírenie dopytu zvyšuje pokrytie tým, že:

Riešenie nejednoznačnosti dopytu

Používatelia často zadávajú krátke alebo nejednoznačné dopyty. Rozšírenie dopytu pomáha:

Zlepšenie párovania dokumentov

Zahrnutím ďalších relevantných pojmov systém zvyšuje pravdepodobnosť zhody dopytu s dokumentmi, ktoré môžu používať inú slovnú zásobu, čím sa zvyšuje celková efektivita vyhľadávania.

Čo je PRF?

Pseudo-relevance feedback je automatická metóda rozšírenia dopytu, v ktorej systém predpokladá, že najvyššie ohodnotené dokumenty z počiatočného vyhľadávania sú relevantné. Z týchto dokumentov extrahuje dôležité pojmy na spresnenie pôvodného dopytu.

Ako PRF funguje

Výhody a nevýhody

Využitie veľkých jazykových modelov

S pokrokom v AI môžu LLM ako GPT-3 a GPT-4 generovať sofistikované rozšírenia dopytu vďaka porozumeniu kontextu a sémantiky.

Ako funguje LLM rozšírenie

Príklad

Pôvodný dopyt:

“Aké boli najdôležitejšie faktory, ktoré prispeli k zvýšeniu tržieb?”

LLM generovaná odpoveď:

“V danom účtovnom roku prispelo k významnému zvýšeniu tržieb spoločnosti niekoľko kľúčových faktorov, vrátane úspešných marketingových kampaní, diverzifikácie produktov, iniciatív na spokojnosť zákazníkov, strategického stanovovania cien a investícií do technológií.”

Rozšírený dopyt:

“Pôvodný dopyt: Aké boli najdôležitejšie faktory, ktoré prispeli k zvýšeniu tržieb?

Hypotetická odpoveď: [LLM generovaná odpoveď]”

Výhody

Výzvy

Postup krok za krokom

Výhody v RAG systémoch

Prečo je preusporiadanie potrebné

Prehľad

Cross-encoder je neurónový model, ktorý prijíma dvojicu vstupov (dopyt a dokument) a vygeneruje skóre relevantnosti. Na rozdiel od bi-encoderov, ktoré kódujú dopyt a dokument samostatne, cross-encoder ich spracováva spoločne, čo umožňuje bohatšiu interakciu medzi nimi.

Ako cross-encoder funguje

Výhody

Výzvy

Čo je ColBERT?

ColBERT (Contextualized Late Interaction over BERT) je vyhľadávací model navrhnutý na vyváženie efektivity a účinnosti. Využíva mechanizmus oneskorenej interakcie, ktorý umožňuje detailné porovnávanie medzi tokenmi dopytu a dokumentu bez vysokých výpočtových nákladov.

Ako ColBERT funguje

Výhody

Použitie

Prehľad

FlashRank je ľahká a rýchla knižnica na preusporiadanie, ktorá využíva najmodernejšie cross-encoder modely. Je navrhnutá na jednoduchú integráciu do existujúcich pipeline a vylepšenie výkonu preusporiadania s minimálnou záťažou.

Vlastnosti

Príklad použitia

from flashrank import Ranker, RerankRequest

query = 'What were the most important factors that contributed to increases in revenue?'

ranker = Ranker(model_name="ms-marco-MiniLM-L-12-v2")

rerank_request = RerankRequest(query=query, passages=documents)

results = ranker.rerank(rerank_request)

Výhody

Proces

Úvahy

Doplnkové techniky

Výhody kombinácie

Ukážkový workflow

Rozšírenie dopytu pomocou LLM:

def expand_query(query):

prompt = f"Provide additional related queries for: '{query}'"

expanded_queries = llm.generate(prompt)

expanded_query = ' '.join([query] + expanded_queries)

return expanded_query

Počiatočné vyhľadanie:

documents = vector_db.retrieve_documents(expanded_query)

Preusporiadanie dokumentov:

from sentence_transformers import CrossEncoder

cross_encoder = CrossEncoder('cross-encoder/ms-marco-MiniLM-L-6-v2')

pairs = [[query, doc.text] for doc in documents]

scores = cross_encoder.predict(pairs)

ranked_docs = [doc for _, doc in sorted(zip(scores, documents), reverse=True)]

Výber top dokumentov:

top_documents = ranked_docs[:top_k]

Generovanie odpovede pomocou LLM:

context = '\n'.join([doc.text for doc in top_documents])

prompt = f"Answer the following question using the context provided:\n\nQuestion: {query}\n\nContext:\n{context}"

response = llm.generate(prompt)

Monitoring a optimalizácia

Scenár

Spoločnosť používa AI chatbota na vybavovanie zákazníckych otázok o svojich produktoch a službách. Zákazníci sa často pýtajú rôznymi spôsobmi, používajú odlišné terminológie alebo frázy.

Výzvy

Implementácia

Výhody

Scenár

Výskumníci používajú AI asistenta na vyhľadávanie relevantných akademických článkov, údajov a poznatkov pre svoju prácu.

Výzvy

Implementácia

Preusporiadanie dokumentov je proces preusporiadania získaných dokumentov po počiatočnom vyhľadávaní na základe ich relevantnosti k dopytu používateľa. Zabezpečuje, že sú uprednostnené najrelevantnejšie a najužitočnejšie dokumenty, čím sa zlepšuje kvalita AI vyhľadávania a chatbotov.

V RAG systémoch využíva preusporiadanie dokumentov modely ako cross-encoder alebo ColBERT na posúdenie relevantnosti každého dokumentu k dopytu používateľa po počiatočnom vyhľadaní. Tento krok pomáha zdokonaliť a optimalizovať súbor dokumentov poskytovaných veľkým jazykovým modelom na generovanie presných odpovedí.

Rozšírenie dopytu je technika v informačnom vyhľadávaní, ktorá rozširuje pôvodný dopyt používateľa o príbuzné pojmy alebo frázy, čím zvyšuje pokrytie a rieši nejednoznačnosť. V RAG systémoch pomáha získať relevantnejšie dokumenty, ktoré môžu používať odlišnú terminológiu.

Kľúčové metódy zahŕňajú neuronové modely cross-encoder (ktoré kódujú dopyt a dokument spoločne pre vysoko presné skórovanie), ColBERT (využíva oneskorenú interakciu na efektívne skórovanie) a knižnice ako FlashRank pre rýchle a presné preusporiadanie.

Rozšírenie dopytu rozširuje vyhľadávanie na získanie viac potenciálne relevantných dokumentov, zatiaľ čo preusporiadanie dokumentov tieto výsledky filtruje a zdokonaľuje, aby sa k AI na generovanie odpovedí dostali len najpodstatnejšie dokumenty, čím sa maximalizuje pokrytie aj presnosť.

Objavte, ako preusporiadanie dokumentov a rozšírenie dopytu môžu zvýšiť presnosť a relevantnosť vašich AI chatbotov a automatizačných tokov. Vytvorte inteligentnejšiu AI s FlowHunt.

Objavte kľúčové rozdiely medzi Retrieval-Augmented Generation (RAG) a Cache-Augmented Generation (CAG) v AI. Zistite, ako RAG dynamicky získava informácie v reá...

Rozšírenie dopytu je proces vylepšenia pôvodného dopytu používateľa pridaním pojmov alebo kontextu, čím sa zlepšuje vyhľadávanie dokumentov pre presnejšie a kon...

Retrieval Augmented Generation (RAG) je pokročilý AI rámec, ktorý kombinuje tradičné systémy na vyhľadávanie informácií s generatívnymi veľkými jazykovými model...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.