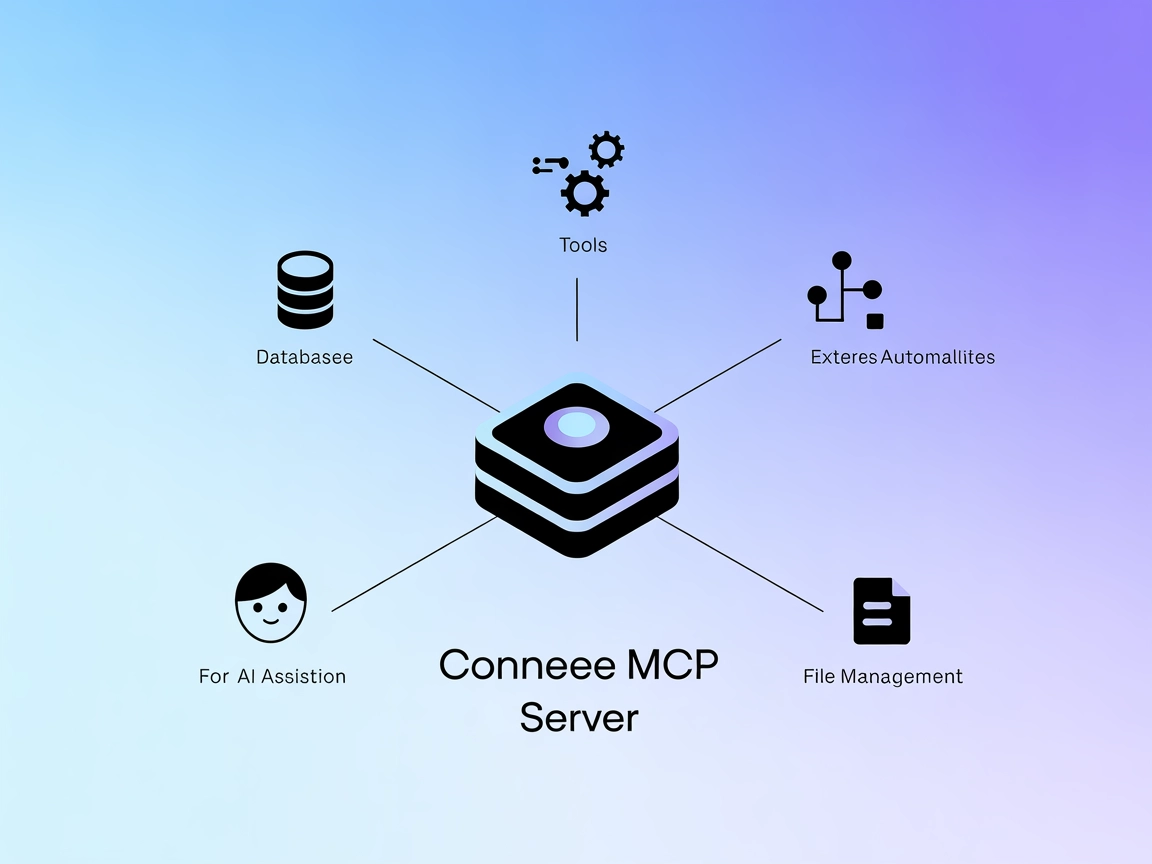

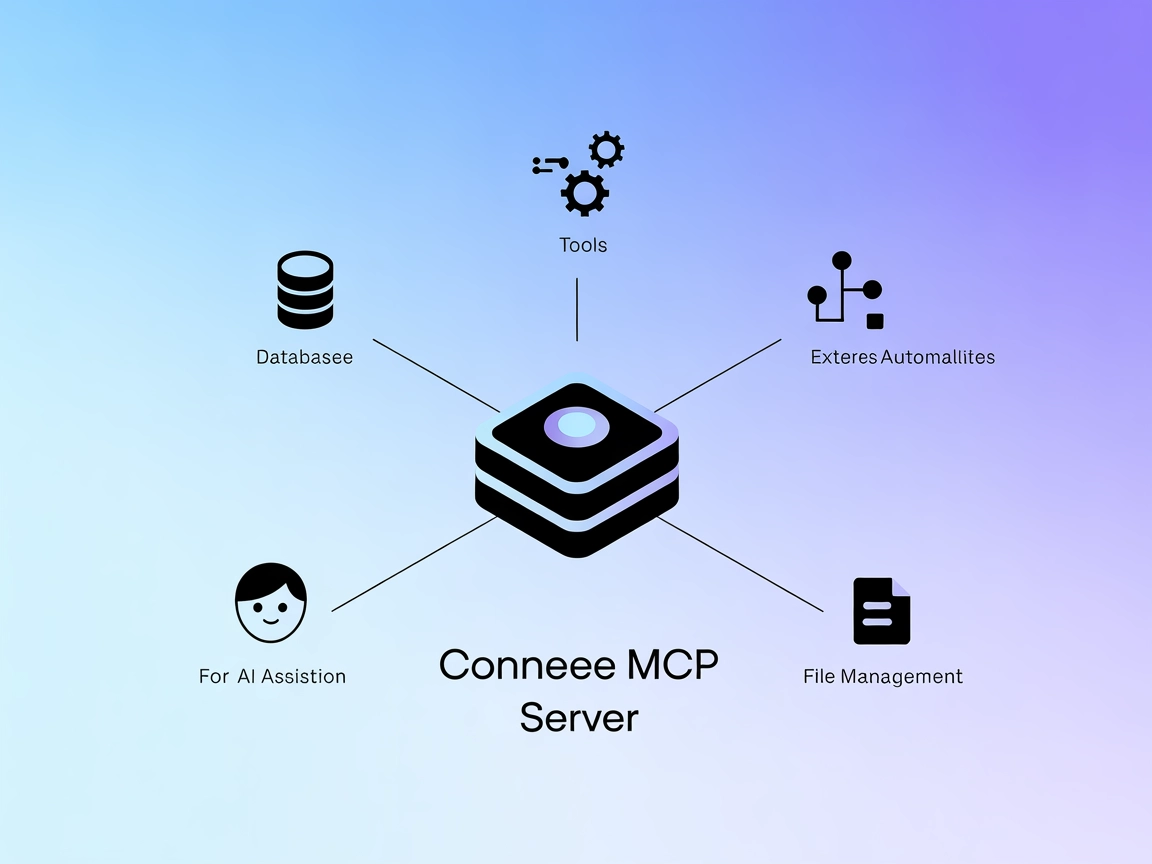

Cognee MCP-server

Cognee MCP (Model Context Protocol) Server kopplar AI-assistenter till externa datakällor, API:er och tjänster—vilket möjliggör strömlinjeformade arbetsflöden, ...

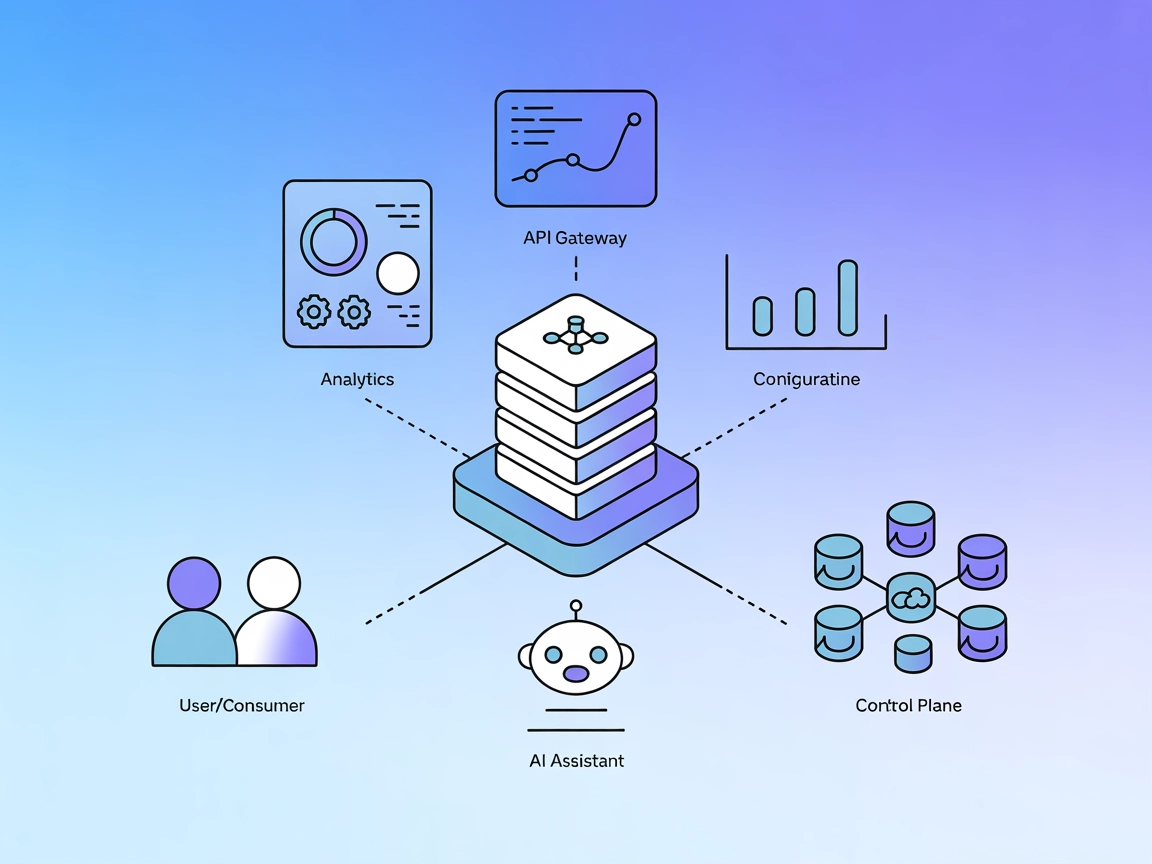

Koppla dina AI-arbetsflöden till Kong Konnects API-gateway för realtidsanalys, konfigurationsgranskning och hantering av kontrollplanet med Kong Konnect MCP-server.

FlowHunt erbjuder ett extra säkerhetslager mellan dina interna system och AI-verktyg, vilket ger dig granulär kontroll över vilka verktyg som är tillgängliga från dina MCP-servrar. MCP-servrar som hostas i vår infrastruktur kan sömlöst integreras med FlowHunts chatbot samt populära AI-plattformar som ChatGPT, Claude och olika AI-redigerare.

Kong Konnect MCP-servern är en Model Context Protocol (MCP)-server som gör det möjligt för AI-assistenter, som Claude, att interagera direkt med Kong Konnects API-gateway. Denna server fungerar som en brygga och ger AI-drivna verktyg möjlighet att fråga och analysera gatewaykonfigurationer, trafik och analysdata via naturligt språk. Utvecklare kan använda servern för att hämta analysdata, granska API-gatewaykonfigurationer och hantera kontrollplan, allt via standardiserade MCP-verktyg. Genom att integrera externa datakällor som Kong Konnect API:er i AI-arbetsflöden förenklar denna MCP-server uppgifter som trafikövervakning, konfigurationsgranskning och hantering av API-tjänster, vilket ökar effektiviteten och intelligensen i utvecklings- och driftarbete.

Fråga API-förfrågningar

Fråga och analysera förfrågningar till Kong API-gateway med anpassningsbara filter som tidsintervall, statuskoder, HTTP-metoder, konsument-ID och mer.

Hämta konsumentförfrågningar

Analysera API-förfrågningar gjorda av en specifik konsument, filtrerat på konsument-ID och tidsintervall.

API-analys och rapportering

Utvecklare och driftsteam kan använda servern för att hämta detaljerad analys av API-förfrågningar, inklusive filtrering på statuskoder, metoder, konsumenter, tjänster och mer för omfattande övervakning.

Konsumentbeteendeanalys

Analysera förfrågningar och beteenden för enskilda konsumenter, vilket hjälper support-, fakturerings- eller säkerhetsgranskningsuppgifter.

Granskning av gatewaykonfiguration

Lista och inspektera tjänster, rutter, konsumenter och plugins för att granska och verifiera API-gatewaykonfigurationer.

Hantering av kontrollplan

Hantera och inspektera kontrollplaner och kontrollplangrupper för att förenkla administrationen av distribuerade API-gateways.

AI-drivna operationer

Möjliggör för AI-assistenter att göra realtidsfrågor och diagnostik på API-infrastruktur, vilket minskar manuellt arbete och snabbar upp incidenthantering.

git clone https://github.com/Kong/mcp-konnect.git

cd mcp-konnect

npm install

npm run build

export KONNECT_ACCESS_TOKEN=your_api_key

export KONNECT_REGION=us

windsurf.json):{

"mcpServers": {

"kong-konnect": {

"command": "npx",

"args": ["@kong/mcp-konnect@latest"],

"env": {

"KONNECT_ACCESS_TOKEN": "${KONNECT_ACCESS_TOKEN}",

"KONNECT_REGION": "us"

}

}

}

}

{

"mcpServers": {

"kong-konnect": {

"command": "npx",

"args": ["@kong/mcp-konnect@latest"],

"env": {

"KONNECT_ACCESS_TOKEN": "${KONNECT_ACCESS_TOKEN}",

"KONNECT_REGION": "us"

}

}

}

}

{

"mcpServers": {

"kong-konnect": {

"command": "npx",

"args": ["@kong/mcp-konnect@latest"],

"env": {

"KONNECT_ACCESS_TOKEN": "${KONNECT_ACCESS_TOKEN}",

"KONNECT_REGION": "us"

}

}

}

}

{

"mcpServers": {

"kong-konnect": {

"command": "npx",

"args": ["@kong/mcp-konnect@latest"],

"env": {

"KONNECT_ACCESS_TOKEN": "${KONNECT_ACCESS_TOKEN}",

"KONNECT_REGION": "us"

}

}

}

}

Obs!

Skydda alltid API-nycklar genom att använda miljövariabler. Exempel:

{

"mcpServers": {

"kong-konnect": {

"command": "npx",

"args": ["@kong/mcp-konnect@latest"],

"env": {

"KONNECT_ACCESS_TOKEN": "${KONNECT_ACCESS_TOKEN}",

"KONNECT_REGION": "us"

},

"inputs": {

"KONNECT_ACCESS_TOKEN": "env:KONNECT_ACCESS_TOKEN"

}

}

}

}

Använda MCP i FlowHunt

För att integrera MCP-servrar i ditt FlowHunt-arbetsflöde, börja med att lägga till MCP-komponenten i ditt flöde och koppla den till din AI-agent:

Klicka på MCP-komponenten för att öppna konfigurationspanelen. I systemets MCP-konfigurationssektion anger du din MCP-serverinformation med detta JSON-format:

{

"kong-konnect": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

När det är konfigurerat kan AI-agenten nu använda denna MCP som ett verktyg med tillgång till alla dess funktioner och kapaciteter. Kom ihåg att byta ut “kong-konnect” till det faktiska namnet på din MCP-server och ersätta URL:en med din egen MCP-server-URL.

| Sektion | Tillgänglighet | Detaljer/Kommentarer |

|---|---|---|

| Översikt | ✅ | Tillhandahållen i README |

| Lista över prompts | ⛔ | Inga promptmallar dokumenterade |

| Lista över resurser | ⛔ | Inga explicita resurser dokumenterade |

| Lista över verktyg | ✅ | Analys- och konfigurationsverktyg sammanfattade i README |

| Säker API-nyckelhantering | ✅ | Användning av miljövariabler dokumenterad |

| Sampling-stöd (mindre viktigt vid utvärdering) | ⛔ | Ej nämnt |

Baserat på ovanstående är Kong Konnect MCP-server ett pågående arbete men exponerar redan relevanta verktyg för analys och konfiguration. Däremot är resurser och prompts inte dokumenterade, och stöd för roots eller sampling nämns inte. Projektet är öppen källkod, rimligt aktivt och har tydliga installationsinstruktioner.

Kong Konnect MCP-server integreras väl med AI-arbetsflöden för API-drift och analys. Dock begränsar avsaknaden av dokumentation för prompts och resurser samt inget explicit omnämnande av roots eller sampling dess fullständighet. Ändå är det en funktionell och värdefull MCP inom sitt område.

Betyg: 6/10

| Har en LICENS | ✅ (Apache-2.0) |

|---|---|

| Har minst ett verktyg | ✅ |

| Antal forkar | 11 |

| Antal stjärnor | 30 |

Kong Konnect MCP-servern gör det möjligt för AI-assistenter att interagera direkt med Kong Konnects API-gateway och ger realtidsanalys, konfigurationsgranskning och hantering av kontrollplanet via naturliga språkfrågor.

Viktiga användningsområden är API-analys och rapportering, analys av konsumentbeteende, granskning av gatewaykonfiguration, hantering av kontrollplan och möjliggör AI-drivna DevOps-funktioner.

Lagra din Kong Konnect API-nyckel i miljövariabler (t.ex. KONNECT_ACCESS_TOKEN) i din konfiguration för att hålla uppgifterna säkra.

Lägg till MCP-komponenten i ditt FlowHunt-flöde, öppna dess konfiguration och ange serveruppgifterna i JSON-format. Då får din AI-agent tillgång till alla MCP-funktioner.

Ja, den är öppen källkod och licensierad under Apache-2.0.

Ge dina AI-agenter möjlighet att utföra API-analys, konfigurationshantering och realtidsdiagnostik på Kong Konnect med MCP-serverintegrationen.

Cognee MCP (Model Context Protocol) Server kopplar AI-assistenter till externa datakällor, API:er och tjänster—vilket möjliggör strömlinjeformade arbetsflöden, ...

Confluent MCP-servern gör det möjligt för AI-assistenter att interagera med Confluent Clouds API:er, vilket möjliggör naturlig språkhantering av Kafka-ämnen, co...

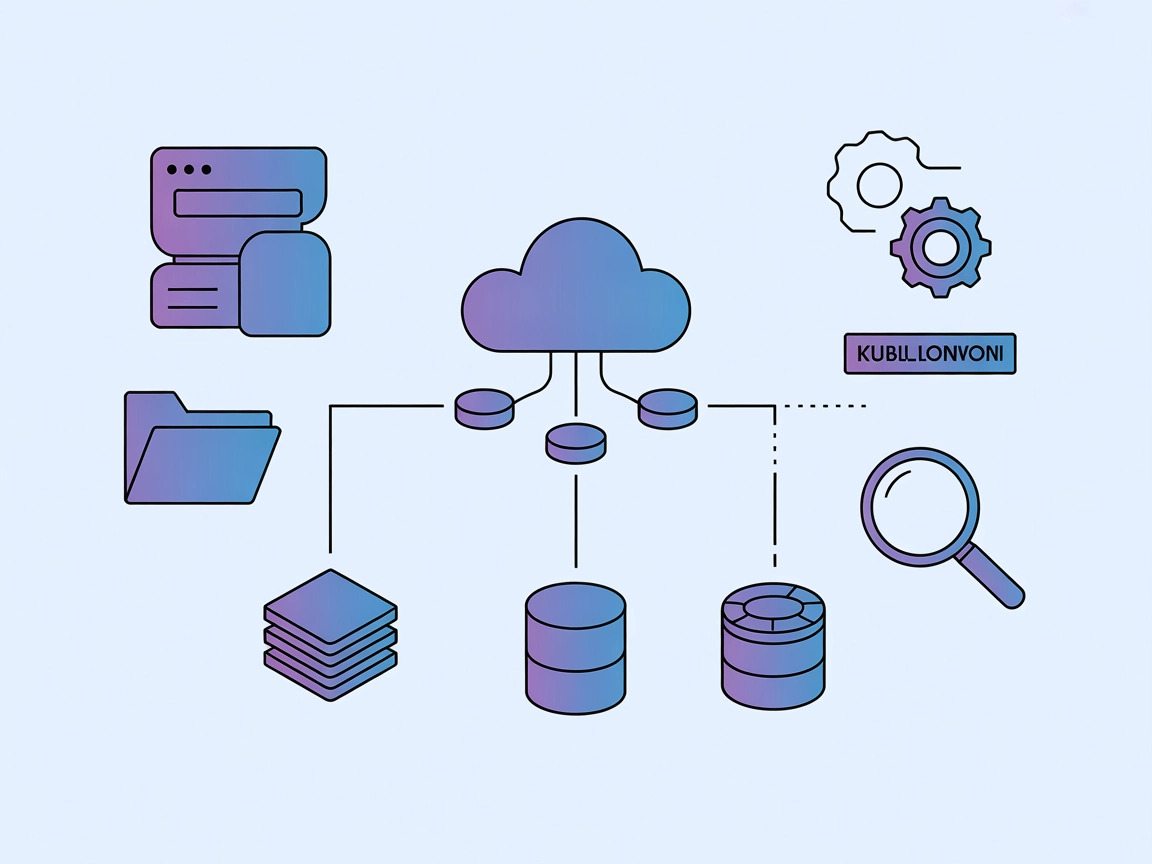

Kubernetes MCP-server fungerar som en brygga mellan AI-assistenter och Kubernetes/OpenShift-kluster, vilket möjliggör programmatisk resursxadhantering, poddxado...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.