Ord-inbäddningar

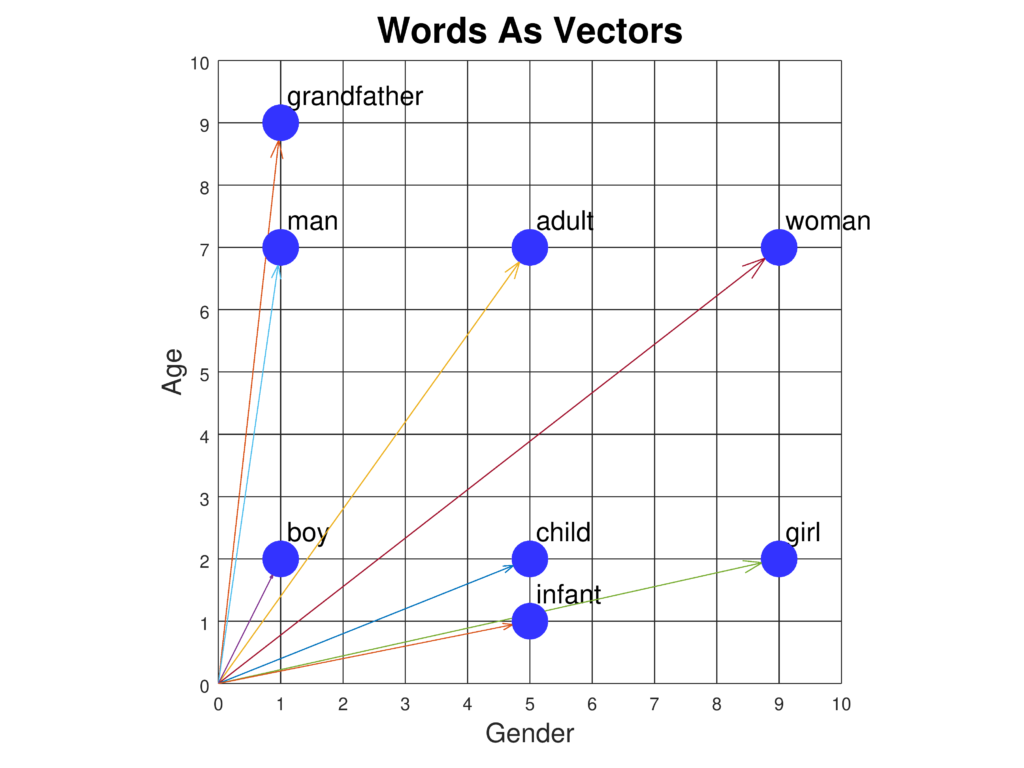

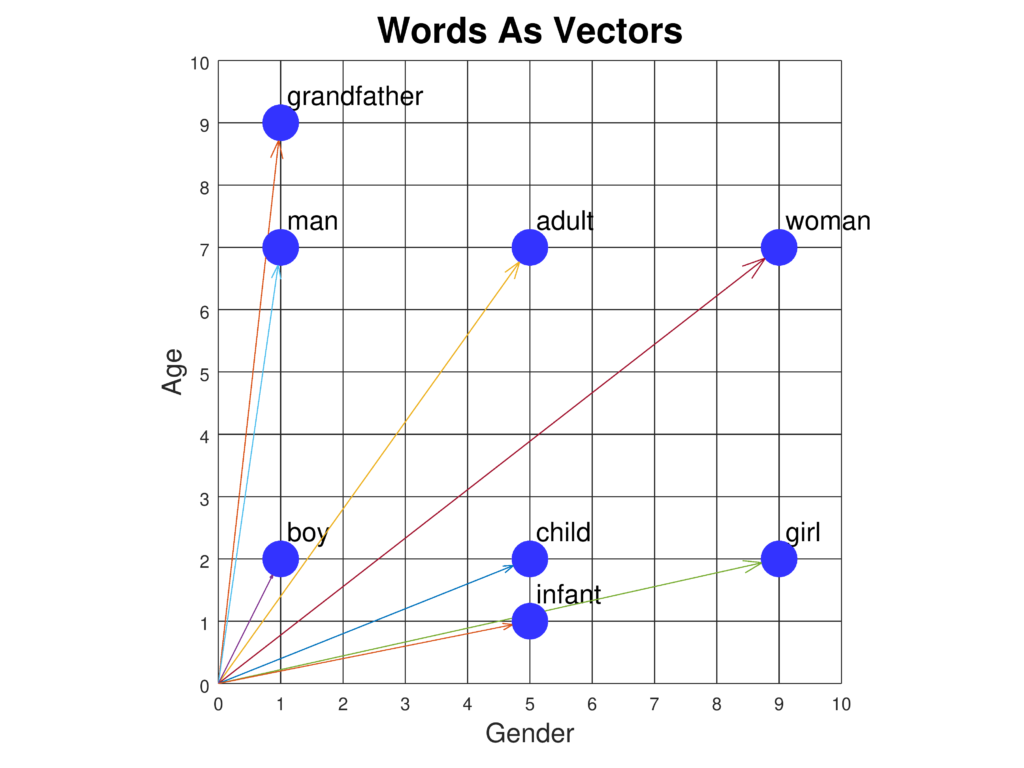

Ord-inbäddningar är sofistikerade representationer av ord i ett kontinuerligt vektorrum som fångar semantiska och syntaktiska relationer för avancerade NLP-uppg...

En inbäddningsvektor är en tät numerisk representation av data i ett flerdimensionellt rum, som fångar semantiska och kontextuella relationer. Lär dig hur inbäddningsvektorer driver AI-uppgifter såsom NLP, bildbehandling och rekommendationer.

En inbäddningsvektor är en tät numerisk representation av data där varje datapunkt mappas till en punkt i ett flerdimensionellt rum. Denna mappning är utformad för att fånga semantisk information och kontextuella relationer mellan olika datapunkter. Liknande datapunkter placeras närmare varandra i detta rum, vilket underlättar uppgifter såsom klassificering, klustring och rekommendation.

Inbäddningsvektorer är i grunden arrayer av siffror som kapslar in de inneboende egenskaperna och relationerna hos den data de representerar. Genom att översätta komplexa datatyper till dessa vektorer kan AI-system utföra olika operationer mer effektivt.

Inbäddningsvektorer är grundläggande för många AI- och ML-applikationer. De förenklar representationen av högdimensionell data och gör det enklare att analysera och tolka.

Att skapa inbäddningsvektorer omfattar flera steg:

Huggingface’s Transformers-bibliotek erbjuder toppmoderna transformermodeller som BERT, RoBERTa och GPT-3. Dessa modeller är förtränade på stora datamängder och ger högkvalitativa inbäddningar som kan finjusteras för specifika uppgifter, vilket gör dem idealiska för att skapa robusta NLP-applikationer.

Säkerställ först att du har transformers-biblioteket installerat i din Python-miljö. Du kan installera det med pip:

pip install transformers

Ladda sedan en förtränad modell från Huggingface model hub. I detta exempel använder vi BERT.

from transformers import BertModel, BertTokenizer

model_name = 'bert-base-uncased'

tokenizer = BertTokenizer.from_pretrained(model_name)

model = BertModel.from_pretrained(model_name)

Tokenisera din inmatningstext för att förbereda den för modellen.

inputs = tokenizer("Hello, Huggingface!", return_tensors='pt')

Kör den tokeniserade texten genom modellen för att få inbäddningar.

outputs = model(**inputs)

embedding_vectors = outputs.last_hidden_state

Här är ett komplett exempel som visar stegen ovan:

from transformers import BertModel, BertTokenizer

# Ladda förtränad BERT-modell och tokenizer

model_name = 'bert-base-uncased'

tokenizer = BertTokenizer.from_pretrained(model_name)

model = BertModel.from_pretrained(model_name)

# Tokenisera inmatningstext

text = "Hello, Huggingface!"

inputs = tokenizer(text, return_tensors='pt')

# Generera inbäddningsvektorer

outputs = model(**inputs)

embedding_vectors = outputs.last_hidden_state

print(embedding_vectors)

SNE är en tidig metod för dimensionalitetsreduktion, utvecklad av Geoffrey Hinton och Sam Roweis. Den fungerar genom att beräkna parvisa likheter i det högdimensionella rummet och försöker bevara dessa likheter i ett lägre dimensionellt rum.

En förbättring av SNE, t-SNE används ofta för att visualisera högdimensionell data. Den minimerar skillnaden mellan två fördelningar: en som representerar parvisa likheter i ursprungsrummet och en i det reducerade rummet, med hjälp av en tungsvansad Student-t-fördelning.

UMAP är en nyare teknik som erbjuder snabbare beräkningar och bättre bevarande av global datastruktur jämfört med t-SNE. Den fungerar genom att konstruera en högdimensionell graf och optimera en lågdimensionell graf för att vara så strukturellt lik som möjligt.

Flera verktyg och bibliotek underlättar visualisering av inbäddningsvektorer:

Börja bygga egna AI-verktyg och chattbotar med FlowHunts plattform utan kod. Förvandla dina idéer till automatiserade Flows enkelt.

Ord-inbäddningar är sofistikerade representationer av ord i ett kontinuerligt vektorrum som fångar semantiska och syntaktiska relationer för avancerade NLP-uppg...

Integrera FlowHunt med Vectorize MCP Server för avancerad vektorsökning, dokumenthämtning och intelligent textektrahering. Superladda din kunskapshantering och ...

AI-sökning är en semantisk eller vektorbaserad sökmetod som använder maskininlärningsmodeller för att förstå avsikten och den kontextuella betydelsen bakom sökf...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.