ديبسيك ثينكر MCP

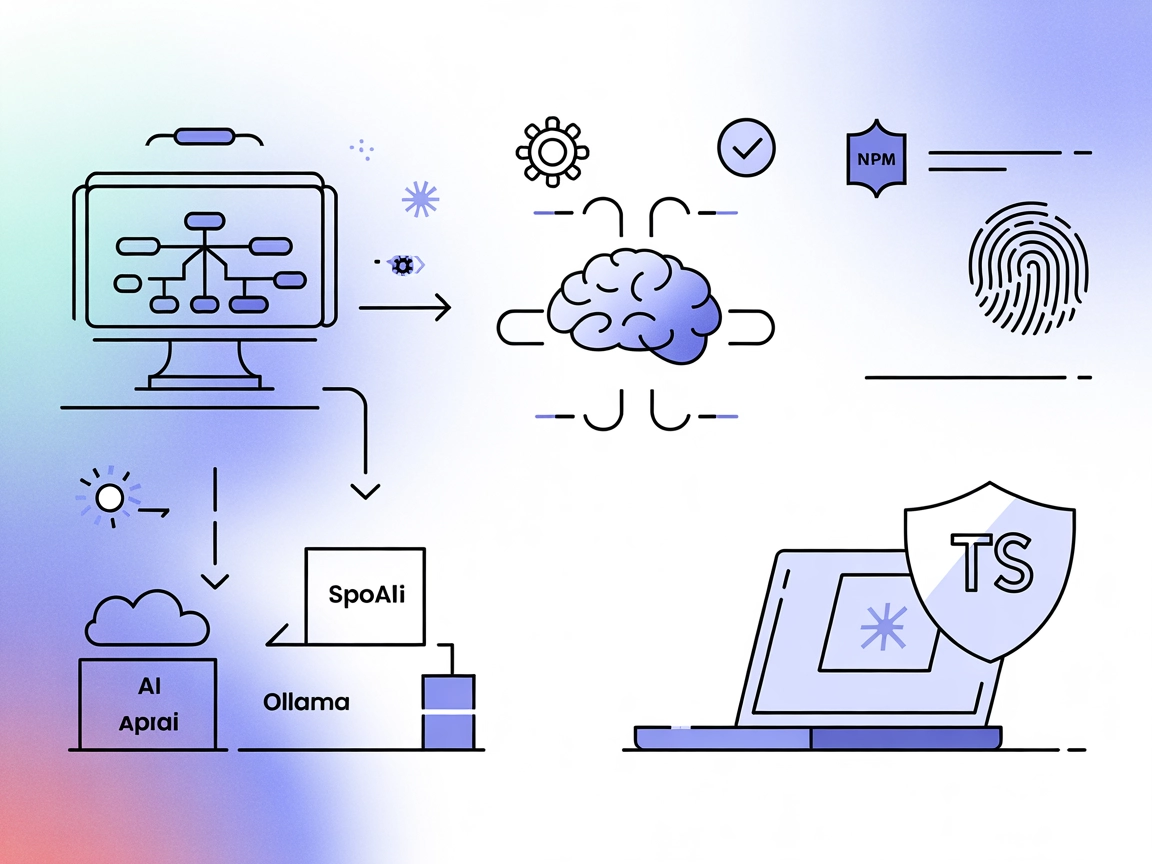

ادمج FlowHunt مع ديبسيك ثينكر MCP لتمكين الاستدلال المتقدم للذكاء الاصطناعي، أوضاع نشر مزدوجة عبر OpenAI API أو Ollama، ومخرجات منظمة خطوة بخطوة لسير العمل المد...

اجلب استدلال ديبسيك الشفاف ومخرجات سلسلة التفكير للذكاء الاصطناعي إلى مساعدينك المدعومين بـ MCP مع دعم النشر السحابي والمحلي.

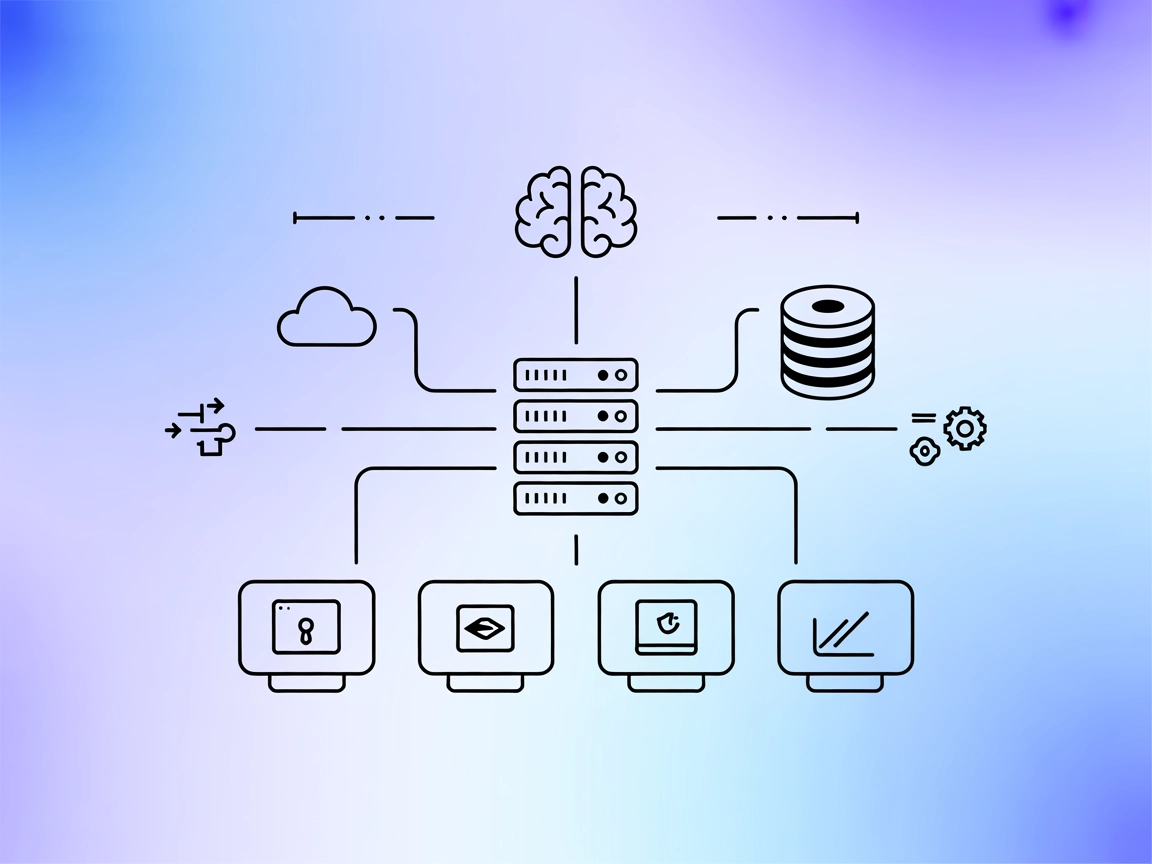

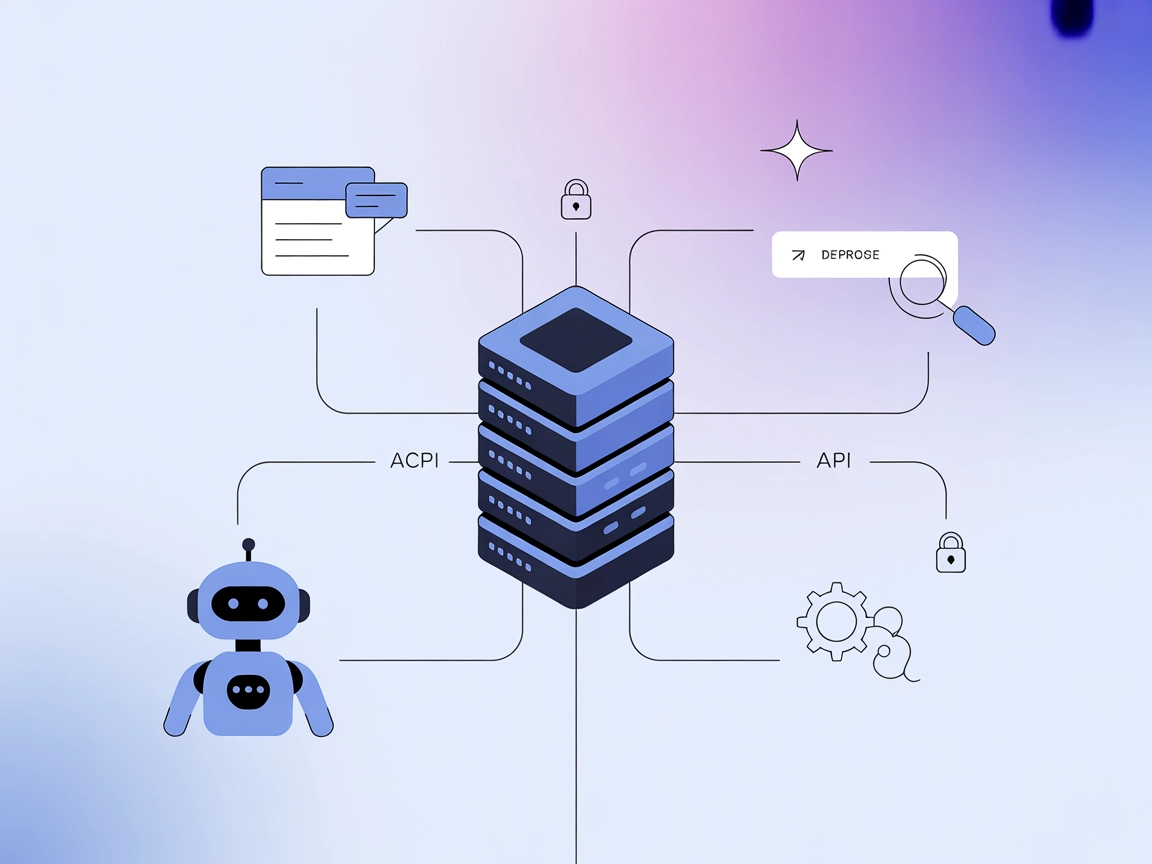

يوفر FlowHunt طبقة أمان إضافية بين أنظمتك الداخلية وأدوات الذكاء الاصطناعي، مما يمنحك تحكماً دقيقاً في الأدوات التي يمكن الوصول إليها من خوادم MCP الخاصة بك. يمكن دمج خوادم MCP المستضافة في بنيتنا التحتية بسلاسة مع روبوت الدردشة الخاص بـ FlowHunt بالإضافة إلى منصات الذكاء الاصطناعي الشائعة مثل ChatGPT وClaude ومحررات الذكاء الاصطناعي المختلفة.

يعمل خادم ديبسيك ثينكر MCP كمزود لبروتوكول سياق النموذج (MCP)، حيث يقدم محتوى استدلال نموذج ديبسيك إلى عملاء الذكاء الاصطناعي المدعومين بـ MCP مثل Claude Desktop. يُمكّن هذا الخادم المساعدين الذكيين من الوصول إلى عمليات التفكير ومخرجات الاستدلال الخاصة بـ ديبسيك إما من خلال خدمة API الخاصة بـ ديبسيك أو من خادم Ollama المحلي. من خلال التكامل مع هذا الخادم، يمكن للمطورين تعزيز سير عمل الذكاء الاصطناعي بالاستدلال المركز، سواء عبر السحابة أو عبر الاستدلال المحلي. هذا الخادم مفيد بشكل خاص في السيناريوهات التي تتطلب سلاسل استدلال مفصلة أو مخرجات سلسلة التفكير (CoT) لإبلاغ المهام اللاحقة للذكاء الاصطناعي، ما يجعله ذو قيمة كبيرة في التطوير المتقدم، وتصحيح الأخطاء، وإثراء وكلاء الذكاء الاصطناعي.

لا توجد قوالب محفزات محددة مذكورة في المستودع أو الوثائق.

لا توجد موارد MCP محددة مفصلة في الوثائق أو قاعدة الشيفرة.

originPrompt (نص) — المحفز الأصلي للمستخدم.windsurf_config.json).mcpServers:{

"deepseek-thinker": {

"command": "npx",

"args": [

"-y",

"deepseek-thinker-mcp"

],

"env": {

"API_KEY": "<Your API Key>",

"BASE_URL": "<Your Base URL>"

}

}

}

claude_desktop_config.json.{

"mcpServers": {

"deepseek-thinker": {

"command": "npx",

"args": [

"-y",

"deepseek-thinker-mcp"

],

"env": {

"API_KEY": "<Your API Key>",

"BASE_URL": "<Your Base URL>"

}

}

}

}

{

"mcpServers": {

"deepseek-thinker": {

"command": "npx",

"args": [

"-y",

"deepseek-thinker-mcp"

],

"env": {

"API_KEY": "<Your API Key>",

"BASE_URL": "<Your Base URL>"

}

}

}

}

{

"mcpServers": {

"deepseek-thinker": {

"command": "npx",

"args": [

"-y",

"deepseek-thinker-mcp"

],

"env": {

"API_KEY": "<Your API Key>",

"BASE_URL": "<Your Base URL>"

}

}

}

}

لكافة المنصات، يجب توفير مفاتيح API والقيم الحساسة باستخدام متغيرات البيئة في قسم env. مثال:

{

"mcpServers": {

"deepseek-thinker": {

"command": "npx",

"args": [

"-y",

"deepseek-thinker-mcp"

],

"env": {

"API_KEY": "<Your API Key>",

"BASE_URL": "<Your Base URL>"

}

}

}

}

للوضع المحلي مع Ollama، عيّن USE_OLLAMA إلى "true" في كائن env:

"env": {

"USE_OLLAMA": "true"

}

استخدام MCP في FlowHunt

لدمج خوادم MCP في سير عمل FlowHunt لديك، ابدأ بإضافة مكون MCP إلى التدفق الخاص بك وربطه بوكيل الذكاء الاصطناعي:

انقر على مكون MCP لفتح لوحة الإعدادات. في قسم إعدادات MCP للنظام، أدخل تفاصيل خادم MCP الخاص بك بهذا الشكل:

{

"deepseek-thinker": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

بعد الإعداد، سيكون وكيل الذكاء الاصطناعي قادراً على استخدام هذا الـ MCP كأداة مع إمكانية الوصول إلى جميع وظائفه وقدراته. تذكر تغيير “deepseek-thinker” إلى اسم خادم MCP الفعلي لديك وتعيين الرابط الصحيح.

| القسم | متوفر | التفاصيل/ملاحظات |

|---|---|---|

| نظرة عامة | ✅ | |

| قائمة المحفزات | ⛔ | لا توجد قوالب محفزات موثقة |

| قائمة الموارد | ⛔ | لا توجد موارد MCP محددة |

| قائمة الأدوات | ✅ | أداة get-deepseek-thinker |

| تأمين مفاتيح API | ✅ | متغيرات البيئة في الإعداد |

| دعم السحب (أقل أهمية) | ⛔ | غير مذكور |

استناداً إلى الجدولين أدناه، يوفر خادم ديبسيك ثينكر MCP أداة مركزة لدمج الاستدلال، وسهل الإعداد، لكنه يفتقر إلى قوالب المحفزات التفصيلية وتعريفات الموارد الواضحة. المشروع مفتوح المصدر، وله متابعة متوسطة، ويدعم إدارة بيانات الاعتماد بشكل آمن. حصل على تقييم 6/10 من حيث الاكتمال والفائدة كخادم MCP.

| هل لديه رخصة LICENSE | ⛔ (لم يتم الكشف عن ملف LICENSE) |

|---|---|

| لديه أداة واحدة على الأقل | ✅ |

| عدد التفرعات Forks | 12 |

| عدد النجوم Stars | 51 |

قم بدمج خادم ديبسيك ثينكر MCP لمنح وكلاء الذكاء الاصطناعي لديك قدرات استدلال مفصلة وتعزيز سير العمل التطويري.

ادمج FlowHunt مع ديبسيك ثينكر MCP لتمكين الاستدلال المتقدم للذكاء الاصطناعي، أوضاع نشر مزدوجة عبر OpenAI API أو Ollama، ومخرجات منظمة خطوة بخطوة لسير العمل المد...

يقوم خادم ديسكورس MCP بربط وكلاء الذكاء الاصطناعي بمنتديات ديسكورس، مما يتيح البحث التلقائي عن المشاركات، واستخلاص المعرفة، وإدارة المجتمع من خلال واجهة بروتوكو...

يعمل خادم Honeycomb MCP كحلقة وصل بين المساعدين الذكيين وبيانات المراقبة في Honeycomb، مما يمكّن نماذج الذكاء الاصطناعي الكبيرة من تحليل المقاييس ولوحات المعلوم...

الموافقة على ملفات تعريف الارتباط

نستخدم ملفات تعريف الارتباط لتعزيز تجربة التصفح وتحليل حركة المرور لدينا. See our privacy policy.