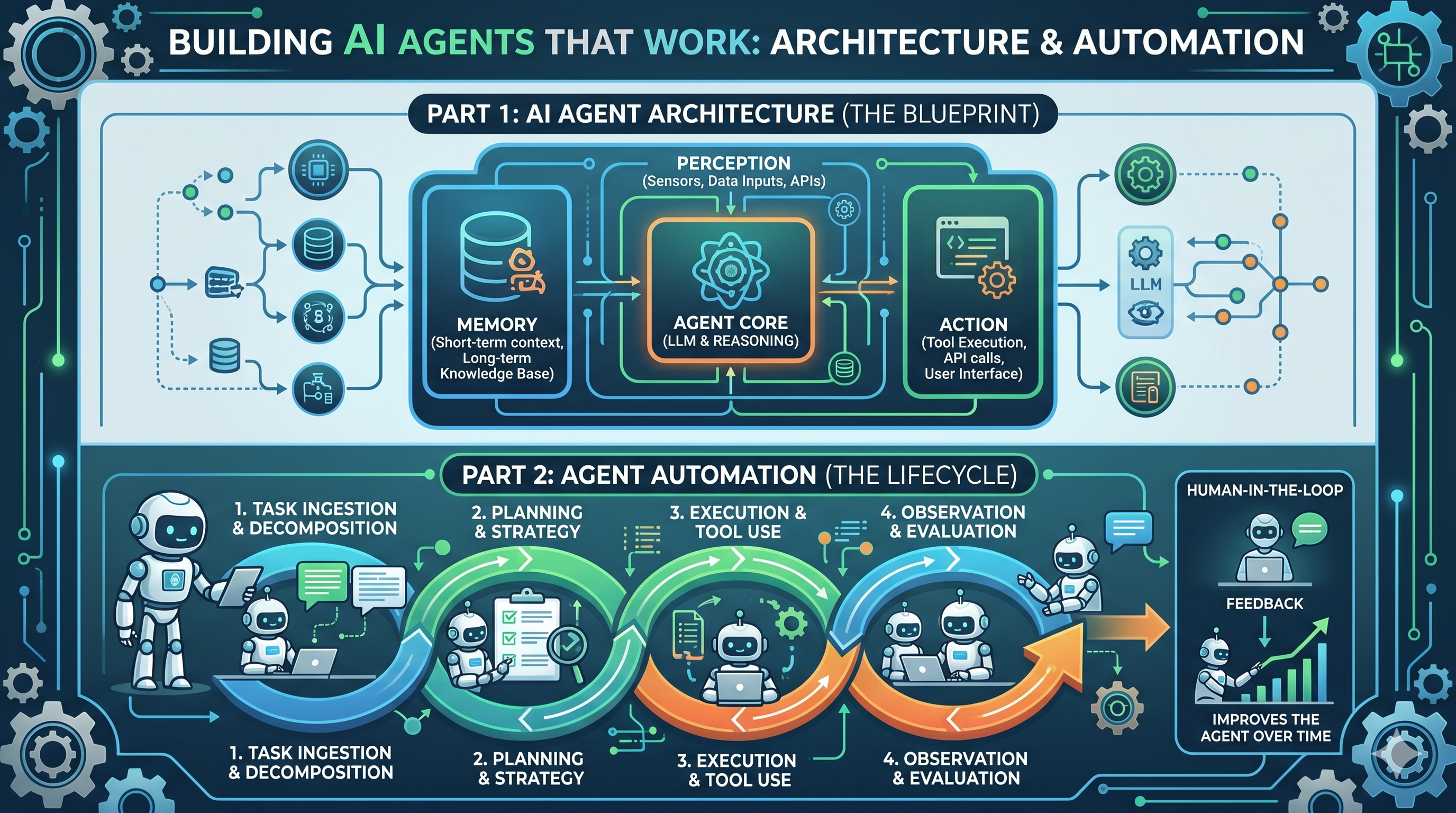

Méthodologie

Nous avons testé 20 modèles d’agents IA différents sur cinq tâches principales, chacune conçue pour explorer des capacités spécifiques :

- Génération de contenu : Rédaction d’un article détaillé sur les fondamentaux de la gestion de projet.

- Résolution de problèmes : Réalisation de calculs liés au chiffre d’affaires et au bénéfice.

- Résumé : Synthèse des points clés d’un article complexe.

- Comparaison : Analyse de l’impact environnemental des véhicules électriques et à hydrogène.

- Écriture créative : Création d’une histoire futuriste centrée sur les véhicules électriques.

Notre analyse s’est concentrée à la fois sur la qualité des résultats et sur le processus de réflexion de l’agent, en évaluant sa capacité à planifier, raisonner, s’adapter et utiliser efficacement les outils disponibles. Nous avons classé les modèles en fonction de leurs performances en tant qu’agent IA, en accordant une importance accrue à leurs processus de réflexion et à leurs stratégies.

Tâche 1 : Génération de contenu

Les vingt modèles ont tous démontré une forte capacité à générer des articles de haute qualité et informatifs. Cependant, le classement suivant prend en compte les processus de réflexion internes de chaque agent et la manière dont ils sont parvenus à leur production finale :

- Gemini 1.5 Pro : Bonne compréhension de la consigne, approche stratégique de la recherche et sortie bien organisée.

- Claude 3.5 Sonnet : Approche solide de la planification avec un rendu clair, concis et accessible.

- Mistral 8x7B : Bonne sélection d’outils et production claire et bien structurée.

- Mistral 7B : Recherche stratégique et rendu final bien formaté.

- GPT-4o AI Agent (Original) : Excellente sélection d’outils et approche de recherche adaptable.

- Gemini 1.5 Flash 8B : Production de haute qualité mais manque de transparence dans les processus internes.

- Claude 3 Haiku : Bonne performance et bonne compréhension de la consigne.

- GPT-4 Vision Preview AI Agent : Bonne performance avec un résultat de qualité.

- GPT-o1 Mini AI Agent : Adaptatif et itératif, bon usage des outils.

- Llama 3.2 3B : Bonne écriture créative et production détaillée, mais le processus interne n’a pas été montré.

- Claude 3 : Démontre une approche itérative tout en s’adaptant aux instructions, mais les réflexions internes n’ont pas été révélées.

- Claude 2 : Bonnes compétences rédactionnelles et compréhension de la consigne.

- GPT-3.5 Turbo AI Agent : A respecté les instructions et les consignes de formatage, mais sans processus interne visible.

- Gemini 2.0 Flash Experimental : Génère un rendu bien écrit mais avec un processus répétitif.

- Grok Beta AI Agent : Utilisation stratégique des outils, mais difficultés avec des boucles répétitives.

- Gemini 1.5 Flash AI Agent : Approche logique mais processus de réflexion répétitif.

- Mistral Large AI Agent : Production bien structurée mais manque de transparence sur les réflexions internes.

- o1 Preview AI Agent : Bonne performance mais aucune transparence sur les processus de réflexion.

- GPT 4o mini AI Agent : Production correcte mais processus internes non affichés.

- Llama 3.2 1B : Bonne performance mais manque de visibilité sur le processus interne et absence d’approche unique.

Tâche 2 : Résolution de problèmes et calcul

Nous avons évalué les capacités mathématiques et les stratégies de résolution des modèles :

- Claude 3.5 Sonnet : Grande précision, réflexion stratégique et solution bien expliquée.

- Mistral 7B : Solutions claires et précises, démontrant une réflexion stratégique.

- GPT-4 Vision Preview AI Agent : Bonne compréhension et calculs précis.

- Claude 3 Haiku : Calcul efficace et explications claires.

- o1 Preview AI Agent : Capacité à décomposer les calculs en plusieurs étapes.

- Mistral Large AI Agent : Calculs précis et réponse finale bien présentée.

- o1 mini : Réflexion stratégique et bonne compréhension des mathématiques nécessaires.

- Gemini 1.5 Pro : Calculs détaillés et précis, bien structurés.

- Llama 3.2 1B : Bonne décomposition des calculs, mais quelques erreurs de formatage.

- GPT-4o AI Agent (Original) : Bonnes performances sur la plupart des calculs et décomposition claire et logique de la tâche.

- GPT-4o Mini AI Agent : Calculs réalisés mais erreurs dans les réponses finales et difficultés de formatage.

- Claude 3 : Approche claire du calcul, mais sans approfondissement.

- Gemini 2.0 Flash Experimental : Calculs de base précis, mais quelques erreurs dans le résultat final.

- GPT-3.5 Turbo AI Agent : Calculs de base corrects, mais problèmes de stratégie et d’exactitude des réponses finales.

- Gemini 1.5 Flash AI Agent : Quelques erreurs de calcul concernant les unités supplémentaires nécessaires.

- Mistral 8x7B : Calculs globalement précis mais n’a pas exploré toutes les solutions possibles.

- Claude 2 : Calculs initiaux corrects mais problèmes stratégiques et erreurs dans la solution finale.

- Gemini 1.5 Flash 8B : Quelques erreurs dans la solution finale.

- Grok Beta AI Agent : N’a pas pu mener la tâche à bien ni fournir un résultat complet.

- Llama 3.2 3B : Erreurs de calcul et présentation incomplète.

Tâche 3 : Résumé

Nous avons évalué la capacité des modèles à extraire les informations clés et à produire des résumés concis :

- GPT-4o Mini AI Agent : Très bon pour résumer les points clés tout en respectant la limite de mots.

- Gemini 1.5 Pro : Bonne capacité à synthétiser le texte fourni, tout en respectant la contrainte de longueur.

- o1 Preview AI Agent : Résumé concis et bien structuré.

- Claude 3 Haiku : Résumé efficace du texte et respect des paramètres donnés.

- Mistral 7B : Résumé précis tout en respectant la limite de mots.

- Mistral 8x7B : Condense efficacement l’information en respectant les paramètres.

- GPT-4 Vision Preview AI Agent : Résumé très fidèle du texte fourni.

- GPT-3.5 Turbo AI Agent : Bonne capacité à résumer le texte, en mettant en avant tous les aspects importants.

- Llama 3.2 1B : Résumé concis et bien structuré.

- Claude 3.5 Sonnet : Résumé concis tout en respectant les consignes de formatage.

- Claude 2 : Résumé concis et bonne compréhension du texte fourni.

- Claude 3 : Information condensée dans un rendu concis.

- Mistral Large AI Agent : Résumé correct du texte, mais non conforme à la limite de mots imposée.