Intégration Prometheus MCP

Intégrez FlowHunt à Prometheus via le Model Context Protocol (MCP) pour une supervision sécurisée pilotée par l'IA, des requêtes PromQL automatisées et une anal...

Connectez sans effort vos assistants IA à Prometheus pour une surveillance en temps réel, des analyses automatisées et des insights DevOps grâce au serveur MCP Prometheus.

FlowHunt fournit une couche de sécurité supplémentaire entre vos systèmes internes et les outils d'IA, vous donnant un contrôle granulaire sur les outils accessibles depuis vos serveurs MCP. Les serveurs MCP hébergés dans notre infrastructure peuvent être intégrés de manière transparente avec le chatbot de FlowHunt ainsi qu'avec les plateformes d'IA populaires comme ChatGPT, Claude et divers éditeurs d'IA.

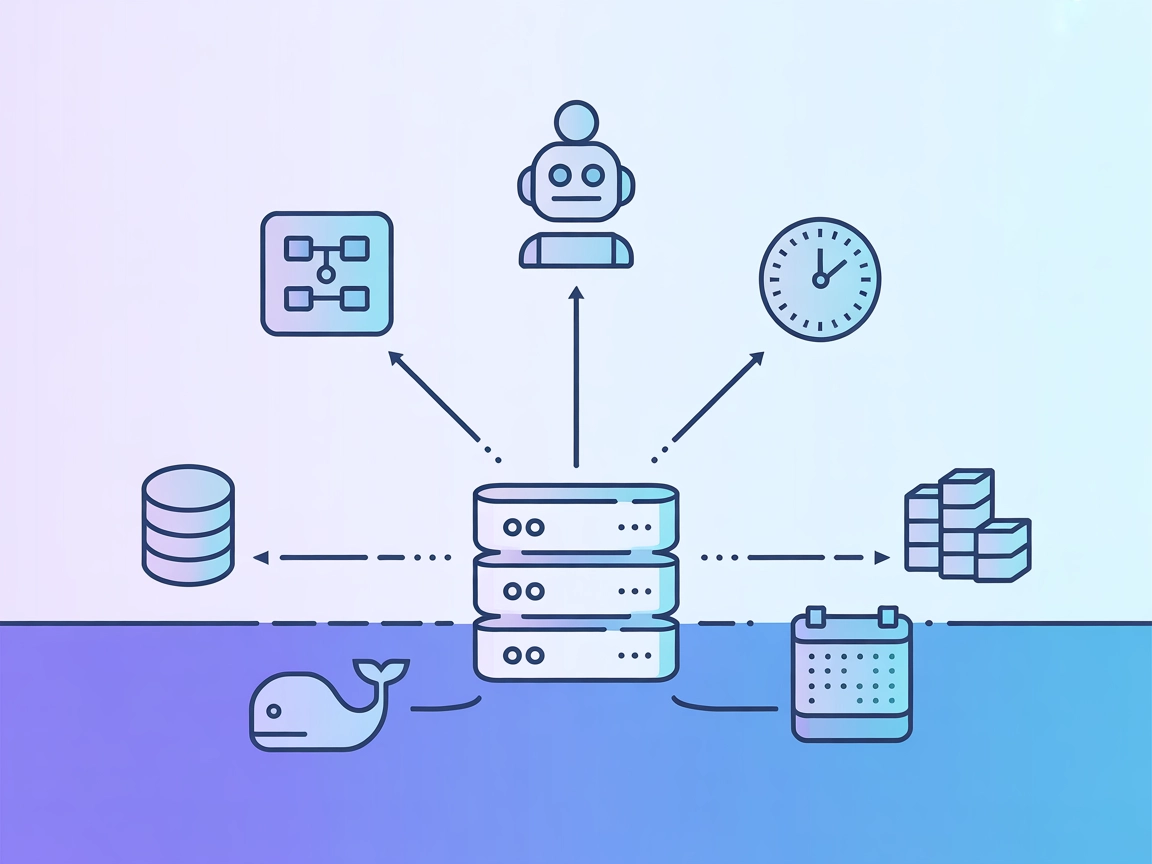

Le serveur MCP Prometheus est une implémentation du Model Context Protocol (MCP) qui permet aux assistants IA d’interagir avec les métriques Prometheus via des interfaces standardisées. Agissant comme un pont entre les agents IA et Prometheus, il autorise l’exécution transparente de requêtes PromQL, la découverte et l’exploration de données de métriques, et fournit un accès direct à l’analyse de séries temporelles. Cela permet aux développeurs et outils IA d’automatiser la surveillance, d’analyser l’état de l’infrastructure et d’obtenir des insights opérationnels sans récupération manuelle des données. Les fonctionnalités clés incluent la liste des métriques, l’accès aux métadonnées, le support des requêtes instantanées et sur plage, ainsi qu’une authentification configurable (authentification de base ou token Bearer). Le serveur est également conteneurisé pour un déploiement facile et peut s’intégrer de manière flexible à divers workflows IA.

Aucune information sur des templates de prompt n’est fournie dans le dépôt.

Aucune ressource explicite (au sens MCP) n’est listée dans le dépôt.

Aucune instruction spécifique n’est fournie pour Windsurf dans le dépôt.

PROMETHEUS_URL, identifiants).mcpServers :{

"mcpServers": {

"prometheus": {

"command": "uv",

"args": [

"--directory",

"<chemin complet vers le dossier prometheus-mcp-server>",

"run",

"src/prometheus_mcp_server/main.py"

],

"env": {

"PROMETHEUS_URL": "http://votre-serveur-prometheus:9090",

"PROMETHEUS_USERNAME": "votre_nom_utilisateur",

"PROMETHEUS_PASSWORD": "votre_mot_de_passe"

}

}

}

}

Remarque : Si vous voyez Error: spawn uv ENOENT, indiquez le chemin complet vers uv ou définissez la variable d’environnement NO_UV=1 dans la configuration.

Aucune instruction spécifique n’est fournie pour Cursor dans le dépôt.

Aucune instruction spécifique n’est fournie pour Cline dans le dépôt.

Sécurisation des clés API

Les valeurs sensibles, telles que les clés API, noms d’utilisateur et mots de passe, doivent être définies via des variables d’environnement.

Exemple (dans une configuration JSON) :

"env": {

"PROMETHEUS_URL": "http://votre-serveur-prometheus:9090",

"PROMETHEUS_USERNAME": "votre_nom_utilisateur",

"PROMETHEUS_PASSWORD": "votre_mot_de_passe"

}

Utiliser MCP dans FlowHunt

Pour intégrer des serveurs MCP à votre workflow FlowHunt, commencez par ajouter le composant MCP à votre flux et connectez-le à votre agent IA :

Cliquez sur le composant MCP pour ouvrir le panneau de configuration. Dans la section configuration système MCP, insérez les détails de votre serveur MCP au format JSON suivant :

{

"prometheus": {

"transport": "streamable_http",

"url": "https://votreserveurmcp.exemple/chemindumcp/url"

}

}

Une fois la configuration terminée, votre agent IA pourra utiliser ce MCP comme outil avec accès à toutes ses fonctions et capacités. N’oubliez pas de remplacer “prometheus” par le nom réel de votre serveur MCP et d’indiquer l’URL de votre propre serveur MCP.

| Section | Disponibilité | Détails/Remarques |

|---|---|---|

| Aperçu | ✅ | Le serveur MCP Prometheus permet les requêtes PromQL et l’analyse |

| Liste des prompts | ⛔ | Aucun template de prompt listé |

| Liste des ressources | ⛔ | Aucune ressource MCP explicite décrite |

| Liste des outils | ✅ | Requêtes PromQL, liste des métriques, métadonnées, requêtes instantanées/plage |

| Sécurisation des clés API | ✅ | Utilisation des variables d’environnement détaillée |

| Prise en charge du sampling (moins important) | ⛔ | Non spécifié |

D’après ce qui précède, le serveur MCP Prometheus offre une forte intégration d’outils et une sécurité claire pour les clés API. Certaines fonctionnalités MCP avancées (prompts, ressources explicites, sampling, roots) ne sont pas documentées ou implémentées.

Le serveur MCP Prometheus obtient un bon score concernant le support des outils MCP de base et l’intégration pratique, mais il lui manque la documentation ou l’implémentation pour les prompts, les ressources et les fonctionnalités MCP avancées. Il est fiable pour l’analyse de métriques mais ne constitue pas un exemple MCP complet. Score : 6/10.

| Possède une LICENSE | ✅ (MIT) |

|---|---|

| Au moins un outil | ✅ |

| Nombre de Forks | 22 |

| Nombre d’étoiles | 113 |

Donnez à vos agents IA la possibilité d'interroger, d'analyser et d'automatiser la surveillance d'infrastructure via le serveur MCP Prometheus. Essayez-le dans FlowHunt ou réservez une démo pour le voir en action.

Intégrez FlowHunt à Prometheus via le Model Context Protocol (MCP) pour une supervision sécurisée pilotée par l'IA, des requêtes PromQL automatisées et une anal...

Le serveur MCP Prefect fait le lien entre les assistants IA et la plateforme d'orchestration de flux Prefect, permettant la gestion en langage naturel des flux,...

Le serveur Patronus MCP simplifie l'évaluation et l'expérimentation des LLM pour les développeurs et chercheurs, en offrant automatisation, traitement par lots ...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.