Serveur Model Context Protocol (MCP)

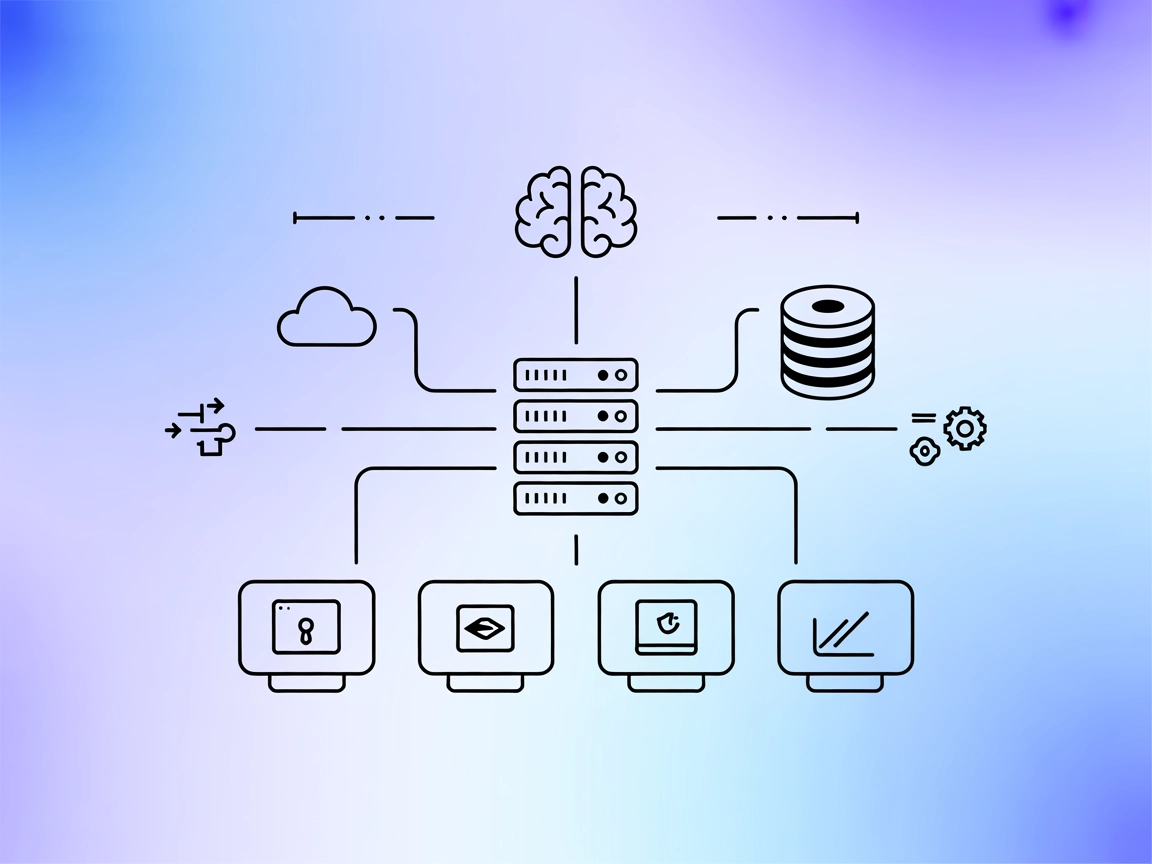

Le serveur Model Context Protocol (MCP) fait le lien entre les assistants IA et des sources de données externes, des API et des services, permettant une intégra...

Think MCP Server dote les agents IA d’étapes de raisonnement explicites et auditables ainsi que d’outils avancés pour des workflows robustes et conformes.

FlowHunt fournit une couche de sécurité supplémentaire entre vos systèmes internes et les outils d'IA, vous donnant un contrôle granulaire sur les outils accessibles depuis vos serveurs MCP. Les serveurs MCP hébergés dans notre infrastructure peuvent être intégrés de manière transparente avec le chatbot de FlowHunt ainsi qu'avec les plateformes d'IA populaires comme ChatGPT, Claude et divers éditeurs d'IA.

Think MCP est une implémentation d’un serveur MCP (Model Context Protocol) qui fournit un outil « think » pour le raisonnement structuré dans les workflows d’IA agentique. Inspiré par les travaux d’ingénierie d’Anthropic, ce serveur permet aux assistants IA de faire une pause et d’enregistrer explicitement leurs pensées lors d’utilisations complexes d’outils ou de raisonnements multi-étapes. En intégrant l’outil « think », les agents peuvent analyser les résultats d’outils, revenir sur des décisions, vérifier la conformité à des politiques détaillées et améliorer la prise de décision séquentielle. Think MCP est conçu pour optimiser les workflows de développement IA en exposant les étapes de raisonnement explicites, rendant ainsi le comportement des agents plus transparent et auditable. Le serveur est minimaliste, basé sur les standards, et prêt à être intégré à Claude ou à d’autres grands modèles de langage agentiques.

thought (chaîne).mcpServers :{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp"],

"enabled": true

}

}

}

Sécurisation des clés API (mode avancé) :

{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp", "--advanced"],

"enabled": true,

"env": {

"TAVILY_API_KEY": "VOTRE_TAVILY_API_KEY"

}

}

}

}

{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp"],

"enabled": true

}

}

}

Clés API : Utilisez la section env (voir exemple Windsurf).

mcpServers :{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp"],

"enabled": true

}

}

}

{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp"],

"enabled": true

}

}

}

Sécurisation des clés API : Utilisez les champs env et inputs comme indiqué ci-dessus.

Utilisation de MCP dans FlowHunt

Pour intégrer des serveurs MCP dans votre workflow FlowHunt, commencez par ajouter le composant MCP à votre flux et connectez-le à votre agent IA :

Cliquez sur le composant MCP pour ouvrir le panneau de configuration. Dans la section de configuration système MCP, insérez les détails de votre serveur MCP en utilisant ce format JSON :

{

"think-mcp": {

"transport": "streamable_http",

"url": "https://votreserveurmcp.exemple/cheminverslemcp/url"

}

}

Une fois configuré, l’agent IA pourra utiliser ce MCP comme un outil avec accès à toutes ses fonctions et capacités. N’oubliez pas de changer « think-mcp » par le nom réel de votre serveur MCP et de remplacer l’URL par celle de votre propre serveur MCP.

| Section | Disponibilité | Détails/Remarques |

|---|---|---|

| Aperçu | ✅ | |

| Liste des prompts | ⛔ | Aucun fourni |

| Liste des ressources | ⛔ | Aucune fournie |

| Liste des outils | ✅ | think, criticize, plan, search |

| Sécurisation des clés API | ✅ | via env |

| Support Sampling (peu important pour l’éval.) | ⛔ | Non mentionné |

D’après ces tableaux, le serveur Think MCP est minimaliste mais ciblé : il implémente l’outil central de raisonnement « think » et ajoute quelques outils avancés en mode enrichi. Bien qu’il n’inclue pas de modèles de prompt ni d’exposition de ressources, son lot d’outils est précieux pour le raisonnement agentique. Le README est clair et la configuration simple. Note : 6/10 — utile pour la recherche et le prototypage, mais moins complet que d’autres serveurs MCP.

| Possède une LICENCE | ✅ (MIT) |

|---|---|

| Au moins un outil | ✅ |

| Nombre de Forks | 4 |

| Nombre de Stars | 27 |

Le serveur Think MCP implémente un outil «xa0thinkxa0» pour le raisonnement structuré dans les workflows d’IA agentique. Il permet aux assistants IA de faire une pause, de consigner explicitement leurs pensées et d’améliorer la transparence de la prise de décision. Le mode avancé ajoute des outils de critique, de planification et de recherche externe.

Les outils disponibles incluentxa0: think (journaliser une pensée), criticize (auto-critique de l’agent), plan (planification étape par étape), et search (recherche externe via API, nécessite TAVILY_API_KEY).

Think MCP est utilisé pour l’analyse des résultats d’outils, la conformité étape par étape aux politiques, la prise de décision séquentielle, l’auto-critique de l’agent et l’intégration d’informations externes pour des workflows agents robustes.

Ajoutez le composant MCP à votre flux FlowHunt, puis configurez-le avec les détails de votre serveur Think MCP. Utilisez le format JSON dans le panneau de configuration MCP pour définir le transport et l’URL.

Oui, Think MCP est publié sous licence MIT.

Pour utiliser «xa0searchxa0» et d’autres outils avancés, activez le mode avancé et renseignez une TAVILY_API_KEY dans la configuration d’environnement du serveur MCP.

Renforcez le raisonnement et la transparence de votre IA en intégrant Think MCP Server à FlowHunt. Activez la journalisation explicite des pensées et des outils avancés de planification pour vos workflows agentiques.

Le serveur Model Context Protocol (MCP) fait le lien entre les assistants IA et des sources de données externes, des API et des services, permettant une intégra...

Le serveur ModelContextProtocol (MCP) agit comme un pont entre les agents IA et les sources de données externes, API et services, permettant aux utilisateurs de...

Le serveur MCP Deepseek Thinker intègre le raisonnement du modèle Deepseek dans les clients IA compatibles MCP comme Claude Desktop, fournissant des sorties ava...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.