Deepseek Thinker MCP サーバー

Deepseek Thinker MCP サーバーは、Deepseekモデルの推論をClaude DesktopなどのMCP対応AIクライアントに統合し、高度な連鎖思考(Chain-of-Thought)出力を提供してAIワークフローを強化します。クラウドとローカル推論の両方に対応し、開発者のデバッグ、透明な推論、AI...

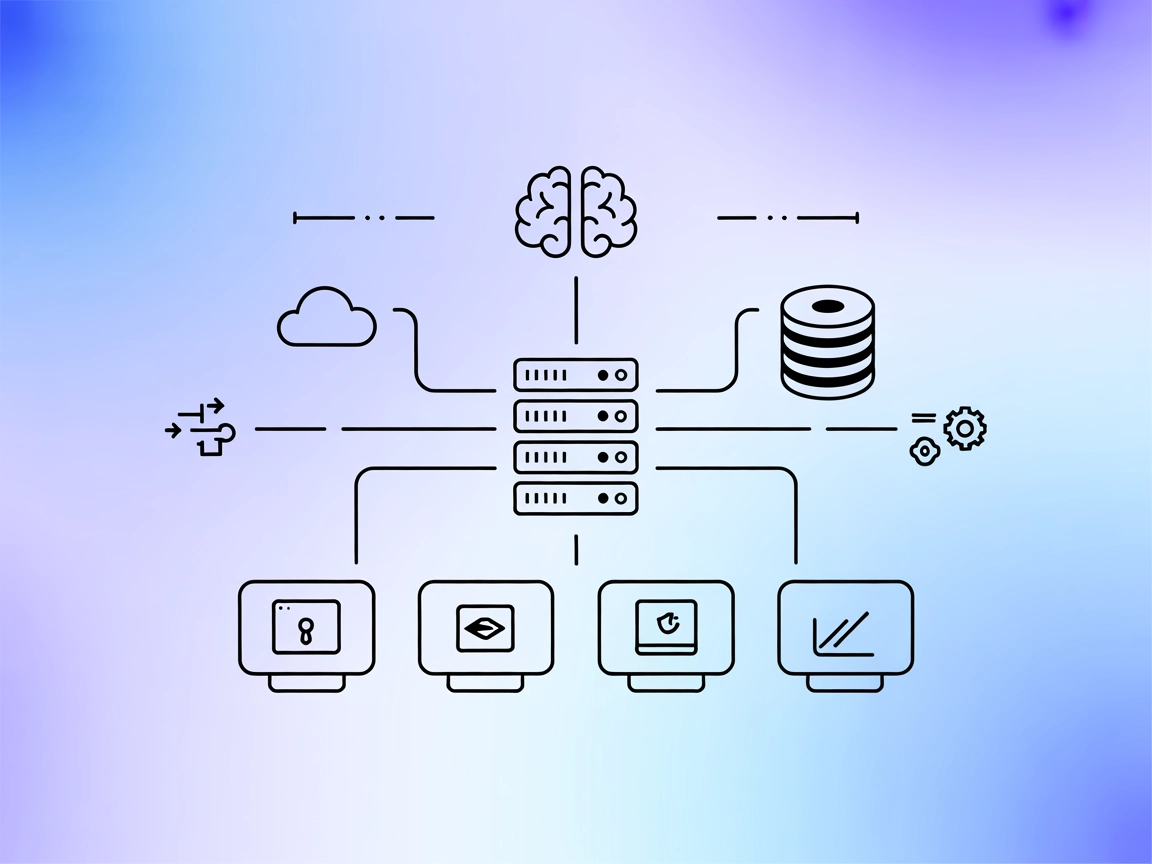

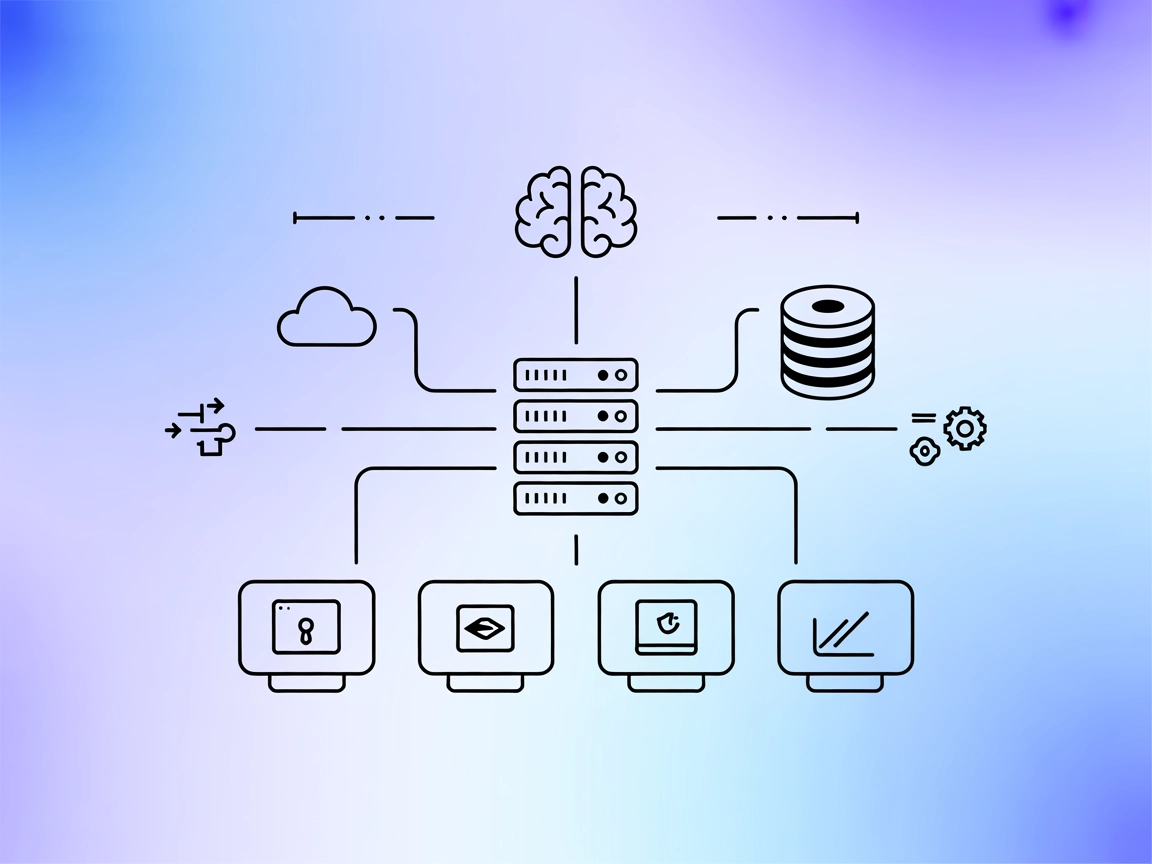

FlowHuntは、お客様の内部システムとAIツールの間に追加のセキュリティレイヤーを提供し、MCPサーバーからアクセス可能なツールをきめ細かく制御できます。私たちのインフラストラクチャーでホストされているMCPサーバーは、FlowHuntのチャットボットや、ChatGPT、Claude、さまざまなAIエディターなどの人気のAIプラットフォームとシームレスに統合できます。

Think MCPは、エージェント型AIワークフローのための「think」ツールを提供するMCP(Model Context Protocol)サーバーの実装です。Anthropicのエンジニアリングリサーチに触発されており、このサーバーによりAIアシスタントは複雑なツール利用や多段階推論の途中で一時停止し、明示的に思考を記録できます。「think」ツールの統合によって、エージェントはツール出力を分析し、意思決定を見直し、詳細なポリシーを順守し、逐次的な意思決定を向上させることが可能です。Think MCPは、明示的な推論ステップを公開することでAI開発ワークフローを強化し、エージェントの行動をより透明かつ監査可能にします。サーバーはミニマルかつ標準準拠で、Claudeなどのエージェント型大規模言語モデルとの統合も可能です。

thought(文字列)。mcpServersセクションにThink MCPサーバーを追加します:{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp"],

"enabled": true

}

}

}

APIキーの保護(高度モード):

{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp", "--advanced"],

"enabled": true,

"env": {

"TAVILY_API_KEY": "YOUR_TAVILY_API_KEY"

}

}

}

}

{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp"],

"enabled": true

}

}

}

APIキー: envセクションを使用してください(Windsurfの例参照)。

mcpServersオブジェクトにThink MCPを追加します:{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp"],

"enabled": true

}

}

}

{

"mcpServers": {

"think-mcp": {

"command": "uvx",

"args": ["think-mcp"],

"enabled": true

}

}

}

APIキーの保護: 上記と同様にenvおよびinputsフィールドを使用してください。

FlowHuntでのMCP利用

FlowHuntワークフローにMCPサーバーを統合するには、まずMCPコンポーネントを追加し、AIエージェントに接続します:

MCPコンポーネントをクリックして設定パネルを開きます。system MCP設定セクションで、次のJSON形式でMCPサーバー情報を入力してください:

{

"think-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

設定後、AIエージェントはこのMCPをツールとして利用でき、すべての機能にアクセス可能となります。“think-mcp"は実際のMCPサーバー名に、URLも自身のMCPサーバーURLに書き換えてください。

| セクション | 利用可否 | 詳細/備考 |

|---|---|---|

| 概要 | ✅ | |

| プロンプト一覧 | ⛔ | 記載なし |

| リソース一覧 | ⛔ | 記載なし |

| ツール一覧 | ✅ | think, criticize, plan, search |

| APIキーの保護 | ✅ | envで対応 |

| サンプリング対応(評価上は重要度低) | ⛔ | 言及なし |

この表から、Think MCPサーバーはミニマルながらフォーカスされた設計です: コアとなる「think」推論ツールを実装し、高度モードではいくつかの追加ツールも搭載しています。プロンプトテンプレートやリソース公開はありませんが、ツールセットはエージェント型推論に有用です。READMEも明快でセットアップも簡単です。評価: 6/10 ― 研究やプロトタイピングに有用ですが、他のMCPサーバーほど多機能ではありません。

| ライセンスあり | ✅ (MIT) |

|---|---|

| 1つ以上のツールあり | ✅ |

| フォーク数 | 4 |

| スター数 | 27 |

Deepseek Thinker MCP サーバーは、Deepseekモデルの推論をClaude DesktopなどのMCP対応AIクライアントに統合し、高度な連鎖思考(Chain-of-Thought)出力を提供してAIワークフローを強化します。クラウドとローカル推論の両方に対応し、開発者のデバッグ、透明な推論、AI...

トークンミンター MCP サーバーは、AIアシスタントやエージェントがブロックチェーンエコシステムとシームレスに連携し、21のブロックチェーンにわたるERC-20トークンの自動デプロイ、クエリ、転送を可能にします。AIワークフローにブロックチェーントークン管理を統合し、迅速なプロトタイピング、分析、ライブデプロイを実現...

JetBrains MCPサーバーは、AIエージェントとIntelliJ、PyCharm、WebStorm、Android StudioなどのJetBrains IDEを接続し、Model Context Protocol(MCP)を介して自動化ワークフロー、コードナビゲーション、リアルタイムのAI-IDE通信を可能に...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.