AI Revolutie 2025: Meta Ray-Ban, Bovenmenselijke Redenering, Autonome Agenten

Ontdek de nieuwste doorbraken in AI-technologie, waaronder Meta's geavanceerde Ray-Ban-bril, OpenAI's modellen met bovenmenselijke redeneervermogen, 3D-wereldge...

Dario Amodei, CEO van Anthropic, gaat in gesprek met Lex Fridman over de toekomst van AI, waaronder scaling laws, AGI-tijdlijnen, veiligheid, interpretatie en regulering.

Schalen is belangrijk voor het ontwikkelen van effectievere en capabelere AI-modellen. De Scaling Law is het idee dat het vergroten van modellen met meer parameters de prestaties van AI verbetert. Amodei bespreekt hoe schaling de mogelijkheden van modellen beïnvloedt en wijst erop dat grotere modellen beter kunnen leren en redeneren. Het gesprek benadrukt de noodzaak om grootte en efficiëntie van neurale netwerken in balans te houden, wat mogelijk tot grote vooruitgang in AI-toepassingen kan leiden.

Amodei voorspelt dat AI mogelijk tegen 2026-2027 het niveau van menselijke intelligentie zal bereiken. Deze voorspelling is gebaseerd op de huidige trends in rekenkracht, data-toegang en de snelle ontwikkeling van AI-technologie. Zijn inzichten gaan niet alleen over de technologische mijlpalen om dit intelligentieniveau te bereiken, maar ook over de ethische en filosofische vragen die hiermee gepaard gaan.

Een grote uitdaging is de concentratie van AI-macht bij enkele sterke partijen. Amodei waarschuwt dat dit kan leiden tot ongelijke toegang tot technologie en mogelijk misbruik, waardoor wereldwijde ongelijkheden toenemen en de democratie wordt bedreigd. Om dit aan te pakken is een eerlijke verdeling van AI-vooruitgang nodig, zodat iedereen profiteert en geen enkele partij het monopolie heeft.

Het is essentieel te begrijpen hoe AI intern werkt, oftewel mechanistische interpretatie, om AI veilig toe te kunnen passen. Amodei benadrukt het belang van inzicht in hoe AI beslissingen en voorspellingen maakt. Door transparantie en interpretatie te verbeteren kunnen onderzoekers AI-gedrag beter voorspellen, vooroordelen herkennen en risico’s verkleinen, zeker nu deze systemen autonomer worden in belangrijke sectoren als gezondheidszorg, financiën en nationale veiligheid.

Modelhiërarchie is een belangrijk onderdeel van de AI-aanpak van Anthropic. Amodei beschrijft hoe verschillende modelgroottes geschikt zijn voor uiteenlopende toepassingen, van kleinere modellen voor dagelijkse taken tot grotere modellen voor gespecialiseerde behoeften. Deze gestructureerde strategie maakt flexibele inzet van AI mogelijk in diverse sectoren, zodat oplossingen passen bij verschillende industrieën en maatschappelijke eisen.

Anthropic’s RSP-framework benadrukt hun toewijding aan AI-veiligheid via verantwoord schalen. Dit framework omvat systematische stappen voor het schalen van AI-modellen, zodat het gebruik van AI met groeiende capaciteiten veilig, ethisch en maatschappelijk verantwoord blijft. Met deze aanpak wil Anthropic potentiële ethische uitdagingen bij AI-ontwikkeling adresseren en vooruitgang stimuleren die zowel zorgvuldig als innovatief is.

Het reguleren van AI is cruciaal om de ontwikkeling in goede en veilige banen te leiden. Amodei pleit voor uitgebreide wettelijke kaders om AI-technologieën te beheersen en benadrukt het belang van regelgeving die duidelijke veiligheidsnormen en toezicht instelt. Deze proactieve aanpak is bedoeld om misbruik van AI te voorkomen en tegelijkertijd technologische vooruitgang te bevorderen die het publieke belang en welzijn beschermt.

Het gesprek gaat ook in op de grenzen die worden veroorzaakt door de huidige rekenkracht en beschikbaarheid van data, die de toekomstige vooruitgang van AI kunnen belemmeren. Dit overwinnen vereist onderzoek naar nieuwe rekenmethoden, zoals quantum computing, ter ondersteuning van de volgende AI-ontwikkelingen. Het vinden van duurzame en schaalbare oplossingen voor datamanagement is ook essentieel om barrières te overwinnen en tegelijkertijd privacy te beschermen.

AI scaling laws verwijzen naar de trend waarbij het vergroten van de omvang en het aantal parameters van AI-modellen leidt tot betere prestaties. Dario Amodei benadrukt dat grotere modellen over het algemeen beter kunnen leren en redeneren, maar dat het belangrijk blijft om grootte en efficiëntie in balans te houden.

Dario Amodei voorspelt dat AI tussen 2026 en 2027 menselijke intelligentie kan bereiken, op basis van trends in rekenkracht, data-toegang en snelle technologische vooruitgang.

Mechanistische interpretatie is cruciaal omdat het onderzoekers helpt te begrijpen hoe AI-modellen beslissingen en voorspellingen maken. Deze transparantie maakt het mogelijk AI-gedrag beter te voorspellen, vooroordelen te identificeren en risico's te verkleinen naarmate AI autonomer wordt in kritieke sectoren.

Belangrijke uitdagingen zijn onder andere de concentratie van AI-macht bij een beperkt aantal partijen, mogelijk misbruik, mondiale ongelijkheden en bedreigingen voor de democratie. Een eerlijke verdeling en verantwoord schalen van AI-technologieën is nodig om deze uitdagingen het hoofd te bieden.

Dario Amodei pleit voor uitgebreide wettelijke kaders en regulering om duidelijke veiligheidsnormen en toezicht te stellen voor AI-ontwikkeling, met als doel misbruik te voorkomen en tegelijkertijd het publieke belang te beschermen en verantwoord technologische vooruitgang te stimuleren.

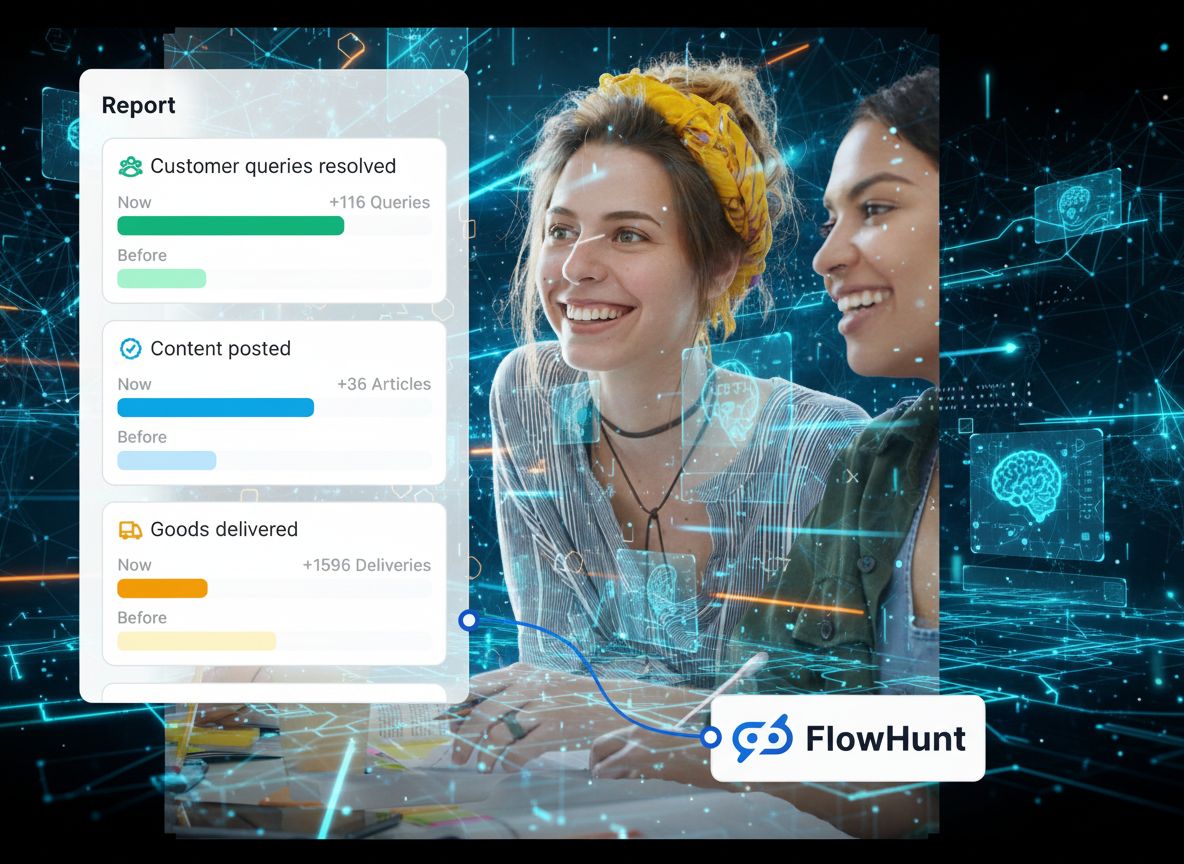

Viktor Zeman is mede-eigenaar van QualityUnit. Zelfs na 20 jaar leiding te hebben gegeven aan het bedrijf, blijft hij in de eerste plaats een software engineer, gespecialiseerd in AI, programmatische SEO en backend-ontwikkeling. Hij heeft bijgedragen aan tal van projecten, waaronder LiveAgent, PostAffiliatePro, FlowHunt, UrlsLab en vele anderen.

Ontdek hoe je FlowHunt kunt gebruiken om aangepaste AI-chatbots en tools te creëren. Begin moeiteloos met het bouwen van geautomatiseerde Flows.

Ontdek de nieuwste doorbraken in AI-technologie, waaronder Meta's geavanceerde Ray-Ban-bril, OpenAI's modellen met bovenmenselijke redeneervermogen, 3D-wereldge...

Ontdek de belangrijkste AI-releases van december 2025, waaronder Google's Gemini 3 Flash, Nvidia's Nemotron 3 Nano en andere baanbrekende modellen die het AI-la...

Ontdek Andrej Karpathy's genuanceerde visie op AGI-tijdlijnen, AI-agenten en waarom het komende decennium cruciaal zal zijn voor de ontwikkeling van kunstmatige...