Linear MCP-server

Linear MCP-serveren integrerer Linear prosjektstyringsplattform med AI-assistenter via Model Context Protocol, og muliggjør automatisering, spørring og håndteri...

Gi AI-assistenten din ekte LinkedIn-innsikt—generer, analyser og omskriv innlegg i din sanne stemme, direkte fra dine FlowHunt-arbeidsflyter.

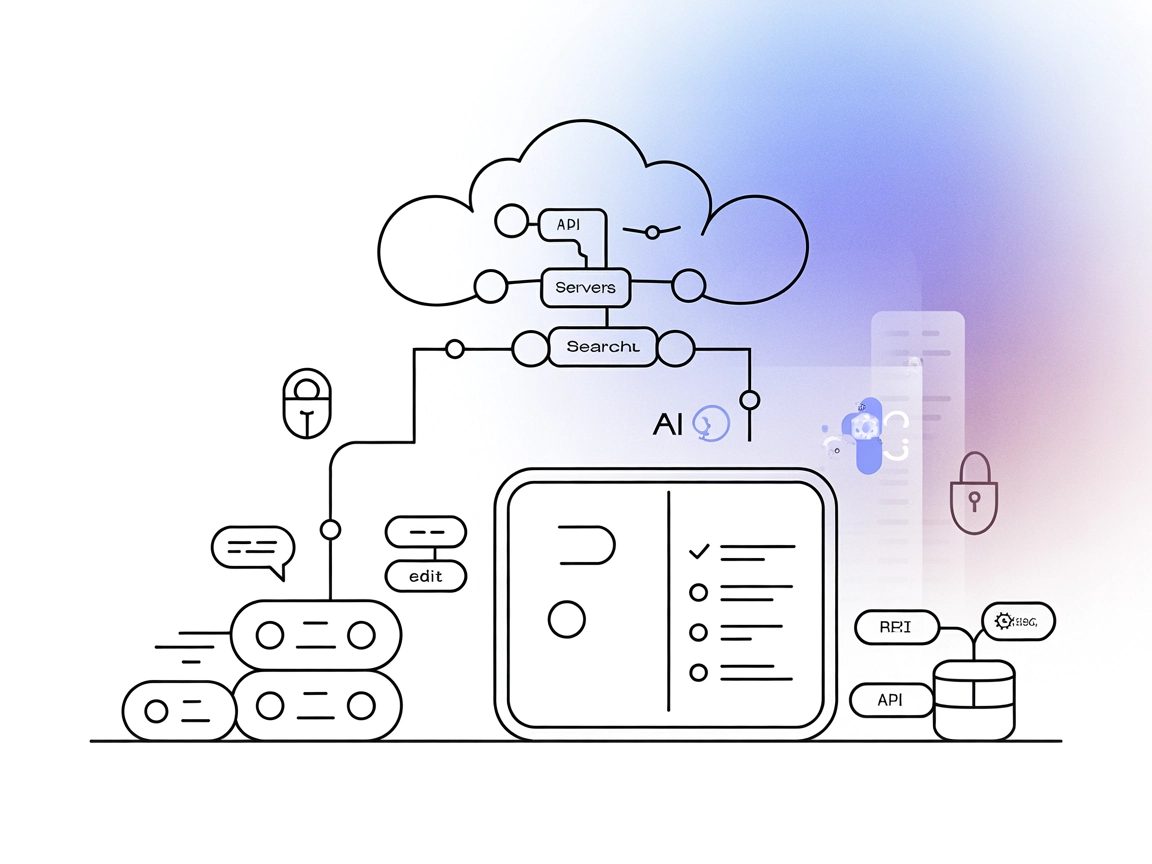

FlowHunt gir et ekstra sikkerhetslag mellom dine interne systemer og AI-verktøy, og gir deg granulær kontroll over hvilke verktøy som er tilgjengelige fra dine MCP-servere. MCP-servere som er hostet i vår infrastruktur kan sømløst integreres med FlowHunts chatbot samt populære AI-plattformer som ChatGPT, Claude og forskjellige AI-editorer.

LinkedIn MCP Runner er en offisiell implementasjon av Model Context Protocol (MCP) designet for å koble AI-assistenter som GPT-baserte modeller til en brukers offentlige LinkedIn-data. Den fungerer som en kreativ medpilot som gjør det mulig for AI-verktøy som Claude eller ChatGPT å få tilgang til dine faktiske LinkedIn-innlegg, analysere engasjement, forstå din skrivestil og hjelpe til med å generere eller omskrive innlegg i din unike stemme. Ved å utnytte ditt ekte innhold, effektiviseres arbeidsflyter for innholdsproduksjon, analyse og engasjementsstrategier—og forvandler AI-assistenter til LinkedIn-eksperter som kan gi handlingsrettede innsikter og automatisere sosiale medier-interaksjon, alt mens brukersamtykke og personvern opprettholdes.

Det er ingen eksplisitte prompt-maler oppført i repoet eller README.

Det er ingen eksplisitte MCP-ressurser beskrevet i repoet eller README.

Det er ingen eksplisitte verktøy (som databaseforespørsler, filbehandling eller API-kall) beskrevet i repoet eller README.

Det er ingen oppsettveiledning eller konfigurasjonseksempler for Windsurf.

Det vises ingen JSON-konfigurasjon i dokumentasjonen.

Det er ingen oppsettveiledning eller konfigurasjonseksempler for Cursor.

Det er ingen oppsettveiledning eller konfigurasjonseksempler for Cline.

Det er ingen informasjon om håndtering av API-nøkler eller miljøvariabler.

Bruke MCP i FlowHunt

For å integrere MCP-servere i din FlowHunt-arbeidsflyt, begynn med å legge til MCP-komponenten i flyten og koble den til din AI-agent:

Klikk på MCP-komponenten for å åpne konfigurasjonspanelet. I systemets MCP-konfigurasjonsseksjon setter du inn MCP-serverdetaljene dine med dette JSON-formatet:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Når dette er konfigurert, kan AI-agenten nå bruke denne MCP-en som et verktøy med tilgang til alle dens funksjoner og kapasiteter. Husk å endre “MCP-name” til det faktiske navnet på MCP-serveren din (f.eks. “github-mcp”, “weather-api”, etc.) og bytt ut URL-en med din egen MCP-server-URL.

| Seksjon | Tilgjengelighet | Detaljer/Notater |

|---|---|---|

| Oversikt | ✅ | |

| Liste over forslag | ⛔ | Ikke spesifisert i repo eller README |

| Liste over ressurser | ⛔ | Ikke spesifisert i repo eller README |

| Liste over verktøy | ⛔ | Ikke spesifisert i repo eller README |

| Sikring av API-nøkler | ⛔ | Ikke spesifisert i repo eller README |

| Sampling-støtte (mindre viktig i vurderingen) | ⛔ | Ikke spesifisert i repo eller README |

Alt i alt tilbyr LinkedIn MCP Runner en unik AI-drevet LinkedIn-innholdsopplevelse, men den offentlige dokumentasjonen mangler detaljer på protokollnivå—som ressurser, prompt-maler og eksplisitte verktøylister. Dermed kan utviklere finne den enkel å bruke, men mangelfull på teknisk transparens.

| Har en LISENS | ✅ (MIT) |

|---|---|

| Har minst ett verktøy | ⛔ |

| Antall forgreininger | 2 |

| Antall stjerner | 4 |

Vurdering:

Gitt den tydelige oversikten og forklaringene av brukstilfeller, men mangel på tekniske MCP-detaljer, vil jeg gi LinkedIn MCP Runner-repositoriet en 4 av 10 for MCP-klarhet og utviklerberedskap.

LinkedIn MCP Runner er en offisiell implementasjon av Model Context Protocol som kobler AI-assistenter til dine offentlige LinkedIn-data. Den gjør det mulig for AI-verktøy å analysere innleggene dine, forstå skrivestilen din og hjelpe til med å lage eller omskrive LinkedIn-innhold tilpasset din unike stemme.

Den lar deg generere innlegg og omskrivinger i din autentiske tone, analyserer tidligere engasjement og gir handlingsrettede innsikter for LinkedIn-strategien din—direkte via din favoritt AI-assistent.

Ja, LinkedIn MCP Runner er designet for kun å få tilgang til dine offentlige LinkedIn-data med ditt samtykke, og sikrer personvern og brukerkontroll.

Serveren fungerer sømløst med Claude, ChatGPT og enhver AI-assistent som støtter Model Context Protocol, noe som gjør det enkelt å integrere i dine FlowHunt-arbeidsflyter.

I FlowHunt, legg til MCP-komponenten i flyten din, klikk for å konfigurere den, og sett inn MCP-serverdetaljene dine ved å bruke det oppgitte JSON-formatet. Pass på å bruke riktig servernavn og URL.

La FlowHunt og LinkedIn MCP Runner forvandle AI-assistenten din til en LinkedIn-ekspert—generer innlegg, analyser engasjement og behold din autentiske stemme.

Linear MCP-serveren integrerer Linear prosjektstyringsplattform med AI-assistenter via Model Context Protocol, og muliggjør automatisering, spørring og håndteri...

Linear MCP-serveren kobler Linears prosjektstyringsplattform med AI-assistenter og LLM-er, slik at team kan automatisere sakshåndtering, søk, oppdateringer og s...

Superlad LinkedIn-innholdsstrategien din ved å integrere FlowHunt med LiGo sitt Model Context Protocol (MCP). Aktiver GPT-baserte assistenter som Claude og Chat...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.