Membase MCP Server

Membase MCP Server zapewnia lekką, zdecentralizowaną i trwałą pamięć dla agentów AI, łącząc ich z protokołem Membase opartym na Unibase. Umożliwia agentom bezpi...

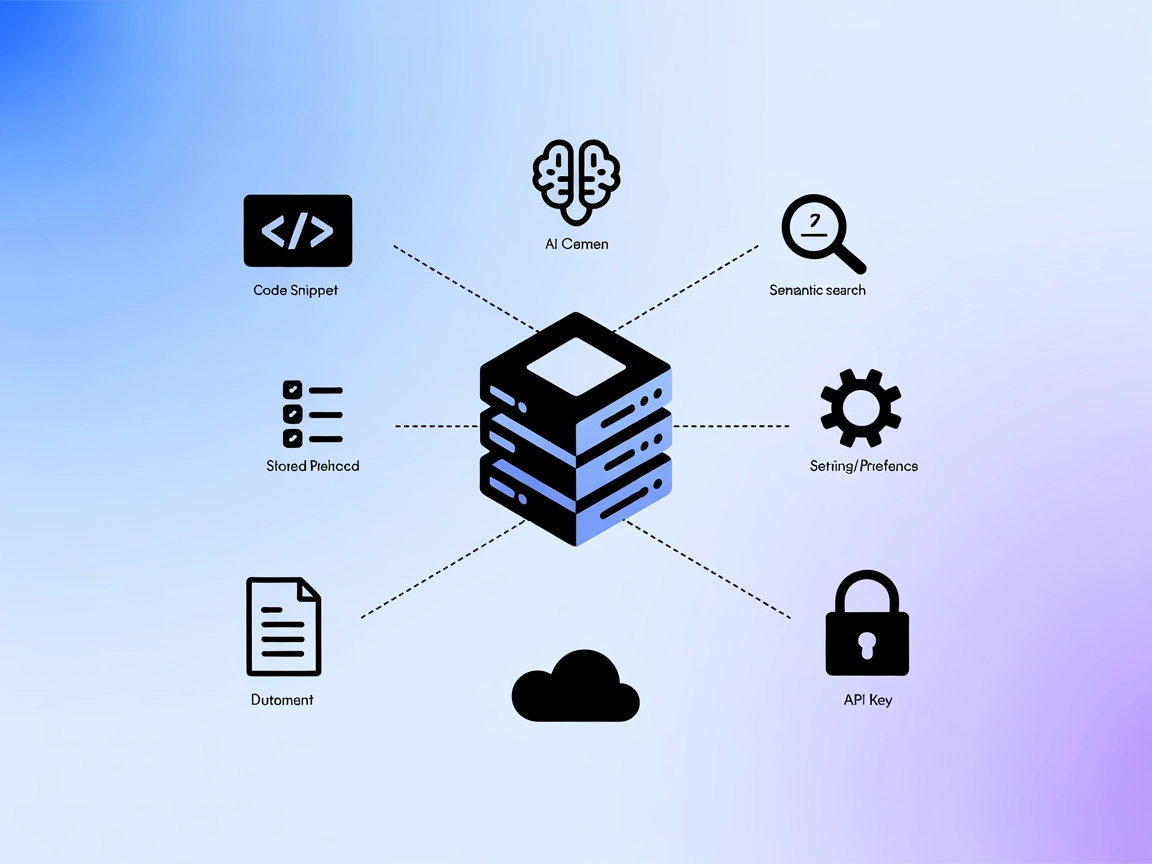

mem0 MCP Server zasila FlowHunt, oferując przechowywanie fragmentów kodu, semantyczne wyszukiwanie oraz solidną dokumentację developerską, usprawniając AI-driven coding workflows.

FlowHunt zapewnia dodatkową warstwę bezpieczeństwa między Twoimi systemami wewnętrznymi a narzędziami AI, dając Ci szczegółową kontrolę nad tym, które narzędzia są dostępne z Twoich serwerów MCP. Serwery MCP hostowane w naszej infrastrukturze można bezproblemowo zintegrować z chatbotem FlowHunt oraz popularnymi platformami AI, takimi jak ChatGPT, Claude i różne edytory AI.

mem0 MCP (Model Context Protocol) Server jest zaprojektowany do efektywnego zarządzania preferencjami kodowania poprzez połączenie asystentów AI ze strukturalnym systemem przechowywania, pobierania i wyszukiwania fragmentów kodu oraz kontekstu deweloperskiego. Działając jako warstwa pośrednia, umożliwia klientom AI interakcję z zewnętrznymi danymi—takimi jak implementacje kodu, instrukcje konfiguracji, dokumentacja czy dobre praktyki—za pomocą standaryzowanych narzędzi i endpointów. Główna rola serwera to usprawnienie procesów programistycznych poprzez funkcjonalności takie jak semantyczne wyszukiwanie, trwałe przechowywanie wytycznych kodowania czy pobieranie wzorców programistycznych, które można zintegrować z IDE lub agentami kodującymi wspieranymi przez AI. Zwiększa to produktywność zarówno pojedynczego programisty, jak i zespołu, ułatwiając dostęp do dobrych praktyk oraz wielokrotnego wykorzystania kodu.

W repozytorium ani dokumentacji nie wspomniano o szablonach promptów.

W repozytorium ani dokumentacji nie wymieniono jawnie zasobów MCP.

uv na swoim systemie..env.{

"mcpServers": {

"mem0-mcp": {

"command": "uv",

"args": ["run", "main.py"],

"env": {

"MEM0_API_KEY": "${MEM0_API_KEY}"

}

}

}

}

Uwaga: Zabezpiecz swój klucz API używając zmiennych środowiskowych, jak pokazano w sekcji env powyżej.

{

"mcpServers": {

"mem0-mcp": {

"command": "uv",

"args": ["run", "main.py"],

"env": {

"MEM0_API_KEY": "${MEM0_API_KEY}"

}

}

}

}

Uwaga: Wrażliwe dane przechowuj w zmiennych środowiskowych.

.env.uv run main.py.http://0.0.0.0:8080/sse).Przykład konfiguracji JSON:

{

"mcpServers": {

"mem0-mcp": {

"command": "uv",

"args": ["run", "main.py"],

"env": {

"MEM0_API_KEY": "${MEM0_API_KEY}"

}

}

}

}

Uwaga: Przechowuj klucz API bezpiecznie w zmiennych środowiskowych.

.env.{

"mcpServers": {

"mem0-mcp": {

"command": "uv",

"args": ["run", "main.py"],

"env": {

"MEM0_API_KEY": "${MEM0_API_KEY}"

}

}

}

}

Uwaga: Do zarządzania kluczem API używaj zmiennych środowiskowych.

Użycie MCP w FlowHunt

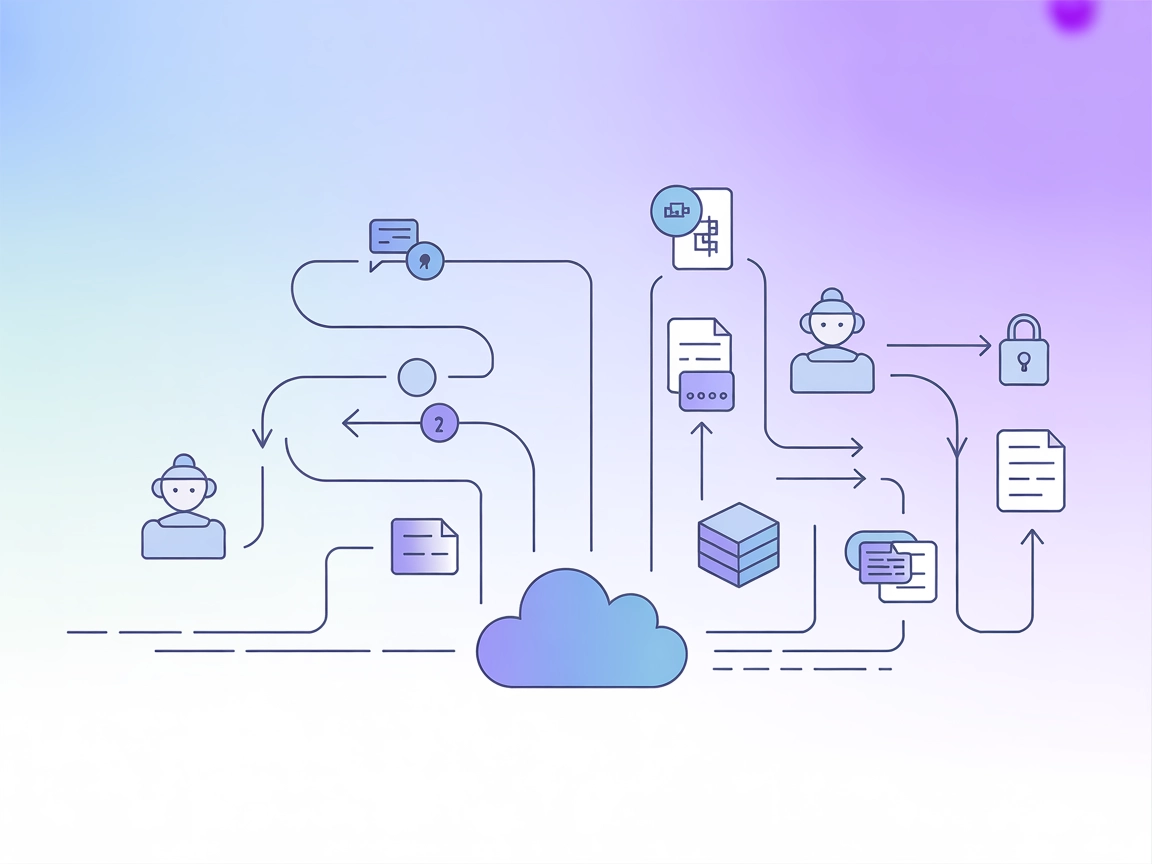

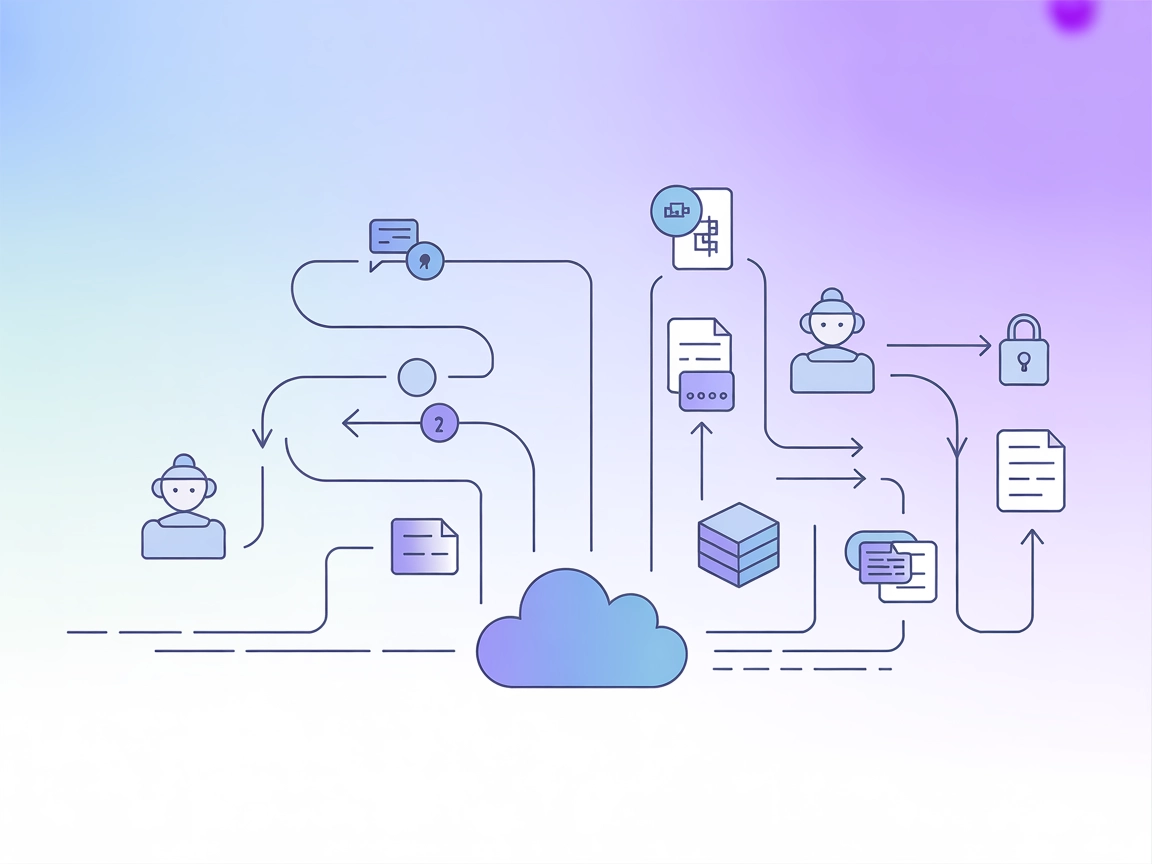

Aby zintegrować serwery MCP z workflow w FlowHunt, rozpocznij od dodania komponentu MCP do swojego flow i połącz go ze swoim agentem AI:

Kliknij komponent MCP, aby otworzyć panel konfiguracji. W sekcji konfiguracji MCP systemu wstaw szczegóły serwera MCP w poniższym formacie JSON:

{

"mem0-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po skonfigurowaniu agent AI otrzyma dostęp do wszystkich funkcji i możliwości tego MCP jako narzędzia. Pamiętaj, by zamienić “mem0-mcp” na aktualną nazwę swojego serwera MCP i podać własny adres URL serwera.

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | Krótkie wyjaśnienie dostępne w README.md |

| Lista promptów | ⛔ | Nie znaleziono szablonów promptów |

| Lista zasobów | ⛔ | Brak jawnych zasobów MCP |

| Lista narzędzi | ✅ | add_coding_preference, get_all_coding_preferences, search_coding_preferences |

| Zabezpieczenie klucza API | ✅ | Używa pliku .env i zaleca zmienne środowiskowe w przykładach JSON |

| Sampling Support (mniej istotne w ocenie) | ⛔ | Nie wspomniano |

Na podstawie dostępnych informacji, mem0-mcp oferuje czytelną definicję narzędzi i instrukcje instalacji, lecz brakuje mu jawnych szablonów promptów i zasobów oraz nie dokumentuje zaawansowanych funkcji MCP takich jak roots czy sampling. W efekcie jest funkcjonalny, lecz podstawowy pod względem kompletności protokołu.

| Licencja | ⛔ (brak pliku LICENSE) |

|---|---|

| Przynajmniej jedno narzędzie | ✅ |

| Liczba forków | 56 |

| Liczba gwiazdek | 339 |

Usprawnij procesy kodowania i uzyskaj zaawansowane możliwości AI w zakresie wyszukiwania, przechowywania i dokumentowania kodu dzięki mem0 MCP Server.

Membase MCP Server zapewnia lekką, zdecentralizowaną i trwałą pamięć dla agentów AI, łącząc ich z protokołem Membase opartym na Unibase. Umożliwia agentom bezpi...

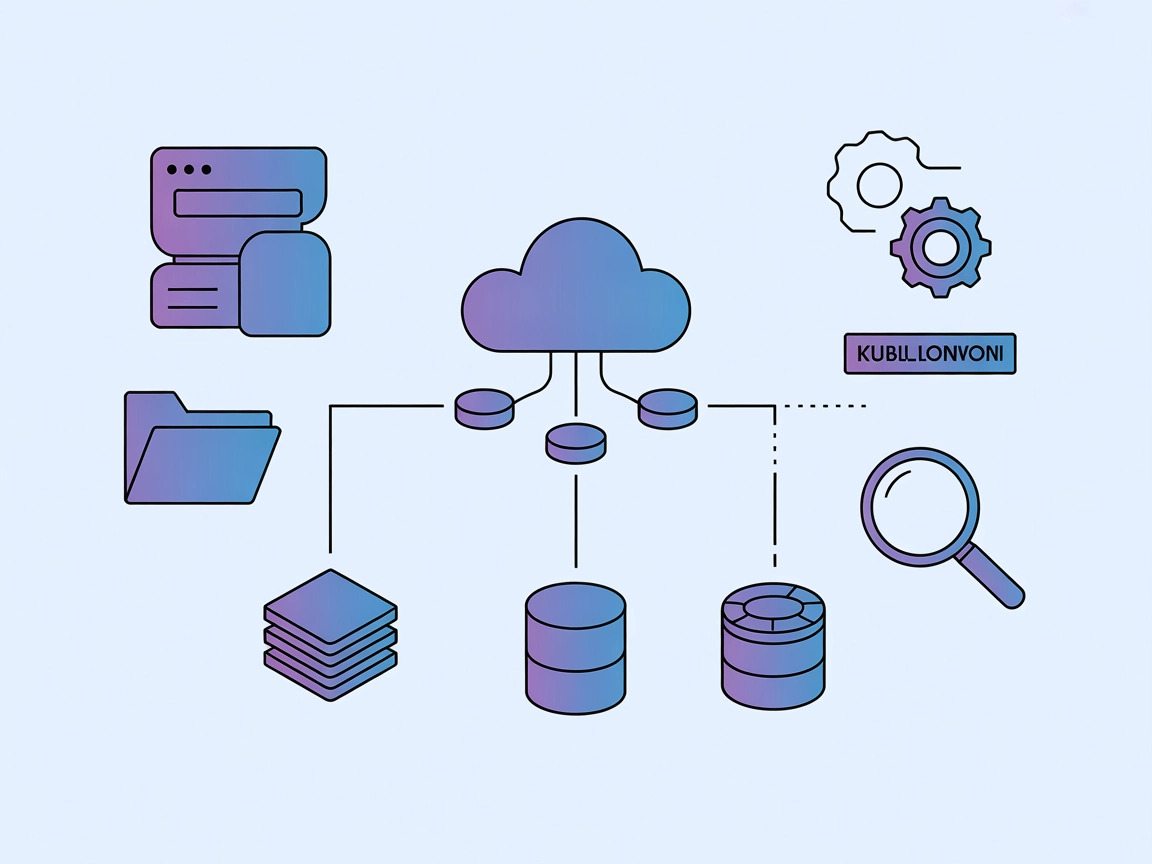

Kubernetes MCP Server łączy asystentów AI z klastrami Kubernetes/OpenShift, umożliwiając programistyczne zarządzanie zasobami, operacje na podach oraz automatyz...

Rememberizer MCP Server łączy asystentów AI z zarządzaniem wiedzą, umożliwiając semantyczne wyszukiwanie, zunifikowane pobieranie dokumentów i współpracę zespoł...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.